Datenschutz & Sicherheit

„Wir haben das Recht auf unserer Seite“

Daten sind das Herzstück von Plattformen wie YouTube, TikTok und Instagram. Dabei geht es nicht nur um die Inhalte wie Videos oder Fotos, sondern vor allem auch um die Daten der Nutzer:innen: Was klicken sie an? Mit welchen Inhalten interagieren sie? Was läuft in Dauerschleife?

Wie ihre Empfehlungssysteme horten Google, ByteDance, Meta und Co. diese Daten und geben sie nur ungern preis. Doch es ist möglich, an sie heranzukommen – für Forschende und auch Nutzer:innen selbst. Wie das funktioniert und welche Hürden auf dem Weg liegen, haben David Wegmann und LK Seiling auf dem 39. Chaos Communication Congress präsentiert.

Die Datenschutzgrundverordnung verhilft zum persönlichen Datensatz

Das wohl bekannteste Werkzeug, um an die eigenen Daten heranzukommen, ist die Datenschutzgrundverordnung (DSGVO). Gemäß Artikel 15 hat eine Person das Recht, über sie verarbeitete Daten, Verarbeitungszwecke und andere Informationen von einem Datenverarbeiter zu erhalten.

Wegmann nutzte dieses Recht für seine Forschung zur Rolle von YouTube im demokratischen Diskurs. Dabei griff er auf Datenspenden von 1.064 Dän:innen zurück, die ihm ihre YouTube-Daten zur Verfügung stellten. Die Daten erhielt er, nachdem er 40.000 Personen um eine Datenspende gebeten hatte, berichtete er in dem Vortrag.

Dabei wurden auch die Probleme mit dem Datenzugang klar: Der Weg, die eigenen Daten herunterzuladen, ist nicht immer leicht. Bei großen Anbietern wie Google gibt es meist Möglichkeiten, über die Plattform direkt die Daten anzufordern. Bei anderen Diensten bekommen Nutzende teils erst auf mehrmalige Nachfrage Auskünfte auf Papier.

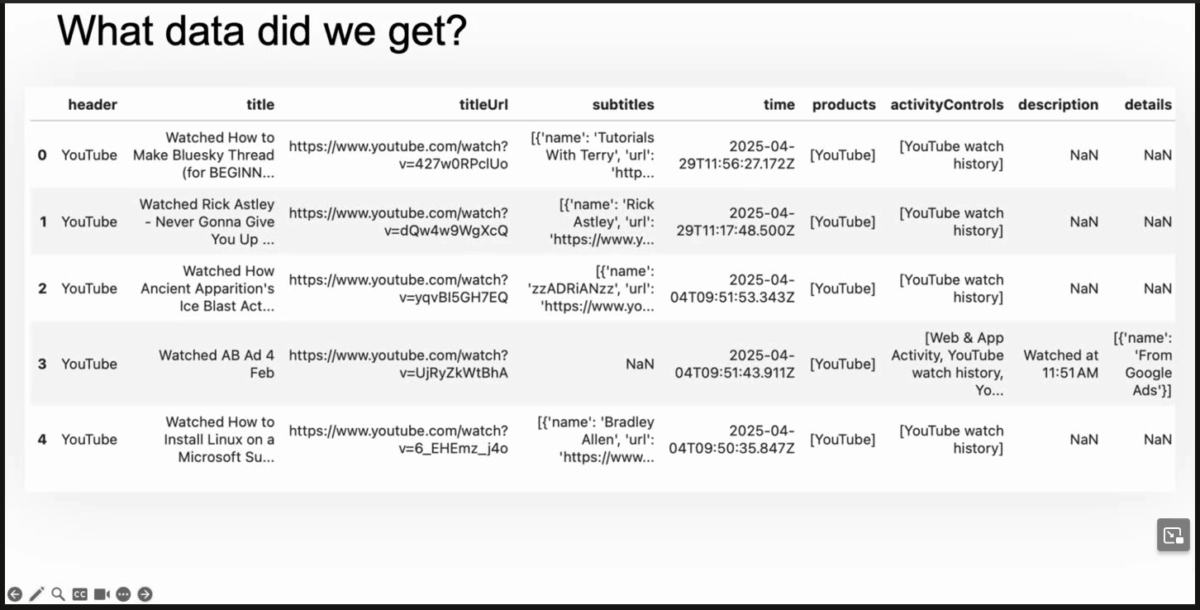

Doch selbst wenn die Daten wie bei YouTube digital über ein Online-Interface zur Verfügung stehen, bleibt es oft kompliziert: Unübersichtliche Dateien, Tabellen mit unklaren Spaltenbezeichnungen und die generelle Menge an Daten führen schnell zu Überforderung. Teils sind nicht alle Informationen enthalten, bei YouTube etwa, wie lange ein bestimmtes Video abgespielt wurde.

Ein weniger bekannter Weg für Nutzende, die eigenen Daten zu erhalten, geht über den Digital Markets Act, der besonders sogenannte Gatekeeper-Unternehmen im Blick hat. Er begründet für Nutzende das Recht auf Datenportabilität, damit es ihnen möglich ist, Anbieter zu wechseln, ohne ihre gesamten Daten bei einem anderen Dienst zu verlieren.

Datenauskünfte nach dem Digital Services Act geben andere Informationen

Nicht Betroffene selbst, aber Forschende können über den Digital Services Act (DSA) Daten von sehr großen Online-Plattformen anfordern. Seiling unterstützte Wegmann dabei, einen Antrag bei Google zu stellen.

Seiling sagt gegenüber netzpolitik.org: „Grundsätzlich gibt es im DSA zwei Arten von Forschungsdatenzugang. Einmal für öffentlich verfügbare Daten in Artikel 40 (12) und für allgemeine Daten in Artikel 40 (4).“ Bei Ersterem sollen Plattform-Anbieter Forschenden Zugang zu öffentlich zugänglichen Daten ihrer Dienste geben, um systemische Risiken zu erforschen. Bei Letzterem geht es um privilegierten Zugang zu Daten, die teilweise nicht öffentlich sind und die ebenfalls zur Risikoerforschung genutzt werden sollen. Das können beispielsweise Informationen zu Moderationsentscheidungen sein. Dafür sind die Hürden höher, der Antrag auf Zugang zu diesen Daten läuft nicht über die Plattformen direkt, sondern über den jeweils zuständigen nationalen Koordinator für Digitale Dienste.

Da der DSA und das darin verbriefte Recht auf Datenzugang noch vergleichsweise neu sind, gibt es teilweise noch Unklarheiten, was Antragsprozesse oder den Umfang der entsprechenden Daten angeht.

„Der DSA spezifiziert nicht genau, was mit öffentlich verfügbaren Daten gemeint ist“, sagt Seiling gegenüber netzpolitik.org. „Meiner Auffassung nach müsste das auch Informationen zum Plattformdesign oder Inhaltsdaten etwa von Videos betreffen. Aber es ist noch nicht klar, wo genau da die Grenze verläuft.“

Wir sind ein spendenfinanziertes Medium

Unterstütze auch Du unsere Arbeit mit einer Spende.

Für Wegmann waren die Hürden des Antragsprozesses zu den öffentlich verfügbaren Daten ein Problem. „Google verlangt, dass man beweist, dass man die Daten supersicher aufbewahren kann und will technische Details zur Speicherung wissen. Wir speichern die nun mit den gleichen Vorkehrungen wie die Patient:innendaten der medizinischen Fakultät“, so der Forscher.

Dass im Vorfeld nicht klar sei, welche Bedingungen man für den Datenzugang erfüllen müsse, sei ein Problem für Wissenschaftler:innen. „Das hat mich Wochen an Arbeit gekostet, all diese Informationen herauszubekommen“, berichtet Wegmann.

Was ist Forschung?

Eine weitere Hürde liegt in der Frage, wer überhaupt laut dem Gesetz als „Forscher“ gilt. Für den Zugang zu öffentlichen Daten muss man nicht an eine Forschungseinrichtung angeschlossen sein. Aber dennoch muss der Antragstellende neben den technischen Voraussetzungen nachweisen, dass die Forschung „unabhängig von kommerziellen Interessen“ ist und seine Finanzierung offenlegen.

Gerade derartig aufwendige Nachweisprozesse dürften für zivilgesellschaftliche Forschung eine Hürde darstellen, insbesondere dann, wenn sie sich über lange Zeiträume hinziehen.

Trotz der bestehenden Hindernisse sehen Wegmann und Seiling in den Datenzugangsrechten wichtige Werkzeuge. „Mir ist wichtig, dass die Hackercommunity versteht, dass wir das Recht auf unserer Seite haben“, sagt Seiling. „Das ist nicht zu unterschätzen.“ Indem über den Datenzugang Probleme identifiziert werden, ließen sich vielleicht auch Plattformen dazu bringen, Umbauten vorzunehmen. Und so steht auch auf ihrer Schlussfolie zum Vortrag die Aufforderung: „Du kannst [die Datenauskunftsrechte] nutzen, um Tech-Plattformen zur Verantwortung zu ziehen.“

Gerade weil diese Rechte ein mächtiges Werkzeug sind, ist es wichtig, sie aktiv zu nutzen und zu verteidigen. Auch gegen Bestrebungen der EU-Kommission, etwa im Digitalen Omnibus die Selbstauskünfte nach der DSGVO einzuschränken. Und so warnt Wegmann davor, dass Datenauskunftsrechte und andere Rechte zur Verhandlungsmasse gemacht werden, auch auf Druck der USA, die sich gegen europäische Tech-Regulierung stemmen.

Datenschutz & Sicherheit

Pi-hole: Update schließt Sicherheitslücken und liefert mehr Performance

Der DNS-basierte Werbeblocker Pi-hole stopft in aktualisierter Fassung zwei Sicherheitslücken. Außerdem haben die Programmierer Änderungen umgesetzt, die der Performance insbesondere auf älteren Raspberry Pis auf die Sprünge helfen.

Weiterlesen nach der Anzeige

In einem Blog-Beitrag auf der Pi-hole-Webseite haben die Entwickler die neuen Versionen der Komponenten angekündigt. Die darin geschlossenen Sicherheitslücken betreffen das Web-Interface von Pi-hole. Zum einen hätten als Admin angemeldete Angreifer eine „Stored HTML-Injection“-Schwachstelle missbrauchen können, um HTML-Code einzuschleusen, der bei der Anzeige der DNS-Eintragstabelle angezeigt wird (CVE-2026-26952, CVSS 5.4, Risiko „mittel“). Zum anderen gelingt dies auch auf der API-Einstellungswebseite (CVE-2026-26953, CVSS 5.4, Risiko „mittel“).

Aktualisierte Pi-hole-Komponenten

Die aktuellen Pi-hole-Komponenten FTL 6.5, Web 6.4.1 und Core 6.4 stopfen die Sicherheitslecks in der Web-Oberfläche. Wer Pi-hole einsetzt, sollte generell sicherstellen, dass die Web-GUI nicht offen im Internet steht und gegebenenfalls den Zugriff auf die Admin-Rechner beschränken.

Die aktualisierten Teile von Pi-hole haben jedoch noch mehr zu bieten. Die Performance haben die Entwickler nach eigenen Angaben darin verbessert. Das Starten geht nun schneller, da FTL den Anfragenverlauf asynchron aus der Datenbank importiert. Bislang blieb die DNS-Auflösung blockiert, bis der komplette Anfrageverlauf in den Speicher geladen wurde. Jetzt akzeptiert FTL Anfragen umgehend und importiert die alten Daten in einem Hintergrund-Thread. Um die Konsistenz sicherzustellen, startet der Garbage Collector erst, wenn der Import abgeschlossen wurde.

Lesen Sie auch

Außerdem bringt die neue Konfigurationsoption database.forceDisk FTL dazu, die eigentlich im Speicher vorgehaltene SQLite3-Datenbank auf das Speicherlaufwerk zu verfrachten. Das reduziert den Speicherverbrauch und ist insbesondere auf älteren Raspberry Pis hilfreich. Die Programmierer weisen darauf hin, dass das besonders für Pi-hole-Instanzen taugt, deren Web-Interface nur selten genutzt wird. Wo lediglich SD-Karten genutzt werden, sorgt das unter Umständen für Geschwindigkeitseinbußen, auf Systemen mit NVMe-Laufwerk waren jedoch keine Unterschiede messbar. Der Standardwert ist „false“, lässt sich aber etwa mittels Aufruf von sudo pihole-FTL --config database.forceDisk true aktivieren.

Zudem soll das Update der Blocklisten, also des Gravity-Systems, zügiger ablaufen. Die Domain-Prüfungsschleife ist nun effizienter – Tests mit fünf Millionen Einträgen aus mehreren Listen senkten die Update-Zeit von 27 auf 23 Sekunden, was einem Geschwindigkeitsgewinn von 16 Prozent Echtzeit entspricht – bei der CPU-Zeit sogar um 22 Prozent.

Weiterlesen nach der Anzeige

Der praktische Test über wenige Tage auf einem Raspberry Pi Zero W zeigt, dass die Entwickler nicht zu viel versprechen. Wo sonst täglich mehrere Warnungen über zu hohe Systemlast in Pi-hole auftauchten, schnurrt das System nun ohne derartige Beschwerden und größere Auslastung vor sich hin. Bestehende Installationen lassen sich durch den Aufruf von „sudo pihole -up“ auf den aktuellen Stand bringen.

Vor einem Jahr hatten die Pi-hole-Entwickler die Major-Version 6 veröffentlicht. Auch diese sollte bereits die DNS-Filtersoftware verschlanken. Die nun veröffentlichten Updates legen insbesondere in diesem Belang jedoch spürbar nach.

(dmk)

Datenschutz & Sicherheit

Roundcube Webmail: Angriffe auf Sicherheitslücken laufen

Die US-amerikanische IT-Sicherheitsbehörde CISA warnt vor Angriffen auf die quelloffene Software Roundcube Webmail. Es handelt sich um eine kritische und eine hochriskante Schwachstelle, die Kriminelle nun offenbar ins Visier nehmen.

Weiterlesen nach der Anzeige

Die Warnung der CISA ist wie üblich äußerst knapp. Angriffe wurden demnach auf eine Schwachstelle bei der Deserialisierung von nicht vertrauenswürdigen Daten (CVE-2025-49113, CVSS 9.9, Risiko „kritisch“) sowie eine Cross-Site-Scripting-Lücke (CVE-2025-68461, CVSS 7.2, Risiko „hoch“) beobachtet. Wie die Angriffe aussehen und in welchem Umfang sie erfolgen, bleibt unklar. IT-Verantwortliche sollten jedoch nicht zögern und auf die jüngste fehlerbereinigte Fassung von RoundCube Webmail aktualisieren.

Die als „kritisch“ eingestufte Sicherheitslücke wurde vom NIST lediglich mit einem CVSS-Wert von 8.8 als hohes Risiko verortet. Allerdings tauchte Anfang Juni vergangenen Jahres bereits ein Beispiel-Exploit auf, der den Missbrauch der Lücke demonstriert. Angreifer können durch die Schwachstelle beliebige Befehle auf verwundbaren Systemen ausführen. Dazu ist ein gültiges Mailkonto nötig. Diese Sicherheitslücke hat Roundcube Webmail 1.5.10 und 1.6.11 geschlossen.

Roundcube Webmail: Zwei attackierte Sicherheitslücken

Die zweite Sicherheitslücke wurde kurz vor Weihnachten bekannt. Sie ermöglicht Cross-Site-Scripting-Angriffe. Die Schwachstelle betrifft die Verarbeitung des „Animate“-Tag in SVG-Dateien. Auch hier hat das NIST zunächst eine Einstufung als mittleres Risiko mit einem CVSS-Wert von 6.1 abgegeben, MITRE hingegen sieht ein hohes Risiko mit der Gefahrenstufe „hoch“ und einem CVSS-Wert 7.2. Die beobachteten Angriffe sprechen offenbar für letztere Einschätzung.

IT-Verantwortliche sollten ihre Systeme absichern, indem sie zumindest auf die fehlerkorrigierten Versionen 1.5.12 und 1.6.12 installieren. Darin haben die Entwickler die Cross-Site-Scripting-Lücke geschlossen. Hinweise für erfolgreiche Angriffe (Indicators of Compromise, IOCs) liefert die CISA ebenfalls nicht, mit denen Admins prüfen könnten, ob ihre Instanzen attackiert wurden.

(dmk)

Datenschutz & Sicherheit

Anthropic launcht Claude Code Security – Cybersecurity-Aktien verlieren

Anthropic hat mit „Claude Code Security“ eine neue Funktion vorgestellt, die direkt in die webbasierte Version von Claude Code integriert ist. Das Werkzeug durchsucht Codebasen nach Sicherheitslücken und schlägt gezielte Software-Patches zur menschlichen Überprüfung vor, wie das Unternehmen auf seiner Website mitteilt. Die Funktion steht zunächst als limitierte Research Preview für Enterprise- und Team-Kunden zur Verfügung. Maintainer von Open-Source-Projekten können einen kostenlosen und beschleunigten Zugang beantragen.

Weiterlesen nach der Anzeige

Laut der Ankündigung von Anthropic soll das Werkzeug ein grundlegendes Problem in der IT-Sicherheit angehen: Es gebe zu viele Software-Schwachstellen und zu wenig Fachleute, die sich darum kümmern könnten. Während sich viele Analysetools auf die Suche nach bekannten Mustern konzentrieren, nutzen Angreifer immer häufiger subtile, kontextabhängige Sicherheitslücken aus.

Kontextbasierte Analyse statt Musterabgleich

Die weitverbreitete statische Codeanalyse arbeitet laut Anthropic regelbasiert: Sie gleicht Code mit bekannten Schwachstellenmustern ab und findet so etwa offengelegte Passwörter oder veraltete Verschlüsselung. Komplexere Fehler – etwa in der Geschäftslogik oder bei Zugriffskontrollen – blieben dabei jedoch oft unerkannt.

Claude Code Security verfolge einen anderen Ansatz: Statt nach bekannten Mustern zu suchen, lese und analysiere die KI den Code so, wie es ein menschlicher Sicherheitsverantwortlicher tun würde. Das System untersucht, wie Komponenten zusammenwirken und wie Daten durch eine Anwendung fließen. Jeder Fund durchlaufe einen mehrstufigen Verifikationsprozess. Laut der Ankündigung von Anthropic überprüfe Claude zudem seine eigenen Ergebnisse, versuche sie zu bestätigen oder zu widerlegen und filtere Falschmeldungen heraus. Den verbleibenden Funden ordne das System Schweregrade und Konfidenzwerte zu.

Die validierten Ergebnisse stellt das Werkzeug in einem Dashboard bereit, in dem Security-Teams die vorgeschlagenen Patches prüfen und freigeben können. Ohne menschliche Zustimmung werde nichts angewendet – die letzte Entscheidung liege stets bei den Entwicklern, betonen die Anthropic-Verantwortlichen.

Über 500 Schwachstellen in Open-Source-Projekten gefunden

Weiterlesen nach der Anzeige

Anthropic stellt Claude Code Security als Ergebnis von mehr als einem Jahr Forschung dar. Das hauseigene Frontier Red Team habe die Cybersecurity-Fähigkeiten von Claude systematisch getestet – unter anderem in Capture-the-Flag-Wettbewerben und in einer Partnerschaft mit dem Pacific Northwest National Laboratory zum Schutz kritischer Infrastruktur.

Mit dem Anfang des Monats veröffentlichten Modell Claude Opus 4.6 habe das Team nach eigenen Angaben über 500 Schwachstellen in produktiv genutzten Open-Source-Codebasen gefunden – Fehler, die trotz jahrzehntelanger Experten-Reviews unentdeckt geblieben seien. Die Offenlegung an die jeweiligen Maintainer laufe derzeit noch. Das Unternehmen nutze Claude auch zur Überprüfung des eigenen Codes und habe das Werkzeug dabei als „extrem effektiv“ eingestuft. Claude Code Security solle diese Fähigkeiten nun einem breiteren Anwenderkreis zugänglich machen.

In diesem Zuge räumt Anthropic allerdings ein, dass dieselben Fähigkeiten, die Verteidigern helfen, auch Angreifern nützen könnten. Claude Code Security solle jedoch gezielt Verteidiger dabei unterstützen, Code gegen eine „neue Kategorie KI-gestützter Angriffe“ zu schützen.

Kurse von Cybersecurity-Aktien brechen deutlich ein

Die Ankündigung hatte unmittelbare Auswirkungen an der Börse. Laut Bloomberg fielen die Aktienkurse zahlreicher Cybersecurity-Unternehmen am 20. Februar 2026 deutlich. So verloren etwa die Papiere von CrowdStrike 8 Prozent, Cloudflare 8,1 Prozent, Zscaler 5,5 Prozent, SailPoint 9,4 Prozent und Okta 9,2 Prozent. Der Global X Cybersecurity ETF gab um 4,9 Prozent nach und schloss damit auf dem niedrigsten Stand seit November 2023.

Der Ausverkauf reiht sich Bloomberg zufolge in einen breiteren Trend ein: Der iShares Expanded Tech-Software Sector ETF hat seit Jahresbeginn rund 23 Prozent verloren und steuert auf seinen größten prozentualen Quartalsrückgang seit der Finanzkrise 2008 zu. Viele Investoren fürchten demnach, dass die Möglichkeit des sogenannten „Vibe Codings“ – also der KI-gestützten Softwareentwicklung – die Nachfrage nach etablierten Softwareprodukten verringern und das Wachstum, die Margen sowie die Preisgestaltung der Anbieter unter Druck setzen könnte.

Analysten: Kurzfristiger Gegenwind, langfristig Chancen

„Es gibt einen stetigen Abverkauf bei Software, und heute trifft es die Security-Branche mit einem Mini-Flash-Crash auf eine Schlagzeile“, sagte Dennis Dick, Head Trader bei Triple D Trading, gegenüber Bloomberg. „Diese Art von Markt ist beängstigend für Investoren, weil die Kurse unerbittlich nach unten gehen, sobald auch nur ein Hauch von Disruption auftaucht.“

Jefferies-Analyst Joseph Gallo erwartet laut Bloomberg hingegen, dass der Cybersecurity-Sektor letztlich ein Netto-Gewinner durch KI sein werde. Allerdings dürften sich Rückschläge durch „Schlagzeilen“ zunächst noch verstärken, bevor Klarheit herrsche und sich die Absicherung von KI-Systemen selbst als Wachstumstreiber für die Branche auszahle. Die mittel- bis langfristigen Implikationen von Anthropics Ankündigung seien, dass KI-Anbieter weitere Produkte auf den Markt bringen und um zusätzliche Cybersecurity-Budgets konkurrieren würden.

Anthropic hat in den vergangenen Monaten die Fähigkeiten von Claude kontinuierlich ausgebaut – von der Veröffentlichung von Claude Sonnet 4.6 mit einem Kontextfenster von einer Million Token bis hin zur Bereitstellung von Claude Code als webbasierte Plattform. Unterdessen befeuert der Abgang eines leitenden IT-Sicherheitsforschers bei Anthropic die Bedenken gegen den zunehmenden Einsatz von KI und die Gefahren durch deren Missbrauch.

(map)

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 2 Wochen

Social Mediavor 2 WochenCommunity Management zwischen Reichweite und Verantwortung

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenFast 5 GB pro mm²: Sandisk und Kioxia kommen mit höchster Bitdichte zum ISSCC

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenHuawei Mate 80 Pro Max: Tandem-OLED mit 8.000 cd/m² für das Flaggschiff-Smartphone

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenKommentar: Anthropic verschenkt MCP – mit fragwürdigen Hintertüren

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenSyncthing‑Fork unter fremder Kontrolle? Community schluckt das nicht

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenGame Over: JetBrains beendet Fleet und startet mit KI‑Plattform neu