UX/UI & Webdesign

KI-Bildgenerierung mit ChatGPT Images 2.0: Praxis-Guide

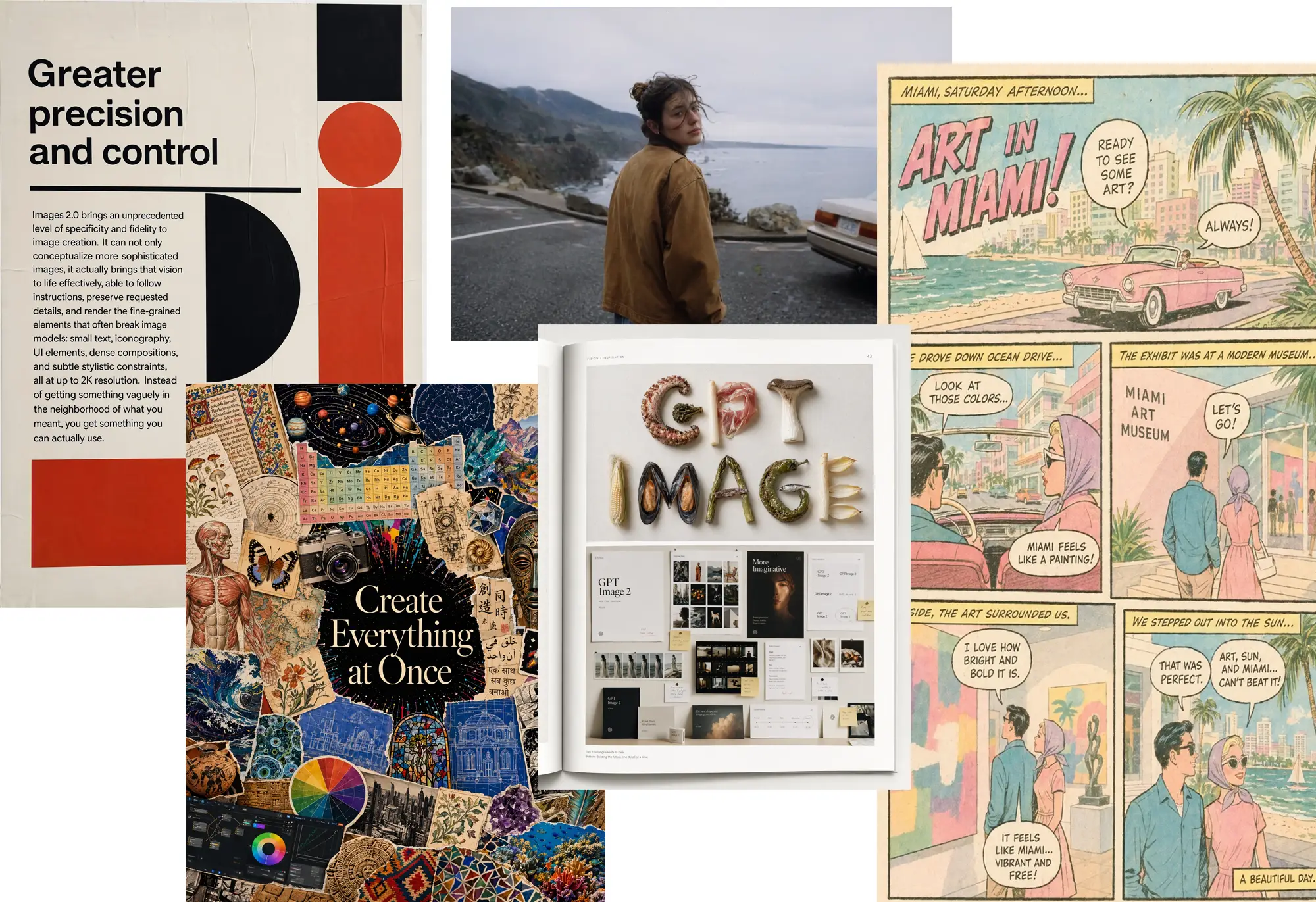

Lesbare Headlines, präzise Layouts, mehrsprachige Schrift, schnelle Iterationen – ChatGPT Images 2.0 hebt die KI-Bildgenerierung auf ein neues Niveau. Hier erfährst du, wie das Modell funktioniert, welche Features für deine Arbeit wirklich relevant sind und mit welchen Prompts und Workflows du das Beste aus dem Tool herausholst.

Jeder, der schon einmal versucht hat, lesbare Schrift in ein KI-Bild zu bekommen, kennt das Phänomen. Diese Schwäche war nicht nur ein nettes Detail am Rande, sie war für viele professionelle Nutzer der Hauptgrund, KI-Bildgeneratoren konsequent links liegen zu lassen.

Mit ChatGPT Images 2.0, von OpenAI am 21. April 2026 veröffentlicht, ist genau diese Hürde gefallen. Und mehr als das. Der eigentliche Sprung liegt nicht in der reinen Bildqualität, sondern in einem Architekturwechsel, der das Verständnis davon verändert, wofür ein Bildgenerator gut ist.

Höchste Zeit also, einmal genauer hinzuschauen, was dieses Werkzeug für deine tägliche Arbeit als Webdesigner bedeutet.

Was ist ChatGPT Images 2.0?

ChatGPT Images 2.0 ist OpenAIs neues Bildgenerierungsmodell, intern als GPT-Image-2 bezeichnet. Es ersetzt die bisherigen Generationen vollständig und übernimmt damit die gesamte Bildproduktion innerhalb von ChatGPT.

OpenAI geht sogar so weit, die etablierten Modelle DALL-E 2 und DALL-E 3 zum 12. Mai 2026 abzuschalten. Wer bislang mit diesen Modellen gearbeitet hat, muss umsteigen, ein Fallback ist nicht vorgesehen.

Diese Konsequenz unterstreicht, wie stark OpenAI auf das neue Modell setzt. Innerhalb weniger Stunden nach dem Launch hat sich Images 2.0 die Spitzenpositionen auf allen drei Image-Arena-Leaderboards gesichert, also bei der reinen Bildgenerierung, bei der Bearbeitung einzelner Bilder und beim Multi-Image-Editing.

Mit einem ELO-Wert von 1512 in der Text-to-Image-Kategorie liegt es 242 Punkte vor dem nächsten Konkurrenten Nano Banana 2. Solche Abstände sind im KI-Bildbereich bisher nicht vorgekommen und deuten darauf hin, dass hier mehr passiert ist als ein üblicher Versionssprung.

Für dich als Nutzer wichtig: Die Basisversion (Instant Mode) ist kostenlos und steht allen ChatGPT-Nutzern zur Verfügung. Eine erweiterte Variante (Thinking Mode) bleibt zahlenden Abonnenten vorbehalten. Dazu gleich mehr.

Die Eckdaten auf einen Blick

- Release: 21. April 2026 durch OpenAI

- Internes Modell: GPT-Image-2

- Abschaltung von DALL-E 2 und 3: 12. Mai 2026

- Verfügbarkeit: kostenlos im Instant Mode, erweiterte Funktionen im Thinking Mode für Abonnenten

- Standardauflösung: 2K, optional 4K über die API-Beta

- Seitenverhältnisse: von 3:1 bis 1:3

- Sprachen: Latein, Chinesisch, Japanisch, Koreanisch, Hindi, Bengalisch, Arabisch

Der technische Bruch im Hintergrund

Um zu verstehen, warum dieser Versionssprung so deutlich ausfällt, hilft ein Blick auf die Architektur. Bisherige Bildgeneratoren, egal ob DALL-E 3, Midjourney oder Stable Diffusion, arbeiten nach dem Diffusionsprinzip. Sie starten mit einem zufälligen Pixelrauschen und entfernen dieses Rauschen schrittweise, bis ein kohärentes Bild entsteht. Das Verfahren liefert ästhetisch starke Ergebnisse, hat aber eine systembedingte Schwäche bei Schrift.

In jedem Trainingsbild macht der eigentliche Text nur einen winzigen Teil der Pixel aus. Auf einem Foto eines Cafés sehen wir vielleicht tausende Pixel an Wänden, Möbeln und Licht, aber nur einen schmalen Streifen für das „Geöffnet“-Schild an der Tür. Die Modelle haben deshalb gelernt, das Aussehen von Schrift zu imitieren, ohne deren Struktur zu verstehen. Sie wissen, dass auf einem Schild Formen vorkommen, die Buchstaben ähneln. Ob die „4“ oder die „9“ gemeint ist, bleibt für sie reine Pixelanordnung.

ChatGPT Images 2.0 wählt einen anderen Weg. Das Modell arbeitet autoregressiv, also ähnlich wie ein Sprachmodell beim Texten.

Es erzeugt Bilder Token für Token, jedes Token basiert auf dem vorherigen. Schrift und Bildinhalt laufen durch dieselbe Verarbeitungspipeline. Wenn du um ein Plakat mit dem Schriftzug „Sommerfest 2026“ bittest, malt das Modell nicht Formen, die wie diese Buchstaben aussehen. Es konstruiert die Wörter mit derselben Sorgfalt, die es auch in einer Textantwort verwenden würde.

Dazu kommt eine Reasoning-Schicht. Erstmals plant ein Bildmodell die Komposition, bevor der erste Pixel entsteht. Es analysiert deinen Prompt, überlegt das Layout, kann Informationen aus dem Web ziehen und sich selbst korrigieren. Das Ergebnis ist eine laut OpenAI selbst gemessene Textgenauigkeit von 99 Prozent, gegenüber 90 bis 95 Prozent bei der Vorgängerversion. Unabhängige Tests bestätigen diese Werte weitgehend, sowohl für lateinische als auch für ostasiatische Schriften.

Die Schrift wirkt nicht mehr wie ein Aufkleber, der über das Bild gelegt wurde.

Das Modell behandelt Typografie als gestalterisches Element.

Die wichtigsten Features im Überblick

Textdarstellung auf Produktionsniveau

Das ist die Eigenschaft, die alles verändert. Du kannst inzwischen vollständige Magazintitel mit korrekt geschriebenen Headlines erzeugen, Produktverpackungen mit echten Markennamen, wissenschaftliche Diagramme mit präzisen Beschriftungen oder eben jene Speisekarte, die jetzt tatsächlich funktioniert.

Wichtiger noch:

Die Schrift wirkt nicht mehr wie ein Aufkleber, der über das Bild gelegt wurde. Das Modell behandelt Typografie als gestalterisches Element, kümmert sich um Hierarchie, Größe und Platzierung wie eine Designerin es tun würde.

Mehrsprachige Schriftsysteme

Während frühere Modelle schon mit deutschen Umlauten ihre Probleme hatten, beherrscht ChatGPT Images 2.0 inzwischen Chinesisch, Japanisch (sowohl Kanji als auch Hiragana), Koreanisch, Hindi, Bengalisch und Arabisch.

Für internationale Webprojekte oder Kunden mit Zielmärkten in Asien öffnet das einen Bereich, der bisher praktisch verschlossen war. Eine Verpackung in Mandarin, eine Social-Kampagne in Hindi, ein UI-Mockup in Japanisch, all das ist nun ohne aufwendige manuelle Korrekturschritte machbar.

Auflösung und Seitenverhältnisse

Standardmäßig liefert das Modell 2K-Auflösung (2048 Pixel), 4K ist über die API als Beta verfügbar. Die unterstützten Seitenverhältnisse reichen von 3:1 (extrabreite Banner) bis 1:3 (hochkant für Pinterest oder Instagram Stories).

Wer noch mit GPT Image 1.5 gearbeitet hat, erinnert sich vermutlich an die Beschränkung auf 1:1, 3:2 und 2:3. Jeder YouTube-Thumbnail brauchte einen manuellen Crop hinterher. Dieser Schritt entfällt jetzt.

Bessere Anweisungstreue

Räumliche Vorgaben wie „drei identische Roboter in einer Reihe“ oder „die rote Tasse links neben dem Laptop“ liefern endlich das, was du gefragt hast. Mehrfach-Bearbeitungen funktionieren in einem einzigen Durchlauf.

Du kannst den Schriftzug ändern, ein Etikett austauschen und die Hintergrundfarbe anpassen, alles im gleichen Prompt. Objekte lassen sich beim Namen nennen („entferne die Person mit der blauen Jacke“), du brauchst keine manuellen Masken oder umständliche Beschreibungen mehr.

Geschwindigkeit und Farbtreue

Bis zu viermal schneller als der Vorgänger. Das mag wie ein technisches Detail klingen, ändert aber das Nutzungsverhalten erheblich (siehe Kapitel zu den Workflows). Außerdem hat OpenAI den deutlichen Gelbstich der Vorgängerversion behoben. Farben wirken jetzt natürlicher und entsprechen besser dem, was du im Prompt beschreibst.

Instant Mode oder Thinking Mode?

Beim Einsatz von ChatGPT Images 2.0 hast du die Wahl zwischen zwei Betriebsarten. Der Instant Mode ist kostenlos und steht allen Nutzern zur Verfügung. Er liefert schnelle Ergebnisse und reicht für die meisten Standardaufgaben aus, etwa für ein Headerbild, eine schnelle Variante eines Mockups oder ein Social-Media-Visual.

Der Thinking Mode ist zahlenden Abonnenten vorbehalten und nutzt die volle Reasoning-Schicht des Modells. Hier nimmt sich das System Zeit, durchdenkt die Bildstruktur, kann Informationen aus dem Web einbeziehen, hochgeladenes Material in visuelle Erklärstücke verwandeln und mehrere Bilder gleichzeitig erzeugen, bei denen Charaktere oder Objekte konsistent bleiben.

Die Faustregel: Für einzelne Assets reicht der Instant Mode. Sobald du einen kompletten Kampagnen-Satz brauchst, in dem dieselbe fiktive Person über mehrere Bilder hinweg auftaucht, oder wenn du komplexe Layouts mit verifizierten Daten erzeugen willst, lohnt sich der Wechsel in den Thinking Mode.

Anwendungsbereiche für deine Webdesign-Praxis

UI-Mockups mit echten Inhalten

Statt mit Lorem-Ipsum-Buttons zu kämpfen, kannst du Mockups mit realistischen Beschriftungen erzeugen. „Jetzt Termin buchen“, „Mehr erfahren“, „In den Warenkorb“ stehen tatsächlich auf den Buttons, und zwar in der korrekten Sprache.

Das spart nicht nur Zeit, es macht Pitches gegenüber Kunden auch deutlich überzeugender. Wer schon einmal versucht hat, einem nicht-technischen Kunden ein Mockup mit Platzhalter-Text zu erklären, weiß den Unterschied zu schätzen.

Komplette Kampagnen in einem Rutsch

Im Thinking Mode kannst du mit einem einzigen Prompt einen vollständigen Asset-Satz erzeugen, also ein Instagram-Square, ein Twitter-Banner, einen LinkedIn-Header, ein YouTube-Thumbnail und eine vertikale Story.

Alles mit konsistenter Bildsprache, gleicher Typografie und einheitlicher Farbgebung. Was früher tagelange Koordination zwischen verschiedenen Designern und Formaten verlangte, lässt sich nun an einem Vormittag als erste Entwurfsfassung durchspielen.

Infografiken und visuelle Erklärstücke

Mehrteilige Layouts mit Diagrammen, Datenpunkten und Fließtext halten endlich zusammen. Magazinspreads mit Charts, Comic-Sequenzen, Whitepaper-Cover, all das sind Aufgaben, an denen Diffusionsmodelle traditionell gescheitert sind.

Wichtige Einschränkung:

Die inhaltlichen Daten musst du immer prüfen. Das Modell erfindet bei Bedarf Zahlen und vertauscht Beschriftungen. Optisch wirkt das überzeugend, fachlich kann es danebenliegen.

Produkt-Mockups mit Markenkommunikation

Verpackungsdesigns mit korrekten Produktnamen, Werbebanner mit echten Slogans, Etikettentexte ohne Buchstabensalat. Für Konzeptphasen in Designprojekten oder für Pitches ein enormer Sprung.

Ob du dabei Markenrechte verletzt, wenn du Modelle mit fremden Logos generieren lässt, ist eine andere Frage und solltest du im Zweifel rechtlich abklären.

Mehrsprachige Webprojekte

Hero-Bilder für internationale Landingpages, lokalisierte Bildwelten, Schulungsmaterial für globale Kunden. Wer Webseiten für Märkte mit nicht-lateinischen Schriften entwickelt, hatte bisher keine ernsthafte KI-Option. Diese Tür ist jetzt offen.

Beitragsbilder und Editorial-Visuals

Für Blogs, Newsletter und Online-Magazine ergibt sich ein neuer Spielraum. Visuelle Schritt-für-Schritt-Anleitungen mit lesbaren UI-Elementen, illustrierte Erklärgrafiken mit eingebettetem Text, Coverbilder mit Headlines. Der Aufwand pro Beitrag sinkt deutlich, ohne dass die Qualität leidet.

Beispielprompts mit Struktur

Die größte Umstellung beim Wechsel auf ChatGPT Images 2.0 ist nicht technischer, sondern sprachlicher Natur. Da das Modell mit einer Reasoning-Schicht arbeitet, profitiert es von Prompts, die wie ein kreatives Briefing geschrieben sind. Die alten Stichwortketten („cinematic, 4k, hyperrealistic, octane render“) führen oft zu schlechteren Ergebnissen als ein gut strukturierter Beschreibungstext.

Eine bewährte Struktur sieht so aus:

- Stil und Medium,

- dann Subjekt,

- dann Umgebung,

- dann Beleuchtung,

- dann Komposition,

- am Ende die technischen Vorgaben.

Drei konkrete Beispiele aus dem Design-Alltag:

Hero-Visual für eine Webagentur:

Modernes 16:9-Hero-Visual für eine Webagentur. Aufgeräumter Arbeitsplatz mit Laptop, Skizzenblock und Kaffeetasse, gedämpftes Tageslicht durch ein Fenster links, freier Bildraum auf der rechten Seite für eine Headline. Headline „Webdesign, das wirkt“ in Libre Baskerville, dezenter Petrol-Akzent. Realistische Studiofotografie, warme Farbtemperatur.

UI-Mockup einer Buchungsseite:

Sauberes UI-Mockup einer Buchungsseite für ein Boutique-Hotel. Hellgraues Layout mit viel Weißraum, Header mit Logo links und Navigation rechts, zentral ein Kalender-Widget mit aktivem Datum 15. Mai, darunter Buttons „Verfügbarkeit prüfen“ und „Anfrage senden“. Sans-Serif-Typografie, 1440 Pixel breit, Light Mode.

Editorial-Infografik zum Mobile-First-Prinzip:

Infografik im Editorial-Stil zum Thema Mobile First Webdesign. Drei nummerierte Bereiche mit minimalistischen Symbolen für Navigation, Performance und Touch-Bedienung. Sand-Hintergrund, Akzentfarbe Petrol, dezente Trennlinien, Headline „Drei Prinzipien für mobile Websites“ oben zentriert.

Vermeide dagegen Prompts wie „irgendein cooles Webdesign-Bild“ oder „modern, professionell, kreativ“ ohne weitere Spezifikation.

Je präziser dein Briefing, desto vorhersagbarer das Ergebnis. Was paradox klingt, in der Praxis aber zutrifft:

Lange, spezifische Prompts liefern bei diesem Modell oft schneller das gewünschte Bild als kurze, weil weniger Iterationen nötig sind.

Workflows, die sich gerade verschieben

Vom Zwei-Schritt- zum Ein-Schritt-Prozess

Bisher lief der Standard-Workflow für KI-Bilder mit Text in zwei Etappen ab. Erst Bild generieren, dann in Photoshop oder Figma jeden Schriftzug per Hand korrigieren. Bei einem Asset mag das verschmerzbar sein, bei dreißig Social-Media-Posts pro Woche summiert sich das schnell zu mehreren Stunden Mehraufwand.

ChatGPT Images 2.0 reduziert diesen Prozess in den meisten Fällen auf einen Schritt. Werbeanzeigen kommen mit korrekt geschriebenen Headlines aus dem Modell, Produktmockups enthalten echten Werbetext, Diagrammbeschriftungen stimmen beim ersten Versuch.

Iteration als kreative Schleife

Die vierfache Geschwindigkeit gegenüber dem Vorgänger klingt nach einer trockenen Kennzahl, ändert aber das Verhalten beim Arbeiten. Statt einen vermeintlich perfekten Prompt zu formulieren und 60 Sekunden auf das Ergebnis zu warten, generierst du einfach drei Varianten in der gleichen Zeit und entscheidest visuell.

Bildgenerierung wird so zu einem kreativen Loop, vergleichbar mit Skizzieren auf Papier, statt zu einer trägen Produktionspipeline.

Image-to-Code-Pipeline

Ein Workflow, der erst durch dieses Modell richtig praktikabel wird: Du erzeugst ein hochauflösendes UI-Mockup mit präzisen Beschriftungen und übergibst es direkt an einen Coding-Agenten wie Claude Code oder Codex, der daraus funktionierende Frontend-Komponenten baut. Dieser Ansatz existierte vorher schon, war aber frustrierend. Wenn das Eingabebild verzerrte Buttons und gebrochene Layouts enthält, beschäftigt sich das Coding-Tool vor allem mit der Korrektur visueller Fehler statt mit dem eigentlichen Code. Saubere Mockups führen zu saubererem Code.

Selektives Editieren statt Neugenerieren

Statt jedes Mal ein neues Bild zu erzeugen, kannst du gezielt einzelne Elemente austauschen. Frisur ändern, Person hinzufügen, Stil von Foto zu Anime wechseln, alles bei gleichbleibender Komposition. Beleuchtung, Gesichter und Umgebung bleiben konsistent. Das Ergebnis erinnert an die Layer-Logik in Photoshop, läuft aber komplett über Sprachbefehle. Für Designer, die schnell Varianten brauchen, ist das eine echte Erleichterung.

Bildgenerierung wird zu einem kreativen Loop, vergleichbar mit Skizzieren auf Papier, statt zu einer trägen Produktionspipeline.

Wo das Tool an seine Grenzen stößt

So beeindruckend der Sprung ist, perfekt arbeitet auch dieses Modell nicht. Wer es ernsthaft in den Produktionsworkflow einbinden will, sollte die Schwächen kennen.

- Physik und Strukturlogik:

Das Modell versteht nicht, wie Dinge in der echten Welt funktionieren. Schuhe können auf physikalisch unmögliche Weise geschnürt sein, Straßen auf Karten enden im Nichts, Treppen führen ins Leere. Wenn dein Bild auf mechanische Korrektheit angewiesen ist, prüfe es genau. - Komplexe Strukturmuster:

Origami-Faltungen, Rubik’s-Cube-Konfigurationen, Puzzle-Layouts oder detaillierte Webmuster werden visuell imitiert, aber strukturell nicht verstanden. Häufig entstehen geometrisch unmögliche Konstrukte. - Schrift auf 3D-Oberflächen:

Flache Texte sehen exzellent aus. Schrift auf gewölbten Flaschen, auf zurückweichenden Flächen oder in starkem Winkel wird ab der zweiten oder dritten Tiefenebene unsauber. - Datengetriebene Inhalte:

Eindrucksvoll aussehende Diagramme, Periodensysteme oder Klimakarten können inhaltlich erfunden sein. Beschriftungen vertauschen, Zahlen verändern sich, Farbskalen passen nicht zur Legende. Ohne fachliche Endkontrolle gehört so ein Bild nicht in eine Veröffentlichung. - Nahaufnahmen von Gesichtern:

Bei dichten Porträts treten weiterhin Inkonsistenzen auf, besonders wenn der Prompt eine reale Person nennt. Für portraitlastige Anwendungen ist eine manuelle Endprüfung Pflicht. - Markenlogos:

Reine Vektorlogos und proprietäre Corporate-Schriften reproduziert das Modell nicht zuverlässig. Für eigenständige Logo-Entwicklung ist es nicht das richtige Werkzeug.

Eine zusätzliche Anmerkung zur Kennzeichnung: ChatGPT Images 2.0 bettet C2PA-Metadaten und digitale Wasserzeichen in alle erzeugten Bilder ein. OpenAI selbst weist darauf hin, dass diese Kennzeichnung nicht fälschungssicher ist. Sobald jemand einen Screenshot macht oder die Datei in einem Social-Netzwerk hochlädt, das die Metadaten entfernt, ist die Spur weg. Wer eigene Generierungen dokumentieren will, sollte parallel ein eigenes Verzeichnis pflegen.

Im Vergleich mit der Konkurrenz

Wo positioniert sich das neue Modell gegenüber den etablierten Mitbewerbern? Die folgende Tabelle zeigt die wichtigsten Unterschiede zu Midjourney V8.1 als prominentestem Konkurrenten:

| Kriterium | ChatGPT Images 2.0 | Midjourney V8.1 |

| Textdarstellung | Marktführend, ca. 99 % Genauigkeit | Verbessert, aber bei langem Text fehleranfällig |

| Mehrsprachigkeit | CJK, Hindi, Bengalisch, Arabisch | Nicht-lateinische Schriften unzuverlässig |

| Anweisungstreue | Sehr hoch, präzise Layouts | Mittel, kreative Interpretation |

| Ästhetik / Atmosphäre | Solide, eher nüchtern | Branchenführend, cinematisch |

| Geschwindigkeit | Bis zu 4x schneller als Vorgänger | Draft Mode 10x schneller |

| Preis Einstieg | Kostenlos (Instant Mode) | Ab 10 USD pro Monat |

| Auflösung Standard | 2K, bis 4K via API-Beta | 2K (HD Default in V8.1) |

Die kurze Lesart: ChatGPT Images 2.0 ist das stärkere Werkzeug, wenn es um Text, Layout, Anweisungstreue und mehrsprachige Inhalte geht, also genau die Bereiche, die im Webdesign zentral sind. Midjourney bleibt im Vorteil, sobald es um pure Ästhetik, atmosphärische Stimmungsbilder oder cinematische Visuals geht. Für hochvolumige Generierung (zehntausend Bilder pro Monat aufwärts) bleibt Google Nano Banana 2 mit ungefähr 0,02 US-Dollar pro Bild ökonomisch attraktiv. Wer auf selbst gehostete Modelle und freie Gewichte angewiesen ist, greift weiter zu FLUX von Black Forest Labs.

Weitere Prompts und Workflows zum austesten:

GPT Image 2 Prompting Guide and Examples

Complete List of Styles & Prompts for ChatGPT Images 2.0

Wie sich KI-Bildgenerierung gerade verändert

Vom Generieren zum Editieren

Drei Jahre lang lautete das Versprechen „Tipp einen Prompt ein und hoffe auf das Beste“. Mit ChatGPT Images 2.0 verschiebt sich der Schwerpunkt. Bilder werden nicht mehr nur erzeugt, sie werden präzise editiert.

Der Chat-Verlauf wird zur Versionshistorie, die Sprache zum Bearbeitungswerkzeug. Was an Photoshop erinnert, läuft jetzt über natürliche Sprache statt über Pinsel und Auswahlrechtecke.

Vom Ästhetischen zum Funktionalen

Die Diskussion um KI-Bildgeneratoren drehte sich lange um die Frage, ob das Modell etwas Schönes erzeugen kann. Mit dem neuen Werkzeug verschiebt sich die Frage. Sie lautet jetzt: Kann das Modell etwas Verwendbares erzeugen? Etwas mit korrektem Text, sauberen Layouts, brauchbaren Formaten und genug Qualität, um ohne Korrekturschleife in eine Veröffentlichung zu gehen? Die Antwort nähert sich dem Ja.

Vom Spezialisten zum Standard

Der kostenlose Zugang verändert die Marktlogik. Spezialisierte Bildgeneratoren als separate Services geraten unter Druck. Spezialwerkzeuge müssen ihre Daseinsberechtigung neu schärfen, generische Bildgeneratoren ohne Reasoning-Layer wirken plötzlich veraltet. Für die Branche bedeutet das eine Konsolidierung, die in den nächsten Monaten an Tempo zulegen dürfte.

Neue Rollen in Designteams

Die Zeit der „Prompt Engineers“ als eigene Berufsgattung dürfte sich dem Ende zuneigen. An ihre Stelle tritt etwas, das einer Art „AI Art Director“ gleicht.

Designer werden weniger zu Konkurrenten der KI als zu Orchestratoren. Wert verschiebt sich vom Handwerk hin zu Geschmack, Konzept und Qualitätskontrolle. Was du nicht delegieren kannst, ist zu wissen, wie ein gutes Bild aussieht und warum.

Was das für deine Arbeit bedeutet

ChatGPT Images 2.0 ist kein gewöhnliches Update. Es ist ein Architekturwechsel, der die Möglichkeiten von KI-Bildgenerierung neu vermisst. Für dich als Webdesigner besonders relevant: UI-Mockups mit echten Beschriftungen, mehrsprachige Bildwelten, schnelle Asset-Produktion für Marketing-Kampagnen, Image-to-Code-Workflows.

Die Tool-Landschaft ordnet sich gerade neu. Spezialisierte Anbieter müssen ihre Stärken nachschärfen, generische Bildgeneratoren ohne Reasoning-Layer wirken plötzlich veraltet.

Mein Vorschlag für die nächste Woche:

Suche dir drei eigene Use Cases aus deinen aktuellen Projekten, am besten je einen aus den Bereichen UI-Mockup, Editorial-Visual und Marketing-Asset. Probiere sie mit ChatGPT Images 2.0 aus. Du wirst schnell sehen, wo das Werkzeug deine Arbeit beschleunigt und wo nicht.

Ein Tool ist nur so gut wie der Mensch, der es einsetzt. Geschmack, Konzept und Urteilsvermögen kann dir auch das fortschrittlichste Modell nicht abnehmen.

Der nächste Sprung ist absehbar. OpenAI investiert seine gesamte Bildroadmap in dieses Modell, und die Konvergenz von Bild und Code ist erst am Anfang.

Wer heute lernt, mit dem Werkzeug souverän umzugehen, hat morgen einen Vorteil. Bildgenerierung ist keine Spielerei mehr. Sie wird zu einer Standardkompetenz, ähnlich wie der Umgang mit CSS oder mit Grid-Systemen.