Künstliche Intelligenz

Sora 2 ist beeindruckend (und unangenehm)

Weiterlesen nach der Anzeige

OpenAIs Videogenerierungs-App Sora 2 befindet sich zurzeit auf Platz 1 des US-iOS-Appstores; das Interesse ist offenbar groß. Die Qualität der generierten Videos hat einen riesigen Sprung nach vorne gemacht. Interessanter ist aber, dass sich Sora als Social-Media-App positioniert. c’t 3003 hat sie ausführlich getestet.

Transkript des Videos

(Hinweis: Dieses Transkript ist für Menschen gedacht, die das Video oben nicht schauen können oder wollen. Der Text gibt nicht alle Informationen der Bildspur wieder.)

Guckt mal hier: Das bin nicht ich, sondern das ist ein von Sora 2 generierter Keno. Sora 2 von den ChatGPT‑Machern von OpenAI ist auf jeden Fall ziemlich beeindruckend. Es zeigt aber auch, dass die großen KI‑Firmen gerade womöglich ziemlich in der Sackgasse stecken. In diesem Video seht ihr, was Sora 2 kann, was es nicht kann – und das ist auch ein bisschen lustig, was es nicht kann, muss ich sagen –, wie man es bekommt und was das große Problem bei Sora ist. Ich habe für diesen Test über 200 Videos generiert. Bleibt dran.

Liebe Hackerinnen, liebe Internetsurfer, herzlich willkommen hier bei…

Ja, bevor ich jetzt in die große technische und soziale Analyse gehe, erst mal hier ganz stumpf ein paar Videos, die ich mit Sora 2 gemacht habe.

[Mehrere Videos sind zu sehen]

Weiterlesen nach der Anzeige

Also, ich finde, das ist tatsächlich das krasseste Video, weil ich habe es mir angeguckt und habe gedacht: Okay, das bin ich. Habe ich das gefilmt? Sind das Aufnahmen von mir? Also, weil – auch wie meine Haut aussieht – und also ganz ehrlich, ich übertreibe da nicht. Das würde ich glauben, dass das ich bin. Auch in diesen Großaufnahmen. Die habe ich auch meinen Kollegen geschickt, und guckt mal, Pascal war auch ganz beeindruckt und hat da direkt so eine technisch‑künstlerische Sicht drauf; ihm ist aufgefallen, wie das Licht „bounced“ und kleine Schatten wirft.

[Mehr Videos sind zu sehen]

Wie ich da in den Videos rede, das hat nicht zwingend mit der Sprache des Prompts zu tun. Also, man kann einfach in Deutsch prompten, man kann auch auf Englisch prompten. Die Sachen, die ich sage – also wenn ich da nichts extra dazu schreibe –, die denkt Sora sich selber aus.

Also hier zum Beispiel bei meinem persönlichen Lieblings‑Sora‑Genre: Keno verwandelt sich in Würmer.

Und das ist ja auch typisch Sora 2. Oft weigert es sich, das zu machen – auch bei völlig harmlosen Sachen wie „Keno verwandelt sich in einen Wurm“. Weigerte sich, das zu generieren. Also, was Sora da für komische Fantasien hat – keine Ahnung.

Oder auch das hier ging nicht, wo ich einfach dieses Foto animiert haben wollte. Und Sora fantasiert mich auch erstaunlich häufig ohne Hose, was nicht ganz verstehe – hier ohne Hose als Elden‑Ring‑Boss. Und was ich auch interessant finde: dass es mich offenbar selbstständig ostfriesisch verortet – komplett ohne Prompt. Ich habe da also einfach nur meinen Namen gepromptet, und dann steht da auf einmal „Moin“ auf der Kaffeetasse. Oder auch, wenn ich einfach prompte „Keno als Reporter“. Ja, dann wirft Sora mich nach Emden.

Sowieso ganz lustig, diese „Lustige-Berufe-Prompten“: Zum Beispiel Zugbegleiter stellt Sora sich total typisch amerikanisch vor. Das geht offenbar nur so retro‑mäßig mit so einer altmodischen Uniform, weil Züge gibt’s ja heute fast gar nicht mehr in den USA. Viele Sachen sehen auf jeden Fall gut aus, finde ich. Aber viele sehen auch gar nicht mal so gut aus. Vor allem, wenn ich irgendwas Cinematisches haben will – wie diese Film‑Noir‑Szene hier –, dann sieht der Hintergrund oft so richtig billig computergeneriert aus, wie aus einem alten Computerspiel. Ja, und obwohl Sora besser Physik versteht als andere KI‑Generatoren, weiß es offenbar nicht so genau, wie die Kulturtechnik des Rauchens funktioniert. Naja, erstmal noch ein bisschen tanzen, ne?

Und wenn ihr euch jetzt fragt: Kann Sora mich so gut nachbauen, weil es so viel Videomaterial von mir auf YouTube gibt? Nein, das hat damit gar nichts zu tun. Das kann jede und jeder, indem man nämlich einfach die Sora‑App installiert und hier auf „Cameo“ tippt. Dann blendet Sora drei Zahlen ein. Die muss man einsprechen. Das ist quasi der Kopierschutz meiner eigenen Identität – also, dass ich das nicht mit fremden Leuten mache.

Und ja, dann dreht man ein bisschen seinen Kopf und versucht, möglichst viele Gesichtsausdrücke in möglichst kurzer Zeit zu machen. Denn man hat nur insgesamt neun Sekunden Zeit. Dann wird das automatisch zu OpenAI hochgeladen, und diese neun Sekunden reichen aus, damit Sora Videos mit einem künstlichen Keno generieren kann – und sogar auch in Ansätzen zumindest mit meiner Stimme sprechen kann.

Also, meine Stimme klingt meiner Meinung nach nur ein ganz kleines bisschen wie meine echte Stimme. Das Problem hatte ich aber auch bei anderen KI‑Diensten wie Eleven Labs schon. Irgendwie spreche ich offenbar komisch. Bei anderen Leuten wie zum Beispiel dem deutschen Streamer Papaplatte klingt die aus diesen neun Sekunden trainierte, generierte Stimme schon, finde ich, ziemlich echt.

Ja, und wenn ihr euch jetzt fragt: Hä, wieso könnt ihr denn Papaplatte‑Videos generieren? Hat der euch die Daten gegeben oder was?

Nein, sondern alle können diese Videos machen. Denn er hat sein Cameo für alle freigegeben. So wie auch Sam Altman, Jake Paul, iJustine und Ricky Burwick.

Das könnte man jetzt erst mal total creepy finden. Also würde ich creepy finden, dass alle mit meinem Aussehen irgendwelchen Quatsch machen können. Ohne jegliche Hürden. Aber die Leute steigern damit offenbar auch ihre Popularität.

Also zumindest, wenn ich durch TikTok swipe, dann ist da ziemlich oft der Sora-generierte Kevin Teller, aka Papaplatte, zu sehen. Noch öfter sehe ich allerdings 2Pac, Michael Jackson, Martin Luther King und andere tote Berühmtheiten, die alle von der Inhaltssperre von Sora durchgelassen werden.

Mein Cameo habe ich übrigens nicht freigegeben. Also man kann diese Datenschutzeinstellungen einigermaßen detailliert justieren. Man kann auch einstellen, ob OpenAI die Sachen fürs eigene Training verwenden darf oder nicht.

Und diese Sora-Videos mit echten Menschen, das ist auf jeden Fall gerade ein Hype. Und ich könnte mir gut vorstellen, dass das auch auf längere Sicht ein Meme-Genre sein wird – also echte Leute in lustigen KI-generierten Situationen. Ganz ehrlich, ich finde das teilweise schon auch witzig. Da stecken manchmal schon ganz gute Ideen drin.

Ich bin da halt auch gerade im Thema und kann die Dinger sofort identifizieren. Also ich sehe, ob das Sora ist oder nicht. Ich nehme aber auch wahr, dass einigen Leuten das eben nicht gelingt und dass die die Sachen halt für echte Videos halten.

Also klar, OpenAI baut da überall so wabernde Sora-Wasserzeichen ein. Aber hey, das kann man wirklich ziemlich einfach wegblurren in jedem Videoschnittprogramm. Es gibt natürlich auch längst Tutorials zum Wegmachen der Wasserzeichen hier auf YouTube. Und andere Leute, die nicht so in der Tech-Bubble sind, die wissen ja eh gar nicht, was Sora ist.

Ich war neulich zum Frühstück eingeladen und habe der Gastgeberin im Messenger vorher dieses Video hier geschickt. Einfach ohne Kontext. Und die haben das nicht gecheckt, dass das KI-generiert ist.

Die haben da halt mit einem Auge hingeguckt, irgendwie so beim Tischdecken oder so, und dachten halt: „Ach, Keno, der macht ja so Sachen mit Videos, der hat uns da jetzt so ein lustiges Video aufgenommen. Ah ja, cool.“ Und das sind auf jeden Fall junge, medienkompetente Leute. Nur die sind halt nicht in der Tech-Bubble.

Das heißt, die haben das nicht permanent auf dem Schirm, dass man so einfach KI-Videos generieren kann – von sich selbst. Also ganz klar, und das ist jetzt auch ein ziemlich langweiliger Take: Videos im Internet kann man nicht mehr trauen. Und das ist ja eigentlich auch schon lange so. Aber Videos sind halt jetzt noch ein bisschen einfacher zu faken. OpenAI hat das Ganze jetzt noch mal deutlich einfacher gemacht.

Es wird deshalb immer wichtiger, immer drauf zu gucken, wer Videos postet, also ob man der Quelle vertraut. Und deshalb haben wir bei c’t 3003 ja auch schon seit Längerem die hochoffizielle Regel, dass wir nicht mit KI-generierten Inhalten arbeiten.

Ja, ich weiß, dass dieses Video hier zu großen Teilen aus KI-generierten Inhalten besteht, aber ich denke, dass das in dem Fall logisch ist. Also ein Video über Sora – da zeigt man Sora-Inhalte. Was ich natürlich meine, sind KI-generierte Inhalte, um irgendwas zu bebildern, für das man eigentlich keine Bilder hat oder keine Lust hat, eigene Bilder dazu zu machen. Und das natürlich auch nicht deklariert. Bei uns alles schön bio – aus der 3003-Bildtextton-Manufaktur.

Also das ist jetzt erst mal der offensichtliche Take. Was ich aber obendrauf total interessant finde: dass Sora jetzt im Gewand einer Social-Media-App daherkommt. Ja, also bislang waren KI-Tools ja meistens Websites, und dann gab es vielleicht irgendwann eine Mobil-App. Bei Sora ist das jetzt so, dass man das Ding nur benutzen kann, wenn man die iOS-App installiert und sich da zumindest einmal eingeloggt hat.

Im Moment braucht man dafür einen Einladungscode und einen US-App-Store-Account, um die Sora-App zu installieren. Hat man das dann auf iOS einmal zum Laufen gebracht – also auch in Deutschland –, dann braucht man dafür kein VPN, muss sich also nicht in die USA tunneln.

Will man Zugriff auf Sora 2 über die Website, dann muss man kurz sich in die USA tunneln mit dem VPN. Was auch ein bisschen weird ist: Das Anlegen von so einem Cameo von sich selbst geht nur mit der App. Das Generieren von Querformat-Videos geht nur über die Website. Also mit der App kann man nur Hochformat generieren.

Naja, es ist auf jeden Fall alles zurzeit noch komplett kostenlos. Man braucht für Sora 2 auch kein Plus-Abo oder so. Und man kann am Tag damit zurzeit – also als ich dieses Video gemacht habe – 30 Videos am Tag generieren. Aber wie gesagt, um überhaupt loslegen zu können, braucht man die App.

Und die – Achtung, jetzt kommt’s – baut offensichtlich TikTok nach, beziehungsweise Instagram oder YouTube Shorts, die ja wiederum auch bei TikTok abkupfern. Aber ja, also man swipet da bei Sora auf jeden Fall durch den Ozean von unendlich vielen Videos.

Und das soll sich eben so anfühlen wie TikTok, was ja sowieso schon ziemlich gehirnschmelzend sein kann. Aber bei Sora sind das halt noch nicht mal Videos von und mit echten Menschen, sondern mit generierten Menschen oder generierten Dingen. Und das ist nicht lustig-seltsam wie, weiß ich nicht, Interdimensional Cable bei Rick & Morty, sondern das ist dystopisch seltsam – also richtig unangenehm.

Irgendwie ist es kurzzeitig unterhaltsam, weil es so neu ist, aber es fühlt sich dann auch sofort ganz, ganz falsch an. Irgendwie einsam. Man ist da so im ewigen Fluss der KI-Suppe des AI-Slops. Also für mich zumindest fühlt es sich ganz komisch und falsch an, da so durchzuswipen.

Ja, und warum macht denn OpenAI das überhaupt? Die wahrscheinliche Antwort darauf ist halt noch unangenehmer: OpenAI weiß nicht, wie es anders mit dem Zeugs Geld verdienen soll, als eben das zu machen, was alle Social-Media-Betreiber machen – nämlich Werbung zu verkaufen.

Sie fixen uns also an mit kostenlosen KI-Generierungen – also von uns selbst. Sie kriegen uns mit unserer Eitelkeit, unserem Ego. Und ja, da bin ich mir ziemlich sicher: Sobald das genug Leute nutzen, werden sie anfangen, Werbung zu verkaufen und anzuzeigen.

Das ist jetzt erst mal kein so schlimmer oder unerhörter Vorgang, aber das zeigt, finde ich, dass KI-Firmen gerade wirklich ziemlich in der Sackgasse stecken. Denn sie wissen nicht, wie sie aus den ganzen Investitionen – also KI-Rechenzentren unvorstellbarer Dimensionen, Millionen von Grafikkarten – wieder Geld machen können.

Und wenn ich mir die Weltwirtschaft gerade so angucke, klammert die sich an die Hoffnung, dass KI die Produktivität auf der ganzen Welt immens steigern wird. Sonst wären die Aktienkurse ja alle nicht so extrem aufgeblasen.

Und da kommt dann am Ende einfach nur das einzige Geschäftsmodell heraus, das alle im Internet machen und das Profit verspricht – also massenweise User an sich binden und denen Werbung reinzudrücken.

Und dafür diese grotesk riesigen Investitionen und Rechenzentren? Also ja, mal abwarten, wie das so weitergeht.

Also wäre Sora gut genug für den professionellen Einsatz für Film- und Videoproduktion, dann könnte man ja damit Geld verdienen. Aber das ist es leider zurzeit nicht, denn die Ergebnisse haben einen ziemlich großen Zufallsfaktor und sehen auch oft ganz schön schlecht aus.

Ja, vor allem kann Sora 2, Stand jetzt, nicht gut einen kohärenten Look über mehrere Szenen aufrechterhalten, was man ja für professionellen Einsatz bräuchte. Also ganz stumpf, dass zum Beispiel die zweite Szene den genau gleichen Look hat wie die erste Szene – sonst kann man ja nichts zusammensetzen. Und das ist bei Sora 2 ziemlich Glückssache.

Ja, und das ist auch in der Pro-Version so, die ziemlich teuer ist. Die kostet nämlich entweder 200 Dollar im Monat im Rahmen des ChatGPT-Pro-Abos oder einzeln über API abgerechnet 50 Cent pro Sekunde bei der höchsten Auflösung von 1792 × 1024 Pixeln, also 7,50 Dollar für ein 15‑Sekunden‑Video – das ist die maximale Länge.

Bei dem von mir getesteten kostenlosen normalen Sora liegt die Auflösung bei 1280 × 704 Pixeln. Da sind die Videos alle immer 10 Sekunden lang.

Ja, halten wir fest: Sora 2 kann recht beeindruckende Dinge. Das reicht aber noch lange nicht, um wirklich menschgemachte Videos oder Filme zu ersetzen.

Was aber wirklich interessant ist: dass OpenAI das offenbar glaubt – dass ihre KI-generierten Inhalte ausreichend gut sind, dass Leute freiwillig durch Sora swipen wollen statt durch TikTok, Insta oder YouTube.

Ich bin ja auch so ein Bio-Snob, der denkt, sein Geschmack ist noch nicht so verkümmert, dass er sich jeden Tag so KI-Slop angucken will. Ich glaube aber, dass es den meisten Menschen so geht.

Also ich muss schon zugeben, dass Sora ein witziges Ding ist, was wirklich ein paar Tage Spaß macht – vor allem, wenn man Freunde oder Kollegen hat, die einem ihre Cameos freigeben, um sich dann gemeinsam in Videos einbauen zu können. Das ist schon lustig.

Aber mal gucken, wie lange das interessant bleibt. Ich glaube nämlich: nicht so lange. Und es ist natürlich auch ein riesiger Haufen an Geld und Energie, der dann dafür verwendet wird, dass ich ein bisschen in Cola schwimmen kann und dann jemand einen Minzbonbon reinwirft. Tschüss.

c’t 3003 ist der YouTube-Channel von c’t. Die Videos auf c’t 3003 sind eigenständige Inhalte und unabhängig von den Artikeln im c’t Magazin. Die Redakteure Jan-Keno Janssen, Lukas Rumpler, Sahin Erengil und Pascal Schewe veröffentlichen jede Woche ein Video.

(jkj)

Künstliche Intelligenz

Nach Netflix-Deal: Paramount bietet 108 Milliarden US-Dollar für Warner Bros.

Der Poker um die Übernahme von Warner Bros. gewinnt an Dramatik: Nachdem sich Warner und Netflix auf einen Übernahme-Deal in Höhe von 83 Milliarden US-Dollar geeinigt haben, mischt sich nun Netflix-Konkurrent Paramount ein: Das Medienunternehmen bietet 108 Milliarden US-Dollar in Cash, um Warner Bros. zu kaufen.

Weiterlesen nach der Anzeige

Das Angebot macht Paramount den Aktionären, die 30 US-Dollar pro Aktie bekommen sollen. Rein finanziell ist das ein stärkeres Angebot als das von Netflix: Der Deal, den Netflix mit Warner ausgehandelt hat, sieht für Aktionäre eine Mischung aus Cash und Netflix-Aktien vor, die gemeinsam einen Wert von 27,75 US-Dollar pro Aktie haben sollen.

„Höherer Wert und sicherer Abschluss“

Das Netflix-Angebot sei für Aktionäre schlechter, argumentiert Paramount in einer Mitteilung. Die Mischung aus Bargeldwerten und Netflix-Aktien sei volatil, zudem sei der Ausgang der Kartellprüfungen unklar und der erfolgreiche Abschluss der Übernahme nicht garantiert: Dass Netflix und Warner weltweit auf 43 Prozent Marktanteil beim Streaming-Geschäft kämen, könnte laut Paramount für viele Kartellbehörden inakzeptabel sein. Zudem habe Netflix nie eine große Akquisition abgeschlossen. Eine Übernahme von Warner durch Paramount würde dagegen den Wettbewerb stärken, argumentiert das Medienunternehmen.

„Unser öffentliches Angebot, das zu denselben Bedingungen erfolgt wie das, das wir dem Vorstand von Warner Bros. Discovery privat vorgelegt haben, bietet einen höheren Wert sowie einen sichereren und schnelleren Weg zum Abschluss“, sagte Paramount-Chef David Ellison. Dass Paramount am Warner-Kauf interessiert ist, wurde schon vor Monaten bekannt. Insgesamt habe man Warner Bros. Discovery sechs Angebote vorgelegt, berichtet Paramount in der Mitteilung. Warner habe sich damit aber nie ernsthaft auseinandergesetzt. Paramount wendet sich daher nun direkt an die Aktionäre und hofft auf deren Unterstützung, um Warner Bros. umzustimmen.

Paramount will auch Nachrichtensender

Während sich das Netflix-Angebot nur auf die Film-Studios und das Streaming-Geschäft von Warner Bros. konzentriert, will Paramount mit seiner Offerte die komplette Firma kaufen. Das bedeutet, dass Paramount auch die Warner-Nachrichtensender kaufen will, darunter CNN und TNT.

Weiterlesen nach der Anzeige

Paramount selbst kommt gerade erst aus einer Fusion mit Skydance, die im Sommer für 8 Milliarden US-Dollar abgeschlossen wurde. Paramount-CEO David Ellison ist der Sohn von Oracle-Gründer Larry Ellison und pflegt gute Beziehungen zum US-Präsidenten Donald Trump.

Das aktuelle Angebot von Paramount hat Gültigkeit bis zum 8. Januar 2026, kann aber verlängert werden. Zuvor hatten Warner Bros. und Netflix angekündigt, die Übernahme bis zum dritten Quartal 2026 vollziehen zu wollen.

(dahe)

Künstliche Intelligenz

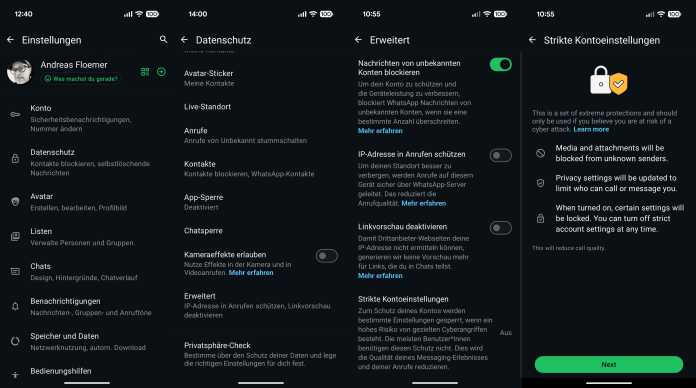

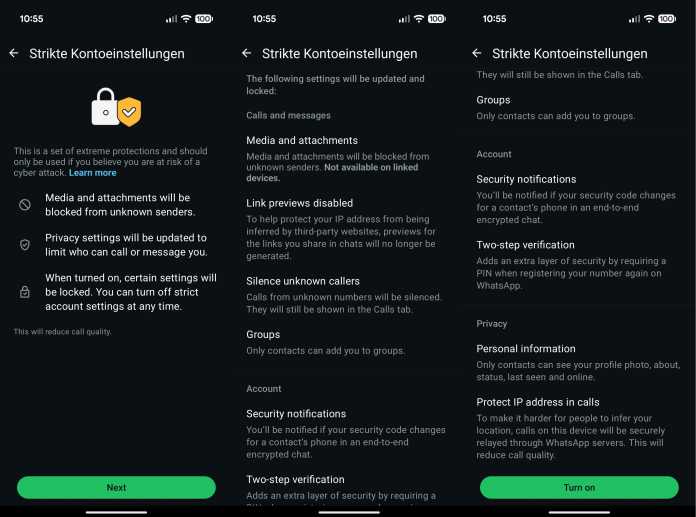

WhatsApp: Funktion in Beta vereinfacht Schutz vor Cyberangriffen

WhatsApp kann als Einfallstor für Schadsoftware dienen: In den vergangenen Monaten kursierten Berichte, denen zufolge sowohl iPhones also wohl auch Samsung-Galaxy-Geräte über den Meta-Messenger angegriffen wurden. Um Angreifern möglichst wenig Angriffsfläche zu bieten, integriert Meta in seinen Messenger eine neue Funktion, die mit einem Klick erweiterte Datenschutz- und Sicherheitsfunktionen aktiviert. Die Funktion nennt sich „strikte Kontoeinstellungen“.

Weiterlesen nach der Anzeige

Schutzschilde hoch

Wie Meta im Supportdokument zu der Funktion schreibt, wurde sie für Benutzerinnen und Benutzer entwickelt, „die Ziel solcher Angriffe sein könnten“. Nutzer sollten die Einstellungen nur aktivieren, wenn sie dazu einen Anlass sehen, betont das Unternehmen – etwa wenn man glaubt, Ziel einer „raffinierten Cyberkampagne“ zu sein. „Die meisten Personen sind von solchen Angriffen nicht betroffen,“ heißt es weiter. Nutzer, die WhatsApp mit einem möglichst weitreichenden Schutz verwenden wollen, können die Funktion dennoch nutzen, jedoch ist die Einstellung nicht prominent platziert.

Recht tief in den Einstellungen versteckt: Die neue WhatsApp-Funktion „Strikte Kontoeinstellungen“.

(Bild: Andreas Floemer / heise medien)

Derzeit steht das Feature nur registrierten Nutzern der Beta-Versionen des Messengers für Android und laut WABetaInfo für iOS zur Verfügung. Nutzer der Beta finden den Knopf zur Aktivierung der „strikten Kontoeinstellungen“ künftig unter „Einstellungen“ > „Datenschutz“ > „Erweitert“.

Nach Aktivierung der „strikten Kontoeinstellungen“ blockiert das Feature sämtliche Medien von unbekannten Absendern. Zudem deaktiviert die Funktion Linkvorschauen und schaltet Anrufe von unbekannten Nummern stumm. Die werden jedoch in der Anrufübersicht angezeigt. Ferner schränkt die Funktion Gruppeneinladungen ein und erzwingt eine zweistufige Verifizierung. Überdies begrenzen die „strikten Kontoeinstellungen“ die Sichtbarkeit von Profilen. Sie leiten außerdem zum Verschleiern der eigenen IP-Adresse Anrufe über WhatsApp-Server weiter.

WhatsApp „Strikte Kontoeinstellungen“: In der Beta sind die Einstellungen noch nicht lokalisiert.

(Bild: Andreas Floemer / heise medien)

Auch der „Zuletzt online“-Zeitstempel und der „Online“-Status, das Profilbild und die Nutzerinfo sind laut Meta nur für die eigenen Kontakte oder eine zuvor festgelegte, eingeschränktere Liste von Personen sichtbar. Zudem rät Meta Nutzern mit aktivierten Backups, die Ende-zu-Ende-verschlüsselte Backup-Funktion zu verwenden.

Weiterlesen nach der Anzeige

Laut WhatsApp können Nutzer die strikten Kontoeinstellungen nur über das Hauptgerät ein- und ausschalten. Weiter heißt es, dass Nutzer alle gegen Änderungen gesperrte Einstellungen unter dem Punkt „Einstellungen“ > „Datenschutz“ > „Erweitert“ > „Strikte Kontoeinstellungen“ > „Gesperrte Einstellungen“ ansehen können.

Wann WhatsApp die Funktion aus der Beta-Version hievt und für alle Nutzerinnen und Nutzer bereitstellt, ist derzeit unklar.

(afl)

Künstliche Intelligenz

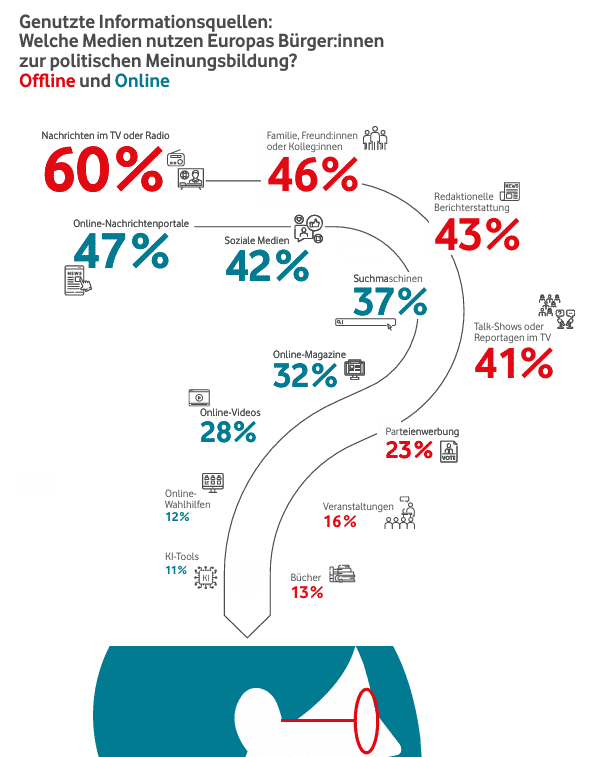

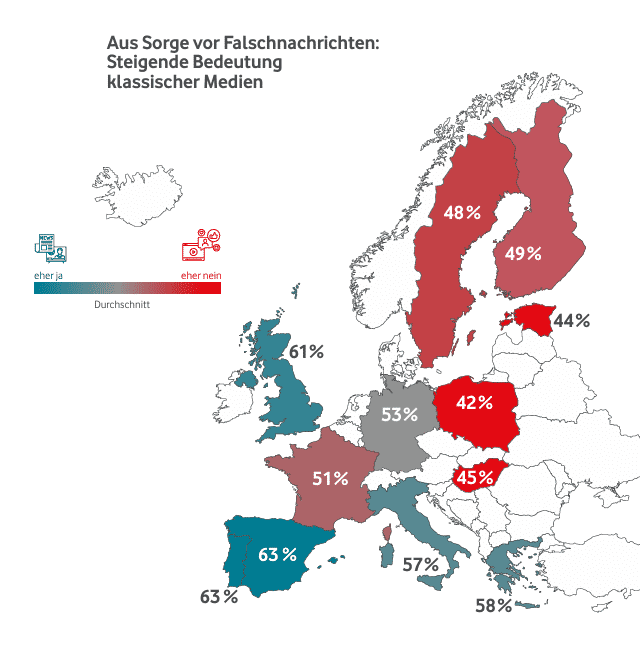

Europäer: Klassische Medien, KI-Detektoren und Staat müssen KI-Inhalte prüfen

Der Schutz der Demokratien in Europa vor KI-Falschnachrichten und Manipulationsversuchen kann aus Sicht der Europäer durch einen Dreiklang von prüfenden Institutionen gewährleistet werden: klassische Medien, KI-Detektoren und staatliche Regulierung. Die eigene Medienkompetenz wird als weniger wirksam eingestuft. Das geht aus einer aktuellen Studie des Vodafone Instituts hervor, der Denkfabrik des Telekommunikationsdienstleisters. KI wird demnach als große Gefahr für die Manipulation von Wahlen und auch das Untergraben des Vertrauens in politische Institutionen durch generierte Falschnachrichten beziehungsweise Desinformation gesehen.

Weiterlesen nach der Anzeige

Bedeutung klassischer Medien hat zugenommen

Für die Studie wurden 12.086 wahlberechtigte Personen ab 18 Jahren in zwölf europäischen Ländern über computergestützte Online-Interviews im Frühjahr 2025 befragt, darunter auch 1002 Personen aus Deutschland. Der Befragung zufolge hat für mehr als die Hälfte der Europäer – unabhängig vom Alter – die Bedeutung redaktioneller Berichterstattung aufgrund der steigenden Gefahr von Falschnachrichten zugenommen. So stimmten insgesamt 53 Prozent der Befragten der Aussage zu, dass die Bedeutung redaktioneller Beiträge aufgrund der aktuellen Lage gestiegen sei. Unter den 25- bis 34-Jährigen sind es 57 Prozent, bei den 18- bis 24-Jährigen und 35- bis 44-Jährigen mit 54 Prozent etwas mehr.

Jüngere informieren sich eher online, ältere eher in klassischen Medien, durch aktuelle Entwicklungen gewinnen redaktionelle Berichterstattungen an Gewicht, um Falschnachrichten zu vermeiden oder besser zu erkennen.

(Bild: Vodafone Institut)

Ältere Menschen konsumieren ohnehin eher klassische Medien, belegt die Studie: Im europäischen Durchschnitt und über alle Altersklassen hinweg greifen rund 60 Prozent der Befragten für politische Informationen auf klassische Medien wie Nachrichten im Fernsehen und Radio zurück. Die Nutzung von Fernsehen und Radio nimmt mit höherem Alter zu. Der Anteil in der Altersgruppe der 18- bis 24-Jährigen liegt bei gut 40 Prozent. Neben Nachrichten im Fernsehen und Radio spielen weitere Quellen eine wichtige Rolle: der persönliche Austausch innerhalb der Familie, im Freundeskreis oder am Arbeitsplatz (46 Prozent), redaktionelle Berichterstattung (43 Prozent) sowie politische Talkshows und Reportagen im Fernsehen (41 Prozent)

60 Prozent der 18- bis 24-Jährigen nutzen für politische Informationen soziale Medien. Instagram (61 Prozent), YouTube (57 Prozent) und TikTok (56 Prozent) sind hierbei die maßgeblichen Plattformen, die zumindest schon einmal zu diesem Zweck genutzt wurden. Mit Blick auf alle Befragten über alle Altersklassen hinweg zeigt sich ein zweigeteiltes Bild für den Nachrichtenbezug online: 47 Prozent informieren sich über Nachrichtenportale, 42 Prozent über soziale Medien.

Jüngere nehmen mehr Fake News wahr

Weiterlesen nach der Anzeige

Wie häufig Menschen in Kontakt mit Falschnachrichten kommen, ist unter den Generationen ebenfalls unterschiedlich. Demnach gaben unter den 18- bis 24-Jährigen 38 Prozent an, in den vergangenen Monaten sehr oder extrem häufig Fake News wahrgenommen zu haben, während der Wert bei den über 64-Jährigen bei 16 Prozent liegt. Die Studie mutmaßt, dass dies unter anderem daran liegen könnte, dass junge Menschen mehr Zeit online verbringen und dadurch öfter Kontakt zu Desinformation haben. Ob sie vielleicht auch besser darin sind, Fake News zu erkennen, hat die Studie nicht untersucht. Sie kommentiert aber an anderer Stelle: „Während die meisten überzeugt sind, sich nicht von Falschnachrichten beeinflussen zu lassen, werden die Manipulationsgefahren bei anderen Personen als viel stärker eingeschätzt: 39 Prozent gegenüber 18 Prozent. Dies ist ein bekanntes Phänomen und daher wenig überraschend, dass es in allen Ländern vorzufinden ist. Es ist aber durchaus relevant, da es zu sozialer Spaltung beitragen kann. Wenn einzelne Gruppen glauben, dass „die Anderen“ durch Medien manipuliert werden, kann dies das Misstrauen in der Gesellschaft verstärken.“

In Südeuropa hat die Bedeutung von klassischen Medien aufgrund der Sorge vor Falschnachrichten zugenommen, in Nordeuropa eher weniger.

(Bild: Vodafone Institut)

Dass Falschnachrichten eine sehr große oder extreme Gefahr für die Demokratie darstellen, gaben 28 Prozent aller Befragten an. Am stärksten davon überzeugt sind Menschen aus Spanien mit 38 Prozent Zustimmung, und am wenigsten Menschen aus Finnland mit 15 Prozent. Je jünger die Befragten, desto stärker bewerten diese den Einfluss von Falschinformationen auf die Demokratie (35 Prozent bei den 25- bis 34-Jährigen vs. 21 Prozent bei den über 64-Jährigen). Wie häufig Fake News wahrgenommen werden, unterscheidet sich auch deutlich zwischen den Ländern: So wurden in Estland und Griechenland (39 und 35 Prozent) wesentlich mehr Fake News von Befragten wahrgenommen als etwa in Finnland und Schweden (20 und 19 Prozent).

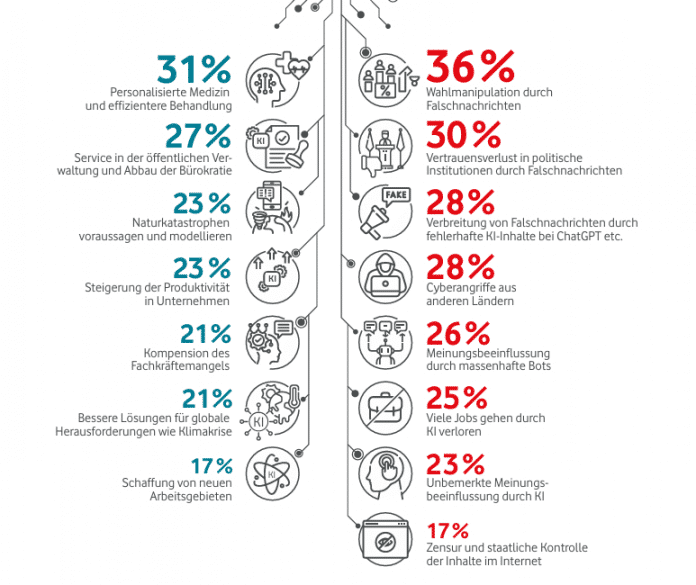

KI als Brandbeschleuniger für Fake News

Da KI auch zur Erstellung von Fake News und täuschend echter Videos und Fotos im politischen Kontext genutzt werden kann, wurden Teilnehmende auch hierzu befragt: Die größten Risiken von KI für die Demokratie werden in Wahlmanipulationsmöglichkeiten im Vorfeld von Wahlen (36 Prozent) und dem Untergraben des Vertrauens in politische Institutionen durch KI-generierte Falschnachrichten (30 Prozent) gesehen. Auch überwiegt bei den befragten Europäerinnen und Europäern derzeit die Skepsis bei der Wahrnehmung von KI. Nur etwa 30 Prozent glauben, dass die Vorteile von KI insgesamt die Nachteile überwiegen. Besonders kritisch gegenüber KI-Inhalten zeigen sich Befragte aus Deutschland und dem Vereinigten Königreich, während es in Südeuropa mehr Zutrauen gibt.

Gute Seiten – schlechte Seiten: KI wird eher skeptisch betrachtet, wo Vor- oder Nachteile liegen (könnten), wurde genauer abgefragt.

(Bild: Vodafone Institut)

Ein Dreiklang aus Maßnahmen hat den Befragten zufolge das größte Zukunftspotential, dem zu begegnen: KI-Detektoren, klassische Medien und staatliche Regulierungen. 45 Prozent sehen vor allem eine Überprüfung durch klassische Medien als relevant an, was besonders von Älteren genannt wurde. Als weniger zukunftsrelevant werden Erkennungsalgorithmen in sozialen Medien (35 Prozent), medienkompetente Nutzer (31 Prozent) und die Förderung des Austauschs von Best Practices durch internationale Organisationen (23 Prozent) gesehen.

Die Befragten sprechen sich dementsprechend für Maßnahmen wie das Kennzeichnen von KI-generierten Inhalten (65 Prozent), Faktenchecks (59 Prozent) sowie den Einsatz nationaler Aufsichtsbehörden (58 Prozent) aus. Teilnehmende aus Portugal befürworten in diesem Zusammenhang die verschiedenen Aspekte des DSA und des AI Act mit 70 Prozent am stärksten, während das Menschen aus Polen mit 50 Prozent am wenigsten tun. Zudem steigt die Zustimmung zu regulatorischen Maßnahmen mit dem Alter und der formalen Bildung. So werden beispielsweise Faktenchecks und die Unterbindung von Hassrede von knapp der Hälfte der formal niedrig Gebildeten (47 Prozent) befürwortet, bei den formal höher Gebildeten sind es zwei Drittel (65 Prozent).

Des Weiteren betrachten 43 Prozent aller Befragten Tools zur Erkennung von künstlich erstellten oder veränderten Videos, Bildern oder Audiodateien (KI-Detektoren) als zukunftsträchtige Lösungen. Bisher nutzen nur 14 Prozent der Befragten solche Detektoren, das Interesse sei aber bei jungen und formal höher gebildeten Menschen größer. Die Nutzungsbereitschaft variiert zwar zwischen den Ländern, aber fast ein Drittel der Europäer kann sich deren Einsatz zur Verifizierung politischer Inhalte gut vorstellen. Insgesamt zeigt die Studie: Ältere Befragte setzen mehr auf staatliche Regulierungen und Überprüfung mit klassischen Medien (49 Prozent bzw. 56 Prozent der über 64-Jährigen), Jüngere halten KI-Detektoren für geeigneter (50 Prozent der 18- bis 24-Jährigen).

KI mehr ein Thema für Jüngere

Der Studie zufolge sind Jüngere aber ohnehin diejenigen, die sich mehr mit KI-Tools auseinandersetzen und diese auch schon für politische Themen genutzt haben. Je jünger die Befragten sind, desto größer ist die Bereitschaft für die (zumindest einmalige) Nutzung. Bei den 18- bis 24-Jährigen sind es 79 Prozent, bei den über 64-Jährigen nur 24 Prozent.

Mit Abstand Spitzenreiter bei den KI-Tools ist ChatGPT, das bereits von einem Drittel im politischen Kontext mindestens einmal genutzt wurde, gefolgt von Google Gemini, Meta AI, Copilot und DeepSeek. Überbewertet werden dürfen diese Daten allerdings nicht, denn wie die Studie auch klarmacht, liegt die Nutzung von KI-Tools für die politische Meinungsbildung im Vergleich zu klassischen Medien oder Nachrichtenportalen und Social Media weit zurück: Insgesamt nur 11 Prozent der Befragten nutzen regelmäßig ChatGPT oder anderen KI-Tools, wenn es um die Beschaffung von politischen Informationen geht.

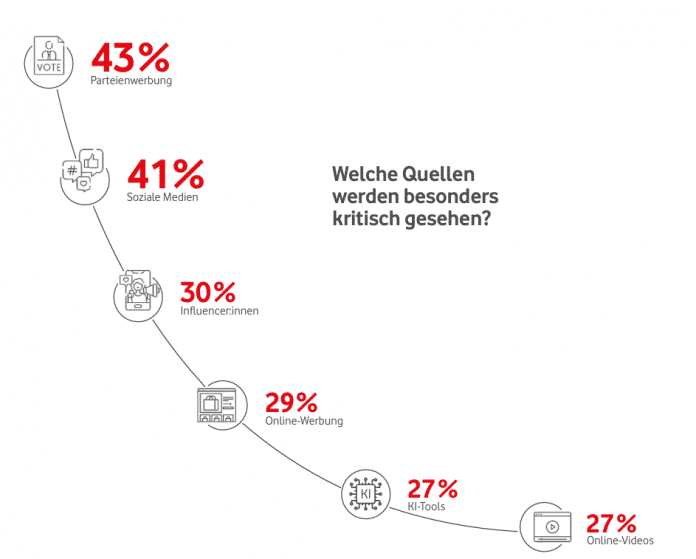

Parteienwerbung hat einen noch schlechteren Ruf als soziale Medien oder KI-Tools.

(Bild: Vodafone Institut)

Und auch wenn jüngere Befragte von 18 bis 24 Jahren zu 48 Prozent die Meinung vertreten, dass KI mehr Vor- als Nachteile bringt, hinterfragen diese Altersgruppen KI-generierte Inhalte mit 43 Prozent sogar leicht überdurchschnittlich. Über alle Altersgruppen hinweg sind 40 Prozent der Befragten KI-Inhalten gegenüber misstrauisch, ähnlich wie auch gegenüber Social-Media-Inhalten mit 41 Prozent. Mit 43 Prozent schneidet nur noch die Werbung von Parteien unter den Befragten schlechter ab.

(kbe)

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenIllustrierte Reise nach New York City › PAGE online

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenJetzt patchen! Erneut Attacken auf SonicWall-Firewalls beobachtet

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAus Softwarefehlern lernen – Teil 3: Eine Marssonde gerät außer Kontrolle

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenFake It Untlil You Make It? Trifft diese Kampagne den Nerv der Zeit? › PAGE online

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenSK Rapid Wien erneuert visuelle Identität

-

Entwicklung & Codevor 3 Wochen

Entwicklung & Codevor 3 WochenKommandozeile adé: Praktische, grafische Git-Verwaltung für den Mac

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenSchluss mit FOMO im Social Media Marketing – Welche Trends und Features sind für Social Media Manager*innen wirklich relevant?