Künstliche Intelligenz

Microsoft zieht Bilanz: Windows-Treiberentwicklung mit Rust

Microsoft integriert Rust schrittweise in den Windows-Kernel und stellt auch die Windows-Treiber-Entwicklung schrittweise um. Microsoft zieht eine Zwischenbilanz.

Aufgrund der Komplexität der Windows-Kernel-API wird es zwar noch einige Zeit in Anspruch nehmen, bis der gesamte Rust-Designprozess abgeschlossen ist, so Microsoft in einem Blogpost des Surface-Entwicklerteams, der den aktuellen Stand der Windows-Treiberprogrammierung mit Rust zusammenfasst. Dranbleiben will die Firma aber auf jeden Fall, denn für Microsoft stellen speichersichere Sprachen wie Rust die Zukunft der sicheren Softwareentwicklung dar. Auch deshalb, weil die Sicherheitslandschaft Zuverlässigkeit und Sicherheitsgarantien auf jeder Ebene erfordere.

Gegenwärtig können Rust-Programmiererinnen und -Programmierer, die das von Microsoft bereitgestellte GitHub-Repository des Rust-Projekts (windows-drivers-rs) importieren, dieselben Bibliotheken und Header im Windows Driver Kit (WDK) nutzen wie C-Entwickler. Außerdem haben sie damit Zugriff auf alle Device Driver Interfaces (DDI), die es zum Erstellen eines Windows-Treibers im User- und Kernel-Mode braucht. Mit dem Tool cargo-wdk soll beides nun komfortabler funktionieren.

Visual Studio als Vorbild: cargo-wdk für Rust

In Microsoft Visual Studio stehen verschiedene Vorlagen bereit, um Windows-Treiber in C zu schreiben. Um die Entwicklung mit Rust ähnlich einfach zu machen, hat Microsoft jetzt die Cargo-Erweiterung cargo-wdk vorgestellt. Mit ihr lassen sich leere Treiberprojekte anlegen, die bereits alle erforderlichen Verknüpfungen, Build-Schritte und Abhängigkeiten mitbringen. Zudem kann cargo-wdk – ähnlich wie bei der Erstellung eines Treibers in C in Visual Studio – WDK-Tools wie InfVerif aufrufen.

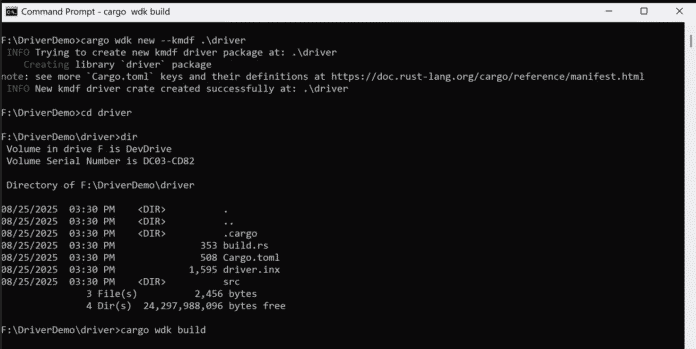

Die Cargo-Erweiterung cargo-wdk im Einsatz.

(Bild: Microsoft)

Wie cargo-wdk funktioniert, demonstriert Microsoft an einem Beispiel. Darin erstellen Entwicker mit cargo wdk new –kmdf eine KMDF-Treibervorlage. Mit Eingabe von cargo wdk build lässt cargo-wdk dann das InfVerif-Tool über die INF-Datei des Treibers laufen und zeigt dabei ähnlich wie in Visual Studio alle gefundenen Fehler an. Im Beispiel wird die INF-Datei schließlich korrigiert, cargo-wdk erneut ausgeführt und so sichergestellt, dass der Treiber mit den entsprechenden Zertifikaten versehen ist.

Mittelfristig will das Team cargo-wdk um Features wie automatische WDK-Installationen, die Unterstützung für NT_TARGET_VERSION, zusätzliche Treibervorlagen und eine volle ARM64-Unterstützung ergänzen. Langfristig plant Microsoft, Programmiererinnen und Programmierern in einer Cargo-Umgebung Zugriff auf dieselben Build-Tools und Konfigurationsoptionen zu bieten wie in Visual Studio.

Neben cargo-wdk enthält das Repo noch folgende Crates:

- wdk-build: Eine Bibliothek zum Konfigurieren eines Cargo-Build-Skripts, das Downstream-Linking des WDK durchführt und Rust-Bindings generiert.

- wdk-sys: Direkte FFI-Bindings zu APIs im WDK verfügbar sind.

- wdk: Sichere idiomatische Bindings zu APIs, die im WDK verfügbar sind.

- wdk-panic: Standardimplementierung von Panic-Handlern für mit dem WDK erstellte Programme

- wdk-alloc: Ein globaler Allocator für die Treiber.

- wdk-macros: Eine Sammlung von Makros, die die Interaktion mit den direkten Bindings von wdk-sys erleichtern.

Von unsicherem Rust zu sicherem Rust

Derzeit umfasst windows-drivers-rs zwar alle Bausteine, um Rust-Treiber für Windows zu programmieren, allerdings sind immer noch erhebliche Mengen an unsafe Rust-Code nötig. Auch unsicheres Rust bietet laut Blog Vorteile, wie starke eine Typprüfung, Zero Cost Abstractions und eine gute Kompatibilität durch das Foreign Function Interface (FFI). Auf lange Sicht soll es Entwicklern aber möglich sein, den Großteil eines Windows-Treibers sicher zu schreiben.

Dazu will Microsoft das Typsystem und den Borrow-Checker von Rust nutzen, um bestimmte Arten von Fehlern zu verhindern, die sich bisher nur durch zusätzliche statische Analysen erkennen lassen. Zudem soll der Umfang des Repositorys kontinuierlich weiter ausgebaut werden. Außerdem soll es sichere Abstraktionen für Kernel-Mode-Strukturen und DDIs geben, um die Anzahl der benötigten unsicheren Codeblöcke zu reduzieren und die Sicherheit schon während der Kompilierzeit zu erhöhen.

Neben dem Surface-Team sind auch andere Abteilungen bei Microsoft damit beschäftigt, sichere Strukturen und APIs zu entwickeln. Diese gehen über das Windows Driver Framework (WDF) hinaus und lassen sich sowohl in der Kernel-Entwicklung von Windows als auch von Drittanbietern in der Treiberentwicklung einsetzen. Einige dieser Arbeiten sind bereits heute im Windows-Kernel enthalten.

(who)

Künstliche Intelligenz

Russland schränkt Whatsapp und Telegram erneut ein

Die russische Telekommunikationsbehörde Roskomnadsor schränkt die beiden Messengerdienste Whatsapp und Telegram in Russland weiter ein. Um Kriminellen entgegenzuwirken, würden Maßnahmen zur teilweisen Einschränkung ausländischer Messenger ergriffen, teilte die Behörde der staatlichen russischen Nachrichtenagentur Tass zufolge mit. Whatsapp und Telegram seien wichtige Dienste für Erpressung, Betrug und Verwicklung russischer Bürger in Sabotageakte, hieß es.

Weiterlesen nach der Anzeige

Die derzeit instabile Funktion der Messenger hänge aber nicht mit einer Zugangssperre durch Telekommunikationsbetreiber zusammen, meldete die Agentur mit Verweis auf solche Unternehmen.

Zahlreiche Störungen gemeldet

Russische Medien berichteten von massiven Einschränkungen der Messengerdienste vor allem im Süden Russlands seit Montag. In Kommentaren auf Störungswebsites hieß es, dass die Verbindungen langsam seien oder die App gar nicht lade. Anrufe über Whatsapp und Telegram sind schon länger eingeschränkt. Auch das begründete Roskomnadsor im August mit der angeblichen Abwehr von Terroristen und Betrügern.

Schon 2024 wurden der verschlüsselte Messenger Signal und der Dienst Viber blockiert. Auch LinkedIn, Facebook, Instagram und viele Websites lassen sich ohne virtuelles privates Netzwerk (VPN) – die ebenso zunehmend gesperrt werden – nicht öffnen. Ausländische Messenger sollen durch die vom Staat bevorzugte App Max ersetzt werden, bei der Kritiker einen Zugriff der Behörden auf Daten befürchten.

Russland schränkt freies Internet zunehmend ein

Moskau baut Kontrolle und Zensur im Internet vor allem seit Beginn der großangelegten Invasion in die Ukraine vor mehr als dreieinhalb Jahren aus. Für die Suche nach Informationen, die die Behörden als „extremistisch“ eingestuft haben, drohen bis zu 5000 Rubel (rund 53 Euro) Strafe, entschied das Parlament im Juli. Als „extremistisch“ gebrandmarkt sind vor allem Internetressourcen, die den Machtapparat kritisieren, wie der Anti-Korruptions-Fonds des in Haft gestorbenen Kremlgegners Alexej Nawalny.

Weiterlesen nach der Anzeige

(dmk)

Künstliche Intelligenz

Donnerstag: Meta reduziert KI-Abteilung, YouTube geht gegen KI-Deepfakes vor

Meta Platforms KI-Abteilung schwimmt in Geld und hat so viele Leute eingestellt, dass sie einander im Weg stehen. Jetzt müssen 600 raus. Durch die Reduzierung der mit KI beschäftigten Mannschaft will der Facebook-Konzern die Anzahl der Besprechungen reduzieren und schneller zu Entscheidungen kommen. KI wird hingegen für YouTube und Videoschaffende zum Problem, wenn Deepfakes gegen Privatsphäre und Urheberrecht verstoßen. Deshalb können Content-Ersteller bei YouTube nun nach KI-Deepfakes ihrer Person suchen und solche Videos entfernen lassen. Dafür benötigt YouTube Ausweis und Gesichtsvideo. Derweil hat der Ausfall der Amazon Web Services (AWS) einige Anwender nicht nur bei der Nutzung von Online-Diensten gestört, sondern sogar beim Schlafen. Denn bestimmte vernetzte Matratzen haben keinen Offline-Modus. Nach dem AWS-Ausfall konnten diese nicht mehr gesteuert werden, sodass Matratzenbesitzer nicht mehr schlafen konnten – die wichtigsten Meldungen im kurzen Überblick.

Weiterlesen nach der Anzeige

Meta Platforms streicht ungefähr 600 Arbeitsplätze in der KI-Abteilung. Dabei geht es aber offenbar weniger um Einsparungen, sondern mehr um Entschlackung. Wer bleibt, muss härter arbeiten. Seit etwa drei Jahren hat Meta für seine „Superintelligence Labs“ KI auf Teufel komm raus Personal eingestellt, in Summe laut Medienberichten rund 3.000 Menschen. Das Ergebnis ist nicht unbedingt effizient. Der Einschnitt bei der KI-Belegschaft soll nicht als Rückzug oder Zurechtstutzung der teuren KI-Bemühungen Metas verstanden werden, haben Manager durchblicken lassen. Vielmehr soll Bürokratie abgebaut und so die KI-Weiterentwicklung beschleunigt werden. Den vom Stellenabbau Betroffenen sollen andere Stellen im Konzern angeboten werden: Meta Platforms kündigt 600 KI-Spezialisten.

Auch YouTube will weniger KI, allerdings auf seiner Plattform, und geht offenbar stärker gegen die Verbreitung von Videos mit per Künstlicher Intelligenz (KI) erstellten oder veränderten Personen vor. Dazu bietet das Portal Videoschaffenden ein Tool zur Ähnlichkeitserkennung an. Damit können Content-Ersteller bei YouTube nach Videos suchen, die das eigene Gesicht enthalten, etwa per KI-Deepfake. Dann darf der Anwender entscheiden, ob er die Entfernung dieses Videos beantragt oder es akzeptiert. Bevor YouTube Ähnlichkeiten in Videos erkennen kann, benötigt der Dienst das Hochladen oder Fotografieren eines Ausweises oder Führerscheins mit Lichtbild sowie ein kurzes Video vom Gesicht der Person aus mehreren Perspektiven: YouTubes neues Tool zur Gesichtserkennung soll KI-Deepfakes unterbinden.

Montagmorgen kam es in einem Amazon-Rechenzentrum im US-Staat Virginia zu einer Störung. Die Auswirkungen waren weltweit zu spüren. Zahlreiche Internet-Dienste ließen sich zeitweise nur eingeschränkt oder gar nicht nutzen. Darunter auch Matratzen. Das belegen Beschwerden diverser Kunden der New Yorker Firma Eight Sleep. Sie verkauft unter der Bezeichnung „Pod“ vernetzte Matratzen, die irreführend als „smart“ bezeichnet werden. Der Schläfer erhält eingebaute Heizung und Kühlung sowie einen Motor, der bestimmte Bereiche der Matratze verformen kann. Damit können Bettbenutzer im Bett etwa besser sitzen. Diese Matratzen kennen aber keinen Offline-Modus, sodass Nutzer nach dem AWS-Ausfall weder Kühlung noch Heizung oder Position ändern konnten: AWS-Ausfall machte vernetzte Matratzen unbrauchbar.

Empfohlener redaktioneller Inhalt

Mit Ihrer Zustimmung wird hier eine externe Umfrage (Opinary GmbH) geladen.

Leider gehören diese „smarten“ Matratzen wohl nicht zu den Elektro-Altgeräten, die in Deutschland kostenlos von größeren Händlern zurückgenommen werden müssen. Doch auf diese Regelung pochen neue Gerichtsentscheidungen. Das festigt die Auslegung der Reform des Elektro- und Elektronikgerätegesetzes. So bestätigen zwei aktuelle Urteile von Landgerichten, dass Elektrogeräte verkaufende Einzelhändler ab einer gewissen Ladengröße ausgediente Elektrokleingeräte wieder annehmen müssen. Und das gebührenfrei. In beiden Fällen ist die Deutsche Umwelthilfe (DUH) gegen die Händler vorgegangen. Testbesucher hatten Verstöße gegen die seit über drei Jahren geltende Rücknahmepflicht festgestellt, sodass die DUH vor Gericht gezogen ist. Jetzt gibt es die Urteile: Auch Aldi Nord und Edeka müssen Elektroschrott gratis zurücknehmen.

In der heutigen Ausgabe der #heiseshow besprechen wir unter anderem, wie der Prozessor den PC voranbrachte. Denn vor 40 Jahren stellte Intel den 80386 vor, der den PC-Markt revolutionierte. Was machte den Prozessor so bedeutend für die Computerentwicklung? Derweil plant Amazon offenbar, bis zu 600.000 US-Mitarbeiter durch Roboter zu ersetzen. Welche Aufgaben sollen die Roboter übernehmen und wie realistisch sind diese Pläne? Wie wirkt sich der verstärkte Robotereinsatz auf die Arbeitswelt der Zukunft aus? Zudem diskutieren wir über Atlas, OpenAIs eigenen Browser für macOS, der ChatGPT integriert. Welche Funktionen bietet Atlas und wie unterscheidet er sich von etablierten Browsern? Das sind die Themen heute um 17 Uhr live in der #heiseshow: 40 Jahre 80386, Amazon und die Roboter, ChatGPT-Browser.

Weiterlesen nach der Anzeige

Auch noch wichtig:

(fds)

Künstliche Intelligenz

YouTubes neues Tool zur Gesichtserkennung soll KI-Deepfakes unterbinden

YouTube will offenbar stärker gegen die Verbreitung von Videos mit per Künstlicher Intelligenz (KI) erstellten oder veränderten Personen vorgehen. Dazu bietet die Plattform Videoschaffenden jetzt ein Tool zur Ähnlichkeitserkennung an. Damit können Content-Ersteller bei YouTube nach Videos suchen, die das eigene Gesicht enthalten, etwa per KI-Deepfake. Dann darf der Anwender entscheiden, ob er die Entfernung dieses Videos beantragt oder es akzeptiert.

Weiterlesen nach der Anzeige

Bevor YouTube Ähnlichkeiten in Videos erkennen kann, benötigt der Dienst das Hochladen oder Fotografieren eines Ausweises oder Führerscheins mit Lichtbild sowie ein kurzes Video vom Gesicht der Person aus mehreren Perspektiven. Damit will das Portal die Identität verifizieren. Die Überprüfung kann allerdings bis zu fünf Tagen dauern. Danach listet YouTube-Studio gefundene Videos, die das eigene Gesicht oder Ähnlichkeiten enthalten, die dann selbst geprüft werden können.

Tool zur Ähnlichkeitserkennung noch in Beta-Phase

Dieses Tool gegen Deepfakes befindet sich bereits seit über einem Jahr in der Entwicklung. Anfang September 2024 erklärte YouTube, dass mehr Schutz vor Deepfakes und unerlaubt geklonten Stimmen geplant ist. Das System zur Ähnlichkeitserkennung wird in den nächsten Wochen ausgerollt, aber YouTube bezeichnet es noch als „experimentelle Funktion“, um Feedback der Nutzer zu sammeln. Das Tool zur Ähnlichkeitserkennung wird zumindest zunächst auch nur in ausgewählten Ländern verfügbar sein, soll aber auf weitere Regionen ausgeweitet werden.

Die Ähnlichkeitserkennung arbeitet laut YouTube ähnlich wie das 2018 als Maßnahme gegen Online-Piraterie ins Leben gerufene Tool „Content ID“. Mit diesem System können YouTuber ihre urheberrechtlich geschützten Inhalte auf dem Videoportal einfacher erkennen und verwalten. Die zu schützenden Inhalte werden dabei, auf Ansinnen der Urheber, in einer Datenbank mit Audio- und Bilddateien gespeichert und mit neu hochgeladenen Videos abgeglichen.

Verletzung von Urheberrecht oder Privatsphäre

YouTube betont zudem den Unterschied zwischen dem Schutz der Privatsphäre und Urheberrechtsverletzungen. In beiden Fällen können Content-Ersteller das Entfernen fremder Videos beantragen, aber eben aus verschiedenen Gründen. Als Beispiele für Urheberrechtsverletzungen nennt YouTube das Kopieren eigener Videos in fremde Videos oder Videoclips in fremden Videos, bei denen die Tonspur geändert wurde, sodass der Eindruck entsteht, man sage etwas anderes.

Weiterlesen nach der Anzeige

Verletzungen der Privatsphäre liegen dagegen vor, wenn jemand anderes das eigene Antlitz entweder per KI produziert oder kopiert und der kopierten Person fremde Worte in den Mund legt, um etwa politische Meinungen zu vertreten oder Produkte anzupreisen. Diese Fälle sollen durch das Tool zur Ähnlichkeitserkennung nun schneller erkannt und damit unterbunden werden.

Lesen Sie auch

(fds)

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenAdobe Firefly Boards › PAGE online

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenPosit stellt Positron vor: Neue IDE für Data Science mit Python und R

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenEventSourcingDB 1.1 bietet flexiblere Konsistenzsteuerung und signierte Events

-

UX/UI & Webdesignvor 1 Monat

UX/UI & Webdesignvor 1 MonatFake It Untlil You Make It? Trifft diese Kampagne den Nerv der Zeit? › PAGE online

-

UX/UI & Webdesignvor 5 Tagen

UX/UI & Webdesignvor 5 TagenIllustrierte Reise nach New York City › PAGE online

-

Social Mediavor 4 Wochen

Social Mediavor 4 WochenSchluss mit FOMO im Social Media Marketing – Welche Trends und Features sind für Social Media Manager*innen wirklich relevant?