Apps & Mobile Entwicklung

Benchmarks Linux vs. Windows 11 auf Radeon & GeForce

Wie steht es um die Gaming-Performance von Linux auf GeForce und Radeon (Mesa 26) im Vergleich zu Windows 11? ComputerBase hat in 19 Spielen den Benchmark-Test gemacht. Dabei kamen die neuesten Treiber inklusive Mesa-26-Update für AMD-Grafikkarten zum Einsatz, das die Raytracing-Performance deutlich beschleunigt haben soll.

Linux vs. Windows 11 in der Gaming-Performance mit CachyOS

Linux mausert sich immer mehr zu einer ernsten Gaming-Alternative zu Windows. Entsprechend wird das Interesse der Leser an diesem Thema immer größer und so hatte sich ComputerBase vor etwas mehr als einem halben Jahr erstmals die Spiele-Performance von Linux angesehen und diese mit Windows 11 verglichen. Seitdem ist einige Zeit verstrichen und Treiber- sowie Linux-Updates sind erschienen. Es ist also wieder Zeit für einen neuen Vergleich.

Diesmal gibt es dabei eine neue Linux-Distribution: Anstatt EndeavourOS wie beim letzten Mal setzt die Redaktion auf den Community-Liebling CachyOS, das zwar ebenso Arch Linux als Basis nutzt, aber potenziell mit weiteren Optimierungen ausgestattet ist. Die aktuelle Version nutzt den Linux-Kernel „6.19.5-3-cachyos“ Die Linux-Version basiert auf dem aktuellen Open-Source-Paket Mesa 26.0.1, das weitreichende Raytracing-Optimierungen für Radeon-Grafikkarten erhalten hat. Die Treiberversion hört auf die Bezeichnung „26.0.1-arch2.3“. Nvidia-Grafikkarten setzen auf den aktuellen 590.48.01-Treiber. Unter Windows werden der GeForce 591.86 und der Adrenalin 26.2.1 genutzt.

Als Grafikkarten kommen eine GeForce RTX 5070 Ti und eine Radeon RX 9070 XT zum Einsatz. In 19 verschiedenen Spielen müssen diese in WQHD und in Ultra HD, meistens in Kombination mit DLSS 4 beziehungsweise FSR Upscaling AI, zeigen, wie viele Bilder pro Sekunde unter Linux erreicht werden können. Verglichen werden die Ergebnisse mit einem klassisch konfigurierten Windows 11 25H2 inklusive sämtlicher Updates. Die genauen Spieleinstellungen sind weiter unten detaillierter aufgeführt.

Es gibt Beschränkungen und Unterschiede

ComputerBase nutzt für diesen Test ausschließlich Proton für Steam, entsprechend werden auch nur auf Steam verfügbare Spiele getestet. Zwar lassen sich auch Spiele auf anderen Launchern oder native Titel einbinden, doch ist dies teils komplexer, was für den Test vermieden werden sollte. Die meisten Steam-Spiele laufen hingegen unter Linux mit nicht mehr als einem Doppelklick auf „Starten“. Wie gut welche Spiele laufen, darüber klärt Steam selbst, aber auch die ProtonDB auf. Handfeste Aussagen zur Performance Windows vs. Linux gibt es dort aber nicht.

Was darüber hinaus ebenso nicht getestet werden kann, sind Spiele mit gewissen Anti-Cheat-Mechanismen. EA-Spiele wie zum Beispiel F1 25 laufen generell nicht unter Linux, da diese nicht mit dem Betriebssystem kompatibel sind. Diese Spiele können entsprechend ebenso nicht getestet werden.

Keine „Windows-Benchmark-Tools“

Was die klassischen Hardware- sowie Benchmark-Tools angeht, herrscht unter Linux Flaute. Das, was man unter Windows gewohnt ist, funktioniert unter Linux nicht, so zum Beispiel MSI Afterburner oder CapFrameX – auch wenn von letzterem eine angepasste Linux-Version demnächst erscheinen soll. Bei einer Radeon fehlt sogar das gesamte Treibermenü. Das hat zur Folge, dass potenziell eine ganze Menge Dritt-Software installiert werden muss.

Als Benchmark-Software dient MangoHUD mit Goverlay als grafische Oberfläche, in der sich durchaus einiges einstellen lässt. Wichtig zu erwähnen ist, dass die Zählweise der Frames völlig anders als unter Windows funktioniert und mit MangoHUD deutlich ungenauer ist.

Denn während die Benchmark-Tools unter Windows zum Beispiel durchweg jeden einzelnen Frame erfassen, macht dies zumindest MangoHUD nicht. Stattdessen wird nur alle x Millisekunden (konfigurierbar) die Informationen abgefragt, was weniger genau ist und auch mehr Hardware-Ressourcen fordert. Das framegenaue Protokollieren unter Windows kostet weniger CPU-Zeit als das Protokollieren alle 10 Millisekunden unter Linux, obwohl ersteres genauer ist. Die Performancekosten sind zwar gering, aber auch mit einer schnellen CPU messbar. Das gilt auch für diesen Artikel: Je nach Spiel gehen zwischen 0 bis 2 Prozent an FPS durch die Benchmark-Protokollierung unter Linux verloren.

Es werden viele (ganz viele) Shader kompiliert

Shader vorab zu kompilieren, ist in Spielen mittlerweile ganz normal. Auch über Steam für Linux wird dies gemacht, in diesem Fall aber initiiert auch über Proton. Das von Windows bekannte Kompilieren in Spielen fällt dann weg oder kürzer aus, das Prozedere vor dem Start zieht sich aber. Auf einer Radeon-Grafikkarte ist die Wartezeit meistens ziemlich kurz, ganz anders dagegen schaut es auf einer GeForce aus. Auch hier kann die Sache nach wenigen Sekunden erledigt sein. Immer mal wieder – und das gar nicht so selten – dauert es aber mehrere Minuten. Und da können auch auf einem Ryzen 7 9800X3D schnell einmal 15 bis 20 Minuten bis zum Spielstart vergehen. Das ist eine ziemlich nervige Angelegenheit.

Apps & Mobile Entwicklung

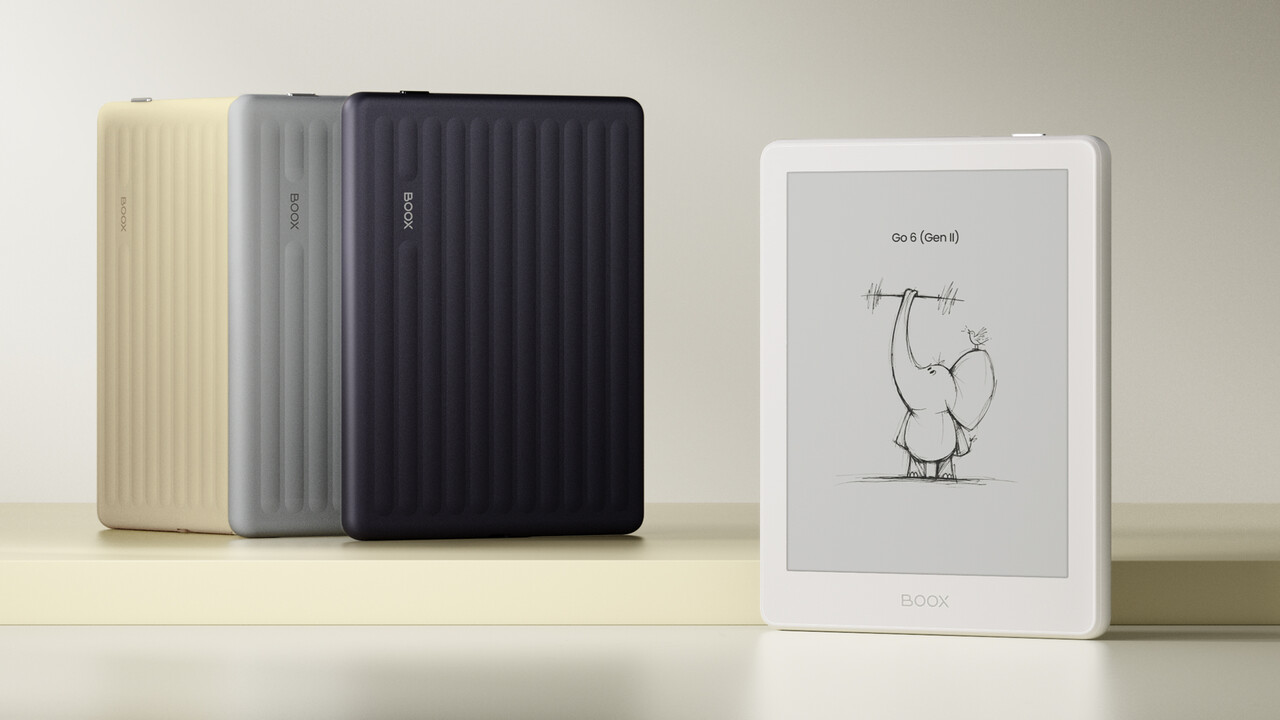

Kompakter 6-Zoll-E-Reader: Boox Go 6 (Gen. 2) richtet sich vor allem an mobile Nutzer

Die zweite Generation des Go 6 soll laut Boox ein kompakter E-Book-Reader sein, der sich an Reisende, Pendler und andere mobile Nutzer richtet. Das neue Modell kombiniert handschriftliche Notizfunktionen mit der Flexibilität von Android und will Lesen, Schreiben sowie die digitale Organisation in einem handlichen Gerät vereinen.

Für kleines Gepäck gemacht und von diesem inspiriert

Im Mittelpunkt der neuen Generation steht ein vollständig überarbeitetes Design, für das laut Hersteller Reisekoffer als Vorbild gedient haben sollen. Die strukturierte Rückseite mit griffigen Rillen und abgerundeten Kanten soll nicht nur optische Akzente setzen, sondern zugleich die Handhabung verbessern. Mit Abmessungen von lediglich 109 × 149 × 6,8 mm soll sich der Reader problemlos in Jackentaschen, Handtaschen oder kleinerem Gepäck verstauen lassen und so zum ständigen Begleiter werden. Das geringe Gewicht von 160 g soll diesen Anspruch zusätzlich unterstreichen.

Fast 6 Jahre altes Android als OS

Das sechs Zoll große Graustufen-Display löst mit 1.072 × 1.448 Bildpunkten auf und erreicht eine Pixeldichte von 300 ppi, wodurch Texte scharf dargestellt werden sollen. Eine Vordergrundbeleuchtung mit integriertem Blaulichtfilter soll Inhalte zudem auch bei ungünstigen Lichtverhältnissen gut lesbar halten. Angetrieben wird der neue Reader von einem nicht näher bezeichneten Achtkern-SoC aus dem Hause Qualcomm, dem 3 GB Arbeitsspeicher sowie 32 GB interner Speicher zur Seite stehen. Letzterer lässt sich zusätzlich per microSD-Karte erweitern. Zur weiteren Ausstattung zählen WLAN im 2,4- und 5-GHz-Band sowie Bluetooth 5. Für die Energieversorgung sorgt ein Akku mit einer Kapazität von 1.500 mAh, der für eine ausreichende Laufzeit sorgen soll.

Die technische Ausstattung ist bei der Nutzung des nicht mehr ganz taufrischen Android 11 und vor allem bei der damit verbundenen Unterstützung des Google Play Store jedoch erforderlich. Dadurch lässt sich der E-Book-Reader mit einer Vielzahl zusätzlicher Anwendungen ausstatten, was die Einsatzmöglichkeiten deutlich erweitert. Bereits ab Werk unterstützt der Go 6 (Gen. 2) zahlreiche Dateiformate, dank Android-Unterstützung können darüber hinaus beispielsweise über die aufgespielte Kindle-App auch DRM-geschützte E-Books auf dem neuen Reader gelesen werden.

Stiftunterstützung für größere Nutzungsmöglichkeiten

Neu ist zudem die Unterstützung des im Lieferumfang enthaltenen InkSense Plus-Stylus. Dieser erweitert den klassischen Funktionsumfang eines E-Book-Readers noch einmal um Anmerkungen in Büchern, Markierungen von Textpassagen sowie handschriftliche Notizen. Der Stift bietet die üblichen 4.096 Druckstufen, unterstützt Neigungserkennung und verfügt über eine Taste, die individuellen mit Funktionen belegt werden kann.

Verkaufsstart hat begonnen

Der Boox Go 6 (Gen. 2) ist ab sofort in den vier Farbvarianten Plum, Stone, Shell und Custard erhältlich. Für den E-Book-Reader nennt der Hersteller eine unverbindliche Preisempfehlung von 199,99 Euro.

Apps & Mobile Entwicklung

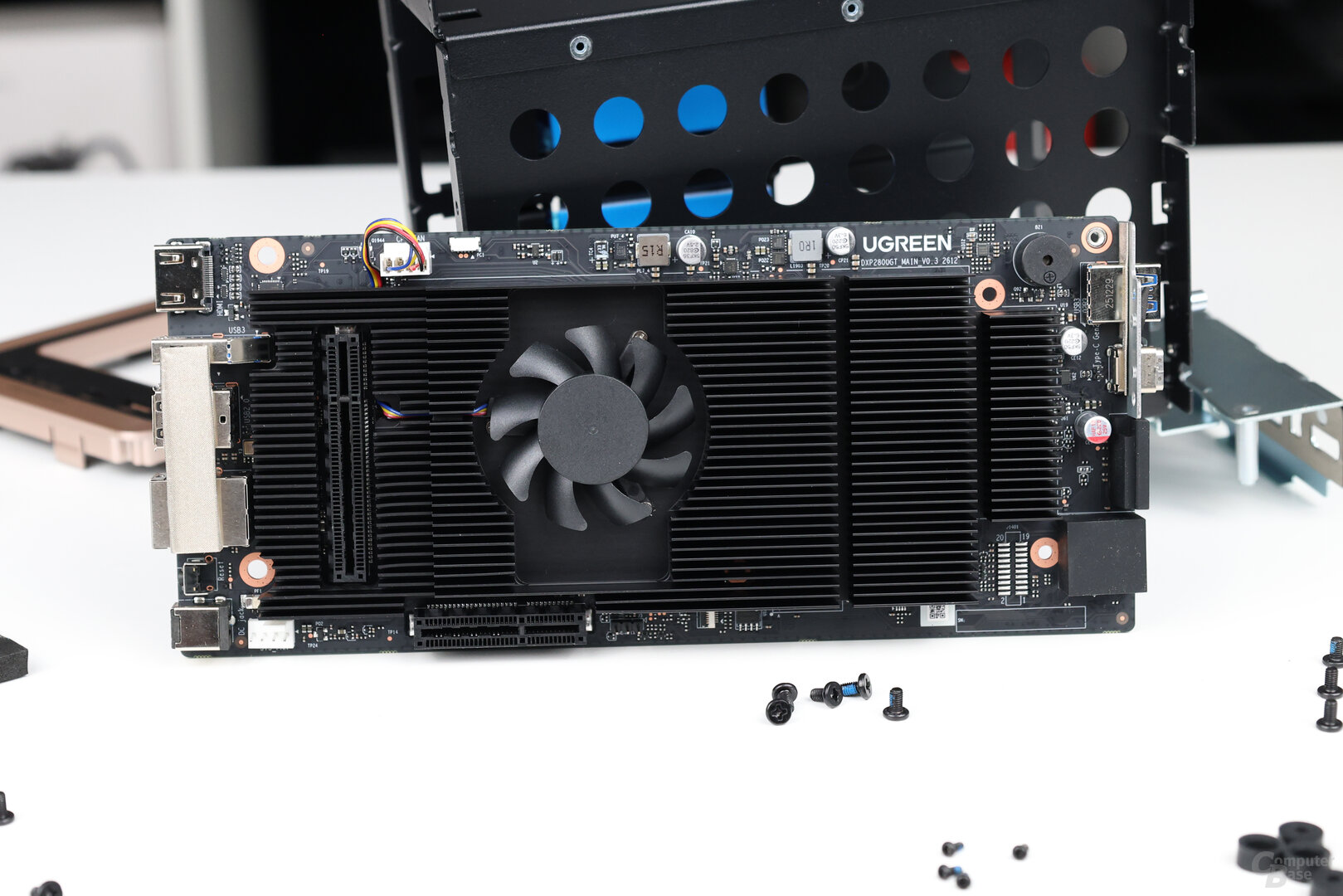

Ugreen DXP4800 GT & DXP2800 GT im Test

Die neuen Ugreen NAS der GT-Serie, DXP2800 GT und DXP4800 GT, treten mit AMD Ryzen, 10 Gigabit LAN und U.2 an. So sollen sie sich stärker als Home-Server positionieren, der zahlreiche Aufgaben parallel erledigen kann. Im ComputerBase-Test profitieren sie allein vom schnelleren LAN im Vergleich zu DXP2800 und DXP4800 schon enorm.

Mit der GT-Serie, bestehend aus dem 4-Bay DXP4800 GT und 2-Bay DXP2800 GT, stellt Ugreen zwei neue Mittelklasse-NAS der DXP-Serie vor, mit der der Hersteller vor zwei Jahren auf dem deutschen Markt gestartet ist und das NAS-Geschäft mit aktueller Technik aufgewühlt hat. Die neuen GT-Modelle sind zwischen den für Einsteiger gedachten DH-Modellen und der neuen, maximal ausgestatteten iDX-Serie mit den AI-NAS iDX6011 und iDX6011 Pro (Test) platziert. Im Vergleich zu der ursprünglichen DXP-Serie mit dem DXP2800 (Test) und DXP4800 (Test) sollen die beiden GT-NAS einige signifikante Upgrades bieten. Unter anderem setzen die neuen GT-NAS auf eine stärkere CPU, nämlich den AMD Ryzen Embedded R2514 mit 4 Kernen, 8 Threads und bis zu 3,7 GHz.

Ugreen zielt mit den neuen Systemen insbesondere auf Nutzer ab, die als Content Creator immer schnellen Zugriff auf ihre Daten benötigen, ohne diese zwischen verschiedenen Systemen zu verschieben, oder die Systeme beispielsweise als Smart-Home-Zentrale zusätzlich 24/7 im Dauereinsatz betreiben möchten.

Preis und Verfügbarkeit

Das neue DXP4800 GT und DXP2800 GT sind ab sofort verfügbar. Die unverbindliche Preisempfehlung des DXP2800 GT beträgt 509,99 Euro. Das DXP4800 GT kostet 659,99 Euro. Bis 22. Juni ist das DXP2800 GT für 459,99 Euro und das DXP4800 GT für 589,99 Euro erhältlich. Noch günstiger wird es mit dem 20-Prozent-ComputerBase-Rabatt. Denn Ugreen hat speziell für die Leser von ComputerBase einen Rabattcode bereitgestellt. Mit diesem erhalten ComputerBase-Leser 20 Prozent Rabatt auf die neuen NAS-Systeme der GT-Serie. Der Code ist nicht mit Launch-Rabatten kombinierbar, reduziert die Preise aber auf 399,99 Euro (DXP2800 GT) beziehungsweise 527,99 Euro (DXP4800 GT).

Die Rabatt-Codes lauten:

- 20 % Rabatt auf DXP2800 GT mit dem Code: 2800GTCBAS

- 20 % Rabatt auf DXP4800 GT mit dem Code: 4800GTCBAS

Auch im Ugreen-Store auf Amazon sind die neuen Systeme verfügbar:

Zunächst werden die neuen NAS-Systeme ihrem jeweiligen Pendant ohne GT-Zusatz aus der DXP-Serie gegenübergestellt, um die Unterschiede und Gemeinsamkeiten in der Technik aufzuzeigen.

DXP2800 GT im Vergleich zur DXP2800

DXP4800 GT im Vergleich zum DXP4800 und DXP4800 Plus und DXP4800 Pro

Die direkte Gegenüberstellung der technischen Daten zeigt vor allem in zwei Bereichen Upgrades der GT-Serie: Prozessor und Netzwerk.

AMD Ryzen statt Intel-CPU

Ugreen setzt bei beiden neuen NAS-Systemen auf den AMD Ryzen Embedded R2514 mit 4 Kerne, 8 Threads, 2,1 GHz Basistakt und bis zu 3,7 GHz Turbotakt. Als Embedded-Prozessor verkauft AMD diesen noch bis ins Jahr 2032, obwohl er bereits 2022 vorgestellt wurde. Die Architektur ist nicht mehr die neueste, denn die R2000-Serie setzt noch auf Zen+, während die V2000-Serie von AMD darüber angesiedelt ist und schon Zen 2 nutzt. Dafür bietet der R2514 vier Kerne und acht Threads und unterstützt maximal DDR4-2667 mit ECC. Zudem verfügen die CPUs über die integrierte Grafikeinheit Vega8 mit 512 Shadern. Die TDP des in 12 nm im FP5-Package hergestellten Prozessors beträgt 15 Watt. PCIe liefert er nach Gen 3 über 16 Lanes.

Durch den neuen Ryzen-Embedded-Prozessor sollen sich vor allem dann Verbesserungen ergeben, wenn mehrere Aufgaben parallel erfüllt werden müssen, also beispielsweise Docker, Backups und Dateitransfers parallel laufen.

Aktive Kühlung notwendig

Zudem sind die Embedded-Prozessoren für einen stabilen Dauerbetrieb ausgelegt, bei dem sie nicht heruntertakten und nicht überhitzen. Dafür kühlt Ugreen die CPUs in der neuen GT-Serie allerdings auch mit einem weiteren Lüfter direkt auf dem CPU-Kühler. Dies ist beim DXP2800 und DXP4800 nicht nötig, hier nutzt Ugreen einen passiven Kühlkörper und den Luftstrom des großen Lüfters an der Rückseite des NAS.

Optional mit ECC-RAM

Darüber hinaus unterstützt der Ryzen-Prozessor auch ECC-Arbeitsspeicher, also Speicher mit automatischer Fehlerkorrektur, um die langfristige Datenintegrität zu gewährleisten. Ab Werk sind die NAS-Systeme allerdings mit RAM ohne ECC ausgestattet. Möchte man ECC nutzen, muss man den verbauten RAM also ersetzen. Die Option hat man aber.

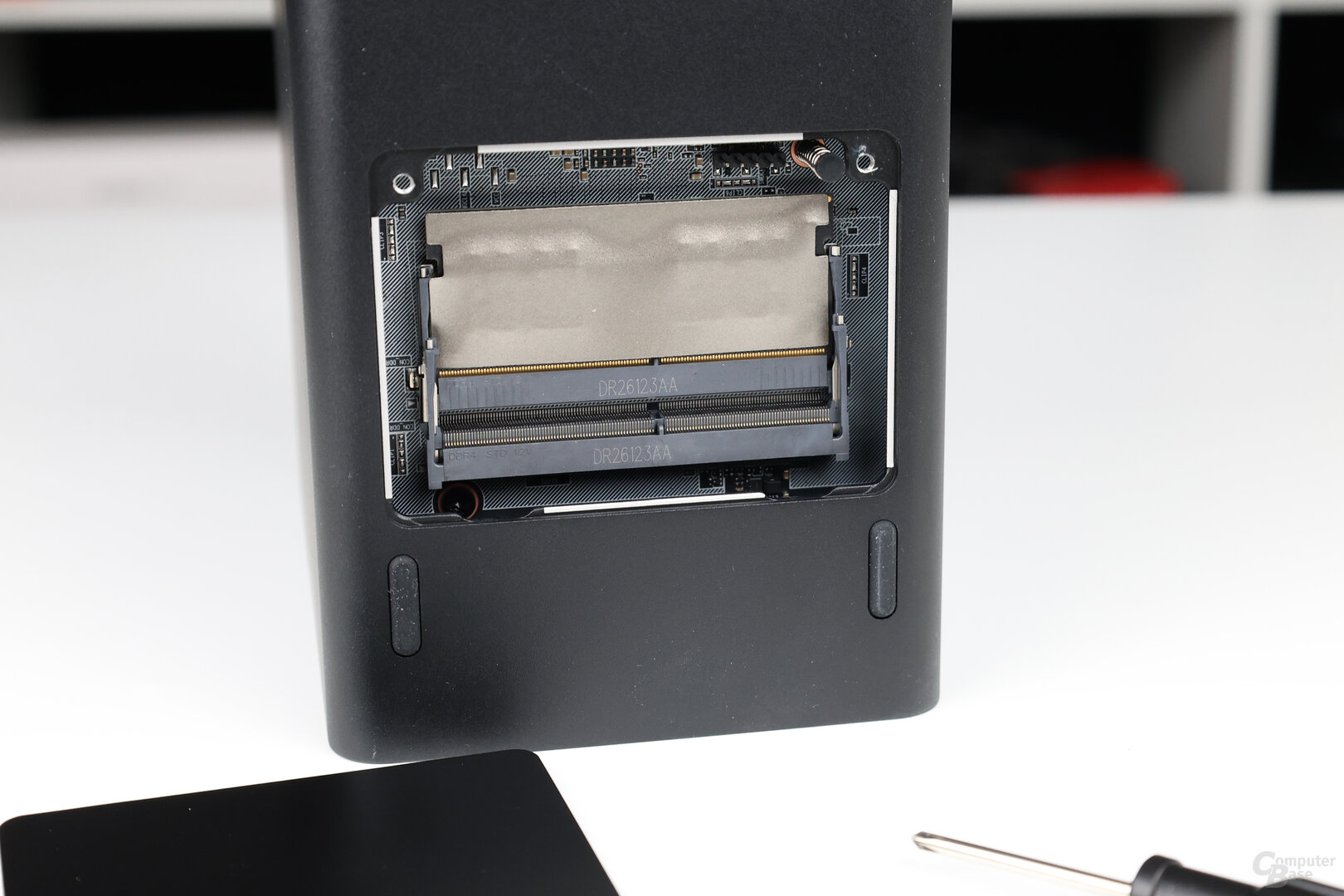

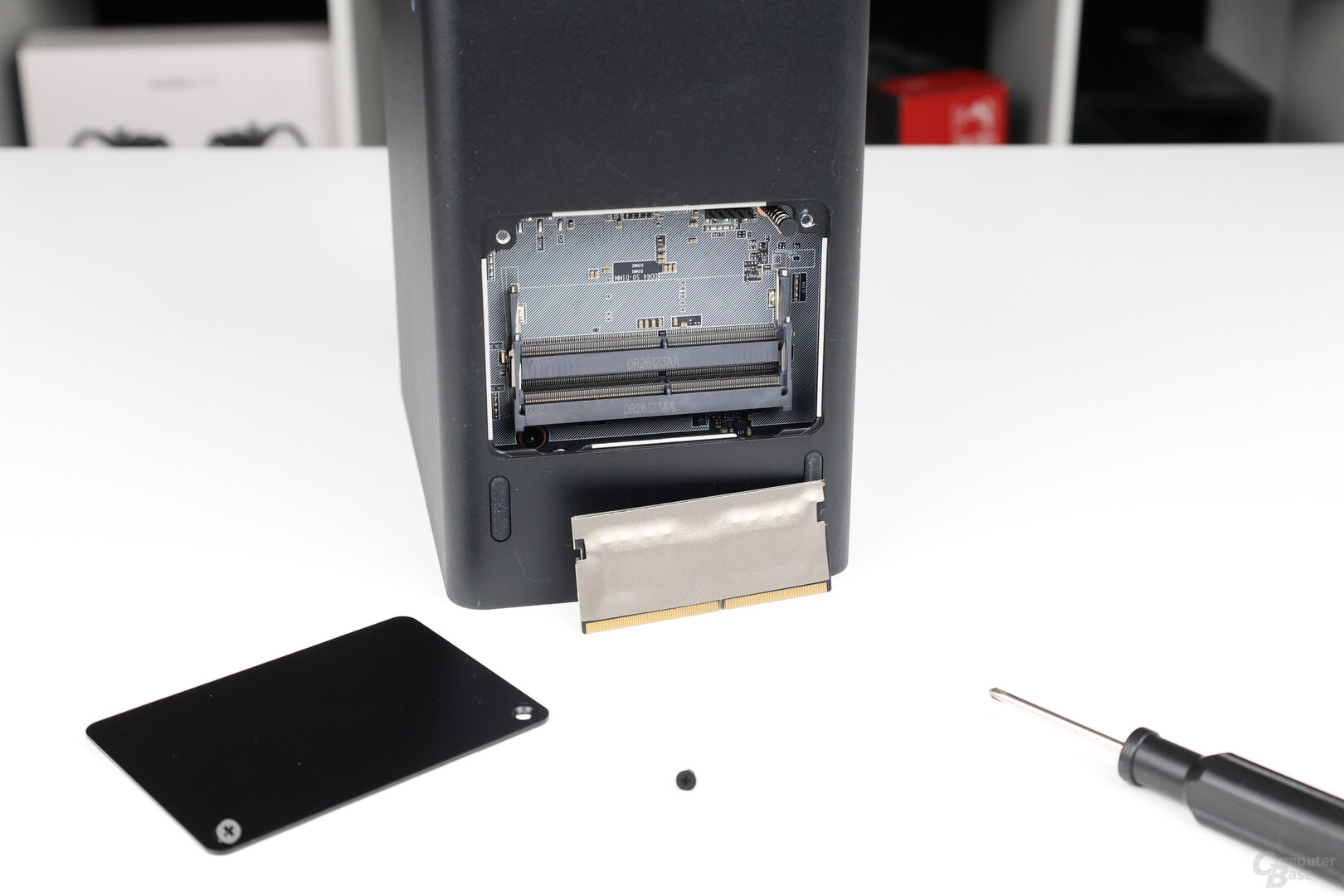

Der Wechsel von Intel auf AMD bedeutet zudem wieder einen Wechsel von DDR5 auf DDR4. Ugreen verbaut zwei SODIMM-Steckplätze, von denen ab Werk einer mit einem 8-GB-Modul belegt ist, das Ugreen mit 3.200 MHz ansteuert, also schneller als AMDs offizielle Spezifikationen, an die sich NAS-Hersteller sonst eigentlich halten. RAM lässt sich also auch bei den neuen NAS einfach upgraden, indem die Abdeckung an der Unterseite geöffnet wird. Maximal lassen sich offiziell 64 GB in den NAS nutzen.

Immer 10 Gigabit Ethernet

Das zweite wichtige Upgrade liegt im Bereich der Netzwerkanschlüsse. Denn die GT-Serie bietet immer 10-Gigabit-LAN. Auch das DXP2800 GT bietet einen einzelnen LAN-Anschluss mit 10 GbE. Das DXP4800 GT verfügt sogar über zwei LAN-Anschlüsse mit 10 GbE.

Das beschleunigt nicht nur die maximal mögliche Datentransferrate, sondern Ugreen hat es auch hier vor allem auf Nutzer abgesehen, die verschiedene Dienste gleichzeitig auf dem NAS nutzen möchten. Wenn Home Assistant, Plex, Smart-Home-Kameras und Dateitransfers gleichzeitig auf die Bandbreite der Netzwerkschnittstelle zurückgreifen, bietet diese mit 10 Gigabit/s nun mehr Spielraum, um parallele Anwendungen gleichzeitig zu versorgen.

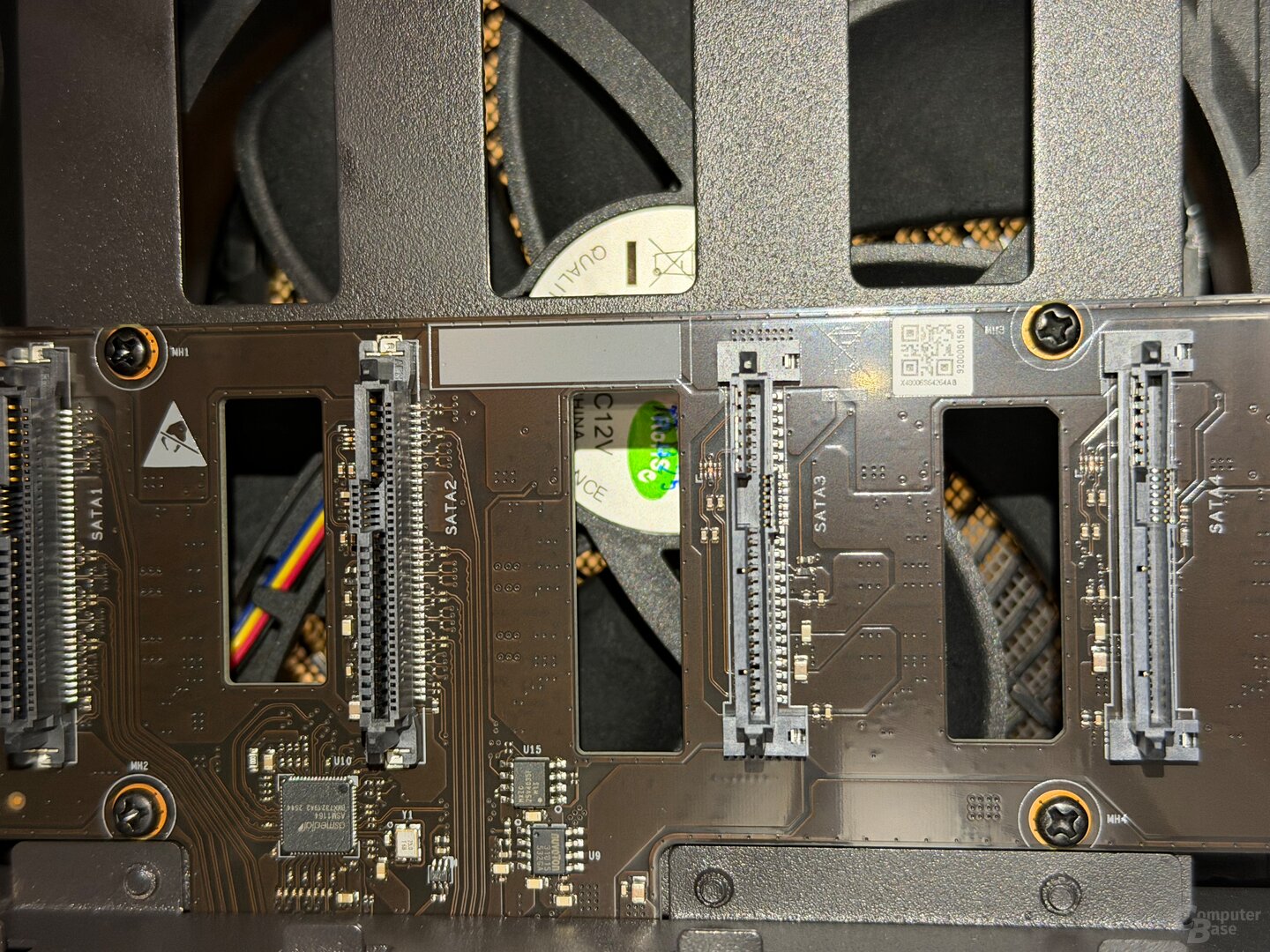

U.2-NVMe-SSDs in den SATA-Bays

Eine weitere Neuerung, die in den technischen Daten nicht sofort ersichtlich ist, betrifft den Hauptspeicher, der unterstützt wird. Denn die GT-Serie unterstützt auch U.2-NVMe-SSDs über zwei Bays. U.2 ist eine Hardware-Schnittstelle, die primär in Datenzentren genutzt wird und sowohl SAS, SATA als auch PCI Express elektrisch unterstützt. So können in den gleichen Steckplätzen Massenspeicher mit allen drei Protokollen genutzt werden. Gedacht ist U.2 für Workstations, Server- oder Storagesysteme – entsprechend teuer sind diese Laufwerke im Handel.

Doch warum unterstützt Ugreen U.2-NVMe-SSDs? Das Unternehmen möchte hiermit insbesondere eine schnellere Alternative zu SATA abseits der beiden M.2-Steckplätze bieten, sofern schnell auf große Dateien auf den Speichervolumes zugegriffen werden soll. Zudem sind U.2-Laufwerke wie der Embedded-Prozessor auf einen Dauerbetrieb ausgelegt und verfügen meist über eine längere Lebensdauer als Consumer-SSDs unter Dauerlast. Mit SATA, U.2 und M.2 bietet Ugreen nun für verschiedene Workloads unterschiedlich abgestufte Optionen, etwa SATA für die Datenarchivierung, U.2 SSDs für häufig frequentierte Workloads und M.2 SSDs für Docker-Container.

Einschränkend muss beachtet werden, dass das DXP4800 GT U.2 nur in den SATA-Bays 1 und 2 unterstützt. Dies liegt an den begrenzten, aber notwendigen PCIe-Lanes. In den SATA-Bays 3 und 4 können ausschließlich normale SATA-Laufwerke genutzt werden.

10 Gbit/s über USB-A und USB-C

Bei den neuen GT-NAS bieten die USB-A-Schnittstellen nun immer 10 Gbit/s, während je nach Modell vorher nur einer dieser Anschlüsse die volle Geschwindigkeit geboten hat. So lassen sich externe Speichermedien über alle USB-A-Schnittstellen mit maximaler Geschwindigkeit ansprechen. Zudem sind ein USB-C-Anschluss mit 10 Gbit/s und zwei langsamere USB-2.0-Ports verbaut. An der Vorderseite sind der USB-C-Port und ein USB-A-3.2-Anschluss platziert, die beiden USB-2.0-Schnittstellen und die zweite USB-3.2-Buchse sind an der Rückseite verbaut.

Bekannte Qualitäten der Ugreen-NAS bleiben erhalten

HDMI-Ausgang für Videostreaming

Dank der Radeon Vega 8 können auch das DXP2800 GT und DXP4800 GT wieder einen HDMI-Ausgang bieten, der 4K und 8K unterstützt. Schließt man ein Display am NAS an, kann man Videoinhalte vom Smartphone über die Ugreen-App an das NAS streamen. Lokale Inhalte lassen sich ebenso wenig über HDMI abspielen wie das Bild virtueller Maschinen darauf ausgeben.

HDDs und M.2-SSDs als Volume und Cache

Abseits von der Unterstützung für U.2-Laufwerke bietet das DXP2800 GT erneut Platz für zwei SATA-HDDs oder -SSDs und zusätzlich zwei M.2-SSDs. Beim DXP4800 GT können vier SATA-HDDs oder -SSDs und ebenfalls zwei M.2-SSDs eingesetzt werden. Die M.2-Laufwerke lassen sich wahlweise als Cache oder aber auch als normale Laufwerke für Speicherpools nutzen. Hier gibt es seitens Ugreen keinerlei Beschränkungen. Theoretisch lassen sich die NAS so auch nur mit einer oder mehreren M.2-SSDs betreiben.

Beim DXP2800 GT sind die M.2-Steckplätze über die Innenseite der Bays erreichbar. Nimmt man die beiden Laufwerksrahmen heraus, sind seitlich die beiden M.2-Steckplätze mit Wärmeleitpads zu sehen – deren Folie muss bei der Montage der Laufwerke noch entfernt werden. Bei der größeren DXP4800 GT hat Ugreen die beiden M.2-Ports hingegen wieder an der Unterseite unter der Abdeckung platziert, über die auch der RAM zugänglich ist. Entsprechend passende, dicke Wärmeleitpads liegen dem NAS bei, um auch hier die Laufwerke mit dem Gehäuse des NAS thermisch zu verbinden.

3,5-Zoll-Laufwerke lassen sich auf den Laufwerksrahmen erneut schrauben- und werkzeuglos montieren. Die Installation ist so mit wenigen Handgriffen erledigt und das NAS einsatzbereit. Für die Montage von 2,5-Zoll-SSDs liegen Schrauben und ein kleiner Schraubendreher bei.

Die Laufwerksrahmen sind durchnummeriert, wodurch die Reihenfolge der Laufwerke beim gleichzeitigen Herausnehmen der Einschübe nicht durcheinandergerät. Um die Rahmen herauszunehmen, muss lediglich der untere Bereich am Rahmen gedrückt werden und die Arretierung wird gelöst. Die Laufwerksrahmen können im NAS gesichert werden, was aber nur verhindert, dass sie ohne Werkzeug gelöst werden können – ein Diebstahlschutz ist dies nicht.

Kein Upgrade über PCIe-Slot

Einen PCIe-Slot, um eine weitere Netzwerk- oder andere Erweiterungskarte in das NAS einzusetzen, weisen beide Modelle nicht auf.

Hervorragende Verarbeitung

Abgesehen von den goldenen Akzenten weisen beide neuen GT-NAS-Modelle das bekannte Ugreen-Design auf. An der Vorderseite sind die LEDs für das System und die Laufwerke sowie der Power-Button untergebracht. LAN-Ports, der Anschluss für das Netzteil und der HDMI-Ausgang sind hingegen an der Rückseite zu finden. Das externe Netzteil mit Hohlstecker liefert bis zu 72 Watt beim DXP2800 GT und bis zu 150 Watt beim DXP4800 GT.

An der Verarbeitung beider NAS-Systeme gibt es erneut nichts auszusetzen. Die Laufwerksrahmen sind stabil und fassen gut im Gehäuse, die Metallgehäuse selbst sind erneut ohne große Spaltmaße perfekt gefertigt.

Auch der Blick ins Innere zeigt den durchdachten Aufbau, wobei man als Nutzer keinen Grund hat, das Gehäuse zu öffnen, möchte man nicht beispielsweise den rückseitigen Lüfter austauschen, was dank gestecktem 4-Pin-Anschluss problemlos möglich ist. Eine interne SSD wie bei den größeren Modellen von Ugreen findet sich in den neuen GT-Modellen aber nicht, der Speicher für das System ist fest verlötet.

Mit etwas Geduld lassen sich die NAS-Systeme der GT-Serie also wieder vollständig zerlegen, falls man die Wärmeleitpads gegen Wärmeleitpaste austauschen, Lüfter wechseln oder andere Modifizierungen vornehmen möchte.

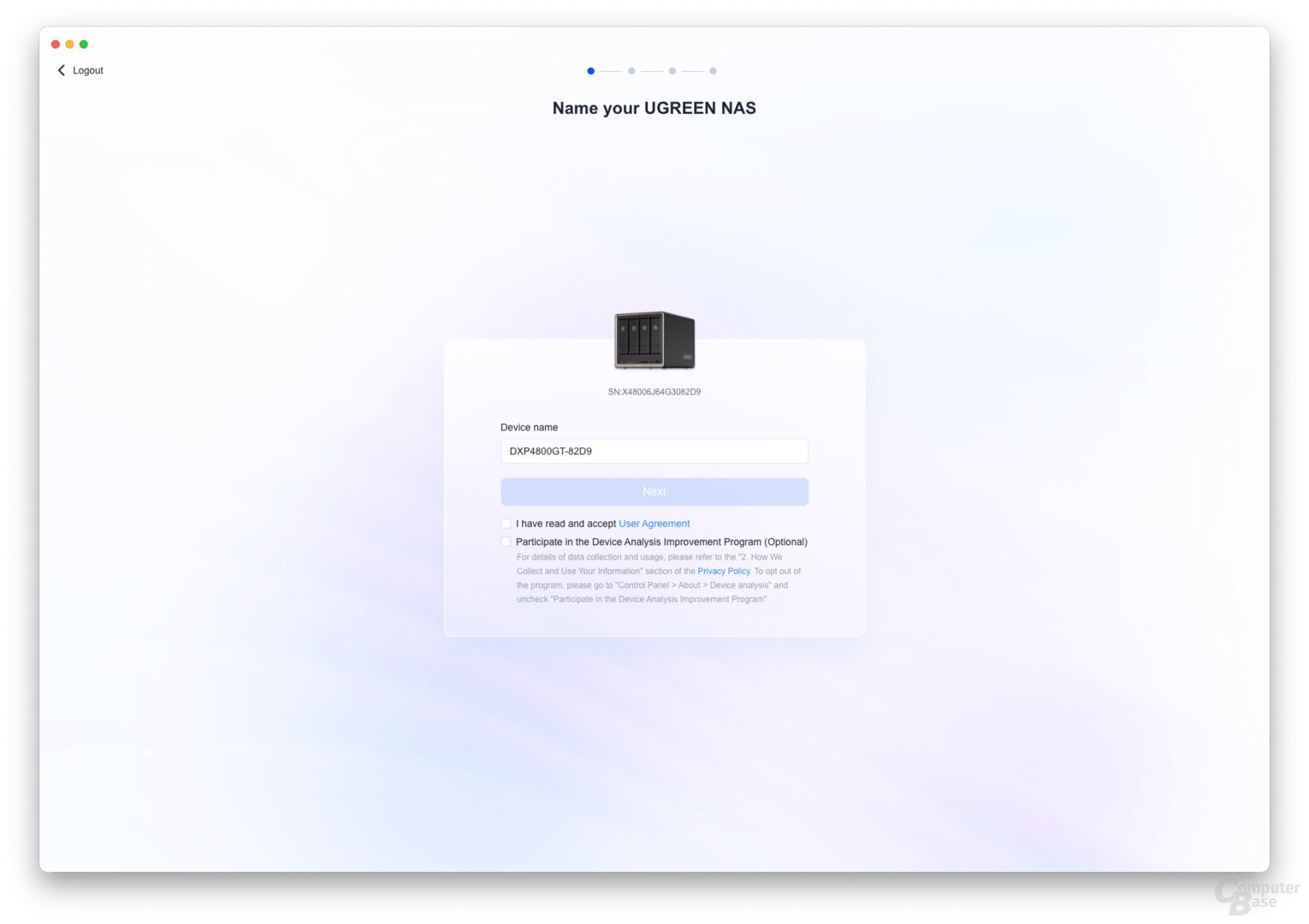

Inbetriebnahme des Ugreen-NAS

Die GT-Modelle von Ugreen ändern an der Inbetriebnahme und der Software zunächst nichts. Laufwerke einbauen, Strom und LAN anschließen, einschalten und entweder per IP, find.ugnas.com oder Ugreen-NAS-Software auf das NAS im Netzwerk zugreifen. Beim Zugriff wird man direkt durch die ersten Schritte wie die Vergabe eines Netzwerknamens und eines Administratorkontos sowie die Konfiguration der Laufwerke und das Einrichten eines Volumes und erster Ordner geführt.

Innerhalb weniger Minuten ist das erste Setup erledigt und man kann während der Synchronisation eines etwaigen RAID-Verbunds mit der weiteren Konfiguration und Installation von Apps fortfahren. Je nach Anzahl der Laufwerke kann man bei ihrer Konfiguration aus einem Einzellaufwerk, JBOD, RAID 0, RAID 1, RAID 5, RAID 5 + Hot Spare, RAID 6 und RAID 10 wählen. Neben ext4 wird auch btrfs als Dateisystem bei der Formatierung der Laufwerke unterstützt. Neben der Erstellung von Snapshots wird auch eine Dateiversionierung geboten, so dass die wichtigsten Funktionen gegen unbeabsichtigtes Löschen von Dateien abgedeckt sind.

Im Test kommt Version 1.15.20.0004 von UGOS Pro zum Einsatz. Das NAS-Betriebssystem von Ugreen hat seit der ersten Version viele Fortschritte gemacht und viele neue Funktionen erhalten, eine Verschlüsselung auf Laufwerks- oder Ordner-Basis fehlt aber weiterhin. In der Tresor-App lässt sich zwar ein geschützter Bereich erstellen und in diesem Dateien gesondert speichern, dieser lässt sich aber gerade nicht als Freigabeordner anlegen, um leicht auf ihn zuzugreifen. Dateien können nur über den Dateimanager des NAS in den Tresor verschoben werden. Automatisierte Backups in den verschlüsselten Bereich sind ebenso wenig möglich wie der Zugriff über SMB oder andere Standards. Ein Ersatz für eine Ordnerverschlüsselung ist er nicht und diese bleibt Ugreen auch weiterhin schuldig.

Wer selbst sehen möchte, welche Updates Ugreen kürzlich vorgenommen hat oder in naher Zukunft plant, für den hält Ugreen eine eigene Website bereit.

Für weitere Details zu virtuellen Maschinen auf dem NAS, dem Videozentrum und anderen Apps wird an dieser Stelle auf die bisherigen Tests der Ugreen-NAS verwiesen.

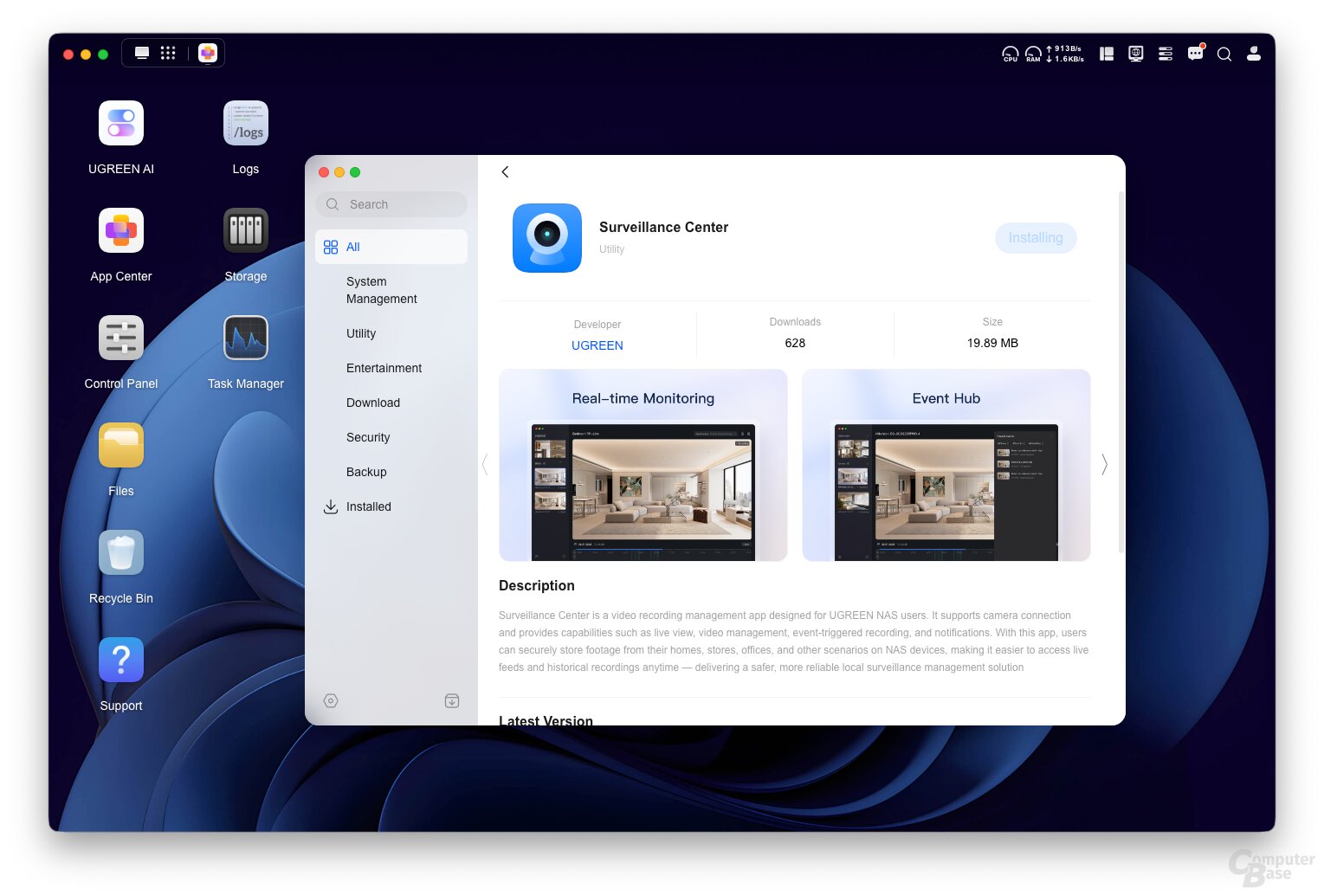

An dieser Stelle wird im Folgenden lediglich eine Neuerung des Betriebssystems vorgestellt, das Surveillance Center.

Auch Ugreen hat jetzt ein Surveillance Center

Außerdem hat Ugreen mit dem Surveillance Center ein neues Feature in der Software freigeschaltet. Dabei handelt es sich derzeit noch um eine Beta-Version, die nicht den finalen Stand darstellt und im Laufe der Zeit weiter verbessert werden soll.

Das Surveillance Center ist wie bei der Konkurrenz etwa von Synology und QNAP eine Anwendung zur Sicherheitsüberwachung, die das NAS zusätzlich als einen Netzwerk-Videorekorder (NVR) nutzen lässt. Nutzer können IP-Kameras hinzufügen und deren Videos aufzeichnen sowie vergangene Aufnahmen wiedergeben. Dies lässt sich auch an Zugriffsrechte koppeln. So kann eingestellt werden, dass Nutzer zwar Livestreams und Aufnahmen ansehen können, aber keinerlei Einstellungen verändern dürfen. Auf Wunsch lassen sich Nutzer auch vollständig vom Zugriff auf das Surveillance Center ausschließen.

Das Surveillance Center ist als eigene App im App Center von UGOS umgesetzt und muss wie die anderen Apps zunächst installiert werden, wenn man es nutzen möchte. Indem jede App nur bei Bedarf installiert wird, wird unnötige Hintergrundaktivität vermieden.

Ugreens Surveillance Center ist vollständig kompatibel mit den gängigen Kamera-Kommunikationsprotokollen ONVIF und RTSP. Ob eine Kamera auf das NAS aufnehmen kann, hängt also in erster Linie von der IP-Kamera ab, nicht vom NAS. Während viele Modelle mit proprietärer Cloud wie die Ring-Kameras von Amazon eine solche Aufnahme auf einem NAS nicht ermöglichen, erlauben es beispielsweise kabelgebundene Kameras von Reolink.

Wählt man in der App „Add camera“ aus, kann die Software zunächst versuchen das Subnetz automatisch nach Kameras zu durchsuchen, bei denen das ONVIF-Protokoll aktiviert ist. Wird eine Kamera gefunden, kann man den Benutzernamen sowie das Passwort für die Authentifizierung eingeben. Kameras lassen sich aber auch manuell anhand der IP-Adresse hinzufügen, wenn sie nicht automatisch erkannt werden.

Bis zu acht Kameras lassen sich dem Surveillance Center derzeit hinzufügen. Für jede Kamera lässt sich der Speicherort, die Aufbewahrungsdauer, die Speicherkapazität, der Aufnahmemodus und ein Kameraname konfigurieren, um die Nutzung des NAS-Speichers zu optimieren. So lässt sich beispielsweise einstellen, dass die älteste Aufnahme immer automatisch überschrieben wird, sobald 500 GB Speicher belegt sind.

Auf der Startseite des Surveillance Center kann man daraufhin einen Livestream aller Kameras einsehen. Auf Wunsch kann man mehrere Kameras gleichzeitig abspielen oder sich eine Kamera größer anzeigen lassen. Wird ein Livestream per Doppelklick ausgewählt, kann man auf die Aufnahmen zugreifen und gezielt Zeitpunkte auswählen. Das System erstellt automatisch alle 10 Minuten eine neue Videodatei.

Unterstützt eine Kamera PTZ, werden unten rechts Bedienelemente angezeigt, um sie zu bewegen.

(*) Bei den mit Sternchen markierten Links handelt es sich um Affiliate-Links. Im Fall einer Bestellung über einen solchen Link wird ComputerBase am Verkaufserlös beteiligt, ohne dass der Preis für den Kunden steigt.

Apps & Mobile Entwicklung

„Chat is dead“: OpenAI plant größte Umgestaltung von ChatGPT seit 2022

OpenAI bereitet Berichten zufolge die größte Neuausrichtung von ChatGPT seit dessen Einführung 2022 vor. Der Chatbot soll schrittweise von einer reinen Frage-und-Antwort-Plattform zu einer umfassenden KI-Anwendung weiterentwickelt werden. Mit diesem Kurswechsel reagiert das Unternehmen auf den zunehmenden Wettbewerb im KI-Markt.

KI-Agenten sind die Zukunft

Laut einem Bericht der Financial Times sieht OpenAI die Zukunft künstlicher Intelligenz nicht länger in klassischen Chatbots, sondern in KI-Agenten. Diese sollen künftig zunehmend eigenständig auch komplexe Aufgaben übernehmen, anstatt lediglich wie bisher nur Antworten auf Fragen zu liefern. Darin sieht das Unternehmen das deutlich größere Potenzial, auch mit Blick auf die wirtschaftlichen Aspekt. Ein ranghoher Mitarbeiter brachte diese Entwicklung intern mit den Worten „Chat is dead“ auf den Punkt und verdeutlichte damit den Strategiewechsel innerhalb des Unternehmens.

Eine zentrale Rolle bei dieser Transformation soll Codex, OpenAIs Plattform für Programmierung und Softwareentwicklung, einnehmen. Obwohl OpenAI beim Start im Februar deutlich hinter anderen Anbietern zurückgelegen hatte, verzeichnete der KI-Agent im weiteren Verlauf ein hohes Wachstum und kann mittlerweile mehr als fünf Millionen wöchentlich aktive Nutzer auf sich verbuchen. Intern gilt Codex als eine der wichtigsten Einnahmequellen des Unternehmens, da Programmierwerkzeuge und produktive KI-Anwendungen deutlich höhere Erlösmöglichkeiten versprechen als die kostenlose Nutzung von ChatGPT. Entsprechend sollen Codex und verwandte Funktionen künftig deutlich stärker in den Mittelpunkt der Plattform rücken.

Erste Auswirkungen stehen bevor

Erste Folgen der neuen Strategie sollen bereits in den kommenden Wochen sichtbar werden. Geplant sind Anpassungen an der Website sowie an den mobilen ChatGPT-Anwendungen. Darüber hinaus soll OpenAI offenbar an einer engeren Einbindung von Partnerdiensten arbeiten. Langfristig soll die KI selbstständig erkennen, welche Aufgabe ein Nutzer erledigen möchte, und automatisch die passenden Werkzeuge oder Dienste bereitstellen, ohne dass zwischen verschiedenen Anwendungen gewechselt werden muss.

Damit nähert OpenAI das eigene Geschäftsmodell zunehmend der Strategie des direkten Konkurrenten Anthropic an, der sich bereits früh auf Geschäftskunden konzentriert hatte – ein Ansatz, der sich als erfolgreich erwiesen hat. Nach Einschätzung von Jenny Xiao, Partnerin bei Leonis Capital und ehemalige Forscherin bei OpenAI, verfolgen dem Bericht zufolge inzwischen sowohl OpenAI als auch Anthropic das Ziel, ihre Geschäftsmodelle stärker auf Profitabilität auszurichten und sich für mögliche Börsengänge attraktiv zu positionieren.

- ChatGPT-Superapp und Agenten: Wie sich OpenAI aus der (öffentlichen) Misere befreien will

- ChatGPT, Codex und Browser verbinden: OpenAI will ChatGPT zur Super-App umbauen

Auch intern hat das Unternehmen mit der Neuorganisation bestehender Strukturen die Voraussetzungen geschaffen, neue Wege einzuschlagen. So wurden unter anderem Codex und weitere Anwendungen unter einer gemeinsamen Führung gebündelt, während gleichzeitig mehrere hochrangige Führungskräfte das Unternehmen verlassen haben. Auch diese Veränderungen verdeutlichen, dass OpenAI den Bereich der Unternehmenskunden als wichtigen Faktor für das weitere Wachstum erkannt zu haben scheint.

Eine App für alles

Hinter all diesen Maßnahmen dürfte die langfristige Vision stehen, ChatGPT von einem einzelnen Produkt zu einer universellen KI-Plattform weiterzuentwickeln. OpenAI geht davon aus, dass die Grenzen zwischen Chatbots, Suchmaschinen, Programmierwerkzeugen, Produktivitätssoftware und digitalen Assistenten künftig zunehmend verschwimmen werden. Statt zahlreiche unterschiedliche Anwendungen zu nutzen, könnten Anwender künftig mit einer einzigen KI interagieren, die sämtliche Aufgaben koordiniert und ausführt. OpenAI-Manager Alex Embiricos geht sogar davon aus, dass in einer Zukunft mit sehr leistungsfähiger künstlicher Intelligenz die Vielzahl eigenständiger Software-Marken weitgehend verschwinden könnte, weil Nutzer ihre Anforderungen direkt an einen zentralen digitalen Assistenten richten.

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenMähroboter ohne Begrenzungsdraht für Gärten mit bis zu 300 m²

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateniPhone Fold Leak: Apple spart sich wohl iPad‑Multitasking

-

Künstliche Intelligenzvor 3 Monaten

JBL Bar 1300MK2 im Test: Soundbar mit Dolby Atmos, starkem Bass und Akku‑Rears

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenPetra‑AI: KI soll Frauen in der Perimenopause unterstützen

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateniX-Workshop KRITIS: Zusätzliche Prüfverfahrenskompetenz für § 8a BSIG