Apps & Mobile Entwicklung

Nackt bei FaceTime? Euer iPhone sieht Euch zu

Mit iOS 26 wurden zwar große Änderungen eingeführt, darunter das Liquid-Glass-Design und eine überarbeitete Kamera, aber das sind vielleicht nicht die auffälligsten Neuerungen der Software. Eine neu entdeckte Funktion in der FaceTime-App, die Videoanrufe automatisch einfriert, wenn sie Nacktheit erkennt, scheint die bisher seltsamste, wenn nicht sogar prüde zu sein.

Apple führte die Warnung vor sensiblen Inhalten mit iOS 17 ein und verbesserte sie in iOS 18. Sie bietet Sicherheitstools zum Schutz von Nutzern, insbesondere von Kindern, indem sie sensible und explizite Inhalte in ausgewählten Apple Apps und Diensten filtert und unkenntlich macht. Wie jetzt in der iOS-26-Beta entdeckt wurde, wird die Funktion auf FaceTime ausgeweitet, allerdings mit einem noch strengeren Erkennungssystem.

FaceTime beobachtet Euren Kamerabildschirm

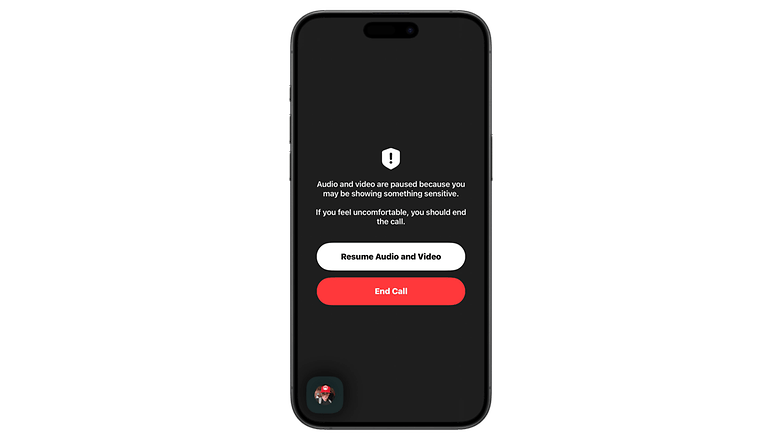

Wie iDeviceHelp berichtet und auf X geteilt hat, pausiert FaceTime unter iOS 26 und iPadOS 26 jetzt automatisch Euer Video, wenn es während eines laufenden Videoanrufs Nacktheit erkennt. Außerdem wird ein Pop-up-Fenster mit einer Warnmeldung angezeigt, die erklärt, warum das Gespräch unterbrochen wurde, sowie zwei große Schaltflächen, mit denen Ihr Audio und Video wieder aufnehmen oder die Sitzung ganz beenden kannst.

Diese Funktion bietet zwar immer noch die Möglichkeit, die Sitzung fortzusetzen, wenn sie unterbrochen wurde, aber es ist unklar, ob eine ähnliche Warnung erscheint, wenn wieder Nacktszenen erkannt werden.

Die Warnung vor sensiblen Inhalten wurde zuerst in Fotos und Nachrichten integriert, daher ist dies das erste Mal, dass wir wissen, wie die Sicherheitsfunktion bei FaceTime funktionieren wird. Apple hat das Framework für die Funktion den Entwicklern zur Verfügung gestellt, so dass Ihr davon ausgehen könnt, dass Drittanbieter-Apps diese Funktion nutzen werden.

Ist diese Funktion ein Durchbruch oder alarmierend?

Obwohl der Zweck dieser Funktion klar ist, gibt sie einigen Personen Anlass zur Sorge um ihre Privatsphäre, vor allem weil die zugrunde liegende Technologie während der Videoanrufe auf das Kameradisplay und den Ton zugreifen kann. Und das, obwohl Apple betont, dass die Technologie keinen Zugriff auf die Medieninhalte selbst hat.

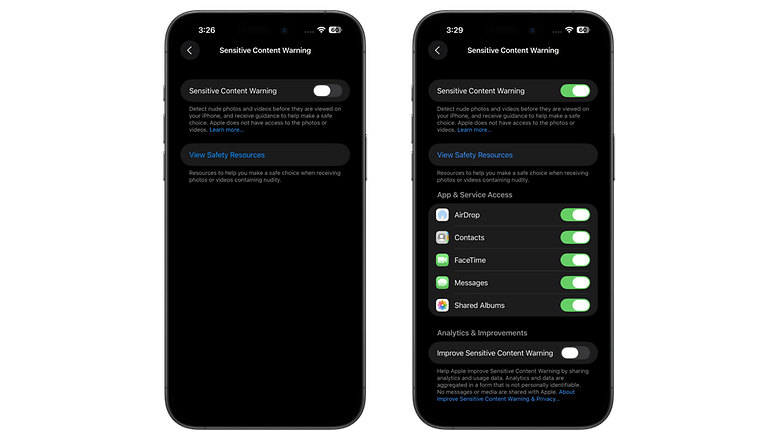

Das Gute daran ist, dass die Warnung vor sensiblen Inhalten für FaceTime standardmäßig ausgeschaltet ist, so dass die Nutzer/innen selbst entscheiden können, ob ihre Anrufe überprüft werden sollen.

Der Schalter für die Warnung vor sensiblen Inhalten für FaceTime ist sowohl in den Einstellungen der App als auch auf der Seite Datenschutz und Sicherheit zu finden, neben anderen Schaltern für verschiedene Apps.

Apps & Mobile Entwicklung

Auf diese Funktion haben viele gewartet

Endlich ist es soweit und Signify gibt eine Funktion wieder frei, die Apple-Nutzer seit der Matter-Einführung vermisst haben. Somit erhalten Hue-Nutzer die altbekannte Flexibilität bei der Nutzung der Leuchtmittel wieder. Um welches Feature es sich handelt und was sich für Nutzer ändert, fassen wir für Euch in diesem Artikel zusammen.

Philips Hue: Beliebte Funktion kehrt zurück

Matter war 2022 ein großes Versprechen: mehr Kompatibilität, weniger Hersteller-Silos, ein einfacheres Smart-Home-Erlebnis. In der Realität sieht das ganz anders aus. Bei einzelnen Herstellern sorgte der Standard dafür, dass beliebte Funktionen gestrichen werden mussten. Eines der beliebtesten Features aus der Hue-App sind die Szenen. Szenen sind voreingestellte Farbkombinationen, die für verschiedene Helligkeiten und Stimmungen sorgen – und das für jeden einzelnen Raum.

Der Export der Szenen aus der Hue-App in Apple Home war ein echtes Komfort-Feature. Nutzer, die in der Hue-App eine Lichtszene erstellt hatten, konnten diese zügig übertragen. Die Szenen standen sofort für Automationen, Shortcuts oder Siri-Sprachbefehle bereit. Mit der klassischen HomeKit-Anbindung, war die Szenenübertragung von der Hue-App zu Apple Home kein Problem. Wer aber auf Matter umgestiegen ist, hatte diese Funktion nicht mehr.

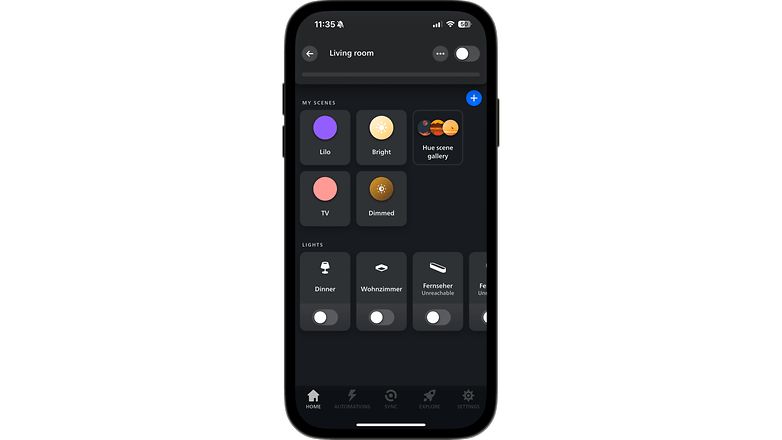

Problematisch war das nach dem Start der Hue Bridge Pro, denn diese kann nur über Matter in Apple Home integriert werden. Jetzt hat das Warten aber ein Ende: Mit der App-Version Hue 5.52 schaltet Signify die Funktion wieder frei, die Apple-Nutzer seit der Matter-Umstellung vermisst haben. Ab sofort lassen sich Hue-Szenen wieder direkt aus der Hue-App in Apple Home exportieren – auch über den Matter-Standard.

So exportiert Ihr Szenen von der Hue-App in Apple Home

Um eine Szene zu Apple Home zu exportieren, müsst Ihr die Szene aktivieren und dann rechts auf das Icon mit den drei Punkten tippen. Dann wählt Ihr “Zu Apple Home hinzufügen” aus. Im Anschluss ist die gewählte Szene in Apple Home verfügbar.

Apps & Mobile Entwicklung

Im Test vor 15 Jahren: Nvidias 3D Vision für mäßiges Spielen in 3D

Ob für Spiele oder Filme, 3D war vor 15 Jahren das Schlagwort. Mit der 3D Vision (Test) bot Nvidia eine 3D-Shutterbrille für Gaming mit kompatiblen Monitoren und Grafikkarten an. Das Ergebnis war durchwachsen: Wenn die Technik funktionierte, dann sah sie toll aus, wenn nicht dann unbeeindruckend bis störend.

Hohe Anschaffungskosten

Die Nvidia 3D Vision selbst in Form der Shutterbrille sowie des Empfängers schlug mit etwa 130 Euro zu Buche. Damit war es mit den Anschaffungskosten jedoch noch nicht getan. Ein kompatibler Monitor startete von 220 Euro für ein 22-Zoll-Modell von Samsung und reichte bis 440 Euro für einen 23-Zoll-Bildschirm von Asus. Die hohen Kosten für die Monitore waren mit der 3D-Vision-Kompatibilität sowie generell der notwendigen Unterstützung einer Bildwiederholfrequenz von 120 Hz verbunden. Zudem musste eine halbwegs aktuelle und zudem sehr schnelle GeForce-Grafikkarte im System verbaut sein. Ab der GeForce-8000-Serie wurde 3D Vision unterstützt, wobei eine 3D-Blu-ray erst ab einer GeForce-GTX-200-Karte wiedergegeben werden konnte.

Technisch setzte Nvidia mit der 3D Vision auf eine aktive Shutterbrille, die in jedem Brillenglas über ein LC-Display verfügte. Diese wurden abwechselnd ein- und ausgeschaltet, sodass jeweils nur ein Auge den eigentlichen Monitor sehen konnte. Dieser zeigte dann zeitlich abgepasst leicht unterschiedliche Bilder an, um einen 3D-Effekt zu erzeugen. Dieser technische Ansatz erklärte auch, wieso ein 120-Hz-Monitor notwendig war: Die effektive Bildwiederholrate halbierte sich durch den aktiven 3D-Effekt.

Eingeschränkte Kompatibilität und mäßige Ergebnisse

Nvidia 3D Vision funktionierte nicht mit jedem Spiel, neben dem 3D-Vision-Treiber wurden generell spezielle 3D-Profile für unterstützte Titel benötigt. Nvidia kategorisierte unterstützte Titel in „Not Recommended“, „Poor“, „Fair“, „Good“, „Excellent“ und „3D Vision Ready“ – wobei alles unter „Good“ quasi unbenutzbar war. Insgesamt testete ComputerBase 17 Titel, die sich stark in dem erzielten 3D-Effekt unterschieden. Besonders positiv fielen Just Cause 2 und Mafia 2 auf. In beiden Fällen bot 3D Vision ein 3D-Erlebnis, das mit den damaligen 3D-Kinofilmen zu vergleichen war. Keine störenden Artefakte, gute räumliche Tiefe und keine Kopfschmerzen auch nach mehreren Stunden Spielzeit sorgten für ausgeprägten Spielspaß. Ganz anders sah es bei vielen anderen Titeln aus, bei denen die Qualität reduziert werden musste, die Spiele störende Artefakte aufwiesen oder Kopfschmerzen verursachten.

Um die für 3D Vision notwendigen FPS zu erreichen, bedurfte es absoluter High-End-Hardware. Selbst eine GeForce GTX 480 – die schnellste Nvidia-Grafikkarte vor 15 Jahren – schaffte es in 1.920 × 1.200 Bildpunkten oft nicht, effektive 60 FPS mit 3D Vision wiederzugeben. Besitzer langsamerer Grafikkarten mussten damit rechnen, die Qualität der meisten Spiele deutlich nach unten schrauben zu müssen.

Unproblematisch war die Wiedergabe von 3D-Blu-rays. Im Test klappte das mit der 3D-Version von „Wolkig mit Aussicht auf Fleischbällchen“ und PowerDVD 10 Ultra Mark II ohne Probleme. Die einzige Beschränkung waren die vergleichsweise geringen Display-Größen der kompatiblen Monitore.

Fazit

Die Nvidia 3D Vision hinterließ einen gemischten Eindruck im Test. Wenn der 3D-Effekt so gut wie in Just Cause 2 oder Mafia 2 funktionierte, dann konnte sie für ein immersives Spielerlebnis sorgen. In den meisten Spielen war dies jedoch nicht der Fall. In Anbetracht der hohen Anschaffungskosten der benötigten Hardware und den hohen Leistungsanforderungen war das Endprodukt insgesamt wenig überzeugend. Die Technologie steckte im Jahr 2010 noch zu sehr in den Kinderschuhen, um vollends zu überzeugen.

In der Kategorie „Im Test vor 15 Jahren“ wirft die Redaktion seit Juli 2017 jeden Samstag einen Blick in das Test-Archiv. Die letzten 20 Artikel, die in dieser Reihe erschienen sind, führen wir nachfolgend auf:

Noch mehr Inhalte dieser Art und viele weitere Berichte und Anekdoten finden sich in der Retro-Ecke im Forum von ComputerBase.

Apps & Mobile Entwicklung

Politik braucht Regeln für KI

Wir reden hier nicht über ferne Zukunft, Freunde! Albaniens „Diella“ soll schon bald als KI-Ministerin Korruption im Beschaffungswesen bekämpfen. Deutschlands Kulturstaatsminister Weimer nutzt seinen „Weimatar“ bereits, um „schnell und mehrsprachig Stellung zu beziehen“. Verspürt beim Betrachten des folgenden Videos übrigens noch jemand außer mir ganz am Schluss Black-Mirror-Vibes?

Auch Estland arbeitet mit künstlicher Intelligenz und experimentiert mit KI-Richtern. Algorithmen entscheiden in diversen Ländern sowieso längst über Sozialhilfe, Steuerbescheide und Verwaltungsabläufe. Das ist kein Pilotprojekt mehr – das ist gelinde gesagt nicht weniger als der Anfang einer Revolution. Und während wir noch überlegen, ob wir darauf Bock haben, schaffen andere längst Fakten.

Die Baustellen sind riesig – und niemand hat einen Plan

Also ja, es gibt viele Baustellen, um die wir uns zu kümmern haben, bevor wir KI flächendeckend in die Politik lassen. Aber das Gute daran ist, dass wir wirklich noch ganz am Anfang dieser Entwicklung stehen. Folgende vier Baustellen habe ich ausmachen können, bei denen noch viel Arbeit ansteht:

- Was ist mit Transparenz? Bislang Fehlanzeige. Wer verstehen will, wie KI-Entscheidungen zustande kommen, stößt schnell an Grenzen. Selbst Expert:innen können oft nicht erklären, warum ein Algorithmus diese und nicht jene Entscheidung trifft. Wie soll das Volk dann beurteilen, ob es fair behandelt wurde?

- Wer trägt eigentlich die Verantwortung? Auch noch unklar. Wenn die Maschine entscheidet – wer übernimmt die Schuld, wenn es schiefgeht? Der Programmierer? Der Minister bzw. die Ministerin? Das Parlament? Diese Frage ist ungeklärt, aber die KI entscheidet trotzdem schon mit.

- Ist KI überhaupt legitimiert und wenn ja, von wem? Definitiv problematisch. Demokratie lebt vom Wählen – aber eine KI wird nie gewählt. Die Opposition in Albanien bringt es auf den Punkt: „Ein Minister muss ein Mensch sein“. Aber was, wenn die KI objektiv bessere Entscheidungen trifft als gewählte Menschen?

- Und wie ist es um die Akzeptanz bestellt? Aktuell nicht gut, tippe ich mal. Sind wir bereit, Macht an eine Maschine zu delegieren? Für viele ältere, weniger tech-affine Bürger muss eine politische Entscheidung durch eine KI doch im Grunde genauso beliebig wirken wie eine gezogene Zahl bei der Lottoziehung.

Wenn Ihr mich fragt, sind das alles keine theoretischen Probleme – das sind exakt die Baustellen, für die wir (noch) keine Regeln haben, sie aber so dringend bräuchten.

Die unbequemen Fragen, die wir uns stellen müssen

Würdet Ihr wollen, dass der klügste Mensch der Welt in die Politik geht? Weil er vielleicht ganz andere Lösungen erdenken kann, Probleme viel besser und schneller versteht? Dann stellt Euch jetzt noch die Frage, ob Ihr das klügste Wesen der Welt auch dann in der Politik sehen wollt, wenn es sich dabei NICHT um einen Menschen handelt.

Ihr wollt lieber einem Menschen den Job anvertrauen als einer Maschine? Dann müssen wir hinterfragen, wieso dem so ist. Weil er mehr Empathie hat? Weil er menschlich ist? Ja, ein Mensch kann besser eine menschliche Entscheidung treffen. Aber ein Mensch kann Euch auch besser als eine Maschine vorgaukeln, dass er es gut mit dem Wahlvolk meint und tatsächlich glaubt, was er sagt.

Schauen wir doch ehrlich hin, was Politiker:innen aus Fleisch und Blut so treiben: Trump verbreitet systematisch Lügen und arbeitet an einer Autokratie, Orban höhlt in Ungarn die Demokratie aus, unsere Koalitionen in Europa scheitern an Eitelkeiten und beugen sich zusehends dem Rechtsruck. Könnte eine KI es wirklich schlechter machen? Oder ist unser Widerstand gegen Maschinen-Politik nur nostalgische Romantik?

Werden sich Politiker:innen selbst abschaffen?

Werden Politiker proaktiv zustimmen oder eher verhindern, dass KIs Einfluss in der Politik gewinnen? Immerhin könnten sie sich dadurch schlimmstenfalls selbst obsolet machen. Das ist eine zentrale Frage, denn die Entscheidung über KI in der Politik liegt – paradoxerweise – nun mal bei eben jenen Menschen, die davon betroffen wären.

Aber vielleicht stellen wir die falsche Frage. Vielleicht geht es gar nicht darum, Politiker:innen zu ersetzen, sondern ihre Rolle zu verändern. Wenn eine KI die objektiv beste Politik vorschlägt, werden Politiker:innen zu dem, was sie schon lange sein sollten: Vermittler, Erklärer, Vertrauen stiftende Persönlichkeiten. Das wäre dann vielleicht das Ende der Berufspolitik, wie wir sie kennen – und der Beginn einer Politik der Persönlichkeiten anstelle von Parteipolitik.

Das Leapfrogging-Problem: Sind andere vielleicht schneller als wir?

Können Länder wie Albanien uns vielleicht sogar abhängen, weil sie einen Schritt auslassen oder deutlich schneller gehen als „wir“? Das Beispiel kennen wir: In Afrika verbreiteten sich Smartphones rasend schnell, weil es kaum die Infrastruktur für Festnetz-Telefone gab. Ebenso hatten nicht so viele Menschen Desktop-PCs für die Internetnutzung oder ein ganz normales Bankkonto, da auch keine Banken-Infrastruktur vorhanden war. Mit dem Smartphone übersprang man all das einfach. Plötzlich waren fast alle Afrikaner online und bezahlten mobil ihre Rechnungen.

Afrikanische Länder haben oftmals also nicht nur sprunghaft aufgeholt, sondern westliche Nationen teils sogar hinter sich gelassen. Ähnlich könnte es uns jetzt beim Thema KI ergehen. Während Deutschland noch über Datenschutz-Grundverordnungen für KI diskutiert, experimentiert Albanien bereits mit KI-Ministern. Während wir ethische Bedenken wälzen, sammeln andere praktische Erfahrungen. Am Ende stehen wir da wie die Musikindustrie, die das Internet verschlafen hat.

„Leapfrogging“ an sich ist eigentlich gar kein Problem, sondern ein positiver Effekt. Die Gründe, wieso plötzlich diese Länder an uns vorbeischießen können, liegen vielmehr bei uns und unseren schwerfälligen Systemen.

Die Wahrheit, die niemand aussprechen will

Habt Ihr kurz vor Ende des Artikels noch spontan Bock auf eine unbequeme Realität? Nämlich folgende: Während wir uns über KI-Minister empören, übersehen wir, dass wir bereits längst von Algorithmen regiert werden. Facebook bestimmt, was wir sehen. Google, was wir wissen. Amazon, was wir kaufen. TikTok, worüber wir diskutieren.

Der einzige Unterschied: Diese Algorithmen sind nicht demokratisch legitimiert. Albaniens KI-Minister wäre immerhin noch dem Parlament verantwortlich – mehr, als man von Zuckerberg oder Musk sagen kann. Wir leben bereits in einer Algokratie. Wir haben nur nie darüber abgestimmt. Mark Zuckerbergs Kasse klingelt, wenn viel Interaktion herrscht und es herrscht viel Interaktion, wenn sich über ein Thema aufgeregt, erbost, echauffiert wird.

Also sorgen Algorithmen dafür, dass diese Themen sichtbarer sind, was wieder mehr Content zum Thema erzeugt und wieder mehr Stimmung zugunsten der vermeintlich einfachen Lösungen entfacht. Wir Medien greifen es entsprechen auf, weil auch wir – so ehrlich müssen wir uns machen – Klick- und Algorithmus-getrieben sind. Wer will da allen Ernstes behaupten zu wissen, dass eine politische Entscheidung einer KI es nicht besser hinbekäme?

Gerade jetzt entscheidet sich alles – mit oder ohne uns

Ich hoffe, Ihr habt hier keinen präzisen Fahrplan erwartet, wie sich KI wann an welchen Stellen in der Politik wiederfindet. Wir sind noch ganz am Anfang bei diesem Thema. Betrachtet diesen Text also eher als mein lautes Nachdenken – mit der ausdrücklichen Einladung an Euch, mitzudenken.

Es wäre naiv zu glauben, wir könnten KI aus der Politik raushalten. Dazu ist es heute bereits zu spät. Aber es wäre gefährlich, sie einfach so reinzulassen. Wir brauchen rote Linien, klare Verantwortlichkeiten, Transparenzpflichten – und das sofort, bevor Experimente wie in Albanien Schule machen.

Die Weichen werden jetzt gestellt. In Ministerien, Verwaltungen, Tech-Konzernen. Die Entscheidung darüber, wie viel Macht Algorithmen über unser Leben haben sollen, fällt in den kommenden Jahren. Und sie wird entweder mit uns getroffen – oder ohne uns.

Die Debatte darf nicht in den Hinterzimmern der Tech-Konzerne oder Parlamente verstauben. Sie gehört in die breite Öffentlichkeit. Sie gehört in Schulen, Unternehmen, Familien. Denn am Ende geht es um die Frage, die unsere Demokratie prägen wird: Wollen wir, dass Maschinen für uns entscheiden – und wenn ja, unter welchen Bedingungen?

Sonst wachen wir in zehn Jahren auf und stellen fest: Die wichtigste Weichenstellung unserer Demokratie haben andere getroffen – und wir haben zugeschaut. Dann ist es zu spät für Debatten. Dann leben wir in der Welt, die andere für uns programmiert haben. Jetzt ist die Zeit, zu handeln. Die Zeit zu diskutieren ist jetzt. Die Zeit zu entscheiden ist jetzt. Morgen könnte es bereits zu spät sein.

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 1 Monat

UX/UI & Webdesignvor 1 MonatAdobe Firefly Boards › PAGE online

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatPosit stellt Positron vor: Neue IDE für Data Science mit Python und R

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatEventSourcingDB 1.1 bietet flexiblere Konsistenzsteuerung und signierte Events

-

UX/UI & Webdesignvor 3 Wochen

UX/UI & Webdesignvor 3 WochenFake It Untlil You Make It? Trifft diese Kampagne den Nerv der Zeit? › PAGE online

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenFirefox-Update 141.0: KI-gestützte Tab‑Gruppen und Einheitenumrechner kommen

-

Online Marketing & SEOvor 2 Monaten

Online Marketing & SEOvor 2 MonatenSo baut Googles NotebookLM aus deinen Notizen KI‑Diashows