Apps & Mobile Entwicklung

Speicherkrise: Microns Umsatz steigt stark und die Prognose explodiert

Mit seinem versetzten Quartalsbericht ist Micron nun der erste DRAM-Hersteller, der Zahlen bis Ende November dabei hat. Und die gehen steil nach oben, sowohl bei dem Blick auf die letzten Monate, aber noch viel mehr bei der Prognose für die nächsten drei Monate, die über 4,4 Milliarden US-Dollar über der Erwartung liegt.

Es ist ein Satz von Micron im Quartalsbericht, der die Situation für die Hersteller gut zusammenfasst:

We expect higher price, lower cost and favorable mix to

all contribute to gross margin expansion.Micron

Die Hersteller verdienen sich nun eine goldene Nase. Dass der Umsatz im aktuellen Quartal bereits auf 13,6 Milliarden geklettert war und dabei 5,5 Milliarden US-Dollar Gewinn abwarf, traf fast die Erwartungen. Diese gingen nun davon aus, dass es im nächsten Quartal etwas weiter nach oben geht, 14,3 Milliarden wurden von Analysten und der Börse anvisiert. Diese Zahl vaporisiert Micron regelrecht und spricht von einer Umsatzerwartung von 18,3 bis 19,1 Milliarden US-Dollar.

Der Blick in die Details verdeutlicht, warum das so ist. Das ist der zuletzt mehrfach erwähnte Nachlauf, der nun erst einsetzt. Viele Großkunden hatten und haben noch Verträge über den Kauf von Speicher, Spot-Preise von der Börse zahlt dort keiner. So wurde in den Monaten September, Oktober und November im Quartalsvergleich bei Micron nur 20 Prozent mehr Umsatz mit DRAM gemacht, der Durchschnittspreis (ASP) stieg auch nur um 20 Prozent.

Genau hier dürften nun größere Zahlen folgen. Je nach Kunde gibt es Verträge, die quartalsweise abgeschlossen werden, andere laufen aber auch ein oder zwei Jahre. Samsung wurde zuletzt nachgesagt, sie machen nur Dreimonatsverträge – die Galaxy-Smartphones setzen auf Microns LPDDR5X. Mit dem Start der neuen Modelle ab Februar könnte Micron hier den einen oder anderen zusätzlichen US-Dollar verdienen.

Ein großer Teil wird aber in Richtung Profisysteme umgelenkt. LPDDR5X hält an immer mehr Stellen Einzug, so auch im Datacenter. Neue Lösungen wie SOCAMM2 setzen beispielsweise auf LPDDR5X. Und dann ist da natürlich das Dauerbrennerthema HBM: HBM4 wird ab 2026 die Wafermengen verschlingen.

Micron wird die geplanten Ausgaben für das neue Jahr leicht erhöhen, von 18 auf 20 Milliarden US-Dollar. Einige Bauprojekte sollen, sofern möglich, etwas schneller umgesetzt werden. Doch hier gibt es bereits die ersten Probleme: Da viele dies nun anstreben, sind Systeme auf dem Markt rar geworden. 2026 scheint demnach durchhalten angesagt, denn echte neue und größere zusätzliche Kapazitäten kommen nicht nur bei Micron erst ab 2027 online.

Apps & Mobile Entwicklung

Trotz KI-Browser-Plänen: Firefox soll einen „AI Kill Switch“ erhalten

Diese Woche skizzierte Mozillas neuer CEO Anthony Enzor-DeMeo die Strategie für die Zukunft. Das Ziel ist, sich als erste Adresse für vertrauenswürdige Software zu etablieren. Das Haken war aber die Ankündigung, den Firefox zu einem modernen KI-Browser weiterzuentwickeln. Der Aufschrei war groß, nun folgte eine Klarstellung.

Bereits in dem Blog-Beitrag erklärte Enzor-DeMeo, Nutzer sollen jederzeit die Kontrolle haben. Der Anspruch ist, dass man nachvollziehen kann, was die KI-Assistenten machen. Und wenn man sie nicht nutzen will, lassen sich diese auch deaktivieren.

Diesen Punkt stellte man nun nochmals klar. Der Firefox-Entwickler Jake Archibald teile über eines der offiziellen Firefox-Konten auf Mastodon mit, dass KI-Funktionen grundsätzlich Opt-In sind. Nutzer müssen also explizit einwilligen, damit diese aktiviert werden. Er räumt aber ein, dass es in Bereichen wie Toolboxen zu Grauzonen kommen kann.

All AI features will also be opt-in. I think there are some grey areas in what ‚opt-in‘ means to different people (e.g. is a new toolbar button opt-in?), but the kill switch will absolutely remove all that stuff, and never show it in future. That’s unambiguous.

Jake Archibald

Daher werde derzeit eine Abschaltfunktion für die KI-Tools entwickelt, die intern unter dem Titel „AI Kill Switch“ läuft. Bei diesem Namen wird es voraussichtlich nicht bleiben, der Sinn bleibt aber bestehen. Wenn Nutzer die KI-Funktionen abschalten, werden diese vollständig entfernt. Nutzer bekommen diese dann auch in Zukunft nicht mehr angezeigt.

Spagat bei der Firefox-Entwicklung

Was Enzor-DeMeo schon im ersten Blog-Beitrag in Aussicht stellte, war ein Spagat. Zwischen modernen KI-Funktionen auf der einen Seite und einem starken Fokus auf Datenschutz, Privatsphäre und Kontrolle auf der anderen Seite.

Allein die Pläne für einen AI-Browser reichten aber schon aus, um die Community zu frustrieren. Von Ungefähr kommt das nicht. Bereits 2024 hatte sich Mozilla Ärger eingesammelt, weil man ursprünglich angekündigte Privatsphäre-Standards missachtete. Das Vertrauen in Mozilla ist derzeit also gering.

Interessant ist daher, wie Mozilla die Firefox-Entwicklung fortsetzt. Sicherheits- und Datenschutz-Themen betreffen ohnehin nicht nur diese Organisation, sondern sämtliche Anbieter von AI-Browser. Und das sind mittlerweile praktisch alle. Von Google mit Chrome über Microsoft und Edge bis zu Opera mit Neon, hinzu kommen noch Neulinge im Markt wie OpenAI mit ChatGPT Atlas und Perplexity mit Comet.

Welche Sicherheitsrisiken bestehen, beschrieb zuletzt ausführlich Google. Der Konzern lieferte direkt auch noch das Konzept für eine neue Sicherheitsarchitektur, die KI-Agenten im Browser absichern soll.

Mit Dank an DeusoftheWired für den Hinweis zu dieser Meldung.

Apps & Mobile Entwicklung

Nativer NVMe-Support: Für Risikofreudige gibt es den neuen Treiber auch unter Windows 11

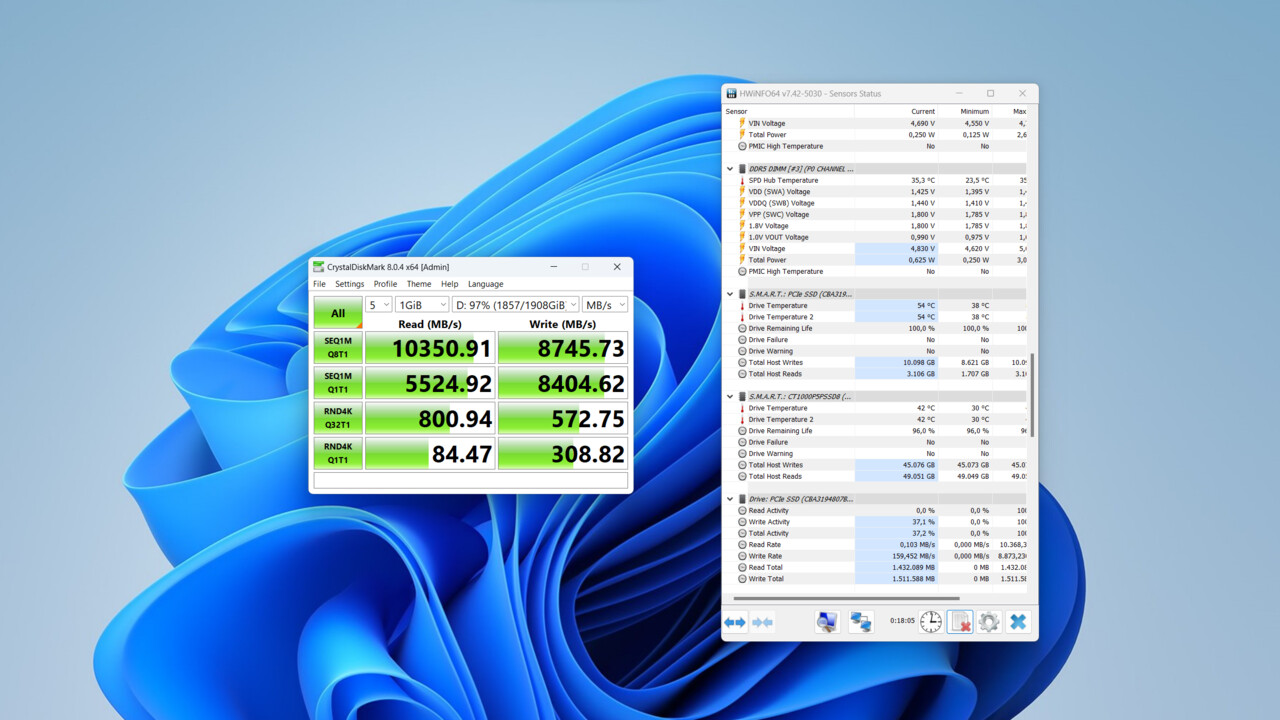

Microsoft hat kürzlich für Windows Server 2025 einen nativen NVMe-Treiber vorgestellt, der die SSD-Leistung deutlich steigern soll. Aktivieren lässt er sich per Registry-Key und das klappt auch unter Windows 11, wieUser herausfanden. Allerdings wird dadurch so einiges verändert, weshalb Vorsicht geboten ist.

Nativer NVMe-Support für Windows Server 2025

Microsoft spricht im eigenen Blog von einer neuen Ära für die Massenspeicherleistung unter Windows Server 2025. Zuvor sei noch vom alten SCSCI-Protokoll auf das neue NVMe-Protokoll übersetzt worden, erst jetzt gebe es nativen NVMe-Support. Damit werden niedrigere Latenzen, mehr IOPS und eine geringere CPU-Last versprochen. Direkt ab Werk gibt es das aber nicht, erst ein manueller Eingriff durch eine Änderung in der Registry schaltet die native NVMe-Unterstützung frei.

Auch mehr Leistung unter Windows 11

Jetzt wird berichtet, dass die gleiche Option auch für Windows 11 zur Verfügung steht und auch dort Leistungsverbesserungen mit sich bringt. User belegen mit Screenshots, dass sich zumindest im Benchmark Transferraten und Latenzen verbessern, manche wollen den Leistungsschub sogar regelrecht spüren, indem etwa Hintergrundanwendungen schneller starten. Heise berichtet von 10 bis 15 Prozent besserem Durchsatz in einem kurzen Selbstversuch. Andere wieder wollen nichts davon merken.

Eingriff nicht ohne Risiko

Doch all das ist rein experimentell und nicht ohne Risiko, denn die Eingriffe in die Registry wirbeln so einiges durcheinander. Zum Beispiel erkennen manche SSD-Tools die Laufwerke nicht mehr (richtig) oder irrtümlich gleich doppelt.

Ein weiterer User warnt, dass es durch die Registry-Hacks Änderungen an den Partitionen gibt. Dadurch werde unter anderem die Datenträger-ID verändert, was erklärt, warum einige Tools danach Probleme haben. Es könnte sein, dass etwa auch Backup-Software mit den geänderten Partitionen Schwierigkeiten bekommt.

Wer das Risiko nicht scheut, sollte zumindest für eine vorherige Systemsicherung sorgen oder die Registry-Änderungen zunächst in einer virtuellen Maschine (VM) testen. Eine Anleitung für das Ausprobieren auf eigene Gefahr liefert Deskmodder.de.

Apps & Mobile Entwicklung

Samsung Exynos 2600: Erster 2-nm-GAA-Chip ist für das Galaxy S26 prädestiniert

Die Semiconductor-Sparte von Samsung hat mit dem Exynos 2600 den industrieweit ersten Chip aus der 2-nm-GAA-Fertigung vorgestellt. Das neue System-on-a-Chip setzt auf die frischen C1-Kerne von Arm und eine in Kooperation mit AMD entwickelte Raytracing-Grafikeinheit. Der Exynos 2600 ist teils für das Galaxy S26 prädestiniert.

Das SoC befindet sich bereits in der Massenproduktion, das geht aus einem Eintrag auf Samsungs Produktseite hervor. Samsung hat den Neuzugang ohne größere Ankündigung der Website hinzugefügt.

Prädestiniert ist der Exynos 2600 für den Einsatz im Galaxy S26, bestätigt ist dies aber noch nicht. Samsungs MX-Sparte für Smartphones ist wie die Chip-Sparte eine unabhängige Einheit im Konzern und hat die freie Wahl, was Prozessoren betrifft. Beim Galaxy S25 wird zum Beispiel durchweg auf den Snapdragon 8 Elite von Qualcomm gesetzt. Gerüchten zufolge soll der Exynos beim nächstjährigen Galaxy S26, das für Ende Februar erwartet wird, aber wieder eine größere Rolle neben dem neuen Snapdragon 8 Elite Gen 5 von Qualcomm spielen.

Fertigung in 2 nm mit Gate-All-Around-Transistoren

Der Exynos 2600 wird in 2 nm GAA gefertigt, bei der Foundry-Sparte von Samsung auch SF2 genannt. Bei der 2-nm-GAA-Fertigung kommen Gate-All-Around-Transistoren zum Einsatz, bei denen das Gate – also die Steuerelektrode – den Kanal, durch den die Elektronen fließen, vollständig von allen Seiten umschließt. Der Kanal besteht aus mehreren extrem dünnen Nanosheets, die übereinander gestapelt sind. Durch das vollständige Umschließen kann das Gate den Stromfluss sehr präzise ein- und ausschalten, was Leckströme reduzieren und die Effizienz verbessern soll. Gegenüber älteren FinFET-Strukturen ermöglicht Samsungs 2-nm-Prozess dadurch eine höhere Leistung bei geringerem Energieverbrauch.

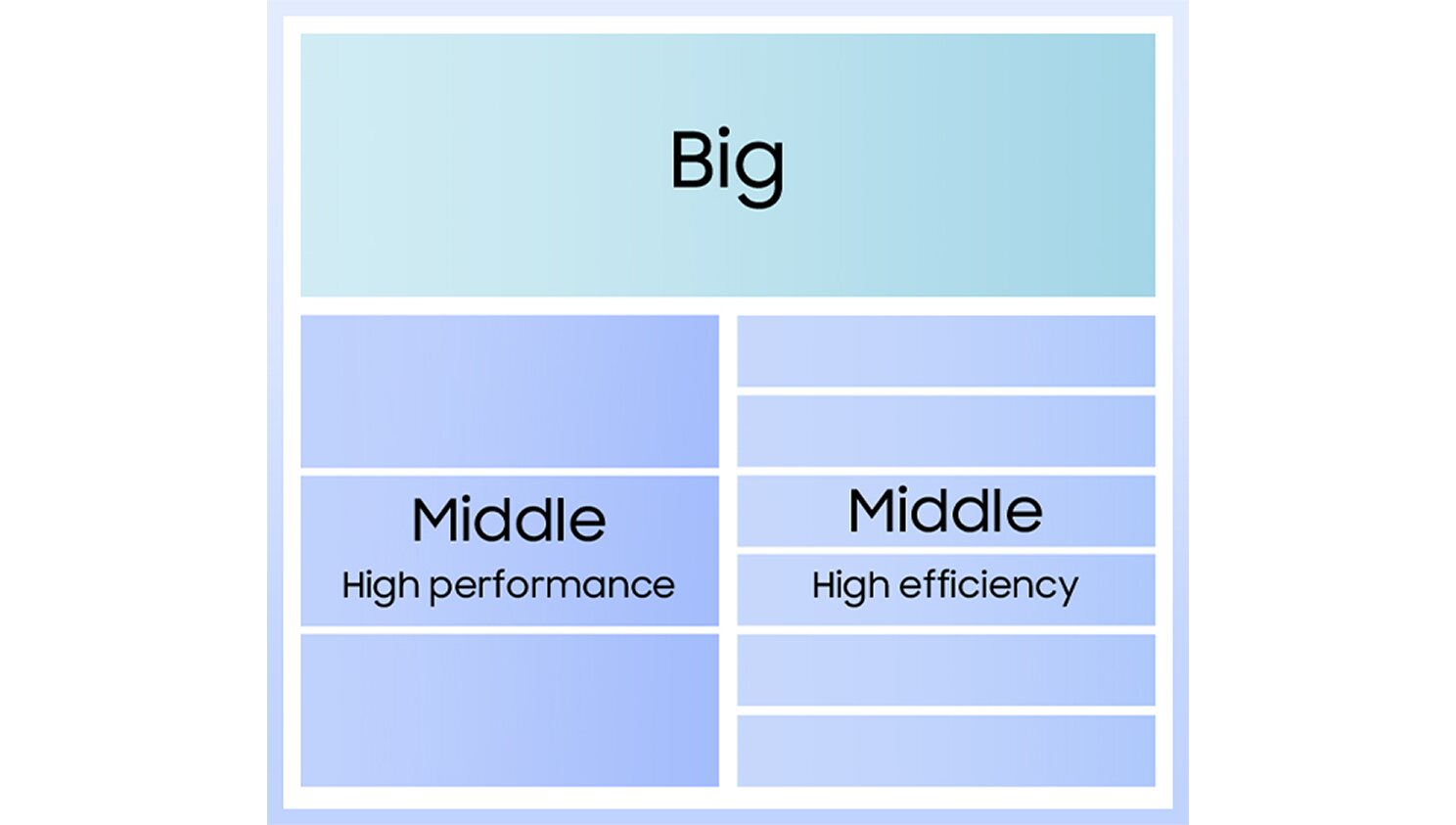

CPU setzt auf C1-Kerne von Arm

Für die CPU im Exynos 2600 vertraut Samsung auf die C1-Kerne von Arm, genauer gesagt einen Deca-Core-Aufbau mit einem einzelnen großen C1-Ultra mit 3,8 GHz, den Arm noch oberhalb des vorherigen Cortex-X925 platziert, und neun C1-Pro, dem Nachfolger des Cortex-A725. Die C1-Pro unterteilt Samsung in zwei Cluster, wovon ein kleineres mit drei Kernen bei 3,25 GHz und ein größeres mit sechs Kernen bei 2,75 GHz arbeitet.

Im Vergleich zum Exynos 2500, der ausschließlich im Galaxy Z Flip 7 (Test) zum Einsatz kommt, fallen somit die traditionellen Efficiency-Kerne weg, während der Spitzentakt des Prime-Cores um 500 MHz steigt. Das verdeutlicht die Effizienzsteigerungen aufseiten der CPU-Mikroarchitektur durch Arm, aber auch aufseiten der Fertigung bei Samsung.

Dennoch: Der in TSMC N3P gefertigte Snapdragon 8 Elite Gen 5 mit Oryon-3-Kernen läuft mit bis zu 4,61 GHz. Samsung gibt die Leistungssteigerung der CPU mit 39 Prozent im Vergleich zum Exynos 2500 an, erklärt dabei aber nicht, ob Single- oder Multi-Thread gemeint ist.

Arm v9.3 und SME2 halten Einzug

Mit den C1-Kernen gehen die Arm-v9.3-Befehlssatzarchitektur und SME2 (Scalable Matrix Extension 2) einher. SME2 ist eine Erweiterung der Armv9-A-Architektur und wurde entwickelt, um den Prozessor bei genau der Art von Rechenarbeit deutlich schneller zu machen, die in KI, Machine Learning, Bild- und Audiosignalverarbeitung ständig vorkommt – nämlich große Matrizen von Zahlen zu verschieben, zu multiplizieren und zu addieren. Die an die CPU gekoppelte SME2-Einheit ermöglicht dem Prozessor, ganze Blöcke von Zahlen gleichzeitig zu verarbeiten, anstatt bei Matrizen viele kleine Schritte nacheinander auszuführen. Das steigert die Leistung in Bereichen wie Bilderkennung, Sprachverarbeitung oder Textzusammenfassung und reduziert zugleich den Stromverbrauch, weil weniger Daten unnötig hin- und hergeschoben werden müssen.

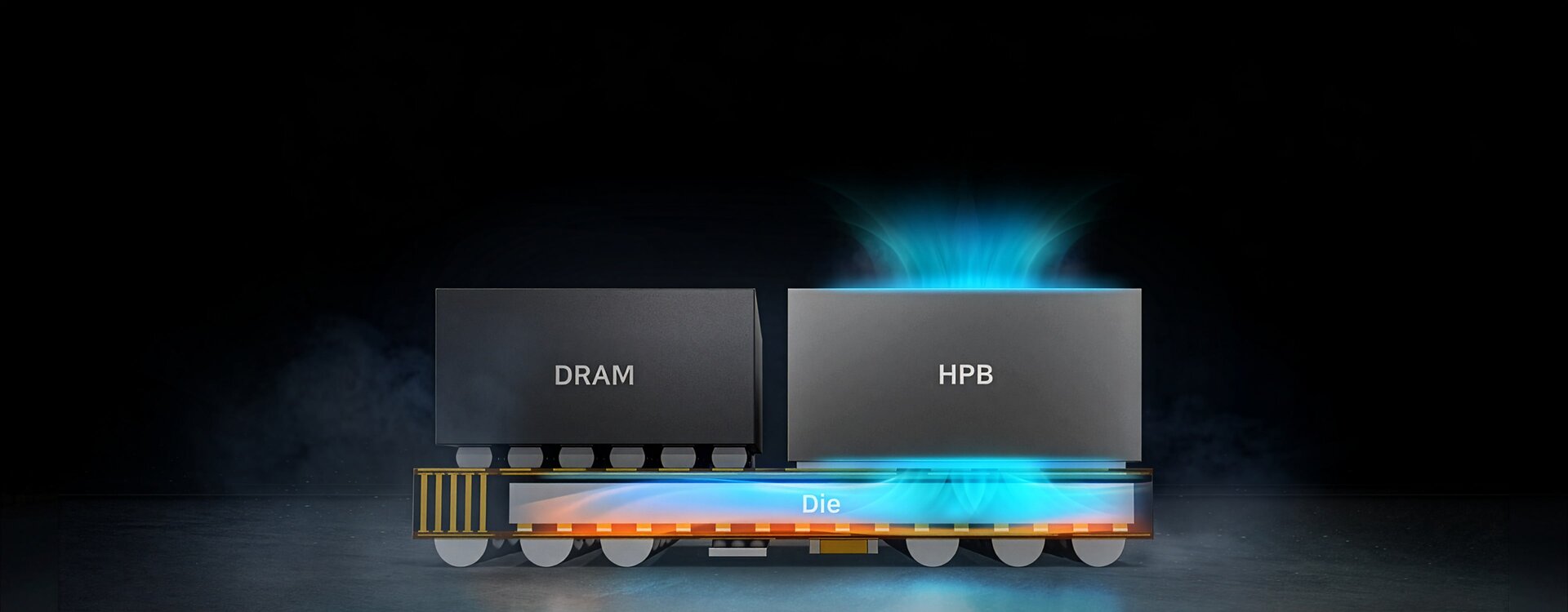

Heat Path Block soll Wärme besser abführen

Der Exynos 2600 soll Wärme über einen Heat Path Block (HPB) besser abführen können. Samsungs Bebilderung zufolge handelt es sich dabei um einem Block neben dem DRAM und somit oberhalb des Compute-Dies, der die Wärmeabfuhr verbessern soll. Samsung setzt dabei auf „High-k EMC“, also High-k-Dielektrikum wie zum Beispiel Hafniumoxid und Embedded Metal Contacts. Zum genauen Aufbau und was wo zum Einsatz kommt schweigt Samsung, aber unterm Strich soll der thermische Widerstand damit 16 Prozent geringer ausfallen, was für niedrigere und stabile Temperaturen unter Last sorgen soll.

Doppelt so schnelle GPU

Aufseiten der GPU wird die Kooperation mit AMD für die neue Xclipse 960 fortgesetzt. Der Konzern spricht von einer neuen Architektur, die eine doppelt so hohe GPU-Leistung im Vergleich zum Vorgänger ermögliche – Details zum genauen RDNA-Unterbau fehlen. Rein auf die Raytracing-Leistung bezogen liege der Fortschritt bei 50 Prozent. Einzug hält dabei auch Exynos Neural Super Sampling (ENSS), das für AI-basiertes Upscaling und Frame Generation steht. Durch die simultane Nutzung von Neural Super Sampling und Neural Frame Generation könne ein Spiel bis zu dreimal „flüssiger“ laufen, erklärt Samsung, vor allem bei eingeschränktem Power-Budget.

Mehr KI-Leistung auch im Bildprozessor

Samsung rüstet den Chip außerdem mit einer 113 Prozent schnelleren NPU aus, was das Ausführen von mehr lokalen KI-Modellen ermöglichen soll. Energieverbrauch und Latenz der NPU habe der Hersteller parallel dazu optimiert. KI spielt auch im Bildprozessor (ISP) eine Rolle, wo ein Visual Perception System (VPS) in Echtzeit verschiedenste Bildelemente in Fotos und Videos erkennen können soll, um diese in Echtzeit und zugleich bei 50 Prozent geringerem Energiebedarf im Vergleich zum Exynos 2500 aufzuwerten. Unterstützt werden Kameras bis 320 MP und unter anderem auch der neue APV-Codec (Advanced Professional Video). Dabei handelt es sich um einen intermediären Lossless-Codec, der für die semiprofessionelle Videoproduktion vorgesehen ist. Der Codec wird aktuell unter anderem von Android 16, Blackmagic Design DaVinci Resolve und FFmpeg unterstützt.

Zu den weiteren Eckdaten des Eyxnos 2600 gehören der Support von LPDDR5X (Geschwindigkeit unbekannt) und der Storage-Standard UFS 4.1. Außerdem kann der Chip Bildschirme bis 4K- respektive WQUXGA-Auflösung (3.840 × 2.400) mit bis zu 120 Hz ansteuern. Nicht im Datenblatt genannt werden Eigenschaften zum integrierten Mobilfunkmodem oder ob der Chip überhaupt über ein integriertes Modem verfügt. Eine Animation zeigt aber immerhin den Schriftzug „5G“ auf dem Package.

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenIllustrierte Reise nach New York City › PAGE online

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAus Softwarefehlern lernen – Teil 3: Eine Marssonde gerät außer Kontrolle

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenSK Rapid Wien erneuert visuelle Identität

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatKommandozeile adé: Praktische, grafische Git-Verwaltung für den Mac

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenNeue PC-Spiele im November 2025: „Anno 117: Pax Romana“

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenDonnerstag: Deutsches Flugtaxi-Start-up am Ende, KI-Rechenzentren mit ARM-Chips

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenArndt Benedikt rebranded GreatVita › PAGE online