Künstliche Intelligenz

WhatsApp-Funktion ermöglicht KI-Abschaltung in Chats – ist aber nicht nötig

Der Chatbot Meta AI ist seit März in WhatsApp integriert. Die KI, die in der App prominent als blau umrandeter Ring auf der Startseite zu finden ist, kann nicht entfernt werden, auch wenn diese Frage offenbar immer wieder gestellt wird. Mithilfe der Funktion „Erweiterter Datenschutz“ (Advanced Chat Privacy), die im April eingeführt wurde, können Nutzer die KI allerdings aus Einzel- und Gruppenchats blockieren, damit Teilnehmer eines Chats die KI nicht zuschalten können.

Dass Meta AI auf alle Daten in WhatsApp zugreifen kann, wie in aktuellen Kettenbriefen kolportiert wird, ist indes nicht korrekt – und schon gar nicht ohne Auftrag des Nutzers.

Meta AI in WhatsApp nur durch Nutzer aktivierbar

Ein Panik verbreitender Kettenbrief warnt vor Meta AI in Whatsapp.

(Bild: heise medien)

Die KI in WhatsApp kann nur auf die Daten des Nutzers oder der Nutzerin zugreifen, wenn man mit ihr interagiert und ihr den Auftrag dazu gibt. Sämtliche Einzel- und Gruppenchats sind standardmäßig Ende-zu-Ende-verschlüsselt, sodass nur die Teilnehmer einer Chatrunde Zugriff auf die darin geteilten Informationen haben.

Die in WhatsApp integrierten KI-Funktionen greifen nur dann, wenn Nutzerinnen und Nutzer sie aktiv verwenden. Das heißt: Es findet kein automatischer Zugriff auf Inhalte, geschweige denn Telefonnummern, statt. Zur Erinnerung: Letztere liefern Nutzer übrigens aktiv an Meta aus, wenn sie ihr Adressbuch mit WhatsApp synchronisieren, um ihre Kontakte zu finden.

Nur, wenn Meta AI über den Befehl @Meta in einem Chatfenster angesprochen wird, öffnet der Nutzer quasi die Tür zum Chat für Metas KI. Mit der KI im Chat können etwa verpasste Nachrichten zusammengefasst werden (zunächst nur in den USA) – diese Funktion ist in Deutschland noch nicht verfügbar.

Wie der Konzern erklärt, wird für diese private KI-Zusammenfassung eine Sitzung mit einem Cloud-Server aufgebaut – anonymisiert durch Oblivious HTTP (OHTTP) über Drittanbieter-Zwischenstationen. Die Session soll der Erläuterung zufolge mit einem temporären Schlüssel verschlüsselt sein, auf den „Meta und WhatsApp keinen Zugriff haben“; nur das Endgerät und die Private-Processing-Server können ihn demnach nutzen: Meta betont, dass „niemand außer dem Gerät des Nutzers oder den ausgewählten TEEs (Trusted Execution Environment)“ die Anfrage entschlüsseln könne.

Zudem unterliegt der „Inhalt und die näheren Umstände von Chats zwischen Nutzerinnen und Nutzern von TK-Diensten“, zu denen WhatsApp gehört, „dem besonderen Schutz des Fernmeldegeheimnisses (§ 3 TDDDG), das im Grundgesetz verankert ist (Art. 10 GG) und dessen Verletzung strafbar ist (§ 206 Strafgesetzbuch),“ erklärt die Bundesbeauftragte für den Datenschutz und die Informationsfreiheit (BfDI).

Erweiterter Datenschutz sperrt Nutzer von KI-Verwendung im Chat

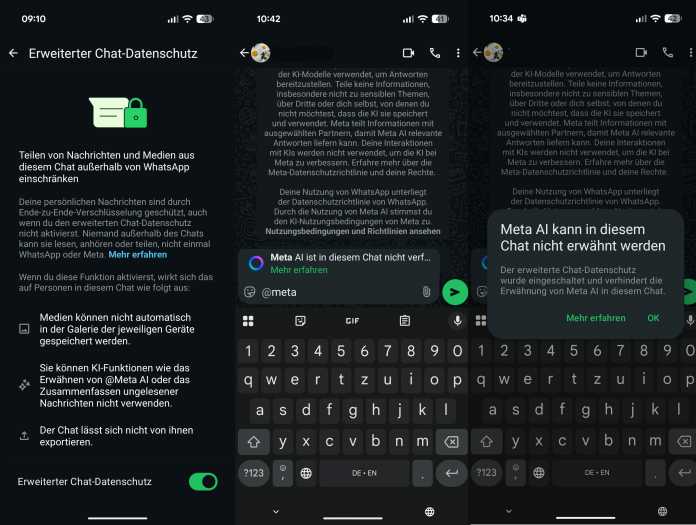

Für noch mehr Kontrolle über die Meta-KI, wenngleich nicht wirklich erforderlich, können Nutzer die Funktion „Erweiterter Datenschutz“ aktivieren. Dieses Feature muss indes für jeden Chat einzeln aktiviert werden. Dies erfolgt über die jeweiligen Einstellungen, die durch einen Druck auf den Empfänger des Chats oder den Gruppennamen aufgerufen werden können (nicht das Drei-Punkte-Menü). Tippt man nun @Meta in ein Chatfenster, erhält man den Hinweis, dass die Funktion in dem jeweiligen Chat nicht verfügbar ist.

Erweiterter Chat-Datenschutz: Unter anderem können Nutzer mit der Funktion Meta AI für einzelne Chats sperren.

(Bild: heise medien)

Durch die Aktivierung der „Erweiterten Datenschutzfunktion“ wird nicht nur der Zugriff von Meta AI im Chat gesperrt, sondern mehr: Das Feature sperrt gleichzeitig die Exportfunktion für den jeweiligen Chat und den Medienzugriff, sodass Bilder und Co. nicht in der jeweiligen Mediengalerie des Geräts gesichert werden. Wie erwähnt, ist diese Funktion nicht erforderlich, um Meta AI von unerlaubtem Datenzugriff abzuhalten. Es genügt, wenn keiner der Teilnehmer in einem WhatsApp-Gruppenchat sie verwendet.

Lesen Sie auch

Die „Erweiterte Datenschutz“-Funktion dient laut Meta vor allem in WhatsApp-Gruppen, in denen jemand nicht alle Teilnehmer näher kennt, jedoch auch vertraulichere Dinge besprochen werden. Als ein Beispiel nennt der Konzern etwa Gespräche über gesundheitliche Probleme in Unterstützer-Gruppen.

(afl)

Künstliche Intelligenz

Galaxy XR im Einsatz, Muse-Pencil für die Vision Pro | TNBT-Podcast

Mit ähnlich hochkarätigen Display-Specs, einem niedrigeren Gewicht und dem erheblich günstigeren Preis ist Samsungs Galaxy XR eine spannende Alternative zur Vision Pro – zumindest auf dem Papier. Durch Android XR, Google Maps, YouTube, Netflix und nicht zuletzt Gemini ist obendrein die Software-Geschichte interessant und bringt so manches mit, was visionOS aktuell schmerzlich fehlt.

Weiterlesen nach der Anzeige

In Episode 57 berichtet Mark Zimmermann, Leiter für mobile Lösungen bei EnBW, ausführlich über seine ersten konkreten Erfahrungen mit der Galaxy XR. Dabei geht es um Tragekomfort, Gewicht, Display-Qualität sowie um Details wie den verborgenen USB-C-Port. Wir diskutieren zudem über Android XR, den Nutzen der „sehenden“ Gemini-KI sowie darüber, ob das Gerät nicht letztlich am Markt vorbei entwickelt wurde. Eine Kehrtwende gibt es bei Logitechs Muse zu verzeichnen: visionOS 26.2 – derzeit noch im Betastadium – integriert den Stift tief ins Betriebssystem und macht ihn damit auf einen Schlag nützlich.

Mac & i-Podcast zu Apple Vision und visionOS

1984, 2007, 2024 – Apples Vision Pro tritt in riesige Fußstapfen: Mac und iPhone haben nicht nur Geschichte geschrieben, sondern auch grundlegend verändert, wie wir Computer verwenden.

Mac & i begleitet die Vision Pro sowie die Chancen und Hürden von „räumlichem Computing“ mit einem eigenen Podcast: TNBT – The Next (Big) Thing beleuchtet die jüngsten Entwicklungen rund um die neue Plattform mitsamt den Auswirkungen auf IT-Branche und Gesellschaft.

TNBT ist in allen großen Podcast-Verzeichnissen zu finden und lässt sich mit Apple Podcasts und Spotify hören oder als RSS-Feed in der Podcast-App der Wahl beziehen. Wir freuen uns unter podcast@mac-and-i.de auf Fragen, Anregungen und Kritik.

Weiterlesen nach der Anzeige

(lbe)

Künstliche Intelligenz

PC-Speichermodul mit 128 GByte für Dual-Slot-Mainboards

Der taiwanische Speichermodulhersteller Adata kündigt ein besonderes DIMM mit 128 GByte Kapazität an: Es funktioniert aber wohl nur auf Mainboards, die Clock-Unbuffered-(CU-)DIMMs ansteuern können und zwei Steckfassungen dafür haben. Damit sind folglich maximal 256 GByte Arbeitsspeicher möglich.

Weiterlesen nach der Anzeige

Desktop-PCs und Notebooks sind üblicherweise nur für sogenannte ungepufferte Speicherriegel ausgelegt, kurz UDIMMs. Diese lassen sich bisher mit maximal 64 GByte DDR5-RAM bestücken.

Auf Mainboards mit vier Fassungen für CUDIMMs dürften sich vier der neuen Module mit je 128 GByte nicht gemeinsam ansteuern lassen, weil Adata sich dabei eine Besonderheit zunutze macht: Die 128-GByte-DDR5-CUDIMMs haben vier statt nur zwei Ranks.

Rank-Kunde

Bisher fertigen DRAM-Chiphersteller einzelne DDR5-SDRAM-Chips mit maximal 32 Gigabit (GBit) Kapazität. Acht davon fassen folglich 32 GByte (8 Bit = 1 Byte) und bilden zusammen einen sogenannten Rank. Ein Single-Rank-(SR-)UDIMM speichert also 32 GByte, ein Dual-Rank-(DR-)UDIMM 64 GByte.

Mehr als zwei Ranks sind bei UDIMMs nicht vorgesehen, sondern nur bei Registered DIMMs (RDIMMs), auch buffered DIMMs genannt.

Die Speichercontroller der meisten Desktop-PC-Prozessoren steuern zwei RAM-Kanäle an, von denen jeder höchstens mit zwei DR-UDIMMs bestückt sein darf, also mit insgesamt vier Ranks.

Rank-Trick

Weiterlesen nach der Anzeige

Der Speicher-Controller typischer Desktop-PC-Prozessoren steuert pro RAM-Kanal maximal vier Ranks an.

(Bild: heise medien)

Bei einem Mainboard mit zwei DIMM-Slots, also nur einem DIMM pro Kanal (1 DIMM per Channel, 1DPC), sind im Prinzip höchstens zwei Ranks vorgesehen. Aber grundsätzlich könnte der Speicher-Controller der CPU noch zwei weitere Ranks ansteuern.

Adata bestückt die neuen 128-GByte-Riegel daher mit vier Ranks (4R), lötet also doppelt so viele DDR5-SDRAM-Chips drauf. Dabei nutzt Adata gleichzeitig einen Clock-Driver-Chip, der die Taktfrequenzsignale stabilisiert. Es handelt sich also um 4R-CUDIMMs.

Laut der Pressemitteilung von Adata laufen Prototypen der 128-GByte-4R-CUDIMMs bereits auf einem MSI-Mainboard mit Z890-Chipsatz für einen Prozessor vom Typ Intel Core Ultra 200.

Preise und Liefertermine nennt Adata bisher nicht. Wegen der zurzeit deutlich steigenden DDR5-RAM-Preise dürfte die Nachfrage nach Speicherriegeln mit extrem hoher Kapazität allerdings gering sein.

(ciw)

Künstliche Intelligenz

KubeCon: Fortschritte, aber auch mehr Arbeit bei Cloud-Native und Cybersecurity

So erfreulich die Fortschritte bei Open-Source- und Cloud-Native-Software auch sind, die die CNCF bei der KubeCon + CloudNativeCon in Atlanta anlässlich ihres 10. Jubiläums gerade feiert – mehr Anwendungen erhöhen zwangsläufig auch die Angriffsfläche für Cyberattacken. Zu den grundlegenden Hausaufgaben von Entwicklerinnen und Entwicklern zählen dabei das Beheben und das Vermeiden von Schwachstellen auf Code-Ebene, die unter Security-Fachleuten als Common Vulnerabilities and Exposures, kurz CVE, bekannt sind.

Weiterlesen nach der Anzeige

Schwachstellen in den Projekten der CNCF

Bezogen auf CNCF-Projekte hat sich deren Anzahl 2025 im Vergleich zum Vorjahr um 16 Prozent erhöht. Besorgniserregend sind vor allem die vermehrten Angriffe auf die Lieferkette im Open-Source-Umfeld. Das jüngste Beispiel ist der Wurm Shai-Hulud, der über 500 Pakete des NPM-Ökosystems kompromittiert hat.

Ein Ansatz für Schutzmaßnahmen ist die Auditierung der verwendeten Software. So lässt sich herausfinden, welche CVEs sind dort vorhanden sind. Dabei kann der Open Source Technology Improvement Fund (OSTIF) unterstützen, der inzwischen eine Reihe von CNCF-Projekten untersucht hat. Anfang November kam der Bericht zu KubeVirt heraus, das eine Umgebung bereitstellt, in der sich virtuelle Maschinen und Container gleichermaßen zusammen verwalten lassen. Laut OSTIF fanden sich in dem Projekt 15 Schwachstellen. Dabei sticht CVE-2025-64324 mit einer hohen Kritikalität heraus. Sieben weitere sind als mittelschwer eingestuft.

Unter anderem auch für die CNCF veröffentlicht OSTIF alljährlich einen Bericht, der typischerweise im Dezember erscheint. Für 2025 steht er noch aus, es liegen aber bereits Teilergebnisse vor. Für das Service-Mesh Linkerd sind darin insgesamt sieben Schwachstellen gelistet, eine davon ist mit der Kritikalität hoch eingestuft. 2024 kamen elf CNCF-Projekte auf den Prüfstand. Das Resultat waren 28 Schwachstellen mit mittlerer oder hoher Kritikalität.

Auszug aus dem OSTIF-Bericht zum CNCF-Projekt Linkerd

(Bild: OSTIF)

Insbesondere auf der Ebene der Container-Images sind Schwachstellen immer noch ein großes Problem. Docker reagierte im Mai 2025 darauf mit der Einführung von Docker Hardened Images (DHI). Deren Grundlage sind abgespeckte Versionen der ursprünglichen Container-Images. Aus der geringeren Anzahl enthaltener Softwarekomponenten resultiert dabei automatisch eine verringerte Angriffsfläche.

Weiterlesen nach der Anzeige

Als neuer Mitspieler in diesem Umfeld positioniert sich Minimus. Im Gespräch mit iX ließ CTO und Mitbegründer John Morello durchblicken, dass die Firma und deren Geschäftsidee schon länger existiere, jedoch seien sie bis Mai 2025 im „Tarnmodus“ unterwegs gewesen. Minimus bietet ebenfalls minimalistische Versionen der ursprünglichen Container-Images an, geht aber noch einen Schritt weiter: Das Produkt „Minimal Images“ prüft alle 24 Stunden, ob es aktualisierte Teilkomponenten des Images gibt. Wenn das Update eine bekannte Schwachstelle behebt, generiert Minimus eine neue Version des Container-Images. So erhalten Benutzer tagesaktuelle Software mit minimaler Anzahl von Schwachstellen bereitgestellt. Diese Technik funktioniert allerdings nur mit Container-Images, die vollständig auf Open Source mit öffentlich zugänglichen Software-Verzeichnissen beruhen. Minimus bietet damit zwar keine Universallösung, kann aber speziell im OSS-Umfeld hilfreich sein.

Neue Ansätze zu Gefahren durch KI und Agenten

Weitere Herausforderungen im Bereich Cybersecurity zieht der Hype um künstliche Intelligenz (KI) nach sich: Sollen KI-Agenten einander vollständig vertrauen dürfen? Wie sieht es mit dem Zugriff auf Daten für die Arbeitsabläufe oder Entscheidungen aus? Sind Modelle korrekt oder manipuliert? Im Bereich des Identitätsmanagements hat sich unter anderem das Unternehmen Cyberark dieser Fragen angenommen. Für Dezember 2025 kündigte Cyberark ein neues Produkt an, das sich auf die agentenbasierte KI fokussiert. Allerdings erfindet die Firma das Rad nicht neu, sondern behandelt KI-Agenten genauso wie menschliche Benutzer.

Vertrauensverhältnisse beruhen auf Identitäten, Zugriffsrechte sind ebenfalls damit verbunden – genauso wie in den Zeiten vor der KI. Die Neuerungen finden sich im Detail. So müssen im Ansatz von Cyberarks die KI-Agenten über ein Gateway mit den MCP-Servern oder den Datenquellen kommunizieren. Eine zentrale Rolle übernimmt dabei die sogenannte Identity Security Platform. Dort finden die Verwaltung und Zuweisung von Berechtigungen beziehungsweise deren Überprüfung statt. Die gesamte Kommunikation erfolgt verschlüsselt. Im informellen Gespräch mit iX ließen Vertreter von Cyberark durchblicken, dass es Pläne für weitere Sicherheitsmechanismen gebe. So soll künftig etwa auch die Integrität der Modelle mit Signaturen abgesichert beziehungsweise geprüft werden. Über erste Ideen hinausgehende konkrete Informationen lägen dazu aber noch nicht vor.

(map)

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenAdobe Firefly Boards › PAGE online

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenGalaxy Tab S10 Lite: Günstiger Einstieg in Samsungs Premium-Tablets

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

Datenschutz & Sicherheitvor 2 Monaten

Datenschutz & Sicherheitvor 2 MonatenHarte Zeiten für den demokratischen Rechtsstaat

-

UX/UI & Webdesignvor 4 Wochen

UX/UI & Webdesignvor 4 WochenIllustrierte Reise nach New York City › PAGE online

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenPosit stellt Positron vor: Neue IDE für Data Science mit Python und R

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenEventSourcingDB 1.1 bietet flexiblere Konsistenzsteuerung und signierte Events