Online Marketing & SEO

How-To – Barrierefreiheit: In fünf Schritten zu barrierefreien Produkten, die allen besser gefallen

Seit Ende Juni müssen digitale Produkte und Services barrierefrei sein. Andernfalls drohen empfindliche Strafen. Doch wie können Marken und Unternehmen Websites, Apps & Co so gestalten, dass sie wirklich von allen Menschen genutzt werden können? Felix van de Sand, CEO von COBE, erklärt in fünf Schritten, wie das geht.

Barrierefreiheit – viele reden darüber, nur wenige wissen wirklich, was es bedeutet. Für die einen ist es ein reines Entwickler:innen-Thema, für andere eine rechtliche Notwendigkeit, die man „irgendwann“ in Angriff nehmen sollte. Fakt ist: Die digitale Barrierefreiheit hat jahrelang ein Nischendasein gefristet. Mit dem Inkrafttreten des Barrierefreiheitsstärkungsgesetz (BFSG) am 28. Juni wurde aus der Empfehlung eine Verpflichtung.

87 Millionen Menschen in der EU leben mit einer Behinderung – das ist fast jede:r Fünfte. Weltweit sind es laut WHO sogar rund 1,3 Milliarden Menschen. Damit geht es bei der Fokussierung auf Barrierefreiheit nicht nur um Inklusion, sondern auch um Wettbewerbsfähigkeit: Wer nicht für diese Zielgruppe gestaltet, verschenkt Potenzial. Zudem drohen mit Inkrafttreten des BFSG empfindliche Strafen: In Deutschland können Unternehmen, deren Barrierefreiheit nicht den neuen Standards entspricht, mit Bußgeldern von bis zu 500.000 Euro belegt werden.

1.

Ein gemeinsames Ziel vor Augen führen

Barrierefreiheit bedeutet nicht „Design für Menschen mit Behinderung“. Es bedeutet: Gestaltung, die niemanden ausschließt. Denn Barrieren entstehen oft dort, wo nicht mitgedacht wird – bei kleinen Schriftgrößen, unklaren Formularen, schlecht kontrastierten Farben oder fehlenden Alternativtexten für Bilder.

Es ist entscheidend, dieses Verständnis im gesamten Team zu schaffen, idealerweise im gesamten Unternehmen. Diese Basis ist wichtig, um gemeinsam auf das Ziel Barrierefreiheit hinzuarbeiten – ohne das eigentliche Ziel eines erfolgreichen digitalen Produkts aus den Augen zu verlieren.

2.

Verständnis und Bewusstsein schaffen

Barrierefreiheit beginnt mit Bewusstsein. Deshalb sollten alle Projektbeteiligten die Grundlagen inklusiven Designs und vor allem auch mögliche Barrieren von Nutzer:innen kennen. Online-Kurse, interne Guidelines oder interaktive Workshops mit Accessibility-Expert:innen helfen, das Thema aus der Theorie in die Praxis zu bringen.

Besonders hilfreich: Fallbeispiele und Live-Tests mit Betroffenen. Wer einmal erlebt hat, wie eine schlecht getaggte Seite über einen Screenreader klingt, versteht sehr schnell, warum semantisches HTML keine Nebensache ist. Wer selbst einmal damit umgehen muss, wie schlecht sich eine Seite ohne Maus navigieren lässt, deren Elemente nicht alle mit der Tab-Taste fokussierbar sind, wird hierfür eine Lösung suchen wollen. Das fördert nicht nur Qualität, sondern auch Motivation.

3.

Schwach- und Baustellen identifizieren und angehen

Bevor mit der Umsetzung begonnen wird, braucht es Klarheit über Zuständigkeiten, Prozesse und Werkzeuge. Accessibility darf nicht allein bei der Entwicklung verortet werden. Es betrifft UX, UI, Content, QA, Management. Kurz: alle, die an digitalen Produkten mitwirken – sowohl an den bestehenden als auch an der Produktentwicklung.

Für die tatsächlichen To-Dos ist die sogenannte A11Y-Checkliste ein guter Startpunkt. Sie deckt typische Problemfelder ab – von Überschriftenstruktur über Farbkontraste bis hin zur Tastaturnavigation – und hilft dabei, bestehende Produkte systematisch zu überprüfen. Zusätzlich bieten Design-Tools wie Figma zahlreiche Plugins, um Accessibility direkt im Designprozess mitzudenken: etwa der a11y Color Contrast Checker, Annotation Kits oder der Stark-Plugin. Wer dann seine Schwach- und Baustellen kennt, kann sichergehen, die notwendige Expertise im Team zu haben oder entsprechend beispielsweise mit externer Unterstützung nachhelfen.

4.

Umsetzen, testen, messen, verbessern

Accessibility ist kein Sprint. Die Anforderungen entwickeln sich weiter. Wer dauerhaft compliant bleiben will, braucht regelmäßige Updates – sowohl technisch als auch organisatorisch. Es braucht systematische Qualitätssicherung. Neben automatisierten Tests (zum Beispiel mit Tools wie WAVE oder Axe) sollte auch regelmäßig manuell geprüft werden: Funktionieren alle Interaktionen mit der Tastatur? Gibt es sinnvolle Alternativtexte? Sind Fehlerhinweise verständlich?

Idealerweise werden reale Nutzer:innen mit unterschiedlichen Einschränkungen in Usability-Tests einbezogen. Ihre Perspektiven sind enorm wertvoll, denn sie zeigen oft Probleme auf, die den technischen Tests entgehen. Ergänzend dazu sollte jedes Projekt über eine lebende Dokumentation verfügen: Checklisten, bekannte Stolperfallen, bewährte Patterns. So wird Accessibility Teil der täglichen Praxis.

5.

Accessibility zur Haltung machen

Wer Barrierefreiheit wirklich erfolgreich umsetzen will, muss sie als Teil der Marken-DNA begreifen – nicht als Checkliste, sondern als Grundhaltung. Denn inklusive Produkte wirken auf alle: Sie vermitteln Verantwortung, Professionalität, Qualität. Wenn es gelingt, Accessibility mit der Markenidentität in Einklang zu bringen, verfliegen auch schnell die Bedenken dazu, dass sich Barrierefreiheit negativ auf die User Experience auswirkt.

Barrierefreiheit ist ein kontinuierlicher Bestandteil moderner Produktentwicklung – genauso wie Performance, Security oder UX. Wer jetzt handelt, verschafft sich nicht nur Rechtssicherheit, sondern bleibt auch im Rennen um Wettbewerbsvorteile: durch bessere Produkte, zufriedenere Nutzer:innen, ein glaubwürdiges Markenbild. Klar strukturierte Seiten, verständliche Sprache, funktionierende Navigation und reduzierte Komplexität führen meistens zu besseren Nutzungserlebnissen – und damit auch zu besseren Ergebnissen. Was als „Zugeständnis“ für bestimmte Nutzergruppen gedacht ist, wird oft zum echten Mehrwert für alle.

Online Marketing & SEO

Herkunftslabel: Siegel „Made in Germany“ genießt weltweit höchstes Vertrauen

„Made in Germany“ ist gefragt

Label wie „Made in Germany“ oder „Made in China“ finden sich auf Produkten wie Kleidung, Elektronik und Autos. Weltweit hat Deutschland ein gutes Image. In manchen Bereichen liegen aber andere vorn.

Produkte mit dem Herkunftssiegel „Made in Germany“ genießen laut einer Studie international höchstes Ansehen. Das Label werde von Konsumenten weltweit am ehesten als vertrauenswürdig angesehen, noch vor dem entsprechenden Siegel der Schweiz, heißt es in einer Umfrage des Nürnberg Instituts für Marktentscheidungen (NIM). Demnach vertrauen 66 Prozent der Befragten „Made in Germany“, knapp vor der Schweiz und Japan.

Deutschland punktet bei Autos, Frankreich bei Luxus

Die Herkunftsangabe „Made in Germany“ wurde Ende des 19. Jahrhunderts in Großbritannien eingeführt, um die heimische Wirtschaft vor vermeintlich minderwertigen Importen aus Deutschland zu schützen. Heute gilt das Label als Gütesiegel. Das zeigt sich auch in der Umfrage: „Made in Germany“ werde am häufigsten mit Qualität in Verbindung gebracht, so die Nürnberger Forscher.

Konsumenten weltweit verbinden mit „Made in Germany“ laut der Studie am meisten Verbrennerautos, gefolgt von Haushaltsgeräten. Andere Labels wie „Made in France“ werden demnach mit einer größeren Anzahl von Produkten assoziiert, etwa Kosmetik, Kleidung, Essen und Wein. Das Siegel „Made in USA“ hingegen werde mit Abstand positiv mit Künstlicher Intelligenz (KI) verbunden. Die Forscher warnen: Zwar habe Deutschland ein gutes Image, bei zukunftsorientierten Produkten wie KI, E-Autos oder Elektronik schnitten aber „Made in USA“ oder „Made in Japan“ stärker ab.

Gutes Image, aber Exporte unter Druck

Die Umfrage zeigt, dass Deutschland als Exportnation international ungebrochen hohes Ansehen genießt. Zugleich haben Deutschlands Exporteure der Bundesbank zufolge auf dem Weltmarkt an Wettbewerbsfähigkeit verloren. Die deutsche Wirtschaft ist stark vom Außenhandel abhängig. Fast jeder vierte Arbeitsplatz hängt vom Export ab, der wegen der hohen US-Zölle unter Druck steht und 2024 geschrumpft ist.

Online Marketing & SEO

Abnabelung von OpenAI? Claude kommt zum Microsoft Copilot

Im Microsoft Copilot Studio können User ab jetzt neben OpenAI-Modellen auch auf Anthropics hochleistungsfähige Modelle Claude Sonnet 4 und Claude Opus 4.1 setzen.

Schon lange arbeiten der Tech-Konzern Microsoft und das weltbekannte KI-Unternehmen OpenAI eng zusammen. Die Modelle von OpenAI werden als Basis für diverse KI-Lösungen Microsofts eingesetzt. So ist zum Beispiel das im Sommer gelaunchte Modell GPT-5 in 365 und im Copilot integriert worden. Bislang waren bei Microsofts Allround-KI-Assistenz Copilot ausschließlich OpenAI-Modelle verfügbar. Jetzt kommen Optionen vom Konkurrenzunternehmen Claude hinzu. Damit verringert Microsoft die Abhängigkeit von OpenAI, dem Unternehmen das inzwischen mit vielen anderen Tech-Unternehmen kooperiert, um eine noch bessere KI-Infrastruktur liefern zu können. Erst kürzlich hat die ChatGPT-Mutter einen milliardenschweren Deal mit Oracle abgeschlossen und 100 Milliarden US-Dollar Investition von NVIDIA zugesichert bekommen sowie zehn Gigawatt für die KI-Entwicklung.

Anthropic pusht Coding‑KI:

Das kann Claude Opus 4.1

Anthropic kommt ins Copilot Studio von Microsoft

Wie Microsoft auf dem hauseigenen Blog mitteilt, werden künftig zwei Modelle von Anthropic im Copilot Studio verfügbar sein. Dabei handelt es sich um Claude Sonnet 4 und Claude Opus 4.1. Letzteres Modell gilt als hochleistungsfähige Alternative, die gerade im Bereich Coding und Software-Entwicklung sehr gute Ergebnisse erzielt. Claude Sonnet 4 wiederum ist deutlich leistungsfähiger als Sonnet 3.7 und passt sich Instruktionen besser an – etwa beim Schreiben –, antwortet präziser und kann Coding und Reasoning deutlich besser durchführen.

Die Einführung der Anthropic-Modelle soll Usern mehr Flexibilität bei der Gestaltung von Agents und Workflows im Copilot Studio liefern. Dort können sie Agents für bestimmte Aufgaben oder Teams erstellen sowie KI-gestützte Funktionen für spezifische Workflows festlegen. Deshalb ist der Einsatz von Claude Sonnet 4 und Claude Opus 4.1 bei der Orchestrierung von Agents ebenso wie im Prompt Builder und dort im Drop-down-Menü möglich. So können alle User das Modell ihrer Wahl für den Einsatz eines Projekts nutzen.

Wer die Modelle von Anthropic nutzen möchte, muss sie erst durch Admins im Microsoft 365 Admin Center (MAC) einstellen lassen. Dann werden sie als Default im Power Platform Admin Center (PPAC) geführt. Sofern die Anthropic-Modelle ausgeschaltet werden, arbeitet der Copilot im Studio wieder mit OpenAIs GPT-4o.

Alle Details zum Einsatz der Modelle im Copilot Studio findest du im Blog Post von Dan Lewis, Corporate Vice President für das Copilot Studio. Dort teilt er auch ein Beispielszenario für die Erstellung eines HR Onboarding Agents inklusive Datei-Upload, Prompt-Kreation und Modellauswahl.

Der Microsoft Copilot bietet Usern diverse Nutzungskontexte. Zuletzt launchte Microsoft beispielsweise eine Copilot AI-Integration im viel genutzten Tool Excel. Unterdessen soll der Tech-Konzern an einem einzigartigen Publisher Content Marketplace arbeiten, der Publisher finanziell für den Einsatz ihrer Inhalte im Copilot entschädigen soll. Damit würden Publisher letztlich vom umfassenden Zugriff des Copilot auf ihren Content profitieren können.

Entlohnung für AI-Nutzung:

Microsoft plant wohl Publisher Marketplace

Online Marketing & SEO

Google Search Live: 5 Tipps zum Einsatz

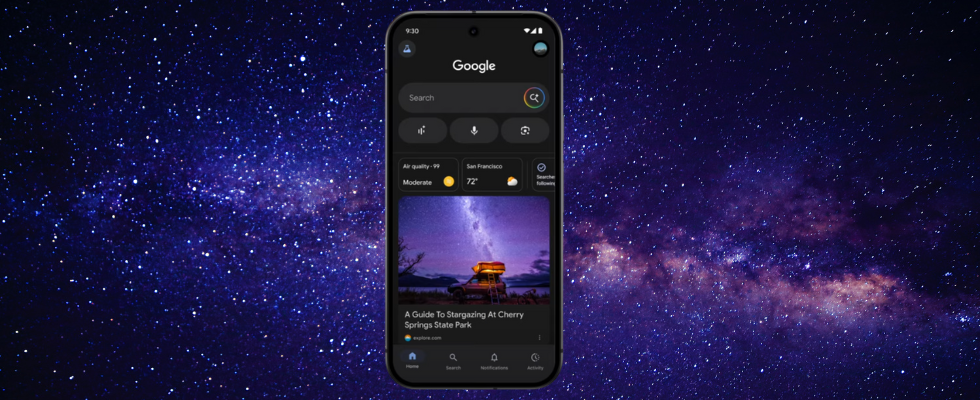

Hunderte Millionen User können jetzt ohne Labs Login Googles Live-Suche mit Kamera und Stimme nutzen, um beispielsweise Hilfe beim Kochen oder Reparieren, Infos beim Reisen oder Einkaufen zu erhalten. Wir zeigen fünf Anwendungsoptionen.

Wenn du nicht weißt, wie du deinen Matcha richtig zubereitest, welches Kabel du wo anschließen musst oder welche Sehenswürdigkeit du gerade vor dir siehst, kannst du einfach mit Google sprechen. Denn dank der neuen Suchfunktion Search Live haben User die Option, im Echtzeitgespräch mit aktivierter Kamera via Stimme und Live Visuals zu suchen. Das funktioniert als eine Konversation mit dem AI Mode, in der Googles KI mithilfe von Gemini als Modell multimodal auf unterschiedliche Bedürfnisse reagiert. Google rollt Search Live nach ersten Tests jetzt für die erste große User-Gruppe direkt in der Suche aus und liefert gleich noch konkrete Anwendungsbeispiele mit dazu.

Google testet Search Live:

Kommt jetzt der Voice Shift in der Suche?

Search Live von Google in der Übersicht: Der Roll-out beginnt

Bisher war Search Live als Test-Feature jenen Usern vorbehalten, die sich in den Google Search Labs registriert haben. So hat es das Unternehmen zuvor auch schon mit anderen Features wie dem AI Mode selbst gehandhabt. Jetzt ist Search Live ohne Login für alle Search User verfügbar, allerdings zunächst nur in den USA und auf Englisch.

Der Modus erlaubt es Nutzer:innen, per Stimme mit Googles KI zu sprechen und Fragen zu all dem zu stellen, was über den geteilten Kamera-Screen zu sehen ist. Der AI Mode reagiert in Echtzeit auf die Anfragen und gibt passende Antworten sowie Links zu relevanten Quellen. Der interaktive Konversationsmodus mit AI Support und Web-Inhalten im Hintergrund soll die Suche weiter revolutionieren. Er lässt sich indes in verschiedenen Situationen einsetzen, die Millionen Usern im Alltag begegnen.

5 Einsatzmöglichkeiten für Search Live als Inspiration

Liza Ma, Director im Product Management für den Search-Bereich Googles, liefert auf dem Blog The Keyword fünf Beispiele für Echtzeithilfe von Google Search Live. Wer die Google App öffnet, findet das neue Live Icon unter der Search Bar. Auch der Zugang über Google Lens und das neue Live Icon ist möglich.

1. Erhalte umfassende Informationen beim Reisen

Du kannst Search Live nutzen, um dich auf Reisen über Sehenswürdigkeiten rechts und links, die besten Routen oder unbekannte Bräuche zu informieren, um noch tiefer in ein Land und eine Kultur einzutauchen. Das Ganze funktioniert hands-free, sodass du beispielsweise in einem Café einfach Fragen zu deiner Umgebung stellen und die lokale Kulinarik zugleich genießen kannst.

2. Versuche dich an einem neuen Hobby

Du möchtest mal wieder etwas Neues lernen und benötigst gerade zum Start Support? Google Search Live kann dir beispielsweise bei der optimalen Matcha-Zubereitung mit einem neuen Matcha Set helfen oder dir alternative Rezepte beim Kochen, Backen oder Zubereiten exotischer Delikatessen – vielleicht gefunden bei der vergangenen Reise – vorschlagen.

3. Lasse dir beim Anschließen von Tech-Systemen helfen

Wenn du ein neues Soundsystem, einen Fernseher oder irgendein technisches Gerät anschließen möchtest, aber dir bei der Aufteilung der Kabel zu den passenden Anschlüssen unsicher bist, kannst du auch Google Search Live einsetzen. Die KI erkennt über die Kamera die verschiedenen Kabel und technischen Geräte und kann Hilfestellung leisten – zumindest in der Theorie.

4. Schulaufgaben erwachen zum Leben

Für Schüler:innen und Student:innen kann Search Live ebenso eine Lernhilfe sein. Im Beispiel von Liza Ma erklärt Googles KI die chemischen Prozesse hinter dem bekannten Elephant-Toothpaste-Experiment. Dabei entsteht durch die Mischung von Wasserstoffperoxid, Kaliumiodid oder Hefe und warmem Wasser als Katalysator eine schaumige Substanz, die sich ausbreitet.

5. Hilfe bei der Auswahl von Spielen

Wer in einem Ferienhaus mit Freund:innen unterwegs ist und einen Spieleabend starten möchte, aber nicht sicher ist, welches der Spiele aus der Sammlung am besten zur Gruppe passt, kann diese einfach Google Search Live zeigen und sich Vorschläge machen lassen. Im Gespräch mit der KI kann die beste Lösung ermittelt werden. Dieses Beispiel lässt sich auf andere Bereiche übertragen, etwa die Auswahl von Restaurants, Filmen im Kino oder passenden Wanderrouten im Urlaub.

Search Live bietet also umfassende Einsatzoptionen, die noch weit über diese knappen Beispiele hinausgehen. Zugleich sind die User angehalten, dem AI Mode und Gemini nicht uneingeschränkt zu vertrauen, sondern im Zweifel eigene Erkundigungen einzuholen. Auch sollte man sich nicht dauerhaft auf die KI-Unterstützung verlassen. Zwar wird sie für Digital-User zum Alltag der Zukunft gehören, doch wenn ein Gerät oder Dienst ausfällt, sollte das nicht die Handlungsfähigkeit der Menschen zurückstellen. Nutze Search Live also als Instrument.

Dieses Instrument unterstreicht derweil, wie facettenreich Googles AI Mode inzwischen ist. Dieser wurde jüngst in über 180 Ländern und verschiedenen Sprachen ausgerollt – jetzt auch in Spanisch – und wird durch die umfassende Einbettung in Chrome, etwa in der Adresszeile, noch mehr Nutzungskontexte erhalten. Der AI Mode ist eine wichtige Säule der Zukunft der Internetsuche.

Gemini und AI Mode erobern Chrome:

Googles größtes Browser Update aller Zeiten

-

UX/UI & Webdesignvor 1 Monat

UX/UI & Webdesignvor 1 MonatDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 4 Wochen

UX/UI & Webdesignvor 4 WochenAdobe Firefly Boards › PAGE online

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatPosit stellt Positron vor: Neue IDE für Data Science mit Python und R

-

Entwicklung & Codevor 3 Wochen

Entwicklung & Codevor 3 WochenEventSourcingDB 1.1 bietet flexiblere Konsistenzsteuerung und signierte Events

-

UX/UI & Webdesignvor 1 Woche

UX/UI & Webdesignvor 1 WocheFake It Untlil You Make It? Trifft diese Kampagne den Nerv der Zeit? › PAGE online

-

Digital Business & Startupsvor 3 Monaten

Digital Business & Startupsvor 3 Monaten10.000 Euro Tickets? Kann man machen – aber nur mit diesem Trick

-

Digital Business & Startupsvor 3 Monaten

Digital Business & Startupsvor 3 Monaten80 % günstiger dank KI – Startup vereinfacht Klinikstudien: Pitchdeck hier