Apps & Mobile Entwicklung

Medienberichte: Samsung qualifiziert endlich 12-Hi HBM3e für Nvidia

Nach jahrelangen Rückschlägen soll es Samsung endlich gelungen sein, den HBM3e für Nvidia zu qualifizieren und final validieren zu lassen. Die Lieferung soll sofort starten, denn das Unternehmen hatte im letzten halben Jahr bereits fleißig auf Halde vorproduziert. Von 10.000 Einheiten direkt zu Beginn ist die Rede.

Noch keine offizielle Bestätigung

Aktuell ist die Quellenlage allerdings noch ziemlich dünn, eine offizielle Bestätigung gibt es nicht. Lediglich das südkoreanische Magazin Alpha Economy direkt aus Seoul berichtet darüber. Wenige Stunden zuvor gab es aber auch bereits erste Gerüchte, die via X verbreitet wurden. Am Tag zuvor hieß es hingegen noch, Samsungs HBM3e sei endgültig durchgefallen; diese Behauptung verneinte Samsung jedoch umgehend und erklärte, alles laufe nach Plan.

Da dieser eigentlich nur vorsieht, dass die Chips von Nvidia gekauft werden, könnte sich die Meldung letztlich als zutreffend erweisen. Zuletzt wirkte die Lage noch dramatisch, als es aus dem Umfeld hieß, Samsung würde sein Leben darauf verwetten, dass der eigene HBM3e am Ende noch zum Erfolg wird.

10.000 Einheiten können viel, aber auch wenig sein

Nicht ganz klar ist, worauf sich die Anzahl von 10.000 Einheiten, die Samsung an Nvidia liefern soll, genau bezieht. Was auf den ersten Blick nach viel klingt, ist aus anderer Perspektive sehr überschaubar. Ein Nvidia GB300 benötigt allein acht 12-Hi-Stacks mit je 36 GByte Kapazität, um seine 288 GByte realisieren zu können. 10.000 komplette HBM3e-Stapel würden also auch erst einmal nur für 1.250 GB300 reichen.

Samsungs Preis für HBM3e 12Hi soll deutlich unterhalb des Preises liegen, den SK Hynix bisher verlangt hat. Koreanische Analysten sehen ihn bei Samsung bei 360 US-Dollar pro Stapel, bei SK Hynix lag der Preis in diesem Jahr bei 540 US-Dollar. Preissenkungen für HBM3e könnten langfristig also die Folge sein, doch schon bald übernimmt HBM4. Hier geht es ebenfalls als 12-Hi Stack wohl bei rund 600 US-Dollar los.

Bei HBM4 erneut hinter SK Hynix?

Letzte Berichte besagen, dass es bei HBM4 zu Beginn wohl erneut ein Alleingang von SK Hynix werden könnte, jedoch soll er dieses Mal nicht mehrere Jahre, sondern nur Monate andauern. Samsung könnte demnach in rund einem Jahr bei HBM4-Lieferungen einsteigen. Nach dem Desaster mit der HBM3e-Qualifizierung bleibt das aber abzuwarten.

Update

Apps & Mobile Entwicklung

Steam Sale: Große Winter-Rabattaktion auf Steam hat begonnen

Schon zwei Tage vor der Wintersonnenwende und damit dem astronomischen Beginn der kalten Jahreszeit läutet Valve mit der zugehörigen Rabattaktion auf Steam den Winter ein. Die Angebote laufen bis zum Abend des 5. Januar 2026, dann ist um 19:00 Uhr Schluss. Nebenher läuft bis zum 3. Januar die Endabstimmung zu den Steam Awards.

Der letzte und erste Steam Sale des Jahres

Laut Valve sind im Rahmen der letzten Rabattschlacht des Jahres erneut Tausende Spiele im Preis reduziert. Mit einem Trailer stimmt der Store-Betreiber auf die begonnene Winteraktion ein.

Nachdem Punkteshop-Dreingaben bei Genre-Aktionen längst keine Selbstverständlichkeit mehr waren, gib es diesmal wieder drei animierte Sticker mit Schnee-Thema gratis. Nutzer müssen sich dafür lediglich einmal durch ihre auf der Event-Seite eingebettete Steam-Entdeckungsliste klicken.

Zu bedenken ist bei derartigen Rabattaktionen wie üblich, dass Sale-Preise nicht unbedingt Tiefstpreise sein müssen. Eine Übersicht über derzeit reduzierte Spiele, bisherige Tiefstpreise und diverse Filter-Optionen liefert die Datenbank SteamDB. Wer am Event teilnehmende und derzeit im Preis reduzierte Spiele empfehlen möchte, kann dies gerne in den Kommentaren tun. Auch Anmerkungen oder Erfahrungen zu teilnehmenden Titeln sind gerne gesehen.

Nach dem Steam Sale ist vor dem Steam Sale

Bei der Winter-Aktion handelt es sich traditionell um die letzte Rabattaktion des Jahres, die wiederum gleichzeitig auch die erste des neuen Jahres ist – schließlich enden die Angebote erst am 5. Januar 2026. Anschließend geht es bereits eine Woche später mit einem Genre-Sale zu Detektivspielen weiter.

Apps & Mobile Entwicklung

Vodafone startet krasses Angebot » nextpit

Wenn Ihr flexibel bleiben möchtet und auf eine feste Vertragslaufzeit verzichten wollt, könnten die neuen Jahrestarife von Vodafone genau das Richtige für Euch sein. Einer davon bietet satte 1.000 GB – und das für nur rund 16 Euro im Monat. Ein starker Deal? Wir machen den Check.

Vodafone hat kürzlich neue Prepaid-Angebote eingeführt, die nicht wie üblich monatlich laufen, sondern direkt für zwölf Monate gelten. Statt jeden Monat Guthaben aufzuladen, begleicht Ihr den Betrag nur einmal im Jahr. Gleichzeitig bleibt Ihr unabhängig von langen Vertragsbindungen: Anders als bei klassischen Laufzeitverträgen geht Ihr keine Verpflichtung über mehrere Jahre ein und könnt bei besseren Konditionen problemlos wechseln. Wir nehmen die Vodafone-Jahrespakete im Detail unter die Lupe.

Bis zu 1.000 GB pro Jahr: Das bieten die Vodafone-Jahrespakete

Klassische Laufzeitverträge bringen oft einen entscheidenden Nachteil mit sich: Ihr legt Euch langfristig fest, während der Markt in der Zwischenzeit gegebenenfalls längst attraktivere Angebote bereithält. Prepaid-Tarife bieten zwar mehr Freiheit, verlangen jedoch regelmäßiges Aufladen oder das Nachkaufen von Datenpaketen. Genau an diesem Punkt setzen die neuen CallYa-Jahrespakete von Vodafone an, die in den Varianten XS, M und XL erhältlich sind:

- CallYa-Jahrespaket XS mit 20 GB für einmalig 49,99 Euro

- CallYa-Jahrespaket M mit 180 GB für einmalig 99,99 Euro

- CallYa-Jahrespaket XL mit 1.000 GB für einmalig 199,99 Euro

Je nach Tarif stehen Euch 20, 180 oder sogar 1.000 Gigabyte für zwölf Monate zur Verfügung, über die Ihr frei verfügen könnt. Ihr entscheidet also selbst, wann Ihr wie viel Datenvolumen nutzt: Im Urlaub könnt Ihr problemlos mehr verbrauchen, während Ihr in anderen Monaten überwiegend im WLAN bleibt und entsprechend weniger benötigt. Falls das enthaltene Datenvolumen doch einmal nicht ausreichen sollte, lässt es sich jederzeit kostenpflichtig erweitern.

Alle Jahrestarife enthalten mobiles Internet im 5G-Netz sowie eine Telefon- und SMS-Flatrate in sämtlichen deutschen Netzen. Dank EU-Roaming nutzt Ihr die Pakete außerdem ohne Einschränkungen im gesamten EU-Ausland. Zusätzlich stellt Vodafone pro Jahr 2.400 Freiminuten oder SMS bereit, die Ihr von Deutschland aus in andere EU-Länder verwenden könnt. Funktionen wie WiFi-Calling sorgen zudem für bessere Sprachqualität in Gebäuden.

Rund 50 bis 200 Euro pro Jahr: Diese Kosten kommen auf Euch zu

Das CallYa-Jahrespaket XS umfasst 20 GB Datenvolumen und kostet einmalig 49,99 Euro pro Jahr, was rechnerisch rund 1,6 GB monatlich entspricht. Diese Menge eignet sich vor allem für Messenger, gelegentliche Online-Abfragen oder Navigation. Deutlich mehr Spielraum bietet das Jahrespaket M: Für 99,99 Euro pro Jahr stehen Euch 180 GB zur Verfügung, ideal für Musik-Streaming, Podcasts und soziale Netzwerke unterwegs.

Am umfangreichsten fällt das CallYa-Jahrespaket XL aus. Hier erhaltet Ihr insgesamt 1.000 GB, die Ihr flexibel über das gesamte Jahr verteilen könnt. Durchschnittlich entspricht das etwa 83 GB pro Monat – Ihr könnt aber auch in einem Monat nur wenige Gigabyte nutzen und in einem anderen deutlich mehr. Der Preis liegt bei 199,99 Euro für 365 Tage, was rund 16,50 Euro pro Monat entspricht. Damit bietet dieses Paket das stärkste Gesamtpaket in Sachen Preis und Leistung.

Mit diesem Symbol kennzeichnen wir Partner-Links. Wenn du so einen Link oder Button anklickst oder darüber einkaufst, erhalten wir eine kleine Vergütung vom jeweiligen Website-Betreiber. Auf den Preis eines Kaufs hat das keine Auswirkung. Du hilfst uns aber, nextpit weiterhin kostenlos anbieten zu können. Vielen Dank! Preisangaben basieren auf dem Zeitpunkt der Veröffentlichung dieses Artikels und können Schwankungen unterliegen.

Dieser Artikel ist Teil einer Kooperation mit Vodafone.

Der Partner nimmt keinen Einfluss auf den Inhalt des Artikels.

Apps & Mobile Entwicklung

Steam Awards 2025: Abstimmung ist gestartet, das sind die nominierten Spiele

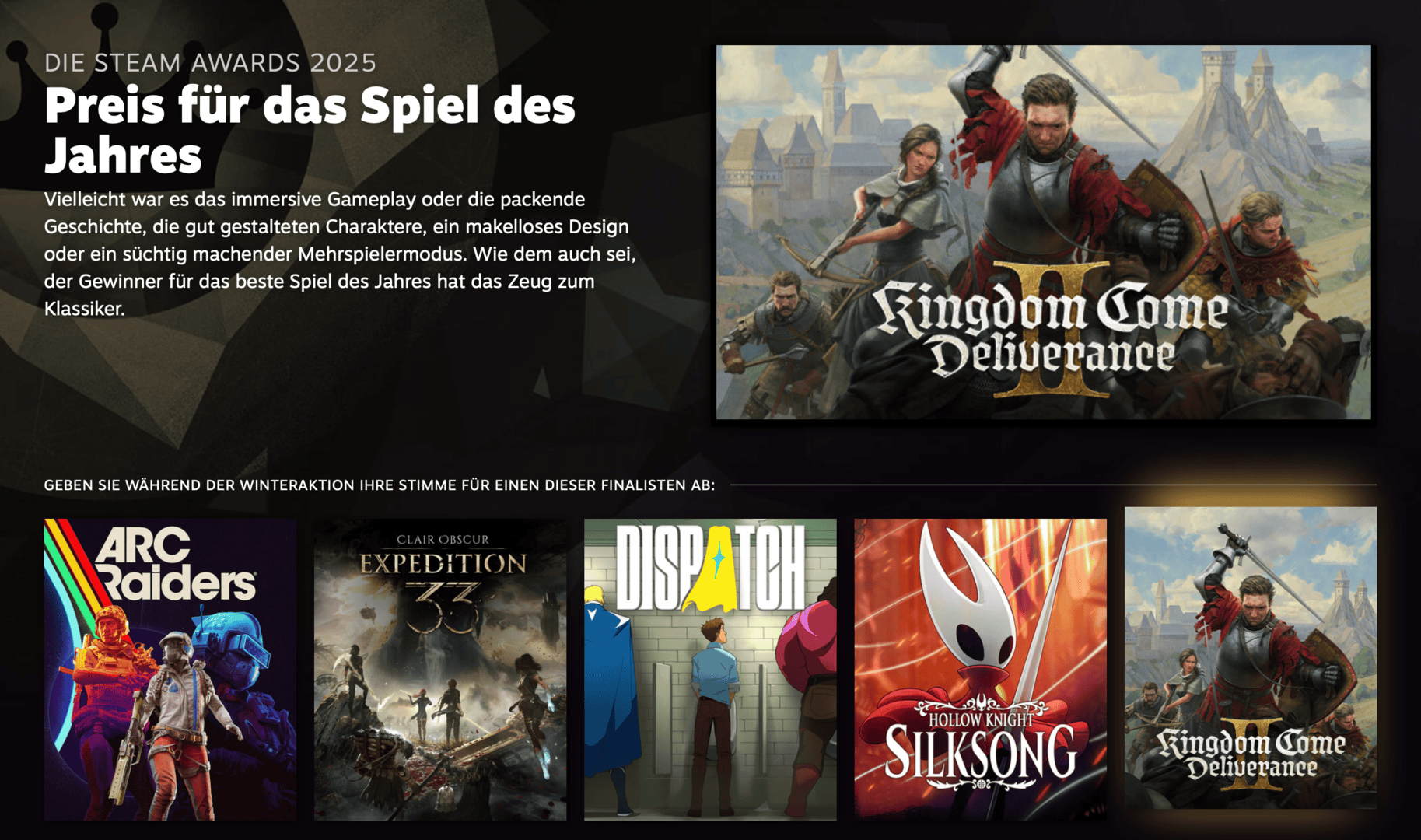

Mit dem Start der Winter-Rabattaktion auf Steam stehen auch die 55 nominierten Spiele für die Steam Awards 2025 fest. Ab sofort können alle Spieler mit Steam-Account in elf Kategorien unter den jeweils fünf Finalisten abstimmen. Die Bekanntgabe der Gewinner erfolgt am 3. Januar 2026.

11 × 5 Nominierungen stehen fest

Ausgewählt wurden die nominierten Spiele ausschließlich von Steam-Nutzern. Bis zum 1. Dezember konnten Spieler ihre favorisierten Titel vorschlagen, jetzt ist die Endabstimmung unter den jeweils fünf Spielen mit den meisten Vorschlägen je Kategorie gestartet. Als Spiel des Jahres stehen der Extraction-Shooter Arc Raiders von Embark, Clair Obscur: Expedition 33 von Sandfall Interactive, Dispatch von AdHoc Studio, Hollow Knight: Silksong von Team Cherry und Kingdom Come: Deliverance II von Warhorse zur Auswahl.

Die nominierten Spieler aller zehn weiteren Kategorien lassen sich der Bildergalerie entnehmen. Auch bei der finalen Abstimmung haben allein Steam-Nutzer das sagen.

Ein Gegenentwurf zu den Game Awards

Die Steam Awards sind somit ein Gegenentwurf zu den Game Awards, deren Sieger für das Jahr 2025 bereits feststehen. Verantwortlich zeichnete dabei maßgeblich eine Jury, bestehend aus einflussreichen Gaming-Medien und -Influencern. Spieler selbst konnten für die nominierten Titel bloß mit einem reinen Stimmgewicht von nur 10 Prozent abstimmen.

Beide Ansätze bringen Vor- und Nachteilen mit sich. Bei den Steam Awards können etwa kategorisch keine Spiele berücksichtigt werden, die gar nicht auf Steam erschienen sind – logisch. Ins Hintertreffen geraten aber ebenso Spiele, die zum Release weniger Trubel und Hype erzeugt haben oder schlicht und ergreifend nicht genügend Spieler über Influencer mobilisieren können. Schlimmstenfalls wird in erster Linie Popularität bewertet, nicht Qualität.

Angesichts der bei Unterhaltungsmedien immer wieder auftretenden Phänomene Review Bombing und Vote Brigading laden publikumsbasierte Preise selbstredend zu Missbrauch ein. Außerdem öffnet eine unkuratierte Abstimmung auch Tür und Tor für Trolle: Vor zwei Jahren hat etwa ausgerechnet Starfield den Preis für das innovativste Gameplay erhalten. Unumstritten und per se aussagekräftiger als die Game Awards sind Valves virtuelle Trophäen also auch nicht.

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenIllustrierte Reise nach New York City › PAGE online

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAus Softwarefehlern lernen – Teil 3: Eine Marssonde gerät außer Kontrolle

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenSK Rapid Wien erneuert visuelle Identität

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatKommandozeile adé: Praktische, grafische Git-Verwaltung für den Mac

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenNeue PC-Spiele im November 2025: „Anno 117: Pax Romana“

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenDonnerstag: Deutsches Flugtaxi-Start-up am Ende, KI-Rechenzentren mit ARM-Chips

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenArndt Benedikt rebranded GreatVita › PAGE online