Online Marketing & SEO

Wie du mit Google-KI Bilderbücher und 3D-Welten erstellst

Fotorealistische 3D‑Welten in Echtzeit und personalisierte Geschichten auf Knopfdruck: Mit Genie 3 eröffnet Google DeepMind neue Möglichkeiten für Bildung, kreatives Arbeiten und Robotik. Parallel ermöglicht die Gemini App das Erstellen individueller Bilderbücher in über 45 Sprachen und macht Lernen wie Erzählen neu erlebbar. KI, die Geschichten erzählt und Welten formt – direkt erlebbar.

Google erweitert sein KI‑Portfolio gleich doppelt: DeepMind stellt mit Genie 3 ein Weltmodell vor, das fotorealistische 3D‑Welten in Echtzeit erzeugt. Parallel bringt das Unternehmen in der Gemini App ein Storytelling Feature an den Start, das personalisierte, illustrierte Bilderbücher in über 45 Sprachen erstellt – auf Basis weniger Eingaben.

In Sekunden zum Erklärvideo:

Googles NotebookLM bekommt Video Overviews

Genie 3: Interaktive KI‑Welten mit Realismus und Gedächtnis

Google DeepMind hat mit Genie 3 ein neues Weltmodell vorgestellt, das interaktive 3D‑Welten in Echtzeit erzeugen kann – allein auf Basis einer Texteingabe. Die Umgebungen laufen mit 24 Bildern pro Sekunde in 720p und bleiben mehrere Minuten lang konsistent. Sogar Details wie Farben, Objektpositionen oder Landschaftsmerkmale werden gespeichert, wenn man den Blick abwendet und später zurückkehrt. In diesem kurzen offiziellen Demonstrationsvideo zeigt Google, wie Genie 3 eine interaktive 3‑Dimensional‑Welt in Echtzeit generiert.

Wie DeepMind im offiziellen Blog erklärt, können Nutzer:innen in diesen KI‑Welten frei navigieren. Sie lassen sich nicht nur betrachten, sondern auch verändern. Der Schritt gilt als Meilenstein in der Forschung zu sogenannten Weltmodellen und könnte Bildung, Robotik und kreative Produktion grundlegend verändern.

Von experimentellen Modellen zu immersiven Simulationen

Weltmodelle simulieren Umgebungen, um KI‑Systeme zu trainieren oder Szenarien für Forschung, Bildung und Unterhaltung zu erschaffen. DeepMind arbeitet seit mehr als zehn Jahren daran, von Strategiespielsimulationen bis zu Trainingsumgebungen für Roboter.

Mit den Vorgänger:innen Genie 1 und Genie 2 konnten bereits neue Szenen generiert werden. Doch die Interaktion war stark eingeschränkt: Meist ließen sich die Welten nur zehn bis 20 Sekunden lang nutzen, bevor sie instabil wurden. Laut The Verge fühlten sich diese Umgebungen eher wie eine unscharfe, sich ständig verändernde Version von Google Street View an. Genie 3 erhöht die Interaktionszeit auf mehrere Minuten, führt ein visuelles Gedächtnis von rund einer Minute ein und liefert stabilere, fotorealistische Szenen – vom Spaziergang an einem Gletschersee über die Fahrt durch ein Vulkangebiet bis zur Erkundung historischer Orte wie Venedig oder dem antiken Athen. In diesem offiziellen Clip demonstriert Google, wie Genie 3 dynamische 3D‑Welten in Echtzeit erzeugt, inklusive stabiler Umgebung, Navigation und Weltereignissen.

Dieses weitere Video visualisiert die Simulation natürlicher Welten mit realistischen Landschaften, fließendem Wasser und beweglicher Vegetation, erzeugt von Genie 3.

Ein offizieller Modellvergleich von Google zeigt zudem, dass Genie 3 die eigenen Vorgänger:innen deutlich übertrifft: Es bietet höhere Auflösung, Echtzeitreaktionen, eine längere Interaktionsdauer und erweiterte Steuerungsmöglichkeiten wie Navigation und steuerbare Weltereignisse.

Steuerbare Weltereignisse: Wetterwechsel, Charaktere, Hindernisse

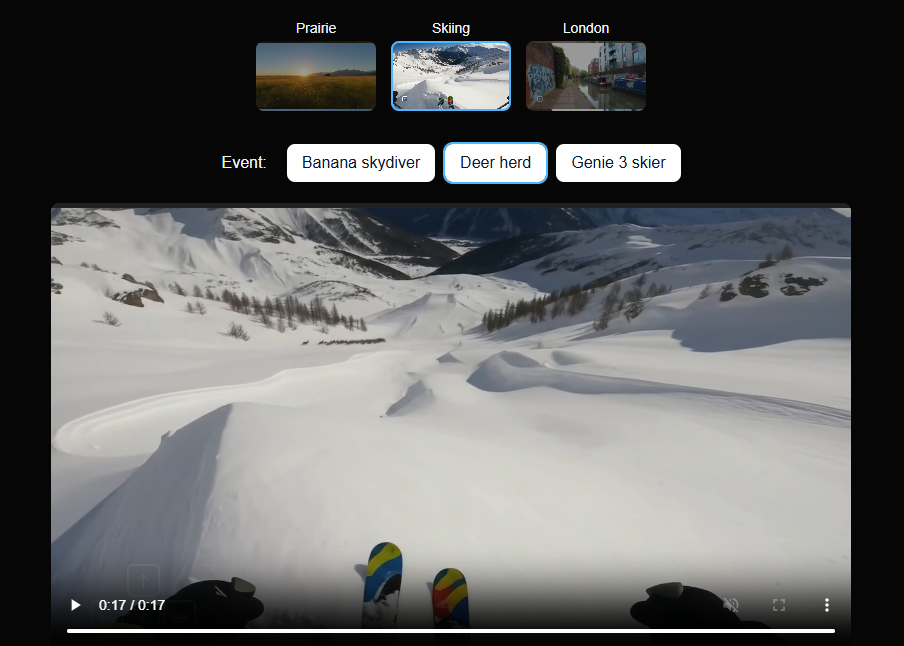

Eine der bedeutendsten Neuerungen sind die aufforderungsfähigen Weltereignisse. Sie ermöglichen es, KI‑Welten während der Interaktion dynamisch anzupassen. Per Texteingabe können Nutzer:innen etwa das Wetter ändern, neue Objekte platzieren oder Charaktere hinzufügen. Das nachfolgende Beispiel zeigt eine von Genie 3 simulierte Skifahrt aus der Ich‑Perspektive. Hier kommen die Weltereignisse zum Einsatz, um die Szene in Echtzeit zu verändern, beispielsweise durch das Einfügen eines „Banana Skydrivers“ oder eines „Genie 3 Skiers“.

Diese Funktionen eröffnen zahlreiche Möglichkeiten, von Unterrichtssimulationen bis zu Robotiktests. Lehrkräfte könnten historische Ereignisse immersiv erlebbar machen, Entwickler:innen könnten autonome Systeme in riskanten Umgebungen trainieren, ohne reale Gefahren einzugehen. Laut DeepMind kann diese Steuerung auch kontrafaktische Szenarien abbilden, um das Verhalten von KI‑Agents in unvorhergesehenen Situationen zu testen.

Potenzial für KI‑Agents und AGI‑Forschung

Google sieht Genie 3 als wichtigen Schritt in Richtung Artificial General Intelligence (AGI). Darunter versteht man KI‑Systeme, die nicht nur einzelne, klar abgegrenzte Aufgaben meistern, wie etwa Texte schreiben oder Bilder generieren, sondern flexibel in vielen verschiedenen Bereichen denken, lernen und handeln können, ähnlich wie ein Mensch. Weltmodelle wie Genie 3 sind dafür wichtig, weil sie KI‑Agents in einer simulierten Welt trainieren können: Sie setzen sich Ziele, verfolgen diese über längere Zeit und passen ihr Verhalten an, wenn sich die Bedingungen ändern. In Tests mit dem eigenen SIMA‑Agent – einem generalistischen KI‑Agent, der Anweisungen in verschiedenen virtuellen 3D‑Umgebungen ausführen kann – konnte DeepMind zeigen, dass durch die längere Interaktion auch komplexere Aufgaben erfolgreich abgeschlossen wurden.

Auch Kreative könnten profitieren. Wer eine Filmszene, eine Gaming‑Kulisse oder ein Kunstprojekt plant, kann mit Genie 3 innerhalb von Sekunden detailgetreue oder stilisierte Welten generieren – ohne klassische 3D‑Software. Die Möglichkeiten reichen von realistischen Naturaufnahmen bis zu fantasievollen Landschaften mit schwebenden Bergen oder biolumineszenten Pflanzen.

Grenzen, kontrollierter Roll‑out und Ausblick

Trotz der Fortschritte hat Genie 3 klare Einschränkungen. Die Interaktionsdauer bleibt auf einige Minuten begrenzt. Komplexe Mehrspieler:inneninteraktionen sind technisch schwierig umzusetzen. Reale Orte werden nicht millimetergenau rekonstruiert. Lesbarer Text in den Welten gelingt nur, wenn er explizit vorgegeben wird.

Deshalb wird Genie 3 vorerst als eingeschränkte Forschungsvorschau veröffentlicht. Zugang erhält nur eine kleine Gruppe von Wissenschaftler:innen und Entwickler:innen, um mögliche Risiken wie Missbrauch oder Fehlinformationen frühzeitig zu erkennen. Google DeepMind betont, dass das Modell von Anfang an verantwortungsbewusst entwickelt wurde und eng mit dem hauseigenen Team für „Responsible Innovation“ abgestimmt ist.

Langfristig ist der Weg zu breiteren Anwendungen jedoch vorgezeichnet. Google sieht Potenzial in Bildung, Robotik, kreativer Medienproduktion und virtuellen Trainingsumgebungen. Während Genie 3 noch im Forschungsstadium bleibt, ist die Bilderbuchfunktion bei Gemini bereits weltweit verfügbar.

Der Google-Dino steht auf:

Mit Veo 3 und Flow Bilder als Video animieren und sprechen lassen

Gemini App: Illustrierte Bilderbücher mit persönlicher Note

Parallel zu Genie 3 erweitert Google auch die Gemini App um ein Storytelling Feature. Wie im offiziellen Blog erklärt, können Nutzer:innen personalisierte, illustrierte Bilderbücher erstellen, die zusätzlich eine Audio Vorlesefunktion enthalten. Dazu genügt eine kurze Beschreibung der gewünschten Geschichte. Gemini erstellt daraus ein zehnseitiges Buch mit passender Illustration in einem frei wählbaren Stil, von Pixelart und Comic über Knetanimation bis hin zu Malbuchoptik. Auf Wunsch kann die KI sich auch von hochgeladenen Fotos oder Kinderzeichnungen inspirieren lassen.

Google nennt Beispiele wie eine kindgerechte Geschichte über das Sonnensystem für Fünfjährige oder eine Lektion über Freundlichkeit zwischen Geschwistern, bei der die Hauptfigur nach Wunsch ein Elefant oder ein anderes Lieblingstier ist. Auch Urlaubsfotos lassen sich so in personalisierte Abenteuer verwandeln. Im offiziellen Clip demonstriert Google die Erstellung eines personalisierten Bilderbuchs in der Gemini App. Gezeigt wird der gesamte Ablauf von der Texteingabe bis zur fertigen illustrierten Geschichte mit Audio Vorlesefunktion.

Das Feature unterstützt mehr als 45 Sprachen und ist seit dem 5. August 2025 weltweit in der Gemini App verfügbar – sowohl auf Desktop als auch mobil. Es richtet sich in erster Linie an Eltern, Pädagog:innen und kreative Anwender:innen, die individuell gestaltete Geschichten für Kinder oder Bildungsprojekte erstellen möchten. Auch für Marketer eröffnet sich Potenzial, etwa um eine kurze Markengeschichte zu erzählen. Gleiches gilt für HR‑Teams, die das Tool im Recruiting‑Kontext nutzen könnten. Die Möglichkeit, eigene Visuals hochzuladen, birgt allerdings auch ein gewisses Risiko für Plagiate. Wer das Feature testen möchte, findet das Storybook Tool unter gemini.google.com/gem/storybook.

KI, die Geschichten schreibt und Welten baut

Mit Genie 3 und der neuen Bilderbuchfunktion in der Gemini App zeigt Google, wie vielseitig generative KI inzwischen geworden ist. Auf der einen Seite steht ein Forschungs-Tool, das begehbare, realistische Welten erschafft und so eine völlig neue Dimension für Lernen, Training und kreatives Arbeiten eröffnet. Auf der anderen Seite gibt es ein sofort nutzbares Feature, das aus einer Idee in Minuten ein personalisiertes Bilderbuch entstehen lässt.

Beide Entwicklungen machen deutlich: KI wird greifbarer und kreativer und sie rückt näher an unseren Alltag. Ob als Werkzeug für Pädagog:innen, Spielwiese für Kreative oder als Lernplattform für zukünftige KI‑Agents, das Zusammenspiel von Genie 3 und der Gemini App zeigt das Potenzial, das noch vor uns liegt. Heute sind es Forschungsvorschau und frische App‑Funktion, morgen vielleicht feste Bestandteile unserer digitalen Werkzeuge.

Online Marketing & SEO

Sport-Sponsoring: Zalando wird Hauptpartner des DFB

Die Stars der Zalando-Kampagne sind unter anderem Florian Wirtz, Joshua Kimmich und Karim Adeyemi.

Zalando hat sich das Ziel gesteckt, Europas führende Sportplattform zu werden. Dafür steigt das Unternehmen jetzt massiv ins Sport-Sponsoring ein und schließt eine fünfjährige Partnerschaft mit dem Deutschen Fußball-Bund (DFB). Alle Details.

Zalando engagiert sich bereits seit Jahren im Sport, ist unter anderem Sponsor beim Berlin Marathon und LAAX Open, Europas größtes Freestyl

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

Online Marketing & SEO

AI Agents – Traumkolleg:innen oder Nervensägen?

AI Agents können den Arbeitsalltag erleichtern, doch sie bringen Tücken mit sich. Beim Digital Bash – SEA Live hat Daniel Flesch von Ambition eindrucksvoll gezeigt, wo AI Agents punkten und wann sie zur Stolperfalle werden. Einen Ausschnitt des Talks kannst du direkt im Artikel anschauen, den vollständigen Vortrag gibt es inklusive Praxisbeispielen und Workflow-Tipps kostenfrei zum Download.

Ob im Kund:innenservice, für die automatisierte Datenanalyse oder als Unterstützung im Sales-Bereich – AI Agents können schon heute wie eigenständige Mitarbeiter:innen agieren. Auf der Dreamforce 2025 wurde deutlich: Die Branche befindet sich in einer Übergangsphase, in der die CRM-Zeit der Agent-Ära weicht.

Schon heute setzen auch große Unternehmen wie Anthropic AI Agents für Aufgaben ein, die bisher von regulären Mitarbeiter:innen übernommen wurden – etwa beim Coding. Die Agents könnten die Arbeitswelt grundlegend verändern und Microsoft CEO Satya Nadella zufolge die Art, wie Menschen Computer nutzen, langfristig revolutionieren:

AI agents will become the primary way we interact with computers in the future.

Laut Salesforce ist das Zeitalter von Agentic Enterprise angebrochen, und auch für Perplexity sind AI Agents ein zentraler Bestandteil der Digitalentwicklung. Doch es gibt Gegenwind: Neben Datenschutzbedenken von Expert:innen und Usern könnten sich verschiedene Player, etwa E-Commerce-Plattformen, langfristig gegen die Nutzung von AI Agents wehren – Amazon hat einen solchen Schritt bereits eingeleitet.

Video: Chancen nutzen, falsche Erwartungen reduzieren

Welche weiteren Herausforderungen Unternehmen beim Einsatz von AI Agents begegnen können, weiß Daniel Flesch, AI Strategist bei ambition. Er hat beim Digital Bash – SEA Live über Chancen und Stolperfallen bei der Implementierung von AI Agents im Arbeitsalltag gesprochen. Du möchtest wissen, wo KI-Agents im Online Marketing einen echten Mehrwert bringen und wann sie an ihre Grenzen stoßen? Im Video verrät Daniel, warum die Agents Traumkolleg:innen sein können – und welche Eigenschaften sie zu echten Nervensägen machen.

Noch mehr Insights zu AI Agents, ihren Stärken und Defiziten gibt es im vollständigen Talk von Daniel Flesch, den du dir jetzt kostenfrei herunterladen kannst. Erfahre, wie du mit AI Agents wiederkehrende Aufgaben automatisierst, Prozesse clever verknüpfst und dein Marketing Setup smarter gestaltest. Im Vortrag erhältst du Antworten auf die folgenden Fragen:

- Was genau ist eigentlich ein AI Agent?

- Welche Use Cases lohnen sich wirklich?

- Wie vermeide ich typische Stolperfallen?

- Wie baue ich in wenigen Schritten ein smartes Setup auf?

Anhand konkreter Workflows und Praxisbeispiele lernst du, wie Künstliche Intelligenz dir Freiraum für das Wesentliche verschafft und in welchen Situationen menschliches Urteilsvermögen unverzichtbar bleibt. Viel Spaß beim Anschauen und Weiterbilden.

Online Marketing & SEO

OWM-Summit 2025: Ulrich Klenke über toxische Tonalität im Internet: „Das geht zu weit“

Ulrich Klenke sprach beim OWM-Summit in Berlin

Ulrich Klenke, Chief Brand Officer der Deutschen Telekom, sprach beim Summit der Organisation Werbungtreibender im Markenverband (OWM) in Berlin nicht nur über Markenführung und KI, sondern vor allem über die gesellschaftliche Stimmungslage und die toxische Tonalität im digitalen Raum.

Seine Worte waren ein Weckruf an die Branche – und ein Appell zur Selbstreflexion. „Ich war schon ein paar Mal davor zu sagen: Ich bin raus. Ich

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenAdobe Firefly Boards › PAGE online

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenGalaxy Tab S10 Lite: Günstiger Einstieg in Samsungs Premium-Tablets

-

UX/UI & Webdesignvor 3 Wochen

UX/UI & Webdesignvor 3 WochenIllustrierte Reise nach New York City › PAGE online

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenPosit stellt Positron vor: Neue IDE für Data Science mit Python und R

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenEventSourcingDB 1.1 bietet flexiblere Konsistenzsteuerung und signierte Events

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenFake It Untlil You Make It? Trifft diese Kampagne den Nerv der Zeit? › PAGE online