Künstliche Intelligenz

Wie Studierende KI an der Uni nutzen – und was Experten davon halten

Es ist 23 Uhr. Die Abgabefrist der Hausarbeit ist am nächsten Morgen. Im schlimmsten Fall bedeutet das eine mühselige Nachtschicht, um noch irgendwie zu bestehen. Für viel mehr ist keine Zeit.

Diese Erfahrungen machen einige Menschen während ihres Studiums. Doch vielleicht bekommen zukünftige Absolvent:innen mehr ruhige Nächte. Denn immer häufiger ist ChatGPT die Antwort auf die Forschungsfrage in der Hausarbeit. Ein nicht repräsentativer Forschungsbericht der Hochschule Darmstadt legt nahe, dass bereits 90 Prozent aller Studierenden in Deutschland KI-Tools für die Uni nutzen.

Einer von ihnen ist Alex (Name geändert). Er greift im Studium öfter auf ChatGPT zurück. Der 23-Jährige studiert Kindheitspädagogik in Hildesheim. „Ich habe mir tatsächlich auch schon unbenotete Arbeiten davon schreiben lassen“, erklärt er. Für ihn ist die generative KI eine Erleichterung. Die Universitäten stehen bei Studierenden wie Alex dagegen vor einer großen Aufgabe. Denn durch die großen Sprachmodelle verändert sich die Art, wie Wissen überprüft wird. Aber wie sollten Hochschulen damit umgehen?

Bitte nicht verbieten

Martin Wan beschäftigt sich mit Fragen wie diesen. Er ist Projektleiter für die Hochschulrektorenkonferenz (HRK) im Hochschulforum Digitalisierung (HFD). Das HFD unterstützt Hochschulen dabei, Fragen zum Einsatz von KI etwa im Studium und der Lehre zu meistern. Während es vereinzelte Stimmen gibt, die nach einem Verbot rufen, hält Wan solche Maßnahmen für falsch. „Die Technologie existiert nun mal. Dadurch ist ein reflektierter Umgang wichtig, der auch an Hochschulen eingeübt werden muss“, sagt er.

Dass es sich dabei um einen langwierigen Prozess handelt, zeigt sich anhand vieler Beispiele. Von einem reflektierten Umgang scheint man nämlich noch weit entfernt zu sein. Im Netz, etwa auf Reddit, berichtet ein Professor über die miserablen Prüfungsleistungen seiner Studierenden. Von zehn korrigierten Bachelorarbeiten seien vier durchgefallen. Alle Student:innen hätten entweder Quellen erfunden oder unpassende Quellen verwendet. Die Vermutung: Die KI hat bei der Literatur halluziniert und Inhalte erfunden. Es ist nicht die einzige Geschichte dieser Art. Das Magazin Rolling Stone berichtete etwa über einen texanischen Professor, der einen Großteil seines Kurses wegen der Verwendung von ChatGPT durchfallen lassen wollte.

In Deutschland gab es bislang nur in einem Fall ein rechtskräftiges Urteil. Die TU München lehnte einen Bewerber ab, der im Motivationsschreiben mutmaßlich KI eingesetzt haben soll. Das Verwaltungsgericht gab der Uni recht und der Bewerber wurde nicht zugelassen. Das Gericht traute den Professor:innen zu, KI-Arbeiten zu erkennen.

„Wenn Studierende die KI nicht kompetent beherrschen, dann kommt ein Bullshit-Bingo heraus“, sagt auch Bernhard Ertl, der an der Universität der Bundeswehr in München zum Lernen und Lehren mit Medien forscht. „Da weiß ich sofort: Diese Textstellen hat noch niemand zuvor gelesen, weil Teile davon einfach hanebüchen sind.“

Die KI als Werkzeug

Bei Maximilians Hausarbeiten wird wohl kein Bullshit-Bingo herauskommen. Der 24-Jährige studiert Data Science im Master an der TU Wien. Statt ChatGPT als Ghostwriter zu verwenden, nimmt er das Tool lieber als Startpunkt für seine Recherche. „Wenn ich am Anfang von einer Hausarbeit einen gewissen Überblick über den Themenbereich bekommen muss, dann eignet sich ChatGPT schon sehr gut“, erklärt er. „Ich kann quasi am Anfang, basierend auf der Forschungsfrage, direkt eine Idee bekommen, wie der aktuelle Stand der Wissenschaft da aussieht.“

Alex geht anders an die Aufgabe. Er recherchiere erst Literatur. „Dann lasse ich ChatGPT den Text so schreiben, dass meine Literatur dafür passt“, sagt er. Entdeckt er bei seiner Recherche Wörter, die er nicht versteht, lasse er sich diese von der KI erklären. Maximilian macht es ähnlich. „So kann ich komplexere Themen runterbrechen, falls ich mal wirklich nichts verstehe“, sagt der Wiener Student. „Oft kann ChatGPT das in eine verständlichere Sprache übersetzen.“

Bernhard Ertl hält den Ansatz für sinnvoll, ChatGPT als ergänzende Hilfe zu verwenden. „Die KI kann ein Werkzeug sein, mit dem die Studierenden zu besseren Ergebnissen kommen, wenn sie sich entsprechend in dieses Werkzeug reinarbeiten“, sagt er. Doch das ist nicht immer der Fall. „Dann wird es schlechter, weil sie einfach nur Prompts machen und was generiert wird, in die Arbeit einfügen, und das nicht verstehen“, ergänzt er.

KI oder keine KI

Alex glaubt, dass es für die Dozierenden kaum erkennbar sei, ob er oder die KI die Hausarbeit geschrieben hat. „Ich muss auch sagen, ich hatte immer Angst, wenn meine Arbeiten durch Plagiatsprüfer überprüft werden. Aber auch da muss ich sagen: Es hat bis jetzt jedes Mal funktioniert“, erzählt er.

Plagiatsprüfer überprüfen, ob die Autor:innen ihren Text abgeschrieben haben. Dabei vergleichen sie die Arbeit mit einer Datenbank aus wissenschaftlichen Texten. Am Ende kommt dabei eine Prozentzahl raus, die bestimmt, wie viel der eingereichte Text denen aus der Datenbank ähnelt. Oft braucht es allerdings eine genaue Überprüfung, um herauszufinden, ob es sich um Ähnlichkeiten oder um wirkliche Plagiate handelt.

Wer beim Abschreiben erwischt wird, fällt durch. Das gilt auch, wenn die KI zufällig dieselben Wörter verwendet. Mittlerweile gibt es auch KI-Detektoren. Die sollen erkennen, ob Studierende bei ihrer Arbeit Texte mit einem KI-Chatbot geschrieben haben. Eine Studie der British University Vietnam und der James Cook University in Singapur zeigt: Oft sind diese Tools sehr ungenau. Einrichtungen wie die Uni Hannover verwenden deswegen Tools dieser Art nicht. In einer Stellungnahme der Universität zur Verwendung von KI-Detektoren heißt es, dass „die Ressourcen der Hochschulen besser in die Anpassung der Prüfungskultur und -formate gesteckt werden sollten“.

Wer das als Freifahrtschein für die KI-Nutzung sieht, sollte trotzdem auf die KI-Richtlinien der jeweiligen Universität achten. So muss man etwa an der Universität zu Köln kenntlich machen, ob und wie KI bei einer Hausarbeit verwendet wurde. Das bereits erwähnte Gerichtsurteil aus München greift die Universität auch auf. „Bei Täuschungshandlungen kann dabei der sogenannte Anscheinsbeweis geführt werden“, heißt es auf der Webseite. Sollten Prüfer:innen mögliche Anzeichen wie erfundene Quellen für eine unrechtmäßige KI-Nutzung feststellen, zählt das in Köln als Täuschung.

Wissensabfragen für Fortgeschrittene

Eine Studie aus dem „International Journal of Educational Technology in Higher Education“ zeigt auch andere Beweggründe auf, ChatGPT in der Uni zu nutzen. Dabei decken die Forscher:innen auf, dass Studierende, die unter großem Druck stehen und einen hohen Workload haben, eher auf ChatGPT zurückgreifen. Besonders vorsichtige Studierende schrecken eher vor der Verwendung zurück – aus Angst vor Konsequenzen.

Wenn Studierende wie Alex Hausarbeiten mit ChatGPT schreiben, ist das für Wan ein Warnsignal. „Ist die Art und Weise, wie wir prüfen, sinnvoll? Fördern wir damit Kompetenzen?“, fragt er. Die Studie zeigt nämlich auch: Wer ChatGPT während des Studiums exzessiv nutzt, erzielt schlechtere Ergebnisse. Trotzdem oder vielleicht sogar deswegen sieht Wan in der KI eine Chance, eine moderne Prüfungskultur zu schaffen, die nicht stumpf Wissen abfragt und stattdessen die Anwendung in den Fokus stellt.

Einen offenen Umgang mit dem Thema gibt es laut Alex an seiner Hochschule nicht. „Ich habe da jetzt noch nicht wirklich viel mitbekommen“, erzählt er. Auf der Webseite der Universität finden sich hingegen viele Infos. Sogar einen kostenlosen Zugang zu ChatGPT 4o samt Handlungsempfehlungen für Studierende gibt es. Lehrende sind etwa angewiesen, Prüfungsaufgaben so zu stellen, dass eine KI nicht ausreicht, um sie zu beantworten.

KI verändert das Lernen

Wan und Ertl sind sich einig: Es braucht die passenden Strukturen für KI. Dafür hat die Hochschulrektorenkonferenz auf über 40 Seiten sieben Handlungsempfehlungen verfasst. Darunter fällt zum Beispiel, dass es ein größeres Verständnis über das Thema benötigt oder Hochschulen Räume für einen interdisziplinären Austausch fördern sollten. „Vor allem empfehlen wir auch nochmal ganz klassische Kompetenzen wie Quellen- und Ideologiekritik einzuüben“, so Wan.

Studierende sollten sich bewusst sein, dass KI-Tools halluzinieren und nicht belegbare Dinge als Fakten darstellen können. „Und das geht bis zu einer Ideologiekritik der Anbieter“, führt Wan fort. Beim Verwenden von Deepseek sollte man im Hinterkopf haben, dass das Tool eher Antworten liefert, die der ideologischen Linie der chinesischen Regierung entsprechen.

Bernhard Ertl arbeitet gerade an einem Projekt, bei dem interkulturelle Trainings mit einem KI-Avatar erleichtert werden sollen. „Das funktioniert ganz gut, wenn es etwa ein Englisch-Training ist, damit die Leute Übung bekommen, in der Sprache zu reden“, erklärt der Professor. Avatare dieser Art sollen aber auch als Lernpartner funktionieren, „der die Leute beim Lernen unterstützt, Fragen beantwortet oder Sachen zusammenfasst.“

Für Studierende wäre das wohl ein Segen. Zumindest erzählen sowohl Alex als auch Maximilian, dass Künstliche Intelligenz ihren Uni-Alltag enorm erleichtert – entweder als Recherche-Hilfe, als Erklär-Tool, aber auch als Ghostwriter. Wer KI falsch in der Uni einsetzt, lernt nicht nur weniger, sondern läuft auch Gefahr, eine schlechte Prüfungsleistung abzugeben. Das Studium wird durch die Sprachmodelle also nicht komplett abgeschafft.

Hochschulen stehen nun vor der Aufgabe, KI so in die Studiengänge zu integrieren, dass Studierende bewusst damit umgehen können. Dafür müssen sie auch überarbeiten, wie sie gelerntes Wissen prüfen, damit nicht mal eben ganze Hausarbeiten gepromptet werden können. Ertl geht davon aus, dass KI den Status von Computern oder Internet-Tools einnehmen wird, die Studierende durch ihren Alltag begleiten. „Das ist ähnlich wie mit einem Hammer“, sagt er. „Ich muss den Hammer so bedienen, dass ich mir nicht auf die Finger haue und dann der Nagel so in der Wand ist, damit das Bild hängen bleibt.“

Dieser Beitrag ist zuerst auf t3n.de erschienen.

(jle)

Künstliche Intelligenz

Apple stellt ganzen App Store ins Web – leakt aus Versehen Code

Schon seit Jahren ist es möglich, via Web Informationen zu Inhalten aus Apples verschiedenen App-Store-Varianten abzurufen. Doch dazu war stets die passende URL notwendig. Nun hat der Konzern seinen Softwareladen für iPhone, iPad, Mac, Vision (Pro), Apple Watch und Apple TV erstmals vollständig in den Browser verfrachtet – inklusive Suchfunktion, redaktionellen Inhalten und mehr. Beim Aufbau kam es allerdings zu einem Leak: Der Front-End-Quellcode entfleuchte und landete zwischenzeitlich auf GitHub. Mittlerweile hat ihn Apple via DMCA-Takedown-Request (anwaltliche Urheberrechtsmeldung) entfernen lassen.

Weiterlesen nach der Anzeige

Fast der ganze App Store im Browser

Mit Apples neuem Web-Interface lässt sich nun fast alles im App Store tun, was man aus der jeweiligen App auf iPhone, iPad, Mac & Co. kennt – mit Ausnahme der tatsächlichen Einkäufe samt Login und Account-Übersicht. Es ist also ein permanenter Gastmodus. Ob Apple daran etwas ändert, bleibt unklar – denkbar wäre beispielsweise, im Web eine App „vorzukaufen“, um sie dann auf dem eigentlichen Gerät herunterzuladen. So gibt es etwa seit Langem eine Web-Version von Apple Music, die zumindest ein Streaming der eigenen Bibliothek sowie weiterer Titel nach dem Einloggen ermöglicht.

Für die Vision Pro hatte Apple bereits die Möglichkeit geschaffen, über eine eigene iPhone-App Anwendungen auch aus der Ferne auf das Headset zu holen. Interessant im Bezug auf das Spatial-Computing-Gerät: Apple bezeichnet es im App Store als „Vision“ ohne „Pro“. Gerüchten zufolge soll Apple zumindest zwischenzeitlich an einer einfacheren Variante seines Headsets gearbeitet haben, zu der die Bezeichnung passen würde.

Sourcemaps-Funktion aktiv

Der auf GitHub entfleuchte Code, den der User rxliuli aufgefunden und dann publiziert hatte, war deshalb sichtbar, weil Apple die Sourcemaps-Funktion versehentlich aktiv gelassen hatte. Der Nutzer konnte dadurch dann mittels Chrome-Erweiterung alle auf Apples Servern zugänglichen Quellen extrahieren und herunterladen. Daraus wurde dann ein GitHub-Repository „zu Bildungszwecken“, wie die Person laut einem Bericht von 9to5Mac dort mitteilte, bevor GitHub die Sammlung herunternahm, vermutlich durch Apple selbst angestoßen.

Zu den verfügbaren Komponenten zählten der API-Integrationscode, Teile der UI, die State-Management-Logik sowie der vollständige Quellcode in Svelte beziehungsweise TypeScript. Auch die Routing-Konfiguration war sichtbar. Es ist verwunderlich, dass Apple vergaß, die Sourcemaps-Funktion zu deaktivieren – das ist üblicherweise einer der letzten Schritte vor dem Live-Gang eines neuen Dienstes. Ob sich aus dem Leak Sicherheitsprobleme für den App Store ergeben könnten, bleibt offen.

Weiterlesen nach der Anzeige

(bsc)

Künstliche Intelligenz

Schaeffler setzt humanoide Roboter von Neura Robotics ein und liefert Teile

Der deutsche Automobil- und Industriezulieferer Schaeffler wird künftig verstärkt Roboterteile an das deutsche Robotikunternehmen Neura Robotics liefern. Das teilte Schaeffler am Dienstag mit. Dazu haben die beiden Unternehmen eine Partnerschaft geschlossen, die zusätzlich vorsieht, dass Schaeffler bis 2035 eine „mittlere vierstellige Zahl“ an humanoiden Robotern in die eigene Produktion integriert.

Weiterlesen nach der Anzeige

Ein kompakter Planetenradaktor von Schaeffler.

(Bild: Schaeffler)

Gemeinsam wollen Schaeffler und Neura Robotics Schlüsselkomponenten für humanoide Roboter entwickeln und herstellen. Dazu gehören etwa Roboteraktuatoren, die die Gelenke der Roboter bewegen. Schaeffler verfügt bereits über einige Expertisen im Bereich der Planetenradaktoren, die präzise Drehbewegungen bei einem zugleich hohen Drehmoment ermöglichen. Zudem sind diese Aktuatoren leicht und robust und damit für einen Dauerbetrieb ausgelegt.

Schaeffler hat bereits Roboteraktuatoren verschiedener Leistungsklassen im Programm, die bis zu 250 Nm Drehmoment liefern können. Der aktuelle humanoide Roboter 4NE1 von Neura Robotics ist mit solchen Aktuatoren ausgerüstet, sodass er in der Lage ist, auch hohe Gewichte zu stemmen. In Zukunft will Neura Robotics seinen Bedarf an leichten und leistungsstarken Aktuatoren durch Schaeffler decken.

Neura-Roboter arbeiten bei Schaeffler

Die getroffene Vereinbarung sieht außerdem vor, dass Schaeffler eine größere Anzahl humanoider Roboter von Neura Robotics in der eigenen Produktion einsetzt. Über die genaue Anzahl haben beiden Unternehmen nichts verlautbart. In der Mitteilung von Schaeffler wird etwas kryptisch von einer mittleren vierstelligen Anzahl gesprochen. Auch zu den Kosten halten sich beide Firmen bedeckt. Aus Industriekreisen heißt es, dass der Auftragswert bei Neura Robotics 300 Millionen Euro betragen soll. Belegen lässt sich das jedoch zunächst nicht.

Während des Einsatzes der Roboter in realen Produktionsumgebungen werden Anwendungsdaten gesammelt, die dann wiederum für das KI-Training der humanoiden Roboter genutzt werden sollen. Das Ziel: Durch das kontinuierliche Lernen spezifischer Fertigkeiten sollen sich die Roboter weiterentwickeln.

Weiterlesen nach der Anzeige

(olb)

Künstliche Intelligenz

No-Code-Plattform SeaTable integriert KI-Automatisierung | heise online

Der deutsche Anbieter SeaTable hat Version 6.0 seiner No-Code-Plattform veröffentlicht. Die neue Version integriert erstmals KI-Funktionen direkt in die Automatisierungsregeln der Tabellen- und Workflowsoftware. Nutzer können mit der KI Texte analysieren, Dokumente auswerten oder Informationen extrahieren.

Weiterlesen nach der Anzeige

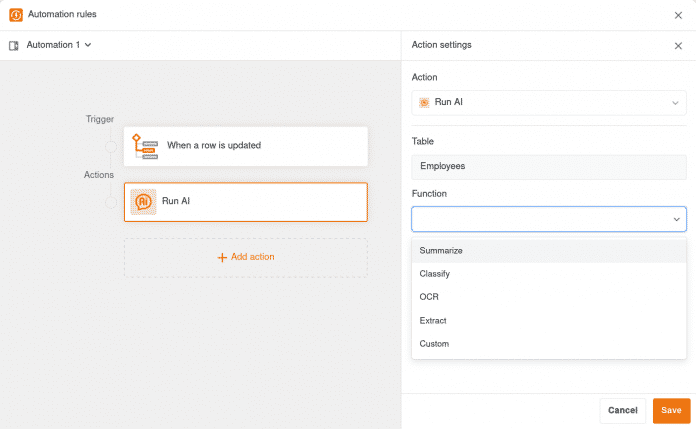

Die KI-Integration umfasst dedizierte Funktionen für Standardaufgaben: Summarize fasst Texte zusammen, OCR erkennt Text in Bildern, Extract zieht spezifische Informationen aus Dokumenten und Classify ordnet Inhalte in Kategorien ein. Für weitere Anwendungsfälle steht eine Custom-Funktion bereit, die ausschließlich auf Basis eigener Prompts arbeitet. Spalteninhalte lassen sich dabei durch Referenzierung in geschweiften Klammern direkt einbinden.

Die neuen KI-Funktionen in SeaTable für die Automatisierung, die Standardaufgaben übernehmen können.

(Bild: SeaTable)

Als KI-Modell setzt SeaTable Cloud auf Gemma 3 mit 12 Milliarden Parametern. Das multimodale Large Language Model von Google läuft auf Servern von Hetzner Online in Deutschland und wird von den SeaTable-Administratoren selbst betrieben. Der Datenaustausch erfolgt verschlüsselt, Informationen werden nicht an externe KI-Anbieter oder ins Ausland übertragen. Enterprise-Kunden erhalten 500 AI-Credits pro Teammitglied, die umfangreiche Tests ermöglichen; für produktive Workloads sind zusätzliche Credits erforderlich.

Allerdings können Nutzer, die SeaTable Server selbst betreiben, genauso eigene LLMs einsetzen oder die neue Komponente SeaTable AI nutzen. Letztere basiert auf LiteLLM und unterstützt viele Modelle und Anbieter, darunter alle LLM-Dienste mit OpenAI-kompatibler API. Die Bereitstellung erfolgt via Docker oder Docker Compose.

Überarbeiteter Editor und neue Ansichten

Neben den KI-Funktionen bringt Version 6.0 einen komplett überarbeiteten Editor für Automatisierungsregeln. Dieser erstreckt sich über die gesamte Bildschirmbreite und bietet eine workflow-orientierte Benutzeroberfläche. Zudem ersetzen die neuen Ansichtstypen Kalender, Kanban und Galerie die bisherigen Plug-ins gleichen Namens und unterstützen nun Features wie View-Sharing, private Ansichten und kollaborative Datenbearbeitung in Echtzeit.

Weiterlesen nach der Anzeige

Alle Informationen zum neuen Release finden sich im SeaTable-Blog. Die SeaTable Cloud wurde bereits auf Version 6.0 aktualisiert. Wer die Software selbst betreibt, kann das stabile Release aus dem Docker Repository herunterladen. Für die kommenden Updates plant SeaTable die Integration weiterer KI-Modelle von OpenAI, Anthropic, Meta, xAI und dem europäischen Anbieter Mistral sowie die Entwicklung eines KI-Assistenten und MCP-Servers.

(fo)

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenAdobe Firefly Boards › PAGE online

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenGalaxy Tab S10 Lite: Günstiger Einstieg in Samsungs Premium-Tablets

-

UX/UI & Webdesignvor 3 Wochen

UX/UI & Webdesignvor 3 WochenIllustrierte Reise nach New York City › PAGE online

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenPosit stellt Positron vor: Neue IDE für Data Science mit Python und R

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenEventSourcingDB 1.1 bietet flexiblere Konsistenzsteuerung und signierte Events

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenFake It Untlil You Make It? Trifft diese Kampagne den Nerv der Zeit? › PAGE online