Apps & Mobile Entwicklung

Anthropic Model Welfare: Claude kann nun schädliche Unterhaltungen beenden

Anthropic hat Teile seines Claude-Angebotes um eine neue, auf den Namen „Model Welfare“ getaufte Funktion erweitert. Sie ermöglicht es dem KI-Modell, Interaktionen mit dem Nutzer zu beenden, wenn der Eindruck entsteht, dass diese Schaden verursachen oder für schädliche Zwecke missbraucht werden könnten.

Aktuell nur für kostenpflichtige Tarife

Die Funktion steht derzeit ausschließlich den Modellen Claude Opus 4 und 4.1 zur Verfügung, die zu den leistungsstärksten, aber auch kostenpflichtigen Varianten zählen. Erfahrungsgemäß dürfte die Neuerung nach einer gewissen Erprobungsphase auch in den frei zugänglichen Tarifen angeboten werden.

Keine neue Idee

Bereits im April dieses Jahres hatte Anthropic erste Ansätze veröffentlicht, wie mit schädlichen Interaktionen in KI-Modellen umgegangen werden soll. Diese Überlegungen hat das Unternehmen nun in die Praxis überführt und eine Funktion in seine Chatbots integriert, die genau vor solchen Situationen schützen soll. Nach eigenen Angaben ist Anthropic jedoch weiterhin unsicher, welchen moralischen Status Claude und andere LLMs möglicherweise haben könnten.

Mit „Model Welfare“ soll dieser Umstand entschärft werden, indem Claude die Möglichkeit erhält, „potenziell belastende Interaktionen“ selbstständig zu beenden. Dazu sollen nach Angaben des Unternehmens etwa Anfragen zu sexuellen Inhalten, die Minderjährige betreffen, sowie Versuche, an Informationen zu gelangen, die groß angelegte Gewalt oder Terrorakte ermöglichen würden, gehören.

Nur wenn es nicht anders geht

Anthropic versteht dieses Vorgehen allerdings lediglich als letzten Schritt einer fehllaufenden Unterhaltung, wenn mehrere Umleitungsversuche gescheitert sind und eine produktive Interaktion nicht mehr erwartet werden kann.

Bei Untersuchungen stellte sich heraus, dass Anwender mit schädlichen Anfragen oder missbräuchlicher Nutzung selbst dann fortfuhren, wenn Claude sich mehrfach weigerte, darauf einzugehen und versuchte, das Gespräch in eine produktive Richtung zu lenken.

Hier soll die neue Funktion greifen, indem Claude befähigt wird, Gespräche eigenständig zu beenden. Das Modell ist jedoch angewiesen, diese Möglichkeit nur in Fällen einzusetzen, in denen Anwender einer unmittelbaren Gefahr ausgesetzt sind, sich selbst oder anderen Schaden zuzufügen. Gleichzeitig betont Anthropic, dass die überwiegende Mehrheit der Nutzer bei der normalen Verwendung von Claude diese Funktion weder bemerken noch davon betroffen sein dürften, auch dann nicht, wenn über sehr kontroverse Themen diskutiert wird.

Wenn Claude eine Unterhaltung beendet, kann der Nutzer keine neuen Nachrichten mehr zu dieser hinzufügen, hat aber die Möglichkeit, frühere Eingaben zu bearbeiten, um das Gespräch in eine konstruktivere Richtung zu lenken. Andere parallele Konversationen sollen davon nicht betroffen sein und unverändert fortgeführt werden können.

Stete Entwicklung

Anthropic bezeichnet die neue Funktion als „ein laufendes Experiment“, sodass weitere und grundlegende Änderungen nicht ausgeschlossen sind. Nutzer werden zudem dazu aufgefordert, Rückmeldungen zu geben, wenn das KI-Modell in dieser Weise reagiert, um das Vorgehen weiter verfeinern zu können.

Apps & Mobile Entwicklung

Intel Diamond Rapids: Die 8-Kanal-RAM-Lösung ist tot, 16 RAM-Channel sind gesetzt

Intels aktuelle Xeon 6 sitzen auf zwei Plattformen: SP und AP. Bei Xeon 7 alias Diamond Rapids wird die kleinere der beiden gestrichen, was bedeutet, dass es nur die große Lösung mit den doppelten 16 Speicherkanälen geben wird. Trotzdem will Intel damit jeden Kunden ansprechen können.

Zwei Plattformen waren die Regel

Aktuelle Xeon-6-Prozessoren gibt es in den Ausführungen Granite-Rapids-SP sowie Granite Rapids-AP und den E-Core-Lösungen Sierra Forest-SP sowie Sierra Forest-AP. Die Kürzel SP und AP bestimmen den Sockel auf der Birch-Stream-Plattform und dazu gehörig unter anderem den Speichersupport: LGA 4710 und maximal acht Speicherkanäle stehen dem LGA 7529 mit zwölf Speicherkanälen gegenüber.

Beim Nachfolger Intel Diamond Rapids wollte Intel das Konzept auf der neuen Oak-Stream-Plattform fortführen. Da aber bis zu 16 Speicherkanäle zur Verfügung stehen, wächst auch der Sockel noch einmal mit: LGA 9324. Darunter sollte deshalb wie zuletzt eine kleinere Lösung angeboten werden, die auf den Massenmarkt abzielt. Dort waren erneut acht Speicherkanäle vorgesehen und damit auch vermutlich auch weniger Kerne als die bisher für die Spitze genannten 192. Erstere soll nach einem Bericht von STH, den Intel offiziell bestätigte, jedoch nicht mehr erscheinen.

We have removed Diamond Rapids 8CH from our roadmap. We’re simplifying the Diamond Rapids platform with a focus on 16 Channel processors and extending its benefits down the stack to support a range of unique customers and their use cases.

Intel

Intels neuer Chef hatte im Frühjahr bereits Änderungen bei den Xeon angekündigt. SMT alias Hyper-Threading wieder großflächig einzusetzen, ist eines der Themen, das sofort publik wurde – ohne dies sei man nicht konkurrenzfähig genug. Dazu passt nun auch, dass kleinere Xeons gehen müssen, wenngleich eine Abkündigung so nah am Marktstart im nächsten Jahr sehr spät ist. Zuvor sind bereits Jahre an Entwicklung in die Lösungen und Infrastruktur geflossen. Der Fokus auf nur noch eine statt zwei Plattformen bringt aber auch Vorteile, von geringeren Kosten einmal abgesehen.

Das Portfolio und der Preis entscheiden

Am Ende hängt alles am Portfolio und der Preisgestaltung. Zwar werben Firmen wie Intel gern mit den größten und schnellsten Lösungen, gekauft wird aber eher zwei oder drei Klassen darunter. Bisher waren das Xeon Gold und vor allem Xeon Silver, aktuell sind es Xeon 6700 und Xeon 6500. Diese sind dadurch auch wieder die populärsten Serien und nutzen sogar den geringeren RAM-Bedarf als Unterscheidungsmerkmal zu AMD, wenn kein maximaler Ausbau bei den Kernen nötig ist. In Zeiten explodierender RAM-Preise und -Knappheit ist das kein unwichtiger Punkt.

Auch könnten große Lösungen den Trend von 2-Sockel-Systemen zu 1-Sockel-Lösungen weiter verstärken. Diesen sah zuletzt auch AMD stetig, die P-Prozessoren der Epyc-Serie, die explizit nur für 1-Sockel-Systeme gedacht sind, gibt es aktuell mit 96, 64, 48 sowie 32 Kernen und deckt damit bis auf das Spitzenmodell jeden Bereich ab. In der Regel lassen sich bei AMD und Intel aber die meisten Epycs respektive Xeons auch im Einzelbetrieb nutzen, die CPU ist aber dementsprechend teurer.

Apps & Mobile Entwicklung

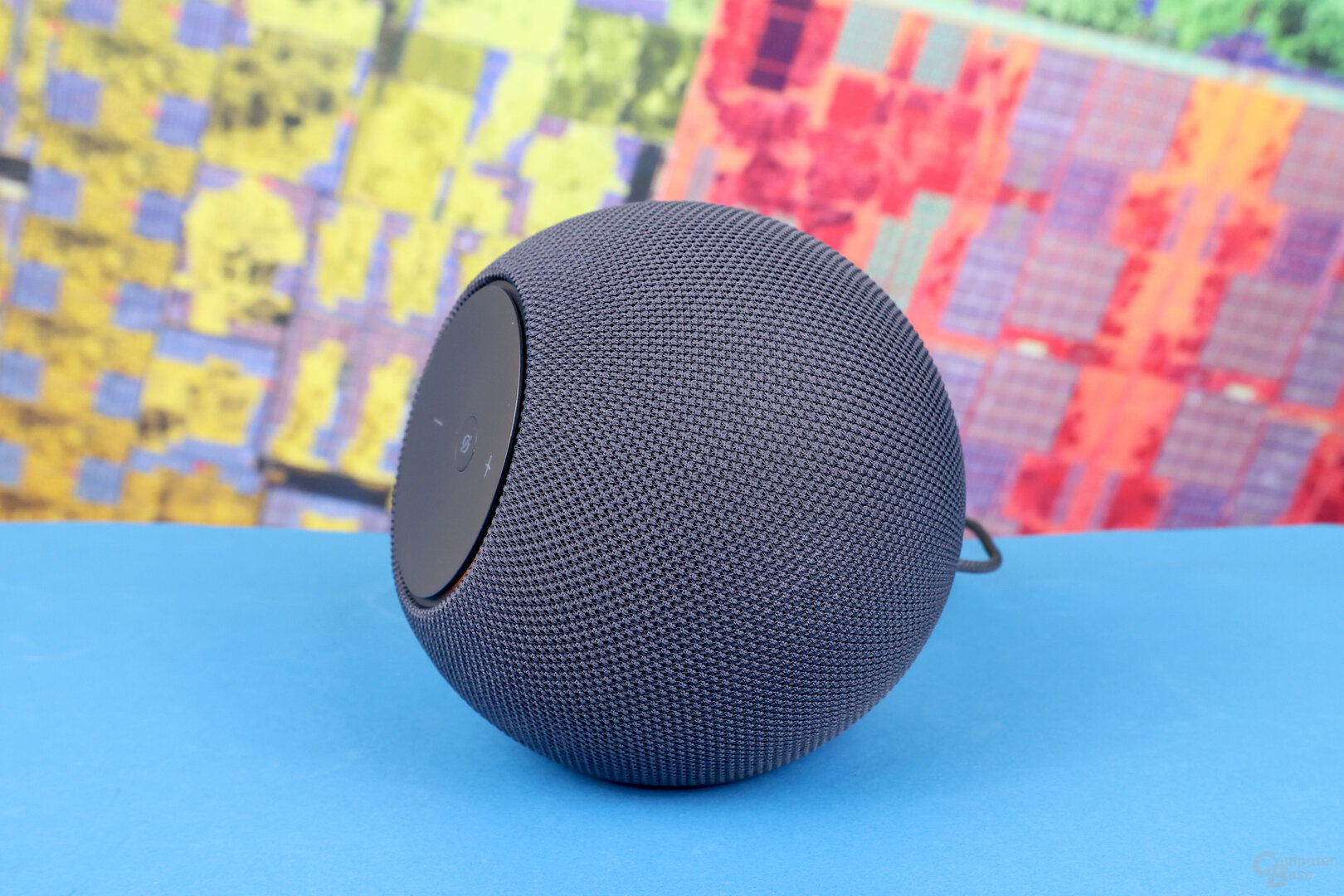

Amazon Echo Dot Max und Echo Studio 2025 im Test

Der neue Echo Dot Max rückt an die Stelle des Echo und hebt sich im Test nicht nur klanglich vom Echo Dot ab, sondern bietet auch deutlich mehr Smart-Home-Features und ist Alexa+ ready. Der Echo Studio bekommt ein großes Redesign und wird als Todesstern deutlich kleiner, was dem Klang aber nicht schadet.

Amazon hat das Line-up der Echo-Lautsprecher diesen Herbst neu aufgelegt. Den Anfang haben der neue Echo Dot Max und der vollständig überarbeitete Echo Studio (2025) gemacht. Beide Lautsprecher müssen im Test gegen den Echo Dot (5. Gen.) und den bisherigen Echo Studio aus dem Jahr 2019 bestehen. Neue Funktionen bieten die neuen smarten Lautsprecher abseits von Alexa Heimkino, bei dem sich ein 5.1 System mit Echos erstellen lässt, kaum, was vor allem auch an dem weiterhin ausstehenden Start von Alexa+ in Deutschland liegt, der neuen generativen AI-Alexa.

Die unverbindliche Preisempfehlung des Echo Dot Max beträgt 109,99 Euro*. Für den Echo Studio ruft Amazon hingegen eine UVP von 239,99 Euro auf*. Der Echo Dot Max und Echo Studio sind seit dem 29. Oktober erhältlich.

Vorbereitet auf die AI-Revolution

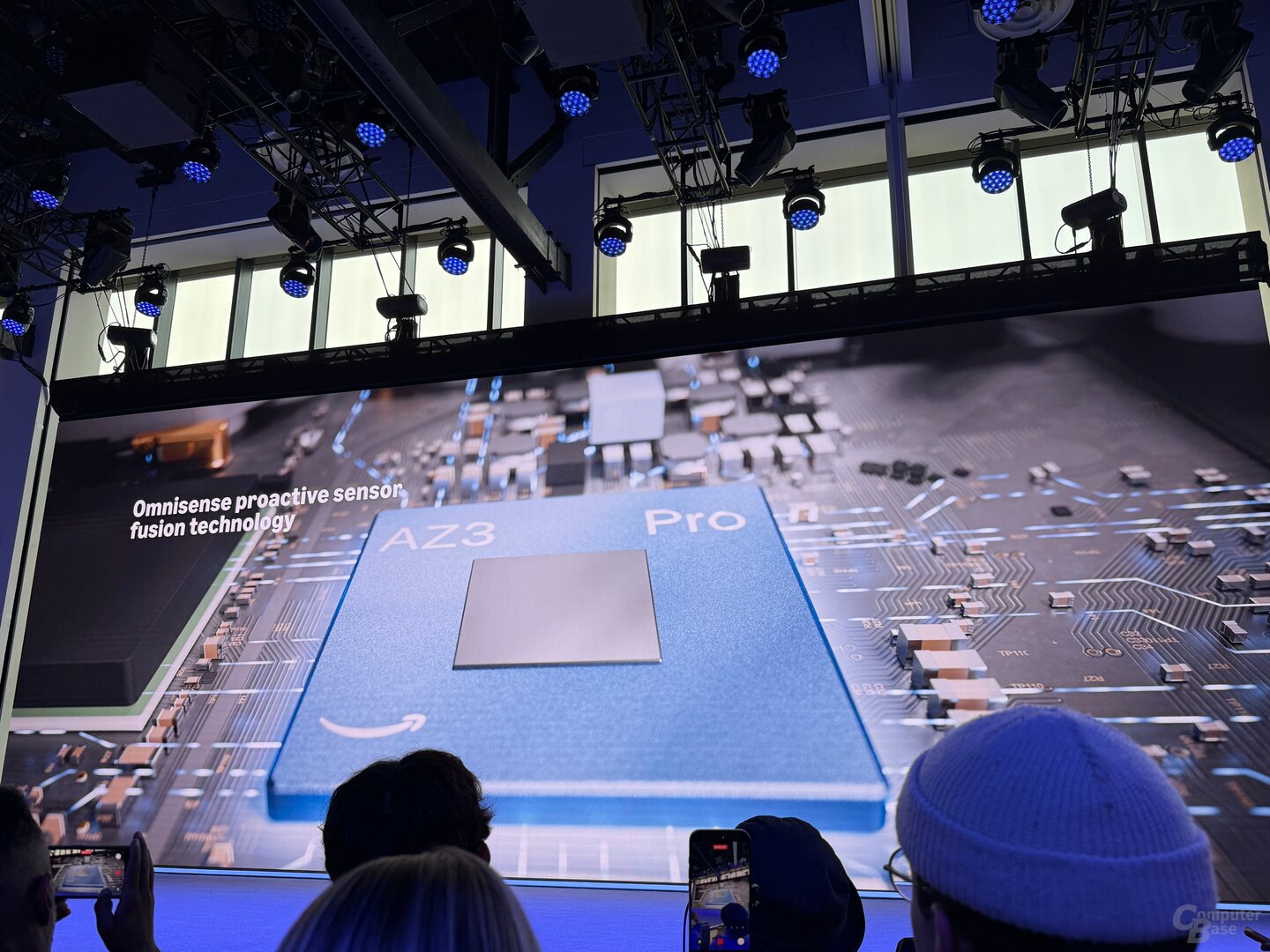

Während in den USA bereits die um generative AI ergänzte Alexa+ genutzt werden kann, heißt es für die neuen Echo-Lautsprecher in Deutschland derzeit noch „Alexa+ ready“. Die neuen Echo Dot Max und Echo Studio, die Amazon zusammen mit dem neuen Echo Show 8 und Echo Show 11 als die bisher fortschrittlichsten Echo-Geräte bezeichnet, erfüllen so zwar bereits die technischen Voraussetzungen für neue auf generativer KI basierende Erlebnisse über Alexa+, in Deutschland bedeutet dies derzeit aber eben noch „sobald der Dienst verfügbar ist“. Denn auch wenn Echo Dot Max und Echo Studio 2025 über mehr Rechenleistung aus eigens von Amazon entwickelten Chips verfügen und die Omnisense-Technologie zur Sensordatenfusion intelligente, personalisierte und proaktive AI-Erlebnisse über Alexa+ ermöglicht, können die smarten Lautsprecher aus Alexa+ in Deutschland derzeit noch kein Kapital schlagen.

AZ3 und AZ3 Pro Chips für Alexa+

Beide neuen Echo-Geräte werden von zwei speziell entwickelten Chips, dem AZ3 und AZ3 Pro, angetrieben und verfügen zudem über einen neuen KI-Beschleuniger, mit dem KI-Modelle in Zukunft direkt auf den Geräten laufen können.

Der Echo Dot Max nutzt den AZ3, der laut Amazon eine verbesserte Gesprächserkennung ermöglicht, was für eine KI, mit der Nutzer von überall im Raum aus kommunizieren können sollen, enorm wichtig ist. Der AZ3 soll im Zusammenspiel mit den verbesserten Mikrofonen für natürlichere, flüssigere Interaktionen mit Alexa sorgen. Der Chip filtert Hintergrundgeräusche und erhöht die Zuverlässigkeit, das Aktivierungswort zu erkennen, um fast 50 Prozent, so das Unternehmen. Im Test und im direkten Vergleich mit einem Echo Dot der 5. Generation erkennt der Echo Dot Max das Aktivierungswort Alexa tatsächlich dann etwas besser, wenn man weiter weg vom Echo-Lautsprecher steht und gleichzeitig weitere Geräuschquellen im Raum aktiv sind. Allerdings wird sich der ganze Nutzen der neuen Technik erst noch beweisen müssen, wenn man mit Alexa+ tatsächlich lockerere Gespräche führt und nicht nur relativ starre Befehle an Alexa gibt, wie es derzeit noch der Fall ist.

Der Echo Studio nutzt hingegen den AZ3 Pro, der auf den Audioverbesserungen des AZ3 aufbaut und für die Unterstützung moderner KI-Architekturen, einschließlich Sprachmodellen und Vision-Transformern, entwickelt wurde. Es ist davon auszugehen, dass der AZ3 Pro im Vergleich zum AZ3 leistungsfähiger ist, im Test ließ sich jedoch (noch) kein Unterschied bei der alltäglichen Nutzung feststellen.

Omnisense: Sensordatenfusion für Ambient-KI

Mit den neuen Geräten wird auch Omnisense eingeführt, eine Technologie zur Sensordatenfusion für Ambient-KI. Omnisense nutzt eine Reihe von Sensoren und Signalen wie beispielsweise Audio, Ultraschall, WLAN-Radar, den Beschleunigungssensor und WLAN-Kanalzustandsinformationen, um personalisierte, proaktive Alexa-Erlebnisse zu ermöglichen. Bei den neuen Echo-Show-Geräten wird zusätzlich auch die Kamera genutzt.

Dank Omnisense kann Alexa auf verschiedene Ereignisse in und um das Zuhause reagieren. Bei Echo Dot Max und Echo Studio umfasst dies die Nutzung neuer Sensoren für erweiterte Routinen. So lassen sich mit Omnisense anwesenheitsbasierte Routinen erstellen, die Ultraschall und WLAN nutzen, um eine Anwesenheitserkennung umzusetzen. Aber auch temperaturbasierte Routinen, die den integrierten Temperatursensor nutzen, sind möglich. So lassen sich andere Geräte in Abhängigkeit der von den Echo-Lautsprechern gemessenen Temperatur auslösen.

Deutschland-Start von Alexa+ steht aus

Einen Termin für Deutschland für die mit generativer KI ausgestattete Variante von Alexa, Alexa Plus, gibt es weiterhin nicht. Zudem ist zu erwarten, dass Amazon zunächst auch hierzulande wie in den USA einen Betatest durchführen wird, bevor alle Nutzer gleichzeitig auf Alexa+ zugreifen können. Alexa+ ist dabei nicht auf die beiden neuen Lautsprecher begrenzt, sondern lässt sich auch mit älteren Modellen problemlos nutzen. Auf welchen alten Echo-Geräten Alexa+ laufen wird, hatte Amazon schon früh verraten.

Im Vergleich zu aktuellen AI-Modellen mit generativer KI wirkt das in Deutschland weiterhin aktive Alexa deshalb etwas altbacken. Mit ChatGPT und Co kann Alexa hierzulande nicht mehr mithalten, weshalb die neuen Lautsprecher auch etwas davon überschattet werden, dass Alexa+ eben noch nicht verfügbar ist. Ohne Alexa+ können sie ihre volle Stärke gar nicht ausspielen, denn in vielerlei Hinsicht sind die Lautsprecher eben nur eine Schnittstelle, die von der Software lebt.

Mit Vega OS und Linux statt Android

Das Thema Software ist ein gutes Stichwort, denn der Echo Dot Max und Echo Studio 2025 nutzen bereits das neue Vega OS, Amazons selbst entwickeltes, neues Betriebssystem für Smart Devices. Statt auf Android basiert Vega OS auf Linux und nutzt React Native als Entwicklungsframework. Vega OS kommt auch bei Amazons neuen Fire-TV-Geräten zum Einsatz, wodurch sich Apps nicht nur mit JavaScript erstellen, sondern auch einfacher auf und von anderen TV-Betriebssystemen übertragen lassen. Im Alltag merkt der Nutzer von dem neuen Betriebssystem für Echo Dot Max und Echo Studio jedoch nichts. Diese lassen sich genauso nutzen und bedienen wie andere Echo-Lautsprecher auch. Zudem hat Amazon Vega OS in den letzten Monaten bereits im Feld erprobt, ohne dass normale Nutzer davon überhaupt etwas gemerkt haben. Denn auch die aktuellen Firmwares von Echo Show 5 (Test), Echo Hub (Test) und Echo Spot (Test) sind bereits auf das neue Betriebssystem umgestellt worden.

Neues Design für Echo Dot Max und Echo Studio

Mit dem Echo Dot Max und dem Echo Studio 2025 hat Amazon auch das Design der smarten Lautsprecher erneut geändert. Während beim Echo und Echo Dot bereits ein rundes Kugeldesign genutzt wurde, kamen der Echo Spot (Test) und Echo Pop (Test) zuletzt als angeschnittene Halbkugeln in den Handel.

Der Echo Dot Max ist wieder mehr Kugel, den Alexa-Ring und die Knöpfe hat Amazon im Vergleich zum Echo Dot (5. Gen.) (Test) aber völlig neu entworfen. Der Alexa-Ring, der bei Anfragen blau, bei Benachrichtigungen orange und bei deaktiviertem Mikrofon rot leuchtet, strahlt nun nicht mehr unten auf die Oberfläche, auf der der Echo steht, sondern wandert wieder nach oben, um die Bedientasten. Das Bedienfeld selbst besteht nun zudem nicht mehr aus einzelnen Tasten für die Lautstärke, sondern wippt als Ganzes nach rechts und links, wenn man die jeweilige Seite für lauter oder leiser drückt. Zentral in der Mitte sitzt die Taste zum Stummschalten der Mikrofone, sodass Alexa nicht mehr auf das Aktivierungswort lauscht und nicht mehr aktiviert werden kann.

Was den beiden neuen Echos fehlt, ist die Aktivierungstaste zum manuellen Aufwecken von Alexa ohne Aktivierungswort. Beide bieten diese nicht mehr, was den Fokus auf die Sprachsteuerung, die im zweiten Schritt ohnehin immer essenziell war, verdeutlicht. Da man diese im Alltag ohnehin nicht genutzt hat, fällt ihr Wegfall nicht ins Gewicht.

Neu ist auch der 3D-Stoff, der die beiden Echo-Lautsprecher umhüllt. Die 3D-Struktur ist deutlich grober als der feine Stoff etwa beim Echo Dot, der den Lautsprecher zudem nicht gänzlich umschloss. Der neue dreidimensional gewebte Stoff soll eine bestmögliche akustische Transparenz gewährleisten. Beim Echo Studio (2025) ist auch das Kabel mit Stoff ummantelt, beim Echo Dot Max hingegen nicht.

ComputerBase hat den Echo Dot Max in der Farbe Amethyst (Violett) getestet. Positiv fällt auf, dass der Stoff und der Kunststoff am Bedienfeld ebenso wie das Netzkabel und selbst das Netzteil farblich hervorragend zusammenpassen. Das war bei bisherigen Echo-Lautsprechern von Amazon nicht immer in diesem Ausmaß der Fall.

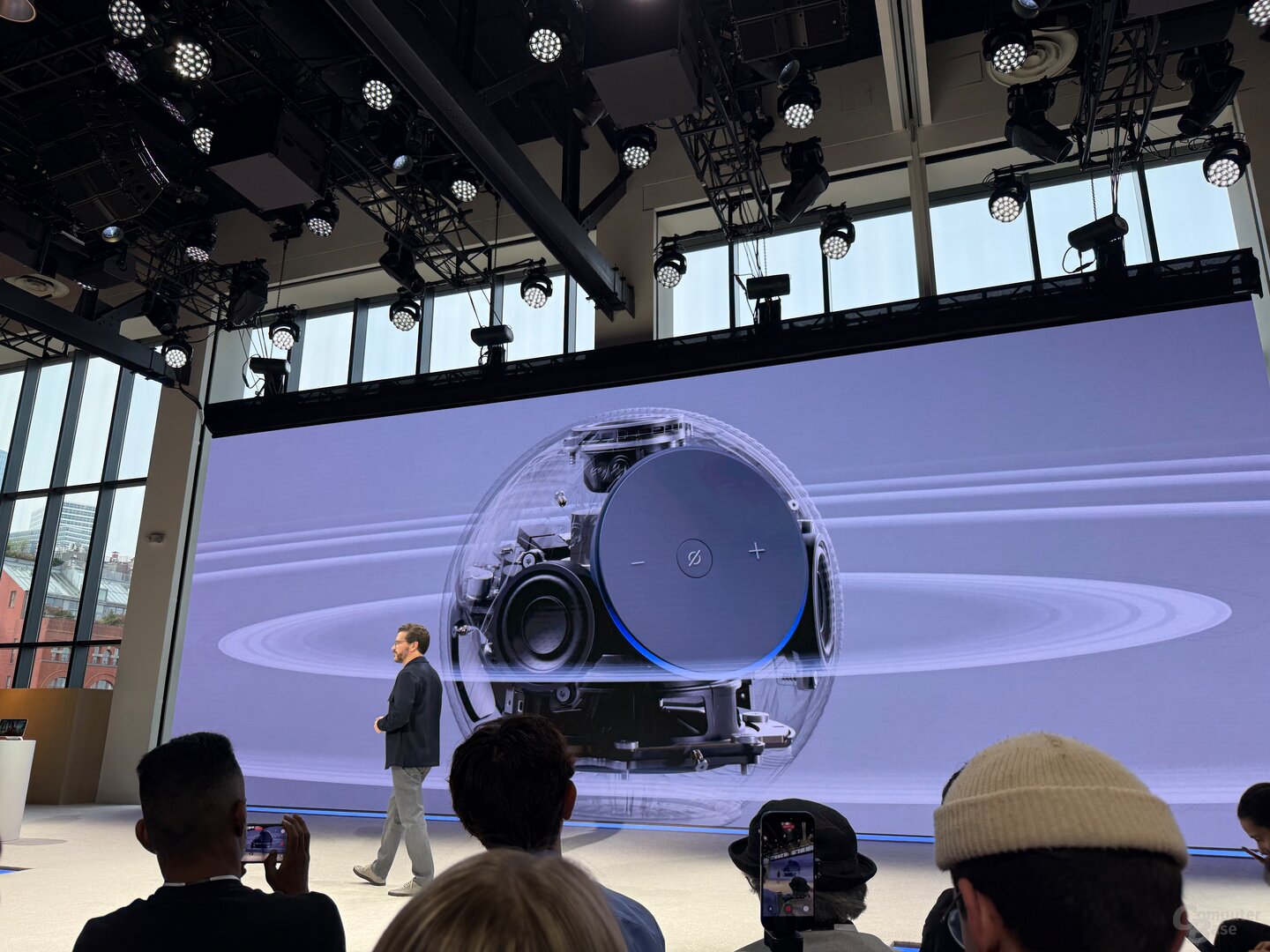

Der Echo Studio ist äußerlich grundsätzlich genauso aufgebaut wie der Echo Dot Max, nur deutlich größer. Bei ihm fällt die Designänderung im Vergleich zum bisherigen Echo Studio von 2019 (Test) dennoch am größten aus. Aus der Tonne mit Kerbe für den Downfiring-Subwoofer wird eine Kugel. Insgesamt ist der Echo Studio so rund 40 Prozent kleiner geworden. Positiv ist in jedem Fall, dass der Alexa-Ring und die Tasten nun nach vorne zeigen und nicht mehr an der Oberseite sitzen, an der sie je nach Standort potenziell schlechter zu sehen sind.

Abmessungen und Gewicht im Vergleich

Dot Max legt leicht zu

Der Echo Dot Max kommt auf 108,7 × 108,6 × 99,2 mm (B×H×T) und wiegt rund 505 Gramm. Ein Echo Dot (5. Gen) misst zum Vergleich 100 × 100 × 89 mm und wiegt 340 Gramm. Das deutlich höhere Gewicht zeigt, dass sich am Innenleben des Echo-Dot-Max-Lautsprechers im Vergleich zum Echo Dot einiges getan haben muss. Schließlich ersetzt das Max-Modell nicht den bisherigen Echo Dot.

Echo Studio wird kleiner und viel leichter

Der neue Echo Studio (2025) ist 155 × 142,2 × 147,3 mm groß und wiegt 1,63 kg. Der alte Echo Studio misst hingegen 206 × 175 mm (Höhe × Durchmesser) und wiegt 3,5 kg. Setzt man das Volumen in Relation und lässt dabei die Kugelform beim neuen und die Aussparungen bemi alten außer Acht, reduziert sich das Volumen um rund 40 Prozent.

Der neue Echo Studio verliert auch den optischen Eingang beziehungsweise die 3,5-mm-Klinkenbuchse des Vorgängers. Das neue Modell besitzt abseits des Stromanschlusses keine Anschlüsse mehr. Vernetzt, nicht verkabelt, lautet auch hier die Devise. Dafür verfügt der neue Echo Studio an der Unterseite über ein ¼-Zoll-Gewinde für Lautsprecherhalterungen.

Der Akustikaufbau der neuen Lautsprecher

Angesichts der neuen Maße und Gewichte stellt sich die Frage nach den Veränderungen im Inneren der Lautsprecher.

Angefangen beim Echo Dot Max setzt dieser auf eine vollständig andere Treiber-Architektur als der Echo Dot. Anstelle des einzelnen Breitbandtreibers mit 44 mm im Echo Dot (5. Gen.), der nach vorne abstrahlt, kommt beim Echo Dot Max – zum ersten Mal bei einem Echo Dot – ein Zwei-Wege-Lautsprechersystem zum Einsatz. Amazon kombiniert einen 20-mm-Hochtöner mit einem 64-mm-Tieftöner. Es ist somit nicht mehr ein Lautsprecher für alle Frequenzen zuständig. Der Hochtöner ist nach vorne unten ausgerichtet und strahlt unter dem Bedienfeld ab, der Tieftöner ist diesem entgegen gerichtet nach hinten schräg oben verbaut. Die Hauptplatine sitzt direkt hinter den Tasten des Echo Dot Max.

Das neue Design des Echo Dot Max eliminiert auch das bisher beim Echo Dot genutzte, separate Lautsprechermodul und integriert den Lautsprecher direkt in das Gerätegehäuse. Neben dem neuen Treiberaufbau soll allein dieser neue innere Aufbau den Bass verbessern.

Beim Echo Studio gibt es ebenfalls Änderungen bei der Art und Anzahl der verbauten Treiber. Beim Echo Studio von 2019 kommen insgesamt fünf Treiber zum Einsatz: Ein 133-mm-Subwoofer, der nach unten gerichtet ist, mit Bassreflexöffnung, ein 25-mm-Hochtonlautsprecher strahlt nach vorne und drei 51-mm-Mitteltöner sind nach oben, rechts und links ausgerichtet.

Beim neuen Echo Studio (2025) kommen hingegen ein 95-mm-Tieftöner und drei Breitband-Treiber zum Einsatz – also insgesamt 4 statt 5 Treiber. Der Aufbau ist etwas komplizierter als beim Echo Dot Max. Zwei der drei Breitbandtreiber strahlen vorne schräg nach unten nach rechts und links ab. Einer ist nach hinten schräg oben gerichtet. Der Tieftöner sitzt an der Basis des Lautsprechers und ist nach unten gerichtet. Aus weniger und kleiner soll der neue Echo Studio also einen ebenso überzeugenden Klang liefern wie das bisherige Modell.

Wie der Vorgänger unterstützt auch das neue Modell 3D-Audio und Dolby Atmos.

Klang im Vergleich

Der neue Echo Dot Max soll beim Sound im Vergleich zum Echo Dot der 5. Generation kräftig zulegen und diesen automatisch an den Raum anpassen. Er bietet dreimal so viel Bass wie der Echo Dot (5. Generation), so Amazon. Dass die beiden getrennten Lautsprecher auch in der Praxis dem Echo Dot überlegen sind, überrascht deshalb im Test nicht. Allerdings bedeutet mehr Bass auch wieder einmal, dass der Echo Dot Max nicht besonders neutral abgestimmt ist, sondern durch seine Bassbetonung überzeugen möchte.

Der Echo Dot Max ist somit auch klanglich ein besserer Echo Dot, aber weiterhin kein Lautsprecher für audiophilen Musikgenuss. Für Hintergrundmusik in der Küche, im Büro oder im Bad bei leiser bis mittlerer Lautstärke ist er aber bestens gerüstet. Nach dem Echo Studio ist er derzeit aber der am besten klingende Echo im Portfolio von Amazon.

Beim Echo Studio verspricht Amazon „den besten Sound für einen Smart Speaker dieser Größe“. Damit lässt das Unternehmen theoretisch die Tür offen, dass der alte Echo Studio besser klingt, denn dieser ist ja deutlich größer. Und der Echo Studio von 2019 hatte bisher ein gewisses Alleinstellungsmerkmal im Angebot von Amazon, da er der einzige Lautsprecher im Sortiment war, bei dem die Audioqualität an erster Stelle gestanden hat, während die smarten Features eher eine willkommene Zugabe waren. Angesichts einer geringeren Leistungsaufnahme des Verstärkers (330 Watt alt vs. 50 Watt neu), weniger Treibern (4 vs. 5) und einem 40 Prozent geringeren Volumens könnte man klanglich einige Abstriche beim neuen Echo Studio erwarten, in der Praxis stimmt dies aber nicht. Auch wenn der alte Echo Studio von 2019 insgesamt lauter aufspielen kann als das neue Modell, klingt er dadurch nicht immer besser. Beim Bass liefert der Echo Studio 2019 einen breiteren Klang als der Echo Studio 2025, dafür ist der Bass beim 2025er Modell etwas präziser. Das neue Modell klingt dadurch etwas wuchtiger und kräftiger als das alte. Im Vergleich mit einem HomePod schneidet dieser beim Tiefbass besser ab und klingt insgesamt neutraler als ein Echo Studio, der mehr Fokus auf den Bass legt. Die Mitten klingen dafür beim neuen Echo Studio am besten. Auch bei Spatial Audio und Dolby Atmos sind Unterschiede zwischen dem alten und neuen Echo Studio nur schwer auszumachen, obwohl der neue sehr viel kleiner ist und weniger Treiber besitzt. Für seine kleinere Größe liefert der Echo Studio demnach erneut einen überzeugenden Klang ab.

Beiden Echo-Lautsprechern gemein ist aber weiterhin, dass sie auf maximaler Lautstärke nicht mehr gut klingen. Der Bass geht dann völlig verloren und die Lautsprecher klingen zwar laut, aber auch sehr hell.

Heimkino mit 5 Lautsprechern

Echo Dot Max und Echo Studio unterstützen das neue Alexa Heimkino, bei dem bis zu fünf Echo-Studio- oder Echo-Dot-Max-Geräte mit kompatiblen Fire-TV-Geräten kombiniert werden können, um ein Surround-Sound-Erlebnis zu schaffen. Wichtig ist, dass es sich bei den fünf Lautsprechern entweder um 5 neue Echo Dot Max oder fünf neue Echo Studio handeln muss. Ein Mischbetrieb ist nicht möglich und auch alte Echo-Lautsprecher können – zumindest vorerst – nicht für das neue Alexa Heimkino genutzt werden. Bisher ließen sich bereits zwei Lautsprecher zu einem Stereo-Setup kombinieren. Alexa passt dabei den Klang der einzelnen Lautsprecher automatisch an den Raum an.

Darüber hinaus bedarf das Heimkino-Setup weiterhin eines zusätzlichen Fire TV Stick 4K oder 4K Max (Test) oder Fire TV Cube (Test). Der neue Fire TV Stick 4K Select (zumindest vorerst) und die neuen Fire TV 2-, Fire TV 4-Serie und Fire TV Omni QLED-Serie unterstützen das neue Alexa Heimkino mit 5 Lautsprechern nicht.

Im Test konnte ComputerBase das neue Alexa Heimkino nicht noch einmal ausprobieren, sondern muss auf die Erfahrungen von einem Event von Amazon zurückgreifen, bei dem 5 Echo Studio zusammengeschaltet waren. Für insgesamt 1.200 Euro klang das Alexa Heimkino in dieser Demo durchaus beeindruckend, ist dann aber auch kein Schnäppchen mehr.

Abgesehen von Alexa Heimkino unterstützen die neuen Echo-Lautsprecher auch Multiroom-Musik, um Musik, Radio, Podcasts oder Hörbücher in verschiedenen Räumen zu hören. Dies ist jederzeit auch per Sprachbefehl „Alexa, spiele Musik überall.“ möglich. Zudem müssen die Lautsprecher nicht zu einem ganzen Heimkino zusammengeschlossen werden, auch ein einfaches Stereo-Paar ist weiterhin möglich. Zwei Echo Dot Max oder Echo Studio lassen sich in der Alexa-App koppeln, wobei der rechte und linke Lautsprecher festgelegt wird.

Smart-Home-Hub, WLAN und Sensoren

Thread und WLAN 6E für den Studio

Zur Einbindung ins heimische Netzwerk bieten der Echo Studio und der Echo Dot Max beide WLAN 6E alias 802.11a/b/g/n/ac/ax. Beim Vorgänger des Echo Studio war und beim Echo Dot 5. Gen. ist mit WLAN 5 alias 802.11a/b/g/n/ac Schluss. Zudem können beide neuen Echos als Smart-Home-Hub genutzt werden und unterstützen dafür nun Zigbee, Matter und Thread, wobei sie auch als Thread Border Router fungieren können. Der alte Echo Studio beherrscht kein Thread und der Echo Dot 5. Gen. kann nicht als Smart-Home-Hub agieren. In diesem Bereich bieten beide neuen Modelle also mehr.

Für das Smart Home und zur Steuerung verfügen der Echo Studio und der Echo Dot Max über einen Umgebungstemperatursensor, Umgebungslichtsensor, eine Anwesenheitserfassung und einen Beschleunigungsmesser. Letzterer wird nicht nur für das eingangs erwähnte Omnisense genutzt, sondern ermöglicht zusammen mit den verbauten Antennen und den Mikrofonen auch die bereits von anderen Echo-Lautsprechern bekannten Tipp-Gesten auf dem Gerät. Tippt man oben auf das Gerät, lassen sich so beispielsweise die Wiedergabe anhalten oder fortsetzen, Anrufe und Drop-Ins beenden, Timer verwerfen oder die Schlummerfunktion für den Wecker aktivieren.

Zur direkten Verbindung mit den Lautsprechern ist zudem auch wieder Bluetooth verbaut.

Inbetriebnahme über die Alexa-App

Die Inbetriebnahme über die Alexa-App ist wie bei bisherigen Echo-Lautsprechern auch in wenigen Minuten erledigt, wenn man bereits über ein Amazon-Konto verfügt und die App schon eingerichtet ist. Die neuen Echo werden automatisch erkannt, wenn sie mit Strom versorgt werden und die App geöffnet wird. Nach einer kurzen Kopplung zwischen Echo und Smartphone werden Amazon bereits bekannte WLAN-Netzwerke automatisch verbunden. Anschließend lässt sich ein Name festlegen und einstellen, in welchem Raum das Gerät steht, etwa um passende Automatisierungen zu konfigurieren.

Leistungsaufnahme im Vergleich

Das Netzteil des Echo Dot Max leistet maximal 22 Watt – 7 Watt mehr als beim Echo Dot 5. Gen., trotzdem ist das Netzteil kleiner. Beim neuen Echo Studio kann das Netzteil hingegen bis zu 50 Watt bereitstellen. Das erscheint im Vergleich zum Verstärker des ersten Echo Studio mit 330 Watt geradezu lächerlich, doch ein Blick auf die realen Werte relativiert dies schnell. ComputerBase testet die Leistungsaufnahme der beiden neuen Echo im Standby und während der Musikwiedergabe und vergleicht sie mit dem Vorgänger beziehungsweise dem aktuellen Echo Dot.

Die Leistungsaufnahme des Echo Dot Max liegt mit 2,3 Watt im Standby deutlich höher als die 1,4 Watt des Echo Dot 5. Gen. Dies liegt in erster Linie an seiner neuen Funktion als Smart-Home-Hub, durch die er Smart-Home-Geräte im Haushalt ohne zusätzliche Bridge oder Hub direkt verwalten und steuern kann. Auch bei der Musikwiedergabe liegt die Leistungsaufnahme durch die neue Treiberkonfiguration etwas höher. Wie immer ist die punktuelle Leistungsaufnahme stark von der Musik abhängig, die wiedergegeben wird. Bei einer Lautstärke von 5 von 10 schwankt die Leistungsaufnahme deshalb zwischen 3 bis 6 Watt, bei 10 von 10 liegt sie hingegen häufiger am oberen Ende und erreicht bis zu 6,2 Watt.

Der neue Echo Studio verbraucht im Standby hingegen genauso viel wie sein Vorgänger und auch bei der Musikwiedergabe geben sich die beiden Echo-Modelle im Grunde nichts. Nur die Bandbreite fällt mit 3 bis 30 Watt sehr viel größer aus als beim Echo Dot Max. Bei einer Lautstärke von 5 von 10 liegt der Echo Studio in der Regel bei 4 bis 6 Watt, benötigt also gar nicht so viel mehr Energie als ein Echo Dot Max. Bei maximaler Lautstärke geht es dann jedoch bis auf 30 Watt hinauf, wobei auch diese nur selten erreicht werden. Meistens beträgt die Leistungsaufnahme bei voller Lautstärke circa 15 Watt.

Fazit

Der Echo Dot Max ersetzt den Echo

Der Echo Dot Max hat eine unverbindliche Preisempfehlung von 109,99 Euro*, der Echo Dot 5. Gen. kostet hingegen 64,99 Euro*. Das Image des günstigen Preises, das man mit einem Echo Dot verbindet, passt somit zumindest zur UVP nicht ganz zum neuen Echo Dot Max.

Insofern ist der Echo Dot Max aber auch kein Ersatz für den Echo Dot, weshalb Amazon ihn auch nicht als dessen Nachfolger zu einem deutlich höheren Preis auf den Markt gebracht hat. Der Echo Dot wird daher auch in Zukunft vor allem am Prime Day zu einem sehr günstigen Preis eine gute Wahl sein, wenn man einen kleinen, zusätzlichen Lautsprecher sucht. Der Echo Dot Max ist hingegen mit Smart Home Hub und mehr Leistung anders positioniert und dient weniger als zusätzlicher Lautsprecher denn als alleiniger Echo-Lautsprecher etwa in kleinen Wohnungen.

Da Amazon derzeit keinen Echo ohne Namenszusatz mehr anbietet, ersetzt der Echo Dot Max somit auch den normalen Echo von 2020 (Test). Dieser bot bei quasi gleichem Preis im direkten Vergleich aber auch keinen besseren Klang als das neue Modell – auch wenn der alte Echo lauter werden kann und noch mehr Bass rauspumpt. Im Vergleich zum Echo Dot ist der Echo Dot Max klanglich aber in jedem Fall deutlich überlegen.

Auch das neue Design mit neuem, besser positioniertem Bedienfeld überzeugt und ist im Vergleich zum Echo Dot eine große Verbesserung. Und die sprachgesteuerten Smart-Home-Funktionen mit Matter, Thread und Zigbee, Sensoren und WLAN-Verbindung hat Amazon mit dem Echo Dot Max ausgebaut. Zudem hört der Echo Dot Max Anfragen bei Hintergrundgeräuschen besser und reagiert auch auf einfache Anfragen wie das Setzen eines Timers oder beim Zugriff auf Smart-Home-Geräte etwas schneller als der Echo Dot. Und wer seinen Echo häufig stummschaltet, sieht nun nur noch ein kleines rotes Symbol und keine kreisrund leuchtende Basis mehr.

Wer einen Echo-Lautsprecher sucht, der mehr kann als der Echo Dot und dabei auch noch hörbar besser klingt, ist mit dem Echo Dot Max in jedem Fall besser beraten. Wer hingegen auch bisher mit einem kleinen Echo Dot glücklich ist und für den die zusätzlichen Smart-Home-Funktionen ohnehin ein Fremdwort sind, der greift auch künftig zum kleinen Echo Dot, der seine Aufgabe insbesondere zum Aktionspreis weiterhin ungeschlagen günstig erledigt.

Echo Studio: Klanglich weiterhin spitze

Der im Test in Schwarz daherkommende Todesstern Echo Studio (2025) tritt in große Fußstapfen der ersten Generation des 2019 veröffentlichten Echo Studio. Einen deutlichen Rückschritt beim Klang, den die kleinere Größe zunächst erwarten ließ, muss man allerdings nicht in Kauf nehmen. Alter und neuer Echo Studio klingen meist ähnlich und auch wenn der alte Echo Studio lauter aufspielen kann, klingen beim neuen Echo Studio die Mitten besser und der Bass präziser, wenn auch weniger breit. Wer einen Echo Studio kaufen wollte, kann somit bedenkenlos zum neuen Modell greifen, das auch in Sachen Rechenleistung und beim Smart Home-Hub mit Matter mehr bietet. Ersteres wird vor allem mit dem Start von Alexa+ an Bedeutung gewinnen.

Aufgrund seines deutlich kleineren Designs kann der Echo Studio nun zudem an deutlich mehr Orten einfacher aufgestellt werden. Gleichzeitig setzt er im Wohnzimmer aber selbst als Stereopaar kein optisches Klang-Statement mehr. Der bisherige Echo Studio hat seinen Anspruch auch optisch mehr in Szene gesetzt.

Lücke im Echo-Portfolio

Zwischen dem Echo Dot Max und Echo Studio klafft preislich eine vergleichsweise große Lücke, die Amazon kaum noch schließen kann, weshalb der Echo Dot Max der neue „kann alles und klingt gut“-Lautsprecher von Amazon ist. Der Echo Studio klingt zwar noch einmal deutlich besser, kostet aber mehr als das Doppelte. Ein zwischen beiden angesiedelter Echo für beispielsweise 170 Euro hätte aber nur die Option, etwas besser als der Echo Dot Max zu klingen, da Amazon auch im Echo Dot Max schon den Smart-Home-Hub und Sensoren verbaut, die auch der Echo Studio bietet.

Ohne Alexa+ fehlt dir was

Sowohl der Echo Studio als auch der Echo Dot Max müssen in Deutschland noch auf Alexa+ mit generativer KI verzichten. Auch wenn Alexa+ weiterhin nicht verpflichtend, sondern ein Extra sein wird, und der AI-Sprachassistent von Amazon noch verbessert werden muss, fehlt er bei den neuen Echo-Lautsprechern. Alexa selbst ist im Vergleich zu anderen AI-Sprachassistenten, die man inzwischen im Alltag nutzt, nicht mehr auf der Höhe der Zeit. Die Kommunikation mit Alexa fühlt sich inzwischen alt und unnatürlich an. Hier wird und muss Amazon auch in Deutschland bald nachlegen, um die eigenen Lautsprecher wieder attraktiver zu machen.

ComputerBase hat den Echo Dot Max (1. Gen.) und Echo Studio (2025) leihweise von Amazon zum Testen erhalten. Eine Einflussnahme des Herstellers auf den Testbericht fand nicht statt, eine Verpflichtung zur Veröffentlichung bestand nicht. Es gab kein NDA.

(*) Bei den mit Sternchen markierten Links handelt es sich um Affiliate-Links. Im Fall einer Bestellung über einen solchen Link wird ComputerBase am Verkaufserlös beteiligt, ohne dass der Preis für den Kunden steigt.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.

Apps & Mobile Entwicklung

Mega-Investitionen: Samsung will 300+ Mrd. USD in RAM, AI & Batterien stecken

In den kommenden fünf Jahren will Samsung 450 Billionen Won, umgerechnet 309 Milliarden US-Dollar, investieren. Ganz oben auf der Ausgabenliste stehen der Fabrikausbau und AI, aber auch Display-Technologien und Feststoffbatterien werden von dem großen Mischkonzern und seinen vielen Abteilungen adressiert.

Fabrikausbau im Bereich Speicher

Angesichts der steigenden RAM-Preise in Folge der sich auch in Zukunft wohl nicht abschwächenden Nachfrage nach Speicher jedweder Art steht der Ausbau der großen Fabrik in Pyeongtaek ganz oben auf der Liste. Der große Complex 2 wird dafür einen fünften Bau erhalten – Line 5 heißt das bei Samsung, manchmal auch Phase 5 genannt. Sie entspricht in etwa einer Phase bei TSMCs Fabrikbauten, die auch immer stets für ein neues großes Fabrikgebäude steht.

Geplant war Line 5/Phase 5 aber schon länger, sie sollte ursprünglich bereits im vorletzten Jahr gebaut werden. Samsungs Schwäche als Foundry und geringe Nachfrage im Speichermarkt führten jedoch zu Verzögerungen. Immerhin wurden einige Vorarbeiten bereits abgeschlossen, sodass es hier nun zügig weitergehen kann, und die Produktion 2028 in Serie hochfährt. Platz wäre am Standort sogar noch für eine sechste Phase, wie koreanische Medien bereits im vergangenen Jahr analysiert hatten.

Geld für Substrate und AI-Rechenzentren

Passend zum Ausbau der Fertigungskapazität wird auch Samsung Electro Mechanics einen Teil der geplanten Summe erhalten. Substrate stehen dort ganz oben auf der Liste, vor allem das klassische FC-BGA für Chips unterschiedlichster Größe liegt im Fokus und wird in Zeiten von neuen, immer größeren AI-Beschleunigern nicht weniger benötigt.

Apropos AI-Beschleuniger: Bereits vor zwei Wochen wurde angekündigt, dass Samsung zusammen mit Nvidia einen AI-Komplex bauen, der unter der Sparte Samsung SDS laufen wird. 15.000 GPUs werden hierfür bis 2028 in einem eigenen Rechenzentrum verbaut. Während der erste Bau zumindest teilweise auch der Allgemeinheit zur Verfügung gestellt werden soll, wird Samsung ein zweites Datacenter errichten, welches nur Samsung und den Subunternehmen zur Verfügung stehen wird.

Geld auch für OLEDs und Next-Gen-Akkus

Geld bekommt auch die Sparte Samsung Display, kurzfristig vorrangig um den Start der „8.6th generation OLED“ anzuschieben. Deren Fertigung wird zur Mitte des kommenden Jahres hochgefahren.

In Samsung SDI wird wiederum weiter investiert, um die „dream batterie“ in die Serienfertigung zu überführen. Diese All-Solid-State-Batteries ( Feststoffbatterien) sind derzeit bei vielen potenziellen Kunden im Test. Zuletzt hatte BMW eine Vereinbarung mit Samsung SDI geschlossen – ab 2027 könnte die Serienproduktion anlaufen.

Unterm Strich plant Samsung in den kommenden fünf Jahren nicht nur große Investitionen, sondern auch die Einstellung von 60.000 neuen Angestellten. Was von diesen Plänen am Ende aber wie und in welchem Umfang umgesetzt wird, bleibt abzuwarten.

Samsung ist für derartige Ankündigungen bekannt, alle paar Jahre wieder werden Hunderte Milliarden versprochen, die jedoch über lange Zeiträume in zahlreiche Bereiche fließen und teilweise bereits zuvor genannte Summen enthalten. Was genau dieses Mal letztlich wirklich neu ist, lässt sich auch aus der neuerlichen Ankündigung deshalb schwer herauslesen.

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenAdobe Firefly Boards › PAGE online

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenGalaxy Tab S10 Lite: Günstiger Einstieg in Samsungs Premium-Tablets

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenHarte Zeiten für den demokratischen Rechtsstaat

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

UX/UI & Webdesignvor 1 Monat

UX/UI & Webdesignvor 1 MonatIllustrierte Reise nach New York City › PAGE online

-

Datenschutz & Sicherheitvor 2 Monaten

Datenschutz & Sicherheitvor 2 MonatenJetzt patchen! Erneut Attacken auf SonicWall-Firewalls beobachtet

-

Online Marketing & SEOvor 3 Monaten

Online Marketing & SEOvor 3 Monaten„Buongiorno Brad“: Warum Brad Pitt für seinen Werbejob bei De’Longhi Italienisch büffeln muss