Apps & Mobile Entwicklung

Rechenzentren in Deutschland: Ausgebremst durch Strommangel, Energiepreise und komplexe Regulierung

Mehr KI, mehr Rechenzentren – die Formel ist einfach. Obwohl der Ausbau sich in Deutschland beschleunigt, reicht es nicht, um die Nachfrage zu decken. Stromknappheit und hohe Preise sowie die komplexe und teils widersprüchliche Regulierung sind zentrale Hürden.

Die Probleme schildert Alexander Rabe, Geschäftsführer des Internetwirtschaftsverbands Eco, auf der Glasfasermesse Fiberdays 26, die der Breko derzeit in Frankfurt am Main veranstaltet. Rechenzentren sind einer der Themenschwerpunkte auf der Messe.

In Frankfurt wird es eng

Selbst wenn man in Europa nicht der Gigantomanie amerikanischer Big-Tech-Konzerne folgt, sind die Ausbaupläne ambitioniert. Allein die IT-Leistung der Colocation-Rechenzentren soll laut Angaben der German Datacenter Association (GDA) bis zum Jahr 2030 von 2,4 GW auf 4,6 GW steigen. Investitionen sollen dafür bei 49 Milliarden US-Dollar liegen.

Speziell in Frankfurt, dem größten Rechenzentrumsstandort in Europa, wird es aber allmählich eng. „Aktuell ist davon auszugehen, dass insbesondere große, leistungsstarke Neuanschlüsse erst ab Mitte der 2030er Jahre erneut bereitgestellt werden können“, erklärte der lokale Energieversorger Mainova laut einem Bericht der Frankfurter Rundschau vor rund einer Woche. Eine Entwicklung, die die Pläne der Branche ausbremst.

Die Nachfrage entwickelt sich dreimal schneller als das Angebot

„Wir haben eine massive Ausbaulücke“, sagt Eco-Geschäftsführer Rabe bei dem Vortrag auf den Fiberdays. Die Ausbaupläne bis 2030 reichen derzeit nicht aus, um Kapazitäten zu decken. Vor allem mit Blick auf die lokale IT-Wirtschaft beschreibt Rabe die Rechenzentren aber als zentrale Infrastruktur für den digitalen Wandel. „Ohne Rechenzentren gibt es keine Künstliche Intelligenz“ – zumindest keine, die von deutschen Anbietern betrieben wird. Sowohl amerikanische als auch chinesische Anbieter präsentieren sich gerne als Alternative, passen aber nur bedingt zu einer Strategie, die auf mehr digitale Souveränität setzen will.

Konkret nennt Rabe vier Punkte, an denen man in Deutschland und der EU ansetzen müsse:

- Regeln für Datenverarbeitung: Der regulatorische Rahmen müsse so gestaltet sein, dass Unternehmen KI-Anwendungen nutzen und entwickeln können.

- Physische Rechenzentren-Kapazitäten erhöhen

- Glasfaser-Anbindungen mit niedrigen Latenzen müssen ausgebaut werden.

- Mehr Energie wird benötigt und die Strompreise müssen sinken.

Energie „ist der Treiber unserer Branche“, so Rabe. Strom macht daher aber auch einen Großteil der Kosten aus. Laut den Zahlen der German Datacenter Association machen Stromkosten rund 50 Prozent der Betriebskosten bei Rechenzentren aus.

Nun ist in Deutschland der Strom nicht nur teuer, sondern auch Mangelware, wie die Einschätzung der Mainova zeigt. Laut Eco sei es daher wichtig, dass Rechenzentren ebenfalls eine Strompreisreduzierung erhalten. Zufrieden ist man daher mit der Rechenzentrum-Strategie, die die Bundesregierung am 18. März vorgestellt hat. Diese sieht unter anderem vor, dass die Betreiber bezahlbare und erneuerbare Energie erhalten. Erleichtert werden soll auch die Standortsuche.

Der Haken an solchen Strategien: Papier ist geduldig. Wie Rabe skizziert, nützt es nichts, das ideale Konzept in der Schublade zu haben. Entscheidend sei vielmehr, was regulatorisch umgesetzt werde. „Wir messen den Erfolg dieser Strategie nicht an Ankündigungen, sondern an dem, was in zwölf Monaten im Bundesgesetzblatt steht“, sagte auch der stellvertretende GDA-Vorsitzende Peter Pohlschröder bei der Vorstellung der Strategie.

Komplexe Regulierung erschwert Standortsuche

Für die Branche relevant sind daher die Reformen beim Energieeffizienzgesetz oder der Digital Network Act (DNA) auf EU-Ebene. Die Gesetze müssten laut Rabe so gestaltet sein, dass sich die Komplexität in der Praxis nicht erhöht.

Schon jetzt sind Vorgaben teilweise widersprüchlich. So müssen Rechenzentren mit erneuerbaren Energien betrieben werden – derzeit sind es 50 Prozent, ab 2027 muss die Ökostrom-Quote bei 100 Prozent liegen. Vorgaben gibt es auch bei der Nutzung der Abwärme. Rechenzentren, die ab dem 1. Juli 2026 ans Netz gehen, müssen 10 Prozent der Abwärme wiederverwenden. Im Juli 2027 steigt der Anteil auf 15 Prozent, 2028 dann auf 20 Prozent. Ebenso benötigen Rechenzentren noch ausreichend Flächen.

In einer Stadt wie Frankfurt am Main, die aufgrund des Internetknotens DE-CIX der größte Rechenzentrenstandort ist, sind jedoch sowohl Flächen als auch Strom äußerst begrenzt. Denkbar wäre also, auf Standorte wie Brandenburg auszuweichen, wo es ausreichend Energie gibt. Der Haken an solchen Orten ist aber: Man wird die Abwärme nicht los.

Konsequenz aus den Hürden ist, dass der Ausbau länger dauert. Rechenzentren benötigen in Deutschland im Schnitt zwischen sieben und zehn Jahren, bis sie in Betrieb gehen. In Großbritannien geht es schneller, dort hat der Ausbau aber auch öffentliches Interesse. An die 1 bis 3 Jahre, die es teils nur in den USA dauert, kommt man in Europa aber nicht heran.

Um die Akzeptanz vor Ort werben

Rechenzentren haben aber auch weitere Herausforderungen. Lokal sind entsprechende Ausbauvorhaben in vielen Fällen äußerst unbeliebt. Das kann laut Rabe dann dazu führen, dass Milliarden-Projekte an Stadtrat-Abstimmungen scheitern können. In der Stadt Maintal, zwölf Kilometer östlich von Frankfurt, wird derzeit um den Bau von zwei Rechenzentren gestritten. Weil der Betreiber Edgeconnex ein Gaskraftwerk für den Betrieb bauen will, steht das Vorhaben auf der Kippe, berichtet die Frankfurter Allgemeine Zeitung (FAZ). Edgeconnex erklärt zwar, Umweltbelastungen wären wesentlich geringer als befürchtet. Kritiker beruhigen kann man bislang aber nicht.

Wie Eco-Präsident Rabe auf den Fiberdays erklärt, müsse die Branche generell besser aufklären, was ein Rechenzentrum vor Ort bedeutet. Ängste, die etwa Umweltverschmutzung oder den Wasserverbrauch betreffen, müssten Betreiber direkt adressieren. Zusätzlich schlägt Rabe mehr finanzielle Anreize vor, um Kommunen zu überzeugen. Denkbar hält er etwa einen neuen Schlüssel bei der Verteilung der Gewerbesteuereinnahmen, sodass Kommunen mehr Geld erhalten, wenn Unternehmen sich in einem Ort ansiedeln.

Apps & Mobile Entwicklung

Ryzen 9 9950X3D2: AMDs Dual-X3D-Prozessor startet am 22. April

AMD hat heute den bereits zur CES 2026 in Aussicht gestellten Ryzen 9 9950X3D2 offiziell gemacht. Er erscheint am 22. April und ist natürlich in erster Linie für Profis gedacht, aber auch Gamer könnten davon profitieren, stellt AMD in Aussicht. Einen Preis nennt das Unternehmen in der kurzen Video-Ankündigung nicht.

Wie die parallel auch online verfügbare Produktseite erklärt, bietet die Lösung die erwarteten 192 MByte L3-Cache, die sich aus jeweils zwei Mal 32 MB plus 64 MByte gestapeltem Cache zusammensetzen. Auf 208 MB kommt AMD im Marketing, wenn die 16 MB L2-Cache dazu gerechnet werden.

Die 16-Kern-Lösung mit 32 Threads wird mit 200 Watt TDP antreten, als Maximaltakt sind 5,6 GHz festgelegt. Da die Plattform AM5 voll unterstützt wird, gibt es keinerlei Änderungen an den weiteren Parametern, auch DDR5-5600 ist und bleibt die favorisierte Speicherunterstützung, wenngleich AMD auch den CPUs Overclockingpotenzial sowohl für Speicher und CPU-Kerne einräumt.

Apps & Mobile Entwicklung

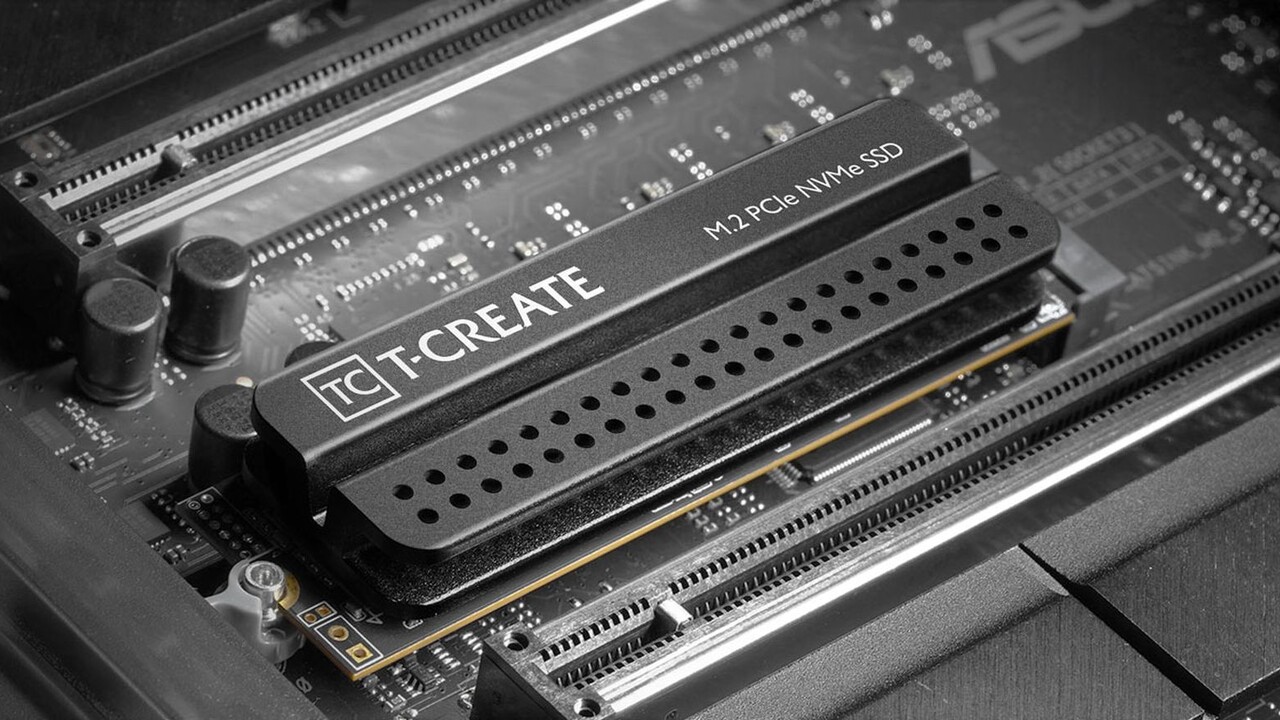

T-Create Classic H514: PCIe-5.0-SSD mit hoher Leistung und Kühleroption

Für Kreativschaffende, die auch durch den Einsatz von generativer KI höhere Anforderungen an die SSD-Leistung stellen, hat Team Group eine neue Serie vorgestellt. Die T-Create Classic H514 nutzt den schnellen SM2508-Controller mit PCIe 5.0 für hohen Durchsatz und geringe Latenzen. Optional gibt es einen Kühlkörper.

Das ist die T-Create Classic H514

Laut Team Group wurde die T-Create Classic H514 entwickelt, „um dem steigenden Bedarf an leistungsstarker Datenspeicherung im Zeitalter der generativen KI gerecht zu werden“. Auch wenn der Hersteller den „fortschrittlichen 6-nm-Controller“ nicht beim Namen nennt, verraten Abbildungen, dass es sich um ein Modell von Silicon Motion handelt. Angesichts der Leistungswerte von bis zu 14.200 MB/s lesend und 13.300 MB/s schreibend, sowie der Adressierung von Endkunden kann es sich nur um den SM2508 handeln. Dieser bildet gemeinsam mit dem Phison E28 die derzeit schnellste SSD-Plattform mit PCIe 5.0 im Client-Segment.

Team Group nennt niedrige Latenzen von 0,05 ms beim Lesen und 0,015 ms beim Schreiben. Die drei Modelle der Serie sollen folgende sequenzielle Transferraten erreichen, die der Hersteller mit dem CrystalDiskMark ermittelt hat:

- 1 TB: Bis zu 14.000 MB/s lesend; bis zu 11.000 MB/s schreibend

- 2 TB: Bis zu 14.200 MB/s lesend; bis zu 13.300 MB/s schreibend

- 4 TB: Bis zu 14.200 MB/s lesend; bis zu 13.300 MB/s schreibend

Zum NAND-Flash werden keine konkreten Angaben gemacht, es sollte sich aber um 3D-TLC-NAND der jüngeren Generation handeln, um diese Leistung zu erreichen. Die Total Bytes Written liegen mit 600 TB, 1.200 TB und 2.400 TB auf dem üblichen Niveau von SSDs mit TLC-Speicher.

Optional mit Aluminium-Kühler

Wie bei so vielen SSD-Serien von Team Group wird die T-Create Classic H514 in der Standardausführung mit einem dünnen Graphen-Pad im Typenaufkleber angeboten. Dieses begünstigt die Wärmeabfuhr, besitzt aber nur ein geringes Kühlpotenzial.

Eine bessere Kühlung ist mit dem optionalen Kühlkörper aus Aluminium zu erwarten. Dieser sieht zudem schick aus und lehnt sich an das Design anderer Produkte der T-Create-Serie an. Mit dem Kühler steigt die Bauhöhe der SSD von 3,7 mm auf 11,7 mm an.

Preise und Verfügbarkeit

Team Group hat noch keine Angaben zu Preisen und Verfügbarkeit gemacht.

Apps & Mobile Entwicklung

SwitchBot revolutioniert das Smart Home mit diesem Gadget

Sci-Fi wird jetzt Realität: Der SwitchBot KI Hub könnte den Smart-Home-Markt aufrütteln. Das neue Gadget ermöglicht nämlich dank OpenClaw-Unterstützung eine ganzheitliche Lösung für Euer intelligentes Zuhause – und das zu einem richtig spannenden Preis.

KI-basierte Lösungen für das Smart Home gibt es zahlreich. Allerdings unterliegen diese häufig einigen Restriktionen oder sind so umständlich einzurichten, dass Ihr besser einen Informatik-Abschluss an einer Hochschule Eurer Wahl vorweisen solltet. Das Ganze soll sich mit dem SwitchBot KI Hub ändern. Dank nahtloser OpenClaw-Unterstützung kann das Gerät nicht nur unzählige Automatisierungen vornehmen, sondern bietet auch Zugang zu Edge-AI-Computing und Vision-Language-Modellen. Warum OpenClaw eine wichtige Neuerung darstellt und was Euch der ganze Spaß kosten soll, erfahrt Ihr in diesem Artikel.

SwitchBot und OpenClaw: Die perfekte Symbiose?

Falls Euch OpenClaw (noch) nichts sagt, ändern wir das jetzt: Hierbei handelt es sich um ein Open-Source-Framework für autonome KI-Agenten. Der SwitchBot KI Hub unterstützt also eine offene Softwareplattform, die nicht nur frei zugänglich ist, sondern stetig von zahlreichen Entwicklern verbessert wird. Die Symbiose der beiden bedeutet, dass Ihr ein flexibles Framework in Verbindung mit einem KI Hub erhaltet, der Euer Smart Home steuert.

In der Praxis könnt Ihr somit auf verschiedene Large-Language-Modelle zugreifen, welche direkt über beliebte Chat-Apps, wie etwa WhatsApp, bedient werden können. Schreibt Ihr beispielsweise, dass Ihr jetzt einen Film schauen möchtet, werden die Vorhänge zugezogen, das Licht gedimmt und gleichzeitig der Fernseher angeschaltet – alles mit einer einzigen Automatisierung. Als Schaltzentrale ermöglicht das Gadget zusätzlich die Anbindung zahlreicher smarter Geräte. So habt Ihr etwa die Möglichkeit, Eure SwitchBot-Videotürklingel zu verbinden, wodurch Personen direkt erkannt werden. Daraufhin erhaltet Ihr eine Chat-Nachricht und könnt dann entscheiden, ob Ihr die Tür öffnen möchtet. Das lokale NVR-System unterstützt bis zu acht Kameras, eine geräteinterne Gesichtserkennung, kostenlose lokale Videoaufzeichnung auf bis zu 16 TB und eine hausweite Überwachung.

Die Möglichkeiten des KI Hub sind enorm und dank Matter-Kompatibilität auch mit externen Geräten kombinierbar. Mit der dialogbasierten Steuerung könnt Ihr das Gadget zudem ohne besondere Befehle bedienen: Ihr möchtet zocken? Dann schreibt es im Chat und das Gerät versteht, welche Automatisierung jetzt greifen sollte. Da es sich zudem um eine lernfähige KI handelt, kann das Gerät auch proaktiv unterstützen, bisherige Verhaltensmuster analysieren und somit Vorschläge ableiten.

Kosten und Verfügbarkeit des SwitchBot KI Hubs

Was klingt, wie aus einem Sci-Fi-Film, wird dank dem SwitchBot KI Hub jetzt zur Realität. Das Gerät ist bereits seit einigen Wochen erhältlich, konnte zum Release jedoch nicht auf alle Funktionen zugreifen. Das ändert sich nun: SwitchBot hat sowohl die OpenClaw-Integration als auch die Unterstützung von SwitchBot-Skills mittlerweile erfolgreich implementiert. Wer nun denkt, dass eine solche KI-Lösung gleich eine halbe Niere kostet, liegt völlig daneben. Der Hersteller ist bekannt für sein äußerst gutes Preis-Leistungs-Verhältnis und beweist dies mit dem KI Hub erneut.

Nur 259,99 Euro verlangt der Hersteller für die ganzheitliche Smart-Home-Lösung. Erhältlich ist das Gerät im offiziellen SwitchBot-Shop und mit dem Code MKMK15 spart Ihr für kurze Zeit zusätzlich 15 Prozent, wodurch der Preis auf 221 Euro purzelt.

Könnt Ihr mit einem solchen Gerät etwas anfangen? Welche Automatisierung würdet Ihr Euch zuerst einrichten? Lasst es uns in den Kommentaren wissen!

Mit diesem Symbol kennzeichnen wir Partner-Links. Wenn du so einen Link oder Button anklickst oder darüber einkaufst, erhalten wir eine kleine Vergütung vom jeweiligen Website-Betreiber. Auf den Preis eines Kaufs hat das keine Auswirkung. Du hilfst uns aber, nextpit weiterhin kostenlos anbieten zu können. Vielen Dank!

Dieser Artikel ist Teil einer Kooperation mit SwitchBot.

Der Partner nimmt keinen Einfluss auf den Inhalt des Artikels.

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 3 Wochen

Social Mediavor 3 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 1 Monat

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenÜber 220 m³ Fläche: Neuer Satellit von AST SpaceMobile ist noch größer

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur