Apps & Mobile Entwicklung

AMD Ryzen Threadripper 9000 im Test

HEDT ist nicht tot. AMD hält die Plattform mit den neuen Ryzen Threadripper 9000 am Leben. 32 und 64 Kerne können sich lohnen, wie der Test zeigt, zumal auch die Effizienz gestiegen ist. Käufer des ersten 64-Kern-Threadripper im Jahr 2020 erwartet heute oft ein dreistelliges Leistungswachstum.

Wer braucht AMD Ryzen Threadripper 9000?

Es gibt nichts zu beschönigen: die besten Zeiten von HEDT-Prozessoren sind längst vorbei. Damals, von Intel Sandy Bridge-E über Ivy Bridge-E bis Haswell-E und auch die ersten Generationen Ryzen Threadripper konnten punkten, da sie etwas boten, was der nächste Mainstream-Markt werden könnte: ein kleines Plus an Kernen und zusätzliche Schnittstellen zu vergleichsweise geringem Aufpreis.

Heute ist die Mainstream-Plattform so breit aufgestellt und auch so gut ausgestattet, dass nur noch wenig Spielraum für HEDT bleibt. Im Vorfeld einer möglichen Anschaffung sollten sich Kunden einige Fragen stellen:

- Brauche ich mehr als 16 Kerne/32 Threads wirklich?

- Reichen 256 GByte DDR5-Speicher oder muss es (mehr und) eventuell zusätzlich ein Quad-Channel-Speicherinterface sein?

- PCIe-Lanes bieten den größten Spielraum für Entfaltungen, hier ist das Mainstream-Segment aber auch am stärksten eingeschränkt. Brauche ich zusätzliche Lanes, insgesamt 80 PCIe-5.0-Lanes an der Zahl, für GPUs und/oder SSDs?

- die Kosten: Threadripper X kostet mindestens das Dreifache, Sechsfache oder Achtfache

Wenn eine oder gar mehrere Fragen mit einem klaren Ja beantwortet wurden, dann kann Threadripper durchaus sinnvoll sein. Denn das Gesamtpaket liefert ab, wie der Überblick in Kurzform zeigt.

- Extreme Anwendungsleistung

- Und dabei sogar ziemlich effizient

- Schneller Vier-Kanal-Speicher

- 1 TByte maximaler Speicherausbau

- 80 PCIe-5.0-Lanes

- Dadurch Vielzahl an Möglichkeiten für SSDs und PCIe

- Lauffähig auf bekannten Mainboards

- Hohe Leistungsaufnahme im Leerlauf

- durchschnittliche Spieleleistung

- gesamte Plattformkosten sehr hoch

- Sehr hohe Anwendungsleistung

- Und dabei sogar ziemlich effizient

- Schneller Vier-Kanal-Speicher

- 1 TByte maximaler Speicherausbau

- 80 PCIe-5.0-Lanes

- Dadurch Vielzahl an Möglichkeiten für SSDs und PCIe

- Lauffähig auf bekannten Mainboards

- Hohe Leistungsaufnahme im Leerlauf

- durchschnittliche Spieleleistung

- gesamte Plattformkosten sehr hoch

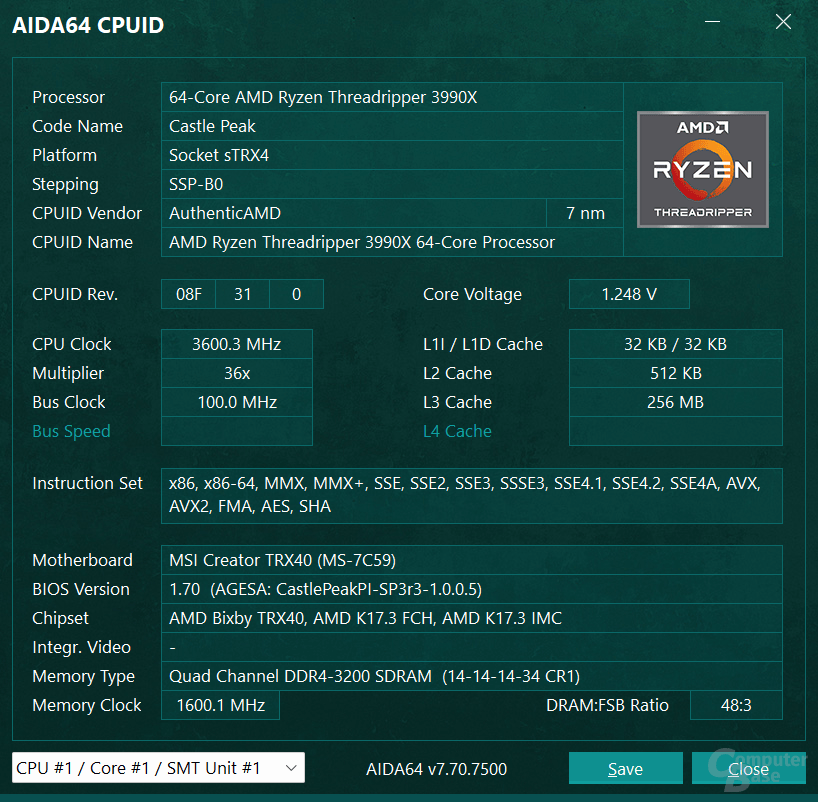

Natürlich gibt es auch Käufer, die bereits einen Threadripper haben oder hatten und die Plattform zu schätzen wissen. Deshalb wird der Test auch einen Blick zurück in Form einiger Vergleichswerte mit dem AMD Ryzen Threadripper 3990X als erstem 64-Kern-Prozessor bieten. Vor 5,5 Jahren vorgestellt war er das Beste, was es im Desktop gab.

Threadripper-Prozessoren und Plattform im Detail

Wie bei den Vorgängern unterteilt AMD das Portfolio in Workstation-Modelle (Threadripper Pro WX) und High-End-Desktop-Modelle (Threadripper X). Unterschiede existieren aber nicht nur bei den Namen, denn nur die Workstation-Ableger bieten ein 8-Kanal-Speicherinterface, während die HEDT-Varianten mit vier Kanälen Vorlieb nehmen müssen. Die Maximalausstattung von 96 Kernen gibt es auch nur in der WX-Serie.

- Ryzen Threadripper (Pro) 9000: AMD bringt Zen 5 für Workstations und als HEDT-CPU

Im HEDT-Segment bleibt es mit 24, 32 und 64 Kernen letztlich wie in den vorangegangenen Generationen. Neue Kerne, eine bessere Fertigung und höherer Takt bringen zusammen mit schnellerem Speicher zusätzliche Leistung.

Zu einem Threadripper gehört auch die passende Plattform. Diese setzt in der Generation 9000 auf die gleiche Infrastruktur wie in der Generation 7000; jedes Threadripper-7000-Mainboard funktioniert so auch für die Neulinge. Ein BIOS-Update ist stets notwendig, damit der AGESA-Code für die neuen CPUs vorhanden ist und sie ordnungsgemäß unterstützt werden.

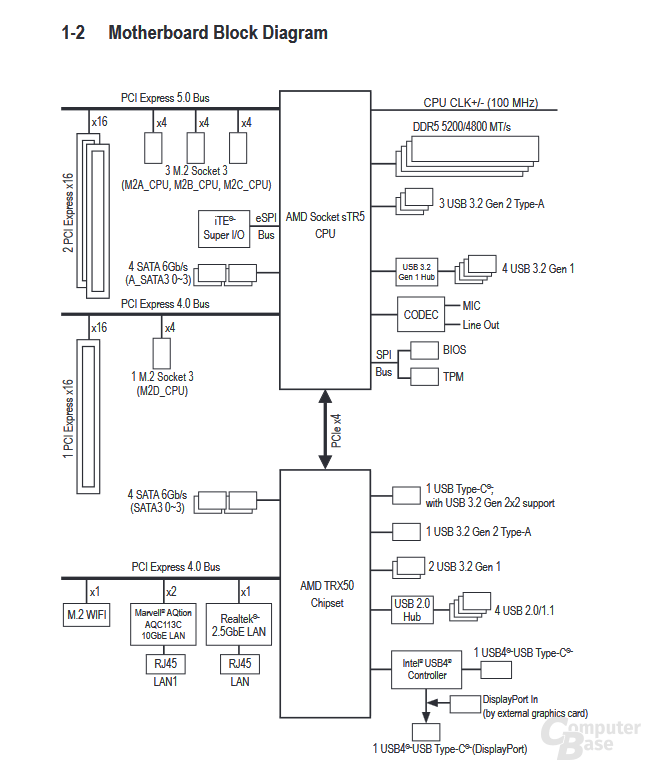

Das Blockdiagramm des Gigabyte TRX50 Aero zeigt, wie die Aufteilung der Möglichkeiten, die vor allem der Prozessor aber auch der Chipsatz auf den aktuellen Platinen bietet, funktioniert. Vor allem sind es die vielen PCIe-Lanes durch den Prozessor, die erst zusätzliche Möglichkeiten bieten, denn der TRX50-Chipsatz mit einer Anbindung von nur vier PCIe-4.0-Lanes in Richtung CPU kann nicht mehr, als die bisherigen AMD-Mainstream-Lösungen.

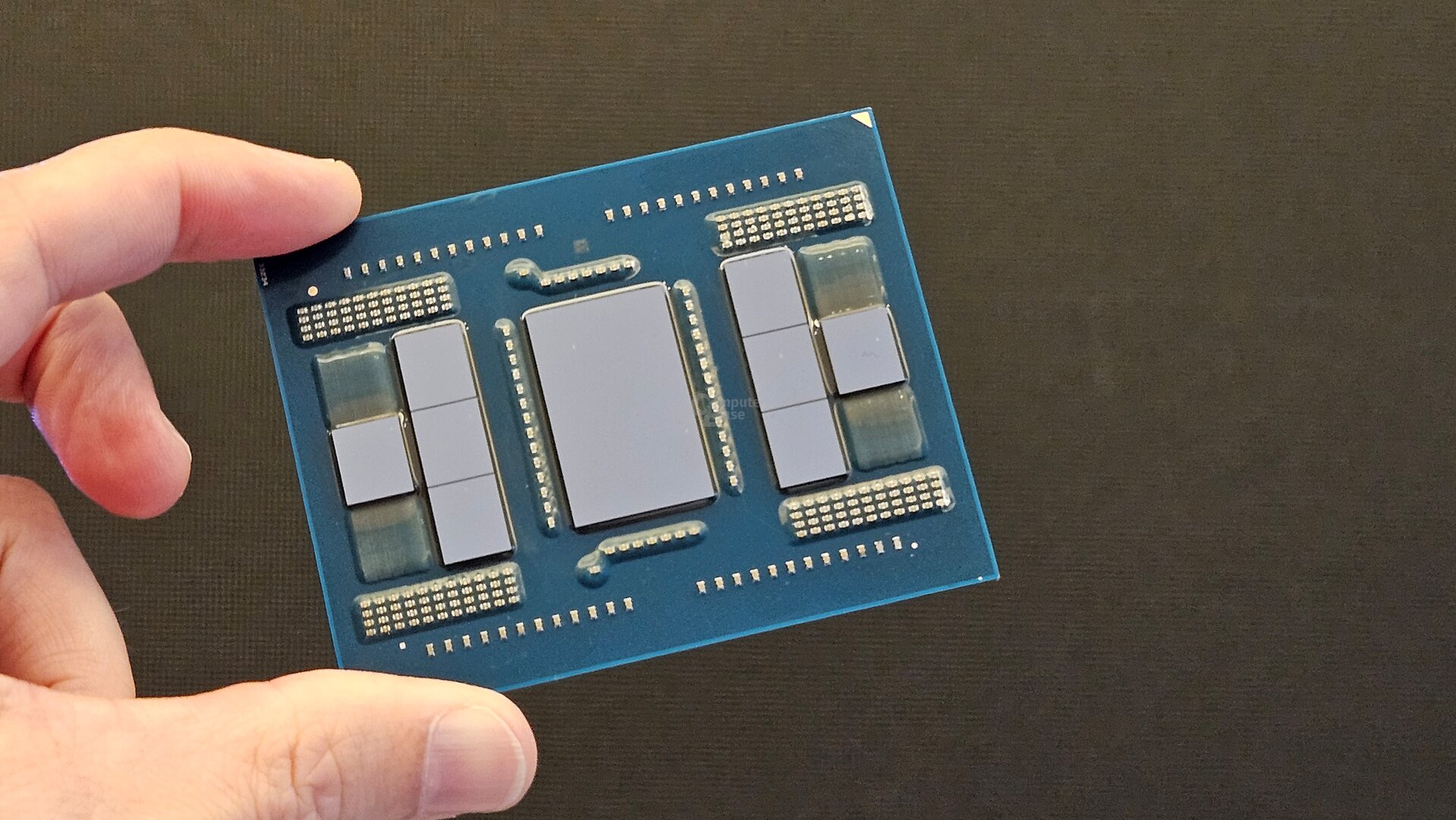

Auf der Plattformseite ist die Frage letztlich schnell geklärt: Threadripper bietet sehr viel Ausstattung, die durch den großen IO-Die in der Mitte des Prozessors realisiert wird. Wenn diese für mehr als eine Grafikkarte oder zusätzliche PCIe-5.0-Speicherlösungen – oder auch beides zusammen – genutzt werden sollen, dann hat man als Kunde gar keine andere Wahl. Intel bietet zwar ebenfalls noch einige Xeon W an, aber diese entsprechen nicht dem Standard der aktuellen Intel Granite Rapids, sondern dem Vorgänger Emerald Rapids. Unterm Strich ist dieser gegen neue Zen-5-Profi-Prozessoren aber chancenlos, zumal diese als echte HEDT-Prozessoren auch gar nicht aufgelegt wurden.

Schnellerer RDIMM muss kühl bleiben

Mit der Anhebung der Spezifikationen für den Speicher auf DDR5-6400 folgt von AMD auch eine Warnung: Die Temperatur dieser Registered-ECC-Module kann von der Plattform ausgelesen werden. Im Normalfall sollte sie 70 Grad nicht übersteigen, schreibt AMD. Spätestens ab 85 Grad wird gedrosselt.

Je nach Board-Aufbau und Modul kann dies durchaus schnell passieren. Einige Module nutzen dicke Heatspreader, die Abstände zwischen den Modulen im verbauten Zustand in den Slots liegt dann oft unter einem Millimeter. Je nach Gehäuse-Beschaffenheit und Frischluft im System kann es so zum Hitzestau kommen.

Betroffen davon dürften in erster Linie OC-Module sein, die jenseits der 6.400 MT/s agieren und dafür mitunter auch die Spannung deutlich anheben müssen. Im Test wurden mit den 6.400er-Modulen im offenen Aufbau mit AiO kaum 60 Grad als Maximum erreicht, Probleme gab es folglich nicht.

TR 3990X vs. TR 9980X – 5 Jahre 64 Kerne bei AMD Threadripper

Was hat sich im HEDT-Bereich in den letzten fünf Jahre getan? Auch diese Frage ist nicht pauschal zu beantworten. Die einen mögen meinen wenig, die anderen viel. Fakt ist, an 64 Kernen hat sich nichts geändert – die gab es schon beim AMD Ryzen Threadripper 3990X, der Anfang 2020 erschien.

Grund genug, ihn noch einmal hervorzuholen, und zu zeigen, was die Unterschiede sind. Kerne sind bekanntlich nur das eine, die zugrunde liegende Architektur macht auch einiges aus. Und natürlich eine neuere Fertigung, ein erhöhter TDP-Spielraum, schnellerer Speicher, Zusatzinstruktionen und und und.

In einigen ausgewählten Benchmarks zeigt sich die Veränderung ganz gut. Mit über 3.100 Punkten im Cinebench-R24-Multi-Core-Score schlägt die fünf Jahre alte Lösung heute noch jeden Mainstream-Prozessor von AMD und Intel. Das komplette Gegenteil ist bei Single-Core-Tests der Fall: Kaum 75 Punkte sind ein massiver Rückstand. Eine in die Jahre gekommene Architektur und vor allem eine vergleichsweise geringe Taktfrequenz haben gegen die Hochtaktlösungen von heute jenseits der 5,7 GHz keine Chance. Zur besseren Einordnung ist deshalb in den Diagrammen auch ein AMD Ryzen 9 9950X3D hinterlegt, die aktuell schnellste Mainstream-Lösung aus gleichem Haus mit 16 Kernen und 32 Threads.

Unterm Strich ist es ein gemischtes Bild, vor allem auch in Bezug auf die Mainstream-Plattform. In gut skalierenden Tests über viele Threads, ist der alte Threadripper mit 64 Kernen weiter gut unterwegs und kann einen Ryzen 9000 mitunter in Schach halten. Dass der Neuling AMD Ryzen Threadripper 9980X mit gleicher Anzahl an Kernen teils auch mehr als doppelt so schnell ist, darf jedoch nicht außer Acht gelassen werden.

Wirklich spürbare Einbrüche gibt es, wenn neue Instruktionen zünden und 128 Threads nicht voll genutzt werden. Handbrake ist so ein Beispiel, hier fällt selbst der alte 64-Kerner gegenüber dem 16-Kerner zurück.

(*) Bei den mit Sternchen markierten Links handelt es sich um Affiliate-Links. Im Fall einer Bestellung über einen solchen Link wird ComputerBase am Verkaufserlös beteiligt, ohne dass der Preis für den Kunden steigt.

Apps & Mobile Entwicklung

Dieses Problem macht die Leute verrückt

Die Apple AirPods Pro 3 stellen eine deutliche Verbesserung gegenüber den AirPods Pro 2 dar. Da ist allerdings ein akustisches Problem, das die Nutzer:innen in den Irrsinn treibt – seid Ihr auch betroffen?

Apple hat im vergangenen Monat die AirPods Pro 3 (Test) vorgestellt – mit einigen der größten Neuerungen seit dem Vorgängermodell, die das Warten auf die nächste Generation durchaus gerechtfertigt erscheinen lassen. Neben verbessertem Klang und optimierter Geräuschunterdrückung bringen die neuen Ohrhörer allerdings auch einige unerwünschte Nebenwirkungen mit sich. Mehrere Nutzer:innen berichten von statischen und zischenden Geräuschen, die das Hörerlebnis deutlich beeinträchtigen.

Die ersten Berichte tauchten im vergangenen Monat auf – kurz nachdem die AirPods Pro 3 ausgeliefert wurden. Und seitdem häufen sich die Meldungen. Einige frühe Käufer berichten, dass bei aktivierter Geräuschunterdrückung und ohne laufende Wiedergabe ein deutliches Rauschen oder weißes Hintergrundgeräusch zu hören sei. Ein Nutzer verglich das Geräusch mit dem ständigen Surren eines Ventilators, während Tech-Journalist Max Jambor es als hochfrequentes Knacken beschrieb.

Die betroffenen Geräte zeigen dabei unterschiedliche Muster: Bei manchen tritt das Problem nur auf einer Seite auf, bei anderen sind beide Ohrstöpsel betroffen. Auch die Lautstärke des Geräuschs variiert. Doch fast alle Betroffenen beschreiben es als deutlich wahrnehmbar und mitunter ziemlich störend.

Viele Betroffene vermuten, dass die Störgeräusche auftreten, wenn der ANC- oder der adaptive Modus in besonders ruhigen Umgebungen aktiviert ist. Andere berichten jedoch, dass das Problem auch im Transparenzmodus bestehen bleibt.

Noch kein Fix für die Geräuschprobleme der AirPods Pro 3

Einige stört das Rauschen kaum – sie überdecken es einfach, indem sie Musik oder Videos abspielen. Als kurzfristige Lösung hilft offenbar, den ANC oder den adaptiven Modus zu deaktivieren. In vielen Fällen verschwinden die störenden Geräusche dadurch.

Noch ist unklar, ob es sich um ein Software- oder ein Hardwareproblem handelt. Zahlreiche Nutzer:innen haben versucht, ihre AirPods Pro 3 zurückzusetzen oder die Ohrstöpsel auszutauschen – beides ohne Erfolg. Auffällig ist, dass das statische Geräusch sowohl unter der Firmware-Version 8A357 als auch 8A358 auftritt. Viele hoffen nun auf ein kommendes Update, das die Ursache endlich beseitigt.

Was genau hinter dem Problem steckt, bleibt bisher offen. Ob ein Produktionsfehler vorliegt, der sich per Software beheben lässt, oder ein dauerhafter Defekt, ist derzeit unklar.

Natürlich nahmen einige Besitzer bereits Kontakt zu Apple oder ihren Händlern auf. In manchen Fällen gab es Ersatzgeräte, doch auch dort trat das Problem teilweise erneut auf.

Von Apple selbst gibt es bislang noch keine offizielle Stellungnahme zum Ausmaß der Störung. Wer von Euch nutzt die AirPods Pro 3 und bemerkt ähnliche Geräusche? Dann gebt doch kurz Laut in den Kommentaren.

Apps & Mobile Entwicklung

Cherry Stream Desktop Ultimate: „Höchste Produktivität“ bei Maus & Tastatur für 200 Euro

Das Stream Desktop Ultimate ist ein Bundle aus Maus und Tastatur, das als „Präzisionsset“ „höchste Produktivität“ im Büro verspricht – für 200 Euro. Der hohe Preis bringt allerdings einige technische Extras mit sich – unter anderem mit einem Mausrad, dessen Feedback einstellbar ist.

Stream Keyboard Ultimate

Die Stream Desktop Ultimate tritt preislich in Konkurrenz zu luxuriösen Office-Tastaturen wie der Logitech Signature Slim Solar+ K980 (Test) für über 100 Euro Kaufpreis. Optisch unterscheidet sich die neue Tastatur kaum von anderen Stream-Modellen, was insbesondere die etwas kleineren F-Tasten und die darüber angeordneten, leicht ovalen Zusatztasten betrifft. Wie gehabt liegen vier Zusatztasten über dem Nummernblock. Kappen bestehen aus ABS-Kunststoff.

Auch die Ultimate-Version setzt auf Cherrys SX-Scherentaster, die die Tastenkappe stabilisiert. Dabei handelt es sich letztlich um gängige „Notebook-Taster“, die mit Hilfe einer Metallplatte in der Tastatur stabilisiert werden und leise Anschläge versprechen. Tasten werden allerdings weiß beleuchtet, rote Status-LEDs auf die entsprechenden Tasten gelegt. Zeittypisch ist zudem die Co-Pilot-Taste, die Microsofts KI-Tool öffnet.

Ungewöhnlich für die den SX-Tastern zugrunde liegende Leiterfolientechnik ist das Key-Rollover. Es liegt, ausgenommen Gaming-Tastaturen, eigentlich immer bei 2, Cherry hebt es auf 6 an und garantiert damit, dass sich mindestens sechs Tasten gleichzeitig betätigen lassen, ohne dass es zum Verschlucken von Eingaben kommt. Die Tastatur kann zudem in drei Winken (0°/4°/8°) angestellt werden.

Daten übertragen Maus und Tastatur entweder über zwei Bluetooth-5.2-Kanäle, mit Hilfe des beiliegenden 2,4-GHz-Funkempfängers oder über ein USB-C-auf-A-Kabel. Funkübertragungen werden im AES-128-Verfahren verschlüsselt. Die Akkulaufzeit der Tastatur soll maximal fünf Monate betragen.

Stream Mouse Ultimate

Bei der Stream Mouse Ultimate handelt es sich um eine 7-Tasten-Maus im Rechtshänder-Design mit einer Abtastrate von maximal 4.000 dpi, die in vier Stufen gewählt werden kann. Eine gummierte Daumenauflage mit 3D-Struktur soll für sicheren Halt sorgen. Besonderheit des Nagers ist sein „ProScroll“-Laufrad. Dieses lässt sich mit der Utility-Software feineinstellen. Mit Hilfe von sieben Parametern können unter anderem Zugkraft, Freilauf, Rasterwiderstand und eine optionale Blockierfunktion konfiguriert werden, um das Feedback zwischen glattem Freilauf und taktilem Feedback feineinzustellen.

Unsere revolutionäre Technologie ermöglicht es Ihnen, das Scrollverhalten individuell an Ihren Workflow anzupassen – egal ob Sie taktiles, flüssiges oder schnelles Scrollen bevorzugen. Das ergonomische Design und die 3D-Daumenablage liegen perfekt in der Hand. Ob Sie Daten durchsuchen, designen oder programmieren – jeder Scrollvorgang und jeder Klick ist auf maximale Effizienz ausgelegt.

Preis und Verfügbarkeit

Im Handel ist das Set noch nicht ab Lager verfügbar, wird aber bereits zur Preisempfehlung gelistet. Die liegt hoch: Maus und Tastatur kosten im Bundle aktuell rund 200 Euro, die Tastatur alleine knapp 120 Euro. Für die Stream Mouse Ultimate ruft Cherry einen Einzelpreis von gerundet 100 Euro auf, den der Einzelhandel bereits um knapp 10 Euro unterbietet. Verglichen mit Logitech-Sets wie dem

MK950 (Test) erscheint das viel verlangt – denn das kostet aktuell knapp 75 Euro für eine Kombination aus Maus und Tastatur.

Apps & Mobile Entwicklung

Walking Pad für unter 150 Euro

Manche Rabatte auf Amazon lassen nur noch staunen. Bestes Beispiel ist ein Walking Pad, das Ihr jetzt 80 Prozent günstiger bekommt. Ob sich der Deal lohnt oder es sich hier nur um einen Scheinrabatt handelt, verrät Euch nextpit in diesem Artikel.

Wer wie ich einen Job hat, bei dem man 40 Stunden in der Woche sitzt, sollte sich auf jeden Fall sportlich betätigen. Andernfalls besteht die Gefahr langfristiger Folgen. Ein gutes Mittel hierfür sind Walking Pads, also Laufbänder, die Ihr Euch unter den Schreibtisch stellen könnt. So müsst Ihr nicht mal rausgehen und könnt – je nach Job – Euch auch während der Arbeit etwas bewegen. Und genau solch ein Gerät bekommt Ihr bei Amazon aktuell 80 Prozent günstiger.

80 Prozent Rabatt: Was ist dran am Mega-Deal?

Normalerweise stehen für das Laufband der Marke Quekuane satte 699,99 Euro auf dem Preisschild. Ziehen wir jetzt den riesigen Rabatt ab, werden nur noch 139,99 Euro fällig. Bei einem solchen Preissturz machen viele sicherlich erst einmal große Augen. Ein Blick auf das Preisvergleichstool Keepa hingegen verrät, dass es diesen Deal schon häufiger gab. Das Walking Pad kostet zwar immer wieder 699,99 Euro, allerdings sinkt der Preis recht häufig auf den aktuellen Deal-Preis.

Zur Einordnung: Das macht dieses Angebot nicht schlecht. Es zeigt nur, dass Amazon hier etwas aufbauscht. Walking Pads kosten nicht selten 500 Euro oder sogar deutlich mehr. Allerdings gibt es im Netz auch andere Modelle für rund 200 Euro. Ein Laufband für zu Hause unter 150 Euro ist hingegen schon etwas schwerer zu finden, wodurch sich das aktuelle Angebot vor allem dann lohnt, wenn Ihr ein Laufband sucht, um Euren Büroalltag etwas sportlicher zu gestalten.

Quekuane Walking Pad: Die günstige Alternative?

Ihr sichert Euch bei diesem Deal ein faltbares Walking Pad, das mit einem 2-PS-Motor ausgestattet ist. Dadurch könnt Ihr maximale Geschwindigkeiten von bis zu 6 km/h erreichen, was einer guten Walkingsession entspricht. Habt Ihr also gehofft, mit dem Gerät für den nächsten 400-m-Sprint zu trainieren, könnte sich das etwas schwierig gestalten. Die Lauffläche misst 90 x 38 cm, wodurch das Walking Pad auch unter den meisten höhenverstellbaren Schreibtischen seinen Platz findet. Die maximale Traglast wird zudem mit 120 kg angegeben.

Möchtet Ihr lieber nach der Arbeit eine Runde laufen, könnt Ihr an den klappbaren Handläufen nach Halt suchen. Eine zusätzliche Smartphone-Halterung ermöglicht es Euch zudem, Eure Lieblingsserie während des Work-outs zu schauen. Eine Fernbedienung ist ebenfalls vorhanden, über die Ihr etwa eine Pausenfunktion nutzen könnt. Der Hersteller verspricht außerdem einen leisen Betrieb, was den Einsatz während der Arbeit erleichtert.

Über ein LED-Display bekommt Ihr permanent angezeigt, wie schnell Ihr seid, wie viele Kalorien Ihr verbraucht und welche Distanz Ihr schon zurückgelegt habt. Möchtet Ihr Euer Homeoffice also etwas spannender gestalten oder sucht einfach nur nach einem Weg, während der Arbeit einige Kalorien zu verbrennen, könnte das aktuelle Amazon-Angebot durchaus spannend für Euch sein.

Wie ist es bei Euch? Nutzt Ihr ein Walking Pad oder ist das nichts für Euch? Lasst es uns wissen!

Mit diesem Symbol kennzeichnen wir Partner-Links. Wenn du so einen Link oder Button anklickst oder darüber einkaufst, erhalten wir eine kleine Vergütung vom jeweiligen Website-Betreiber. Auf den Preis eines Kaufs hat das keine Auswirkung. Du hilfst uns aber, nextpit weiterhin kostenlos anbieten zu können. Vielen Dank!

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenDer ultimative Guide für eine unvergessliche Customer Experience

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenAdobe Firefly Boards › PAGE online

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenRelatable, relevant, viral? Wer heute auf Social Media zum Vorbild wird – und warum das für Marken (k)eine gute Nachricht ist

-

UX/UI & Webdesignvor 2 Wochen

UX/UI & Webdesignvor 2 WochenIllustrierte Reise nach New York City › PAGE online

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenPosit stellt Positron vor: Neue IDE für Data Science mit Python und R

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenEventSourcingDB 1.1 bietet flexiblere Konsistenzsteuerung und signierte Events

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenFake It Untlil You Make It? Trifft diese Kampagne den Nerv der Zeit? › PAGE online

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenGalaxy Tab S10 Lite: Günstiger Einstieg in Samsungs Premium-Tablets