Apps & Mobile Entwicklung

Auf diese neue Gratis-Funktion haben alle Nutzer lange gewartet

Spotify nutzen viele, trotz der zahlreichen Preiserhöhungen in der jüngeren Vergangenheit. Vor allem durch den Algorithmus gehören Playlists wie „Dein Mix der Woche“ zu den beliebtesten auf der Plattform.

Das Streaming-Unternehmen hat auf der Technologie- und Kulturkonferenz SXSW in Austin eine Beta-Funktion namens Taste Profile vorgestellt. Dahinter steckt ein einfaches Versprechen: Ihr bekommt endlich Einblick in das algorithmische Modell, das Eure Musikempfehlungen steuert, und könnt sie aktiv verändern.

Algorithmus steuern: So funktioniert Taste Profile

Spotify räumt mit dem Taste Profile endlich mit einem der größten Frustrationspunkte seiner Nutzer auf. Dabei handelt es sich um das persönliche Geschmacksprofil, das Spotify im Hintergrund für jeden Nutzer anlegt. Bislang arbeitete dieser Algorithmus unsichtbar: Er analysierte still und heimlich, was Ihr wann gehört habt, was Ihr übersprungen habt und zu welchen Tageszeiten Ihr bestimmte Musik auflegt. Aus all diesen Signalen baute Spotify ein Bild von Euch, das dann unter anderem die Playlists Discover Weekly und Made For You sowie das alljährliche Spotify Wrapped befeuert.

Das Problem dabei: Wer seinen Account mit anderen teilt, wer nachts Einschlafgeräusche hört oder wer auf dem Weg zur Arbeit mal schnell Kinderliedchen für die Kleinen abgespielt hat, landete mit all diesen Zufallshörern in einem Profil. Der Algorithmus wurde verwirrt, die Empfehlungen wurden schlechter und der Nutzer hatte keine Möglichkeit, das zu korrigieren. Zwar gab es bislang die Option, einzelne Songs oder Playlists aus dem Profil zu entfernen, doch das war aufwendig und wenig wirksam.

Mit dem Taste Profile ändert sich das grundlegend. Die neue Funktion fasst alle Hördaten aus Musik, Podcasts und Hörbüchern an einem zentralen Ort in der App zusammen. Nutzer können dort auf einen Blick sehen, welche Genres und Künstler Spotify mit ihnen verbindet, und dann direkt eingreifen. Das Besondere: Die Anpassungen funktionieren über natürlichsprachige Prompts, also ganz normale Textbefehle. Ihr könnt dem System zum Beispiel sagen, dass Ihr mehr energiereiche Tracks für das morgendliche Workout wollt oder dass Ihr Schlafgeräusche lieber aus Eurem Profil heraushalten möchtet.

So beeinflusst Ihr die KI künftig mit eigenen Worten

Was das Taste Profile von bisherigen Anpassungsoptionen unterscheidet, ist die Tiefe der Kontrolle. Spotify hat die Funktion so konzipiert, dass sie nicht nur kurzfristige Stimmungslagen berücksichtigt, sondern auch langfristige Gewohnheiten. Wer gerade für einen Marathon trainiert und täglich motivierende Beats braucht, kann das dem System mitteilen. Wer seinen täglichen Arbeitsweg mit Nachrichtenpodcasts verbringt, gibt das als Signal ein. Spotify passt die Startseite dann entsprechend an.

Taste Profile ist nicht allein: Spotify hatte bereits vor einigen Wochen das Feature Prompted Playlist eingeführt, mit dem man Playlists über Textbefehle generieren kann. Während Prompted Playlist etwas Neues erschafft, korrigiert das Taste Profile das, was bereits vorhanden ist. Im Endeffekt zeigen beide Funktionen zusammen, wohin die Reise beim Musikstreaming geht. Auch hier also mehr KI, mehr Personalisierung und mehr Nutzereinfluss.

Vorerst wird Taste Profile als Beta-Funktion ausschließlich für Premium-Abonnenten in Neuseeland ausgerollt. Einen konkreten Zeitplan für die globale Verfügbarkeit hat Spotify noch nicht genannt. Allerdings zeigt die Vergangenheit: Neuseeland diente bereits beim Prompted Playlist als erstes Testpflaster, bevor die Funktion rund einen Monat später in den USA, Kanada, Australien, Irland, Schweden und dem Vereinigten Königreich verfügbar wurde. Die Veröffentlichung in Deutschland könnt Ihr wie gewohnt im Anschluss erwarten.

Apps & Mobile Entwicklung

CPUs bleiben wichtig: Nvidia bietet reines Vera-CPU-Rack mit 256 Prozessoren an

Agentic AI und Reinforcement Learning benötigen schnelle CPUs, erklärt Nvidia zur GTC. Deshalb bietet das Unternehmen seine neue Vera-CPU jetzt auch in einem Rack ausschließlich mit CPUs an. Es reiht sich damit neben der Vera-Rubin- und der neuen LPU/LPX-Lösung ein. Partner gehen dabei noch weiter als Nvidia selbst mit 256 CPUs.

Vera hat 88 Custom-Arm-Kerne mit SMT für 176 Threads

Vera ist Nvidias neue Custom-Arm-CPU und bildet den CPU-Teil der neuen Vera-Rubin-Plattform, die in der zweiten Jahreshälfte 2026 an den Start gehen soll. Nvidia hatte Vera erstmals zur Computex 2024 benannt, zudem sind seit der letztjährigen GTC erste technische Details bekannt. Vera bietet 88 Custom-Arm-Kerne mit SMT für 176 Threads und wird mittels NVLink-C2C-Interconnect mit 1,8 TB/s an Rubin angebunden.

Zur diesjährigen GTC zeigt Nvidia die Vera-CPU allerdings auch als Einzellösung im Rack – ohne Rubin-GPU. Datacenter-Installationen lassen sich damit um mehr Prozessoren erweitern, als sie die Vera-Rubin-Plattform in der CPU-GPU-Kombination alleine mitbringt. Zur Erinnerung: Im „Oberon“ getauften Rack von Vera Rubin (VR NVL72) kommen 18 Compute Trays mit jeweils zwei Boards zum Einsatz, wobei auf jedem Board zwei Rubin-GPUs und eine Vera-CPU verbaut sind, also vier GPUs und zwei CPUs pro Tray für insgesamt 72 GPUs (mit 144 Dies) und 36 CPUs pro Rack.

Warum schnelle CPUs auch bei KI wichtig sind

Schnelle CPUs können im Zeitalter von Agentic AI und Reinforcement Learning von hoher Bedeutung im KI-Rechenzentrum sein. Reinforcement Learning ist ein Verfahren aus dem Machine Learning, bei dem ein KI-System durch Ausprobieren und Feedback lernt. Ein Agent führt Aktionen in einer Umgebung aus und erhält dafür Belohnungen oder Strafen. Durch viele Wiederholungen lernt das System, welche Entscheidungen langfristig die beste Belohnung bringen, und verbessert so schrittweise seine Strategie.

Nvidia sieht eine Architektur für das Reinforcement-Learning-Training von KI-Agenten vor, bei der GPUs und CPUs unterschiedliche Aufgaben übernehmen. Ein großer GPU-Cluster führt das Training und Inference des Modells durch. Das Modell erzeugt dabei Tokens – z. B. Code, Befehle oder Abfragen. Eine Sandbox-Infrastruktur mit CPU-Kernen führt diese erzeugten Tokens tatsächlich aus, z. B. SQL-Abfragen, Code kompilieren, Python-Programme laufen lassen. Die CPUs liefern die Ergebnisse und Daten zurück, die als Bewertung (Evaluation/Reward) für das Training dienen. Damit wird Reinforcement Learning umgesetzt: Das Modell probiert Aktionen aus (Code schreiben), sieht das Ergebnis der Ausführung und lernt daraus, bessere Lösungen zu erzeugen.

Olympus-Kern mit „world-class“ Single-Thread-Leistung

Zur GTC hat sich Nvidia erstmals auch zur Mikroarchitektur von Vera geäußert und dabei erklärt, was die Custom-Arm-Kerne auszeichnet. Die eigens entwickelten Kerne laufen demnach unter der Bezeichnung „Olympus“ und sollen eine „world-class“ Single-Thread-Leistung erreichen. Vera biete die 1,5-fache IPC von Grace, erklärte Nvidia in San Jose zur Hausmesse für KI-Entwickler.

Olympus bietet ein „10-wide instruction decode“, kann demnach bis zu 10 Instruktionen pro Takt dekodieren und an die Ausführungseinheiten weiterreichen. Die Mikroarchitektur bietet einen Neural Branch Predictor, also eine neue Art der Sprungvorhersage, bei der ein kleines neuronales Modell verwendet wird, das Muster in früheren Programmverläufen erkennt und dadurch oft genauere Vorhersagen trifft als klassische Tabellen- oder Heuristik-basierte Verfahren. Dadurch werden Pipeline-Stalls im Idealfall reduziert und die CPU kann effizienter arbeiten. Zwei Sprungvorhersage pro Taktzyklus sind bei Olympus möglich. Außerdem kommt bei der CPU ein für PyTorch optimierter Instruction-Buffer zum Einsatz.

Mehr Speicherbandbreite als x86-Prozessoren

Eine weitere Eigenschaften von Vera ist die laut Nvidia dreifache Speicherbandbreite pro Kern im Vergleich zu – namentlich nicht genannten – x86-Prozessoren. Das Unternehmen gibt insgesamt 1,2 TB/s für die 1,5 TB SOCAMM-LPDDR5X an, die jeder CPU zur Seite stehen. Pro Kern ist von bis zu 80 GB/s die Rede. Die CPUs bieten einen NVLink GPU Connect mit 1,8 TB/s sowie einen CPU-Chip-zu-Chip-Support für 2P-Lösungen.

Vera-CPU-Rack mit 256 Prozessoren

Nvidia selbst zeigt zur GTC ein neues Vera-CPU-only-Rack mit insgesamt 256 Vera-CPUs (22.528 Kerne mit 45.056 Threads), 400 TB SOCAMM-LPDDR5X für insgesamt 300 TB/s und 64 BlueField-4 DPUs. Vera-Racks setzen auf dieselbe MGX-Architektur zur Flüssigkeitskühlung wie die Vera-Rubin-Plattform.

Die Partner gehen noch weiter

Vera sei in voller Produktion, sagt Nvidia, und soll im Laufe des zweiten Halbjahres 2026 von zahlreichen namhaften Server-Partnern verfügbar sein. Einer davon ist HPE, der mit seinem GX5000 Rack weit über die Lösung von Nvidia hinausgeht. Bis zu 40 Blades mit jeweils 8 Nodes mit jeweils 2 Vera-CPUs (16 CPUs pro Blade) sind bei HPE möglich, sodass in einem Rack bis zu 640 CPUs mit 56.320 Olympus-Kernen zum Einsatz kommen.

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA im Vorfeld und im Rahmen einer Veranstaltung des Herstellers in San Jose, Kalifornien erhalten. Die Kosten für An-, Abreise und fünf Hotelübernachtungen wurden vom Unternehmen getragen. Eine Einflussnahme des Herstellers oder eine Verpflichtung zur Berichterstattung bestand nicht. Die einzige Vorgabe aus dem NDA war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

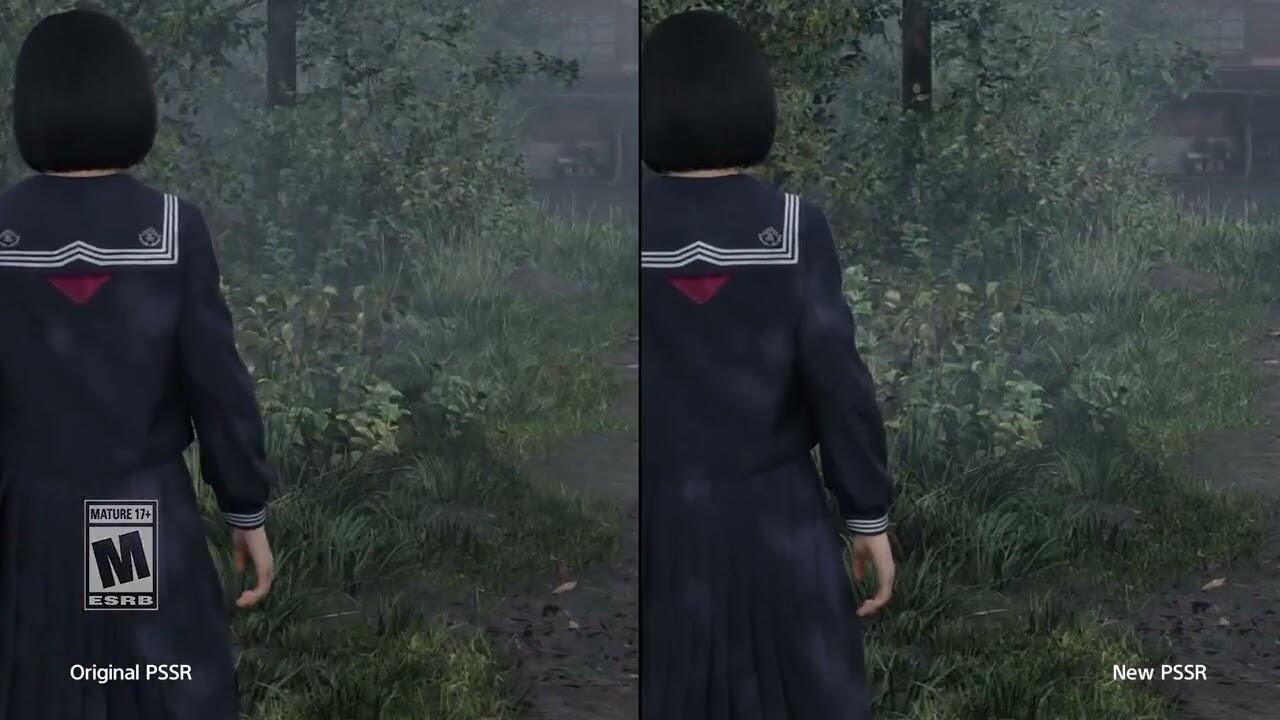

Systemsoftware-Update: Das neue PSSR („FSR 4“) für die PlayStation 5 Pro ist da

Sony hat das angekündigte Systemsoftware-Update für die PlayStation 5 Pro freigegeben, das in kompatiblen Spielen das neue PSSR-Upscaling, das FSR 4 nahesteht, möglich macht. Ab sofort nutzen können es zwölf Spiele, drei weitere kommen in Kürze dazu; darunter Crimson Desert zum Launch am 19. März und Cyberpunk 2077 per Patch.

Seit 18 Uhr wird das Update ausgerollt

Ganz ohne Software-Update hatte das neue PSSR bereits vor gut zwei Wochen seine Premiere in Resident Evil Requiem gefeiert. Nach dem heute bereitgestellten Software-Update, das seit heute 18 Uhr in Wellen ausgerollt werden wird, lässt es sich über die Systemeinstellungen in allen Spielen, die dafür vorbereitet sind, nutzen.

Die aktualisierte PSSR-Technologie ist vollständig in das neue PS5-Systemsoftware-Update integriert, das schrittweise ab 16. März (10 Uhr Pazifische Zeit) eingeführt wird. Das Update wird im Laufe der kommenden Tage nach und nach für alle Benutzer verfügbar gemacht. Über die PS5-Systemeinstellungen kann das Update auch manuell gesucht und installiert werden.

Diese Spiele sind zum aktualisierten PSSR kompatibel

Die folgenden Spiele können das aktualisierte PSSR auf der PlayStation 5 Pro ab dem Software-Update nutzen, oder erhalten in Kürze einen Patch:

- Resident Evil Reqiuem

- Silent Hill f

- Silent Hill 2

- Monster Hunter Wilds

- Dragon’s Dogma 2

- Dragon Age: The Veilguard

- Nioh 3

- Rise of the Ronin

- Final Fantasy VII Rebirth

- Senua’s Saga: Hellblade II

- Control

- Alan Wake 2

- Crimson Desert (zum Launch am 19. März)

- Cyberpunk 2077 (bald per Update)

- Assassin’s Creed Shadows (bald per Update)

Entwickelt zusammen mit AMD

Die aktualisierte Version von PSSR, die keinen eigenen Namen erhalten hat, wurde von Sony zusammen mit AMD entwickelt und soll die Fortschritte, die FSR 4 gegenüber der ersten Version von PSSR gezeigt hat, auf die PlayStation 5 Pro holen. Beide Partner machen sich dabei zunutze, dass die Grafikeinheit der PlayStation 5 Pro zwar auf RDNA-3-Shader setzt, aber bereits um KI-Funktionen von RDNA 4 erweitert worden war.

Apps & Mobile Entwicklung

Mit diesem Update hat niemand gerechnet

Apple hat überraschend ein neues Modell seiner beliebten AirPods angekündigt. Während sich am Äußeren nur wenig ändert, bringt das Update der Kopfhörer eine Reihe von Features, die dem bisherigen Modell gefehlt haben.

Die AirPod-Familie ist nicht nur bei Apple-Nutzern beliebt. Jetzt gibt es ein überraschendes Update bei einem Modell, mit dem aber selbst in der Apple-Welt kaum jemand gerechnet hat. Während den meisten Nutzern vor allem die In-Ear-Kopfhörer bekannt sind, gibt es auch noch die AirPods Max. Diese Over-Ear-Modelle befinden sich am oberen Ende der Preisskala. Das ändert sich auch bei der nun vorgestellten Variante nicht. Im Gegensatz zum Minimal-Update im September 2024, das den Kopfhörern vor allem einen USB-C-Anschluss spendierte, gibt es aber nun endlich eine Reihe neuer Features.

AirPods Max 2: Modellpflege à la Apple

Im Inneren der neuen AirPods Max 2 arbeitet Apples eigener H2-Chip, der bereits seit einiger Zeit in den AirPods Pro zum Einsatz kommt. Dieser Chip ist auch verantwortlich für die neuen und verbesserten Funktionen der Over-Ear-Kopfhörer. So verspricht das Unternehmen etwa eine „1,5-mal effektivere“ aktive Geräuschunterdrückung (ANC). Das bedeutet, dass störende Umgebungsgeräusche, zum Beispiel im Flugzeug oder in der Bahn, stärker reduziert werden können.

Neu hinzugekommen ist außerdem das seit den AirPods Pro 2 bekannte „Adaptive Audio“. Dabei reagieren die Kopfhörer automatisch auf Umgebungsgeräusche und reduzieren diese gezielt. Das neue Feature arbeitet auch zusammen mit der Konversationserkennung, die dem Vorgänger ebenfalls fehlte. Wie beim Vorgänger erfolgt die Verbindung mit dem Smartphone oder Laptop jedoch entweder via Bluetooth oder USB-C. Letzteres dient auch zum Laden der Kopfhörer.

Selbstverständlich verspricht Apple einen verbesserten Klang. Der iPhone-Hersteller spricht auch von „Audioaufnahmen in Studioqualität“. Dank verringerter Latenz sollen die Kopfhörer zudem besser für Spiele geeignet sein.

Ein weiteres Feature, welches den alten Over-Ear-Kopfhörern fehlte, ist die Live-Übersetzung. Diese ist mit den AirPods Max 2 ebenfalls ab sofort möglich und erlaubt Euch Unterhaltungen ohne Sprachbarrieren. Die ebenfalls neue Stimmisolation soll bei Telefonaten oder FaceTime-Anrufen dem Gegenüber darüber hinaus eine bessere Qualität Eurer Stimme übermitteln. Dabei werden Umgebungsgeräusche in Eurer Nähe unterdrückt, während Eure Stimme priorisiert wird.

Wie bei den AirPods Pro erkennen die Max 2 Eure Kopfbewegungen. Damit könnt Ihr auf Siri-Anfragen antworten, indem Ihr mit Eurem Kopf leicht nickt oder Euren Kopf schüttelt. Die Digital Crown kann jetzt außerdem als Kamerafernbedienung zur Aufnahme von Fotos genutzt werden.

Keine Änderungen am Zubehör und Akkulaufzeit

Während die internen Komponenten und Features damit in vielen Details auf den Stand der AirPods Pro gebracht werden, sind einige Kritikpunkte auch bei den AirPods Max 2 weiterhin gültig. So gibt es keine neue Hülle. Der altbekannte „Schutz“ ist weiterhin verbesserungswürdig, da viele Teile der Kopfhörer ungeschützt bleiben. Im geschlossenen Zustand sind die Over-Ear-Modelle ebenfalls noch recht groß, ein kompakteres Zusammenfalten erlaubt Apple nicht.

Die Akkulaufzeit der AirPods Max 2 gibt Apple mit bis zu 20 Stunden mit aktiver Geräuschunterdrückung an. Die neuen Kopfhörer sind in den Farben Blau, Violett, Mitternacht, Polarstern und Orange verfügbar. Sie können ab dem 25. März zum Preis von 579 Euro vorbestellt werden. Die Auslieferung beginnt Anfang April. Ein genaueres Datum nannte Apple bislang nicht.

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 2 Wochen

Social Mediavor 2 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 4 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenÜber 220 m³ Fläche: Neuer Satellit von AST SpaceMobile ist noch größer