Online Marketing & SEO

Darum siehst du bald Werbung auf Threads

Ads auf Threads kommen weltweit und bieten mehr Spielraum für Meta Marketing. User werden mit Werbung konfrontiert, können denn Ads aber auch entsagen.

Neuer CEO, endlich eigene DMs, über 400 Millionen User und umfassende Advertising-Lösungen: Metas X-Konkurrenz Threads entwickelt sich immer weiter und wird parallel für Creator, Brand und User sowie Werbetreibende interessanter. In diesem Kontext gibt es jetzt eine große Ankündigung von Meta. Die Anfang 2025 eingeführten Ads werden weltweit ausgerollt.

Threads Ads werden zum Alltag:

Jetzt noch einfacher ausspielen

Threads User aufgepasst: Ads kommen überall

Meta kündigt an, dass die Werbeoptionen in alle Märkte kommen. Advertiser haben damit die Option, Metas jüngste Social-Media-Plattform für die bezahlte Verbreitung ihrer Botschaften zu nutzen.

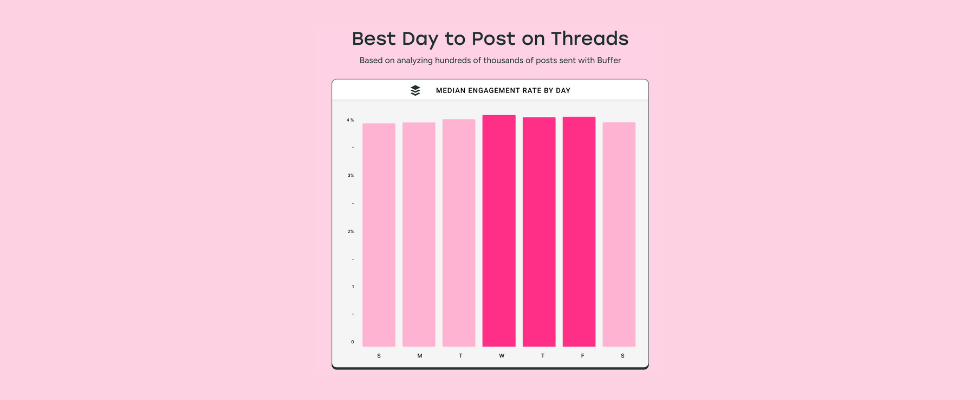

Wer organisch auf Threads postet, kann sich an den Top-Posting-Zeiten für die Plattform orientieren.

Die besten Posting-Zeiten für Threads

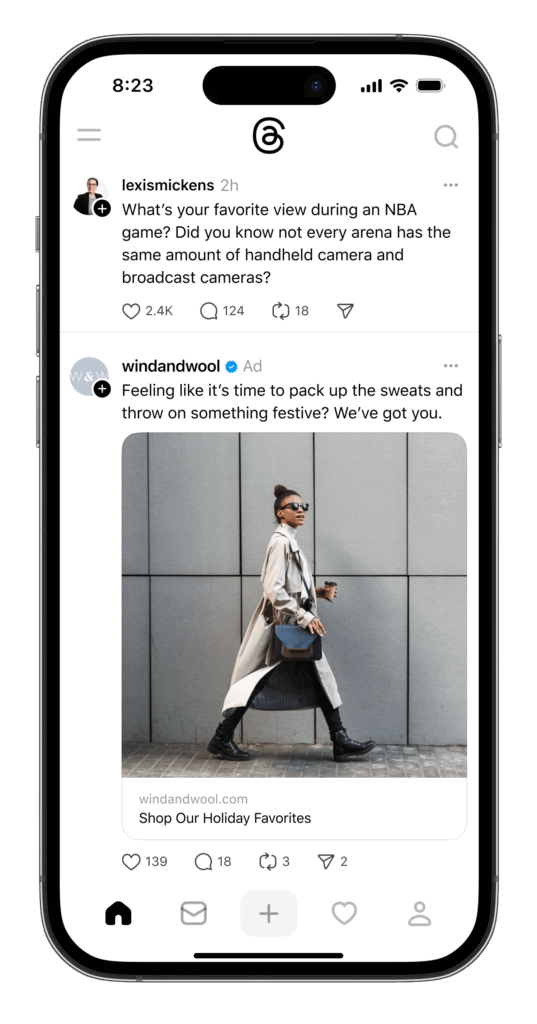

Anzeigen auf Threads wurden schon Frühjahr 2025 in ausgewählten Märkten angekündigt. Im nächsten Monat beginnt Meta aber damit, sie weltweit einzuführen. Nutzer:innen werden werden dann überall Werbung ausgespielt bekommen. Meta schreibt, dass das nur nach Zustimmung passiert, was wie ein Ausweg für die User erscheint. Wer aber auf Ads verzichten möchte, muss alternativ Metas kostenpflichtiges Abonnement ohne Werbung nutzen.

Die erweiterte Einführung der Anzeigen auf Threads wird schrittweise erfolgen, sodass die Ads in den kommenden Monaten global verfügbar gemacht werden. Zu diesem Prozess teilte Meta einige Kernentwicklungen und erklärte, dass Unternehmen ihre bestehenden Werbekampagnen über die Apps von Meta einfach auf Threads ausweiten und so die für sie wichtigsten Zielgruppen an noch mehr Orten erreichen können. Der Threads Feed für Anzeigenplatzierungen wird standardmäßig automatisch ausgewählt, wenn Advertiser Advantage+-Platzierungen nutzen.

Wer Threads Ads schaltet, kann über die Insights API die Performance analysieren. Du musst jedoch vorab einige wichtige Punkte beachten, um überhaupt Werbung auf der Social-Media-Plattform schalten zu können. Zentral ist, dass Advertiser einen eigenen Threads Account benötigen. Im Developer-Kontext benötigen die API User zudem die Erlaubnis des sogenannten App Users, um Informationen und Medien von mit Instagram verbundenen Threads Account verarbeiten zu dürfen. Dann können Partner:innen die zugehörige Threads User ID einholen. Ebenfalls wichtig zu beachten ist die Tatsache, dass die neuen Threads Feed Ads eine neue Werbeplatzierung darstellen, die noch nicht als Standalone gilt. Das heißt, Advertiser können nur die Platzierungsgruppe wählen und müssen die Ads gleichsam auch für den Instagram Feed freigeben.

Unterstützt werden aktuell Einzelbilder im Format 9:16 und 16:9 sowie Videos und Carousels. Große Formate werden auf das Standardformat 1:1 zurechtgeschnitten und eine Personalisierung der Assets wird in diesem Kontext vorerst nicht gewährleistet. Eine umfassende Developer-Dokumentation für Threads-Werbeanzeigen liefert dir noch mehr Details von Meta. Und in unseren ausführlichen Beiträgen über Threads Ads, die inzwischen auch schon Videowerbung ermöglichen, kannst du noch mehr über die Möglichkeiten erfahren.

Hier hat Threads X überholt:

Daten zeigen Power Shift

Online Marketing & SEO

Meta stellt Vibes als KI-Video-Editor bereit

Erste Creator können Metas Vibes bereits als Editing Tool im Web nutzen, um KI-Videos zu kreieren und ganze Projekte zu bearbeiten.

Erst im Herbst 2025 erreichte Metas KI-Video-Feed Deutschland. Was als dedizierter Bereich zur Integration und Rezeption von KI-generierten Inhalten für den Meta-Kosmos gestartet war, entpuppte sich schon bald darauf als Nährboden für eine umfassende KI-Kreation von Visuals. Passend dazu hat der Tech-Konzern bereits einen Test für eine Standalone App gestartet. Und jetzt ist Vibes sogar als vielschichtiger Editor für KI-Videoinhalte aktiv. Diese Inhalte können Creator dank Vibes als Sora- oder Google Flow-Konkurrenz im Handumdrehen kreieren und bearbeiten, ehe sie im Vibes Feed, auf Instagram oder Facebook geteilt werden.

Vibes oder AI Slop?

Metas KI-Feed bald als App

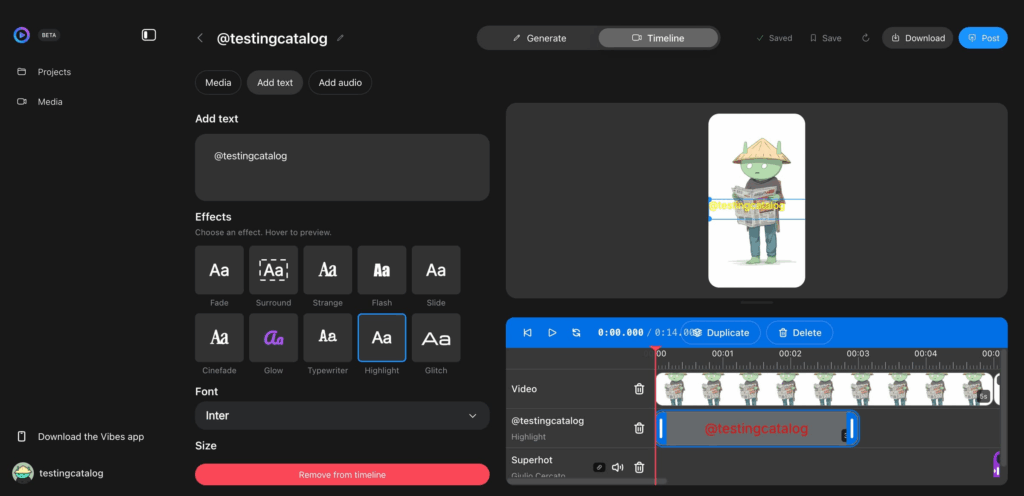

Nützlich für Creator und Marketer: Vibes mit diversen Kreations-Templates im Editor

Der Publisher TestingCatalog berichtet von der Verfügbarkeit von Vibes als Editor. Im Beitrag erwähnt Alexey Shabanov, dass die Version derzeit im Web für einige User bereitsteht, aber noch nicht für alle.

Dabei wandelt sich Vibes von der reinen Rezeptionsumgebung mit grundlegenden Kreationsfunktionen zur dedizierten Editing-Option. So könnte Vibes künftig mit Tools wie Veo 3.1 oder sogar Flow von Google, aber auch Sora von OpenAI oder Adobes Firefly konkurrieren. Laut TestingCatalog können User inzwischen schon ganze Projekte bearbeiten und beispielsweise ausgehend von Prompts für die Visuals mit Charakteren und verschiedenen Styles, mit unterschiedlichen Formaten, Musikhintergründen, Lip Sync und der Sprachauswahl sowie Image-to-Video-Kreation arbeiten.

Zusätzlich ermöglicht die Timeline-Bearbeitung Anpassungen für Sound und Videoebene im gleichen Workspace. Verschiedene Effekte und Schriftarten lassen sich ebenfalls einfügen. Darüber hinaus sollen noch deutlich mehr Optionen integriert werden. Shabanov berichtet von einem Media Tab, Style- und Charakterbibliotheken, Textkontrollen für die Timeline und Moodboards, die derzeit in der Entwicklung sind.

Während Meta Vibes also Stück für Stück zu einem nützlichen Editor ausbaut, gibt es noch einige Einschränkungen, die die Konkurrenzfähigkeit begrenzen. Zum einen haben noch nicht alle User Zugriff auf die Kreationsumgebung. Zum anderen lassen einige der Ergebnisse nach Ansicht von Alexey Shabanov noch zu wünschen übrig, können zumindest dem Anspruch im Rahmen der Tool-Vielfalt nicht immer gerecht werden. Shabanov schreibt:

[…] The main limitation at present is output quality: while the tooling appears mature, the generated results do not consistently meet the interface’s ambitious standards.

Teil einer großen Video- und Editing-Offensive Metas

Vibes soll Metas Editing Tools um eine weitere, besonders auf AI Content ausgerichtete, Variante erweitern. Story und Reel Content können Creator beispielsweise bereits mit dem Restyle Feature mithilfe der Meta AI bearbeiten. Diese Option ist nicht nur via Meta AI, sondern auch in der Edits App verfügbar. Edits ist Metas große CapCut-Konkurrenz, die seit rund einem Jahr auf dem Markt ist. Inzwischen bietet Edits eine Vielzahl an Bearbeitungsoptionen und ist gerade für Instagram Creator zu einer relevanten Editieroption avanciert.

Vibes weist als Editing-Umgebung bereits Parallelen zu Edits auf und könnte Meta im AI-Zeitalter noch mehr Zulauf bei der Videokreation und -bearbeitung bieten. Immerhin eignen sich die eigenen Lösungen für einen Workflow all jener Marketer und Creator, die anschließend ihre Inhalte im Meta-Kosmos auf Facebook, Instagram oder auch Vibes verbreiten und damit potentiell für Millionen oder gar Milliarden von Menschen ausspielen.

Ghostface erobert Metas KI-Feed Vibes:

So wirst du wirst Teil von Scream 7

Online Marketing & SEO

Rückblick auf Werbeklassiker: Die bemerkenswerte Evolution der Zielgruppe Frau in der Werbung

2004 startete Dove seine Real-Beauty-Initiative – heute gilt sie als Pionier unter den Haltungskampagnen

Über Sinn und Unsinn von Diversität im Marketing wird immer wieder gerne diskutiert. Gerade der Umgang der Werbebranche mit Frauen als Zielgruppe zeigt, wie wichtig das Thema immer noch ist. Kurz nach dem Weltfrauentag blicken wir zurück auf die Entwicklung von sexistischen Kampagnen hin zu einem modernen Frauenbild.

Es ist ein etabliertes Ritual der Branche: Alle sechs Monate berichtet der Deutsche Werberat über die eingegangenen Beschwerden gegen Werbekampag

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

Online Marketing & SEO

KI enttarnt anonyme Accounts: Diese Spuren verraten dich

Anonym im Netz? Eine aktuelle Studie zeigt, dass große Sprachmodelle (LLMs) Accounts unter Pseudonym immer häufiger den dahinterstehenden Personen zuordnen können. Schon Schreibstil, Interessen oder kleine Details können Profile enttarnen – mit Risiken für Privatsphäre und Whistleblower.

Ein Reddit-Alt, ein anonymer LinkedIn-Kommentar oder ein pseudonymer Thread auf Hacker News galten lange als vergleichsweise sichere Wege, unerkannt im Netz zu agieren. Doch die Studie Large-scale online deanonymization with LLM agents, an der unter anderem Forschende der ETH Zürich und der University of Washington beteiligt waren, zeigt, wie leistungsfähig große Sprachmodelle inzwischen bei der Zuordnung pseudonymer Accounts werden.

Wer also noch glaubt, dank eines Nicknames wirklich anonym zu bleiben, könnte sich täuschen. Denn was Menschen beim Lesen oft übersehen, kann KI inzwischen systematisch erkennen: Muster in Sprache, Interessen oder biografischen Details lassen sich automatisiert analysieren und über Plattformen hinweg miteinander verknüpfen. Über die Analyse berichten unter anderem The Verge und The Guardian. In der Studie untersuchten die Forschenden, wie LLM-Agents öffentlich verfügbare Informationen auswerten und Profile plattformübergreifend miteinander abgleichen können. Die Forschung wurde von der ETH Zürich geleitet, wo auch die zentralen Experimente durchgeführt wurden. Der KI-Sicherheitsforscher Nicholas Carlini von Anthropic unterstützte das Team zusätzlich als wissenschaftlicher Berater.

OpenAI erreicht neues User- und Abo-Hoch:

Stoppt CancelChatGPT den Höhenflug?

Dein Schreibstil ist dein digitaler Fingerabdruck

Die Untersuchung zeigt, dass zur Identifizierung weder Hacks noch Datenlecks nötig sind. Oft reichen bereits Informationen, die Nutzer:innen selbst veröffentlichen. Die in der Studie eingesetzten LLMs analysieren Texte aus anonymen Accounts und suchen im Netz nach wiederkehrenden Mustern. Dabei erkennen sie typische Signale, die Rückschlüsse auf eine Person zulassen können, etwa:

- Schreibstil

- Wortwahl und Satzstruktur

- Interessen und Fachbegriffe

- biografische Hinweise aus Posts

Diese Informationen werden anschließend mit Profilen auf anderen Plattformen abgeglichen. Ziel ist es, mögliche Identitäten hinter pseudonymen Accounts zu identifizieren. Die Ergebnisse sind bemerkenswert. In Tests konnte das System Accounts mit einer Trefferquote von 68 Prozent bei 90 Prozent Präzision den dahinterstehenden Personen zuordnen. Grundlage waren Datensätze aus Plattformen wie Reddit, Hacker News und LinkedIn sowie Interview-Transkripte.

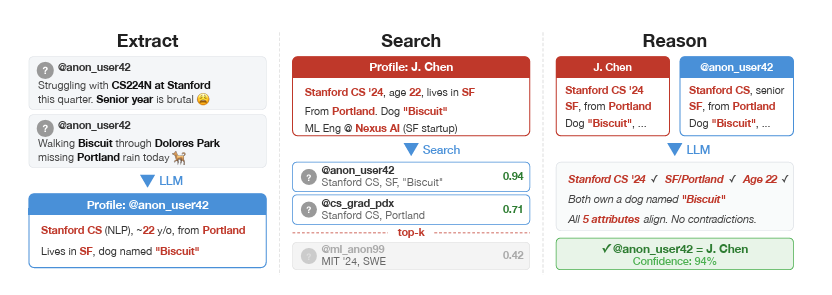

Ein Beispiel aus der Studie zeigt, wie die Methode funktioniert. Ein anonymes Konto berichtet etwa über schulische Schwierigkeiten und erwähnt Spaziergänge mit seinem Hund Biscuit im Dolores Park. Die KI durchsucht anschließend andere Plattformen nach Profilen mit ähnlichen Details und konnte so den anonymen Account @anon_user42 zuordnen. Voraussetzung dafür ist jedoch, dass irgendwo im Netz öffentliche Informationen existieren, etwa ein Profil mit Klarnamen, persönliche Posts oder andere Hinweise, die eine Verbindung ermöglichen. Erst durch solche übereinstimmenden Details kann die KI mehrere Profile derselben Person miteinander verknüpfen. Je mehr Inhalte ein anonymer Account veröffentlicht, desto leichter lässt er sich enttarnen.

Wer heute im Netz anonym bleiben möchte, müsste seine Accounts deshalb deutlich stärker voneinander trennen. Mögliche Gegenmaßnahmen wären etwa:

- bewusst unterschiedliche Schreibstile verwenden

- unterschiedliche Accounts konsequent voneinander trennen

- keine biografischen Details teilen

- wiederkehrende Interessen oder Themen nicht plattformübergreifend posten

- keine spezifischen Ortsangaben oder persönlichen Routinen erwähnen

- unterschiedliche Nutzungszeiten oder Aktivitätsmuster verwenden

- keine identischen Emojis, Formulierungen oder Redewendungen nutzen

Große Sprachmodelle können solche Analysen erstmals kostengünstig skalieren. Was früher Stunden oder sogar Tage manueller Recherche erforderte, lässt sich heute automatisiert durchführen. Gleichzeitig bleiben die Kosten niedrig. Laut der Studie kann eine Analyse lediglich ein bis vier US-Dollar pro Profil kosten. Die KI-Forscher Simon Lermen und Daniel Paleka erklärten, dass LLMs damit „eine grundlegende Neubewertung dessen erzwingen könnten, was im Internet noch als privat gilt“.

Die Risiken der KI-Deanonymisierung: Betrug, Fehlzuordnungen und Druck auf Whistleblower

Die KI-gestützte Überwachung entwickelt sich zu einem schnell wachsenden Forschungsfeld, das bei Informatiker:innen und Datenschutzexpert:innen zunehmend Besorgnis auslöst. Große Sprachmodelle können enorme Mengen öffentlich zugänglicher Informationen über Personen sammeln und miteinander verknüpfen. Für Menschen wäre eine solche Analyse kaum zu bewältigen, für KI lässt sie sich dagegen automatisieren und in großem Maßstab durchführen. Noch handelt es sich allerdings nicht um ein perfektes Überwachungssystem. Die Experimente wurden mit kuratierten Datensätzen durchgeführt, das zugrunde liegende Paper ist bislang nicht peer-reviewed und die Methode wurde nicht mit realen anonymen Accounts im offenen Internet getestet.

Potenzielle Vorteile solcher Technologien liegen vor allem im Bereich der Analyse und Moderation digitaler Kommunikation. KI-Systeme könnten etwa helfen, koordinierte Desinformationskampagnen aufzudecken, Bot-Netzwerke zu identifizieren oder orchestrierte Einflussversuche schneller zu erkennen. Gerade für Plattformen, die mit Manipulation, Fake Accounts oder organisierten Kampagnen kämpfen, könnte eine solche Analyse ein nützliches Werkzeug sein.

Der KI-Forscher Simon Lermen weist jedoch darauf hin, dass öffentlich zugängliche Informationen über Bürger:innen bereits heute „direkt für Betrug missbraucht werden“ könnten. Ein Beispiel ist Spear Phishing. Dabei sammeln Angreifer:innen gezielt Informationen über eine Person – etwa aus Social-Media-Profilen, Kommentaren oder Forenbeiträgen – und nutzen diese, um besonders glaubwürdige Betrugsnachrichten zu erstellen. Die Nachricht wirkt dann so, als käme sie von einer vertrauten Person oder einem bekannten Unternehmen und enthält häufig einen Link oder eine Bitte um persönliche Daten. Durch KI wird dieser Betrugsprozess deutlich einfacher. Große Sprachmodelle können Informationen über eine Person automatisch zusammentragen und daraus personalisierte Nachrichten formulieren.

Ein weiteres Risiko sind mögliche Fehlzuordnungen. Der Informatikprofessor Peter Bentley vom University College London warnt, dass KI-Systeme Accounts auch falsch miteinander verknüpfen könnten. Im schlimmsten Fall könnten Menschen dadurch für Aussagen verantwortlich gemacht werden, die sie nie getätigt haben.

Besonders kritisch ist die Entwicklung zudem für Menschen, die bewusst unter Pseudonym kommunizieren. Dazu zählen etwa Aktivist:innen, Journalist:innen oder Mitarbeitende, die Missstände anonym öffentlich machen wollen. Wenn sich solche Accounts durch KI leichter einer realen Person zuordnen lassen, könnten Betroffene schneller identifiziert und unter Druck gesetzt werden, etwa durch Belästigung im Netz, berufliche Konsequenzen oder rechtliche Schritte.

Wie sieht die Zukunft der Online-Anonymität im KI-Zeitalter aus?

Online-Anonymität verschwindet durch solche Technologien nicht sofort. Sie wird jedoch deutlich fragiler. Wer über verschiedene Plattformen hinweg ähnliche Interessen, Geschichten oder Schreibweisen teilt, hinterlässt einen digitalen Fingerabdruck. Genau diese digitalen Spuren können große Sprachmodelle heute schneller erkennen, analysieren und miteinander verknüpfen als Menschen.

Das hat zwei Seiten. Einerseits könnten solche Systeme Plattformen dabei helfen, Manipulation im Netz besser zu erkennen. Probleme wie Hate Speech, Bot-Netzwerke oder koordinierte Desinformation beschäftigen Social-Media-Dienste seit Jahren. Besonders schwer zu kontrollieren sind sogenannte Sockpuppet Accounts, also mehrere Profile, die von einer Person gesteuert werden, um Diskussionen gezielt zu beeinflussen oder künstlich Reichweite zu erzeugen. Wenn Systeme Schreibmuster, Inhalte und biografische Hinweise analysieren, lassen sich möglicherweise orchestrierte Debatten, Astroturfing-Kampagnen oder koordinierte Einflussversuche schneller identifizieren. Gerade für Community-Plattformen und Diskussionsnetzwerke wie Reddit, X, Threads oder Discord wäre das relevant.

Gleichzeitig zeigt die Forschung, wie leicht sich digitale Spuren im Netz zusammenführen lassen – und wie schnell sie für Betrug missbraucht oder für Datenschutzangriffe eingesetzt werden könnten. Mit immer leistungsfähigeren KI-Systemen wird Online-Anonymität zunehmend brüchiger. In Zukunft dürfte sie weniger eine Frage des Nicknames sein, sondern vielmehr davon abhängen, wie konsequent digitale Spuren getrennt werden.

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 4 Wochen

Social Mediavor 4 WochenCommunity Management zwischen Reichweite und Verantwortung

-

Social Mediavor 1 Woche

Social Mediavor 1 WocheCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Künstliche Intelligenzvor 3 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Anthropic verschenkt MCP – mit fragwürdigen Hintertüren

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenGame Over: JetBrains beendet Fleet und startet mit KI‑Plattform neu

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenDigital Health: „Den meisten ist nicht klar, wie existenziell IT‑Sicherheit ist“

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights