Datenschutz & Sicherheit

Generative KI: Finger weg von Bildgeneratoren

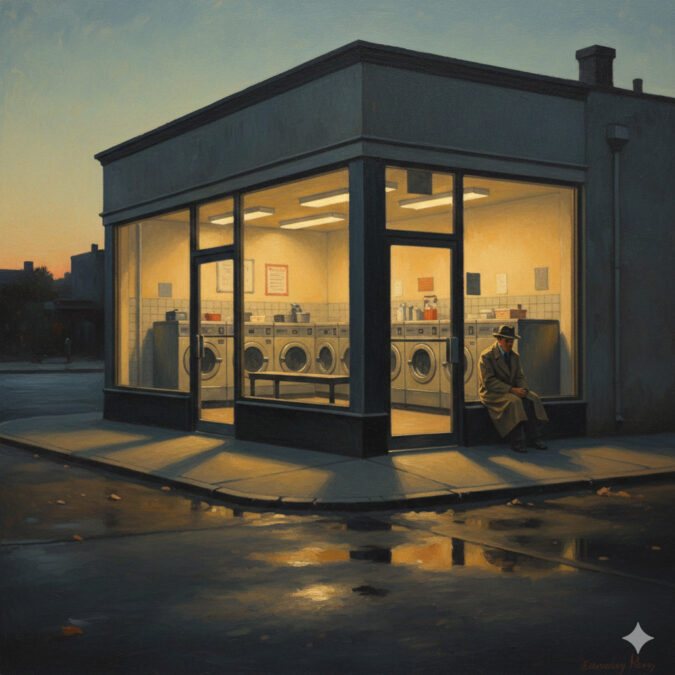

Eines der ersten Bilder, das ich mit „generativer KI“ erstellt habe, war ein Waschsalon im Stil von Edward Hopper. Das Motiv entspricht dem US-amerikanischen Maler sehr: ein halb-öffentlicher, halb privater Raum; die Stimmung irgendwo zwischen Kontemplation und Melancholie. Aber gemalt hat er es nie. Das KI-generierte Bild hatte das typische Hopper-Gefühl in mir geweckt, ich war begeistert. Bildgeneratoren sind der Anfang von etwas Großem, da war ich mir im Jahr 2022 sicher.

Schon früh war die öffentliche Debatte über Bildgeneratoren begleitet von teils inbrünstigen Einwänden, dass Erzeugnisse von Maschinen doch keine ernst zu nehmenden Gefühle oder Bedeutungen zum Ausdruck bringen könnten. Immerhin berechnet Software ihre Erzeugnisse bloß aus Material, das es bereits gibt; es fehlt also der Wille eines Menschen, etwas auf bestimmte Weise auszudrücken.

Mich überzeugt das nicht. Warum soll das Erzeugnis einer Maschine von Gefühl und Bedeutung entleert sein, das Erzeugnis eines Menschen aber gefühlvoll und bedeutsam? Diese KI-Kritik ist von klassischen Kommunikations-Modellen geprägt, die Sender und Empfänger in den Mittelpunkt rücken. Einfach ausgedrückt packt demnach ein Sender einen gewünschten Inhalt auf einen Kommunikationsträger, der die Botschaft zum Empfänger bringt – etwa per Wort oder Bild. Gerade Künstler*innen können diesem Modell zufolge ihre Kommunikation in Form eines Kunstwerks ganz besonders mit Bedeutung aufladen, weil sie dabei auf geniale Weise wie aus tiefer Seele schöpfen.

Diesem Modell zufolge kann ein KI-erzeugtes Bild schon allein deshalb nichts Sinnvolles ausdrücken, weil die Maschine nichts meinen kann. Das Erzeugnis ist allenfalls ein Klumpatsch von einst bedeutsamen Inhalten, also: KI-Slop.

Spätere Ansätze – von Systemtheorie über Poststrukturalismus – haben jedoch das Modell verworfen, wonach Bedeutung wie ein Päckchen von A nach B transportiert wird. Bedeutung lässt sich demnach auch nicht in einem Bild verpacken, sodass es nur noch beim Betrachten ausgepackt und in Empfang genommen werden muss. Vielmehr lässt sich jede Kommunikation und damit auch jedes Bild als eine Art Remix aus bestehenden Bedeutungsträgern beschreiben. Die konkrete Bedeutung eines Werks wiederum entsteht bei jeder Beobachtung aufs Neue und zwar durch die Betrachtenden. Das heißt, nicht nur jedes Werk ist ein Remix, sondern auch jede Beobachtung eines Werks.

Selbst das Wetter meint etwas – für uns

Insofern fehlt maschinell erzeugten Bildern zwar die menschliche Intention bis ins Detail, die etwa anzunehmen ist, wenn jemand nach jahrelanger Übung gezielt eine Leinwand mit Pinsel und Farbe bearbeitet hat. Gefühl und Bedeutung können KI-Bilder trotzdem haben, und zwar beim Betrachten. Das klappt auch ohne jegliche Intention eines Senders.

Das Prinzip kennen wir alle aus unserem Alltag, und zwar vom Wetter: Auch Sonnenuntergänge, Gewitter oder Wolkenformationen können ins uns eine Menge Gefühle auslösen, obwohl das Wetter nichts meinen kann. Es meint trotzdem etwas – für uns.

Die Grenze zwischen menschengemachten und synthetischen Werken ist weniger klar, als man auf den ersten Blick meinen könnte. Auch ohne Einsatz von Software haben Künstler*innen immer wieder gezielt die Kontrolle über ihre Werke reduziert. So spielen beim Action Painting Zufall und Physik eine wichtige Rolle, wenn Künstler*innen Farben schleudern und spritzen. Im Konstruktivismus wiederum geht es um Berechenbarkeit statt Zufall, wenn Künstler*innen streng auf geometrische Formen setzen.

Die Beispiele zeigen, generative KI ist weniger ein radikaler Bruch im kreativen Schaffen, sondern eher eine neue Verschiebung in der Rolle des Menschen beim Entstehen eines Werks. Statt mit Pinsel und Farbe hantiert man mit Prompts; feilt an Textbefehlen, bis die Maschine etwas erzeugt, das man gerne speichern und weiterverbreiten möchte. Der Stoff, aus dem ein Werk entsteht, ist nicht roh wie etwa eine Tube Ölfarbe, sondern vorgeformt durch das einfließende Trainingsmaterial.

Wie es sich praktisch anfühlt, mit Bildgeneratoren zu arbeiten, habe ich eine Zeit lang selbst getestet. Über Monate hinweg habe ich die Software genutzt, um eigene Artikel zu bebildern. Es war reizvoll, mehr Freiheiten in der Gestaltung der Motive zu haben. Inzwischen habe ich aber damit aufgehört – und ich halte es sogar für besser, wenn Redaktionen die Finger von Bildgeneratoren lassen. Dafür sehe ich vor allem drei Gründe.

1. Der typische KI-Look wirkt unseriös

Nach ein paar Jahren KI-Hype und einer Flut KI-generierter Bilder auf Websites und in sozialen Medien zeigt sich eine Kluft zwischen Theorie und Praxis: Während KI-Bilder meiner Meinung nach bedeutsam, gefühlvoll und schön sein können, sind sie es erstaunlich oft – einfach nicht.

So unbegrenzt wie Anfangs vermutet sind die kreativen Möglichkeiten dann doch nicht. Zumindest Stand aktuell, und mit dem eher geringen Aufwand, den viele in ihre Prompts und KI-Erzeugnisse stecken. An einem Großteil der tatsächlich in meinen Feeds kursierenden, KI-generierten Bilder habe ich mich sattgesehen. Sie sind oft überladen und austauschbar, teils offensiv geschmacklos. Einflüsse von Stilrichtungen lassen sich erahnen, sind aber oft grobschlächtig miteinander vermengt, ohne Gefühl für Stimmigkeit. Ein schauriges Beispiel dafür ist das oben eingebettete KI-Bild, das ich leider selbst als Artikelbild veröffentlicht habe, und heute für einen Griff ins Klo halte.

Websites, die auf KI-Bilder setzen, erscheinen mir inzwischen suspekt. Denn in der Praxis nutzen die meisten seriösen Medien solche Bilder nicht oder kaum; fragwürdige Content-Schleudern aber schon.

Egal, wie man sonst zu KI-Bildern steht: Sie können mangelnde Seriosität ausstrahlen. Besonders wenn Leser*innen eine Website nicht gut kennen und nur die Bilder ins Auge springen. Es könnte bei manchen die Frage aufkommen, ob die Redaktion möglicherweise auch ihre Texte achtlos zusammenrührt; wie sorgfältig das redaktionelle Angebot wirklich ist. Die Bebilderung von Artikeln sollte funktional sein und nicht mehr Fragen aufwerfen als die Hauptinhalte.

2. Generative KI schafft bedenkliche Abhängigkeiten

Generative KI gibt Menschen mit Internetverbindung zuvor ungeahnte Produktionsmittel in die Hand. Selbst ohne Vorkenntnisse lassen sich etwa Texte, Übersetzungen, Code, Bilder und Videos in mindestens mittelmäßiger Qualität erstellen. Und wer würde so viele verschiedene Dinge schon mindestens mittelmäßig hinbekommen? Das bedeutet mehr Möglichkeiten und mehr Macht für alle. Aber das ist nur die eine Seite der Medaille.

Die andere Seite ist düster. Je mehr sich generative KI verbreitet, desto mehr zementieren deren Anbieter ihre Machtposition. Als der Bild-Generator Stable Diffusion erstmals gratis für alle veröffentlicht wurde, hatte ich die Hoffnung auf eine dezentrale Zukunft generativer KI ohne mächtige Tech-Unternehmen als Nadelöhr. Es kam anders.

Heute kontrollieren einige wenige Unternehmen wie OpenAI, Anthropic, Microsoft, Meta und Google die populären und effizienten KI-Anwendungen. Sie sammeln die Risiko-Milliarden ein, steigen zu den reichsten Unternehmen der Welt auf oder festigen diese Position. Unter der Regie der KI-Konzerne entsteht eine technologische Infrastruktur, die Produktionsweisen zentralisiert. Die Konzerne bestimmen in der Folge, welche KI-Anwendungen kostenlos sind und wofür man zahlen muss. Sie bestimmen, für welche Sprachen, welche gesellschaftlichen Gruppen, welche Einsatzmöglichkeiten ihre Dienste optimiert werden.

Auf rabiate Weise extrahieren KI-Konzerne massenhaft Werke zum Training ihrer Modelle aus dem Netz, selbst wenn die Künstler*innen und Urheber*innen dahinter das nicht möchten. Einerseits finde ich: Zur Freiheit von Kunst sollte es gehören, dass sich Menschen oder auch Maschinen frei an Werken bedienen können, um Neues zu schaffen. Andererseits bereitet mir das extreme Macht-Ungleichgewicht Bauchschmerzen, das besteht, wenn Milliarden-Konzerne diese Freiheit brachial für kommerzielle Interessen ausnutzen.

In der Folge profitieren nicht alle gleichermaßen von den Produktionsmöglichkeiten sogenannter KI. Die neue Technologie kann nicht nur Gewinner*innen hervorbringen, sondern auch Verlierer*innen. Sie birgt etwa das Potenzial, KI-freie Formen künstlerischer oder handwerklicher Bildproduktion allein durch diese Produktionsgewalt zu verdrängen, zu ersetzen und damit unter die Kontrolle weniger Konzerne zu bringen.

Diese Kontrolle bezieht sich nicht nur auf die Gestaltung der KI-Werkzeuge, sondern auch auf die erzeugten Inhalte. Die KI-Konzerne entscheiden und moderieren, was erlaubt und verboten ist. Bei Sprachmodellen wie Grok aus den USA oder DeepSeek aus China sieht man, wie schnell vermeintliche Inhaltsmoderation in autoritäre Zensur und Desinformation umschlägt.

Bei den meisten kommerziellen Bildgeneratoren gibt es zudem sehr hohe Hürden für jegliche Darstellung von Nacktheit. Damit wollen die Konzerne unter anderem verhindern, dass Menschen illegale Inhalte erzeugen, und nehmen dabei Overblocking in Kauf. Die Folge ist, dass selbst jugendfreie Darstellungen zensiert werden, etwa wissenschaftliche oder künstlerische Motive. Zum Vergleich: Sogar in der Sixtinischen Kapelle im Vatikan sind Adam und Eva ohne Kleider zu sehen.

Keine Skrupel haben die KI-Konzerne dagegen offenbar bei Deals über hunderte Millionen US-Dollar mit dem Militär der rechtsradikalen Trump-Regierung.

Die erhoffte Demokratisierung von Produktionsmitteln durch generative KI hat also auch gegenteilige Effekte. Solange Bildgeneratoren von wenigen Konzernen kontrolliert werden, entstehen neue Formen von Abhängigkeit, und zwar von konkreten KI-Modellen und deren Features, von Plattform-Policys, Finanzierungsmodellen und letztlich auch den Launen und Ideologien ihrer superreichen Eigentümer.

Entsprechend unangenehm ist es, etwa einen journalistischen Artikel oder einen Blogbeitrag mit einem Generator von Google oder OpenAI zu bebildern. Der Name dieser Konzerne in der Bildunterschrift: ein unerwünschter Werbe-Effekt.

Wir sind ein spendenfinanziertes Medium

Unterstütze auch Du unsere Arbeit mit einer Spende.

Auch wenn meine kleinen Beiträge als Nutzer oder Konsument von KI-Bildgeneratoren das Machtgefüge dahinter nicht nennenswert beeinflussen – es muss einfach nicht sein. Gerade wenn Redaktionen ihre Artikel in großem Stil mit KI bebildern, verstetigen sie den Gebrauch fragwürdiger Produkte.

3. Hinter generativer KI stecken hohe, unsichtbare Kosten

Oft sind die wahren Kosten meines privilegierten, digitalen Alltags unsichtbar, und bei den meisten Leser*innen hier dürfte es ähnlich sein. Wir tippen, streamen und surfen mit energiehungrigen Produkten aus unter anderem Plastik und Seltenerdmetallen, die durch geplante Obsoleszenz zugleich der umweltschädliche Elektroschrott von morgen sind; produziert und bis zur Haustür gebracht von oftmals schlecht behandelten Angestellten; entworfen und kontrolliert von Megakonzernen, die damit Milliarden anhäufen. Obendrauf kommen jetzt noch die Kosten für generative KI.

Es ist widersprüchlich, an einem Apple-Laptop sitzend von der Nutzung einer Technologie abzuraten, weil sie verborgene Kosten für Gesellschaft und Umwelt mit sich bringt. Denn was ich an generativer KI kritisiere, trifft auch auf meine eigenen Geräte zu. Um davon nicht völlig blockiert zu sein, will ich zwei Ebenen voneinander unterscheiden: Einerseits strukturelle Ausbeutungsverhältnisse, andererseits individuelle Konsumentscheidungen. Ersteres lässt sich nicht durch letzteres überwinden. Dennoch sind individuelle Konsumentscheidungen nicht egal. Bildgeneratoren sind noch nicht so tief in unseren Alltag gesickert wie Laptops; sie sind noch kein wichtiger Teil digitaler, gesellschaftlicher Teilhabe. Noch haben wir die Wahl.

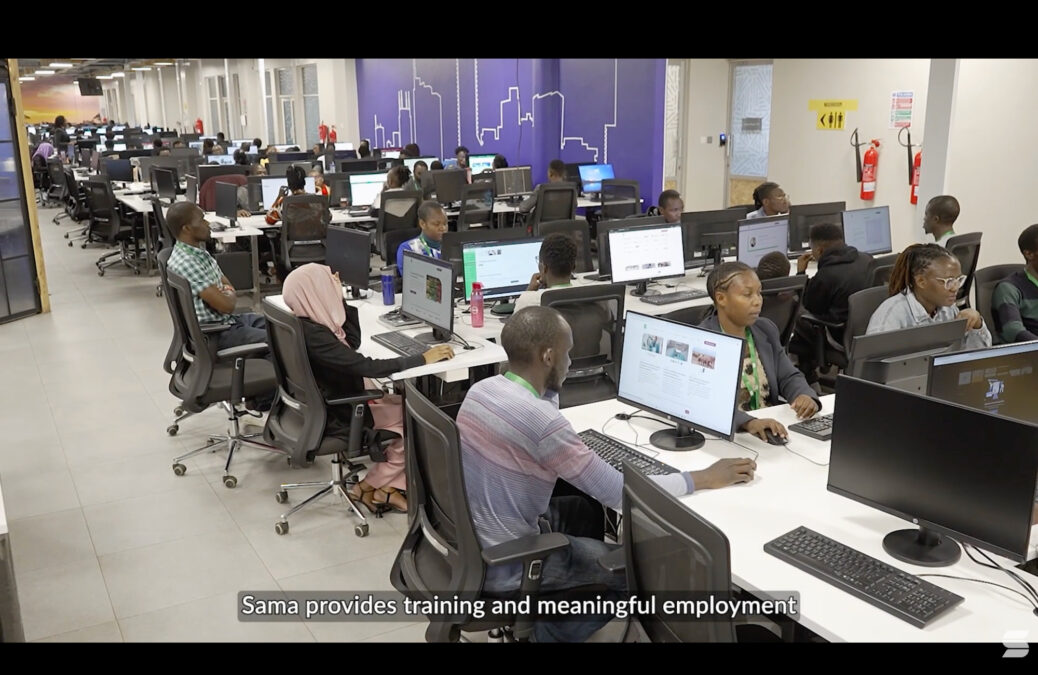

Die Systeme hinter KI-generierten Bildern fressen Energie durch Training und Betrieb und sind deshalb klimaschädlich. Die Konzerne hinter kommerziellen Bildgeneratoren ziehen riesige Rechenzentren hoch, zapfen Atomkraftwerke an und können Menschen im Umland zur Kühlung der Server sogar das Wasser abgraben. Millionen gering bezahlte Arbeiter*innen, oftmals aus dem Globalen Süden, machen durch ihre Arbeit die Leistungen der Software überhaupt erst möglich.

Die menschliche Arbeit hinter sogenannter KI soll nicht nur bewirken, dass generierte Bilder möglichst gut aussehen, sondern auch, dass sie möglichst nicht illegal oder verstörend sind. Gewalt, Folter, Missbrauch – all das sollen Nutzer*innen am Ende nicht zu Gesicht bekommen. Dafür sichten und annotieren Angestellte im Akkord Inhalte, etwa Bilder aus dem Trainingsmaterial oder neue KI-Erzeugnisse. Solche Arbeit ist oftmals psychisch belastend, die therapeutische Begleitung schlecht. Für ihren Lohn zahlen Datenarbeiter*innen also nicht nur mit ihrer Arbeitskraft, sondern auch mit ihrer Gesundheit.

Diese und weitere Kosten verschwinden hinter den glatt designten Oberflächen der Bildgeneratoren, die per Mausklick Inhalte en masse ausspucken, als wären nur Maschinen am Werk. Ich finde: Gerade weil es leicht zugängliche KI-freie Alternativen zur Bebilderung gibt, muss man das als redaktionelles Angebot nicht aktiv unterstützen.

Ambivalenzen aushalten

Mehr als drei Jahre, nachdem ich mit Stable Diffusion einen Waschsalon im Stil von Edward Hopper erzeugt habe, wiederhole ich den Versuch. Dieses Mal mit Google Gemini Ende 2025: „Wie hätte Edward Hopper einen Waschsalon gemalt?“

Ich hoffe darauf, dass mich das Ergebnis kaltlässt, schließlich habe ich mich in diesem Text daran gemacht, Bild-Generatoren zu kritisieren und von ihrem Einsatz abzuraten. Bloß, das Gegenteil ist der Fall: Die Software erzeugt ein Bild, das mir sofort gefällt. Hätte ich es früher in einem Hopper-Sammelband gesehen, es hätte zu meinen Lieblingsmotiven gezählt. Zugleich merke ich, was für ein Luxus daraus spricht, dieses Bild generieren und genießen zu können.

KI genießen, KI ablehnen – wie lässt sich diese Ambivalenz aushalten?

Der Knackpunkt liegt für mich darin, in welcher Rolle ich mit KI-generierten Bildern umgehe. Im Fall vom Hopper-Bild entscheide ich mich als Privatperson dafür, ein problematisches Produkt wie einen Bildgenerator für eine ästhetische Erfahrung zu nutzen: Das ist reiner Luxus. Ob und wie oft man das tun möchte, darüber muss wohl jede*r für sich selbst entscheiden.

Anders ist die Lage, wenn ich in meiner Rolle als Redakteur KI-Bilder in die redaktionelle Routine integriere. Dann wären sie kein privater Luxus mehr, sondern beruflich genutzte Gebrauchsgrafiken für ein breites Publikum. Sie würden den Einsatz einer Technologie normalisieren, die ich sehr kritisch sehe. Mein Fazit: Finger weg.

Zumindest zu dokumentarischen Zwecken kommt der falsche Hopper als eingebettete Grafik in diesen Text. Typisch für Hopper sehen wir hier einen isolierten Menschen in einer urbanen Umgebung. Er scheint in sich gekehrt, als würde er dem Gefühl einer inneren Leere nachhängen. Wahrscheinlich interessiert mich dieses KI-Bild deshalb umso mehr: Weil sich auch KI-Bilder die Frage nach innerer Leere gefallen lassen müssen. Und schon sind sie nicht mehr leer.

Datenschutz & Sicherheit

Wenn das Leben von Chats und Apps abhängt

„Sie haben mich festgehalten und etwa 12 Stunden lang verhört. In meinem Handy haben sie auf irgendeine Art und Weise den Chat mit meinem Bruder gefunden, wo ich mich deutlich äußerte, dass Russland Unrecht tut. Sie nahmen meine biometrischen Daten auf, meine Fingerabdrücke, zogen mich aus und fotografierten meinen Körper. Zwei Mal. Einer von ihnen drohte mir, dass er mir einen Elektroschocker in den Hintern stecken würde“, sagt Ari.

So erzählt die heute 39-jährige trans Frau, wie sie bei ihrem Fluchtversuch am russischen Grenzübergang misshandelt wurde. Es war ihr erster Versuch, aus einem kleinen Dorf im Norden der Region Luhans’k zu fliehen. Unweit der russischen Grenze gelegen, fand es sich mit dem Beginn des Krieges gegen die gesamte Ukraine unter russischer Besatzung wieder. In der Region fanden aktive Kampfhandlungen statt, Geschützfeuer war zu hören. Ari wollte über Russland und später Estland nach Schweden gelangen, um dort internationalen Schutz zu beantragen.

Damals hatte sie noch nicht mit der Hormontherapie begonnen, ihr Aussehen entsprach ihren Dokumenten. Als die russischen Grenzschützer Ari verhörten und misshandelten, wussten sie nichts von ihrer Transidentität. „Das wäre wahrscheinlich auch lebensgefährlich gewesen“, sagt sie.

Sie störten sich daran, dass Ari vor vielen Jahren bei den ukrainischen Streitkräften war und unterstellten ihr, sie wolle in Russland Sabotageakte verüben. Mitarbeiter des russischen Geheimdienstes FSB seien angerückt, um ihr Handy zu durchsuchen. Sie haben den Chat mit ihrem Bruder und andere Daten wiederhergestellt, obwohl Ari sie im Vorfeld gelöscht und das Handy anderweitig bereinigt hatte. Schließlich ließen sie sie gehen. Nach Russland einreisen durfte sie nicht.

„Es gab überhaupt keine Informationen darüber, wie man fliehen kann. Kurz nach der Invasion haben die Besatzer die gesamte Region vollständig vom Internet abgeschnitten und den Mobilfunk abgeschaltet“, erinnert sich Ari im Gespräch mit netzpolitik.org.

Beim zweiten Fluchtversuch einige Wochen später fuhr Ari dann doch ins Zentrum des Kriegsgeschehens, in der Hoffnung, dort auf einen offiziellen Evakuierungsbus zu treffen. Doch diese fuhren nicht mehr, diese Information war veraltet. Gescheitert und auf dem Rückweg nach Hause musste sie nochmals unzählige Checkpoints passieren, an denen lokale Separatisten und russische Soldaten kontrollierten. Aris Handy wurde erneut überprüft, doch diesmal hatte sie es auf Werkeinstellungen zurückgesetzt. An einem Kontrollpunkt wurde sie wieder genötigt, sich zu entkleiden. Russische Soldaten zwingen die Menschen dazu, um sie vermeintlich nach nationalistischen Tätowierungen abzusuchen.

Erzwungene Nacktheit sowie Androhung von Vergewaltigung sind nur einige Formen sexualisierter Gewalt, die russische Besatzer gegen die ukrainische Zivilbevölkerung einsetzen.

Erst beim dritten Anlauf gelang ihr die Flucht auf von der ukrainischen Regierung kontrolliertes Gebiet. Sie war eine von etwa 100 Personen, die mutige Busfahrer auf eigene Faust über Felder und vorbei an russischen Checkpoints evakuiert haben. Unabhängig überprüfen lassen sich Aris Schilderungen nicht.

„Mobiltelefone wurden sehr streng kontrolliert“

Dass russische Militärs an Checkpoints nicht nur Dokumente kontrollieren, sondern auch Handys durchsuchen, ist aus anderen besetzten und ehemals besetzten Gebieten wie Kherson bekannt. „Auch Mobiltelefone wurden sehr streng kontrolliert“, sagt Marina Usmanova, Menschenrechtsaktivistin und Gründerin der NGO „Insha“ – was auf ukrainisch so viel wie „die Andere“ heißt. Seit 2014 setzt sich die NGO für die Rechte von queeren Menschen in Kherson ein. Die Stadt liegt im Süden der Ukraine und zählte einst rund 300.000 Einwohner*innen.

Usmanova selbst konnte vor dem Einmarsch der Besatzungstruppen, der sich mit Beginn der Vollinvasion mit rasender Geschwindigkeit ereignete, fliehen. Aus ihrem Berliner Exil stand sie im engen Kontakt mit der Community. Rund 300 queere Personen habe Insha finanziell und logistisch bei der Flucht aus dem damals besetzten Kherson unterstützt, erzählt sie.

„Die meisten, die wir bei der Ausreise unterstützt haben, haben das Handy entweder versteckt oder, denn das Leben ist kostbar, kein Smartphone mitgenommen“. Wollten Menschen aus der Stadt in Richtung ukrainisch kontrolliertes Territorium ausreisen, mussten sie an Dutzenden russischen Checkpoints vorbei.

Eine der empfohlenen Strategien war laut Usmanova, alte Tastenhandys mitzunehmen, auf denen Apps wie Facebook oder Instagram gar nicht laufen können. „Damit die Militärs es wirklich nicht schaffen, etwas auszugraben. Denn aus Smartphones haben sie alles ausgegraben, was auch immer man zuvor gelöscht hat“. Wie genau die Besatzer gelöschte Dateien und Apps wiederherstellen, sei unklar. Mitarbeiter des russischen Geheimdienstes FSB seien mitunter daran beteiligt, so die Vermutung.

Wegen schwuler Dating-App im Folterkeller

Selbst innerhalb der Stadt und auf den Straßen war man vor solchen Kontrollen nicht sicher. Bei den Handydurchsuchungen haben die Militärs Kontakte geprüft, mit wem man schreibt, in welchen Gruppen bei Facebook man ist und welche Telegram-Kanäle man abonniert hat, sagt Usmanova. „Es gab viele Fälle, in denen Menschen in den Folterkeller gerieten oder Probleme bekamen, weil sie Grindr auf ihrem Handy hatten.“

In einem Bericht hat Insha, gemeinsam mit der Menschenrechtsorganisation Projector, Verbrechen des russischen Militärs gegen queere Menschen im besetzten Kherson dokumentiert. „Russische Soldaten suchten gezielt nach Angehörigen der LGBTIQ-Community“, heißt es darin. Die Besatzer hätten bei Kontrollen Männer gezwungen, sich auszuziehen und ihre Smartphones nach queeren Dating-Apps durchsucht, bestätigt der Bericht.

Einige dokumentierte Menschenrechtsverletzungen können als Kriegsverbrechen und Verbrechen gegen die Menschlichkeit eingestuft werden, so die juristische Analyse von Projector. Die NGO hat ihren Sitz in der Nachbarstadt Odessa und bietet Betroffenen rechtliche und soziale Unterstützung an. Acht solcher Opfergeschichten stellt der Bericht näher vor.

„Wir hatten schon fast keine Hoffnung mehr, Oleksii jemals lebend wiederzusehen“

Einer von ihnen ist Oleksii Polukhin. Der damals 22-jährige wurde an einem Checkpoint in Kherson aufgehalten, bevor die russischen Besatzer ihn in eine Folterkammer verschleppten.

In Kherson pflegte ein Aktivist damals eine interaktive Karte mit Standorten russischer Checkpoints. Sie sollte den Einwohner*innen helfen, sich sicher in der Stadt zu bewegen und den Kontakt zu russischen Soldaten möglichst zu vermeiden. Doch Polukhin wurde an einem mobilen Checkpoint aufgehalten, den die Besatzer anlässlich der Feierlichkeiten zum Tag des Sieges am 9. Mai, einem für die russische Propaganda wichtigen Tag, aufstellten.

Bei der Durchsuchung seines Handys fanden sie Fotos und Videos von russischen Militärfahrzeugen, die Polukhin sammelte, um sie an ukrainische Streitkräfte weiterzugeben. Außerdem stießen sie auf mehrere LGBTI-Gruppen in Telegram. Polukhin ist LGBTI-Aktivist und engagierte sich unter anderem bei Insha. In aller Öffentlichkeit zwangen sie ihn, sich zu entkleiden. Sie entdeckten ein Tattoo mit dem ukrainischen Wappen und der Flagge auf seinem Unterarm.

64 Tage hielten ihn die Besatzer in Gefangenschaft. Zum ersten Verhör mit einem FSB-Offizier zwangen sie ihn, ein rotes Kleid anzuziehen. Im Verhör forderten sie von Polukhin Adressen von anderen LGBTI-Aktivist*innen und Organisationen. Insgesamt wurde er fünf Mal verhört. „Man wurde dort von morgens bis abends geschlagen. Ich habe einmal den Verhörraum geputzt, dort war sehr viel Blut“, erzählte Polukhin der Ukrainischen Helsinki-Vereinigung für Menschenrechte.

„Drei Tage lang wurden die Gefangenen in den Flur gebracht, bekamen eine blau-gelbe Flagge und ein Teppichmesser und mussten sie in Stücke schneiden, die sie schlucken konnten. Aber nur so, dass das Stück nicht kleiner als eine Handfläche war. So habe ich etwa die Hälfte der Flagge gegessen“, sagte Polukhin weiter.

„Ehrlich gesagt hatten wir schon fast keine Hoffnung mehr, Oleksii jemals lebend wiederzusehen“, erinnert sich Marina Usmanova.

Sexualisierte Gewalt in russischer Gefangenschaft

Die Folterkammer, in der Polukhin gefangen gehalten wurde, war ein ehemaliges Untersuchungsgefängnis der ukrainischen Polizei. Russische Militärs wandelten es zur größten Folterkammer der Stadt um, die nach Khersons Befreiung als eine der berüchtigten Folterzellen von Kherson bekannt wurde. Sexualisierte Gewalt war hier laut ukrainischen Angaben an der Tagesordnung. Um etwa duschen zu dürfen, wurden die Gefangenen laut Polukhin zu sexuellen Handlungen gezwungen.

Andere Foltermethoden umfassten Waterboarding, schwere Schläge mit Knüppeln und Stöcken sowie Elektroschocks und Stromschläge an Genitalien, heißt es im Bericht. Die Khersoner Staatsanwaltschaft gibt gegenüber netzpolitik.org an, bislang Kenntnis von 305 Personen zu haben, die hier rechtswidrig gefangen gehalten und brutal misshandelt wurden. Bei 24 Personen von ihnen wurde die Folter durch Stromschläge an Genitalien offiziell bestätigt. Die Dunkelziffer liegt aber viel höher. Insgesamt gehen die Ermittlungsbehörden von rund 500 Menschen aus, die in dieser Folterkammer waren. Die Identität der weiteren Opfer wird noch ermittelt.

Ein Urteil gegen einen russischen Militärangehörigen, der Polukhin und andere Gefangene in dieser Folterkammer misshandelt hat, erging im vergangenen Herbst. Der 22-jährige Ruslan Alikhamov aus Wolgograd von der russischen Nationalgarde war so etwas wie ein Wachmann in der Anstalt. Er wurde wegen Folter und Beihilfe zum Mord vom Stadtgericht Kherson zu lebenslanger Haft verurteilt. Das Verfahren und die Urteilsverkündung fanden in seiner Abwesenheit statt. Das Urteil ist laut Projector noch nicht rechtskräftig. Gegen sechs weitere Angeklagte laufen derzeit Gerichtsverfahren, in denen Polukhin als Opfer anerkannt ist.

Misstrauen gegenüber Strafverfolgungsbehörden ist groß

Polukhin blieb in Kherson, bis die russischen Militärs nach der achtmonatigen Besatzung der Stadt auf die andere Seite des Flusses Dnipro vor den ukrainischen Befreier*innen flüchten mussten. Heute lebt er in der Westukraine. Er war der erste queere Überlebende russischer Verbrechen, der über die grausame Behandlung öffentlich erzählte. Er ist auch einer der wenigen, die Aussagen bei Behörden machten.

Aus Misstrauen gegenüber ukrainischen Strafverfolgungsbehörden und aus Angst vor queerfeindlicher Diskriminierung sehen viele Betroffene von einer Anzeige ab. Hinzu kommt, dass nicht alle Opfer sexualisierter Gewalt bereit sind, Anzeige zu erstatten.

Wir sind communityfinanziert

Unterstütze auch Du unsere Arbeit mit einer Spende.

„Viele Menschen wollen darüber überhaupt nicht sprechen“, sagt Usmanova. „Ich persönlich kenne mehr als ein Dutzend queerer Personen, die in diesem Folterkeller waren. Oleksii haben sie über zwei Monate lang festgehalten, andere wurden dort zu einem kurzen Gespräch hingebracht, eingeschüchtert und wieder freigelassen. Andere wiederum wurden geschlagen und mehrere Tage dort festgehalten“.

Die Khersoner Staatsanwaltschaft sagt hingegen auf Anfrage: „Derzeit liegen keine Informationen über die Inhaftierung und Folter von LGBT-Personen an diesem Ort vor.“ Denn Verbrechen gegen queere Personen erfasst die Staatsanwaltschaft nicht gesondert von anderen Verbrechen. Derzeit ermittelt sie lediglich in zwei Fällen mutmaßlicher Kriegsverbrechen, in denen „Anzeichen für Straftaten gegen Menschen aus der LGBT-Community festgestellt“ wurden. Einer davon ist der gewaltsame Einbruch von vier bewaffneten russischen Soldaten in die Büroräume von Insha, der von Videokameras aufgezeichnet wurde.

Der schwierige Kampf um Gerechtigkeit

Bei den Verbrechen sehe man „keine systematische Verfolgung von Personen aufgrund ihrer Zugehörigkeit zur LGBT-Community“, so die Behörde. Handydurchsuchungen und Identifizierung über soziale Netzwerke zielten ihr zufolge nicht speziell darauf ab, queere Personen zu finden. „Solche Maßnahmen wurden hauptsächlich mit dem Ziel durchgeführt, patriotisch gesinnte Bürger, Informationen über die Unterstützung der ukrainischen Streitkräfte und die Beteiligung an Partisanenbewegungen aufzuspüren.“ Auch die Generalstaatsanwaltschaft der Ukraine führt nach eigenen Angaben keine Statistik darüber, wie viele queere Personen von sexualisierter Gewalt durch russische Besatzer betroffen waren oder sind.

Die NGO Projector argumentiert dagegen, dass Gewalt gegen LGBTI-Personen charakteristisch für die russische Invasion und Kriegsführung ist. Die Organisation arbeitet mit Hochdruck daran, die systematische Verfolgung von queeren Menschen nachzuweisen. Aktuell begleiten die Jurist*innen 19 Fälle im Rahmen ihrer Projekte, sagt Yelyzaveta Barashkova von Projector. In neun von ihnen wurden bereits Strafverfahren eingeleitet, die Ermittlungen laufen noch. Gleichzeitig betont Barashkova, dass die Datenbank mit möglichen Zeugen und Opfern von Verbrechen wesentlich umfangreicher sei. Sie umfasse aktuell 153 Personen.

Den Jurist*innen geht es darum, zunächst eine Rechtsprechung auf nationaler Ebene zu etablieren, die die Gräueltaten gegen queere Menschen als Kriegsverbrechen anerkennt und ahndet. Diese kann dann in Zukunft als Grundlage für internationale Prozesse dienen, beispielsweise vor dem Internationalen Strafgerichtshof in Den Haag, sollte sich das Ausmaß solcher Verbrechen in der Ukraine bestätigen.

„Ich habe meine Chats in Telegram jeden Tag gelöscht“

Der andere von zwei Fällen, in denen die Staatsanwaltschaft wegen Verbrechen gegen queere Personen ermittelt, ist der von Mileriia Afanasiievska. Als einzige trans Frau lebte sie in der kleinen Stadt Oleschky, am gegenüberliegenden Ufer des Dnipro, bevor die russische Armee einmarschiert ist. Afanasiievska kann ihre Geschichte erzählen, weil sie, wie Ari, geschafft hat zu fliehen. Denn anders als die Stadt Kherson befindet sich Oleschky – wie der Großteil der Region – nach wie vor unter russischer Besatzung und erlebt aktuell eine humanitäre Katastrophe.

„Jeden Tag habe ich meine Chats in Telegram gelöscht und den Cache geleert. Besonders wenn ich aus dem Fenster gesehen habe, dass russische Soldaten vorbeigingen, habe ich das mehrmals pro Minute gemacht“, erzählt Afanasiievska. Unter der Besatzung herrschte eine bedrückende Atmosphäre der Angst und Zensur. „Ich habe gleich verstanden, dass ich mir auf die Zunge beißen muss, bei dem, was ich sage“. Wenn sie mit Verwandten aus dem ukrainisch kontrollierten Gebiet telefonierte, passte sie auf, nichts über Raketeneinschläge, Soldaten oder Politik zu sagen. „Wir unterhielten uns, als gäbe es keinen Krieg“.

Der Terror, das Verschwinden und Foltern von Aktivist*innen, Journalist*innen und Lokalpolitiker*innen zwang die Menschen dazu, sich auch in persönlichen Offline-Gesprächen mit Unbekannten zu zensieren.

Wenn Afanasiievska aus dem Haus ging, habe sie immer ihr altes Tastenhandy mitgenommen, ohne SIM-Karte, wie sie erzählt: Für den Fall, dass sie auf der Straße kontrolliert und ihr Mobiltelefon überprüft würde. Solche und andere Maßnahmen wie das Löschen von Chats waren essenziell für das Überleben. „Das war nicht nur für mein eigenes Überleben wichtig, sondern auch für das Überleben meines Nachbarn, meines Bekannten und anderer Menschen aus meiner Stadt, mit denen ich chattete.“

Nicht nur private Kommunikation, auch das Konsumieren von Nachrichten konnte laut Afanasiievska zum Verhängnis werden. Bestimmte pro-ukrainische Kanäle lokaler Bloger*innen auf Telegram, die die Bevölkerung über Raketeneinschläge und militärische Vorgänge informierten, seien den Besatzern besonders ein Dorn im Auge gewesen. „Ich habe Geschichten gehört, dass man, zum Beispiel, für die Gruppe „Nikolaevsky Vanyok“ erschossen wird, weil ihnen nicht gefällt, was dort geschrieben wird“, erzählt Afanasiievska.

„Erst jetzt bin ich dieses Gefühl der Paranoia losgeworden“

Länger als ein Jahr lang hat Afanasiievska es geschafft, unbemerkt und unversehrt zu bleiben – bis russische Soldaten in das Haus gegenüber einzogen. Eines Tages stürmten sie in ihren Hof, weil sie nach Wasser zum Duschen suchten. Als sie ihre Stimme hörten, fragten die Soldaten, ob sie eine Frau sei. Dann beschimpften und schlugen sie sie schwer. Dabei habe sie mehrere Zähne verloren, erzählte Afanasiievska in früheren Interviews. Laut der Khersoner Staatsanwaltschaft werde aktuell wegen eines möglichen Kriegsverbrechens gegen unbekannte russische Militärs ermittelt, die eine Person aus der LGBTI-Community mit Maschinengewehren bedroht und körperliche Verletzungen zugefügt haben.

Nachdem russische Truppen im Juni 2023 den Staudamm in Nova Kakhovka gesprengt und dabei Afanasiievskas Haus überflutet haben, beschloss sie nach Berlin zu fliehen, wo sie heute wohnt. „Ich lebe nun schon seit drei Jahren in Deutschland. Erst jetzt bin ich dieses Gefühl der Paranoia losgeworden.“ Langsam kehre das Gefühl zurück, dass sie am Telefon über alles sprechen kann, ohne ihre Aussagen zu zensieren. Bei ihrer Mutter ist das anders. Diese ermahne sie immer wieder, sie solle beim Telefonieren aufpassen, was sie über Russland sagt. „Meine Mutter leidet unter diesem Trauma, dieser Paranoia und panischer Angst, dass jemand wieder in das Haus stürmen könnte.“

Von vielen Kriegsverbrechen gegen queere Menschen, die sich weiterhin unter russischer Besatzung befinden, gibt es nach wie vor keine Kenntnis.

Datenschutz & Sicherheit

„Passwort“ Folge 52: Von kugelsicheren Netzen, kaputten Appliances und mehr

Sylvester ist im Urlaub, der stellvertretende c’t-Chefredakteur Jan Mahn springt ein und bringt ein Thema mit in den „Passwort“-Podcast: Bulletproof Hoster, kurz BPH. Die nutzen allerlei Tricks, um ihre oft böswilligen Kunden vor Behördenanfragen, Abschaltung und anderen Störungen ihrer Machenschaten zu schützen. Gemeinsam mit Christopher hat Jan in dieser Szene recherchiert und einen besonders krassen Fall von Identitätsdiebstahl aufgedeckt – die Spur führt in die Türkei.

Weiterlesen nach der Anzeige

Aber natürlich gibt es auch wieder reichlich PKI: Zertifikate für recht originelle Domains, erste Details zu einem neuen ACME-Mechanismus und eine deutliche Warnung vor IP-Zertifikaten sind die Themen, die die Szene in den letzten Wochen bewegten. Und auch Security-Appliances dürfen nicht fehlen, diesmal jedoch aus einem eher wirtschaftlichen Blickwinkel. Christopher erzählt, wie ein bekannter Hersteller von Security-Appliances durch Investoren erst gegründet und dann systematisch kaputtgespart wurde. Das schreibt der Branchendienst Bloomberg in einer langen Analyse. Christopher kann die nachvollziehen, zumal die Ergebnisse für sich sprechen: Schwere Sicherheitsversäumnisse ermöglichten massive Angriffskampagnen von Cyberkriminellen und ausländischen Mächten.

Die aktuelle Folge von „Passwort“ steht seit Mittwoch, dem 4. März auf allen Plattformen bereit.

(imp)

Datenschutz & Sicherheit

Sachsen-Anhalt: Sachverständige lehnen Palantir-Polizeigesetz ab

Heute stimmt der Landtag in Sachsen-Anhalt über ein neues Polizeigesetz ab. Darin soll erstmals eine Softwarelösung erlaubt werden, die ganz unterschiedliche Datentöpfe der Polizeibehörden zusammenbringen und damit Datenanalysen ermöglichen soll. Solche Software bezieht nicht nur Verdächtige von Straftaten ein, sondern massenhaft Unbeteiligte, Zeugen oder Kontaktpersonen, die auch in einem solchen Analysesystem landen würden.

Nach harscher Kritik hat die Landesregierung nun eine abgeänderte Version des Gesetzes vorgelegt, die einige Aspekte der Kritik aufnimmt und die Hürden zur Durchführung der Datenanalysen erhöht. Die Änderungen werden von Kritikern positiv bewertet. Indes sind sich Sachverständige einig: Ausreichend sind die Neuerungen nicht, um die gesetzlichen Regelungen zur Datenrasterung als verfassungskonform zu bewerten.

Auch ist weiterhin nicht ausgeschlossen, dass eine Software des US-Konzerns Palantir zum Einsatz kommen könnte. Die Nutzung einer Big-Data-Analysesoftware des Überwachungskonzerns war als Zwischenlösung im Gespräch.

Wesentliche Kritikpunkte bleiben

Der Streit um das Gesetz köchelt seit etwa einem Jahr. Sachverständige hatten bei einer Anhörung wenig Lob für den Gesetzentwurf der schwarz-rot-gelben Landesregierung zur Änderung des Polizeigesetzes. Sie kritisierten besonders, dass der Entwurf sehr weitgehende und kaum begrenzte Analysen riesiger Datenmengen erlaube, beispielsweise aus den hoheitlichen Datenschätzen der verschiedenen polizeilichen Informationssysteme sowie Vorgangs- und Falldatensammlungen.

Von der Polizei dürfte diese automatisierte Datenrasterung unter deutlich zu geringen Voraussetzungen vorgenommen werden, so die Sachverständigen. Deswegen verstoße die geplante landesrechtliche Regelung gegen das Grundrecht auf informationelle Selbstbestimmung und missachte die klaren Maßstäbe des Bundesverfassungsgerichts in seinem Datenanalyse-Urteil. Das hohe Gericht hatte bestimmt, dass Wesentliches bei einer Datenanalyse gesetzlich zu regeln sei. Die Praxis und damit die Eingriffe in Grundrechte von Bürgern allein der Polizei und gar deren Dienstleistern zu überlassen oder in eine Verordnung auszulagern, ist seither eigentlich nicht mehr möglich.

Klar ist: Solche automatisierten Datenanalysen bleiben nicht folgenlos, das betonte das Bundesverfassungsgericht in seiner Entscheidung aus dem Jahr 2023. Denn die Ergebnisse dieser Analysen ziehen ja polizeiliche Maßnahmen nach sich, können also diejenigen Menschen schwer belasten, die ins Raster geraten sind. Weitere polizeiliche Eingriffsbefugnisse können und sollen schließlich auf die Datenanalyse folgen.

Der Wilde Westen beim Data-Mining der Polizei ist vorbei

Auf die Kritik hat die Landesregierung reagiert: Mehrere Änderungen gab es nun in dem Paragraphen, der das polizeiliche Data Mining ermöglicht (§ 30a). Das wird in Sachsen-Anhalt einerseits strategische Datenanalyse und andererseits operative Datenanalyse genannt.

Der schon als Sachverständiger mit dem Entwurf befasste Jurist am Deutschen Forschungsinstitut für öffentliche Verwaltung Speyer, Jonas Botta, begrüßt gegenüber netzpolitik.org die Überarbeitung: Die Anforderungen an die Durchführung solcher Analysen seien verschärft worden. Das nun enthaltene „ausdrückliche Verbot lernender KI-Systeme“ schätzt er als positiv ein.

Allerdings sieht er eine „Diskrepanz zwischen Norm und Begründung“ bei dem entsprechenden Paragraphen im Gesetz zur Datenanalyse. Denn der erlaube „eine Datenzusammenführung ausschließlich zum Zweck einer konkreten Analyse“. Der Gesetzestext sagt, dass eine Analyse „im Einzelfall“ polizeiliche Ermittlungen unterstützen oder zur Gefahrenabwehr beitragen soll.

Die Gesetzesbegründung zeige hingegen, so Botta, dass „eine dauerhafte Zusammenführung angestrebt wird“. Auch vergleichbare Normen in Polizeigesetzen anderer Bundesländer ließen dies erkennen. Für diese dauerhafte Zusammenführung der Datensammlungen fehle jedoch in Sachsen-Anhalt eine „eigenständige gesetzliche Grundlage“.

Botta stellt zudem insgesamt gegenüber netzpolitik.org fest: „Wesentliche Kritikpunkte aus dem parlamentarischen Verfahren“ blieben bestehen. Der Jurist sagt: „Der Umfang der zusammenzuführenden Datensätze ist nach wie vor erheblich und erfasst auch Daten von Unbeteiligten, Zeugen und Geschädigten.“

Es fehle ebenso ein „belastbares Kontrollkonzept“. So wären „verpflichtende Stichproben durch die unabhängige Datenschutzaufsicht“ notwendig. Der Grund ist ein „strukturelles Rechtsschutzdefizit“, das auszugleichen ist. Es besteht darin, dass „die Betroffenen von der Verarbeitung ihrer Daten in aller Regel nichts erfahren“.

Auch die Juristin Franziska Görlitz von der Gesellschaft für Freiheitsrechte (GFF) hatte den Entwurf bereits als Sachverständige analysiert und kritisiert. Sie weist nun gegenüber netzpolitik.org darauf hin, was der Kern der Kritik war und bleibt: „Mit der Änderung des Polizeigesetzes werden der Polizei in Sachsen-Anhalt nun komplexe intransparente Datenanalysen erlaubt. In diese Analysen geraten in riesigen Mengen auch Daten von bisher unbeteiligten Personen.“

Denn schon wer beispielsweise einmal einen Verkehrsunfall hat, eine Straftat beobachtet oder eine Anzeige erstattet, landet in Polizeisystemen und „dessen Daten fließen in die Analysen ein“, so Görlitz. „Im schlimmsten Falle können Menschen so fälschlicherweise ins Visier der Polizeibehörden geraten.“

Die Datenanalysen seien weiterhin unter zu geringen Voraussetzungen zulässig. Auch „ausreichende Vorkehrungen gegen Fehler und Diskriminierung bei der Analyse“ fehlten noch immer. Wie Botta sieht Görlitz die Kontrolle als mangelhaft: Die Analysepraxis werde durch das Gesetz nicht ausreichend kontrolliert.

Sie senkt selbst nach den Änderungen deutlich den Daumen: „Das Gesetz genügt den Anforderungen des Bundesverfassungsgerichts für Datenanalysen nicht. Der Schutz der Grundrechte ist nicht ausreichend sichergestellt.“

Bleibt ein Einsatz der Software von Palantir möglich?

Was die Frage nach einen möglichen Einsatz von Software von Palantir angeht, sagt Görlitz gegenüber netzpolitik.org: Das Gesetz stelle „nicht sicher, dass für die Analysen nur Softwaretools genutzt werden dürfen, deren Funktionsweise transparent ist“. Es könnten nach dem Gesetzestext also Abhängigkeiten von Konzernen wie Palantir drohen.

Die Nutzung einer Software des US-Konzerns Palantir bleibt damit rechtlich weiter möglich, aber politisch in der derzeitigen Landesregierung wohl unwahrscheinlich.

Unverbindlicher Antrag

Darauf deutet auch ein Papier, das zusammen mit dem neuen Gesetz kommt. Denn zugleich soll der Landtag einen Entschließungsantrag zur digitalen Souveränität abstimmen, der als Ziel ein „bundesweit betriebenes, europäisch beherrschtes System“ für die polizeiliche Datenanalyse formuliert. Die bislang nicht existierende Software soll so konzipiert sein, dass sie „die digitale Souveränität Deutschlands und Europas stärkt, die vollständige rechtliche und technische Kontrolle durch staatliche Stellen gewährleistet und Abhängigkeiten von außereuropäischen Anbietern vermeidet“.

Digitale Unabhängigkeit

Wir berichten seit Jahren unter dem Stichwort Digitale Souveränität über Abhängigkeiten von Technologien, vor allem aus dem Nicht-EU-Ausland. Unterstütze unsere Arbeit!

Der Antrag betont, „dass der Einsatz automatisierter Datenanalyseverfahren einen besonders intensiven Eingriff in die Grundrechte der betroffenen Personen darstellt“. Er sei wegen dieser Eingriffstiefe und Streubreite „nur unter strikter Beachtung der verfassungsrechtlichen Vorgaben zulässig“.

Doch genau das bezweifeln die Experten mit guten Argumenten. Görlitz betont gegenüber netzpolitik.org zu dem Papier: „Der geplante Entschließungsantrag ist unverbindlich und kann die digitale Souveränität nicht sicherstellen.“ Mehr als Symbolpolitik ist ein solcher Antrag also nicht.

Das weiß auch Jurist Botta. Er entfalte keine „Bindungswirkung gegenüber der Landesregierung“, sagt er gegenüber netzpolitik.org. Ohnehin werde Palantirs „Gotham“-Software in dem Entschließungsantrag gar nicht benannt. Botta betont, der Einsatz von Palantir-Software möge politisch derzeit unwahrscheinlich sein, „die nächste Landesregierung könnte das jedoch schon ganz anders sehen“.

Und das könnte nach dem 6. September im Falle eines Wahlsiegs auch eine Regierung mit der AfD sein. Die Partei ist vom Inlandsgeheimdienst dort als gesichert rechtsextrem eingestuft, erreicht in Umfragen aber Werte um die vierzig Prozent.

Die Fraktionsvorsitzende der oppositionellen Linken im sachsen-anhaltinischen Landtag, Eva von Angern, fordert daher, die Grundrechte der Bürgerinnen und Bürger anzuerkennen und besser gleich grundrechtskonforme Regeln zu schaffen. Denn „Rechtssicherheit hilft am Ende auch den Polizeibehörden deutlich mehr, als wenn Teile des Gesetzes einer Prüfung vor Gericht nicht standhielten“. Die Linke brachte einen Änderungsantrag ein, der einen Parlamentsvorbehalt und bessere Kontrollvorgaben beinhaltet und die Datenanalyse auf Verdächtige, Beschuldigte und Festgenommene beschränkt.

Nach dem Anschlag auf den Magdeburger Weihnachtsmarkt im Dezember 2024, der oft als Begründung für die neuen Befugnisse herangezogen wurde, und dem nachfolgenden Untersuchungsausschuss fordert von Angern die Innenministerin Tamara Zieschang (CDU) auf, statt der neuen Befugnis die „Defizite in ihrer Polizeibehörde“ aufzuarbeiten. Denn beim „Attentäter von Magdeburg gab es ein eindeutiges Behördenversagen“, so von Angern. Sie wendet sich dagegen, nun durch das Polizeigesetz ein ganz neues Instrument zu etablieren, „das am Ende womöglich als rechtswidrig eingestuft wird und Bürgerinnen und Bürger einem Generalverdacht unterzieht“.

Die Befürchtung, dass die Datenanalyse-Regeln bei einer Prüfung in Karlsruhe nicht Bestand hätten, teilt der Jurist Botta. Er sagt gegenüber netzpolitik.org mit Blick auf den Datenanalyse-Paragraphen und die fehlende gesetzliche Grundlage für die offenbar dauerhaft geplante Polizeidatenzusammenführung: „Sollte Verfassungsbeschwerde erhoben werden, dürfte das Bundesverfassungsgericht die Norm aus den genannten Gründen zumindest teilweise für verfassungswidrig erklären.“

Die GFF-Juristin Görlitz zeigt sich gegenüber netzpolitik.org ebenfalls skeptisch. Sie sagt: „Die GFF hat bereits im Gesetzgebungsverfahren starke Bedenken an der Verfassungsgemäßheit der Regelung geäußert. Bei Inkrafttreten des Gesetzes prüfen wir mögliche Klagen.“

Es wäre nicht das erste Mal, dass die GFF verfassungswidrige Gesetze erfolgreich in Karlsruhe zu Fall bringt. Denn das Datenanalyse-Urteil aus dem Jahr 2023 ging schon auf die Kappe der Grundrechtsaktivisten, da sie eine Verfassungsbeschwerde eingereicht hatten. Auch gegen die Regelungen in den Bundesländern Nordrhein-Westfalen, Hessen und Bayern, die Software von Palantir nutzen, ging die GFF bereits aktiv rechtlich vor. Das sollte den Abgeordneten, die über das Gesetz abstimmen, vielleicht zu denken geben.

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 3 Wochen

Social Mediavor 3 WochenCommunity Management zwischen Reichweite und Verantwortung

-

Social Mediavor 3 Tagen

Social Mediavor 3 TagenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Künstliche Intelligenzvor 2 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenSyncthing‑Fork unter fremder Kontrolle? Community schluckt das nicht

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Anthropic verschenkt MCP – mit fragwürdigen Hintertüren

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenGame Over: JetBrains beendet Fleet und startet mit KI‑Plattform neu

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights