Apps & Mobile Entwicklung

Ein gefährliches Experiment am Patienten

Das Versprechen neuer KI-Tools wie ChatGPT Health ist verlockend: die Fähigkeit, jahrelange persönliche Gesundheitsdaten von Geräten wie der Apple Watch zu analysieren, um bedeutsame Erkenntnisse zu gewinnen. Aber was passiert, wenn man diese Theorie in die Praxis umsetzt?

Geoffrey A. Fowler, Tech-Kolumnist der Washington Post, wollte es unbedingt wissen. Er gab dem neuen Tool Zugriff auf die Daten eines ganzen Jahrzehnts – darunter 29 Millionen Schritte und 6 Millionen Herzschlagmessungen, die in seiner Apple-Health-App gespeichert sind. Dann bat er den Bot, seine Gesunderheit, bzw. speziell seine Herzgesundheit zu bewerten.

Der Bot gab ihm eine glatte Sechs (ein F nach amerikanischem System, also die schlechtestmögliche Bewertung).

„Ich bekam Panik und ging joggen“, schreibt Fowler in seinem Artikel. Dann schickte er den Bericht von ChatGPT an seinen echten Arzt. Dessen Antwort war deutlich beruhigender : Fowlers Risiko für einen Herzinfarkt ist tatsächlich so gering, dass seine Versicherung wahrscheinlich nicht einmal für einen zusätzlichen Test zahlen würde, um die KI zu widerlegen.

ChatGPT Health: “Das ist nicht bereit für irgendeine medizinische Beratung“

Als Fowler die KI erneut bat, seine Herzgesundheit zu bewerten, änderte sich das Urteil dramatisch. Plötzlich war es eine „4“ (D). Er fragte weiter und beobachtete, wie die Note zwischen einer „6“ (F) und einer „2“ (B) schwankte. Der Journalist zeigte die Ergebnisse dem Kardiologen Eric Topol, einem Experten für KI in der Medizin. Sein Urteil war unmissverständlich:

Das ist haltlos. Das ist nicht bereit für irgendeine medizinische Beratung.

Über die willkürlichen Schwankungen in den Bewertungen urteilte Topol ebenso scharf: Diese Art von Zufälligkeit sei „völlig inakzeptabel“.

Die Gefahr liegt auf der Hand: Solche unausgereiften Werkzeuge könnten bei gesunden Menschen extreme Ängste auslösen oder umgekehrt Personen mit echten Gesundheitsproblemen in einem falschen Gefühl der Sicherheit wiegen.

Fehlinterpretation: Warum die KI oft an Daten scheitert

Die fehlerhafte Analyse von ChatGPT hatte konkrete Ursachen. Erstens stützte die KI ihre negative Einschätzung stark auf den VO2-max-Wert. Apple selbst bezeichnet diesen Wert jedoch nur als „Schätzung“, und unabhängige Forscher:innen stellten fest, dass diese Schätzungen im Durchschnitt um 13 Prozent zu niedrig ausfallen können.

Zweitens interpretierte die KI Schwankungen in Fowlers Ruhepuls als besorgniserregende Gesundheitssignale und riet ihm, mit seinem Arzt über eine „bemerkenswerte Erhöhung“ zu sprechen. Dabei übersah sie einen entscheidenden Faktor: Die Veränderungen traten immer dann auf, wenn der Journalist ein neues Apple-Watch-Modell mit verbesserten Sensoren erhielt.

Ein KI-Arzt mit Gedächtnisverlust

ChatGPT Health behandelte diese „unscharfen Daten“ wie eindeutige medizinische Fakten und ließ den kritischen Kontext vermissen, den ein menschlicher Experte sofort erkennen würde. Selbst als Fowler seine offiziellen Krankenakten aus der Arztpraxis mit dem Tool verband, verbesserte sich die Note nur auf eine „5“ (D) – ein weiterer Beweis dafür, dass das Kernproblem nicht die Datenmenge, sondern die mangelnde Analysefähigkeit ist.

Über verschiedene Chats hinweg vergaß ChatGPT wiederholt wichtige persönliche Informationen über Fowler, darunter sein Geschlecht, sein Alter und aktuelle Vitalwerte. Selbst als die KI Zugriff auf seine neuesten Bluttestergebnisse hatte, bezog sie diese manchmal nicht in die Analyse mit ein. Für ein Werkzeug, das persönliche Gesundheitseinblicke liefern soll, ist dies ein fundamentaler Mangel. Ein konsistentes Verständnis des Individuums ist die Grundlage jeder sinnvollen Gesundheitsbewertung.

Einordnung: Wo stehen wir bei der KI-Gesundheit?

Dieses Experiment passt zu einem beunruhigenden Trend: Technologieunternehmen bringen KI-Produkte auf den Markt, die bestenfalls wenig akkurat sind – oder schlimmstenfalls sogar „gefährlich“. Das Problem ist dabei beileibe nicht auf OpenAI und ChatGPT Health beschränkt. Der Konkurrenz-Bot Claude aus dem Hause Anthropic bewertete Fowlers Herzgesundheit ebenfalls mit einer „4“ (C) und stützte sich dabei auf die gleiche fehlerhafte Logik.

Zudem fallen diese Dienste nicht unter strenge Gesetze zum Schutz von Gesundheitsdaten wie HIPAA in den USA. Das Experiment ist somit ein wichtiger Weckruf und wirft eine entscheidende Frage für die Zukunft auf: Wem sollten wir vertrauen, wenn eine KI schlechte Gesundheitsratschläge gibt, und wie können wir sicherstellen, dass zukünftige Innovationen sicher und zuverlässig sind?

Wie sieht es bei Euch aus? Nutzt Ihr bereits KI, um Gesundheitsdaten zu tracken, oder um Gesundheitsfragen zu klären?

Apps & Mobile Entwicklung

Chatkontrolle: EU-Parlament stimmt überraschend gegen anlasslose Scans

Überraschende Wendung bei der Chatkontrolle: Das EU-Parlament stimmte nach unzähligen Vorschlägen in den letzten Monaten nun mehrheitlich gegen die von der EU-Kommission vorgeschlagene anlasslose Überwachung privater Kommunikation. Ein Grund dürfte gewesen sein, dass manche Vorschläge das Blatt überreizt haben.

EU-Parlament setzt seine Ablehnung noch weiter als zunächst angenommen

Mit einer, wenn auch knappen, Mehrheit wurde im EU-Parlament der Antrag der Piratenabgeordneten Markéta Gregorová aus der Grüne/EFA-Fraktion angenommen. Dieser verlangt, dass die Überwachung privater Kommunikation zwingend auf einzelne Nutzer oder Nutzergruppen beschränkt bleiben muss, bei denen die zuständige Justizbehörde eine Verbindung zu sexuellem Kindesmissbrauch erkennt. Damit würde das Parlament an seiner bereits 2023 formulierten Position zur permanenten Chatkontrolle-Verordnung festhalten.

In der Vergangenheit hatte das EU-Parlament bereits zahlreiche Kompromissvorschläge abgelehnt und unmissverständlich signalisiert, dass es das Vorhaben der EU-Kommission in den angedachten Formen nicht mittragen wird. Mit der jetzigen Entscheidung dürfte es für die Kommission auch nach drei Jahren zäher Diskussion noch schwieriger werden, ihre Pläne in den nun gestarteten Trilog-Verhandlungen mit EU-Rat und Parlament durchzusetzen.

Chatkontrolle in geplanter Form vor dem Aus

Die Verhandlungen finden unter enormem Zeitdruck statt, denn eigentlich sollte die bisherige Verordnung zur freiwilligen Kontrolle am 6. April 2026 auslaufen. Diese wurde nun noch einmal bis zum 3. August 2027 verlängert, wobei die Erkennung allerdings nur auf Material angewendet werden soll, das bereits als potenziell missbräuchlich identifiziert oder gekennzeichnet wurde-

Die Fronten dürften allerdings verhärtet bleiben: Sowohl die EU-Kommission als auch die übergroße Mehrheit im EU-Rat – einschließlich der Bundesregierung – lehnen bislang kategorisch jede Einschränkung der anlasslosen Massen-Scans ab. Sollten sich beide Gremien nicht bewegen, würde dies das endgültige Aus für die Chatkontrolle bedeuten, da der nun beschlossene Antrag keinerlei Aufweichung zulässt.

Der ehemalige EU-Abgeordnete Patrick Breyer von der Piratenpartei wertet den Beschluss als „sensationellen Erfolg der unzähligen Bürger, die sich per Telefon und Mail für die Rettung ihres digitalen Briefgeheimnisses eingesetzt haben“. Für Breyer muss eine anlasslose Durchleuchtung digitaler Kommunikation genauso tabu sein wie bei analogen Briefen. Die EU-Regierungen müssten seiner Ansicht nach endlich einsehen, dass echter Kinderschutz sichere Apps, die Löschung von Material an der Quelle und gezielte Ermittlungen gegen Verdächtige mit richterlichem Beschluss erfordert – aber „keine übergriffige, sinnlose Massenüberwachung“.

Blatt überreizt

Die jetzt vollzogene Ablehnung samt der eng gesteckten Grenzen für die Chatkontrolle dürfte maßgeblich auf einen vor wenigen Tagen eingebrachten Vorschlag der drei größten Parlamentsfraktionen zurückgehen: EVP (Europäische Volkspartei, CDU/CSU), S&D (Progressive Allianz der Sozialdemokraten, SPD) und Renew Europe (Renew, FDP). Anstatt deeskalierend zu wirken, verschärften diese Fraktionen ihre Gangart noch einmal deutlich. Der zuvor im LIBE-Ausschuss abgelehnte Berichtsentwurf wollte zumindest die unzuverlässigsten Technologien ausschließen. Der neue Vorschlag hingegen sah nicht nur vor, die anlasslose Überwachung von Kommunikation beizubehalten, sondern diese zusätzlich mittels einer laut Breyer „hochgradig experimentellen“ KI auszuweiten, die private Chat-Texte und unbekanntes Bildmaterial automatisiert bewerten soll.

Keine menschliche Kontrollinstanz

Das würde bedeuten, dass weder ein Richter noch eine andere Person den „begründeten Verdacht“ vorab prüft oder anordnet. Algorithmen und private Tech-Konzerne würden im Alleingang darüber entscheiden, wer überwacht wird. Da der Vorschlag zudem keine zeitliche Begrenzung vorsieht, wächst die Gefahr massiven Missbrauchs. Der Text stützt sich außerdem auf vage Begriffe wie „Trusted Flagger“, ohne festzulegen, wer diesen Status vergibt oder wie Missbrauch verhindert werden soll. Eine Pflicht zur nachträglichen Benachrichtigung von Nutzern, deren Accounts fälschlicherweise gemeldet und gescannt wurden, fehlt ebenfalls. Damit würde laut Breyer jeglicher Rechtsschutz ausgehebelt.

Diese weitreichenden Vorschläge dürften ihrerseits dazu beigetragen haben, dass das EU-Parlament einen derart drastischen Schritt vollzogen hat. Die Chatkontrolle in der Form, wie sie die EU-Kommission einst vorgesehen hatte, dürfte damit endgültig beerdigt sein.

Apps & Mobile Entwicklung

Update wird ausgerollt: Zwei Schwachstellen gefährden Chrome-Anwender

Mit einem aktuell verteilten Update behebt Google zwei gefährliche Schwachstellen in seinem Browser Chrome. Bereits der Besuch einer manipulierten Webseite soll ausreichen, damit Angreifer aus der Ferne schadhaften Code aufspielen können. Die Sicherheitslücken werden laut Google bereits aktiv ausgenutzt.

Erneut bekannte Module betroffen

Durch das Aufspielen von beliebigem Code können Angreifer nicht nur persönliche und sensible Daten abgreifen, sondern auch die vollständige Kontrolle über das jeweilige System erlangen. Google verortet die beiden Lücken in der als zentrale Grafik-Engine agierenden Open-Source-2D-Grafikbibliothek Skia (CVE-2026-3909) sowie erneut in der JavaScript-Engine V8 (CVE-2026-3910). Von beiden Bereichen geht laut den Sicherheitsexperten bei Google ein hohes Gefahrenpotenzial aus, die Exploits sollen bereits für Angriffe genutzt werden. Daher sollte die korrigierte Version schnellstmöglich eingespielt werden.

Über weitere Details hüllt sich Google wie gewohnt in Schweigen – zum einen, um Nutzern genügend Zeit für das Update der Anwendung zu verschaffen, aber auch, um Angreifern keine zusätzlichen Informationen an die Hand zu geben, die sie für ihre Aktionen verwenden könnten.

Google reagiert mit Updates

Für die korrigierten Versionen greifen Windows- und macOS-Nutzer zur Version 146.0.7680.75/76, für Linux steht die bereinigte Ausgabe 146.0.7680.75 bereit. Für Android hat Google hingegen Version 146.0.76380.115 veröffentlicht, die Variante für iOS sowie die für auf Chromium basierende Browser sollten erfahrungsgemäß in den nächsten Tagen folgen.

Ab sofort verfügbar

Die Aktualisierung von Chrome lässt sich über die interne Update-Funktion anstoßen, viele Nutzer sollten darüber hinaus bereits eine Benachrichtigung über die neue Version erhalten haben. Alternativ kann diese wie gewohnt bequem über den Link am Ende dieser Meldung aus dem Download-Bereich von ComputerBase bezogen werden. Android-Nutzer greifen hingegen zum Play Store von Google, Besitzer eines iOS-Gerätes werden im App Store von Apple fündig.

Downloads

-

2,9 Sterne

Google Chrome ist der meistgenutzte Browser, bietet aber keinen nennenswerten Tracking-Schutz.

- Version 146.0.7680.75/76 Deutsch

- Version 147.0.7727.3 Beta Deutsch

- Version 109.0.5414.120 Deutsch

Apps & Mobile Entwicklung

Chuwi CoreBook X/Plus: Skandal um falsche Notebook-CPUs weitet sich aus

Der chinesische Mini-PC- und Notebook-Hersteller Chuwi kommt in Erklärungsnot: Nachdem Notebookcheck vor einer Woche nachweisen konnte, dass in einem Notebook des Herstellers nicht die versprochene CPU, sondern eine schwächere sitzt, gibt es nun einen zweiten bestätigten Fall – in einer anderen Serie von Chuwi.

Fall 1: Was war geschehen?

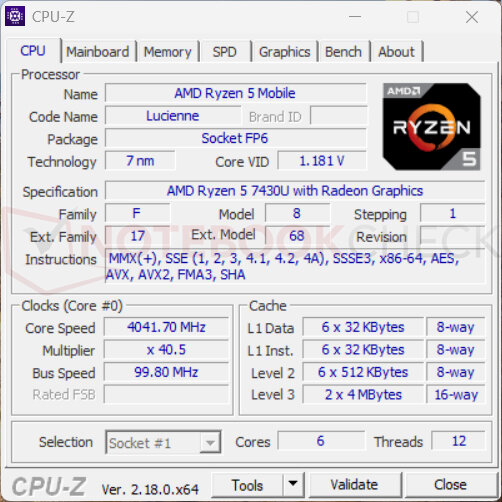

Erste Berichte zu Unstimmigkeiten im CoreBook X mit 7430U gab es schon zum Jahreswechsel. Vor einer Woche hatte Notebookcheck davon berichtet, dass in dem im Sommer 2025 getesteten Chuwi CoreBook X kein Ryzen 5 7430U, sondern ein Ryzen 5 5500U saß.

Das prekäre daran: Nicht auf der Produktseite, nicht auf dem Datenblatt, ja nicht einmal unter Windows oder im BIOS war das beim Blick auf den Produktnamen ersichtlich, denn die CPU gab sich auch als Ryzen 5 7430U aus – erst ein genauerer Blick auf die Angaben in Windows und in das Notebook auf die CPU beziehungsweise deren Produktnummer lüftete das Geheimnis.

Aufgefallen war das Notebookcheck im initialen Test nicht, wofür sich die Publikation entschuldigt. Denn auch wenn sich beide Prozessoren nahe stehen, gibt es Unterschiede und die waren über Windows-Tools und auch in Windows selbst sichtbar: Codename (in CPU-Z), L3-Cache (im Taskmanager) und Taktraten (Basistakt im Taskmanager). Diese Angaben entsprachen dem Original.

Chuwis erste Reaktion

Chuwi hatte daraufhin erklärt, der Ursache auf den Grund zu gehen, aber vorerst keinen Fehler eingestanden. Inzwischen berichtet Notebookcheck allerdings auch von der Androhung rechtlicher Konsequenzen, sollte der ursprüngliche Bericht nicht offline genommen werden.

Chuwi hat tatsächlich geantwortet, jedoch nicht explizit einen Fehler eingestanden. Stattdessen wird auf verschiedene Produktionschargen, genauer gesagt noch im Umlauf befindliche Restbestände verwiesen. Auf diese Geräte habe man keinen direkten Einfluss mehr. Weiterhin räumt der Hersteller ein, dass dieses Thema sehr ernst genommen wird und eine interne Prüfung in die Wege geleitet wurde, um die genaue Ursache zu klären.

Chuwis 1. Antwort laut Notebookcheck

Fall 2: Noch eine falsche CPU

Das ist bisher nicht passiert. Stattdessen gibt es jetzt einen zweiten Bericht, denn Notebookcheck hat nach eigenen Aussagen in der letzten Woche ein Notebook der Serie Chuwi CoreBook Plus im deutschen Handel erworben, das ebenfalls mit Ryzen 5 7430U beworben wird – und diese CPU auch wieder im BIOS und unter Windows so ausweist. Beim Blick auf AMDs Tray-Produkt-ID auf dem CPU-Package kommt jedoch auch in diesem Fall eine Ryzen 5 5500U zum Vorschein.

Chuwi hat sich bis dato noch nicht zu dem zweiten Fund dieser Art, der rein theoretisch auch auf einen Betrug in der Zulieferkette zurückzuführen sein könnte, geäußert.

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 2 Wochen

Social Mediavor 2 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenDigital Health: „Den meisten ist nicht klar, wie existenziell IT‑Sicherheit ist“

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights

-

UX/UI & Webdesignvor 1 Monat

UX/UI & Webdesignvor 1 MonatEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenEMEC vereint Gezeitenkraft, Batteriespeicher und H₂-Produktion in einer Anlage