Apps & Mobile Entwicklung

Generatives Musikmodell: So erstellt man mit Lyria 3 kurze Soundtracks in Gemini

Google hat seinen KI-Musikgenerator Lyria 3 in Gemini integriert. Nutzern sollen damit durch einfache Prompt-Eingaben ansehnliche Musikstücke verschiedener Stilrichtungen erstellen können. Die Länge der generierten Stücke ist derzeit noch auf 30 Sekunden begrenzt, Google hat damit vor allem Videos im Blick.

Vom Text zur fertigen Musik

Das aus Googles DeepMind stammende Musikmodell soll nicht nur anhand einfacher, per Text eingegebener Beschreibungen wie gewünschtem Genre oder vorgegebener Stimmung entsprechende Tracks erzeugen können, sondern auch auf Basis von Bildern und Videos. Gemini erstellt daraufhin einen vollständigen, bis zu 30 Sekunden langen Track mit einer Abtastrate von bis zu 48 kHz. Im Gegensatz zu früheren Lyria-Versionen kann das Stück auf Wunsch direkt von der KI mit einem passenden Text versehen werden. Durch die Möglichkeit, Videos als beschreibende Quelle zu nutzen, soll sich das neue Modell zudem für die unkomplizierte musikalische Untermalung kurzer Videos eignen, die dafür lediglich hochgeladen werden müssen.

Größere Kontrolle und Einfluss

Mit dem neuen Modell erhalten Anwender zudem deutlich mehr Kontrolle über die Ausgabe – etwa hinsichtlich Stil, gewünschtem Tempo, Stimme und Stimmung, aber auch bei spezifischeren Parametern wie Tonart, Akkord-Progressionen oder der Frage, ob das Stück überwiegend Dur- oder Moll-Akkorde verwenden soll. Die Informationsrichtung kann dabei auch umgekehrt verlaufen: Auf Wunsch gibt Lyria 3 die verwendeten Akkorde aus, eine vollständige Partitur mit sämtlichen Noten ist jedoch nicht möglich. Gleiches gilt für die Ausgabe einzelner Spuren zur späteren Weiterverarbeitung oder besseren Abmischung. So lässt sich beispielsweise keine isolierte Gesangsspur erzeugen, die in eigenen Produktionen weiterverwendet werden kann.

Gleichzeitig wird für die erstellten Inhalte mittels Nano Banana ein individuelles Cover-Art generiert, das in kurzen Tests der Redaktion jedoch nur wenig überzeugen konnte und inhaltlich meist nur bedingt einen Bezug auf einen möglichen Text erkennen ließ.

Wie funktioniert Lyria 3 in der Praxis?

Die Redaktion hat Lyria 3 einem Kurztest unterzogen und versucht, dem KI-Modell mittels einfacher Prompts ein hörbares Stück zu entlocken. Bereits mit einer schlichten Eingabe wie

Eine Frauenstimme soll über das Wetter singen. Die Tonart soll in C-Dur gehalten werden, der Stil in Richtung Synthwave oder Retro-Wave gehen und ein höheres, treibendes Tempo besitzen. Das Stück soll eine fröhliche Grundstimmung besitzen und das erste schöne Frühlingswetter nach langen Regentagen beschreiben.

lässt sich bereits ein hörbares Ergebnis erzeugen.

Je detaillierter ein Prompt jedoch formuliert ist und je mehr Informationen dieser enthält, desto präziser kann die von Lyria 3 erstellte Ausgabe den eigenen Vorstellungen entsprechen. So konnte mittels

Eine Frauenstimme soll über das Wetter singen. Die Tonart soll in C-Dur gehalten werden, der Stil in Richtung Synthwave oder Retro-Wave gehen und ein höheres, treibendes Tempo besitzen. Als Akkordprogression soll I-V-vi-IV verwendet werden. Im Hintergrund soll ein das Musikstück umhüllendes Pad zu hören sein, der Bass sollte aber einen hohen Attack besitzen und leicht metallisch klingen. Background-Sänger sollen teile des Refrains wiederholen. Das Stück soll eine fröhliche Grundstimmung besitzen und das erste schöne Frühlingswetter nach langen Regentagen beschreiben. Es sollen zudem Wörter wie „Regen“, „Sonnenschein“ „Regenzeit“, „schlechtes Wetter“ und „Wolkenbruch“ verwendet werden.

deutlich mehr Einfluss auf das ausgegebene Musikstück genommen werden.

Dabei eignet sich Lyria 3 ebenso für die Erstellung skurriler oder humorvoller Stücke:

Eine Männerstimme soll den deutschen liebstes Fleischgericht besingen: Das Schnitzel! Die Musik soll vom Stil der stampfend sein und nach einem deftigen Wirtshaus klingen. Dementsprechend soll auch die Musik angepasst sein. Etwas Blasmusik wäre ebenfalls schön, der Hintergrund ansonsten schlagermäßig synthetisch klingen. Das Stück soll zudem ein mittleres, eher gemütliches Tempo besitzen, das zum Schunkeln einlädt.

Gerade dieses Stück zeigt, dass KI-Modelle wie Lyria 3 künftig vor allem in der Werbung stärkere Verbreitung erfahren könnten.

Nicht selten erweist es sich zudem als vorteilhaft, einen Prompt mehrfach einzugeben, da Lyria 3 bei jeder erneuten Generierung unterschiedliche Stücke präsentiert und so eine größere Auswahl zur Verfügung stellt.

Identifikation von KI-Inhalten soll einfacher werden

Google hat eigenen Angaben zufolge bei Lyria 3 nicht nur Nutzerfreundlichkeit und Qualität gesteigert, sondern zugleich erweiterte Möglichkeiten geschaffen, um mit dem KI-Modell erzeugte Inhalte leichter identifizieren zu können. So werden alle in Gemini erstellten Stücke mit dem hauseigenen SynthID-System versehen, das die Inhalte mit einem nicht sichtbaren Wasserzeichen markiert. Ein Musikstück kann dazu einfach in die Gemini-App geladen und auf SynthID überprüft werden. Google betont zudem, dass Lyria 3 auf den „künstlerischen Ausdruck ausgelegt“ sei, nicht jedoch auf das gezielte Nachahmen bestehender Künstler. Diese können in Prompts zwar genannt werden, das System nutzt sie dann jedoch lediglich als Inspiration und versucht, einen ähnlichen Track im Stil der jeweiligen Band oder des Künstlers zu erzeugen. Für eine bessere Nutzung von Prompts stellt Google Nutzern darüber hinaus zahlreiche Hilfestellungen bereit.

Creator können Lyria 3 ab sofort auch in Dream Track verwenden, dem experimentellen KI-Tool von YouTube zur klanglichen Untermalung von YouTube Shorts. Dieses war bislang ausschließlich in den USA verfügbar und wurde nun auch für weitere Länder freigeschaltet.

(Noch) Kein professionelles Werkzeug

Auch wenn die Fähigkeiten von Googles Musik-Tool deutlich erweitert wurden, ordnet es sich weiterhin klar hinter professionellen Lösungen wie Suno AI oder Udio ein. Die von Google genannten Einsatzszenarien verdeutlichen, dass sich Lyria 3 primär an normale Nutzer und Contentcreator richtet, die mit einfachen Methoden ein Musikstück für den Hintergrund ihrer Bilder oder Videos erstellen möchten und keine tiefgreifende Kontrolle benötigen.

Ab sofort verfügbar

Lyria 3 ist ab sofort in Gemini für alle Nutzer ab 18 Jahren auf Deutsch, Englisch, Französisch, Hindi, Japanisch, Koreanisch, Portugiesisch und Spanisch verfügbar. Weitere Sprachen sind Google zufolge geplant. Abonnenten von Google AI Plus, Pro und Ultra erhalten zudem höhere Nutzungslimits, zu deren konkreter Ausgestaltung Google bislang jedoch keine weiteren Informationen veröffentlicht hat.

Apps & Mobile Entwicklung

Ehemalige OpenAI-Mitarbeiter beteiligt: Neuer Fond soll Startups gezielter fördern

Mit dem neuen Risikokapitalfonds „Zero Shot“ wollen unter anderem ehemalige Mitarbeiter von OpenAI, nicht zuletzt auf Grundlage eigener Erfahrungen, künftig vielversprechende Startups identifizieren und gezielter fördern. Eine erste Finanzierungsrunde wurde bereits erfolgreich mit 100 Millionen US-Dollar abgeschlossen.

Viel Wissen von OpenAI

Zu den Gründungsmitgliedern des nach einem Begriff aus dem KI-Training benannten Fonds zählen unter anderem drei ehemalige Mitarbeiter von OpenAI: Evan Morikawa, der während der Einführung von DALL-E und ChatGPT über Codex als Leiter der angewandten Technik tätig war, Andrew Mayne, ursprünglicher Prompt-Engineer und zugleich Moderator des OpenAI-Podcasts, sowie Shawn Jain, ehemaliger Ingenieur und Forscher. Zum Führungsteam gehören darüber hinaus Kelly Kovacs, zuvor Gründungspartner der Venture-Capital-Firma 01A, sowie Brett Rounsaville, der zuvor bei Twitter und Disney tätig war. Auch im Kreis der Berater finden sich bekannte Namen aus dem OpenAI-Umfeld, darunter Diane Yoon, ehemalige Personalchefin, Steve Dowling, ehemaliger Kommunikationsleiter, sowie Luke Miller, ehemaliger Produktleiter bei OpenAI.

Andere Fonds fördern viel unwichtiges

Als Begründung für die Gründung eines weiteren Risikokapitalfonds, der in einem bereits stark umkämpften Markt agiert, führen die Beteiligten eine aus ihrer Sicht bestehende große Lücke zwischen den zahlreichen finanzierten KI-Startups und dem tatsächlichen Bedarf des Marktes an. Auf Basis eigener Erfahrungen vertreten sie die Auffassung, ein besonders gutes Gespür dafür zu besitzen, „wohin die Reise geht“, wie Andrew Mayne in einem Gespräch mit TechCrunch erklärt. Durch ihre bisherige Tätigkeit würden sie Künstliche Intelligenz tiefergehend verstehen als viele andere Kapitalgeber, die vielfach in nahezu jedes Projekt investieren, das auch nur entfernt mit KI in Verbindung steht. Entsprechend soll gezielt nach Startups gesucht werden, die dem Bereich tatsächlich neue Impulse verleihen oder bestehende Lücken schließen.

Zu diesem Erfahrungsschatz gehöre jedoch ebenso die Fähigkeit, ungeeignete Ideen frühzeitig zu erkennen und bewusst zu meiden. So zeigt sich Mayne gegenüber vielen Varianten des Vibe-Codings skeptisch, da er davon ausgeht, dass Modellentwickler mit ihrem eigenen Programmierwissen entsprechende Plattformen und deren Abonnementmodelle rasch obsolet machen könnten. Evan Morikawa erklärt in dem Gespräch hingegen, dass er aufgrund seiner Kenntnisse in KI und Robotik kein Befürworter der zahlreichen „ergozentrischen Videodatenunternehmen ist, die es derzeit in der Robotik gibt“, die an Trainingsdaten für verkörperte Robotik arbeiten.

Bereits zahlreiche Projekte unterstützt

Der Fonds hat bereits eine Reihe von Projekten unterstützt. Dazu zählt unter anderem das Startup Worktrace AI der ehemaligen OpenAI-Produktmanagerin Angela Jiang. Dieses entwickelt eine KI-basierte Management-Softwareplattform, die Unternehmen dabei unterstützen soll, Aufgaben zu automatisieren, indem zunächst identifiziert wird, welche Prozesse sich dafür eignen. Laut Schätzungen von PitchBook konnte das Startup bereits eine Seed-Finanzierungsrunde in Höhe von 10 Millionen US-Dollar mit namhaften Investoren wie Mira Murati und dem OpenAI-Fonds abschließen.

Ein weiteres gefördertes Projekt ist Foundry Robotics, das an KI-gestützter Fabrikrobotik der nächsten Generation arbeitet. Das Unternehmen hat kürzlich eine Seed-Finanzierung in Höhe von 13,5 Millionen US-Dollar unter der Führung von Khosla Ventures erhalten.

Apps & Mobile Entwicklung

Samsung Galaxy Book 6 Pro mit Panther-Lake-X7 überzeugt

Im Samsung Galaxy Book 6 Pro steckt der zweitschnellste Intel-Panther-Lake-Prozessor und zeigt, was er kann, wenn das Notebook mitspielt. Denn in 16 Zoll kann sich der Core Ultra X7 358H leise voll ausleben und sorgt so für ein sehr gut ausbalanciertes Produkt. Auch sonst kann das Notebook im Komplettpaket überzeugen.

Auch Samsung geht in diesem Jahr in die Vollen und hat das im Januar zur CES vorgestellte Galaxy Book 6 im März auf den Markt gebracht. Los geht es ab 1.049 Euro, die Varianten Pro und Ultra kosten allerdings deutlich mehr. ComputerBase konnte nach dem Ersteindruck vor einigen Wochen das mittlere Modell nun einem ausführlichen Test unterziehen: das Samsung Galaxy Book 6 Pro in der 16-Zoll-Variante mit Intel Core Ultra X7 358H.

Ultra vs. Pro vs. „Normal“

Zuvor jedoch die Einordnung der Modelle in ihren drei Klassen. Die Ultra-Version mit zusätzlicher diskreter GPU packt Samsung nur in ein 16-Zoll-Gehäuse, die beiden Varianten darunter, die nur auf Panther Lakes integrierte Arc-Grafik setzen, gibt es alternativ in 16 oder 14 Zoll.

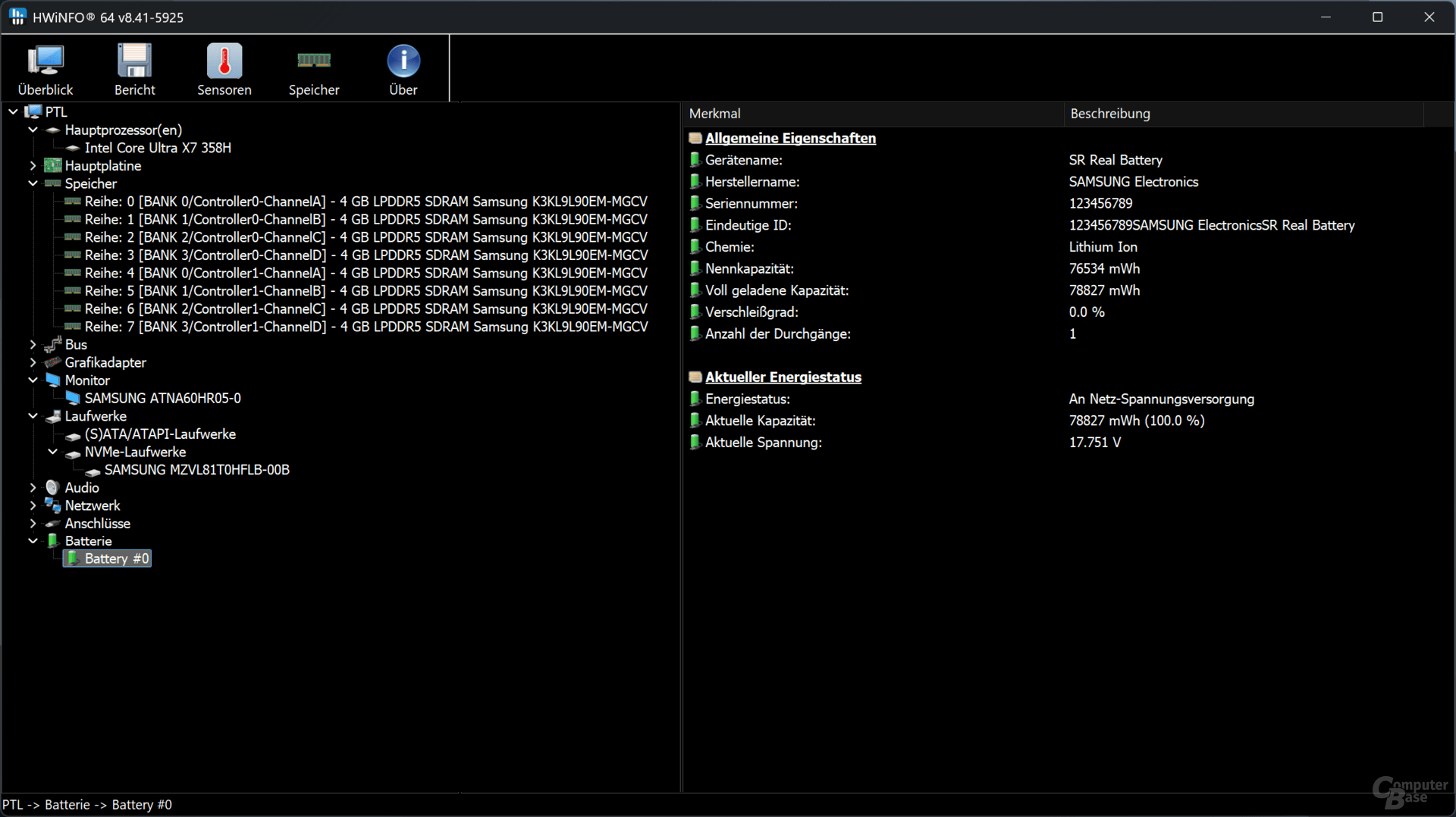

Samsung Galaxy Book 6 Pro ist (fast) All-in Samsung

Samsung-Notebooks nutzen in der neuen Generation einmal mehr vieles, was im eigenen Haus produziert wird. So stammt unter anderem der verlötete LPDDR5X-9600 von Samsung selbst, natürlich auch die 1-TByte-SSD. Das hochauflösende und mit 120 Hz angesteuerte OLED ist aber genau so aus dem Hause Samsung wie auch der verbaute 78-Wh-Akku, den eine andere Abteilung, aber letztlich immer noch Samsung produziert. Bekanntlich ist der Mischkonzern riesig, sodass viele Einzelteile eines Notebooks quasi „in house“ abgedeckt werden können.

Samsung Galaxy Book 6 Pro im Einsatz

Die Qualität des Notebooks weiß durchweg zu überzeugen. Das Gehäuse fühlt sich hochwertig an, es erinnert dabei stark an Apples MacBook Air und Pro. Unterschiede gibt es aber im Detail: So sind die Lautsprecher beispielsweise hier bei der Tastatur tiefer eingefasst, bei den MacBooks sitzen sie außen im Rahmen. Das kann bei der Nutzung etwas irritieren, denn neben den letzten Tasten links und rechts denkt man in den ersten Stunden stets, es würde etwas fehlen, und das provoziert mitunter sogar Vertipper – man denkt, der Buchstabe sei dort, ist er aber nicht. Wie üblich ist so etwas aber schnell Gewohnheitssache.

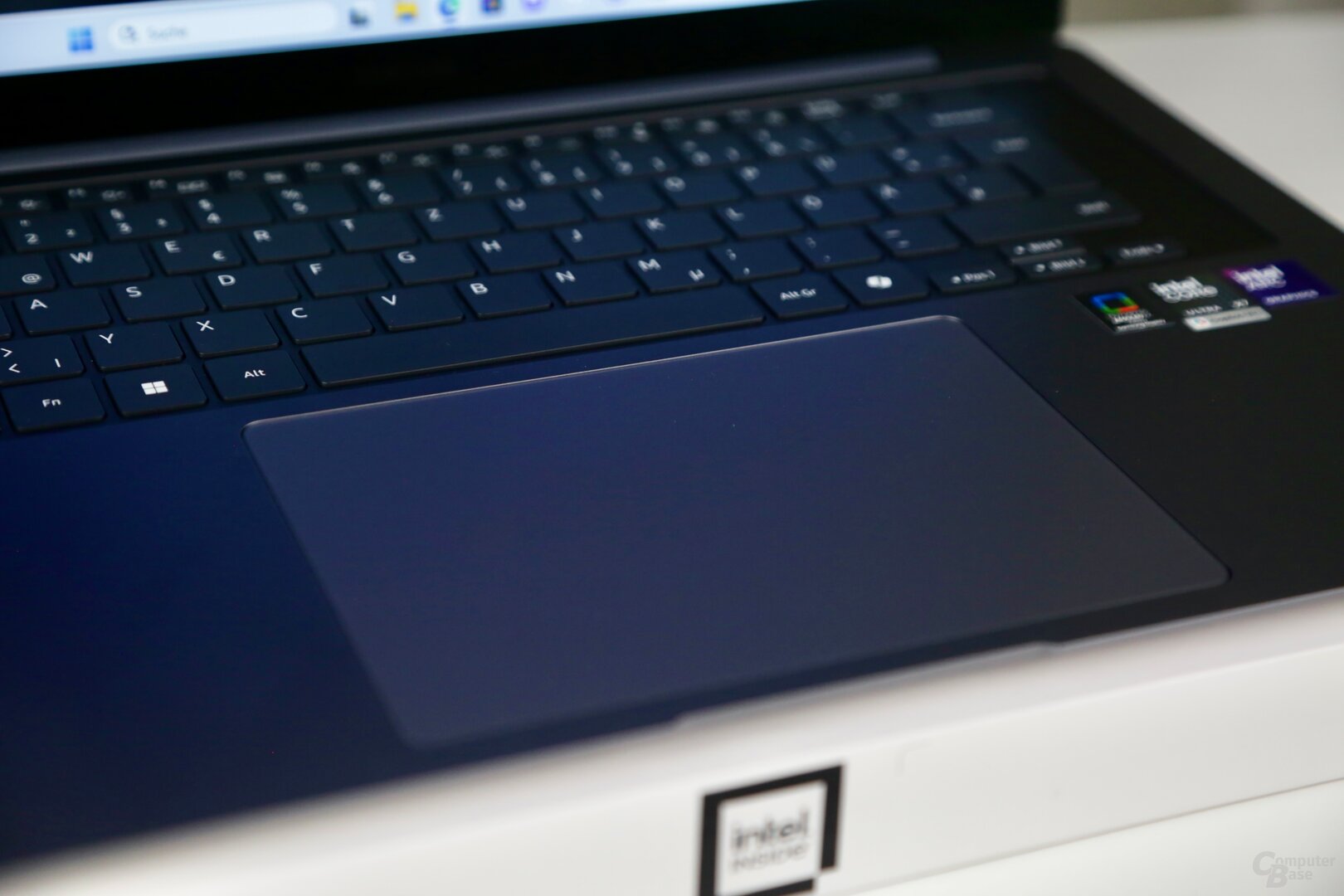

Überzeugen kann das große Display. 16 Zoll groß als AMOLED mit 2.880 × 1.800 Bildpunkten und 120 Hz lassen kaum Wünsche offen. Das gilt auch für das haptische Touchpad. Dieses ist supergroß und funktioniert auch gut, allerdings ist die Voreinstellung in Windows nicht für jeden direkt das Richtige. Mit ein wenig Feintuning kann aber auch das optimiert werden.

Ein wenig knapp bemessen sind jedoch die Anschlüsse des nicht gerade günstigen Modells, de facto gibt es nur USB und HDMI, dazu immerhin noch einen Klinkenanschluss. Alles in allem ist es aber Jammern auf ganz hohem Niveau, denn im Gesamtpaket gefällt das Notebook.

Apps & Mobile Entwicklung

Mehrere Gigawatt Rechenleistung: Anthropic baut Partnerschaft mit Google und Broadcom aus

Anthropic sucht weiterhin nach Wegen, die eigenen Kapazitätsengpässe zu beheben. Dazu hat das Unternehmen nun eine Partnerschaft mit Google und Broadcom angekündigt, die mehrere Gigawatt an TPU-Kapazität ermöglichen soll. Davon könnten auch Drittanbieter-Agenten profitieren, die zuletzt noch blockiert worden waren.

Knappe Kapazitäten führen zum Ausschluss von externen Agenten

Diese Engpässe waren von Kunden von Claude Code oder Cowork insbesondere zu Stoßzeiten bemerkt und kritisiert worden, weshalb sich Anthropic zu dem Schritt gezwungen sah, seine KI-Dienste für Drittanbieter-Tools wie OpenClaw zu sperren. Laut Claude-Code-Entwickler Boris Cherny seien Anthropics Kapazitäten nicht auf den Ansturm solcher Drittanbieter-Tools ausgelegt.

Mehr Rechenleistung in den USA ab nächstem Jahr

Mit der nun mit den Konzerngrößen Google und Broadcom geschlossenen Partnerschaft soll diesem Engpass entgegengewirkt werden. Die unterzeichnete Vereinbarung sieht vor, voraussichtlich ab 2027 mehrere „Gigawatt TPU-Kapazitäten der nächsten Generation“ aufzubauen, wie Anthropic in einem veröffentlichten Blog-Beitrag erklärt. Mit dieser Maßnahme soll zu diesem Zeitpunkt der Ausbau der eigenen Recheninfrastruktur beginnen, um die weltweit gestiegene Nachfrage nach KI-Diensten des Unternehmens bedienen zu können. „Wir bauen die Kapazitäten auf, die erforderlich sind, um dem exponentiellen Wachstum unserer Kundenbasis gerecht zu werden, so Krishna Rao, CFO bei Anthropic, im Beitrag.

Der Großteil der neuen Kapazitäten soll in den Vereinigten Staaten entstehen und damit die im November 2025 angekündigten Investitionen von 50 Milliarden US-Dollar in den Ausbau der amerikanischen Recheninfrastruktur unterstützen. Anthropic will dabei weiterhin auf eine hohe Diversität setzen, bei der verschiedene KI-Hardware wie AWS Trainium, Google TPU und NVIDIA-GPU zum Einsatz kommen, sodass für unterschiedliche Anforderungen die jeweils passende Technologie genutzt wird. Diese Vielfalt an Plattformen soll nicht nur die Leistung steigern, sondern auch die Ausfallsicherheit erhöhen, insbesondere für Kunden, die bei kritischen Anwendungen auf Claude angewiesen sind.

Anthropic will breit aufgestellt bleiben

Amazon soll trotz der neu geschlossenen Partnerschaft weiterhin sowohl primärer Cloud-Anbieter als auch Trainingspartner von Anthropic bleiben, zugleich soll die enge Zusammenarbeit mit AWS am Projekt Rainier fortgeführt werden. Claude soll dabei allerdings weiterhin das einzige wegweisende KI-Modell bleiben, das Kunden auf allen drei der weltweit größten Cloud-Plattformen zur Verfügung steht: Amazon Web Services (Bedrock), Google Cloud (Vertex AI) und Microsoft Azure (Foundry).

Erfolg fordert Maßnahmen

Diese Investitionen gelten auch als notwendig, da sich der Zustrom neuer Kunden im Jahr 2026 weiter beschleunigt hat. Der Run-Rate-Umsatz von Anthropic – eine betriebswirtschaftliche Kennzahl, die den aktuellen Umsatz eines Unternehmens auf ein volles Jahr hochrechnet – lag Ende 2025 bei rund 9 Milliarden US-Dollar und soll im laufenden Jahr auf 30 Milliarden US-Dollar ansteigen. Mit der Finanzierungsrunde im Februar 2026 hatte Anthropic mitgeteilt, dass rund 500 Geschäftskunden jeweils mehr als eine Million US-Dollar pro Jahr ausgeben; mittlerweile hat sich diese Zahl innerhalb von weniger als zwei Monaten auf 1.000 verdoppelt.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenX3D² bestätigt: Der AMD Ryzen 9 9950X3D2 mit doppeltem 3D V-Cache kommt!

-

Entwicklung & Codevor 4 Wochen

Entwicklung & Codevor 4 WochenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB