Künstliche Intelligenz

KI-Update kompakt: AI Impact Summit, Security Dashboard, Ring-Kameras, KI-Bremse

KI-Abkommen und Rufe nach Regulierung beim KI-Gipfel in Indien

Weiterlesen nach der Anzeige

Deutschland und Indien haben beim AI Impact Summit in Neu-Delhi ein KI-Abkommen unterzeichnet. Bundesdigitalminister Karsten Wildberger und sein indischer Amtskollege wollen indische IT-Expertise mit dem deutschen Mittelstand und der Industrie zusammenbringen. Im Fokus stehen Mobilität, Energieversorgung, Gesundheitswesen und smarte Produktion. Beide Seiten betonten zudem, KI im Einklang mit demokratischen Werten entwickeln zu wollen.

Sam Altman, Chef von OpenAI, nutzte den Gipfel, um vor einer Superintelligenz zu warnen, die schon in zwei Jahren Realität werden könne. Er forderte eine weltweite Aufsichtsbehörde nach dem Vorbild der Atomenergiebehörde. Allerdings passt das nur bedingt zu OpenAIs bisheriger Praxis, neue Modelle schnell auf den Markt zu bringen und Sicherheit nachzulagern. Die geforderte Regulierung dürfte eher darauf abzielen, wer KI entwickeln und betreiben darf. Zudem dienen solche Warnungen auch dem Marketing: Wer vor der eigenen Technologie warnt, lässt sie mächtiger erscheinen. Ob große Sprachmodelle überhaupt zu Superintelligenz führen können, bezweifeln zahlreiche Experten.

Microsoft investiert Milliarden für den KI-Ausbau im globalen Süden

Microsoft hat auf dem Gipfel in Neu-Delhi angekündigt, bis Ende des Jahrzehnts 50 Milliarden US-Dollar in KI-Infrastruktur für Länder des globalen Südens zu stecken. Präsident Brad Smith und die verantwortliche KI-Chefin Natasha Crampton begründeten den Schritt mit der wachsenden Kluft zwischen Industrie- und Entwicklungsländern bei der KI-Nutzung.

Das fünfteilige Programm umfasst den Aufbau von KI-Infrastruktur, die Ausweitung von Qualifizierung, die Stärkung mehrsprachiger Fähigkeiten, die Förderung lokaler Innovationen und die Messung der KI-Verbreitung als Grundlage für künftige Strategien.

Microsoft startet Vorschau auf Security Dashboard for AI

Weiterlesen nach der Anzeige

Microsoft hat den öffentlichen Test seines „Security Dashboard for AI“ gestartet. Das Werkzeug soll Unternehmen helfen, Sicherheitsrisiken beim Einsatz von KI zentral zu überwachen. Es bündelt Informationen aus verschiedenen Microsoft-Diensten wie Defender, Entra und Purview und liefert eine Echtzeitübersicht über alle genutzten KI-Ressourcen, von Microsoft 365 Copilot über eigene Entwicklungen bis zu Drittanbietern wie OpenAI oder Google Gemini.

Ein Übersichts-Tab macht auf einen Blick sichtbar, wo Risiken liegen, und gibt Empfehlungen zur Verbesserung der KI-Sicherheit. Für Kunden, die bereits Microsofts Sicherheitslösungen nutzen, fallen keine zusätzlichen Lizenzgebühren an. Das Dashboard ist direkt über das Microsoft-Security-Portal erreichbar.

Gemini 3.1 Pro soll deutlich besser schlussfolgern

Google hat Gemini 3.1 Pro vorgestellt, ein Upgrade seiner Modellfamilie. Das Modell soll primär beim logischen Schlussfolgern und beim Programmieren zulegen. In einigen von Google herausgestellten Benchmarks liegt es vor OpenAIs GPT-5.2 und Anthropics Claude Opus 4.6. In der Praxis bleibt allerdings ein bekanntes Problem: Googles Modelle setzen Werkzeuge oft weniger effizient ein als die Konkurrenz.

Das Modell ist ab sofort als Vorschau verfügbar, unter anderem über die Gemini-App, Google AI Studio und die Gemini-API. Die API-Preise entsprechen denen von Gemini 3 Pro und liegen deutlich unter denen von Anthropics Opus-Modellen. Google will auf Basis von Nutzerfeedback weitere Verbesserungen vornehmen, bevor eine allgemeine Verfügbarkeit folgt.

Google Gemini kann jetzt KI-Musik generieren

Googles Chatbot Gemini kann ab sofort Musik per generativer KI erstellen. Die 30 Sekunden langen Tracks werden mit einem unhörbaren Wasserzeichen versehen, um sie als KI-generiert zu kennzeichnen. Grundlage ist die dritte Version von Google DeepMinds Musikmodell „Lyria“. Nutzer geben lediglich eine Musikrichtung vor, Angaben zu Gesang, Stimmlage oder Tempo sind optional. Auch Bilder oder Videos können als Inspiration hochgeladen werden. Passend zum Musikstück erstellt Gemini automatisch eine Grafik als Cover, produziert vom integrierten Bildgenerator Nano Banana.

Google betont, dass die Generierung keine Urheberrechte verletze und keine Künstler nachahme. Bestehende Musikstücke dienten lediglich als Inspiration.

Wie intelligent ist Künstliche Intelligenz eigentlich? Welche Folgen hat generative KI für unsere Arbeit, unsere Freizeit und die Gesellschaft? Im „KI-Update“ von Heise bringen wir Euch gemeinsam mit The Decoder werktäglich Updates zu den wichtigsten KI-Entwicklungen. Freitags beleuchten wir mit Experten die unterschiedlichen Aspekte der KI-Revolution.

Claude Sonnet 4.6 rückt an Opus heran

Anthropic hat die neueste Version von Claude Sonnet veröffentlicht und stuft sie als bisher leistungsfähigste Sonnet-Variante ein. Das Modell soll beim Programmieren, beim Schlussfolgern, bei agentischen Aufgaben und im Design zulegen. Neu ist ein Kontextfenster von einer Million Token. In Anthropics eigenen Benchmarks liegt Sonnet 4.6 nun zwischen Opus 4.5 und Opus 4.6, obwohl Sonnet eigentlich das mittlere Modell der Claude-Familie ist.

Besonders hervor hebt Anthropic die Fähigkeit „Computer Use“, bei der das Modell reguläre Software fast wie ein Mensch bedient. Diese Funktion ist allerdings anfällig für Angriffe wie Prompt Injections, etwa versteckte Anweisungen auf Webseiten. Die neue Version soll solche Angriffe besser erkennen und umgehen, gelöst ist das Problem damit aber nicht. Claude Sonnet 4.6 wurde zunächst als Beta veröffentlicht und wird zum Standardmodell für Nutzer des kostenlosen Chatbots.

Ring-Kameras: Hundesuche war nur der Anfang

Amazons Tochter Ring warb beim Super Bowl für „Search Party“, eine Funktion, mit der Besitzer verlorener Hunde ein Foto hochladen und alle Ring-Türkameras in der Nachbarschaft per KI nach dem Tier suchen lassen können. Schon damals warnten Kritiker, es werde nicht bei Hunden bleiben. Eine nun aufgetauchte interne E-Mail vom Oktober bestätigt diese Befürchtung: Ring-Chef schrieb darin, die Hundesuche sei nur der Anfang, das Ziel sei, die Kriminalität in der Nachbarschaft auf null zu senken.

Ring hat die Echtheit der E-Mail bestätigt, verwies aber auf praktische Anwendungsfälle wie die Suche nach Haustieren oder Warnungen bei Bränden. Kritiker sehen in der Funktion die Vorbereitung einer Massenüberwachung, die mit Technik gewöhnlicher Konsumenten betrieben wird.

Perplexity verzichtet auf Werbung

Perplexity hat sich vorerst gegen Werbung entschieden, während Konkurrenten wie OpenAI mit ChatGPT Anzeigen testen. Perplexity gehörte 2024 selbst zu den ersten KI-Unternehmen, die gesponserte Antworten einblendeten. Eine Führungskraft erklärte der Financial Times, das Problem sei, dass Nutzer bei Werbung anfangen, die Antworten der KI anzuzweifeln.

Stattdessen konzentriert sich das Unternehmen darauf, die Richtigkeit seiner Antworten zu verbessern. Den Großteil seiner Einnahmen erzielt Perplexity aus kostenpflichtigen Abonnements zwischen 20 und 200 US-Dollar pro Monat.

Größte Seed-Finanzierung eines europäischen KI-Start-ups

David Silver, langjähriger KI-Forscher bei Google DeepMind, hat laut der Financial Times rund eine Milliarde Dollar für sein neues Start-up „Ineffable Intelligence“ eingesammelt. Die von Sequoia Capital angeführte Runde bewertet das Londoner Unternehmen mit etwa vier Milliarden Dollar. Silver, der maßgeblich an AlphaGo und Googles Gemini-Modellfamilie mitarbeitete, verließ DeepMind Ende vergangenen Jahres.

Ineffable Intelligence setzt auf Reinforcement Learning, bei dem KI-Systeme durch zahlreiche Versuche selbst lernen statt primär aus großen Textmengen. Im Zentrum stehen sogenannte Weltmodelle, mit denen KI-Agenten die Folgen ihrer Handlungen vorhersagen können. Silver reiht sich damit in eine wachsende Zahl führender KI-Forscher ein, die nicht glauben, dass die aktuelle Transformer-Architektur allein zu Superintelligenz führt.

Accenture macht KI-Nutzung zur Beförderungsvoraussetzung

Accenture, ein Beratungskonzern mit fast 800 000 Beschäftigten weltweit, erfasst seit diesem Monat wöchentlich die KI-Tool-Logins einzelner Senior-Mitarbeiter. Die Nutzung wird zum Beförderungskriterium, wie aus einer internen E-Mail hervorgeht, die die Financial Times einsehen konnte. In zwölf europäischen Ländern sind Beschäftigte von der Regelung ausgenommen.

Intern regt sich Widerstand: Zwei mit der Änderung vertraute Personen bezeichneten einige der Tools als „kaputte Slop-Generatoren“. Führungskräfte anderer großer Beratungsfirmen bestätigen, dass es schwieriger ist, erfahrene Manager zur KI-Nutzung zu bewegen als Nachwuchskräfte. Accenture-Chefin Julie Sweet kündigte an, Mitarbeitende, die sich nicht anpassen, müssten das Unternehmen verlassen. Der Aktienkurs von Accenture ist in zwölf Monaten um 42 Prozent gefallen.

KI-Notbremse für autonome Autos aus Magdeburg

Wissenschaftler der Otto-von-Guericke-Universität Magdeburg haben ein KI-gestütztes Verfahren vorgestellt, das erkennt, wenn die Sensordaten autonomer Fahrzeuge unzuverlässig werden, und im Zweifel eine Notbremsung auslöst. Die Methode kombiniert maschinelles Sehen mit maschineller Selbsteinschätzung: Die KI analysiert nicht nur, was sie wahrnimmt, sondern auch, wie verlässlich die Daten sind. Sinkt die Qualität unter einen Schwellenwert, reagiert das System automatisch.

Getestet wurde das Verfahren an einem autonomen Shuttle auf einem Uni-Testgelände. Bei leichtem Nebel, Regen oder Schneefall korrigierte das System die gestörten Sensordaten sogar eigenständig. Bei starkem Niederschlag stoppte das Fahrzeug kontrolliert. Dem Projektleiter zufolge war das System eher zu vorsichtig als zu riskant. Ob und wann die Technologie in Serienfahrzeuge kommt, ist offen, der Transfer in konkrete Anwendungen ist aber erklärtes Ziel.

Handbuch mit KI-Drohnen-Bauanleitungen der Frankfurt UAS

Die Frankfurt University of Applied Sciences hat ein Open-Source-Handbuch zum Bau von KI-Drohnen auf GitHub veröffentlicht. Es vermittelt praxisnah die technischen Grundlagen für Objekterkennung, autonome Navigation und automatisches Folgen von Zielen. Das Handbuch erklärt, wie Sensorik, Recheneinheiten und Software kombiniert werden, um Drohnen intelligent agieren zu lassen, und berücksichtigt dabei auch Kosten und Wirtschaftlichkeit.

Die Anleitungen basieren auf Erfahrungen aus dem Projekt „KI-gestützte Drohnenplattformen“ und zielen auf robuste Systeme für Tier- und Objekterkennung, Umweltmonitoring oder Inspektions- und Logistikaufgaben. Das Handbuch steht in Deutsch und Englisch bereit und soll von Studierenden und Forschenden der Fachhochschule laufend aktualisiert werden.

Love-Scams dank KI immer erfolgreicher

Liebesbetrug im Internet nimmt laut dem Landeskriminalamt seit Jahren deutlich zu, begünstigt durch den Einsatz von KI. Betrüger erstellen massenhaft Fakeprofile in sozialen Netzwerken und generieren mit KI-Tools täuschend echte Profilbilder. Sprachmodelle liefern auf Knopfdruck überzeugende Liebesnachrichten, moderne Übersetzungsprogramme sorgen für nahezu fehlerfreie Kommunikation in verschiedenen Sprachen.

Diese technischen Möglichkeiten senken den Aufwand und erhöhen die Schlagzahl der Angriffe erheblich. International operierende Netzwerke nutzen KI, um ihre Betrugsmaschen effizienter und schwerer erkennbar zu machen.

(igr)

Künstliche Intelligenz

Vorsicht, Kunde: Wie EWE Netz einen Smart-Meter-Nutzer zur Verzweiflung treibt

Eine PV-Anlage auf dem Dach, eine Wärmepumpe im Technikraum, ein E-Auto im Carport: Michael B. aus Norddeutschland zählt zu den Menschen, die die Energiewende im Privaten schon vollzogen haben. Um sein Auto gezielt dann zu laden, wenn der Strom gerade günstig ist, entschied sich der c’t- Leser außerdem für einen dynamischen Stromtarif.

Bevor B. diesen Tarif nutzen konnte, musste erst einmal sein alter Stromvertrag auslaufen, obendrein brauchte er ein Smart Meter. Diese Kombination aus digitalem Stromzähler („moderne Messeinrichtung“) und Kommunikationsmodul („Smart-Meter-Gateway“) ist mittlerweile die Voraussetzung für die Abrechnung zu dynamisch wechselnden Strompreisen.

Das Gateway erfasst viertelstündlich den Stromverbrauch des Haushalts und übermittelt die Daten einmal täglich an den sogenannten Messstellenbetreiber. Dieser gibt sie dann an den örtlichen Stromnetzbetreiber weiter, der sie wiederum an den Stromanbieter leitet. Im Fall von B. ist das Unternehmen EWE Netz mit Hauptsitz in Oldenburg gleichzeitig der zuständige Messstellen- und Stromnetzbetreiber.

Das war die Leseprobe unseres heise-Plus-Artikels „Vorsicht, Kunde: Wie EWE Netz einen Smart-Meter-Nutzer zur Verzweiflung treibt“.

Mit einem heise-Plus-Abo können Sie den ganzen Artikel lesen.

Künstliche Intelligenz

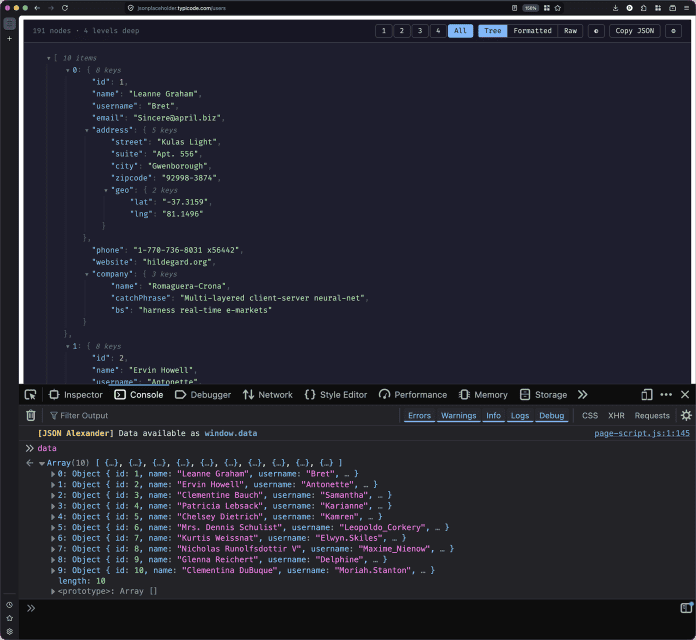

JSON Alexander: Syntax-Highlighting und Baumdarstellung im Browser

JSON Alexander, eine neue Extension für Firefox und Chrome, formatiert automatisch JSON-Daten, die beispielsweise von einer API gesendet wurden. Das Add-on erweitert die rudimentären Darstellungen der Browser insbesondere um Syntax-Highlighting und eine Baum-Ansicht.

Weiterlesen nach der Anzeige

JSON Alexander zeigt JSON-Daten übersichtlich formatiert.

(Bild: JSON Alexander)

Das Add-on bietet eine Reihe von Komfortfunktionen, die über die Standarddarstellung der Browser hinausgehen. Neben dem Syntax-Highlighting und den ausklappbaren Strukturbäumen sind das zum Beispiel Zusatzinfos beim Hover über ein Feld oder eine parallele Daten-Ansicht als windows.data in der Konsole.

JS-Autor und Podcaster Wes Bos hat JSON Alexander unter MIT-Lizenz veröffentlicht. Zuvor waren ihm Zweifel am Add-on „Heads Up“ gekommen, das ähnliche Funktionen bietet, weil es laut Bos Webtracking in Webseiten implementiert. Die Redaktion konnte das nicht überprüfen.

Das Add-on ist noch nicht in den Stores der Browser vorhanden, sondern Anwenderinnen und Anwender müssen es von Hand installieren. Bei Firefox müssen sie zusätzlich den JSON-Standardmechanismus deaktivieren. Anleitungen finden sich im Repository. Der Name des Tools spielt auf den US-amerikanischen Schauspieler Jason Alexander an.

Lesen Sie auch

(who)

Künstliche Intelligenz

Ethical Hacking für Fortgeschrittene – sich selbst hacken, bevor es andere tun

Mithilfe von Ethical Hacking nutzen Admins und IT-Sicherheitsverantwortliche die Techniken und Tools potenzieller Angreifer, um besser gegen diese gewappnet zu sein. Unser neuer Classroom Fortgeschrittenes Ethical Hacking – Deep Dive ins Pentesting für Admins gibt Ihnen ein noch tiefergehendes Wissen zur Abwehr an die Hand. Lernen Sie in fünf Sessions „richtig zu hacken“, um potenziellen Angriffen frühzeitig zu begegnen, indem Sie eigene Systeme auf Herz und Nieren prüfen.

Weiterlesen nach der Anzeige

Unser Experte Frank Ully widmet sich im Rahmen des Classrooms allen relevanten Bereichen, über die potenzielle Angreifer Zugriff auf Ihre Systeme erhalten können: Das betrifft sowohl externe Umgebungen und die eigene öffentliche IT-Infrastruktur als auch interne Netzwerke mit Fokus auf Active Directory (AD). Aber auch Webanwendungen und Web-Schnittstellen (APIs) stellen potenzielle Einfallstore dar, die Sie aus der Angreiferperspektive kennenlernen. Abschließend stehen auch die öffentlichen Clouds im Fokus, mit Schwerpunkt auf der Microsoft-Cloud (Entra ID, Microsoft 365) sowie Amazon Web Services (AWS).

Praxisbeispiele zum Angriff auf die eigenen Systeme

Für zahlreiche Bereiche zeigt unser Experte, in welcher absichtlich verwundbaren Umgebung Sie kostenfrei oder preiswert hacken und sich weiterbilden können – auch weit über diesen Classroom hinaus. Sie lernen das Ausnutzen von Schwachstellen, Erlangen weiterer Privilegien und Erreichen eines Ziels, etwa Ransomware im gesamten Netzwerk auszurollen.

Bereits ab dem zweiten Classroom oder einem Classroom und drei Videokursen rechnet sich unser Professional Pass mit Zugriff auf den gesamten heise academy Campus!

Mit diesem Wissen sind Admins in der Lage, Angriffe frühzeitig zu erkennen und bereits im Vorhinein zu erschweren. Sie kennen und beherrschen die Tools der Hacker und können dieses Wissen gegen potenzielle Angreifer anwenden. Die Termine sind:

- 09.06.26: Fortgeschrittenes Pentesting und OSINT für proaktive IT-Sicherheit

- 17.06.26: Metasploit unter Kali Linux – Command-and-Control- und andere Angriffs-Frameworks für Linux und Windows

- 23.06.26: Windows-Netzwerke angreifen – Dienste im Active Directory und Linux-Systeme proaktiv schützen

- 30.06.26: Schwachstellen in Webanwendungen und Web-APIs nutzen – fortgeschrittene Techniken

- 07.07.26: Unsichere Standardeinstellungen und Fehlkonfigurationen in der Microsoft-Cloud ausnutzen – und AWS weiter härten

Praxis- und Expertenwissen – live und für später

Weiterlesen nach der Anzeige

Die Sessions haben eine Laufzeit von jeweils vier Stunden und finden von 9 bis 13 Uhr statt. Alle Teilnehmenden können sich nicht nur auf viel Praxis und Interaktion freuen, sondern haben auch die Möglichkeit, das Gelernte mit allen Aufzeichnungen und Materialien im Nachgang zu wiederholen und zu vertiefen. Fragen werden direkt im Live-Chat beantwortet und Teilnehmer können sich ebenfalls untereinander zum Thema austauschen. Der nachträgliche Zugang zu den Videos und Übungsmaterialien ist inklusive.

Unser Experte für Cybersicherheit und Pentesting, Frank Ully, ist bereits bestens aus unserem Classroom „Ethical Hacking für Admins – Pentesting für eine sichere IT“ bekannt. Thematisch baut unser neuer Classroom auf diesem auf, eine vorherige Teilnahme wird aber nicht vorausgesetzt, sofern Sie bereits Erfahrungen mit Pentesting und Ethical Hacking besitzen. Weitere Informationen und Tickets finden Interessierte auf der Website des Classrooms.

E-Mail-Adresse

Ausführliche Informationen zum Versandverfahren und zu Ihren Widerrufsmöglichkeiten erhalten Sie in unserer Datenschutzerklärung.

(cbo)

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenX3D² bestätigt: Der AMD Ryzen 9 9950X3D2 mit doppeltem 3D V-Cache kommt!

-

Entwicklung & Codevor 4 Wochen

Entwicklung & Codevor 4 WochenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB