Apps & Mobile Entwicklung

Apple setzt bei Siri auf Google Gemini

Es grenzt an eine Kapitulation: Apple muss sich Hilfe beim Erzrivalen holen. Künftig soll Google Gemini die angestaubte Siri retten. Ein Milliarden-Deal, der Apples Abhängigkeit zementiert, aber für Euch endlich bessere KI-Features aufs iPhone bringt.

Es ist eine der wohl spektakulärsten Kehrtwenden der jüngeren Tech-Geschichte: Apple und Google gehen eine milliardenschwere Allianz ein. Was im Silicon Valley schon länger als Gerücht die Runde machte, bestätigte Apple zunächst gegenüber CNBC. Selbst für eingefleischte Apple-Fans dürfte das gemeinsame Statement mit Google überraschend gewesen sein. Darin heißt es:

Nach sorgfältiger Prüfung kam Apple zu dem Schluss, dass die KI-Technologie von Google die leistungsfähigste Grundlage für Apple Foundation Models darstellt, und freut sich auf die innovativen neuen Erfahrungen, die sie Apple-Nutzern ermöglichen wird. Apple Intelligence wird weiterhin auf Apple-Geräten und Private Cloud Compute laufen und dabei die branchenführenden Datenschutzstandards von Apple einhalten.

Für einen Konzern, der stolz darauf ist, Hard- und Software aus einer Hand zu liefern und die volle Kontrolle zu behalten, ist das weit mehr als ein normales Lizenzabkommen. Es ist das Eingeständnis, es allein nicht geschafft zu haben – und gleichzeitig ein cleverer Schachzug, um die eigene Relevanz zu sichern.

Der Apple-Google-Deal im Detail: Eine ungewöhnliche Ehe

Die mehrjährige Partnerschaft mit dem direkten Konkurrenten zeigt, wie dringend Apple den Rückstand bei der Künstlichen Intelligenz aufholen muss. Die Zahlen sprechen dabei für sich: Apple überweist rund eine Milliarde US-Dollar jährlich nach Mountain View.

Ihr bekommt auf dem iPhone aber kein „Standard-Gemini“ vorgesetzt. Es handelt sich um eine speziell angepasste Version mit etwa 1,2 Billionen Parametern, die als neues Gehirn für Siri dient – ein gewaltiger Sprung im Vergleich zu Apples bisherigem Cloud-Modell mit seinen 150 Milliarden Parametern.

Gemini soll dabei das Fundament für rechenintensive Aufgaben bilden. Wir erwarten, dass die neue, Gemini-gestützte Siri-Version voraussichtlich im Frühjahr 2026 mit iOS 26.4 an den Start geht. Dass Apple diesen Schritt geht, ist jedoch kein Zeichen von neuer Offenheit, sondern die bittere Konsequenz jahrelanger Versäumnisse. Der einstige Pionier der Sprachassistenten ist im KI-Rennen zum Nachzügler geworden.

Eingeständnis des Scheiterns: Warum Apples KI-Strategie nicht aufging

Dass Apple die Intelligenz für Siri extern einkauft, ist ein klares Eingeständnis, dass die eigene KI-Strategie gescheitert ist. Die Gründe liegen tief in der Firmenkultur: Der interne Drang, externe Lösungen zu meiden – lange Zeit ein Erfolgsgarant – wurde im rasanten KI-Wettlauf zum Bremsklotz.

Die Probleme haben sich über Jahre aufgestaut. Siri entwickelte sich von der Revolution zur Lachnummer, ausgebremst durch eine fragmentierte und veraltete Architektur, die mit ChatGPT und Co. nicht mehr mithalten konnte.

Das Resultat ist ein technologischer Rückstand von geschätzt 18 bis 24 Monaten gegenüber OpenAI und Google. Eigene Modelle waren nicht leistungsfähig genug, um die auf der WWDC 2024 angekündigten „Apple Intelligence“-Funktionen zuverlässig umzusetzen.

Hinzu kam ein massiver „Brain Drain“: Frustrierte Talente verließen das Unternehmen unter anderem Richtung Meta, weil Bürokratie und fehlende Visionen sie ausbremsten. Apple blieb kaum eine andere Wahl, als bei Google anzuklopfen – doch wie löst man dabei das Datenschutz-Problem?

Privacy First: Wie Apple Eure Daten schützt

Hier wird es technisch spannend und wichtig für alle Datenschutz-Bewussten unter Euch: Apple nutzt zwar Googles „Gehirn“, gibt aber die Kontrolle nicht ab. Das Zauberwort heißt „Private Cloud Compute“. Das Gemini-Modell läuft ausschließlich auf Apples eigener Server-Infrastruktur. Google liefert zwar den Code, hat aber keinen Zugriff auf die Hardware oder Eure Daten. Anfragen werden unter keinen Umständen an Google-Server weitergeleitet.

Auch der hybride Ansatz bleibt bestehen: Persönliche, sensible Aufgaben werden weiterhin lokal auf dem iPhone verarbeitet. Nur komplexes Weltwissen geht an das in Apples Cloud gehostete Gemini-Modell. So wahrt Apple den Schein der Privatsphäre, auch wenn die Technologie dahinter eingekauft ist. Für Cupertino ist das eine bittere Pille, aber eine notwendige taktische Atempause.

Blick in die Zukunft: Apple meldet sich zurück

Dieser Deal ist ein strategischer Drahtseilakt. Intern gilt er als Überbrückung, um Zeit für die Entwicklung eines eigenen Modells zu gewinnen, das Gemini später ersetzen soll. Zudem zwingen geopolitische Faktoren Apple zum Handeln, da Google beispielsweise in China nicht verfügbar ist und dort Partner wie Baidu nötig sind. Eine eigene KI-Plattform bleibt also Pflicht.

Kurzfristig rettet der Deal die Siri-Krise und macht das iPhone im KI-Zeitalter wieder konkurrenzfähig. Langfristig begibt sich Apple jedoch in eine unangenehme Abhängigkeit vom größten Rivalen. Für die nächste Zeit trägt Apple Intelligence zwar das Etikett aus Cupertino, das Herz schlägt aber im Takt von Mountain View. Im Silicon Valley muss man eben manchmal den Stolz runterschlucken, um im Spiel zu bleiben.

Was haltet Ihr von dieser „Zwangsehe“ – ist es Euch egal, wessen KI im Hintergrund werkelt, solange Siri endlich schlauer wird?

Apps & Mobile Entwicklung

Apple Silicon: M5 Pro und M5 Max sind Dual-Die-CPUs in 3 nm ohne E-Cores

Auf den M5 aus dem Oktober 2025 lässt Apple heute M5 Pro und M5 Max folgen. Für TSMCs 2-nm-Fertigung war das wohl noch zu früh, denn der Prozess bleibt N3P. Beide SoCs setzen sich aus zwei Dies zusammen, die über Apples eigene „Fusion Architecture“ besonders schnell miteinander verbunden worden sind.

Die neue Apple Fusion Architecture

M5 Pro und M5 Max setzen sich aus zwei Chiplets zusammen, die über die neue „Apple Fusion Architecture“ mittels Advanced Packaging verbunden werden. Die Bandbreite soll besonders hoch, die Latenz besonders niedrig ausfallen – genaue Details inklusive Schaubild liefert Apple per Pressemitteilung allerdings nicht.

Apple spricht bei der Fusion Architecture von „Apple-designed“, es dürfte sich aber um einen SoIC-Prozess von eben TSMC handeln, genauer gesagt den vorab bereits spekulierten SoIC-mH (molding horizontal). Bis dato nutzten nur die Ultra-Chips (M1 Ultra, M2 Ultra und M3 Ultra) direkt miteinander verbundene Chiplets.

M5 Pro and M5 Max introduce the Apple-designed Fusion Architecture, a state-of-the-art design that connects two dies into a single SoC. This brings together two third-generation 3-nanometer dies with high bandwidth and low latency using advanced packaging. The two dies include a powerful new CPU, scalable GPU, Media Engine, unified memory controller, Neural Engine, and Thunderbolt 5 capabilities.

M5-CPU und -GPU in viel größer

Neue 18-Kern-CPU mit Super-Cores und P-Cores

Sowohl M5 Pro als auch M5 Max bieten eine „neue 18-Core-CPU“, die neben sechs mit dem M5 eingeführten Performance-Cores, die Apple jetzt „Super Cores“ nennt, auch zwölf ganz neue Performance-Cores bieten soll. Die neuen großen „Super Cores“ entsprechen den P-Cores des M5, wurden rückwirkend jetzt aber umbenannt – auch im M5. Darunter positioniert Apple in M5 Pro und M5 Max ganz neue Performance-Cores – die E-Cores des M5 bieten sie nicht.

The industry-leading super core was first introduced as performance cores in M5, which also adopts the super core name for all M5-based products — MacBook Air, the 14-inch MacBook Pro, iPad Pro, and Apple Vision Pro. This core is the highest-performance core design with the world’s fastest single-threaded performance, driven in part by increased front-end bandwidth, a new cache hierarchy, and enhanced branch prediction.1

M5-GPU mit bis zu 40 CUs

Bei der GPU hat Apple die ebenfalls die mit dem M5 eingeführte neue Architektur hingegen vollständig übernommen, nur dass sie jetzt mit bis zu 20 (M5 Pro) respektive 40 (M5 Max) statt 10 (M5) Shader-Clustern daher kommt.

Leistungsvorteile gegenüber M4 Pro/Max

Für M5 Pro verspricht Apple bis zu 30 Prozent mehr Multi-Threading-Leistung gegenüber M4 Pro, 20 Prozent schneller soll die GPU in Grafik-Lasten sein (+35 Prozent mit Raytracing). Dank neuer Architektur und höherer Bandbreite soll Compute in Ausnahmeszenarien sogar um den Faktor 4 zulegen.

Für M5 Max nennt Apple „nur“ bis zu 15 Prozent mehr Multi-Threading-Leistung der CPU und erneut 20 Prozent mehr GPU-Leistung (Grafik, mit Raytracing +30 Prozent) gegenüber dem M4 Max. In Compute-Tasks sind auch hier bis zu 300 Prozent mehr Leistung drin.

M5 Pro mit bis zu 64 GB, M5 Max mit bis zu 128 GB RAM

Der M5 Pro wird von Apple mit bis zu 64 GB Unified Memory angeboten, die Bandbreite liegt bei bis zu 307 GB/s. Den M5 Max gibt es mit bis zu 128 GB Unified Memory, die Bandbreite erreicht bis zu 614 GB/s. Mehr Speicher gibt es also nicht, aber der Durchsatz fällt höher aus – das war auch beim M5 schon so.

AV1-Encoding lässt weiter auch sich warten

Die Video-Engine hat gegenüber dem M5 offensichtlich kein Update erfahren: H.264 und HEVC sowie ProRes werden zwar in Hardware De- und Encodiert, AV1 aber weiterhin nur in Hardware decodiert.

Apps & Mobile Entwicklung

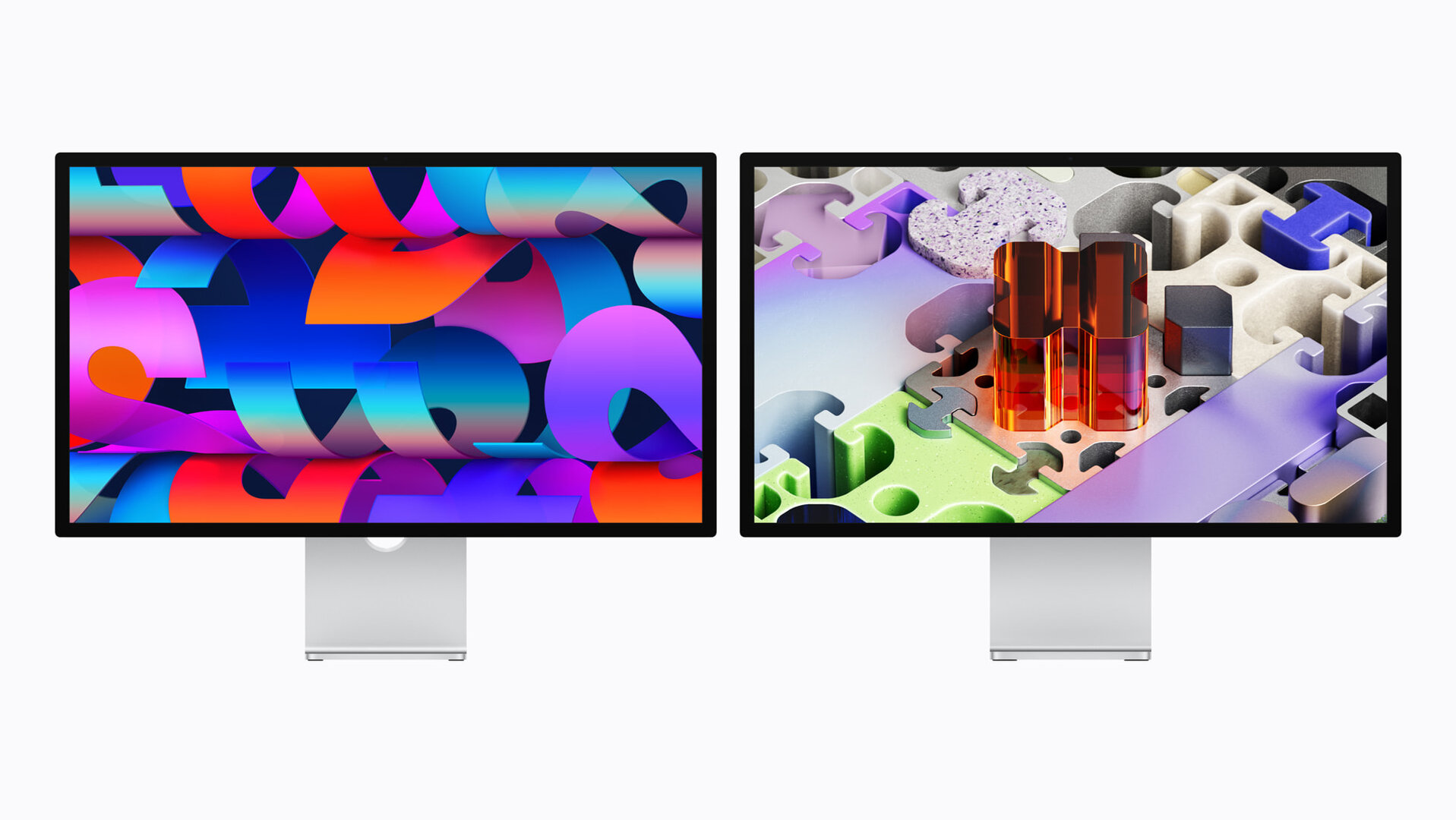

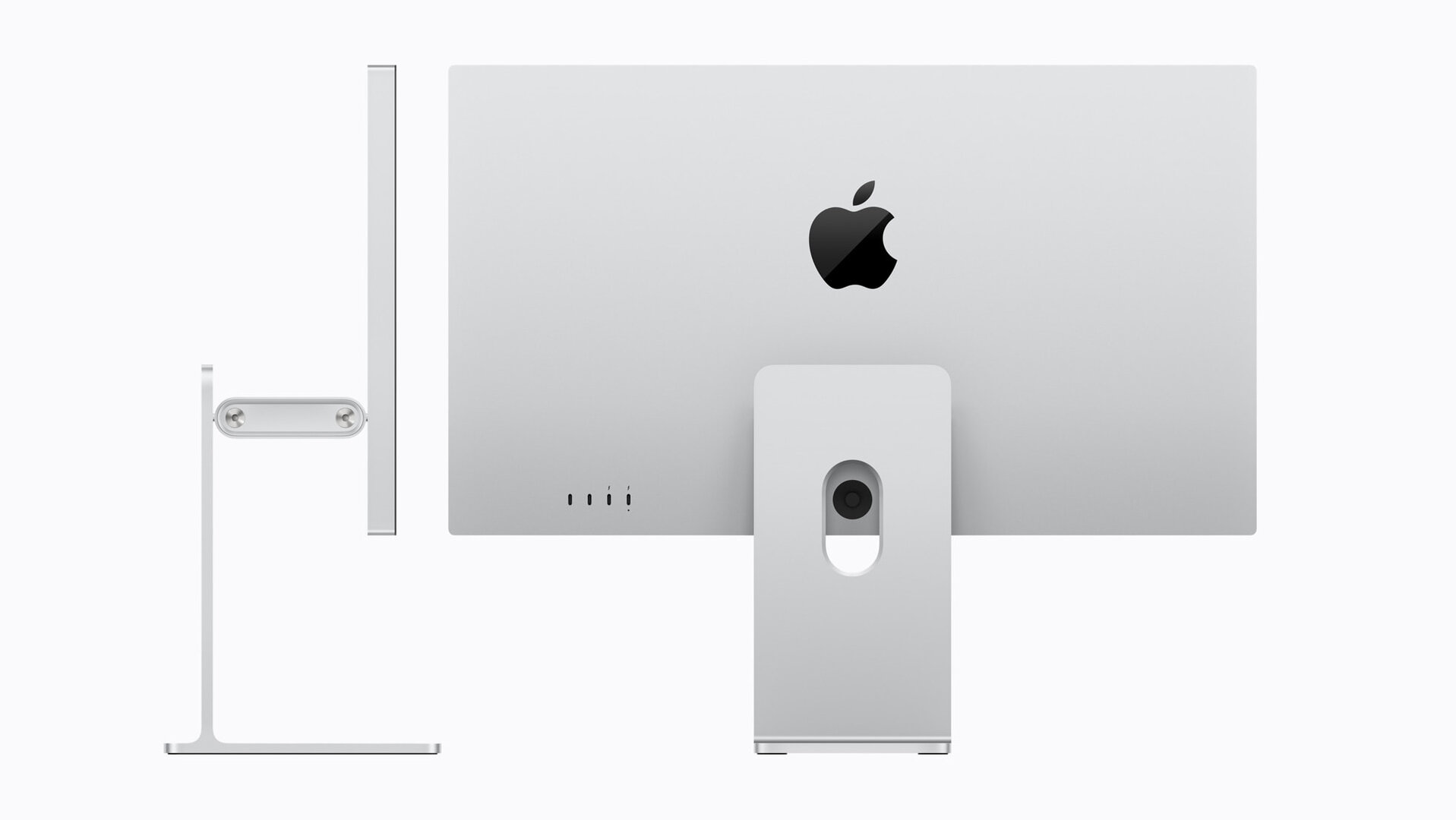

Studio Display (XDR): Apples 5K-Monitor erhält Thunderbolt 5 und Mini-LED-Option

Apple bringt zwei neue Monitore auf den Markt. Das Studio Display erhält nach rund 4 Jahren einen Nachfolger und eine XDR-Variante mit Mini-LED-Technik. Während es bei 5K-Auflösung und einmal auch 60 Hz bleibt, gibt es nun Thunderbolt 5, besseren Sound und (optional) einen höhenverstellbaren Ständer.

Apple Studio Display (2026) mit 60 Hz

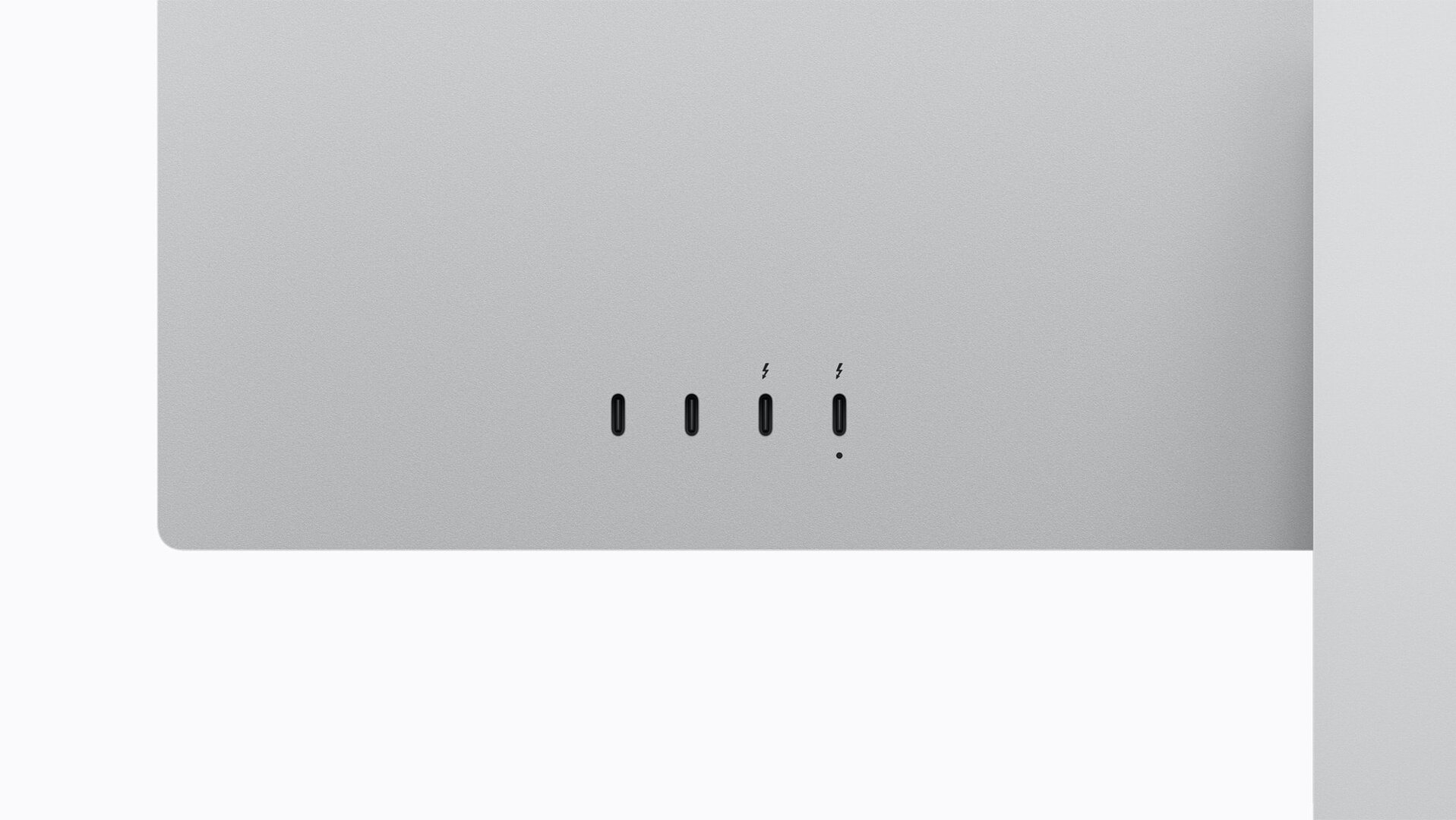

Apple verpasst seinem Studio Display einen neuen Ständer und moderne Anschlüsse. Optional und gegen Aufpreis gibt es nun einen Standfuß mit Höhenverstellung , die Standardausführung erlaubt nur das Neigen des Displays. Bei den Anschlüssen wird auf Thunderbolt 5 aktualisiert. Die Universalschnittstelle mit USB-C-Anschluss gibt es im Doppelpack: Als Eingang mit 96 Watt Power Delivery (etwa für ein Notebook) und als Ausgang (etwa für ein zweites Display). Daneben liegen noch zwei USB-C-Ports mit 10 Gbit/s.

Am eigentlichen Display ändert sich wenig, denn erneut wird die 5K-Auflösung 5.120 × 2.880 auf 27 Zoll Diagonale mit somit 218 ppi geboten. Helligkeit (600 cd/m²) und Bildwiederholrate (60 Hz) entsprechen auch dem Vorgängermodell aus dem Jahr 2022.

Überarbeitet wurden die integrierte 12-MP-Webcam (mit Center Stage und Desk View) sowie das Sound-System mit 6 Lautsprechern, 3 Mikrofonen und angeblich 30 Prozent tieferen Bässen.

Ab dem 4. März kann das neue Apple Studio Display vorbestellt werden und soll ab dem 11. März verfügbar sein. Die Preise beginnen bei 1.599 USD für die Standardversion mit normaler Glasfront und einfachem Ständer. Gegen 300 USD Aufpreis gibt es Nanotexturglas und der höhenverstellbare Ständer kostet weitere 400 USD. Somit ist die beste Ausstattung erst für 2.299 USD zu haben.

Apple Studio Display XDR mit Mini-LED und 120 Hz

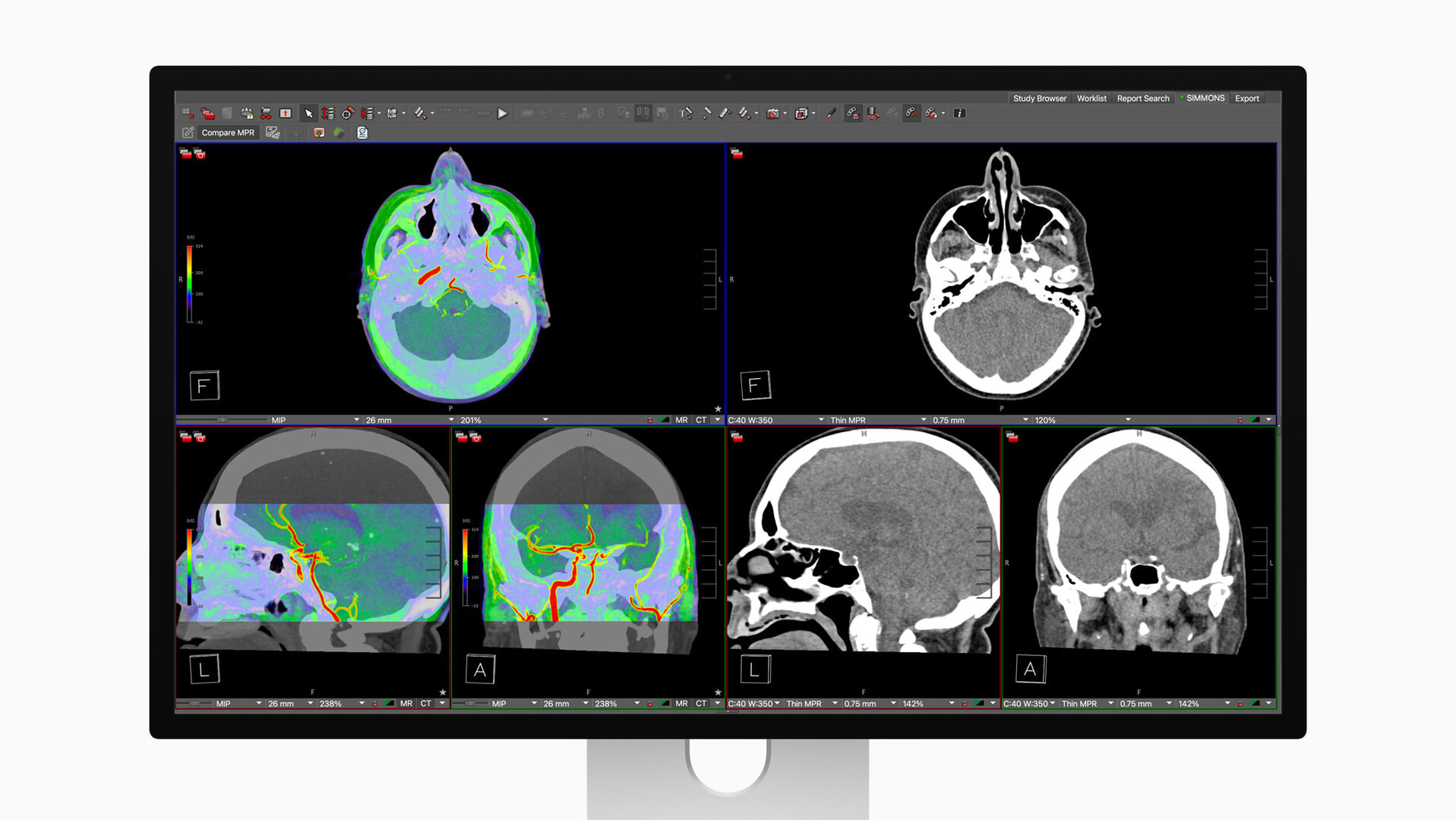

Erstmals gibt es eine „XDR“-Variante des Studio Display. Diese liefert die gleiche Auflösung von 5.120 × 2.880 Pixeln allerdings in Kombination mit einem Mini-LED-Backlight. Dieses verteilt sich auf 2.304 individuell dimmbare Leuchtzonen und soll 1.000 cd/m² im SDR-Betrieb und bis zu 2.000 cd/m² im HDR-Modus erreichen. Damit ist der Kontrastumfang (1 Mio. zu 1) weitaus größer als beim Standardmodell. Diesem hat die XDR-Version auch die auf 120 Hz verdoppelte Bildwiederholrate voraus. Angaben zur Reaktionszeit macht Apple nicht.

Profis sollen mit Voreinstellungen für Farbräume wie P3 und Adobe RGB, HDR-Inhalte und sogar für Digital Imaging and Communications in Medicine (DICOM) angesprochen werden. Die Anschlüsse entsprechen mit zweimal Thunderbolt 5 (in/out) und zweimal USB-C (10 Gbit/s) jenen des neuen Studio Display. Allerdings liefert der TB5-Upstream-Port sogar bis zu 140 Watt. Wie beim Studio Display hat auch das Studio Display XDR eine 12-MP-Kamera mit Center STage und Desk View sowie ein Soundsystem mit 6 Lautsprechern.

Das Apple Studio Display XDR ist ebenfalls ab dem morgigen 4. März vorbestellbar und ab dem 11. März erhältlich. Der Startpreis liegt bei hohen 3.299 USD mit Standardglas. Das „nano-texture glass“ gibt es auch hier gegen 300 USD Aufpreis. Der vielseitigere Ständer mit Höhen- und Neigungsverstellung ist wiederum bei der XDR-Version gesetzt und kostet nichts extra.

Apps & Mobile Entwicklung

CB-Fotowettbewerb: Im März fotografiert die Community Aufzüge

Der monatliche Fotowettbewerb der ComputerBase-Community geht in die nächste Runde. Im März 2026 werden Aufnahmen zum Thema „Aufzüge“ gesucht. Bilder können wie üblich bis zum 20. Tag des Monats eingereicht werden, dann beginnt die Abstimmung innerhalb der Community.

Aus dem Sitzen hoch hinaus

Im vergangenen Februar konnte sich zum Thema „Sitzgelegenheiten“ einmal mehr Community-Mitglied K P K behaupten: Seine Aufnahme zeigt eine verzierte Bank vor einer im Einklang verzierten Wand. Insgesamt gaben ihm 26 Prozent der Teilnehmer an der Abstimmung eine ihrer drei Stimmen.

Die Redaktion gratuliert zum gelungenen Foto und dem ersten Platz. Wie üblich gebührt K P K damit einhergehend das Recht, das Thema für den nachfolgenden Monat zu setzen. Gesucht sind diesmal Bilder zum Thema „Aufzüge“.

Aufzüge! Erlaubt sind: Personenaufzüge, Lastenaufzüge, Aufzüge in und außerhalb von Gebäuden, Aufzugskabinen von innen und außen. Auch eindrucksvolle Aufzugstüren und -eingänge sind okay und selbstverständlich auch Paternoster.

Community-Mitglied K P K

Damit sind alle interessierten Community-Mitglieder aufgefordert, bis zum 20. März 2026 um 23:59 Uhr eine Aufnahme (JPEG oder PNG) zum Thema per E-Mail mitsamt dem eigenen Benutzernamen im ComputerBase-Forum an Initiator lowrider20 einzusenden.

Teilnahmebedingungen und Abstimmung

Je registriertem Community-Mitglied ist die Teilnahme mit einem eigens aufgenommenen, beliebig alten Bild erlaubt, das in noch keinem vorherigen Fotowettbewerb eingereicht oder anderweitig im ComputerBase-Forum veröffentlicht wurde. Aufnahmen mit dem gleichen Motiv eines bereits veröffentlichten Bildes aus leicht abgeänderter Perspektive sind unerwünscht. Nicht gestattet sind überdies Zeichnungen, gemalte oder per KI generierte Bilder sowie Renderings. Einmal eingereichte Bilder können nicht mehr ausgetauscht werden.

Nach Einsendeschluss startet eine neuntägige Abstimmung zu allen, maximal aber den ersten 40 eingereichten Bildern, an der alle Leser mit Forum-Nutzerkonto teilnehmen dürfen. Um die Anonymität der Fotografen zu wahren, werden die Fotos auf maximal 3.840 Pixel in Höhe und Breite verkleinert und die EXIF-Daten entfernt. Der zum Ende des Monats feststehende Gewinner darf erneut über das Monatsthema der nächsten Runde entscheiden. Die Redaktion wünscht allen Teilnehmern viel Erfolg!

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 3 Wochen

Social Mediavor 3 WochenCommunity Management zwischen Reichweite und Verantwortung

-

Social Mediavor 2 Tagen

Social Mediavor 2 TagenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Künstliche Intelligenzvor 2 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenSyncthing‑Fork unter fremder Kontrolle? Community schluckt das nicht

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Anthropic verschenkt MCP – mit fragwürdigen Hintertüren

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenGame Over: JetBrains beendet Fleet und startet mit KI‑Plattform neu

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights