Apps & Mobile Entwicklung

Seagate Mozaic 4+: Die ersten 44-TB-Festplatten rotieren schon bei Kunden

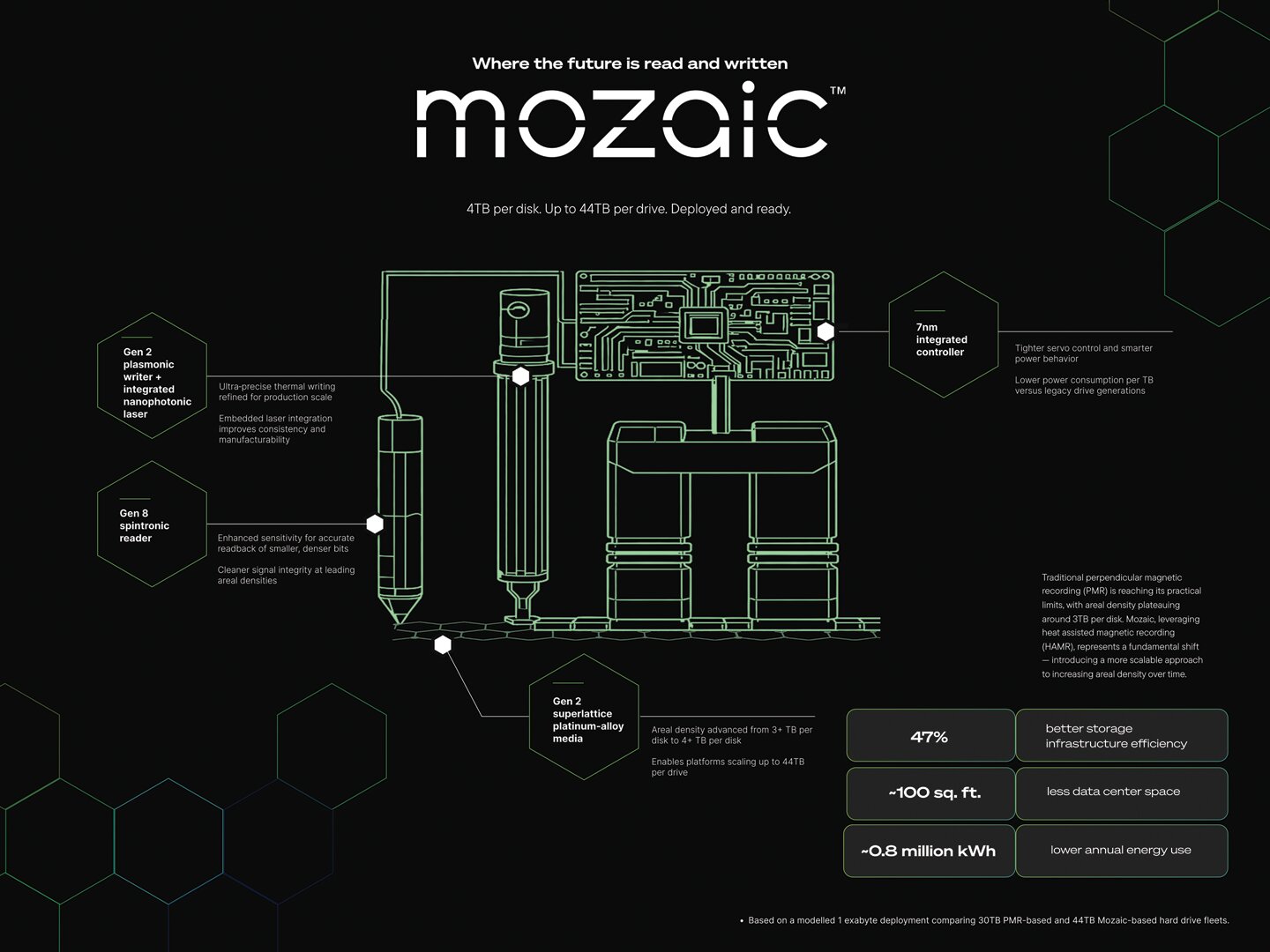

Bei der maximalen HDD-Speicherkapazität legt Seagate die Messlatte höher. Jetzt kommen über 4 TB pro Scheibe für 44 TB in der Spitze unter. Die neuen Festplatten für Rechenzentren erreichen diese Speicherkapazität mit der weiterentwickelten HAMR-Technik „Mozaic 4+“. Bei zwei Hyperscalern kommen sie schon zum Einsatz.

HAMR-Technik erreicht das nächste Level

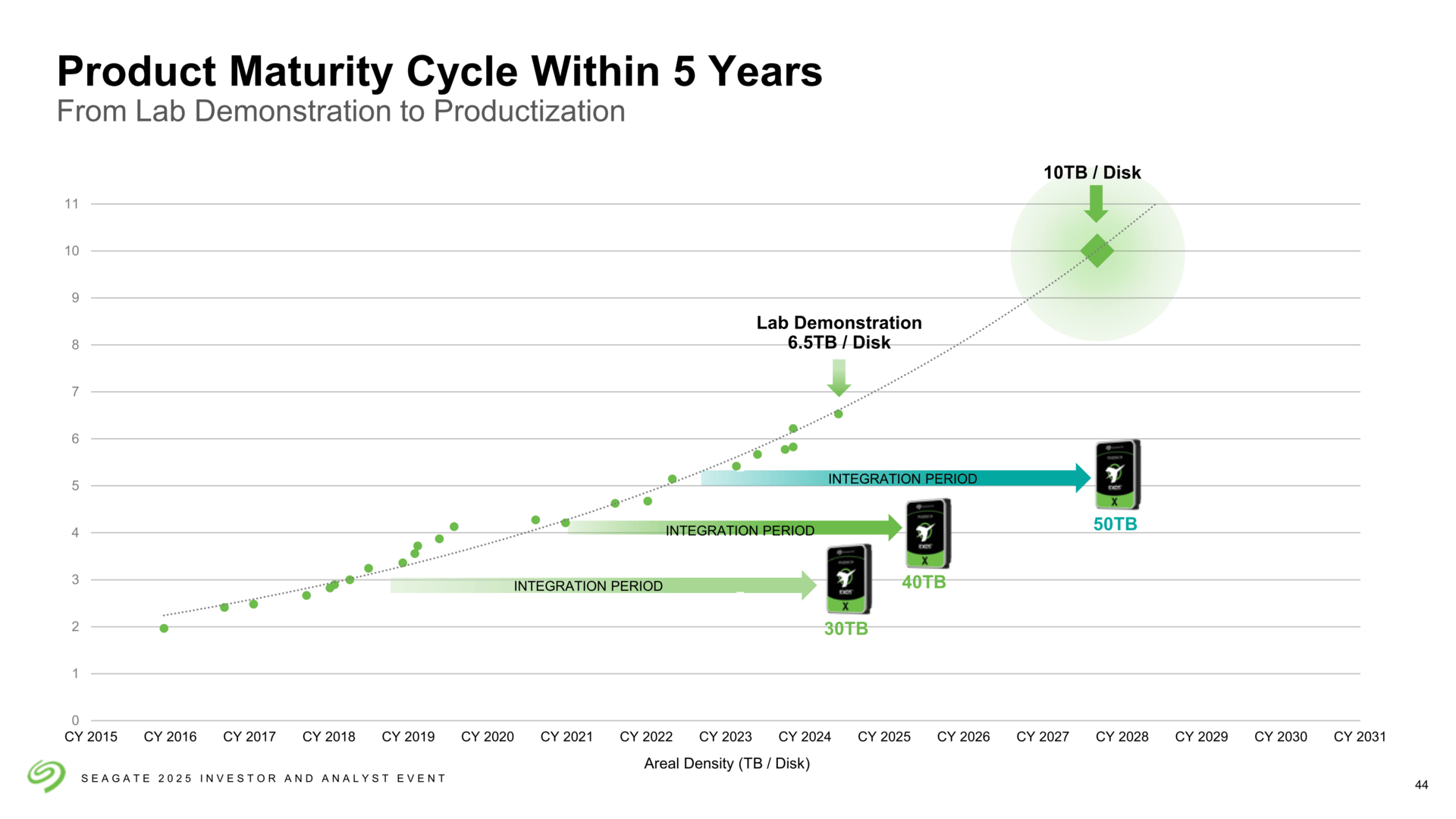

Bisher bot Seagate seine HAMR-Festplatten mit bis zu 32 TB an, 36 TB waren mit überlappenden Spuren (SMR) möglich. Bei 10 Magnetscheiben (Platter) ergab sich ein Speichervolumen von gut 3 TB pro Scheibe. Daher heißt diese Generation auch „Mozaic 3+“.

- IronWolf HDD mit HAMR im Test: Seagate presst mit Hitze 30 TB auf nur zehn Platter

- Seagate IronWolf Pro 32 TB im Test: Die derzeit größte HDD für NAS-Systeme

Doch jetzt kündigt der HDD-Hersteller die nächste Generation an: Mozaic 4+. Folglich steigt die Kapazität pro Platter auf über 4 TB. Dem 10-Platter-Design bleibt Seagate treu, sodass darauf mehr als 40 TB möglich werden. Die Rede ist von „bis zu 44 TB“, was Modelle mit etwa 40 TB oder 42 TB nicht ausschließt.

Es kommt SMR zum Einsatz

Wie ComputerBase auf Nachfrage beim Hersteller erfuhr, kommt bei Mozaic 4+ allerdings SMR-Technik mit überlappenden Spuren zum Einsatz. Das schränkt die Leistung beim erneuten Beschreiben ein, denn angrenzende Spuren müssen ebenso aktualisiert werden. Für „kalte“ Daten ist dies aber selten ein Problem. Dennoch stellt sich die Frage, wie viel TB bei konventioneller Aufzeichnung (CMR) möglich wären. Seagate erklärte, dass momentan Mozaic-HDDs bis 32 TB mit CMR und bis 44 TB mit SMR im Programm sind.

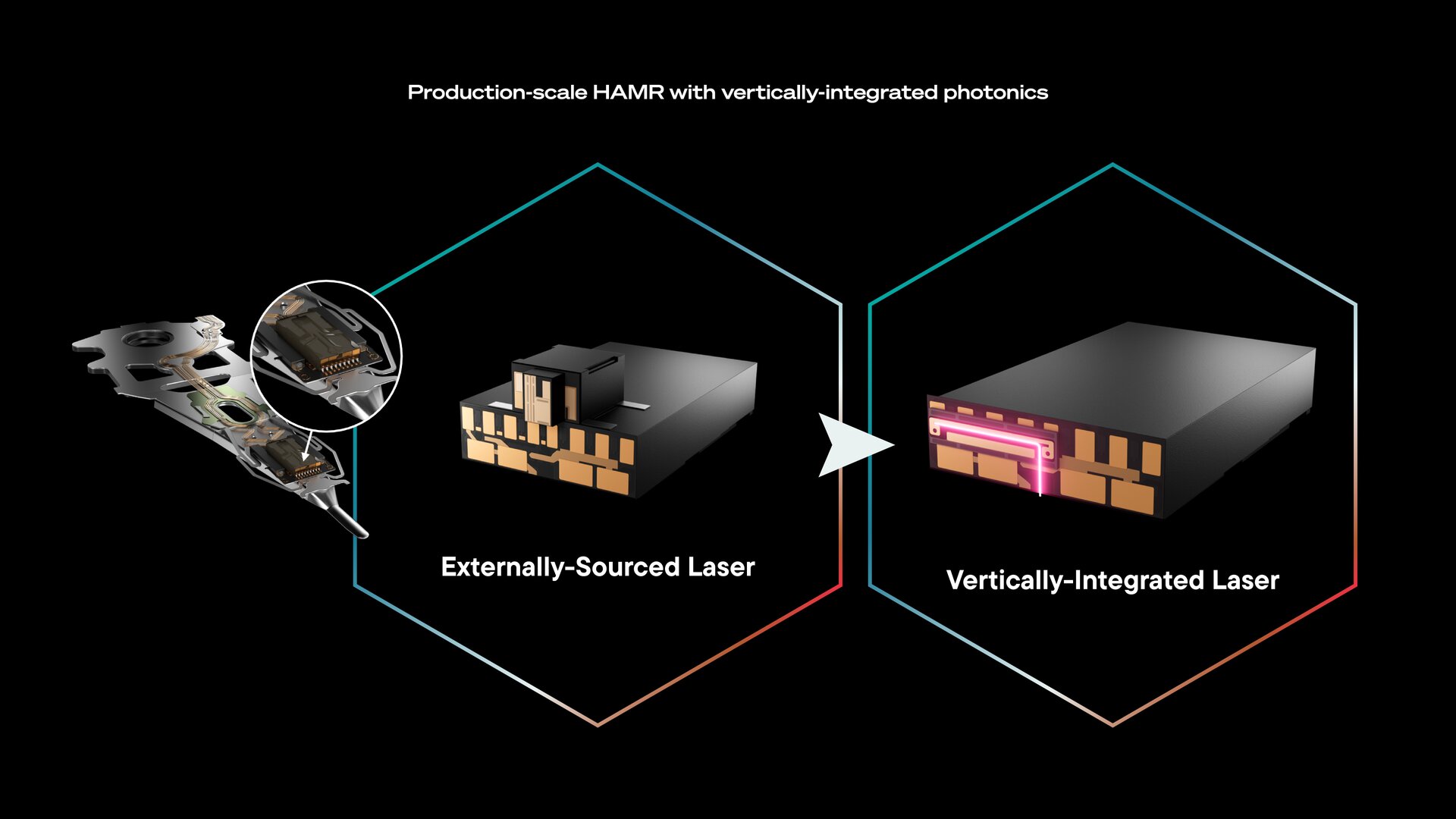

Bei der Technik geht Seagate nicht allzu sehr ins Detail, nennt aber „eine Suspension-Architektur der nächsten Generation und ein verbessertes System-on-a-Chip“ als Fortschritte mit der neuen Plattform. Die bereitgestellte Explosionsgrafik ist symbolisch gemeint, denn darauf sind nur 8 Platter zu sehen, die für 44 TB mehr als 5 TB bieten müssten. Eine 32-TB-Version ließe sich nun aber durchaus mit nur 8 Plattern dank Mozaic 4+ realisieren.

Neue Platten rotieren schon bei Kunden

Nach Angaben von Seagate wurde die Mozaic-4+-Plattform schon von zwei großen Hyperscale-Cloud-Providern qualifiziert. Beide würden nun „in hohen Stückzahlen“ mit den HDDs mit bis zu 44 TB beliefert, heißt es weiter. Um welche Kunden es sich dabei handelt, bleibt allerdings geheim.

Seagate will damit zeigen, dass die zuvor dargelegte Roadmap diesmal eingehalten wird. Die Marke von 40 TB war bereits im vergangenen Jahr auf 2026 datiert worden. Im gleichen Kontext wäre dann mit 50 TB für 2028 zu rechnen. Für die Zukunft sind 100 TB bei 10 TB pro Scheibe geplant. Im vergangenen November hatte Seagate erklärt, in den eigenen Forschungslaboren bereits 7 TB pro Platter erreicht zu haben.

KI sorgt für Nachfrage

Wie fast überall in der Branche ist auch bei diesen Produkten der vermehrte Einsatz von Künstlicher Intelligenz die Triebfeder. KI-Modelle benötigen riesige Datenmengen für ihr Training, die relativ kostengünstig auf Festplatten gesichert werden können. Da für die gleiche Speichermenge im Rechenzentrum mit den 44-TB-HDDs deutlich weniger Festplatten nötig sind als bisher, sinkt der Energie- und Platzbedarf. Im Gegenzug lässt sich viel mehr Speicher bei sonst gleichbleibender Infrastruktur realisieren.

„Der Bedarf an riesigen Datenmengen – sowohl realen als auch synthetisch generierten – ist für den Fortschritt der KI von entscheidender Bedeutung. Denn KI-Modelle entwickeln sich ebenso weiter wie die Fähigkeiten und Reichweite von GenAI-basierten Anwendungen“, zitiert Seagates Pressemitteilung Bob O’Donnell, den Präsidenten von TECHnalysis Research.

„Die HAMR-basierten Mozaic-Produkte von Seagate bieten die Skalierbarkeit, Leistung und

Effizienz, die Kunden benötigen, um das Potenzial ihrer Daten auszuschöpfen,“ erklärt wiederum Dave Mosley, Vorsitzender und CEO von Seagate.

Der Konkurrenz einen Schritt voraus

Seagate ist nach wie vor der einzige HDD-Hersteller, der HAMR-Festplatten auf den Markt gebracht hat – und das obwohl die Technik schon reichlich Verspätung hat.

Doch auch bei WD und Toshiba spielt HAMR künftig eine Rolle. WD wurde jüngst konkreter und kündigte seinerseits für den späteren Jahresverlauf seine ersten HDDs mit HAMR-Technik an. Dass diese ebenfalls bis zu 44 TB erreichen sollen (allerdings auf 11 Scheiben), ist womöglich kein Zufall. Die breite Verfügbarkeit wird aber voraussichtlich erst 2027 gegeben sein.

Während Seagate voll und ganz auf HAMR setzt, fährt WD aber vorerst zweigleisig: Parallel werden die PMR-Festplatten (ePMR) weiterentwickelt, aus denen WD noch bis zu 60 TB herauskitzeln will.

Die Redaktion hat Informationen in diesem Artikel von Seagate unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Im Test vor 15 Jahren: Intels Core i3-2100 bot Sandy-Bridge-Leistung für 95 Euro

Intel Core i7-2600K, 4C/8T, 3,40 GHz, 32 nm, Turbo, SMT

Intel Core i5-2500K, 4C/4T, 3,30 GHz, 32 nm, Turbo

Intel Core i7-980X, 6C/12T, 3,33 GHz, 32 nm, Turbo, SMT

Intel Core i5-2400, 4C/4T, 3,10 GHz, 32 nm, Turbo

Intel Core i7-960, 4C/8T, 3,20 GHz, 45 nm, Turbo, SMT

Intel Core i7-870, 4C/8T, 2,93 GHz, 45 nm, Turbo, SMT

Intel Core i5-760, 4C/4T, 2,80 GHz, 45 nm, Turbo

Intel Core i3-2120, 2C/4T, 3,30 GHz, 32 nm, SMT

Intel Core i3-2100, 2C/4T, 3,10 GHz, 32 nm, SMT

AMD Phenom II X6 1100T, 6 Kerne, 3,30 GHz, 45 nm, Turbo

AMD Phenom II X4 975, 4 Kerne, 3,60 GHz, 45 nm

AMD Phenom II X6 1075T, 6 Kerne, 3,00 GHz, 45 nm, Turbo

Intel Core i3-2120, 2C/2T, 3,30 GHz, 32 nm

Intel Core i5-661, 2C/4T, 3,33 GHz, 32 nm, Turbo, SMT

Intel Core i3-2100, 2C/2T, 3,10 GHz, 32 nm

Intel Core i3-540, 2C/4T, 3,06 GHz, 32 nm, SMT

Intel Core 2 Quad Q9550, 4C/4T, 2,83 GHz, 45 nm

AMD Phenom II X4 840, 4 Kerne, 3,20 GHz, 45 nm

AMD Athlon II X4 645, 4 Kerne, 3,10 GHz, 45 nm

AMD Phenom II X3 740, 3 Kerne, 3,00 GHz, 45 nm

AMD Athlon II X3 450, 3 Kerne, 3,20 GHz, 45 nm

AMD Phenom II X2 565, 2 Kerne, 3,40 GHz, 45 nm

Intel Core 2 Quad Q6600, 4C/4T, 2,40 GHz, 65 nm

AMD Athlon II X2 265, 2 Kerne, 3,30 GHz, 45 nm

Apps & Mobile Entwicklung

OpenAI Codex: Der Coding-Assistent kann jetzt auch den Mac steuern

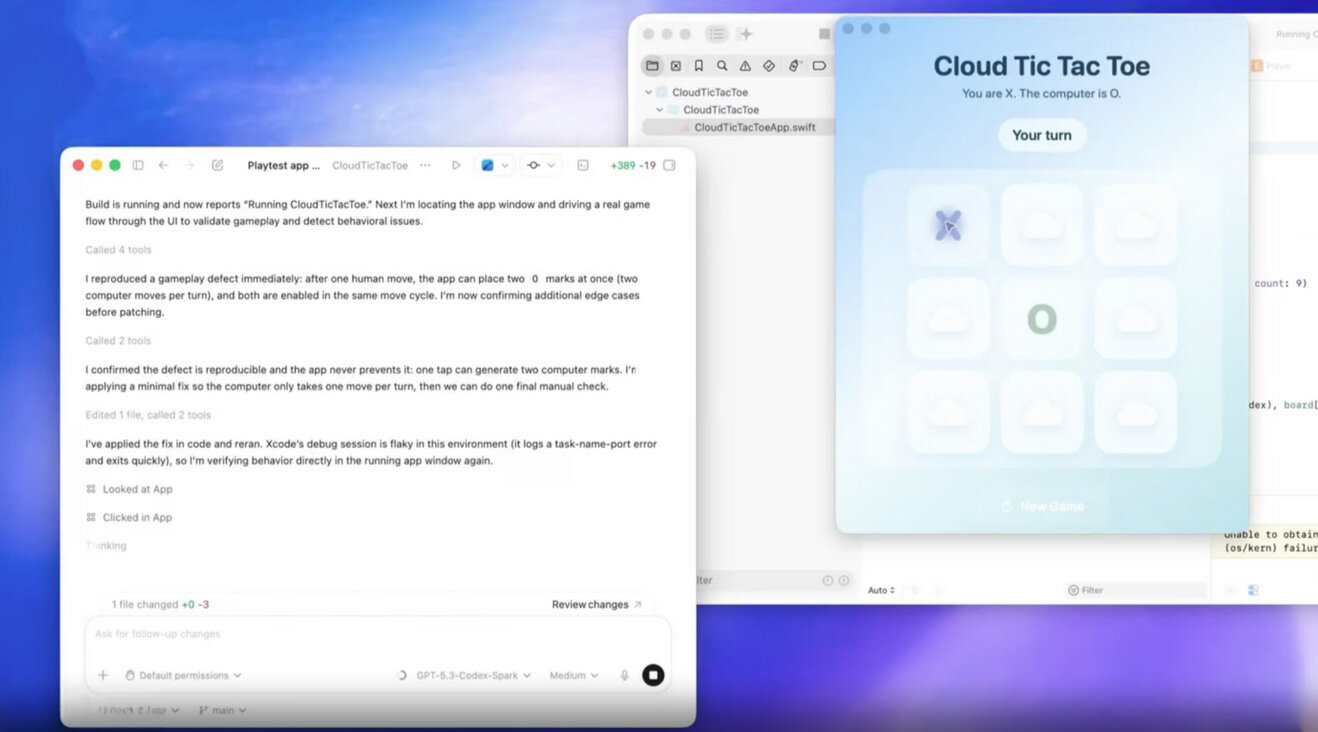

OpenAI hat ein Update für seinen KI-Agenten zur Software-Entwicklung veröffentlicht, das den Rückstand auf den in vielen Bereichen enteilten Konkurrenten Claude Code (Test) verringern soll, wobei ein Teil der Funktionen zunächst ausschließlich unter macOS verfügbar ist – Mac-Steuerung inklusive.

Vom kleinen Agenten zum kompletten Hub

OpenAI hatte Codex 2025 ursprünglich als Cloud-basierten Agenten für die Software-Entwicklung vorgestellt, der parallele Aufgaben in Sandbox-Umgebungen übernehmen konnte. Mit einem im März dieses Jahres bereitgestellten Update wurde daraus eine Desktop-Kommandozentrale für parallel arbeitende Agenten.

Das nun veröffentlichte Update geht einen Schritt weiter und erlaubt es der KI, den Rechner im Hintergrund aktiv zu nutzen. Ausgestattet mit einem eigenen Cursor kann Codex eigenständig agieren, Programme öffnen und innerhalb dieser arbeiten. Dabei lernt der Agent aus früheren Aktionen, sodass im Laufe der Zeit immer mehr wiederkehrende Aufgaben automatisiert übernommen werden können.

Eigenständiges Arbeiten über viele Apps hinweg

Anwender von macOS sollen Codex nun auch zur direkten Steuerung ihres eigenen Rechners einsetzen können, wobei der Assistent mit einer größeren Bandbreite an Anwendungen zusammenarbeitet und sogar SSH-Zugriff bietet. Damit entwickelt sich Codex vom reinen KI-Werkzeug zu einem umfassenden Workflow-Hub. Dabei können auch mehrere Agenten parallel auf dem Mac aktiv sein. Laut OpenAI sollen diese Möglichkeiten Entwickler deutlich entlasten, indem Agenten etwa Frontend-Anpassungen übernehmen, parallel Anwendungen testen oder auch in Programmen ohne verfügbare API arbeiten. Über den integrierten Browser kann Codex zudem direkt online agieren. Künftig soll der Agent den Browser auch über Web-Anwendungen hinaus auf dem lokalen Host steuern können.

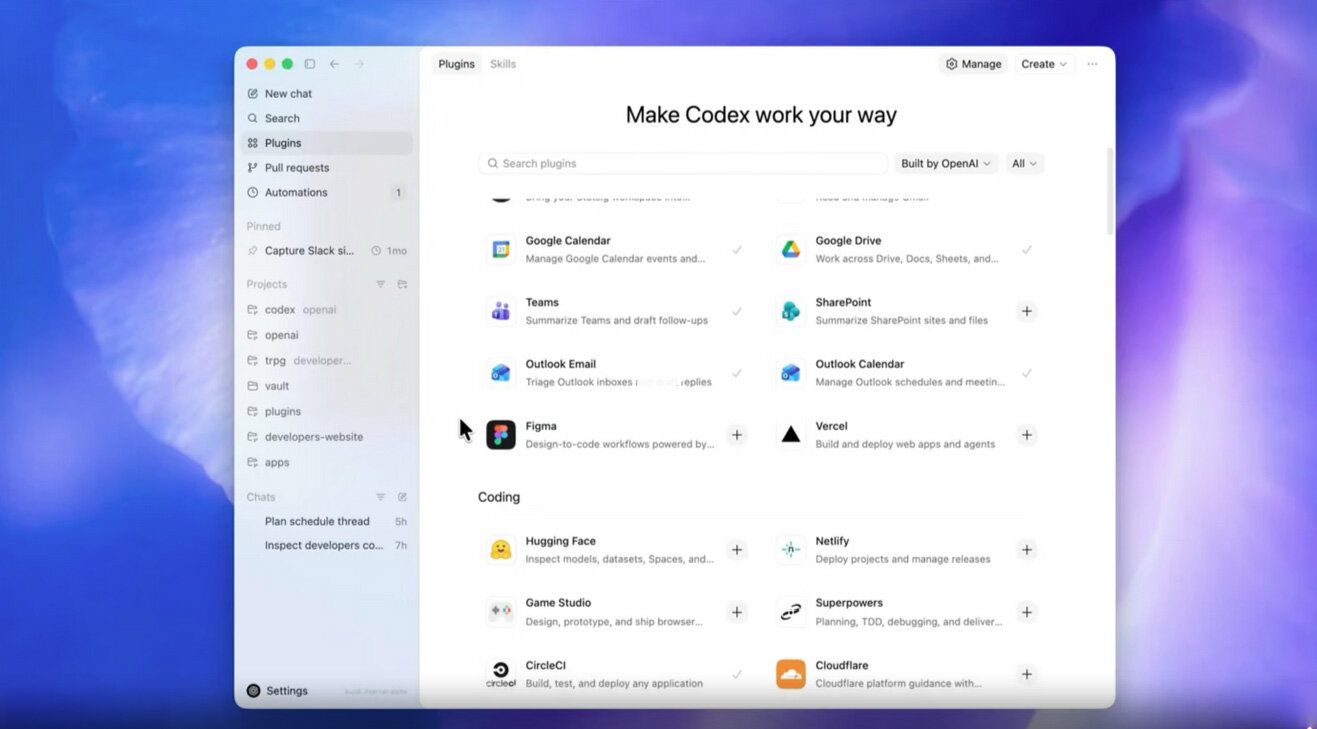

Darüber hinaus ist der Agent nun in der Lage, über gpt-image-1.5 eigenständig Bilder zu generieren. In Kombination mit Screenshots innerhalb desselben Workflows lassen sich so Visualisierungen für Produktkonzepte und ähnliche Szenarien erstellen. Zum Start der neuen Codex-Iteration kündigt OpenAI außerdem mehr als 90 zusätzliche Plugins an, die Fähigkeiten, App-Integrationen und MCP-Server bündeln sollen. Dadurch soll der Assistent mehr Kontext erfassen und über verschiedene Anwendungen hinweg gezielt Aktionen ausführen können. Zu den neuen Plugins, die Entwickler deutlich entlasten sollen, zählen unter anderem Atlassian Rovo zur Verwaltung von JIRA, CircleCI, CodeRabbit, GitLab Issues, Microsoft Suite, Neon von Databricks, Remotion, Render und Superpowers.

Die Anwendung unterstützt ab sofort zudem die Bearbeitung von GitHub-Review-Kommentaren, das parallele Ausführen mehrerer Terminal-Tabs sowie die Verbindung zu Remote-Devboxes über SSH, zunächst allerdings lediglich in einer Alpha-Version. Dateien lassen sich direkt in der Seitenleiste mit umfangreichen Vorschauen für PDFs, Tabellen, Präsentationen und Dokumente öffnen. Ein neuer Übersichtsbereich sorgt außerdem dafür, dass Agentenpläne, Quellen und Artefakte jederzeit nachvollziehbar bleiben.

Codex wird selbstständiger

Parallel dazu hat OpenAI die Automatisierungsfunktionen erweitert, um bestehende Konversationen wiederverwenden zu können und so den aufgebauten Kontext zu erhalten. Dadurch wird Codex in die Lage versetzt, Aufgaben eigenständig zu planen und langfristig auch ohne erneute Zuweisung durch den Anwender auszuführen. Bestandteil des Updates ist zudem eine Vorschau auf eine Speicherfunktion, mit der sich der Agent relevante Zusammenhänge aus früheren Arbeiten merken kann, darunter persönliche Präferenzen, Korrekturen und weitere Informationen. Ergänzend schlägt Codex proaktiv sinnvolle Aufgaben vor, um den Anwender gezielt zu unterstützen.

Ab heute für macOS-Nutzer verfügbar

Die Nutzung auf dem eigenen Rechner steht zunächst ausschließlich unter macOS zur Verfügung und soll in Kürze auch für Nutzer in der EU sowie im Vereinigten Königreich bereitgestellt werden. Die neuen Personalisierungsfunktionen wie kontextbezogene Vorschläge und Speicher sollen ebenfalls zeitnah für Nutzer der Enterprise-, Edu-, EU- und UK-Versionen verfügbar sein.

Apps & Mobile Entwicklung

Atari Intellivision Retro-Konsole im Test

Atari hat mit der Intellivision Sprint eine Neuauflage des einstigen Konkurrenten auf dem Markt gebracht, der mit vielen Schwächen des Originals, aber auch mit einigen selbstgemachten Problemen zu kämpfen hat. Vieles davon dürfte sich mit neuer Software beheben lassen, anderes kann als Originaltreue bezeichnet werden.

Der erste Blick auf die Intellivision Sprint

Es birgt eine gewisse Ironie, dass ausgerechnet der einstige Hauptkonkurrent der ursprünglichen Intellivision heute für die Neuauflage in Form einer Retro-Konsole verantwortlich zeichnet. Gleichzeitig muss jedoch angemerkt werden, dass der heutige Name Atari im Grunde nur noch wenig mit dem damaligen Konsolen- und Computerspezialisten gemein hat.

Den Charme des Originals eingefangen

Atari hat sich bei der Gestaltung der Neuauflage sichtbar darum bemüht, die äußere Erscheinung möglichst nah am Original zu halten, sodass insbesondere ältere Retro-Fans, die die ursprüngliche Konsole noch selbst genutzt haben, diese auf den ersten Blick wiedererkennen dürften. Entsprechend sollte sich auch schnell ein gewisser Hauch von Nostalgie einstellen.

Insgesamt gelingt es dem Hersteller, den charakteristischen Charme des Originals bei der mit 34,5 × 21 × 6 cm nur unwesentlich kleineren Neuinterpretation weitgehend einzufangen, auch wenn bei dieser anstelle der echten Holzakzente des Originals lediglich entsprechend gestalteter Kunststoff zum Einsatz kommt.

Aber doch erkennbar anders

Bei genauerem Hinsehen fallen jedoch einige Unterschiede auf, die Kennern sofort ins Auge springen dürften. Dazu zählt unter anderem der auf der rechten Seite fehlende Einschub für Peripheriegeräte. Gleichzeitig sind durch die beibehaltenen Controller in Originalgröße, die wie beim Vorbild zur Aufbewahrung auf der Oberseite eingeschoben werden können, die nachgebildeten Kühlrippen bei der nun kompakteren Intellivision Sprint schmaler ausgeführt. Ebenso ist das ursprünglich in der linken Ecke platzierte Mattel-Logo verschwunden, an dessen Stelle nun ausschließlich der Intellivision-Schriftzug zu finden ist. Der Einschaltknopf sowie der Reset-Schalter befinden sich hingegen weiterhin an der bekannten Position, liegen bei der Neuauflage jedoch etwas näher beieinander.

Die Intellivision galt in ihrer Zeit als die größte Bedrohung für Ataris Vorherrschaft, die das Unternehmen mit seinem 2600er-System (in den USA hieß dieses schlicht „Atari VCS“) seinerzeit innehatte, und löste mit ihrer Veröffentlichung zugleich den ersten „Konsolenkrieg“ aus. Bereits der Name, ein „Kofferwort“ aus „Intelligent“ und „Television“, sollte die Konsole als zukünftiges und zentrales Heimcomputersystem positionieren, das sich mit einer stetig wachsenden Anzahl an Peripherie erweitern ließe.

Die Entwicklung begann bei Mattel im Jahr 1978, ehe die Intellivision bereits 1979 auf der CES in den USA erstmals einem breiteren Publikum vorgestellt wurde. Der erste Verkauf an Endkunden erfolgte pünktlich zum Weihnachtsgeschäft am 3. Dezember 1979 zunächst als Test in Form eines Sets mit vier Spielkassetten zu einem Preis von 275 US-Dollar zuzüglich Mehrwertsteuer in den Gottschalk-Kaufhäusern in Fresno, Kalifornien. Die landesweite Markteinführung zog sich anschließend schrittweise über das Jahr 1980 hinweg und erfolgte zu einem etwas höheren Preis von 299 US-Dollar. Ab diesem Zeitpunkt stand die Konsole in direkter Konkurrenz zum Atari 2600, das mit 199,99 US-Dollar deutlich günstiger angeboten wurde.

Der höhere Preis der Intellivision hatte jedoch seine Gründe, denn im Gegensatz zur Atari-Konsole handelte es sich bei der Intellivision um eine echte 16-Bit-Konsole, deren Herzstück der CP1610 von General Instruments bildete, der über einen 16-Bit-Datenbus sowie eine ebenfalls 16 Bit umfassende RAM-Adressierung verfügte. Eine Besonderheit stellte dabei das Decle-Befehlsformat der CPU dar: Anstatt mit Opcodes in 8 oder 16 Bit zu arbeiten, speicherte diese ihre Befehle in 10 Bit, den sogenannten „Decles“, was wiederum 10 Bit breite ROM-Chips erforderte. Atari setzte demgegenüber mit dem MOS 6507 sogar auf eine noch weiter abgespeckte Variante des MOS 6502 und damit auf eine reine 8-Bit-CPU.

Auch beim RAM hatte die Intellivision die Nase deutlich vorne und konnte auf insgesamt 1.456 Bytes zurückgreifen, die sich auf das System, die Grafikeinheit und einen Bereich primär für das Betriebssystem aufteilte. Atari verbaute gerade einmal 128 Bytes an internen Speicher.

Für die Grafikausgabe zeichnete ein Standard Television Interface Chip (STIC) vom Typ AY-3-8900-1 von Generel Instruments verantwortlich, der eine Auflösung von 159 × 196 Pixeln bot, wobei spätere Revisionen diese auf 160 × 196 Pixel korrigierten. Der Bildschirm war dabei in 20 × 12 Kacheln unterteilt. Die Farbpalette umfasste 16 Farben, bestehend aus 8 Primär- und 8 Pastellfarben, die gleichzeitig dargestellt werden konnten. Darüber hinaus verfügte das System über 8 Hardware-Sprites, die bei der Intellivision als „Movable Objects“ bezeichnet wurden. Diese konnten jeweils eine Auflösung von 8 × 8 oder 8 × 16 Pixeln besitzen, waren individuell skalier- und spiegelbar und verfügten zudem über eine Hardware-Kollisionserkennung.

Das Atari VCS bot zwar eine nahezu identische Auflösung, konnte jedoch lediglich bis zu 8 Farben gleichzeitig darstellen und damit nur die Hälfte dessen, was die Intellivision leistete. Auch bei der Anzahl der Sprites zeigte sich eine Einschränkung, da hier lediglich 5 zur Verfügung standen, die zudem ausschließlich in einer Größe von 8 × 8 Pixeln dargestellt werden konnten.

Beim Sound kam in der Intellivision ein AY-3-8914 zum Einsatz, der im Vergleich zum Atari 2600 mit seinen zwei TIA-Kanälen über drei Tonkanäle sowie einen zusätzlichen Rauschkanal verfügte.

Insgesamt verfügte die Intellivision damit über eine deutlich fortschrittlichere und leistungsfähigere Hardware als die Atari-Konsole, was sich auch in der Umsetzung der Spiele bemerkbar machte.

Hinzu kam, dass der Joystick von Atari bereits kurz nach seiner Einführung als ikonisch wahrgenommen wurde, wogegen der Controller der Intellivision trotz seines größeren Funktionsumfangs als umständlich und unhandlich galt, was sich ebenfalls nachteilig auf die Wahrnehmung der Konsole auswirkte.

Zu Mattels Leidwesen trat im August 1982 zudem mit Coleco ein weiterer Konkurrent in den Markt ein, der mit der ColecoVision eine technisch leistungsfähige Konsole präsentierte. Diese basierte auf einer Z80-Architektur und konnte sowohl mit einer für die damalige Zeit soliden Rechenleistung als auch mit einer nochmals verbesserten Grafikleistung überzeugen. Trotz dieser technischen Vorteile wurde die Konsole mit einem Einführungspreis von 175 US-Dollar deutlich günstiger angeboten als die Intellivision. Dennoch gelang es auch diesem neuen Wettbewerber nicht, Atari von seiner führenden Position zu verdrängen, insbesondere da Atari im selben Jahr zusätzlich das Atari 5200 veröffentlichte, wenngleich dieses nicht mit seinem Vorgänger kompatibel war. Ungeachtet dessen konnte die Intellivision in ihrer Hochphase einen Marktanteil von rund 20 Prozent erreichen.

Dennoch stellte der höhere Preis, den Mattel für die Intellivision aufrief, für viele Käufer einen entscheidenden Faktor dar, sich stattdessen für die günstigere Atari-Konsole zu entscheiden. Hinsichtlich der insgesamt verkauften Einheiten existieren unterschiedliche Angaben, im Allgemeinen lässt sich jedoch festhalten, dass zwischen drei und fünf Millionen Konsolen abgesetzt wurden. Die Atari-Konsole hingegen wurde über einen Zeitraum von 15 Jahren hinweg gefertigt und erreichte Verkaufszahlen von über 30 Millionen Exemplaren, womit sie trotz der schwächeren Hardware letztlich als eindeutiger Sieger hervorgeht.

Die Konsole im Detail

Auf der Rückseite, an der sich beim Original lediglich der Stromanschluss sowie das Antennenkabel zur Verbindung mit einem Röhrenfernseher befanden, integriert Atari bei der Sprint-Version moderne Schnittstellen. Dazu gehören ein USB-C-Anschluss für das nicht im Lieferumfang enthaltene Netzteil sowie ein HDMI-Ausgang, über den Inhalte mit einer Auflösung von 720p ausgegeben werden, was angesichts der ursprünglichen 160 × 196 Pixel als ausreichend erscheint. Zusätzlich befinden sich dort zwei kleine Taster, über die sich die drahtlosen Controller mit der Konsole synchronisieren lassen. Im rechten Bereich der Rückseite sind darüber hinaus drei USB-Anschlüsse untergebracht, von denen zwei für zusätzliche Controller vorgesehen sind, während der dritte den Anschluss von Speichermedien wie USB-Sticks oder externen Festplatten ermöglicht. Über diesen Weg lassen sich sowohl Firmware-Updates durchführen als auch weitere Spiele auf die Konsole übertragen, worauf später noch näher eingegangen wird.

Da auch die Intellivision Sprint ohne separaten Audio-Ausgang ausgeliefert wird, sind Käufer, die die Konsole an einem herkömmlichen Monitor betreiben möchten, darauf angewiesen, dass dieser über entsprechende Audio-Ausgänge verfügt, um das Tonsignal weiterleiten zu können. Andernfalls bleibt nur der Umweg über Zubehör wie einen HDMI-Splitter. Bei klassischen Fernsehgeräten stellt sich dieses Problem hingegen in der Regel nicht.

Zum Lieferumfang gehören neben einem HDMI- sowie einem USB-C-Kabel außerdem zwei Sätze mit jeweils 45 der bekannten Overlays. Dabei handelt es sich um Karten, die auf das Nummernpad der Controller geschoben werden und den Spielern die jeweils spezifische Tastenbelegung sowie die Steuerung der einzelnen Spiele zeigen.

Die Controller

Die beiden in ihrer ursprünglichen Größe belassenen Controller werden zwar wie beim historischen Vorbild auf der Oberseite der Konsole eingeschoben, sind im Gegensatz zur Intellivision von 1982 jedoch drahtlos über das 2,4-GHz-Band mit dieser verbunden. Im vollständig eingeschobenen Zustand werden die Controller gleichzeitig geladen, wobei Atari nicht auf offen liegende Kontaktpins setzt, sondern stattdessen USB-C-Anschlüsse verwendet. Dass die Konsole für den Ladevorgang mit Strom versorgt werden muss, versteht sich von selbst.

Die Führungen in den Schächten der Konsole sowie an den Controllern sorgen dabei für eine saubere Ausrichtung, sodass Stecker und Anschluss ohne Verkanten ineinandergreifen können. Alternativ lassen sich die Controller bei niedrigem Akkustand auch kabelgebunden über ein entsprechendes Verlängerungskabel nutzen, wobei mit einem aufgedrehten Kabel die Nutzung sogar sehr nahe an das Original herankommen dürfte. Darüber hinaus soll ein vom Hersteller angekündigter, bislang jedoch noch nicht erschienener Adapter künftig ermöglichen, auch Eingabegeräte der Intellivision II und III zu verwenden.

Beim Intellivision war von Beginn an vorgesehen, die Konsole mithilfe verschiedener optionaler Erweiterungen zu einem vollwertigen Heimcomputersystem auszubauen, was sich rückblickend jedoch nicht wie geplant umsetzen ließ. So präsentierte Mattel bereits 1979 auf der damaligen CES ein Tastatur-Modul, das die Intellivision um einen MOS-6502-Zweitprozessor, 16 Kilobyte Arbeitsspeicher, eine Vollhub-Tastatur sowie ein digitales 4-Spur-Kassettenlaufwerk erweitern sollte. Letztlich erwies sich das Projekt jedoch als zu ambitioniert, technisch zu unzuverlässig und mit einem Preis von 600 US-Dollar anstelle der ursprünglich vorgesehenen 165 US-Dollar auch als deutlich zu teuer. Nach mehreren Jahren Verzögerung fertigte Mattel lediglich schätzungsweise 1.000 bis 4.000 Einheiten, für die sich kaum Abnehmer fanden, beziehungsweise wurden viele der verkauften Geräte wieder zurückgegeben.

Die anhaltenden Verzögerungen bei bereits bezahlten Einheiten führten in den USA dazu, dass die Wettbewerbsbehörde FTC (Federal Trade Commission) Ermittlungen wegen Betrugs- und Irreführungsverdachts einleitete. Die Höhe der verhängten Strafen ist bis heute nicht eindeutig geklärt: Während einige Quellen von einer monatlichen Zahlung in Höhe von 10.000 US-Dollar berichten, sprechen andere sogar von 10.000 US-Dollar pro Tag. In der Folge bot Mattel den betroffenen Kunden eine vollständige Rückerstattung sowie zusätzliche großzügige Entschädigungen an.

Als Reaktion auf das gescheiterte Tastatur-Modul wurde vergleichsweise unauffällig das Projekt „LUCKI“ initiiert, aus dem schließlich das Entertainment Computer System (ECS) hervorging. Dieses kombinierte 2 Kilobyte Arbeitsspeicher mit einer 49-Tasten-Chiclet-Tastatur, einem BASIC-Interpreter, einem zusätzlichen Soundchip vom Typ AY-3-8917 mit insgesamt sechs Tonkanälen sowie Anschlüssen für Kassette und Drucker. Darüber hinaus standen zwei zusätzliche Controller-Ports für Mehrspieler-Anwendungen mit bis zu vier Teilnehmern zur Verfügung. Optional wurde zudem ein Piano-Synthesizer-Keyboard mit Sechs-Noten-Polyphonie angeboten. Der Markterfolg blieb jedoch so gering, dass keine belastbaren Verkaufszahlen zu finden sind.

Unabhängig davon war Mattel mit seinen Ideen Streckenweise seiner Zeit voraus: So entwickelte das Unternehmen mit „PlayCable“ bereits im Jahr 1981 einen frühen Download-Dienst für Spiele. Hierfür kooperierte das Unternehmen mit der Kabeldivision Jerrold des US-amerikanischen Telekommunikationsunternehmens General Instruments. Ein PDP-11-Minicomputer übertrug die Spiele über spezielle FM-Frequenzen, die anschließend von einem PlayCable-Adapter im Kassettenschacht der Konsole empfangen wurden. Die Auswahl erfolgte über ein Bildschirmmenü, wobei der Download eines Titels in der Regel zwischen 10 und 20 Sekunden in Anspruch nahm. Üblicherweise standen dabei etwa 15 bis 20 Spiele zur Verfügung, die in monatlichen Abständen ausgetauscht wurden.

Trotz der vorhandenen USB-Anschlüsse unterstützt die Intellivision Sprint keine weiteren externen Controller anderer Hersteller wie den CX 40 von Atari, den TheJoystick von Retro Games oder andere Gamepads, was die Einsatzmöglichkeiten der Konsole spürbar einschränkt. Die zusätzlichen Tasten der mitgelieferten Controller stellen dabei nicht das eigentliche Problem dar, da Retro Games, das gemeinsam mit Atari an der Konsole gearbeitet und Teile der Emulationssoftware beigesteuert hat, bei seinen eigenen Systemen durchaus über einen Mapper die Möglichkeit integriert hat, Tasten individuell zu belegen und Funktionen flexibel zuzuweisen.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenInterview: Massiver Anstieg der AU‑Fälle nicht durch die Telefon‑AU erklärbar

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Entwickler, wacht auf – oder verliert euren Job