Künstliche Intelligenz

Künstliche Intelligenz: Auf der Suche nach dem Einstein-Modell

Es ist das ewige Versprechen der Branche und das Feigenblatt, um bis dahin das Verbrennen von Milliarden Dollar und Unmengen an Energie zu rechtfertigen: die Suche nach der AGI. Die Artificial General Intelligence (Künstliche allgemeine Intelligenz) gilt als heiliger Gral der KI-Forscher. Wenn die Software lernt, ohne menschliche Hilfe zu lernen, sollen undenkbare Fortschritte möglich sein. Manch einer hat auch Angst, dass sich die KI dann gegen den Menschen wendet. Aber in zunehmendem Maße halten Menschen diese Zukunftsvision für eine Fata Morgana und den Weg dorthin noch für sehr weit.

Weiterlesen nach der Anzeige

Demis Hassabis, Chef von Googles KI-Sparte DeepMind, hält die AGI für erreichbar. Aber erst in fünf bis zehn Jahren. In einem Interview mit Alex Kantrowitz von Big Technology ließ er kein gutes Haar an seinem Mitbewerber OpenAI und dessen Chef Sam Altman. Man dürfe AGI nicht als Marketingbegriff verwenden, mahnt er. Die allgemeine künstliche Intelligenz sei ein System, das alle kognitiven Fähigkeiten zeigen kann, die Menschen haben, sagt er: „Und ich meine alle.“

Was die AGI können muss

Aber wo ist der Nutzen für die Menschheit? Den würde diese Form von KI erst haben, wenn sie der Menschheit zu neuen Durchbrüchen verhilft, erklärt Hassabis. Es sei nicht damit getan, eine mathematische Gleichung oder eine Vermutung zu lösen. Bahnbrechende Vermutungen sind gefragt, ein neuer Einstein. Oder im künstlerischen Bereich ein Picasso oder ein Mozart. Und zwar mit Fähigkeiten und einer Schlagzahl, wie sie bei Menschen kaum oder gar nicht möglich wäre.

Und obwohl er die Ansicht vertritt, dass die Fähigkeiten heutiger KI-Modelle noch gar nicht alle erkannt und ausgeschöpft sind, zeigt sich Hassabis überzeugt, dass diese noch weit von einer AGI entfernt sind. Heutige KI habe ein „Goldfischgehirn“. Sie kann das Internet durchsuchen, aber dieses Wissen ändere das Modell nicht und sei nach der Sitzung wieder vergessen. Eine Superintelligenz würde sogar noch weitergehen, sie könnte andere Systeme wie Wettersatelliten integrieren oder in 14 Dimensionen denken – Dinge, zu denen kein Mensch fähig wäre.

Mehrere Durchbrüche nötig

Weiterlesen nach der Anzeige

KI brauche auf dem Weg zur AGI noch mehrere Durchbrüche: Neben kontinuierlichem Lernen seien das effizientere Kontextfenster und langfristige Planung. Während das menschliche Gehirn mit selektiver Aufmerksamkeit nur das Wichtige verarbeitet, behandelt KI alle Informationen im Kontext gleich. Dies ist ineffizient und teuer.

In dem Bühnengespräch in Davos ging Hassabis auch auf die Frage ein, ob Google wie OpenAI plane, in seinem Chatbot Werbung zu integrieren. Viel Lob verteilte Hassabis für Start-up Anthropic, in das Google bereits Milliarden Dollar investiert hat. Deren Entwicklungs-Tool Claude Code sei sehr gelungen. Google selbst will die Fähigkeiten seines KI-Modells Gemini mit der neu veröffentlichten IDE Antigravity besser zur Geltung bringen.

Googles Smart-Glass-Pläne

Konkret äußerte sich Hassabis zu Smart Glasses: Google arbeitet mit Partnern wie Warby Parker, Gentle Monster und Samsung an einer neuen Generation KI-gestützter Brillen, die „vielleicht bis zum Sommer“ auf den Markt kommen sollen. Anders als beim gescheiterten Google Glass vor gut zehn Jahren seien nun sowohl die Form ausgereift als auch – entscheidend – die „Killer-App“ vorhanden: ein universeller digitaler Assistent, der freihändig im Alltag hilft. Hassabis selbst arbeitet persönlich an dem Projekt mit.

(mki)

Künstliche Intelligenz

Digitalbudgets steigen um 30 Prozent – fast ein Drittel geht in KI-Projekte

Rund zwei Drittel der Unternehmen im DACH-Raum, den USA und Skandinavien planen für 2026, ihr Digitalisierungsbudget im Schnitt um 30 Prozent zu erhöhen. Knapp ein Drittel davon soll in KI-Projekte fließen. Das geht aus der aktuellen „Digital Value Studie“ der Unternehmensberatung Horváth hervor, für die mehr als 200 Unternehmen befragt wurden – darunter 100 aus Deutschland.

Weiterlesen nach der Anzeige

Trotz der wachsenden Investitionsbereitschaft zeigt die Horváth-Studie ein ernüchterndes Bild bei der praktischen Umsetzung. 68 Prozent der Führungskräfte sehen zwar eine höhere Investitionsbereitschaft des Top-Managements für KI als für andere Technologien. Gleichzeitig bewerten aber 66 Prozent der Befragten Reife und Funktionsumfang aktueller KI-Anwendungen als hinter den Erwartungen zurückbleibend. Diese Diskrepanz führen die Befragten auf den aggressiven Vertrieb der Anbieter zurück.

Silodenken und fehlende KPIs als Hauptbremsen

Die Studie identifiziert erhebliche strukturelle Schwächen bei der Umsetzung von Digitalprojekten. Mangelnde Zusammenarbeit über Abteilungsgrenzen hinweg, also Silodenken, nennen 67 Prozent der Befragten als zentrales Hindernis. Unzulängliches Prozessmanagement (66 Prozent), fehlende Kennzahlen zur Erfolgsmessung (65 Prozent) und grundsätzliche Implementierungsschwächen (64 Prozent) folgen dicht dahinter. Nur ein Drittel der Unternehmen evaluiert seine Digitalisierungsmaßnahmen hinsichtlich der Umsetzungsrisiken – obwohl gerade die Komplexität von KI-Implementierungen regelmäßig unterschätzt werde, warnt Studienleiter Rainer Zierhofer.

„Die Investitionsbereitschaft ist nach einem Jahr der Verunsicherung und des Zögerns deutlich gestiegen – und KI ist längst kein Add-on mehr, sondern integraler Bestandteil der Digitalbudgets“, so Zierhofer. Entscheidend sei jetzt, den Wertbeitrag systematisch zu steuern, anstatt nur Projekte zu addieren.

Deutschland setzt auf CIOs – die USA auf CEOs

Auffällig ist der unterschiedliche organisatorische Ansatz bei der Digitalverantwortung: In Deutschland liegt diese zu 70 Prozent bei den CIOs und der IT-Leitung. In den USA hingegen verantworten die CEOs in mehr als der Hälfte der Fälle die Digitalisierung – mit einem stärker strategischen Fokus. Die Studienautoren sehen im deutschen Modell die Gefahr, dass der geschäftliche Mehrwert und der Kundennutzen gegenüber rein technischen Aspekten in den Hintergrund rücken.

Weiterlesen nach der Anzeige

Nur die Hälfte der befragten Unternehmen verfügt über eine ganzheitliche Digitalisierungsstrategie. Ein Viertel arbeitet mit Teilstrategien, 19 Prozent verfolgen lediglich bereichsweise Ziele, und 4 Prozent haben gar keine Strategie. Immerhin messen deutsche Unternehmen den Wertbeitrag ihrer Digitalprojekte vergleichsweise häufig: 73 Prozent tun dies regelmäßig in einem etablierten Prozess, während es international nur 44 Prozent sind. Als zentrale Erfolgsfaktoren für einen messbaren „Digital Value“ identifiziert die Studie die Integration digitaler Effekte in das Business Performance Management, die Aufnahme in persönliche Ziele der Verantwortlichen sowie klare Zuständigkeiten – Aspekte, die erst 54 bis 59 Prozent der Unternehmen nachhaltig verankert haben.

Branchenübergreifende Skepsis trotz Budgetzuwachs

Die Ergebnisse von Horváth reihen sich in ein Gesamtbild ein, das auch andere Erhebungen zeichnen. Eine Bitkom-Umfrage zu KI-Kosten zeigte kürzlich, dass rund ein Drittel der KI-nutzenden Unternehmen von den tatsächlichen Kosten überrascht wird. Der Fachkräftemangel bremst dabei als externer Faktor zusätzlich – 70 Prozent der Bitkom-Befragten nannten ihn als Hemmnis. Auch international gibt es Ernüchterung: Laut einer NBER-Studie sehen über 80 Prozent der befragten Unternehmen noch keine messbaren Auswirkungen von KI auf Beschäftigung oder Produktivität.

Zierhofer mahnt, Komplexität und Aufwand der Umsetzung würden häufig unterschätzt: „Damit ist eine Implementierungsschwäche quasi vorprogrammiert – was oft in einer negativen Kosten-/Nutzen-Bilanz resultiert, zu Frust führt und dadurch auch die Akzeptanz für diese Maßnahmen reduziert.“ Neben KI-Projekten priorisieren die befragten Unternehmen demnach auch klassische Ansätze wie Prozessautomatisierung und Outsourcing, um ihre Effizienz zu steigern.

(fo)

Künstliche Intelligenz

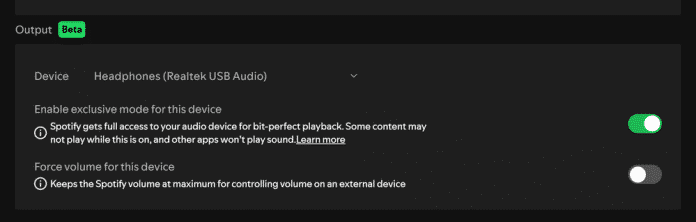

Spotifys neuer exklusiver Modus umgeht Audioverarbeitung von Windows

Eine neue Funktion für die Desktop-App von Spotify verhindert, dass sich Windows in die Audiowiedergabe des Musik-Streamingdiensts einmischt. Ist der Exclusive Mode aktiviert, läuft die Wiedergabe ausschließlich über das Audio-Interface. Das kann laut Spotify zu präziserer Tonqualität führen.

Weiterlesen nach der Anzeige

Üblicherweise schaltet sich Windows in die Wiedergabe aller Audioquellen ein: Sounds können neu abgemischt oder anderweitig angepasst werden, bevor sie zum Digital-Analog-Wandler oder Audio-Interface kommen. Im exklusiven Modus umgeht Spotify den Windows-Audiomixer und gibt das Signal direkt an das Audiogerät weiter.

Das sorgt laut Spotify für „Bit-perfekte Wiedergabe“, dürfte aber vor allem Menschen mit feinem Gehör und hochwertigem Equipment auffallen. Der Exclusive Mode ist für die Wiedergabe von verlustfreien Audiodateien gedacht. Seit Herbst des vergangenen Jahres können Spotify-Nutzer Musik im FLAC-Codec bei einer Qualität von 24-bit/44.1 kHz anhören.

Kein Ton von anderen Quellen

Für den Alltagsgebrauch eignet sich der exklusive Modus dagegen nur eingeschränkt: Solange er aktiviert ist, kann das Gerät keine Töne von anderen Quellen abspielen. Das bedeutet: Musikhören beim Videospielen ist nicht möglich, und auch Audio-Benachrichtigungen für eingehende Mails werden nicht abgespielt. Wer die Musikwiedergabe beendet und ein YouTube-Video schauen will, muss den exklusiven Modus dafür in der Spotify-App manuell beenden.

Möglich ist es aber, ein Audiogerät im exklusiven Modus laufen zu lassen und ein anderes für die normale Windows-Wiedergabe zu benutzen. Dafür muss man das Wiedergabegerät in Windows umstellen. Podcasts, Musikvideos und Hörbücher unterstützen den exklusiven Modus auf Spotify zudem nicht.

Weiterlesen nach der Anzeige

Der exklusive Modus steht Premium-Abonnenten von Spotify zur Verfügung. Auch in Deutschland lässt sich die Funktion bereits aktivieren. Dazu geht man in der Desktop-App von Spotify in die Einstellungen und scrollt zu „Wiedergabe“. Unter „Audioausgabe“ wählt man zuerst das gewünschte Gerät aus, bevor man den Schalter bei „Exklusivmodus für dieses Gerät aktivieren“ setzt.

In den Einstellungen der Desktop-App lässt sich der exklusive Modus aktivieren.

(Bild: Spotify)

Der exklusive Modus von Spotify nutzt den exklusiven Modus von WASAPI, der Windows Audio Session API, um die Audio-Pipeline zu kontrollieren. Eine Mac-Variante des Features ist laut Spotify aktuell noch in Entwicklung.

(dahe)

Künstliche Intelligenz

Reine Solardrohne fliegt über fünf Stunden lang am Stück

Der südafrikanische Ingenieur Luke Maximo Bell hat seinen viermotorigen Solar-Quadrokopter, der ohne Pufferbatterie fliegen kann, neu konstruiert und ihn einem Ausdauertest unterzogen. An einem sonnigen, windstillen Tag flog die Drohne ununterbrochen mehr als fünf Stunden mit reiner Solarenergie im Schwebeflug. Die Drohne hätte noch länger in der Luft bleiben können, musste allerdings aufgrund problematischer Windverhältnisse nach genau 5 Stunden, 2 Minuten und 21 Sekunden gelandet werden.

Weiterlesen nach der Anzeige

Zum Redesign der ersten Solardrohne analysierte Bell die Schwachstellen des Quadrokopters. Eine Schwierigkeit ergab sich vor allem aus den bruchanfälligen Solarzellen, die auf einer Gitterkonstruktion aus dünnen Karbonstäben aufgebracht waren. Bei der neuen Konstruktion verstärkte der Bastler das Gitter und stellte außerdem sicher, dass die dünnen Maxeon Sunpower C60 Silizium-Solarpanels zu je 5 W so angebracht wurden, dass sie nicht mehr so schnell brechen können. Verwendet wird nun ein Array von 8 × 4 Panels. Bei voller Sonneneinstrahlung liefern die Solarzellen insgesamt etwa 100 W bei rund 18 V, in der Spitze bis zu 110 W. Die Solarpanels sind oberhalb der Drohne angebracht, um die Sonne optimal einfangen zu können.

Empfohlener redaktioneller Inhalt

Mit Ihrer Zustimmung wird hier ein externes YouTube-Video (Google Ireland Limited) geladen.

Das Video zeigt die durchgeführten Verbesserungen an der Solardrohne und den Rekordflug.

Zudem reduzierte Bell die Länge der Ausleger, an denen die vier Motoren angebracht sind. Bei der ersten Version der Solardrohne waren die Ausleger länger und die Drohne größer. Dadurch kam es zu einer unerwünschten Rotation des Fluggeräts, die ständig ausgeglichen werden musste, was Strom kostete. Die zweite Version der Solardrohne weist durch die Verkleinerung dieses Rotationsbestreben nicht mehr so stark auf und benötigt daher weniger Strom für Korrekturen. Zudem reduziert dies das Gewicht um rund 70 g, was den Strombedarf zusätzlich verringert.

Die Motoren des Typs T-Motor Antigravity MN4005 300 KV, die vier NS-18×6-Rotoren aus Karbon sowie die Steuerungselektronik und den Electronic Speed Controller (ESC) übernahm Bell von der Vorgängerversion.

Flugversuche und Fehlerbehebungen

Ein erster Flugversuch der Solardrohne an einem Tag mit geringem Wind und starker Sonneneinstrahlung scheiterte jedoch. Die Drohne musste bereits nach etwas mehr als 2 Minuten aufgrund von Instabilität gelandet werden. Als ursächlich erwies sich, dass die Solarzellen keine kontinuierlich ausreichende Stromversorgung bieten können. Bell entschloss sich, eine kleine Pufferbatterie mit 720 mAh zu installieren, die von den Solarzellen geladen wird und bei kurzzeitigen Stromschwankungen einspringen kann. Zudem stabilisierte Bell die wackelige Solarzellenkonstruktion durch eine Verstärkung und legte die Zellen tiefer. Der Ingenieur reduzierte auch die Anzahl der Panels auf 28, was nach zuvor durchgeführten Simulationen keine großen Auswirkungen auf die Flugfähigkeit versprach.

Der zweite Flugversuch, ebenfalls an einem Platz mit geringem Wind und großer Sonneneinstrahlung, scheiterte zunächst an einem losen Motor. Nach der Reparatur flog die Solardrohne im Schwebeflug ausreichend stabil, bis das GPS aufgrund von Strommangel wegen kurzzeitiger Bewölkung ausfiel. Bell übernahm die Steuerung dann manuell, um den Windeinfluss kontinuierlich auszugleichen, was sich als mental anstrengend erwies. Das GPS setzte dann aber wieder ein und die Drohne konnte die Position erneut selbstständig halten. Nach 3 Stunden, 31 Minuten und 6 Sekunden knackte die Drohne den bestehenden inoffiziellen Rekord für ununterbrochene Flüge für eine elektrische Multirotor-Drohne (mit Akku). Nach insgesamt 5 Stunden, 2 Minuten und 21 Sekunden musste Bell die Drohne aufgrund schlechter werdender Windverhältnisse und geringerer Sonneneinstrahlung sicherheitshalber landen.

Weiterlesen nach der Anzeige

(olb)

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 2 Wochen

Social Mediavor 2 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 4 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenÜber 220 m³ Fläche: Neuer Satellit von AST SpaceMobile ist noch größer

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur