Apps & Mobile Entwicklung

Das Warten auf AI-Siri geht weiter

Seit fast zwei Jahren warten iPhone-Nutzer auf eine Reihe von Apple versprochener Features. Mit iOS 26.4 schienen zumindest Teile davon in greifbarer Nähe. Ein neuer Bericht bringt jedoch erneut schlechte Nachrichten.

Schon im Sommer 2024 zeigte der iPhone-Hersteller stolz diverse Fähigkeiten von Apple Intelligence. Eine der eindrucksvollsten Funktionen war das überarbeitete Siri, das dank Zugriff auf persönliche Daten hilfreiche Informationen erkennen und zusammenfassen konnte. Damit sollten Antworten auf Fragen wie „Wann kommt meine Mutter am Flughafen an?“ von dem Assistenten auf Basis von Textnachrichten und Mails erfolgreich beantwortet werden können.

iOS 18 kam und ging – Apple musste Verzögerungen eingestehen. Werbespots mit den angekündigten Features wurden wieder entfernt. Zuletzt war die Hoffnung groß, dass zumindest einige der Funktionen zeitnah als Teil von iOS 26.4 erscheinen würden. Doch Bloombergs üblicherweise gut informierter Apple-Insider Mark Gurman hat erneut schlechte Nachrichten im Gepäck.

Gurman: Das Warten auf Apples AI-Siri geht weiter

In seinem aktuellen Bericht schreibt Gurman, dass das geplante Upgrade für Siri in den vergangenen Wochen erneut für Probleme gesorgt hat. Diese internen Tests könnten nun dafür sorgen, dass Apple-Nutzer abermals länger warten müssen.

Ursprünglich war der Plan, erste neue Funktionen als Teil von iOS 26.4 vorzustellen. Das Update wird im März erwartet. Glaubt man dem neuen Bericht, plant Apple die Vorstellung dieser Features zu verteilen. Das bedeutet, dass zumindest einige Neuheiten erst Teil von iOS 26.5 oder später sein würden. 26.5 wird im Mai erwartet. Sogar eine Verschiebung auf iOS 27, das im September erscheinen soll, gilt laut dem Bericht als möglich.

Ursprünglich sollten Features wie die Sprachsteuerung von Apps via Siri bereits Anfang 2025 Teil von Apples Betriebssystemen sein. Diesen Zeitplan konnte das Unternehmen nicht einhalten und kündigte eine Verzögerung an. Stattdessen sollen sie im Jahr 2026 erscheinen. Ein Ziel, das immerhin noch möglich ist – selbst wenn die AI-Features erst Teil von iOS 27 sein werden.

Intern hatte Apple sich aber laut Gurman das Ziel mit iOS 26.4 im März 2026 gesetzt. Ein Ziel, das noch im vergangenen Monat fest im Visier war. Der Grund für die neuen Verzögerungen sind angeblich weiterhin Probleme mit Siri. So werden Anfragen nicht korrekt bearbeitet oder Antworten dauern zu lange.

Diese Funktionen sind betroffen

Statt iOS 26.4 soll jetzt 26.5 ein wichtiger Punkt sein. Apples Entwickler wurden laut Gurman angewiesen, diese Version zum Test der neuen Siri-Funktionen zu nutzen.

Eine der betroffenen Funktionen ist Siris Zugriff auf die persönlichen Informationen des Nutzers. Diese erlaubt es dem Assistenten zum Beispiel in Textnachrichten Antworten auf eure Fragen zu finden. Apples Mitarbeiter können eine „Vorschau“ auf diese Funktion in iOS 26.5 aktivieren. Gurman vermutet, dass der iPhone-Hersteller auch seinen Nutzern beim Start des Features vielleicht einen Hinweis zeigen könnte, dass es unvollständig ist oder unter Umständen fehlerhaft sein könnte. Ähnliches gibt es schon heute bei den Beta-Tests der Betriebssysteme.

Neben dem Zugriff auf eure Daten bereitet offenbar auch die Sprachsteuerung von Apps Probleme. Das Feature ist Teil von iOS 26.5, arbeitet jedoch nicht zuverlässig. Diese Sprachkontrolle würde es euch erlauben, in einem Sprachbefehl Siri nach einem Bild zu fragen, welches es dann an einen Kontakt schickt.

In den Tests gab es jedoch Probleme mit der Zuverlässigkeit. Außerdem wurden Tester von Siri unterbrochen, wenn sie zu schnell sprechen. Längere Anfragen sollen ebenfalls für Probleme mit längeren Bearbeitungszeiten gesorgt haben.

Zu guter Letzt kommt es hin und wieder vor, dass Siri auf OpenAIs ChatGPT zurückgreift, obwohl Apples eigene Lösung die Antwort liefern könnte.

Apple plant zwei bislang unbekannte Neuheiten

Es gibt jedoch auch gute Nachrichten. So arbeiten Apples Entwickler an zwei neuen Features, die bislang unbekannt waren. Dabei handelt es sich um eine neue Web-Suche sowie ein neues Werkzeug zur Bilderstellung.

Die neue Web-Suche funktioniert ähnlich wie die KI-Unterstützung in der Google Suche. Eure Anfragen werden also analysiert und ihr bekommt eine Zusammenfassung der wichtigsten Details. Zu der neuen Bilderstellung hat Gurman nur wenige Details. Sie benutzt dieselbe Technologie wie die bekannte Image Playground-App.

Diese beiden Features sind aktuell Teil von iOS 26.5, wurden jedoch auch in 26.4 getestet und könnten somit vielleicht doch schon im März erscheinen.

Das vollständig neue Siri, an dem Apple in Kooperation mit Google arbeitet und das auf Google Gemini basiert, bleibt dagegen Teil von iOS 27, iPadOS 27 und macOS 27. Dieser Assistent soll sich stärker an Chatbots wie ChatGPT orientieren und deutlich kontextbezogener arbeiten.

Apps & Mobile Entwicklung

App zur Erstellung individueller Feeds: Bluesky enthüllt KI-Assistenten „Attie“

Im Rahmen der an diesem Wochenende stattfindenden Atmosphere-Konferenz hat das soziale Netzwerk Bluesky einen KI-Assistenten vorgestellt, der künftig vielfältige Aufgaben wie das Entwerfen von Algorithmen sowie die Erstellung individueller Feeds übernehmen soll. Dabei greift das Unternehmen auf die Dienste von Anthropic zurück.

“Attie“ als Agentische Social-App

Laut Jay Graber, ehemals CEO von Bluesky und inzwischen Chief Innovation Officer, sowie CTO Paul Frazee soll die neue Anwendung jedoch kein direkter Bestandteil des sozialen Netzwerks werden, sondern vielmehr eigenständig agieren und gleichzeitig eng mit diesem zusammenarbeiten können. Ziel des Projekts ist es, eine „agentische Social-App“ zu entwickeln, die auf dem zugrunde liegenden Protokoll von Bluesky, dem AT-Protokoll (kurz „atproto“), basiert. Die Konferenzteilnehmer werden dabei die ersten Beta-Tester für die neue App sein, die unter der Haube auf Anthropics „Claude“ basiert.

Mit „Attie“ soll künftig jeder Anwender in der Lage sein, mittels natürlicher Sprache einen eigenen, individuell zugeschnittenen Feed zu erstellen – ein Ansatz, der bereits aus der Nutzung moderner Chatbots bekannt ist. Für den Zugriff genügt es, sich mit dem Atmosphere-Login anzumelden, der für sämtliche Anwendungen verfügbar ist, die auf atproto aufbauen. Ein wesentlicher Vorteil liegt dabei in der Offenheit des Systems: Bluesky und das gesamte dahinterstehende Ökosystem ermöglichen einen App-übergreifenden Austausch von Daten, wodurch sich die Einsatzmöglichkeiten deutlich erweitern. So soll „Attie“ unter anderem dazu dienen, personalisierte Feeds auf Basis individueller Interessen zu erstellen, ohne dass dafür auch nur eine einzige Zeile Code erforderlich ist.

Menschenorientierte künstliche Intelligenz

Nach Angaben des Unternehmens handelt es sich bei der neuen Anwendung um ein stark menschenzentriertes KI-Produkt. „Wir glauben, dass KI eine sehr leistungsstarke Technologie ist, aber wir wollen sicherstellen, dass wir sie nutzen, um Dinge zu entwickeln, die den Menschen wirklich zugutekommen“, erklärt Interim-CEO Toni Schneider im Gespräch mit TechCrunch. Zum Start werden die Funktionen zunächst noch eingeschränkt sein: In der ersten Ausbaustufe dient „Attie“ ausschließlich der Erstellung entsprechender Feeds. Perspektivisch soll es jedoch möglich werden, dass Nutzer auf Basis von „Attie“ eigene soziale Anwendungen entwickeln, die ebenfalls auf dem von Bluesky verwendeten Protokoll aufsetzen.

Jay Graber, die ihren Posten als CEO abgegeben hatte, um sich wieder stärker der Entwicklung widmen zu können, kritisierte im Zuge der Ankündigung, dass KI derzeit von großen Plattformen häufig primär im eigenen Interesse und nicht im Sinne der Nutzer eingesetzt werde. Dies geschehe unter anderem, indem versucht werde, die Verweildauer innerhalb der jeweiligen Apps zu erhöhen, um mehr Daten zu sammeln und die Kontrolle über algorithmische Prozesse zu behalten. „Wir sind der Meinung, dass KI den Menschen dienen sollte, nicht den Plattformen“, so die aktuelle CIO. Ein offenes Protokoll könne diese Kontrolle direkt in die Hände der Nutzer verlagern: „Man kann es nutzen, um eigene Feeds zu erstellen, Software zu entwickeln, die so funktioniert, wie man es möchte, um Signale im Rauschen zu finden“, führt Graber weiter aus.

Finanzierung bereits für einen längeren Zeitraum gesichert

Finanziert werden soll das Projekt unter anderem durch eine kürzlich abgeschlossene Finanzierungsrunde, in deren Zuge zusätzliche Mittel in Höhe von 100 Millionen US-Dollar eingesammelt wurden. Damit gilt die Finanzierung des Vorhabens für rund drei Jahre als gesichert, was laut Interim-CEO Schneider zugleich Stabilität und Planungssicherheit für das gesamte Ökosystem schaffen soll. Darüber hinaus erhält das Team auf diese Weise den notwendigen Spielraum, um ohne unmittelbaren Zeitdruck an weiteren Herausforderungen zu arbeiten. Dazu zählt unter anderem die Integration umfassender Datenschutzkontrollen in das Protokoll des sozialen Netzwerks, das inzwischen auf eine Nutzerschaft von 43,4 Millionen angewachsen sein soll.

Keine Anlaufstelle für Kryptowährung

Nicht Teil der Umsetzung soll hingegen die Integration von Kryptowährungen sein – und das trotz finanzieller Unterstützung durch mehrere Investoren aus dem Krypto-Umfeld. Mit dieser klaren Abgrenzung möchte Schneider insbesondere Bedenken innerhalb der Nutzerschaft begegnen, die befürchtet hatte, die Anwendung könnte zur Zielscheibe von Krypto-Betrugsversuchen werden oder sich zu einem Zahlungsinstrument entwickeln.

Apps & Mobile Entwicklung

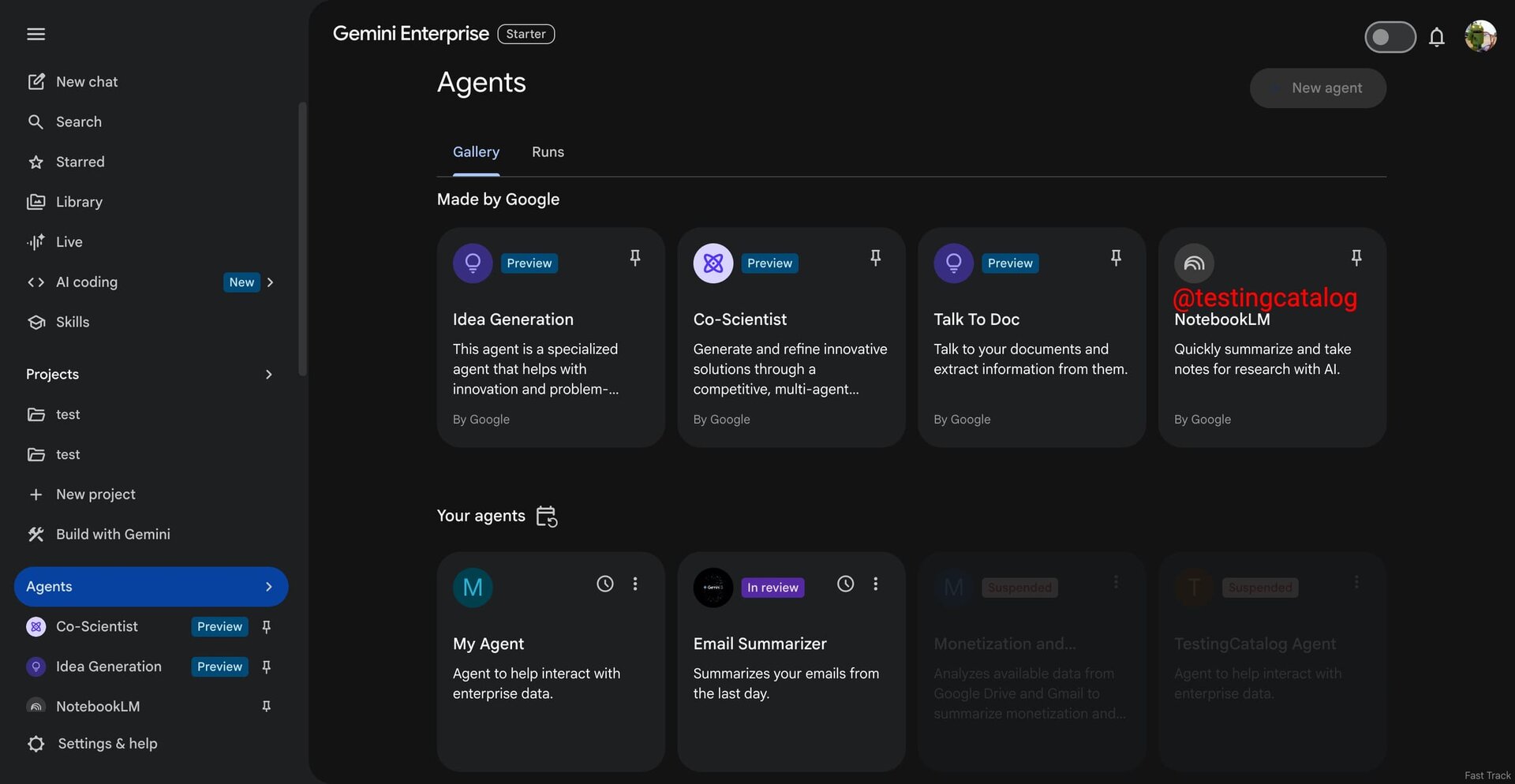

Gemini for Business: KI soll Integration von NotebookLM und Skills erhalten

Google bereitet laut TestingCatalog die Integration von NotebookLM sowie vorgefertigter Skills für Gemini for Business vor. Darauf sollen Hinweise in jüngst veröffentlichten Builds hindeuten, die bereits entsprechende, bislang jedoch noch versteckte Funktionen enthalten.

Zu den augenscheinlich neuen Funktionen von Gemini for Business zählt unter anderem eine nun beobachtete tiefere Integration mit NotebookLM. Diese könnte es Nutzern der Business-Stufe ermöglichen, ihre eigenen NotebookLM-Notebooks direkt über die Startseite von Gemini einzusehen. Im Bereich der Agenten scheint darüber hinaus bereits ein vorgefertigter NotebookLM-Agent vorhanden zu sein, der als Werkzeug zum Zusammenfassen und Strukturieren von Rechercheinhalten mithilfe künstlicher Intelligenz beschrieben wird. Dies soll laut dem Artikel von TestingCatalog darauf hindeuten, dass mit dieser Funktion Daten aus Notizbüchern abgerufen und innerhalb der Konversationsoberfläche von Gemini bereitgestellt werden könnten.

Diese Annahme erscheint plausibel, da eine vergleichbare Integration bereits im Januar 2026 für Privatnutzer sowie Anwender von Workspace Enterprise und Education eingeführt wurde. Eine entsprechende Ausweitung auf den Business-Bereich würde folglich eine einheitliche Funktionsbasis über alle kostenpflichtigen Workspace-Tarife von Google hinweg schaffen.

Gerade für kleine und mittelgroße Teams, die auf kuratierte Wissensdatenbanken innerhalb von NotebookLM angewiesen sind, könnte eine solche Integration den Arbeitsalltag deutlich vereinfachen, da der Zugriff auf relevante Informationen künftig ohne Wechsel zwischen verschiedenen Anwendungen erfolgen würde.

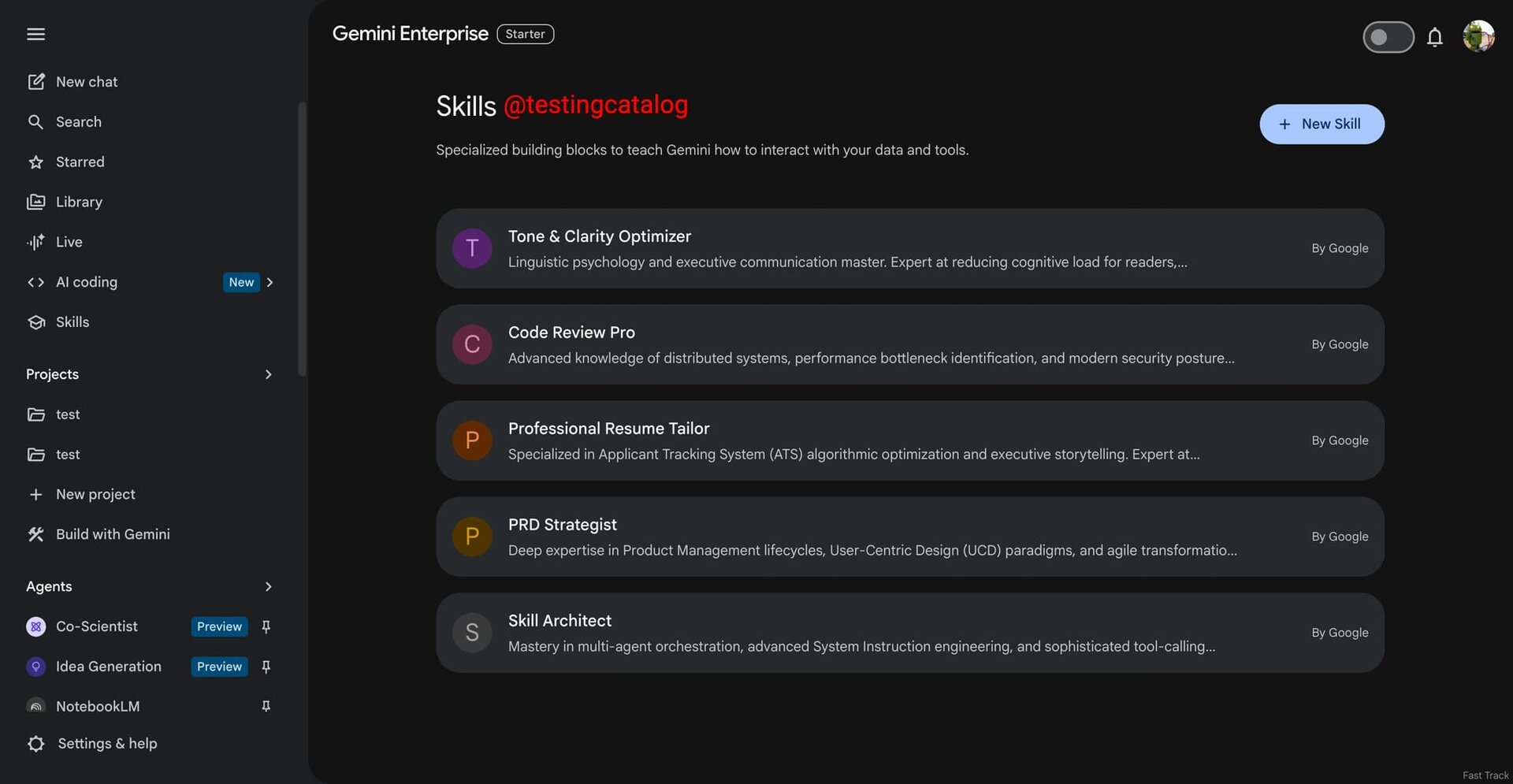

Skill mit weiteren Funktionen

Parallel dazu scheint Google auch bei den sogenannten Skills für Gemini for Business Fortschritte zu erzielen. Obwohl die entsprechende Registerkarte derzeit noch ausgeblendet ist, werden bereits mehrere vorgefertigte Skills von Google angezeigt. Dazu zählen unter anderem Optionen für Code-Reviews, das Erstellen von PRDs sowie ein Meta-Skill mit der Bezeichnung „Skill Architect“, der Anwender dabei unterstützen soll, eigene benutzerdefinierte Skills zu entwickeln.

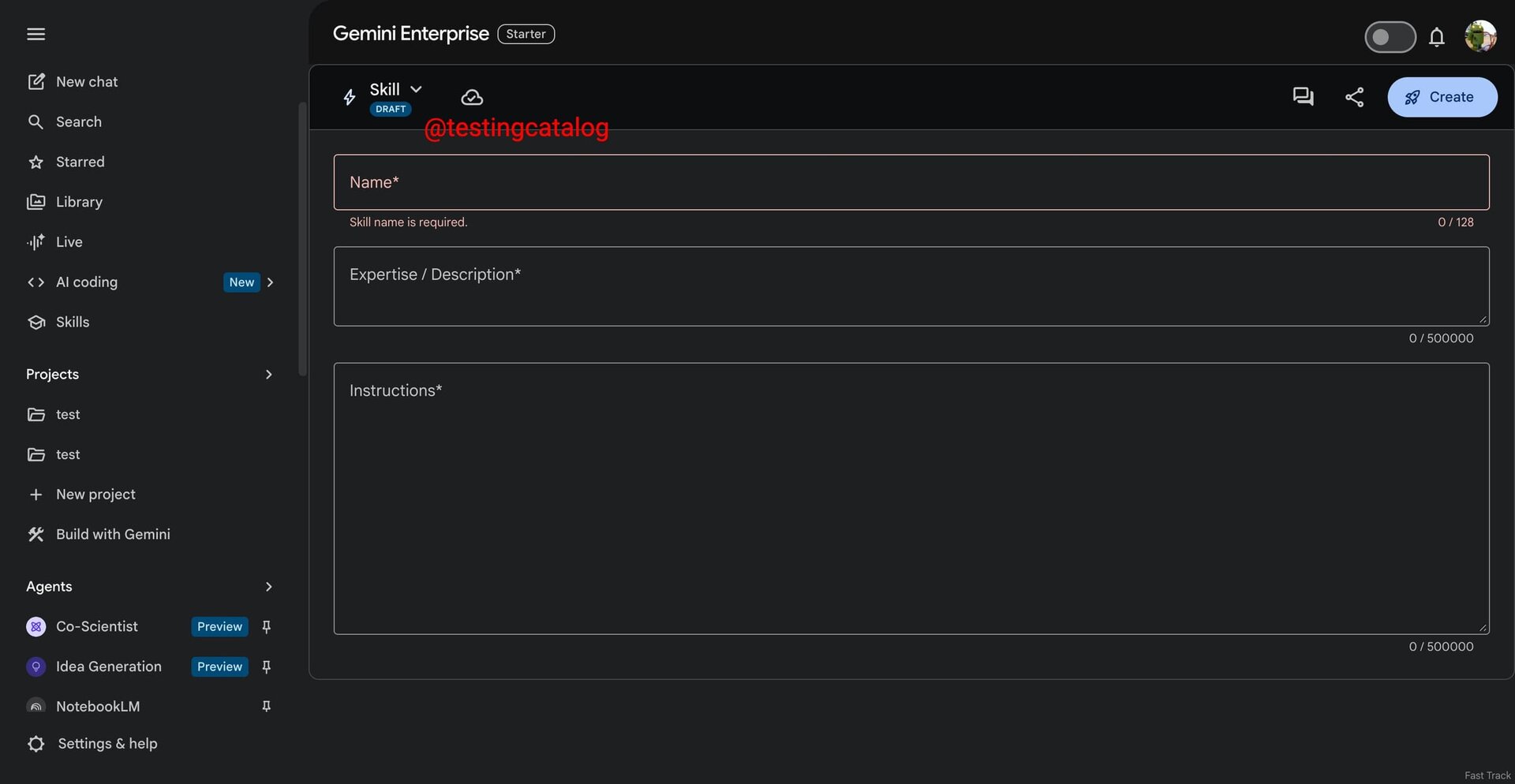

Darüber hinaus konnten die Experten von TestingCatalog ein neues Menü zur Erstellung von Skills identifizieren, das bereits Eingabefelder für Name, Beschreibung und Anweisungen umfasst. Das zugrunde liegende Konzept ist nicht neu, sondern existiert bereits in Googles Entwicklerwerkzeugen wie Gemini CLI und Antigravity, wo Nutzer spezialisierte Befehlssätze installieren und verwalten können. Mit der Integration in Gemini for Business würde diese Funktion jedoch einer deutlich breiteren Nutzerschaft zugänglich gemacht werden. Zudem deutet die Einbindung von „Skill Architect“ laut Bericht darauf hin, dass Google Unternehmen künftig ermöglichen möchte, wiederverwendbare und domänenspezifische KI-Assistenten zu erstellen, ohne dass dafür tiefgehendes technisches Fachwissen erforderlich ist.

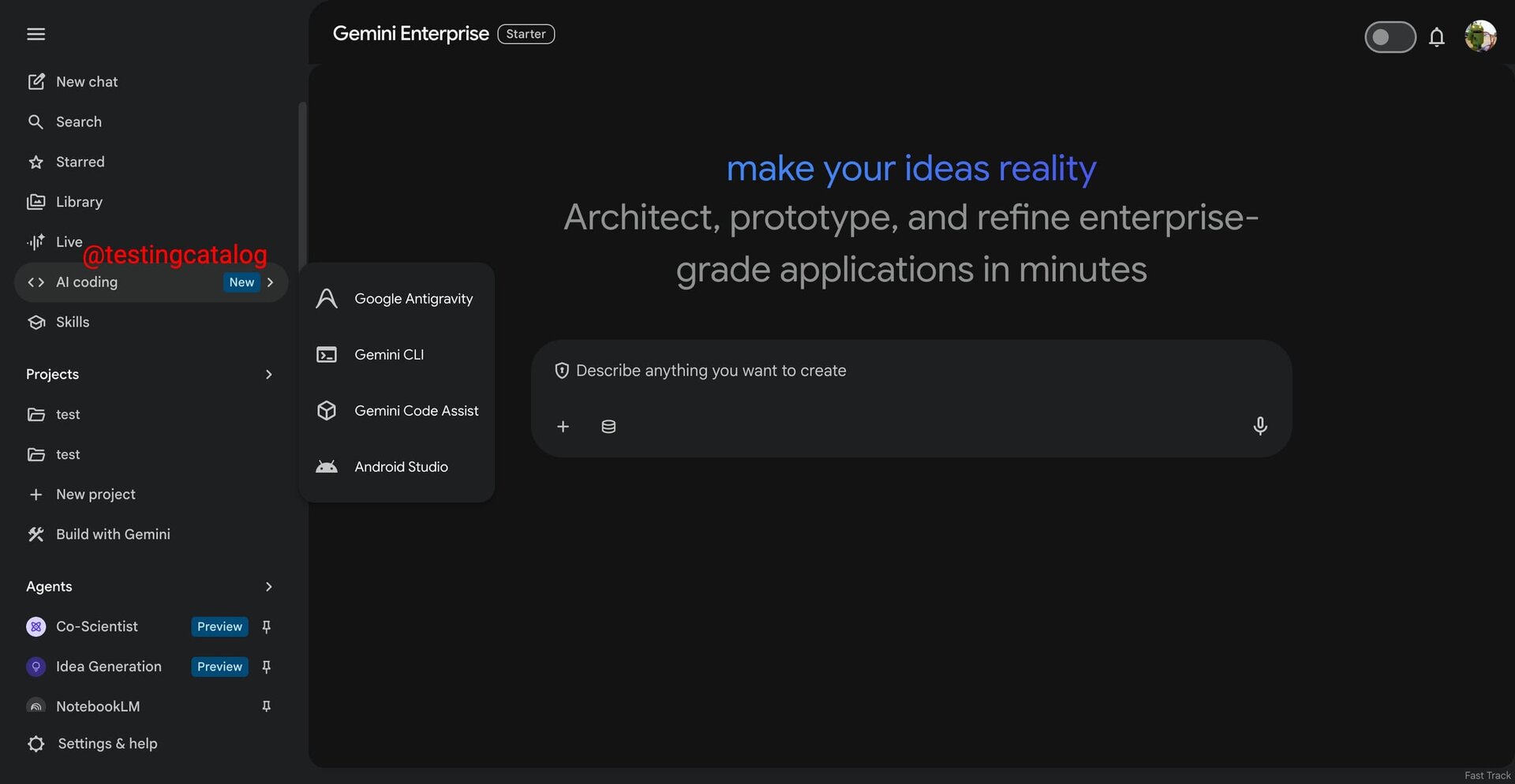

Zusätzlich haben die Experten eine weitere, bislang versteckte Schaltfläche mit der Bezeichnung „AI Coding“ entdeckt. Diese scheint derzeit jedoch kaum mehr als ein Verzeichnis zu sein, das Nutzer auf bestehende Werkzeuge verweist. Konkret werden dort offenbar bereits vorhandene Lösungen wie Antigravity und Gemini CLI inklusive entsprechender Installationshinweise für die Gemini-Befehlszeilenschnittstelle gebündelt.

Kein Zeitpunkt für offiziellen Start erkennbar

TestingCatalog weist zudem darauf hin, dass für keine der entdeckten Funktionen bislang ein bestätigter Veröffentlichungstermin vorliegt, weshalb sich ein konkreter Startzeitpunkt derzeit nicht prognostizieren lässt. Die erkennbaren Fortschritte in der Entwicklung deuten jedoch darauf hin, dass Google sein Business-Angebot konsequent weiter ausbauen dürfte, was nicht zuletzt im Zusammenhang mit der zunehmend wachsenden Konkurrenz zu sehen ist.

Apps & Mobile Entwicklung

Gaming-Grafikkarten: Was hat sich über den Winter in euren Gaming-PCs getan?

Mit welchen Anteilen sind die drei maßgeblichen Grafikkarten-Hersteller im ComputerBase-Forum vertreten, wann haben die Leser ihre aktuelle Grafikkarte gekauft und welche Modelle werden konkret genutzt? Auf diese und weitere Fragen gibt es mit dem halbjährlichen Format der heutigen Sonntagsfrage abermals Antworten.

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Künstliche Intelligenzvor 1 Monat

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 4 Wochen

Social Mediavor 4 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenX3D² bestätigt: Der AMD Ryzen 9 9950X3D2 mit doppeltem 3D V-Cache kommt!