Apps & Mobile Entwicklung

Nvidia DGX Station: GB300 mit 288 GB HBM3e für den Desktop ist jetzt bestellbar

Ein Jahr nach der Ankündigung der DGX Station lassen sich die von Nvidia und Partnern entwickelten AI-Workstations mit GB300 für den Desktop in Kürze vorbestellen. Entwickler erhalten damit den großen Datacenter-Chip GB300 mit 288 GB HBM3e – nur eben für den Schreibtisch. Die Auslieferung wird aber noch einige Monate brauchen.

Wem ein DGX Spark (Test) für die lokale KI-Entwicklung nicht genügend Rechenleistung zur Verfügung stellt, kann sich mittelfristig auch eine DGX Station auf den Schreibtisch stellen. Anstelle des „kleinen“ GB10 erhalten Käufer dann einen GB300, den großen Grace-Blackwell-Chip, wie er auch in den Datacenter-Racks von Nvidia zum Einsatz kommt. Dort bringt ein Server-Rack gleich 72 GPUs mit 36 CPUs zusammen.

GB300 Grace Blackwell Ultra Desktop Superchip,

Auf dem Schreibtisch geht zwar alles eine Nummer kleiner vonstatten, die technischen Daten sind dennoch beachtlich. Die DGX Station setzt auf den GB300 Grace Blackwell Ultra Desktop Superchip, der ein Blackwell-Ultra-Package mit zwei GPU-Dies und 288 GB HBM3e über einen 900 GB/s schnellen NVLink-C2C-Interconnect mit einer Grace-CPU verbindet, die 72 Neoverse-V2-Kerne von Arm und 496 GB LPDDR5X mit 396 GB/s bietet.

Nvidia gibt die AI-Leistung des Systems mit 20 PetaFLOPS an, wobei es sich dabei um 20 PetaFLOPS für FP4 mit Sparsity-Beschleunigung handelt, nachdem Blackwell Ultra im Data Center auf 15 PetaFLOPS für FP4 Dense und höhere 30 PetaFLOPS mit FP4 Sparsity kommt. Zum Vergleich: GB10 im kleineren DGX Spark bietet eine GPU mit 1 PetaFLOPS FP4-Leistung (mit Sparsity) – also nur 5 Prozent der Leistung.

DGX Station als On-Demand-Node nutzen

KI-Entwickler erhalten somit eine Workstation mit 784 GB DRAM verteilt über den HBM der GPU und den SOCAMM-LPDDR5X der CPU. Sprachmodelle mit bis zu einer Billion Parametern sollen sich lokal ausführen lassen. Die Systeme lassen sich als eigener „AI Supercomputer“ oder aber remote als On-Demand-Node mit verteilter Rechenleistung für ein ganzes Team nutzen. Weil die Architektur dieselbe ist wie im Datacenter, sollen sich Projekte nahtlos von der lokalen Umgebung ins Rechenzentrum portieren lassen.

Developers can run and fine-tune state-of-the-art models on DGX Station — including OpenAI [gpt-oss-120b], Google Gemma 3, Qwen3, Kimi K2.5, Mistral Large 3, DeepSeek V3.2 and NVIDIA Nemotron — and tap into a wide variety of familiar tools and platforms from 1x, Aible AI, Anaconda, Docker, Red Hat, JetBrains, Docker, Inc., Ollama, llama.cpp, ComfyUI, LM Studio, Llm.c, Weights & Biases (acquired by CoreWeave), Odyssey, Roboflow, VLLM, SGLang, Unsloth, Learning Machine, Quali, Lightning AI and more.

Nvidia über die DGX Station

Bis zu 1.600 Watt kann eine DGX Station ziehen

Die einzige Voraussetzung für den Arbeitsplatz? US-Kunden empfiehlt Nvidia einen „20A circuit“, also eine Steckdose an einem Stromkreis mit 20A/120V, demnach bis zu 2.400 Watt. Üblich sind in den USA nämlich 15A/120V für maximal 1.800 Watt. Nvidia gibt den Leistungsbedarf einer DGX Station offiziell mit bis zu 1.600 Watt an.

Auslieferung in den kommenden Monaten

Während Nvidia bei dem DGX Spark auch ein eigenes Modell in Gold mit besonders viel Storage anbietet und Acer, Asus, Dell, Gigabyte, HP, Lenovo und MSI alternative, günstigere Designs mit demselben Board zur Auswahl stellen, hält sich Nvidia bei der DGX Station zurück und überlässt das Feld Asus, Dell, Gigabyte, MSI und Supermicro. Später im Jahr soll auch HP mit einer DGX Station folgen. Weil Nvidia nicht selbst mit einem System involviert ist, fehlen derzeit auch noch Preise. Bei den Partnern dürften Interessenten aber in jedem Fall fünfstellig tief ins Portemonnaie greifen müssen.

Apropos später im Jahr: Für eine DGX Station muss man weiterhin Geduld zeigen. Vorbestellungen seien laut Nvidia zwar ab dem 16. März möglich, doch die Auslieferung soll ohne konkreten Termin erst in den „kommenden Monaten“ erfolgen.

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA im Vorfeld und im Rahmen einer Veranstaltung des Herstellers in San Jose, Kalifornien erhalten. Die Kosten für An-, Abreise und fünf Hotelübernachtungen wurden vom Unternehmen getragen. Eine Einflussnahme des Herstellers oder eine Verpflichtung zur Berichterstattung bestand nicht. Die einzige Vorgabe aus dem NDA war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

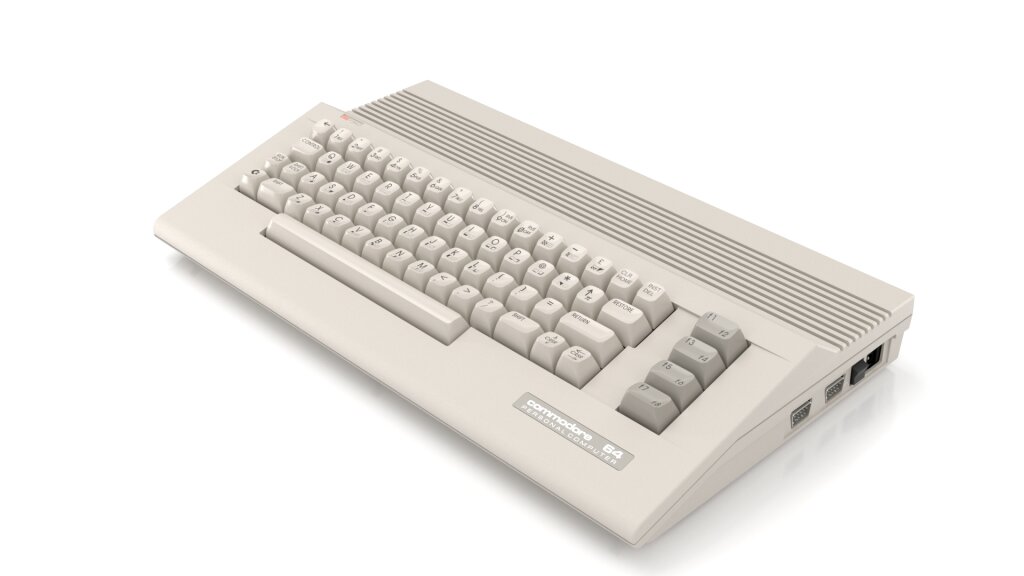

Retro-Heimcomputer-Neuauflage: Commodore 64C Ultimate erscheint im September

Mit dem Commodore 64C Ultimate bekommt ein weiteres Modell des altehrwürdigen Retro-Rechners eine Neuauflage mit aktueller FPGA-Technologie. Das Gehäuse entspricht weiterhin dem des Original-64C aus dem Jahr 1986.

Die Neuauflage des Commodore 64C kann ab sofort zum Preis ab rund 300 US-Dollar vorbestellt werden. Die Auslieferung wird dem Hersteller zufolge im Zeitraum zwischen dem 2. und 15. September 2026 erfolgen. Dabei nutzt Commodore die Spritzgussformen des Originalmodells, wodurch rundliche Fließspuren als Echtheitsmerkmale auf der Gehäuseoberfläche erkennbar sind.

Commodore 64C Ultimate mit moderner FPGA-Technik

Während das Äußere des Commodore 64C Ultimate dank der wiedererworbenen Gussformen dem Original treu bleibt, basiert das Innenleben des Retro-Heimcomputers auf aktueller FPGA-Technologie. FPGA, ausgeschrieben „Field Programmable Gate Array“, sind hierbei integrierte Schaltkreise, dessen Logik weitreichend umprogrammiert werden kann. Dadurch kann die ursprüngliche Hardware genau nachgebildet werden.

Das FPGA-basierte Mainboard bietet darüber hinaus aber auch aktuelle Anschlussmöglichkeiten wie ein HDMI-Port, USB-Anschlüsse sowie WLAN. Zudem wird der Commodore 64C Ultimate mit Spielen und Demos ausgeliefert, während ein spiralgebundenes Handbuch nicht nur die Bedienung des Retro-Computers erläutert, sondern zusätzlich in die Programmierung mit BASIC einführt.

Drei Editionen stehen zur Wahl

Dabei stehen insgesamt drei Editionen des Commodore 64C Ultimate zur Auswahl, die schon jetzt mit einem Preisnachlass von jeweils 50 US-Dollar vorbestellt werden können. Demnach gibt es die „BASIC Beige“-Edition zum Preis von 299,99 US-Dollar als originalgetreue Nachbildung, die „Starlight Edition“ mit durchsichtigem Gehäuse und LED-Beleuchtung für 349,99 US-Dollar sowie die „Founder’s Edition“ mit goldbeschichteten Tastenkappen, vergoldeten Logos und halbtransparentem Gehäuse für 499,99 US-Dollar.

The Commodore 64 Ultimate has tapped into a nostalgia not just for a piece of technology, but for a time when technology served us not enslaved us; when it challenged us and helped us grow. But there’s still something comforting about the tangible side of that nostalgia; a visual reminder of the time we long to return to. And for many users, that memory is intrinsically tied to the C64C. Soon they can have one at their fingertips once again.

Peri Fractic, Präsident und CEO sowie Chief Product Officer von Commodore

Mit dem Commodore 64C Ultimate möchte das Unternehmen die Sehnsucht nach Nostalgie bedienen, als „uns Technologie noch diente, statt zu versklaven“, wie Commodore-Chef Peri Fractic im Rahmen eines Blogbeitrags erklärt. Ferner ist diese Ankündigung, die als zweites Produkt auf den „Brotkasten“ Commodore 64 Ultimate folgt, nur die erste von mehreren Enthüllungen, die noch für das aktuelle Jahr geplant sind.

Apps & Mobile Entwicklung

Moza R9 mit CS Pro Lenkrad im Test

Mit der R9 V3 Wheel Base mit 9 Nm, den SR-P-Pedalen mit Hybrid-Load-Cell-Bremse sowie dem neuen CS Pro Wheel mit RGB-Buttons, 2,99“-Display und mindestens vier rückseitigen Paddeln bietet Moza ein komplettes Racing-Sim-Paket für knapp über 800 Euro an. Der Test zeigt Vorzüge, aber auch Einschränkungen auf.

Das Bundle im Überblick

Das getestete Bundle besteht aus der Moza R9 V3 Wheel Base, einer passenden Tischklemme, den SR-P-Pedalen sowie dem recht neuen Moza CS Pro Lenkrad. Im Preisvergleich kommen die Komponenten in Summe zum Start in den Mai auf 820 Euro, wobei das Lenkrad aktuell nur bei Moza selbst verfügbar ist.

Die Moza R9 V3 Wheel Base

Die Wheel Base bietet ein maximales Drehmoment von 9 Newtonmetern bei einer maximalen Leistung von 180 Watt sowie Mozas Quick-Release-Verbindung für die Lenkradaufnahme. Die Tischklemme ist aus schwarzem Metall gefertigt und kostet ab 45 Euro. Die Wheel Base ist ab 309 Euro erhältlich.

Die Moza SR-P Pedale

Die SR-P-Pedale bestehen aus einem Gas- und einem Bremspedal. Letzteres soll mit einer Hybridbremse, die eine Load-Cell und einen Winkelsensor kombiniert, überzeugen. Mit einer UVP von rund 160 Euro ist es ein wenig günstiger als die Fanatec CSL Pedals LC und 10 Euro teurer als die kürzlich zusammen mit dem Logitech G RS50 System getesteten RS Pedals für rund 150 Euro. Der Handel ruft aber schon nur noch Preise ab 118 Euro auf.

Das Moza CS Pro Lenkrad

Das neue Moza CS Pro Lenkrad bietet ein Display, hinterleuchtete Knöpfe sowie auf der Rückseite zwei Schaltwippen und zwei Kupplungspaddel. Sein Lenkradkranz hat einen Durchmesser von 325 mm. Verkauft wird es ab 349 Euro. Das zusätzliche Paddel-Addon-Kit kostet weitere 50 Euro.

Macht in Summe ohne die Addon-Paddles etwas über 800 Euro. Was Kunden dafür bekommen, hat ComputerBase ausführlich getestet. Die Details finden sich auf den folgenden Seiten.

- Moza R9 V3 Wheel Base

- Moza SR-P-Pedale mit Gas- und Bremspedal

- Moza CS Pro Lenkrad mit Paddles-Addon-Kit

- Tischklemme

Apps & Mobile Entwicklung

Philips Evnia AmbiScape: Raumbeleuchtung folgt Ambiglow-Monitor auf den Fuß

Die Umgebungsbeleuchtung „Ambiglow“ der Evnia-Monitore von Philips kann nun mit Matter-kompatibler Innenraumbeleuchtung in Einklang gebracht werden. AmbiScape nennt sich die neue Funktion, die Raum und Monitor synchron leuchten lässt.

Voraussetzung dafür ist zum einen der Besitz eines Evnia-Monitors mit Ambiglow und zum anderen ein netzwerkfähiges Beleuchtungssystem, das mit dem Matter-Ökosystem kompatibel ist.

Realisiert wird der Abgleich der Beleuchtung über die kostenlose Software Philips Evnia Precision Center. Ambiglow nutzt eine mit KI optimierte Technik, die die Beleuchtung dynamisch an das Geschehen im Spiel anpasst. Dabei werden unter anderem Farbbalance und Szenenwechsel erfasst und mit der Umgebungsbeleuchtung in Einklang gebracht. Das Pendant dazu bei Philips-Fernsehern ist Ambilight.

AmbiScape nutzt Matter-Standard

Mit AmbiScape wurde jetzt eine Matter-zertifizierte Schnittstelle hinzugefügt, „die das Geschehen auf dem Bildschirm in die Umgebung überträgt, indem sie Matter-kompatible Smart-Leuchten mit dem Geschehen auf dem Bildschirm synchronisiert“, erklärt Philips.

Aktuelle Version des Precision Center nötig

Die neue Funktion stehe allen Besitzern eines Evnia-Monitors kostenlos zur Verfügung. Dafür müssen diese mindestens die Version 1.9 der Precision Center Software installiert haben, die seit dem 29. April zum Download angeboten wird.

Nähere Informationen liefert Philips auf seiner Webseite zu AmbiScape.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview