Apps & Mobile Entwicklung

Free Software Foundation: Mit freien Inhalten trainierte KI-Modelle sollten für alle frei sein

Die Free Software Foundation (FSF) hat Anthropic erneut für die Nutzung ihrer Materialien beim Training der KI-Modelle kritisiert. Zugleich fordert die Organisation auch von anderen LLM-Entwicklern, Modelle, die mit frei zugänglichen Inhalten trainiert wurden, ebenfalls frei für Nutzer bereitzustellen.

Freie Werke fallen unter Fair Use

Die FSF und Anthropic blicken bereits auf eine bewegte Geschichte juristischer Auseinandersetzungen zurück. Zuletzt trafen beide Parteien sowie Meta im Juni 2025 im Rahmen einer von drei Autoren angestrebten Sammelklage aufeinander, in der es um die Nutzung von im Internet verfügbaren Werken zum Training von Anthropics KI-Modellen ging. Beide Seiten konnten in dem Rechtsstreit seinerzeit Erfolge für sich verbuchen: So befand das Gericht damals, dass das Verwenden von im Netz verfügbaren Büchern unter die Fair-Use-Regelung falle, da bei der Verwendung geschützter Werke für das Training eines Large Language Models (LLM) etwas Neues entstehe. Das Vorgehen sei somit transformativ, was eine Grundvoraussetzung für die Annahme von Fair Use darstellt.

Eine Rechtsverletzung hatte seinerzeit laut dem Gerichtsurteil dennoch stattgefunden, da sich Anthropic und Meta urheberrechtlich geschützte Werke aus illegalen Quellen beschafft und behalten hatten – Copyright-Piraterie wie bei dem verwendeten Books3- und LibGen-Datensatz, welche Millionen von Büchern enthalten haben, sei laut dem damals verantwortlichen Richter William Alsup durch Fair Use nicht abgedeckt. Im Rahmen eines Vergleiches erklärte sich Anthropic im September 2025 zur Einrichtung eines 1,5 Milliarden Euro hohen Fonds bereit, um Autoren zu entschädigen, deren Werke das Unternehmen ohne Genehmigung zum Trainieren seiner Modelle verwendet hatte.

Unternehmen sollen Daten teilen

Unter den Büchern, die für das Training genutzt wurden, befanden sich allerdings auch zahlreiche freie Werke, wie beispielsweise „Free as in Freedom: Richard Stallman’s Crusade for Free Software“ von Sam Williams. Dieses wurde laut der FSF von O’Reilly und der FSF unter der GNU Free Documentation License (GNU FDL) veröffentlicht.

Die freie Lizenz erlaube laut der FSF die Nutzung des Werks für jeden Zweck ohne Bezahlung. Aus diesem Grund fordert die Organisation Anthropic auf, die vollständigen Trainingsdaten mit jedem Nutzer des LLM kostenlos zu teilen, zusammen mit dem vollständigen Modell, den Einstellungen der Trainingskonfigurationen und dem dazugehörigen Software-Quellcode. Allerdings dürfte der FSF klar sein, dass der KI-Spezialist dieser Forderung nicht nachkommen wird – nicht zuletzt auch, weil die Organisation ebenso erklärte, dass ihr die Ressourcen für einen langjährigen Rechtsstreit fehlen würden. Sie erklärte allerdings ebenso, dass sie, sollte sie sich an einem Rechtsstreit beteiligen und dabei feststellen, dass ihre Urheberrechte und Lizenzen verletzt wurden, „als Entschädigung sicherlich die Freiheit der Nutzer fordern würde“.

Erkenntnisse aus freien Werken soll kostenlos sein

Vor diesem Hintergrund darf eher davon ausgegangen werden, dass die FSF hier eine öffentliche Debatte darüber entfachen will, dass bei der Nutzung freier Inhalte auch deren Bedingungen in Bezug auf den freien Gedanken weitergetragen werden sollten – und dass Konzerne mit zum Allgemeinwohl freigegebenen Inhalten Einnahmen generieren, während andere, die auf die Erkenntnisse aus diesen Werken zugreifen wollen, dafür bezahlen müssen.

Apps & Mobile Entwicklung

UltraGear evo GM9 27GM950B: LG bringt hellen 5K-Monitor mit über 9.000 Mini-LEDs

Einen 5K-Monitor mit hellem Mini-LED-Backlight und Dual-Mode bringt LG mit dem UltraGear evo GM9 (27GM950B) auf den Markt. Der 27″-Monitor liefert 218 ppi und soll in der Spitze mit 1.250 cd/m² leuchten. Spieler haben die Wahl zwischen nativer Auflösung mit 165 Hz oder WQHD mit 330 Hz.

5K-Auflösung für 218 ppi

Die 5.120 × 2.880 Pixel des UltraGear evo GM9 (27GM950B) bedeuten eine Bildpunktdichte von 218 ppi bei 27 Zoll Diagonale. Diese Variante der 5K-Auflösungen wird auch 5K UHD+ genannt und nutzt das klassische 16:9-Seitenformat. Sie liefert doppelt so viele Pixel wie Dual QHD mit 5.120 × 1.440 in 32:9.

IPS mit 2.304 Mini-LED-Zonen

Das IPS-Display ist mit einem Mini-LED-Backlight bestückt, das über 2.304 separat dimmbare Leuchtzonen verfügt. Die Gesamtzahl der Mini-LEDs gibt LG mit 9.216 an. Jede Zone verfügt demnach über 4 Leuchtdioden. Je mehr Zonen ein Mini-LED-Display hat, umso feiner ist die Abstufung bei der Beleuchtung, was den Halo-Effekt bei hellen Objekten vor dunklem Hintergrund verringert, aber nicht eliminiert. Die Kombination aus 5K UHD+ und 2.304 Mini-LED-Zonen bietet sonst nur Apples Studio Display XDR.

LG spricht von „Hyper Mini LED“ und wirbt mit einer „überragenden Spitzenhelligkeit“ von 1.250 cd/m². Diese Leuchtkraft wird allerdings nur punktuell erreicht. Auf ganzer Fläche sollen aber ebenfalls hohe 750 cd/m² möglich sein. Der Monitor ist nach DisplayHDR 1000 zertifiziert.

Durch einen besonders geringen Abstand zwischen Panel und Hintergrundbeleuchtung sollen lichtdurchlässige Stellen und Blooming-Effekte reduziert werden. LG spricht von „Zero Optical Distance“-Technologie.

Dual-Mode für bis zu 330 Hz

Die native 5K-Auflösung wird mit bis zu 165 Hz dargestellt. Spieler, die Auflösung zugunsten einer höheren Bildwiederholrate opfern wollen, können auf den alternativen Modus mit 2.560 × 1.440 Pixeln umschalten, um dann die doppelte Bildwiederholfrequenz von 330 Hz zu erhalten.

DisplayPort 2.1 mit UHBR20

Bei den Videoeingängen ist der aktuelle DisplayPort 2.1 in der maximalen Ausbaustufe mit vier 20-Gbit/s-Lanes (UHBR20) für 80 Gbit/s brutto vertreten. Außerdem gibt es zweimal HDMI 2.1, einen USB-C-Anschluss mit 90 Watt Power Delivery sowie zwei USB-A-Buchsen und einen Kopfhörerausgang. Eine KVM-Funktion wird auf den Produktseiten zwar nicht explizit erwähnt, doch weist der Eintrag „Dual Controller“ bei den Spezifikationen darauf hin.

Weitere Ausstattung

Der Monitor verfügt über einen integrierten Prozessor, mit dem sich niedriger auflösende Inhalte auf 5K Hochskalieren lassen (Upscaling). Das Feature ist allerdings nicht für Spiele gedacht, hier leisten die Grafikkarten von AMD, Intel und Nvidia bessere Arbeit.

Die integrierten Stereolautsprecher (2 × 7 W) sollen dank „AI Sound“ ein immersives virtuelles 7.1.2-Kanal-Klangerlebnis simulieren.

AI Sound trennt einzelne Audioelemente – Stimmen, Effekte und Hintergrundgeräusche – auf intelligente Weise voneinander und passt sich dem Spielgeschehen an. So entsteht ein immersives virtuelles 7.1.2-Kanal-Klangerlebnis. Über die integrierten 7-W-Stereolautsprecher (2 x 7 W) oder Kopfhörer bleiben Stimmen auch in intensiven Feuergefechten deutlich hörbar, während wichtige Hinweise wie Schrittgeräusche jederzeit klar zu erkennen sind.

LG

Sowohl AMD FreeSync als auch Nvidia G-Sync (kompatibel) werden unterstützt. Das Display lässt sich in der Höhe verstellen, neigen sowie vertikal und horizontal schwenken. Auf der Gehäuserückseite ermöglichen zwei LED-Streifen RGB-Leuchteffekte.

Preis und Verfügbarkeit

Die internationale Pressemitteilung nennt den April für den Marktstart, der je nach Region aber variieren kann. In den USA wird der UltraGear evo GM9 (27GM950B) zum Preis von rund 1.200 Dollar zur Vorbestellung angeboten.

Apps & Mobile Entwicklung

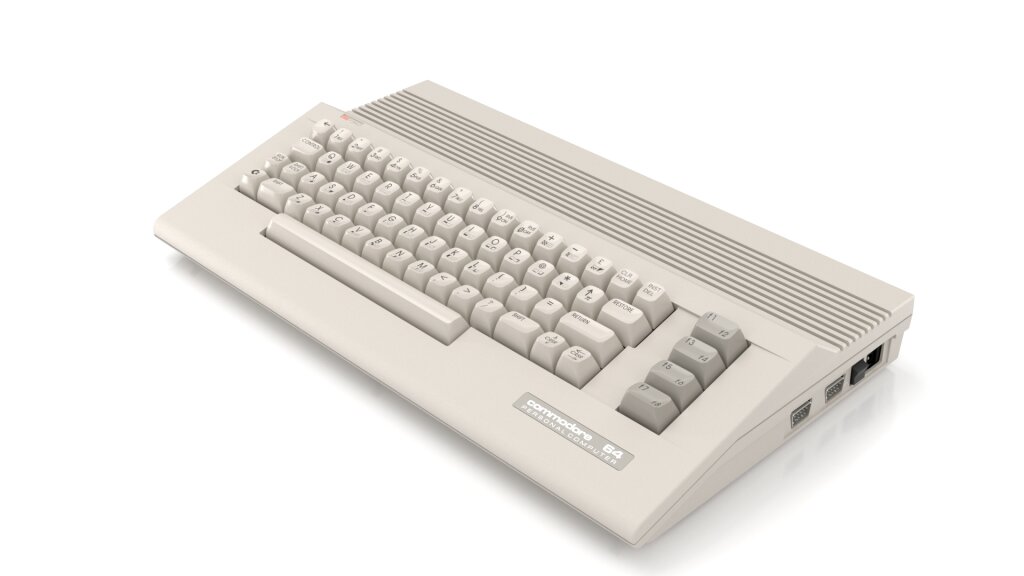

Retro-Heimcomputer-Neuauflage: Commodore 64C Ultimate erscheint im September

Mit dem Commodore 64C Ultimate bekommt ein weiteres Modell des altehrwürdigen Retro-Rechners eine Neuauflage mit aktueller FPGA-Technologie. Das Gehäuse entspricht weiterhin dem des Original-64C aus dem Jahr 1986.

Die Neuauflage des Commodore 64C kann ab sofort zum Preis ab rund 300 US-Dollar vorbestellt werden. Die Auslieferung wird dem Hersteller zufolge im Zeitraum zwischen dem 2. und 15. September 2026 erfolgen. Dabei nutzt Commodore die Spritzgussformen des Originalmodells, wodurch rundliche Fließspuren als Echtheitsmerkmale auf der Gehäuseoberfläche erkennbar sind.

Commodore 64C Ultimate mit moderner FPGA-Technik

Während das Äußere des Commodore 64C Ultimate dank der wiedererworbenen Gussformen dem Original treu bleibt, basiert das Innenleben des Retro-Heimcomputers auf aktueller FPGA-Technologie. FPGA, ausgeschrieben „Field Programmable Gate Array“, sind hierbei integrierte Schaltkreise, dessen Logik weitreichend umprogrammiert werden kann. Dadurch kann die ursprüngliche Hardware genau nachgebildet werden.

Das FPGA-basierte Mainboard bietet darüber hinaus aber auch aktuelle Anschlussmöglichkeiten wie ein HDMI-Port, USB-Anschlüsse sowie WLAN. Zudem wird der Commodore 64C Ultimate mit Spielen und Demos ausgeliefert, während ein spiralgebundenes Handbuch nicht nur die Bedienung des Retro-Computers erläutert, sondern zusätzlich in die Programmierung mit BASIC einführt.

Drei Editionen stehen zur Wahl

Dabei stehen insgesamt drei Editionen des Commodore 64C Ultimate zur Auswahl, die schon jetzt mit einem Preisnachlass von jeweils 50 US-Dollar vorbestellt werden können. Demnach gibt es die „BASIC Beige“-Edition zum Preis von 299,99 US-Dollar als originalgetreue Nachbildung, die „Starlight Edition“ mit durchsichtigem Gehäuse und LED-Beleuchtung für 349,99 US-Dollar sowie die „Founder’s Edition“ mit goldbeschichteten Tastenkappen, vergoldeten Logos und halbtransparentem Gehäuse für 499,99 US-Dollar.

The Commodore 64 Ultimate has tapped into a nostalgia not just for a piece of technology, but for a time when technology served us not enslaved us; when it challenged us and helped us grow. But there’s still something comforting about the tangible side of that nostalgia; a visual reminder of the time we long to return to. And for many users, that memory is intrinsically tied to the C64C. Soon they can have one at their fingertips once again.

Peri Fractic, Präsident und CEO sowie Chief Product Officer von Commodore

Mit dem Commodore 64C Ultimate möchte das Unternehmen die Sehnsucht nach Nostalgie bedienen, als „uns Technologie noch diente, statt zu versklaven“, wie Commodore-Chef Peri Fractic im Rahmen eines Blogbeitrags erklärt. Ferner ist diese Ankündigung, die als zweites Produkt auf den „Brotkasten“ Commodore 64 Ultimate folgt, nur die erste von mehreren Enthüllungen, die noch für das aktuelle Jahr geplant sind.

Apps & Mobile Entwicklung

Moza R9 mit CS Pro Lenkrad im Test

Mit der R9 V3 Wheel Base mit 9 Nm, den SR-P-Pedalen mit Hybrid-Load-Cell-Bremse sowie dem neuen CS Pro Wheel mit RGB-Buttons, 2,99“-Display und mindestens vier rückseitigen Paddeln bietet Moza ein komplettes Racing-Sim-Paket für knapp über 800 Euro an. Der Test zeigt Vorzüge, aber auch Einschränkungen auf.

Das Bundle im Überblick

Das getestete Bundle besteht aus der Moza R9 V3 Wheel Base, einer passenden Tischklemme, den SR-P-Pedalen sowie dem recht neuen Moza CS Pro Lenkrad. Im Preisvergleich kommen die Komponenten in Summe zum Start in den Mai auf 820 Euro, wobei das Lenkrad aktuell nur bei Moza selbst verfügbar ist.

Die Moza R9 V3 Wheel Base

Die Wheel Base bietet ein maximales Drehmoment von 9 Newtonmetern bei einer maximalen Leistung von 180 Watt sowie Mozas Quick-Release-Verbindung für die Lenkradaufnahme. Die Tischklemme ist aus schwarzem Metall gefertigt und kostet ab 45 Euro. Die Wheel Base ist ab 309 Euro erhältlich.

Die Moza SR-P Pedale

Die SR-P-Pedale bestehen aus einem Gas- und einem Bremspedal. Letzteres soll mit einer Hybridbremse, die eine Load-Cell und einen Winkelsensor kombiniert, überzeugen. Mit einer UVP von rund 160 Euro ist es ein wenig günstiger als die Fanatec CSL Pedals LC und 10 Euro teurer als die kürzlich zusammen mit dem Logitech G RS50 System getesteten RS Pedals für rund 150 Euro. Der Handel ruft aber schon nur noch Preise ab 118 Euro auf.

Das Moza CS Pro Lenkrad

Das neue Moza CS Pro Lenkrad bietet ein Display, hinterleuchtete Knöpfe sowie auf der Rückseite zwei Schaltwippen und zwei Kupplungspaddel. Sein Lenkradkranz hat einen Durchmesser von 325 mm. Verkauft wird es ab 349 Euro. Das zusätzliche Paddel-Addon-Kit kostet weitere 50 Euro.

Macht in Summe ohne die Addon-Paddles etwas über 800 Euro. Was Kunden dafür bekommen, hat ComputerBase ausführlich getestet. Die Details finden sich auf den folgenden Seiten.

- Moza R9 V3 Wheel Base

- Moza SR-P-Pedale mit Gas- und Bremspedal

- Moza CS Pro Lenkrad mit Paddles-Addon-Kit

- Tischklemme

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview