Apps & Mobile Entwicklung

G-Sync Pulsar: Neue Monitortechnik in Videos erklärt und getestet

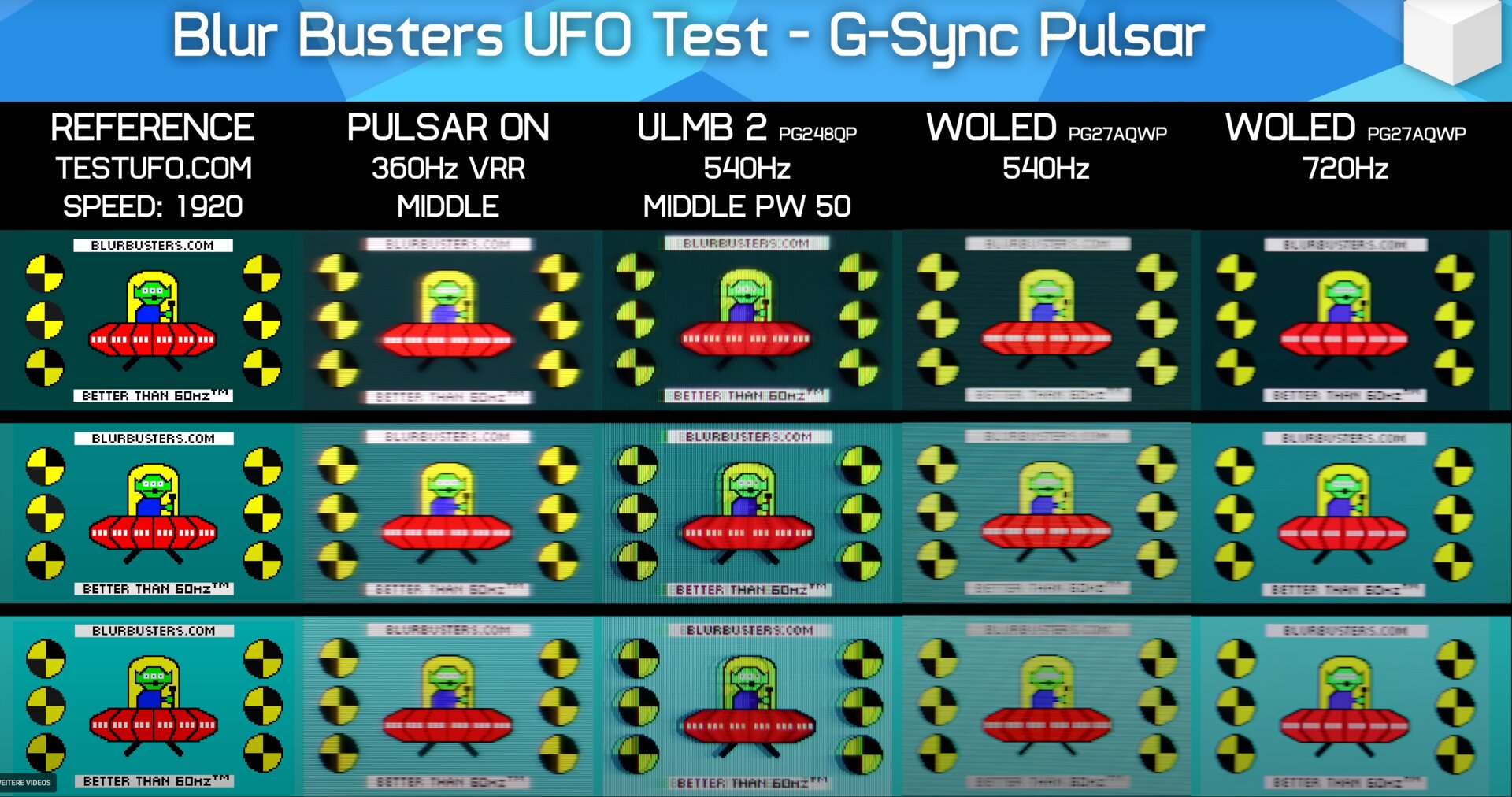

In einem Video erklärt der G-Sync-Chefarchitekt Gerrit Slavenburg, was hinter der neuen Monitortechnik G-Sync Pulsar steckt. Diese soll die Bewegungsunschärfe in Spielen soweit reduzieren, dass die Darstellung einem 1.000-Hz-Display entspreche. Erste Tests überzeugen und die Resultate bieten selbst OLED die Stirn.

G-Sync Pulsar kurz erklärt

Im Grunde ist G-Sync Pulsar eine Weiterentwicklung des sogenannten Backlight Strobing, auch als Black Frame Insertion (BFI) bekannt. Dabei wird die Hintergrundbeleuchtung im schnellen Wechsel an- und ausgeschaltet. Das sorgt dafür, dass beim Übergang zwischen zwei Bildern nicht wie sonst ein Schatten vom vorherigen Bild stehen bleibt. Und so erscheinen Bewegtbilder viel schärfer und nicht so verschwommen (Motion Blur).

Bei G-Sync Pulsar wird aber nicht auf einmal die ganze Fläche der Hintergrundbeleuchtung an- und abgeschaltet, sondern diese in Streifen von oben nach unten schrittweise oder eben „pulsierend“ eingesetzt. In Kombination mit einer höheren Frequenz wird ein Flimmern minimiert.

Nvidia wirbt damit, dass die Darstellung mit G-Sync Pulsar effektiv einem Display mit über 1.000 Hz entspricht. Zudem funktioniert es gleichzeitig mit variablen Bildwiederholraten (VRR), was beim vorherigen Ultra Low Motion Blur (ULMB) nicht der Fall ist.

G-Sync Pulsar in ersten Tests

Der YouTube-Kanal Monitors Unboxed konnte sich bereits einen ersten Eindruck von G-Sync Pulsar verschaffen. Dabei kam der Asus ROG Strix Pulsar XG27AQNGV zum Einsatz, der neben Modellen von Acer, AOC und MSI zu den ersten vier Monitoren mit G-Sync Pulsar gehört, die zum Teil noch diesen Monat den Handel erreichen sollen.

Der Tester zeigt sich beeindruckt und findet, dass G-Sync Pulsar die derzeit beste Implementation von Backlight-Strobing darstellt. ULMB 2 sei zwar ähnlich effektiv, doch ist dies nur mit einer festen Bildwiederholrate nutzbar, während G-Sync Pulsar auch zusammen mit einer Variablen Refresh Rate (VRR) funktioniert. Selbst OLED-Monitore mit hohen Bildwiederholraten sind laut den im Video zu sehenden Aufnahmen kaum besser oder sogar schlechter bei der Reduzierung von Bewegungsunschärfe als das Pulsar-Display.

Übrigens steht der Kanal mit seinen positiven Eindrücken von G-Sync Pulsar nicht alleine da. Zum Beispiel zeigte sich PC Gamer von der CES-Demo ebenfalls sehr angetan:

Aber ich kann Ihnen sagen, dass ich als jemand, der schon vor Hunderten (wahrscheinlich mittlerweile Tausenden) von extrem guten Gaming-Monitoren gestanden hat , die Art und Weise, wie G-Sync Pulsar die Wahrnehmung schnell bewegter Bilder verändert, geradezu tiefgreifend ist.

Funktioniert es auch mit Radeon?

Eine Frage, die sich vielen bei den Meldungen über G-Sync Pulsar stellte, ist, ob G-Sync Pulsar nur mit GeForce-Grafikkarten funktioniert oder sich auch mit AMD Radeon verwenden lässt. Damit wird direkt ein Kritikpunkt der Tester angesprochen: Obwohl G-Sync Pulsar wie auch FreeSync auf Radeon mit dem offenen Standard Adaptive-Sync arbeitet, kann es nur mit Nvidia GeForce genutzt werden. Es wird nämlich in der derzeitigen Form eine Aktivierung über den GeForce-Treiber benötigt. Da G-Sync Pulsar ein neues Argument für den Kauf eines Monitors mit (teurem) G-Sync-Modul ist, ist sehr unwahrscheinlich, dass sich dies ändern wird.

Es ist aber nicht auszuschließen, dass Monitorhersteller ihrerseits eine ähnliche Technik umsetzen, sofern etwaige Patente dies nicht untersagen. Die Idee, das Backlight in Zonen zu unterteilen, um die negativen Effekte des Backlight-Strobing zu minimieren, hatten zuvor auch bereits andere, wie DyAc 2 von BenQ beweist. Jetzt muss dies noch mit FreeSync kombiniert werden, damit auch Radeon-Nutzer in den Genuss einer ähnlich effektiven Technik kommen.

Apps & Mobile Entwicklung

Resident Evil Requiem: Den Unterschieden zu den PCGH-Ergebnissen auf der Spur

Im Technik-Test zu Resident Evil Requiem kam ComputerBase zu dem Schluss: RTX 5000 hat bei Pathtracing mal wieder keinen Vorteil gegenüber RTX 4000. Doch von Lesern kam Gegenwind: Bei PC Games Hardware kam genau das Gegenteil heraus! Ein Fehler? Nein, wie der Nachtest in Absprache mit PCGH gezeigt hat: beides stimmt.

RTX 5000 vs. RTX 4000: Bei „CB“ keine Vorteile

Nvidias Blackwell-Architektur bietet offiziell verbesserte Raytracing-Einheiten gegenüber dem Vorgänger Lovelace. In Sachen Performance hat sich das bis jetzt aber noch nie so richtig gezeigt. Die Pathtracing-Ergebnisse der Redaktion in Resident Evil Requiem waren dann auch keine große Überraschung: Auch hier konnte sich RTX 5000 nicht von RTX 4000 absetzen. Konkret gelingt es der RTX 5080 nicht auf die RTX 4090 aufzuschließen.

PCGH hat genau das Gegenteil raus?!

Dann wurde die Redaktion in der Community auf die Pathtracing-Benchmarks der Kollegen der PCGH aufmerksam gemacht. In diesen zeigt sich Blackwell deutlich stärker als Lovelace: Die GeForce RTX 5080 ist rund 15 bis 20 Prozent schneller als die GeForce RTX 4090.

Kooperation statt Konfrontation!

Wie kann das sein? Ist vielleicht beides richtig? Oder hat wer einen Fehler gemacht? ComputerBase und PCGH sind der Ursache gemeinsam auf den Grund gegangen, auch um den gegenseitigen Fingerzeigen der Communities eine Alternative gegenüber zu stellen. Kooperation statt Konfrontation.

Nein, kein Fehler gemacht

Zuerst einmal stand die Kontrolle an, ob es einen Messfehler gegeben hat. Die eigene Szene wurde erneut und erstmals auch die von PCGH vermessen – mit den dort genutzten Einstellungen. Fazit: Beide Redaktionen haben korrekt gemessen!

In der Testszene von ComputerBase ist die GeForce RTX 4090 mit Pathtracing und DLSS Performance wirklich die gezeigten 20 Prozent schneller als die GeForce RTX 5080, in der PCGH-Szene mit DLSS Quality liegt dagegen die RTX 5080 16 Prozent vor der RTX 4090. Das ist eine Differenz von satten 36 Prozentpunkten!

Upsampling macht keinen Unterschied aus

Ein Unterschied zwischen den Messverfahren ist das Upsampling: ComputerBase nutzt DLSS Performance, PCGH DLSS Quality. Indem die ComputerBase-Testszene erneut mit DLSS Quality vermessen wurde, die PCGH-Szene dagegen mit DLSS Performance, sollte ein Einfluss durch DLSS ausgeschlossen werden.

Und, nein, daran liegt es auch nicht: In der CB-Sequenz kann sich die GeForce RTX 4090 mit DLSS Quality um 31 Prozent anstatt um 20 Prozent mit Quality von der GeForce RTX 5080 absetzen, was aufgrund der zusätzlichen Renderpixel und damit der höheren Rechenlast eine erwartete Entwicklung ist.

In der PCGH-Sequenz ändert DLSS Performance an der Reihenfolge ebenso wenig. Die RTX 5080 kann sich mit 23 Prozent sogar noch besser als mit DLSS Quality von der RTX 4090 absetzen. Mit dieser Einstellung beträgt die Differenz nur noch 16 Prozent.

Die Ergebnisse bleiben also grundsätzlich gleich, aber sie ergeben mit dem Blick auf die DLSS-Einflüsse noch weniger Sinn: Die GeForce RTX 4090 kann sich aufgrund der zusätzlichen Recheneinheiten bei einer höheren Anzahl an Renderpixel eigentlich immer mehr von der RTX 5080 absetzen, da es ihr leichter fällt, die vielen Einheiten auszulasten. Da die PCGH-Szene genau die gegenteilige Entwicklung aufzeigt, liegt nahe, dass das Ergebnis der GeForce RTX 4090 das ungewöhnliche ist; die Lovelace-Architektur in der Sequenz also ein Problem hat, sei es eine Hardware-Limitierung oder ein Treiber-Limit.

Die Testsequenz ist die Ursache

Bleibt nur noch die Testszene selbst, um den Unterschied zu erklären: Sie ist also verantwortlich für die Diskrepanz. Aber lässt sich sagen, welche besser das Spiel repräsentiert?

Um das zu erklären, hat sich ComputerBase verschiedene Savegames geschnappt, die aus unterschiedlichen Innen- sowie Außenlevels, teils mit Grace und teils mit Leon bestehen. Alle Ergebnisse wurden in WQHD mit DLSS Quality erstellt.

In allen fünf Testszenen ist die GeForce RTX 4090 schneller als die GeForce RTX 5080, teils auch deutlich. Nur einmal wird es knapp, in einer Sequenz liegt die RTX 4090 nur 6 Prozent vor der RTX 5080. Zur Erinnerung: Mit denselben Einstellungen ist die RTX 4090 in der ComputerBase-Testsequenz 31 Prozent schneller als die RTX 5080, bei der PC Games Hardware dagegen die RTX 5080 16 Prozent schneller als die RTX 4090.

Am Ende reichen aber auch in Summe sieben verschiedene Szenen Testszenen nicht aus um zu sagen „Der Wert ist der richtige“, denn das gesamte Spiel repräsentieren sie nicht. Das kann aber auch generell kein Benchmark, ganz gleich welcher.

Schlussbemerkung

Verschiedene Testszenen erzeugen immer leicht unterschiedliche Ergebnisse. Nicht nur, aber auch, weil sich die Last zwischen CPU und GPU teils deutlich verschieben kann. So große Differenzen wie bei den Pathtracing-Benchmarks von ComputerBase und PCGH in Resident Evil Requiem, wo sich die Reihenfolge komplett gedreht hat, sind aber sehr selten anzutreffen.

Doch wie dargelegt, sind die Ergebnisse bei beiden Magazinen korrekt und unterschiedliche Upsampling-Einstellungen auch nicht die Ursache. Es liegt schlicht an der Testsequenz. Unklar bleibt aktuell noch, ob in der Szene von PCGH wirklich die verbesserte Raytracing-Hardware in RTX 5000 dafür verantwortlich ist, oder ein Software-Fehler in Spiel oder Treiber. Die gute Nachricht: In der Regel sind Unterschiede weniger gravierend und selbst wenn sie es mal sind, liegt es nicht an der Unfähig- oder Boshaftigkeit der Tester.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.

Apps & Mobile Entwicklung

Die nervigste Aufgabe nach dem Duschen ist kein Problem mehr

Jede Person mit langen Haaren kennt das Problem: Nach der Dusche fängt erstmal eine Föhn-Odyssee an, die je nach gewünschtem Styling ewig dauern kann. Wenn man dann noch unterwegs ist und auf einen Billig-Föhn angewiesen ist, wird das Ganze nur noch schlimmer. Es gibt jedoch eine einfache Lösung.

Auch wenn ich selbst keine langen Haare habe, kenne ich das Problem nur zu gut. Meine Frau ärgert sich nämlich nach jeder Dusche darüber, wie lang das Föhnen und Stylen anschließend in Anspruch nimmt. Im Rahmen der Recherche für diesen Artikel habe ich ihr die modernen Föhne von Marken wie Laifen gezeigt – und sie ist begeistert. Warum genau, das erkläre ich Euch jetzt.

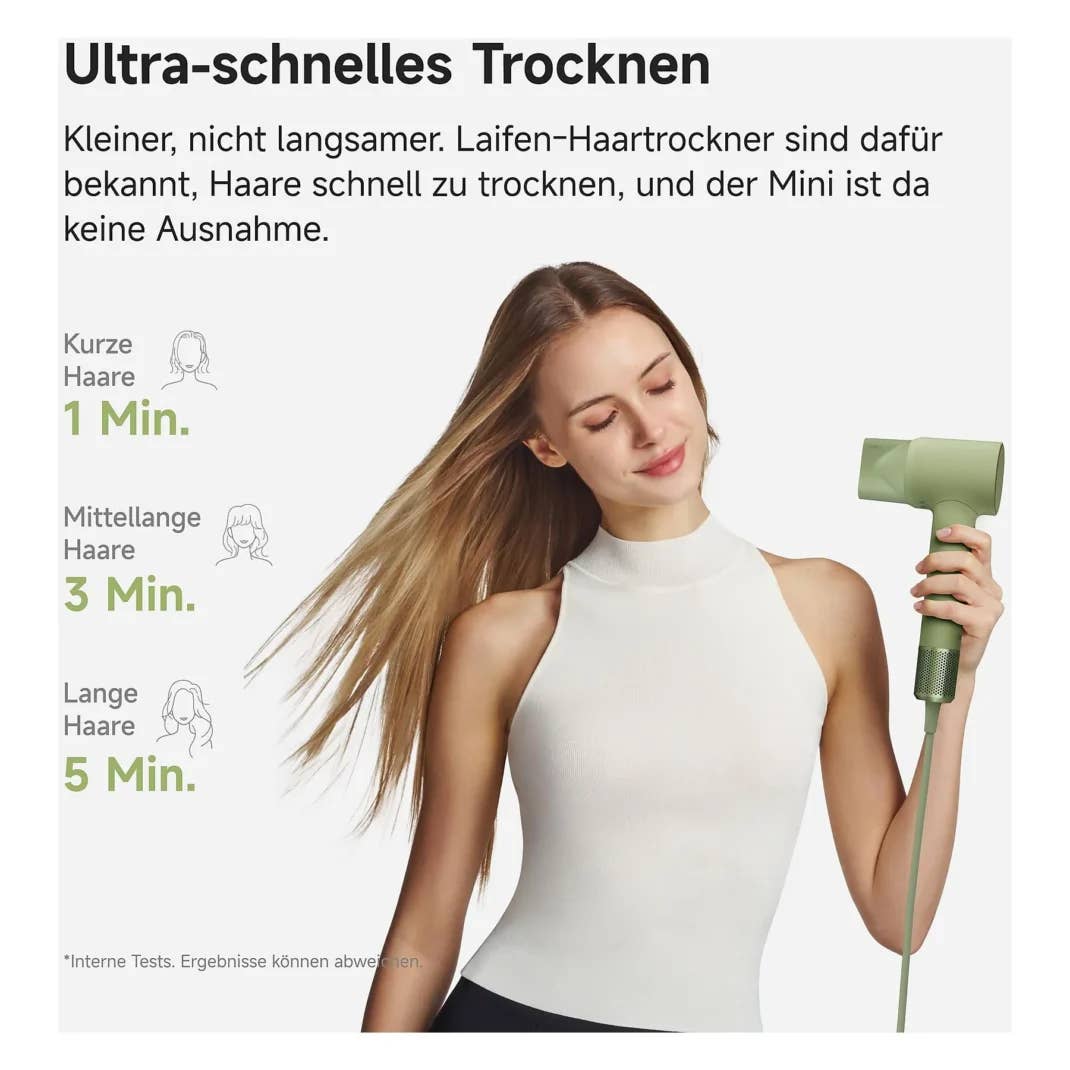

Kleiner Unterschied, große Wirkung: So viel leichter kann Föhnen gehen

Meistens sind es nur die kleinen Unterschiede, die im Alltag eine große Wirkung haben können. Etwa indem man die Zeit, die man fürs Föhnen und Stylen nach der Dusche benötigt, reduziert. Genau das versprechen moderne Ionen-Haartrockner wie der Laifen Mini. Anstatt die Haare nur mittels warmer Luft zu trocknen, setzen solche Geräte auf negative Ionen, welche die positiven Ionen in den Wassermolekülen der Haare neutralisieren. Einfach ausgedrückt sorgt das nicht nur dafür, dass die Haare schnell trocken werden, gleichzeitig wird dadurch auch statische Elektrizität eliminiert – und das reduziert Frizz und sorgt für wirklich glattes Haar.

Die Vorteile liegen somit auf der Hand: Die nervigste Aufgabe nach dem Duschen wird schneller erledigt, nerviges Frizz gehört zudem der Vergangenheit an und – je nachdem, wie lockig die Haare von Natur aus sind – spart man sich gegebenenfalls sogar das Glätten. Doch es gibt sogar noch einen weiteren, enormen Pluspunkt.

Auch auf Reisen immer dabei dank kompakter Größe

Ich kann hier wieder nur von meiner Frau berichten: Immer wenn wir in den Urlaub fahren, überlegt sie vorher, ob bzw. wie sie ihren Föhn mitnehmen kann. Denn auf die Geräte in den Hotels ist meist kein Verlass. Gleichzeitig ist ihr Föhn aber ziemlich groß und nimmt so viel Platz im Koffer ein. Auch hier hat Laifen mitgedacht und eliminiert so ein weiteres Problem.

Der Laifen Mini ist nämlich nur 31,1 x 13,9 x 12,6 cm groß und wiegt gerade einmal 299 g. Ihr könnt ihn also wirklich ohne Probleme in den Koffer packen und habt so unterwegs immer Euren hochwertigen Föhn dabei.

So viel kostet der Laifen Mini Föhn

Wenn Ihr – genauso wie ich – jetzt darüber nachdenkt, den Laifen Mini zu kaufen (sei es für Euch selbst oder für den Partner oder die Partnerin), fehlt natürlich noch die Info zum Preis. Der Hersteller bietet seinen kompakten Ionen-Föhn sowohl im eigenen Shop als auch bei Händlern wie Amazon zum UVP von 129,99 Euro an. Bei MediaMarkt kommt Ihr momentan allerdings schon für lediglich 79,99 Euro an das Gerät.

Mit diesem Symbol kennzeichnen wir Partner-Links. Wenn du so einen Link oder Button anklickst oder darüber einkaufst, erhalten wir eine kleine Vergütung vom jeweiligen Website-Betreiber. Auf den Preis eines Kaufs hat das keine Auswirkung. Du hilfst uns aber, nextpit weiterhin kostenlos anbieten zu können. Vielen Dank!

Dieser Artikel ist Teil einer Kooperation mit Laifen.

Der Partner nimmt keinen Einfluss auf den Inhalt des Artikels.

Apps & Mobile Entwicklung

Künstliche Intelligenz: Meta mietet für Milliarden US-Dollar Googles KI-Chips

Nachdem Meta für das Jahr 2026 Investitionen von 115 bis 135 Mrd. Dollar angekündigt hat, folgt nun die große Einkaufstour. 50 Mrd. USD gehen an Nvidia, 60 Mrd. an AMD – jeweils für gekaufte Hardware. Weitere Milliarden gehen an Google, in dem Fall aber als Miete.

Erst Nvidia, dann AMD, nun Google

In der letzten Woche wurde bekannt, dass Meta bei Nvidia für 50 Milliarden Dollar sowohl Blackwell als auch die zukünftigen Rubin-Beschleuniger für die eigenen KI-Rechenzentren kaufen wird. Schnell machte die Runde, dass sich Meta exklusiv an Nvidia binden könnte. Doch schon am Dienstag dieser Woche wurde dann ein 60-Milliarden-US-Dollar-Deal mit AMD bekannt. Teil dieses Deals ist es, dass Meta die Option hat, 10 Prozent der Firmenanteile von AMD zu erwerben; zuvor hatte AMD schon mit OpenAI eine solche Vereinbarung getroffen.

Bei Google wird gemietet

Ein neuer Bericht von Reuters offenbart einen weiteren Deal von Meta, dieses Mal mit Google. Meta kauft dabei keine Hardware, sondern mietet Rechenleistung. Reuters beruft sich dabei auf einen Artikel von The Information (Paywall), der sich wiederum auf Insider-Informationen stützt. Meta und Google haben gegenüber Reuters eine Stellungnahme abgelehnt.

Google will Nvidia Paroli bieten

Bereits im April 2025 stellte Google die neue TPUv7 Ironwood vor, die von der Rechenleistung in bestimmten Aspekte mit Nvidia mithalten können soll.

Googles Strategie für ihre eigenen KI-Ambitionen sehen vor, alle sechs Monate die Rechenleistung zu verdoppeln. Die gewaltigen Summen, die Meta, Google und Microsoft sowie andere Firmen in die Rechenleistung investieren, stoßen dabei auf zaghafte Skepsis der Anleger. Der Vertrag mit Meta kann Google dabei helfen, die Investitionen in ihre Rechenzentren vor Anlegern zu rechtfertigen, da so im Cloud-Sektor entsprechende Einnahmen generiert werden.

Wird Google auch Hardwareanbieter?

Neben dem Anmieten von Rechenleistung aus der Google-Cloud soll Meta auch ein Interesse am Kauf von Googles Hardware haben. Weder Reuters noch The Information konnten in diesem Fall den genauen Stand dieses Geschäftes ermitteln. Google soll mit einer nicht genannten Investmentfirma einen Vertrag unterzeichnet haben, um ein Joint Venture zu gründen. Das Joint-Venture soll Googles TPU an andere Firmen vermieten.

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 2 Wochen

Social Mediavor 2 WochenCommunity Management zwischen Reichweite und Verantwortung

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenHuawei Mate 80 Pro Max: Tandem-OLED mit 8.000 cd/m² für das Flaggschiff-Smartphone

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenSyncthing‑Fork unter fremder Kontrolle? Community schluckt das nicht

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Anthropic verschenkt MCP – mit fragwürdigen Hintertüren

-

Künstliche Intelligenzvor 1 Woche

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenGame Over: JetBrains beendet Fleet und startet mit KI‑Plattform neu

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights