Datenschutz & Sicherheit

Generative KI: Finger weg von Bildgeneratoren

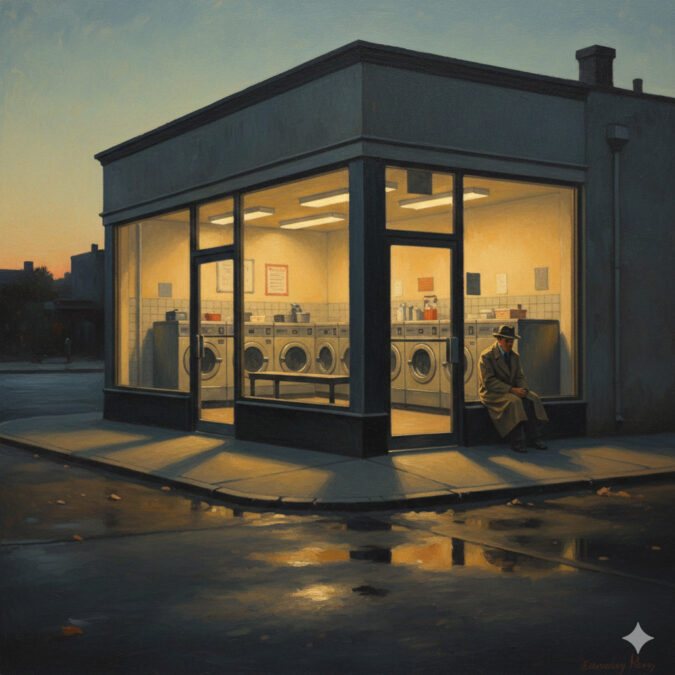

Eines der ersten Bilder, das ich mit „generativer KI“ erstellt habe, war ein Waschsalon im Stil von Edward Hopper. Das Motiv entspricht dem US-amerikanischen Maler sehr: ein halb-öffentlicher, halb privater Raum; die Stimmung irgendwo zwischen Kontemplation und Melancholie. Aber gemalt hat er es nie. Das KI-generierte Bild hatte das typische Hopper-Gefühl in mir geweckt, ich war begeistert. Bildgeneratoren sind der Anfang von etwas Großem, da war ich mir im Jahr 2022 sicher.

Schon früh war die öffentliche Debatte über Bildgeneratoren begleitet von teils inbrünstigen Einwänden, dass Erzeugnisse von Maschinen doch keine ernst zu nehmenden Gefühle oder Bedeutungen zum Ausdruck bringen könnten. Immerhin berechnet Software ihre Erzeugnisse bloß aus Material, das es bereits gibt; es fehlt also der Wille eines Menschen, etwas auf bestimmte Weise auszudrücken.

Mich überzeugt das nicht. Warum soll das Erzeugnis einer Maschine von Gefühl und Bedeutung entleert sein, das Erzeugnis eines Menschen aber gefühlvoll und bedeutsam? Diese KI-Kritik ist von klassischen Kommunikations-Modellen geprägt, die Sender und Empfänger in den Mittelpunkt rücken. Einfach ausgedrückt packt demnach ein Sender einen gewünschten Inhalt auf einen Kommunikationsträger, der die Botschaft zum Empfänger bringt – etwa per Wort oder Bild. Gerade Künstler*innen können diesem Modell zufolge ihre Kommunikation in Form eines Kunstwerks ganz besonders mit Bedeutung aufladen, weil sie dabei auf geniale Weise wie aus tiefer Seele schöpfen.

Diesem Modell zufolge kann ein KI-erzeugtes Bild schon allein deshalb nichts Sinnvolles ausdrücken, weil die Maschine nichts meinen kann. Das Erzeugnis ist allenfalls ein Klumpatsch von einst bedeutsamen Inhalten, also: KI-Slop.

Spätere Ansätze – von Systemtheorie über Poststrukturalismus – haben jedoch das Modell verworfen, wonach Bedeutung wie ein Päckchen von A nach B transportiert wird. Bedeutung lässt sich demnach auch nicht in einem Bild verpacken, sodass es nur noch beim Betrachten ausgepackt und in Empfang genommen werden muss. Vielmehr lässt sich jede Kommunikation und damit auch jedes Bild als eine Art Remix aus bestehenden Bedeutungsträgern beschreiben. Die konkrete Bedeutung eines Werks wiederum entsteht bei jeder Beobachtung aufs Neue und zwar durch die Betrachtenden. Das heißt, nicht nur jedes Werk ist ein Remix, sondern auch jede Beobachtung eines Werks.

Selbst das Wetter meint etwas – für uns

Insofern fehlt maschinell erzeugten Bildern zwar die menschliche Intention bis ins Detail, die etwa anzunehmen ist, wenn jemand nach jahrelanger Übung gezielt eine Leinwand mit Pinsel und Farbe bearbeitet hat. Gefühl und Bedeutung können KI-Bilder trotzdem haben, und zwar beim Betrachten. Das klappt auch ohne jegliche Intention eines Senders.

Das Prinzip kennen wir alle aus unserem Alltag, und zwar vom Wetter: Auch Sonnenuntergänge, Gewitter oder Wolkenformationen können ins uns eine Menge Gefühle auslösen, obwohl das Wetter nichts meinen kann. Es meint trotzdem etwas – für uns.

Die Grenze zwischen menschengemachten und synthetischen Werken ist weniger klar, als man auf den ersten Blick meinen könnte. Auch ohne Einsatz von Software haben Künstler*innen immer wieder gezielt die Kontrolle über ihre Werke reduziert. So spielen beim Action Painting Zufall und Physik eine wichtige Rolle, wenn Künstler*innen Farben schleudern und spritzen. Im Konstruktivismus wiederum geht es um Berechenbarkeit statt Zufall, wenn Künstler*innen streng auf geometrische Formen setzen.

Die Beispiele zeigen, generative KI ist weniger ein radikaler Bruch im kreativen Schaffen, sondern eher eine neue Verschiebung in der Rolle des Menschen beim Entstehen eines Werks. Statt mit Pinsel und Farbe hantiert man mit Prompts; feilt an Textbefehlen, bis die Maschine etwas erzeugt, das man gerne speichern und weiterverbreiten möchte. Der Stoff, aus dem ein Werk entsteht, ist nicht roh wie etwa eine Tube Ölfarbe, sondern vorgeformt durch das einfließende Trainingsmaterial.

Wie es sich praktisch anfühlt, mit Bildgeneratoren zu arbeiten, habe ich eine Zeit lang selbst getestet. Über Monate hinweg habe ich die Software genutzt, um eigene Artikel zu bebildern. Es war reizvoll, mehr Freiheiten in der Gestaltung der Motive zu haben. Inzwischen habe ich aber damit aufgehört – und ich halte es sogar für besser, wenn Redaktionen die Finger von Bildgeneratoren lassen. Dafür sehe ich vor allem drei Gründe.

1. Der typische KI-Look wirkt unseriös

Nach ein paar Jahren KI-Hype und einer Flut KI-generierter Bilder auf Websites und in sozialen Medien zeigt sich eine Kluft zwischen Theorie und Praxis: Während KI-Bilder meiner Meinung nach bedeutsam, gefühlvoll und schön sein können, sind sie es erstaunlich oft – einfach nicht.

So unbegrenzt wie Anfangs vermutet sind die kreativen Möglichkeiten dann doch nicht. Zumindest Stand aktuell, und mit dem eher geringen Aufwand, den viele in ihre Prompts und KI-Erzeugnisse stecken. An einem Großteil der tatsächlich in meinen Feeds kursierenden, KI-generierten Bilder habe ich mich sattgesehen. Sie sind oft überladen und austauschbar, teils offensiv geschmacklos. Einflüsse von Stilrichtungen lassen sich erahnen, sind aber oft grobschlächtig miteinander vermengt, ohne Gefühl für Stimmigkeit. Ein schauriges Beispiel dafür ist das oben eingebettete KI-Bild, das ich leider selbst als Artikelbild veröffentlicht habe, und heute für einen Griff ins Klo halte.

Websites, die auf KI-Bilder setzen, erscheinen mir inzwischen suspekt. Denn in der Praxis nutzen die meisten seriösen Medien solche Bilder nicht oder kaum; fragwürdige Content-Schleudern aber schon.

Egal, wie man sonst zu KI-Bildern steht: Sie können mangelnde Seriosität ausstrahlen. Besonders wenn Leser*innen eine Website nicht gut kennen und nur die Bilder ins Auge springen. Es könnte bei manchen die Frage aufkommen, ob die Redaktion möglicherweise auch ihre Texte achtlos zusammenrührt; wie sorgfältig das redaktionelle Angebot wirklich ist. Die Bebilderung von Artikeln sollte funktional sein und nicht mehr Fragen aufwerfen als die Hauptinhalte.

2. Generative KI schafft bedenkliche Abhängigkeiten

Generative KI gibt Menschen mit Internetverbindung zuvor ungeahnte Produktionsmittel in die Hand. Selbst ohne Vorkenntnisse lassen sich etwa Texte, Übersetzungen, Code, Bilder und Videos in mindestens mittelmäßiger Qualität erstellen. Und wer würde so viele verschiedene Dinge schon mindestens mittelmäßig hinbekommen? Das bedeutet mehr Möglichkeiten und mehr Macht für alle. Aber das ist nur die eine Seite der Medaille.

Die andere Seite ist düster. Je mehr sich generative KI verbreitet, desto mehr zementieren deren Anbieter ihre Machtposition. Als der Bild-Generator Stable Diffusion erstmals gratis für alle veröffentlicht wurde, hatte ich die Hoffnung auf eine dezentrale Zukunft generativer KI ohne mächtige Tech-Unternehmen als Nadelöhr. Es kam anders.

Heute kontrollieren einige wenige Unternehmen wie OpenAI, Anthropic, Microsoft, Meta und Google die populären und effizienten KI-Anwendungen. Sie sammeln die Risiko-Milliarden ein, steigen zu den reichsten Unternehmen der Welt auf oder festigen diese Position. Unter der Regie der KI-Konzerne entsteht eine technologische Infrastruktur, die Produktionsweisen zentralisiert. Die Konzerne bestimmen in der Folge, welche KI-Anwendungen kostenlos sind und wofür man zahlen muss. Sie bestimmen, für welche Sprachen, welche gesellschaftlichen Gruppen, welche Einsatzmöglichkeiten ihre Dienste optimiert werden.

Auf rabiate Weise extrahieren KI-Konzerne massenhaft Werke zum Training ihrer Modelle aus dem Netz, selbst wenn die Künstler*innen und Urheber*innen dahinter das nicht möchten. Einerseits finde ich: Zur Freiheit von Kunst sollte es gehören, dass sich Menschen oder auch Maschinen frei an Werken bedienen können, um Neues zu schaffen. Andererseits bereitet mir das extreme Macht-Ungleichgewicht Bauchschmerzen, das besteht, wenn Milliarden-Konzerne diese Freiheit brachial für kommerzielle Interessen ausnutzen.

In der Folge profitieren nicht alle gleichermaßen von den Produktionsmöglichkeiten sogenannter KI. Die neue Technologie kann nicht nur Gewinner*innen hervorbringen, sondern auch Verlierer*innen. Sie birgt etwa das Potenzial, KI-freie Formen künstlerischer oder handwerklicher Bildproduktion allein durch diese Produktionsgewalt zu verdrängen, zu ersetzen und damit unter die Kontrolle weniger Konzerne zu bringen.

Diese Kontrolle bezieht sich nicht nur auf die Gestaltung der KI-Werkzeuge, sondern auch auf die erzeugten Inhalte. Die KI-Konzerne entscheiden und moderieren, was erlaubt und verboten ist. Bei Sprachmodellen wie Grok aus den USA oder DeepSeek aus China sieht man, wie schnell vermeintliche Inhaltsmoderation in autoritäre Zensur und Desinformation umschlägt.

Bei den meisten kommerziellen Bildgeneratoren gibt es zudem sehr hohe Hürden für jegliche Darstellung von Nacktheit. Damit wollen die Konzerne unter anderem verhindern, dass Menschen illegale Inhalte erzeugen, und nehmen dabei Overblocking in Kauf. Die Folge ist, dass selbst jugendfreie Darstellungen zensiert werden, etwa wissenschaftliche oder künstlerische Motive. Zum Vergleich: Sogar in der Sixtinischen Kapelle im Vatikan sind Adam und Eva ohne Kleider zu sehen.

Keine Skrupel haben die KI-Konzerne dagegen offenbar bei Deals über hunderte Millionen US-Dollar mit dem Militär der rechtsradikalen Trump-Regierung.

Die erhoffte Demokratisierung von Produktionsmitteln durch generative KI hat also auch gegenteilige Effekte. Solange Bildgeneratoren von wenigen Konzernen kontrolliert werden, entstehen neue Formen von Abhängigkeit, und zwar von konkreten KI-Modellen und deren Features, von Plattform-Policys, Finanzierungsmodellen und letztlich auch den Launen und Ideologien ihrer superreichen Eigentümer.

Entsprechend unangenehm ist es, etwa einen journalistischen Artikel oder einen Blogbeitrag mit einem Generator von Google oder OpenAI zu bebildern. Der Name dieser Konzerne in der Bildunterschrift: ein unerwünschter Werbe-Effekt.

Wir sind ein spendenfinanziertes Medium

Unterstütze auch Du unsere Arbeit mit einer Spende.

Auch wenn meine kleinen Beiträge als Nutzer oder Konsument von KI-Bildgeneratoren das Machtgefüge dahinter nicht nennenswert beeinflussen – es muss einfach nicht sein. Gerade wenn Redaktionen ihre Artikel in großem Stil mit KI bebildern, verstetigen sie den Gebrauch fragwürdiger Produkte.

3. Hinter generativer KI stecken hohe, unsichtbare Kosten

Oft sind die wahren Kosten meines privilegierten, digitalen Alltags unsichtbar, und bei den meisten Leser*innen hier dürfte es ähnlich sein. Wir tippen, streamen und surfen mit energiehungrigen Produkten aus unter anderem Plastik und Seltenerdmetallen, die durch geplante Obsoleszenz zugleich der umweltschädliche Elektroschrott von morgen sind; produziert und bis zur Haustür gebracht von oftmals schlecht behandelten Angestellten; entworfen und kontrolliert von Megakonzernen, die damit Milliarden anhäufen. Obendrauf kommen jetzt noch die Kosten für generative KI.

Es ist widersprüchlich, an einem Apple-Laptop sitzend von der Nutzung einer Technologie abzuraten, weil sie verborgene Kosten für Gesellschaft und Umwelt mit sich bringt. Denn was ich an generativer KI kritisiere, trifft auch auf meine eigenen Geräte zu. Um davon nicht völlig blockiert zu sein, will ich zwei Ebenen voneinander unterscheiden: Einerseits strukturelle Ausbeutungsverhältnisse, andererseits individuelle Konsumentscheidungen. Ersteres lässt sich nicht durch letzteres überwinden. Dennoch sind individuelle Konsumentscheidungen nicht egal. Bildgeneratoren sind noch nicht so tief in unseren Alltag gesickert wie Laptops; sie sind noch kein wichtiger Teil digitaler, gesellschaftlicher Teilhabe. Noch haben wir die Wahl.

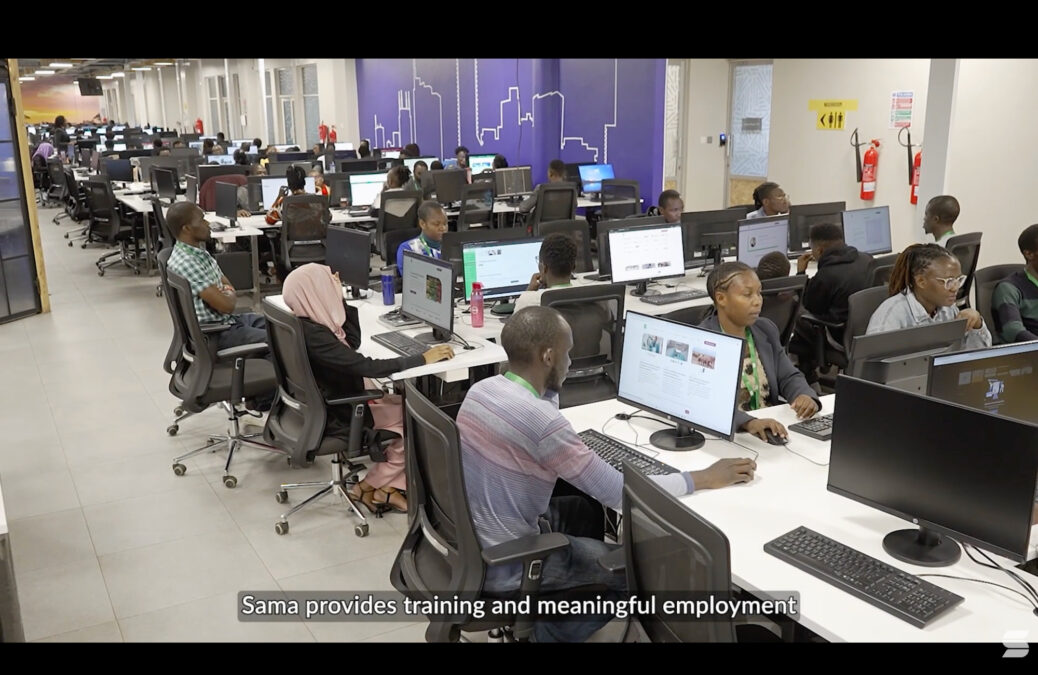

Die Systeme hinter KI-generierten Bildern fressen Energie durch Training und Betrieb und sind deshalb klimaschädlich. Die Konzerne hinter kommerziellen Bildgeneratoren ziehen riesige Rechenzentren hoch, zapfen Atomkraftwerke an und können Menschen im Umland zur Kühlung der Server sogar das Wasser abgraben. Millionen gering bezahlte Arbeiter*innen, oftmals aus dem Globalen Süden, machen durch ihre Arbeit die Leistungen der Software überhaupt erst möglich.

Die menschliche Arbeit hinter sogenannter KI soll nicht nur bewirken, dass generierte Bilder möglichst gut aussehen, sondern auch, dass sie möglichst nicht illegal oder verstörend sind. Gewalt, Folter, Missbrauch – all das sollen Nutzer*innen am Ende nicht zu Gesicht bekommen. Dafür sichten und annotieren Angestellte im Akkord Inhalte, etwa Bilder aus dem Trainingsmaterial oder neue KI-Erzeugnisse. Solche Arbeit ist oftmals psychisch belastend, die therapeutische Begleitung schlecht. Für ihren Lohn zahlen Datenarbeiter*innen also nicht nur mit ihrer Arbeitskraft, sondern auch mit ihrer Gesundheit.

Diese und weitere Kosten verschwinden hinter den glatt designten Oberflächen der Bildgeneratoren, die per Mausklick Inhalte en masse ausspucken, als wären nur Maschinen am Werk. Ich finde: Gerade weil es leicht zugängliche KI-freie Alternativen zur Bebilderung gibt, muss man das als redaktionelles Angebot nicht aktiv unterstützen.

Ambivalenzen aushalten

Mehr als drei Jahre, nachdem ich mit Stable Diffusion einen Waschsalon im Stil von Edward Hopper erzeugt habe, wiederhole ich den Versuch. Dieses Mal mit Google Gemini Ende 2025: „Wie hätte Edward Hopper einen Waschsalon gemalt?“

Ich hoffe darauf, dass mich das Ergebnis kaltlässt, schließlich habe ich mich in diesem Text daran gemacht, Bild-Generatoren zu kritisieren und von ihrem Einsatz abzuraten. Bloß, das Gegenteil ist der Fall: Die Software erzeugt ein Bild, das mir sofort gefällt. Hätte ich es früher in einem Hopper-Sammelband gesehen, es hätte zu meinen Lieblingsmotiven gezählt. Zugleich merke ich, was für ein Luxus daraus spricht, dieses Bild generieren und genießen zu können.

KI genießen, KI ablehnen – wie lässt sich diese Ambivalenz aushalten?

Der Knackpunkt liegt für mich darin, in welcher Rolle ich mit KI-generierten Bildern umgehe. Im Fall vom Hopper-Bild entscheide ich mich als Privatperson dafür, ein problematisches Produkt wie einen Bildgenerator für eine ästhetische Erfahrung zu nutzen: Das ist reiner Luxus. Ob und wie oft man das tun möchte, darüber muss wohl jede*r für sich selbst entscheiden.

Anders ist die Lage, wenn ich in meiner Rolle als Redakteur KI-Bilder in die redaktionelle Routine integriere. Dann wären sie kein privater Luxus mehr, sondern beruflich genutzte Gebrauchsgrafiken für ein breites Publikum. Sie würden den Einsatz einer Technologie normalisieren, die ich sehr kritisch sehe. Mein Fazit: Finger weg.

Zumindest zu dokumentarischen Zwecken kommt der falsche Hopper als eingebettete Grafik in diesen Text. Typisch für Hopper sehen wir hier einen isolierten Menschen in einer urbanen Umgebung. Er scheint in sich gekehrt, als würde er dem Gefühl einer inneren Leere nachhängen. Wahrscheinlich interessiert mich dieses KI-Bild deshalb umso mehr: Weil sich auch KI-Bilder die Frage nach innerer Leere gefallen lassen müssen. Und schon sind sie nicht mehr leer.

Datenschutz & Sicherheit

GrapheneOS: Microsoft Authenticator unterstützt sicheres Android-OS nicht

In der vergangenen Woche hat Microsoft angekündigt, dass der Microsoft Authenticator Entra-ID-Zugänge am Ende von Mobilgeräten löschen wird, die er als gerootet oder gejailbreakt erkennt. GrapheneOS wurde für sicherheits- und datenschutzbewusste Menschen konzipiert – Microsoft will es jedoch offiziell nicht unterstützen. Die Nutzung des Microsoft Authenticators mit Entra-ID-Konten steht dort auf wackeligen Füßen. Das teilte das Unternehmen auf Anfrage von heise security mit.

Weiterlesen nach der Anzeige

GrapheneOS genießt einen ausgezeichneten Ruf bezüglich Datenschutz und Sicherheit. Es lässt sich auf Google-Pixel-Smartphones besonders datensparsam nutzen, kann aber auch Google-Dienste einsetzen und legt ihnen jedoch die Leine an: sie starten wie alle anderen Apps in einer Sandbox mit Rechteverwaltung. Durch die weitreichende Kompatibilität etwa mit Banking-Software und Streamingdiensten, die auf vielen Custom-ROMs nicht starten, hat GrapheneOS sich zu einem der beliebtesten Custom-ROMs entwickelt. Die Entwickler sind schnell mit dem Schließen von Sicherheitslücken, gelegentlich fließt sogar Code von GrapheneOS zurück ins Android-Projekt.

Auf dem Mobile World Congress (MWC) in Barcelona verkündete zudem Motorola am Montag dieser Woche, offiziell GrapheneOS zu unterstützen. Damit ist das sichere Betriebssystem nicht mehr exklusiv auf Pixel-Smartphones zu Hause. Motorola will damit nicht weniger als „mithilfe von GrapheneOS die Smartphone-Sicherheit neu definieren“. GrapheneOS bringt demnach einen „verstärkten Sicherheitskern“ und „Schutz vor komplexen Bedrohungen“ mit. Motorola will „spezielle hochsichere Geräte“ anbieten, die etwa in Unternehmen, Behörden und so weiter eingesetzt werden können.

Sichereres Custom-ROM reicht nicht

Für die sichere Nutzung von Unternehmens-E-Mails und zum sicheren Datenaustausch über Smartphones wirkt GrapheneOS damit prädestiniert. Da inzwischen viele ihre Dienste mit Microsofts Identitätsverwaltungsangebot Entra-ID zur Anmeldung ausstatten, ist der Microsoft Authenticator für die Nutzung in Unternehmen wichtig. Er dient als zweiter Faktor zur Anmeldung. Die Entra-ID-Konten müssen sich mit der Smartphone-App daher nutzen lassen, oder Nutzer und Nutzerinnen werden ausgesperrt.

Gegenüber heise security sagte ein Microsoft-Sprecher auf Anfrage: „Microsoft Authenticator wird auf GrapheneOS nicht offiziell unterstützt, und Entra-Konten können in Zukunft auf Geräten mit GrapheneOS beeinträchtigt sein, die als gerootet erkannt werden.“

Unklar ist, ob GrapheneOS-Geräte generell vom Microsoft Authenticator als gerootet erkannt werden. Es bleibt zu hoffen, dass Microsoft da gegebenenfalls doch noch seine Position ändert und das sicherere Android-OS auch offiziell unterstützt. Etwas komplizierter und ohne Microsofts Sicherheitserweiterungen im Authenticator lassen sich alternativ jedoch auch andere Authenticator-Apps mit Microsoft-Konten verknüpfen. Dahinter steckt jedoch auch die Frage, ob etwa die IT-Abteilung die Nutzung davon freigibt.

Weiterlesen nach der Anzeige

(dmk)

Datenschutz & Sicherheit

„Wir wollen gemeinsam darüber diskutieren, welche digitale Zukunft wir anstreben“

Heute startet in Bochum die zweitägige Konferenz Bits & Bäume NRW 26. Anne Mollen von der Universität Münster gehört zum Team der Organisator:innen. Gegenüber netzpolitik.org erläutert sie, was die Akteur*innen aus Wissenschaft, Zivilgesellschaft und Verwaltung von der Landespolitik fordern, warum es wichtig ist, Digitalisierung von Anfang an nachhaltig zu gestalten, und wie das die Abhängigkeit von Tech-Konzernen verringert.

netzpolitik.org: Anne Mollen, warum findet die Konferenz in NRW statt?

Anne Mollen: Es gab schon zwei Konferenzen in den Jahren 2018 und 2022, allerdings auf Bundesebene. Bereits damals ging es darum, die Themen Nachhaltigkeit und Digitalisierung zusammenzubringen. Aber die Bits-&-Bäume-Bewegung besteht aus vielen lokalen Zweigen, einer davon ist der nordrhein-westfälische. Uns vor Ort war schnell klar: Wir müssen auch die Landespolitik adressieren. Denn sie nutzt ihre politischen Handlungsspielräume nur unzureichend oder gar nicht.

Beim Bau von Rechenzentren Probleme gemeinsam betrachten

netzpolitik.org: In NRW baut Microsoft gerade Hyperscaler-Rechenzentren im Rheinischen Revier. Das Braunkohlegebiet soll zukünftig als Vorzeigeregion für strukturellen Wandel gelten. Was ist daran falsch?

Anne Mollen: So einiges. Der Bund für Umwelt und Naturschutz NRW hat etwa die Flächenversiegelung kritisiert, weil für die Rechenzentren nicht bereits brachliegende Flächen genutzt werden, sondern landwirtschaftliche Nutzflächen wegfallen.

Und natürlich geht es auch um den Energieverbrauch. Denn Microsoft hat wichtige Informationen nicht öffentlich gemacht. Zum Beispiel, wie sie den Bedarf an erneuerbaren Energien decken wollen. Solche fehlenden Informationen sind ein wiederkehrendes Muster. An anderen Orten sehen wir, dass Unternehmen dann klimaschädliches Gas zur Energiegewinnung einsetzen, wenn nicht ausreichend Grundlaststrom vorhanden ist.

Diese Intransparenz ist ein Problem. Wir wissen aus der Forschung, wie sich Rechenzentren etwa in Irland Zusagen für erneuerbare Energien holen, um sich klimaneutral zu präsentieren. Im Anschluss kommt es dann aber zu Verteilungskonflikten, weil Privathaushalte das Nachsehen haben. Deswegen fordern wir einen ganzheitlichen, nachhaltigen Strukturwandel, der lokale Akteur*innen stärkt.

netzpolitik.org: Aber profitieren strukturschwache Regionen nicht wenigstens von neuen Arbeitsplätzen?

Anne Mollen: Microsoft hat versprochen, 450 Arbeitsplätze in der Region zu schaffen. Ich habe aber nicht herausgefunden, wie sie auf diese Zahl kommen.

Angaben aus den USA zeigen, dass pro Terawattstunde, die ein Rechenzentrum an Energie aufnimmt, in der Regel sehr wenige langfristige Vollzeitarbeitsplätze geschaffen werden. Kurzfristig entstehen natürlich Jobs, um die Rechenzentren hochzuziehen. Aber bei dem Bedarf, den wir im Rheinischen Revier mit dem Wegfall des Kohleabbaus haben, ist das ein Tropfen auf den heißen Stein.

Diese Transformationserzählung, dass Rechenzentren den Strukturwandel bringen und die auch die Landespolitik weiterträgt, ist hochproblematisch. Denn wenn man genauer hinschaut, wohin die Milliardeninvestitionen fließen, wird dieses Versprechen nicht eingelöst.

Microsoft hat Investitionen in Höhe von 3,2 Milliarden Euro zugesagt, die ins Rheinische Revier fließen sollen. Ein Großteil des Geldes wird aber für die Hardware der Rechenzentren aufgewendet. Die wird jedoch nicht in NRW hergestellt, im Zweifel nicht einmal in Deutschland.

Unabhängige Gutachten müssen Transparenz schaffen

netzpolitik.org: Was wäre denn die Alternative?

Anne Mollen: Damit Prozesse transparenter sind, müssten den Unternehmen klare Auflagen gemacht werden. Es braucht verpflichtende unabhängige Gutachten zu den ökologischen Auswirkungen. Und die Unternehmen müssten nachweisen, wie sie Umweltschäden eindämmen wollen.

Außerdem sollten kommunale Akteur*innen massiv gestärkt und sensibilisiert werden, wenn es um Verhandlungen mit großen Playern wie Microsoft geht. Damit sie einschätzen können, was es bedeutet, wenn ein Konzern bei ihnen vor Ort ein Rechenzentrum aufmacht.

netzpolitik.org: Aber reicht der Blick aufs Lokale?

Anne Mollen: Nein, die globale Perspektive entlang der Lieferketten ist natürlich ebenso wichtig. Werden Server so hergestellt und später entsorgt, dass ihre Einzelteile in einen Kreislauf überführt werden? Auch dafür sind verpflichtende Umweltgutachten wichtig.

Mit unseren politischen Forderungen gehen wir in die Breite. Und die Rechenzentren sind nur ein Aspekt von vielen. Ebenso setzen wir uns für partizipative Beteiligungsprozesse ein. In Chile können wir zum Beispiel sehen, wie lokale Proteste Wirkung zeigen. Dort hat die Ansiedlung von Microsoft-Rechenzentren die Wasserkrise massiv verschärft. Das Unternehmen ist daraufhin auf eine weniger wasserintensive Technologie umgestiegen. Und auch in Hessen hat lokaler Widerstand dazu geführt, dass ein Hyperscale-Rechenzentrum nicht gebaut wurde.

Deshalb fordern wir, dass die Zivilgesellschaft von vornherein eingebunden ist. Da stehen dann auch die kommunale Politik und die Landespolitik in der Verantwortung. Statt solchen Bodenwert leichtfertig an große Unternehmen abzugeben, könnten sie mehr Geld in digitale Souveränität investieren.

Selbstbestimmung statt digitale Abhängigkeiten fördern

netzpolitik.org: Digitale Souveränität ist ein gutes Stichwort. Was kann NRW hier aus eurer Sicht ausrichten?

Anne Mollen: Es ist wichtig, über alternative Formen der digitalen Infrastruktur zu sprechen. Und gerade Hochschulen verfügen über unabhängige digitale Infrastrukturen, die kommunale Rechenzentrumsbetreiber oder die Hochschulen selbst betreiben. Das Prinzip der digitalen Souveränität wird auf Grundlage von Open-Source-Anwendungen hier bereits seit rund 15 Jahren umgesetzt.

Wir sind communityfinanziert

Unterstütze auch Du unsere Arbeit mit einer Spende.

Aber auch bei generativer KI ist das Land NRW vorne dabei. Verschiedene Universitäten, auch bundesweit, hosten beispielsweise ein lokales großes Sprachmodell. Und es gibt das Projekt Open Source-KI.nrw. Das ist ein Servicezentrum, das KI-Infrastrukturen für Hochschulen und Forschungseinrichtungen anbietet.

Aber solche Angebote kosten Geld. Deswegen muss das Land NRW in Hochleistungsrechenzentren investieren, die diese KI-Dienste durch entsprechende Dauerstellen stützen.

Bisher gibt es landesweit noch Projekte, die zweigleisig unterwegs sind. Einige haben Schnittstellen zu kommerziellen Anbietenden. Langfristig sollten sich aber alle Akteur*innen zu souveränen Lösungen verpflichten, damit wir uns nicht in die nächste digitale Abhängigkeit begeben.

Denn die Abhängigkeit kostet auch. Gerade sind Lizenzkosten für kommerzielle KI-Modelle zwar noch massiv subventioniert. Forschende warnen aber davor, dass Lizenzkosten langfristig vermutlich deutlich höher ausfallen, als Investitionen in digitale Souveränität kosten würden.

Bürger*innen beteiligen, Forschung anhören, mit der Politik verbinden

netzpolitik.org: Lassen sich eure Forderungen auf andere Bundesländer übertragen?

Anne Mollen: Zunächst halten wir es für wichtig, auf Landesebene das Politikfeld nachhaltige Digitalisierung zu schaffen. Bisher ging es dort vor allem um die Frage, wie wir mit dem Einsatz digitaler Technologien Nachhaltigkeit erreichen können. Wir wollen aber die Perspektive etablieren, dass wir Digitalisierung gemeinsam und nachhaltig gestalten sollten.

Dabei darf die Landespolitik nicht allein in der Verantwortung sein, aber sie sollte neuen Ideen auch nicht im Wege stehen.

Wir wollen gemeinsam mit Menschen aus der Forschung und aus der Zivilgesellschaft darüber diskutieren, welche digitale Zukunft wir anstreben. Denn wir alle sollten die Möglichkeit haben, unsere digitale Zukunft zu gestalten, sei es an der Hochschule, in der Verwaltung oder auch im Verein.

Eine solche Zukunftsvorstellung, auf die wir hinarbeiten, können wir auch anderen Bundesländern anbieten. Unsere Hoffnung ist, dass unsere Forderungen eine Eigendynamik entwickeln und die Länder dann durch gute Beispiele voneinander lernen.

Datenschutz & Sicherheit

Cisco Secure Firewall Management Center über kritische Root-Lücken angreifbar

Angreifer können die volle Kontrolle über Cisco Secure Firewall Management Center (FMC) erlangen. Diese und weitere Sicherheitsprobleme in Secure Firewall Adaptive Security Appliance (ASA) und weiteren Produkten haben die Entwickler mit nun veröffentlichten Sicherheitspatches gelöst. Bislang gibt es keine Hinweise, dass Angreifer bereits Netzwerke attackieren.

Weiterlesen nach der Anzeige

Root-Schwachstellen

FMC ist gleich über zwei „kritische“ Sicherheitslücken mit Höchstwertung (CVE-2026-20079, CVE-2026-20131 jeweils CVSS Score 10 von 10) angreifbar. Im ersten Fall können entfernte Angreifer ohne Authentifizierung mit präparierten HTTP-Anfragen an der Schwachstelle ansetzen. Klappt das, können sie Skripte mit Root-Rechten ausführen.

Im zweiten Fall sind Attacken ebenfalls aus der Ferne und ohne Authentifizierung möglich. Hier können Angreifer Schadcode mit Root-Rechten ausführen. In beiden Fällen ist davon auszugehen, dass Instanzen im Anschluss als vollständig kompromittiert gelten. Um die jeweils passenden Sicherheitsupdates zu finden, müssen Admins in den unter den CVE-Nummern verlinkten Warnmeldungen in einem Auswahlmenü unter anderem ihre Firewall-Modelle angeben.

Weitere Gefahren

Über sieben weitere mit dem Bedrohungsgrad „hoch“ eingestufte Lücken in ASA und FMC können Angreifer DoS-Attacken auslösen oder auf eigentlich abgeschottete Daten zugreifen. Zusätzlich haben die Entwickler noch mehrere mit „mittel“ eingestufte Sicherheitslücken geschlossen. An diesen Stellen sind neben DoS- auch XSS-Attacken möglich.

In Webex wurde ebenfalls eine XSS-Lücke (CVE-2026-20149 „mittel“) geschlossen. Weitere Informationen zu den Schwachstellen und Sicherheitspatches listet Cisco im Sicherheitsbereich seiner Website auf.

Weiterlesen nach der Anzeige

(des)

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 3 Wochen

Social Mediavor 3 WochenCommunity Management zwischen Reichweite und Verantwortung

-

Social Mediavor 3 Tagen

Social Mediavor 3 TagenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Künstliche Intelligenzvor 2 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenSyncthing‑Fork unter fremder Kontrolle? Community schluckt das nicht

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Anthropic verschenkt MCP – mit fragwürdigen Hintertüren

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenGame Over: JetBrains beendet Fleet und startet mit KI‑Plattform neu

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights