Online Marketing & SEO

Influencer-Zensur? Wie ein chinesisches Gesetz Deutschland verändern würde

China geht einen radikalen Schritt: Influencer dürfen nur noch über Medizin, Recht, Finanzen oder Bildung sprechen, wenn sie entsprechende Abschlüsse oder Zertifikate vorweisen. Welche Folgen hätte ein solches Gesetz für Deutschland?

In den sozialen Medien war es noch nie so einfach, medizinisches Wissen, Finanzstrategien oder rechtliche Einschätzungen mit anderen zu teilen. Für viele gilt es als normal, intime und komplexe Fragen öffentlich auszudiskutieren. Das Problem: Laut einem Bericht des RKI und BIÖG besitzen rund 82 Prozent der Deutschen nicht genügend Gesundheitskompetenz, um medizinische Inhalte sicher richtig einzuordnen. Und dieser Kompetenzmangel betrifft längst nicht nur Gesundheitsthemen, sondern auch die Fähigkeit, digitale Informationen kritisch zu bewerten und einzuordnen.

Während Deutschland weiterhin auf Eigenverantwortung und Selbsteinschätzung setzt, ist China am 25. Oktober 2025 einen drastischen Schritt gegangen: Ein neues Gesetz erlaubt es Influencern nur noch dann, über sensible Themen wie Medizin, Recht, Finanzen oder Bildung zu sprechen, wenn sie die dafür nötigen Abschlüsse, Zertifikate oder Lizenzen vorweisen können. Ein radikaler Eingriff, und gleichzeitig ein klares Zeichen, wie ernst die Bedrohung durch Fehlinformationen zu sein scheint. Die Meinung der Deutschen ist klar: Das ist Zensur. Aber muss Einschränkung zwingend Zensur bedeuten?

Das Social-Media-System: Wie Anreize für falsche Inhalte entstehen

Influencer haben heute die Macht, die in der Vergangenheit den klassischen Medien vorbehalten war. Auch immer mehr Unternehmen erkennen das Potenzial: Die Ausgaben für Influencer Marketing weltweit sind laut einer Studie des Influencer Marketing Hub seit 2021 von 13,8 Milliarden US-Dollar auf mehr als das doppelte angewachsen. Aussagen von Creatorn wirken schneller und emotionaler. Sie kommen ohne Redaktion, ohne Faktencheck und ohne Einordnung aus.

Wer Einfluss hat, trägt Verantwortung für die Folgen der eigenen Taten oder in diesem Fall der eigenen Inhalte. Und genau hier wird es schwierig. Die Plattformlogik belohnt Engagement, nicht zwingend die Wahrheit. Skandale, Streitigkeiten, Zuspitzungen und vermeintliche Geheimtipps generieren Klicks, Aufmerksamkeit und somit Reichweite. So entstehen monetäre Anreize, selbst dann, wenn sie falsch, unvollständig, manipulativ oder gefährlich sind. Dabei spielt Meinungsfreiheit eine entscheidende Rolle, entbindet aber nicht von Verantwortung.

Wo Meinung auf Beratung trifft und Grenzen verschwimmen könnten

Ein deutsches Äquivalent zum chinesischen Modell würde das Internet und insbesondere die Social-Media-Kultur drastisch verändern. Medizinischer Rat von Fitness- oder Ernährungs-Influencern? Verschwunden. Finanztricks von selbsternannten Börsengurus? Nur noch mit Nachweis. Pädagogische Tipps von Lifestyle Creatorn ohne Ausbildung? Unauffindbar.

Was im ersten Moment unvorstellbar klingt, hätte auch entscheidende Vorteile. Wenn Fachwissen von nun an belegt werden müsste, bekämen nur noch qualitativ hochwertige Beiträge eine hohe Reichweite. Das würde bedeuten, dass insbesondere junge Nutzer:innen besser vor gefährlichen Fehlinformationen und problematischen Empfehlungen geschützt wären. Gerade weil Influencer eine Community haben, die ihnen vertraut, werden Aussagen häufig kaum hinterfragt. Zusätzlich würde Expertise-getriebene Werbung auch den Markt für manipulative Beiträge oder problematische Produkte eindämmen – insbesondere im Gesundheits- oder Finanzbereich.

Grundsätzlich ist es positiv zu bewerten, dass auf Social Media offen über solche Themen gesprochen wird. Das war nicht immer der Fall. Heute profitieren viele Jugendliche davon, früh ein ausgeprägtes Gesundheitsbewusstsein zu entwickeln oder ein besseres Verständnis für Bereiche wie Investments zu erhalten – die Möglichkeiten zur Weiterbildung sind deutlich vielfältiger geworden. Früher galten viele dieser Themen als Tabu, beispielsweise auch Fragen zu Gehältern in bestimmten Branchen. Durch den offenen Austausch in sozialen Netzwerken wird inzwischen insgesamt wesentlich transparenter kommuniziert.

Lohntransparenz 2026:

EU macht Schluss mit undurchsichtigen Gehältern

Jede Regulierung hat dennoch ihren Preis. Eine stärkere Kontrolle von Inhalten erhöht zwar die Sicherheit, greift aber auch spürbar in die Meinungsfreiheit ein, die gerade in Deutschland einen besonders hohen Stellenwert hat. Gleichzeitig könnte sie die Vielfalt und kreativen Stimmen reduzieren, die gerade die Social-Media-Kultur seit jeher auszeichnen. Auch der Einstieg in die Branche würde schwieriger. Wer sich erst mühsam Expertise in komplexen Themenfeldern erarbeiten muss, steht vor zusätzlichen Hürden.

Der wohl entscheidendste Punkt bleibt jedoch die rechtliche Grauzone: Wo endet Entertainment, wo beginnt Beratung? Was gilt als persönliche Erfahrung, was bereits als fachliche Empfehlung? Gleichzeitig stellt sich eine grundsätzliche Frage, die die Debatte zusätzlich kompliziert macht: Wer entscheidet, welche Themen welche Art Qualifikation bedürfen? Und wo genau verläuft die Grenze? Ist die Bewerbung eines Energydrinks durch einen Gaming Influencer oder einer Finanz-App durch einen Lifestyle Creator bereits ein Tipp, der geprüft und verifiziert werden muss? Diese Fragen zeigen, wie schwierig die Setzung klarer Grenzen in der Praxis wäre.

Strengere Regeln, smartere Strategien: Was künftig auf Marken zukommen könnte

Neben den Auswirkungen auf Influencer und ihre Communities ergeben sich auch neue Möglichkeiten und spürbare Herausforderungen für die Werbebranche – ganz gleich, ob Unternehmen, Agentur oder Vermittlungsplattform. Es entstehen neue Möglichkeiten, zugleich aber auch erhebliche Herausforderungen: Strategien müssen neu gedacht, Kooperationen neu gestaltet und strengere Anforderungen erfüllt werden. Ein Gesetz, das klare Expertise verlangt, würde die Branche nachhaltig prägen und damit Fragen aufwerfen, die bisher nie gestellt wurden.

Auf der positiven Seite stiege vor allem die Glaubwürdigkeit: Werbung über zertifizierte oder nachweislich fachkundige Creator wäre für Konsument:innen deutlich nachvollziehbarer und seriöser. Gleichzeitig ließe sich das Reputationsrisiko reduzieren, da Marken seltener in Situationen geraten würden, in denen sie mit fragwürdigen oder falschen Empfehlungen in Verbindung gebracht werden – egal ob bewusst oder unbewusst. Auch die Kampagnenqualität könnte profitieren, da fachlich korrekte Informationen eine transparentere und sauberere Kommunikation ermöglichen würden, insbesondere in sensiblen oder stark regulierten Branchen. Schlussendlich könnte auch die Suche nach passenden Influencern einfacher werden. Da nur qualifizierte Creator bestimmte Produkte oder Themen bewerben dürften, würde sich die Auswahl zwar verkleinern, aber deutlich klarer strukturieren. Marken könnten somit schneller die passenden Partner:innen finden, ohne sich durch einen unübersichtlichen Markt arbeiten zu müssen und selbst Kriterien zur Einschätzung aufzustellen.

Gamechanger für Creator?

Das ist YouTubes Open Call

Doch diesen Vorteilen stehen ebenso deutliche Herausforderungen gegenüber. Strengere Vorgaben würden in vielen Bereichen – insbesondere in spezialisierten Nischen wie Gesundheit, Finanzen oder Recht – zu weniger verfügbaren Creatorn führen. Ein kleinerer Markt kann zwar die Orientierung erleichtern, bedeutet aber gleichzeitig weniger Wettbewerb und damit potenziell höhere Preise, denn

zertifizierte Expert:innen könnten deutlich höhere Honorare verlangen, im Extremfall sogar eine Art Monopol einzelner Fach-Creator entwickeln.

Für Marken würde dies zudem eine komplexere Kampagnenplanung bedeuten: Inhalte müssten sorgfältiger geprüft, Qualifikationen verifiziert und zusätzliche regulatorische Anforderungen berücksichtigt werden. Doch hier stellt sich eine zentrale praktische Frage: Woher sollen Unternehmen die Informationen bekommen, um diese Qualifikationen zuverlässig zu überprüfen? Durch klare Standards, zentrale Register oder speziell befugte Personen? Ohne sie könnten Unsicherheiten oder betrügerische Strukturen entstehen. Das zeigt, dass ein kleinerer, stärker regulierter Markt zwar Übersicht schafft, aber zugleich neue Unklarheiten und Risiken mit sich bringt.

Zwischen Realität und Zukunft: Welche Wege wirklich sinnvoll sein könnten

Ein striktes Influencer-Gesetz nach chinesischem Vorbild wäre in Deutschland kaum umsetzbar – und vermutlich auch nicht sinnvoll. Die Bedeutung der Meinungsfreiheit, die Vielfalt der digitalen Kultur und die Komplexität unseres regulatorischen Umfelds sprechen klar gegen ein solches stark eingreifendes Modell. Dennoch zeigt der Blick nach China, dass bestimmte Herausforderungen, wie mangelnde Transparenz, fragwürdige Empfehlungen oder manipulative Inhalte real und längst auf dem politischen Radar sind.

Denn gleichzeitig wächst auch in Deutschland der politische Druck, hier stärker einzugreifen. Über verschiedene regulierende Optionen wird bereits diskutiert oder zumindest nachgedacht: Kennzeichnungspflichten für qualifikationsrelevante Inhalte, eine striktere Regulierung von Empfehlungs-Marketing in sensiblen Bereichen, über algorithmische Transparenz und Risikominderungsmaßnahmen im Rahmen des DSA, über berufsrechtliche Grenzen etwa im Gesundheits- oder Rechtsbereich sowie über standardisierte Prüfprozesse der Plattformen für Creator. Gerade vor diesem Hintergrund lohnt es sich, über clevere Zwischenschritte nachzudenken, die Orientierung und Schutz bieten, ohne grundlegende Freiheiten zu beschneiden:

1. Expertise-Ausweise für Creator

Plattformen könnten Expertise-Badges etablieren, ähnlich zu bestehenden Verifikationssymbolen. In Bereichen wie Medizin, Ernährung, Recht oder Finanzen dürften Creator ihre Inhalte nur dann entsprechend labeln, wenn sie nachvollziehbare Qualifikationen nachweisen. Sollte jene nicht vorhanden sein, müsste das ebenfalls gekennzeichnet sein als „nicht verifizierter Inhalt“.

2. Transparenzpflicht für sensible Inhalte

Durch klare Einblendungen wie „Dieser Inhalt stellt keine professionelle Beratung dar“ oder „Creator besitzt „…“ Qualifikation“ ließen sich Aussagen besser einordnen. Auch eine Kombination mit dem Expertise-Ausweis wäre denkbar. Nutzer:innen erhielten damit eine echte Entscheidungshilfe, ohne dass Inhalte eingeschränkt werden müssten.

3. Creator-Schulungen und Zertifikate durch unabhängige, geprüfte Organisationen

Solche Programme müssten nicht staatlich sein, sollten aber standardisiert und transparent gestaltet werden. Sie würden Professionalität fördern, ohne Kreativität zu beschneiden. Hier würden sich zudem neue Arbeitsplätze kreieren lassen.

4. Erweitertes Bildungsangebot an Schulen und Universitäten

Hier könnte es sinnvoll sein, die Einschätzung von Quellen und die Überprüfung von Fakten, die über Social Media verbreitet werden, fest in den Lehrplan zu integrieren. So würde früh ein Bewusstsein aufgebaut werden.

Die goldene Mitte: Der Dialog, der längst begonnen hat

Ein pauschales Verbot für nicht-qualifizierte Creator mag überzogen wirken, doch es zeigt eine reale Entwicklung: Die digitale Öffentlichkeit hat ein Informations- und Vertrauensproblem. Wer Einfluss hat, trägt Verantwortung. Und wer Verantwortung trägt, braucht klare Rahmen.

Allen voran gilt deshalb, zentrale Fragen zu Standards, Prüfprozessen, Informationsbereitstellung und den bestehenden Grauzonen zu klären und verbindlich zu regeln. Dafür muss Deutschland nicht Chinas Gesetz übernehmen, aber es braucht einen neuen, ehrlichen Dialog darüber, wie Meinungsfreiheit, Kreativität und Sicherheit im Netz miteinander vereinbar bleiben. Ob ein solches Gesetz Zensur oder Schutz ist? Die Wahrheit liegt dazwischen. Klar ist: Die Debatte hat begonnen und sie wird intensiver werden.

Der Preis der Sichtbarkeit:

Warum viele Influencer sich am eigenen Image erschöpfen

Online Marketing & SEO

Wird George Clooney abgelöst?: Das verrät Nespresso-Marketingchefin Lea Drusio über den Deal mit Dua Lipa

Nespresso-Testimonials Dua Lipa und George Clooney: Kann es nur eine(n) geben?

Seit 20 Jahren wirbt George Clooney für Nespresso. Die von McCann kreierten Kampagnen mit dem Hollywoodstar haben Werbegeschichte geschrieben. Nach der jüngst verkündeten Partnerschaft mit Dua Lipa steht die Frage im Raum, ob es das jetzt gewesen ist. Wir haben Marketingchefin Lea Drusio dazu befragt.

Fans der ikonischen Nespresso-Spots mit „Mr. What Else?“, wie Clooney in Anspielung auf den langjährigen Nespresso-Werbeslogan auch genannt wird,

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

Online Marketing & SEO

„Welcome Home“: F1-Pilot Kimi Antonelli ist der Star der neuen Mercedes-Kampagne

Kimi Antonelli ist Star der Kampagne zum neuen elektrischen GLC

Willkommen zu Hause ist seit vergangenem Sommer das übergeordnete Markenversprechen von Mercedes-Benz. Jetzt trägt der Stuttgarter Autobauer dieses erstmals in die Werbung – und das gleich doppelt.

Bislang hat Mercedes-Benz „Welcome Home“ vor allem auf Events gespielt oder in der Kommunikation angerissen. Das ändert sich ab heute. Der Stuttgarter Autobauer lässt gleich zwei Kampagnen anlaufen. Beide verfolgen zwei Ziele: Das wiederentdeckte „Willkommen zu Hause“ vermitteln und jeweils ein SUV-Modell damit zu verknüpfen: den neuen elektrischen GLC und den neuen elektrischen GLB. Ein Kampagnen-Duett gab es so bislang nicht. Das dürfte vor allem der anstehenden Launchstrecke geschuldet sein. Bis 2027 will der Hersteller über 40 neue Modelle und Facelifts auf die Straße bringen. Hinzu kommt: Mercedes will den Druck hochhalten. Im Januar ist die Marke mit der neuen S-Klasse in ihr 140-Jahre-Jubiläum gestartet. Vor ein paar Tagen folgte der neue VLE. Jetzt folgt schon der nächste Aufschlag.

In der Werbung für den neuen GLC legt Mercedes-Benz sogar noch einen drauf. Der Star in der Kampagne ist Kimi Antonelli. Das kann man eine Punktlandung nennen. Der Mercedes AMG Petronas F1 Team-Fahrer hat am vergangenen Wochenende beim Grand Prix in Shanghai seinen ersten Sieg eingefahren. In der Werbung für das beliebteste Modell der Marke geht er es etwas gemächlicher an. Zwar verlässt er die Rennstrecke zu Beginn des Films noch, aber bei dem Roadtrip mit seinem Vater geht es weniger um hohe Geschwindigkeiten. Verschiedene Features des GLC werden eher beiläufig zitiert, wie das Sky Control Panoramadach, der Totwinkel-Assistent, die intuitive Bedienung und die Massagesitze. Der Film zelebriert nicht die Dynamik, er betont die Entspannung.

Die Credits

Idee, Konzept & Umsetzung: Team X

Produktion: BWGTBLD

Regie: Caroline Koning

Fotograf: Hollie Fernando

Musik: Gustav Karlström

#Beim neuen GLB verzichtet Mercedes-Benz dagegen auf ein prominentes Gesicht. Stattdessen taucht die Marke in den Alltag von Menschen ein, etwa wenn eine Familie nach einem Jahrmarktbesuch ungeplant größer wird. Neben zwei Kindern sind zwei flauschige Stofftiere in dem Film die Hauptakteure. Der GLB mit seinem Platzangebot für bis zu sieben Personen steht für Sicherheit, Wendigkeit und Flexibilität.

Die globalen Kampagnen für den GLC und GLB sind unter anderem in Social-Media, TV und verschiedenen Videoformaten zu sehen. In Print gibt es zudem Kampagnenmotive mit Kimi und seinem Vater Marco. Das freut vor allem Printhäuser freuen, zeigt vor allem aber eines: Willkommen zu Hause spielt Mercedes konsequent Kanälen.

Online Marketing & SEO

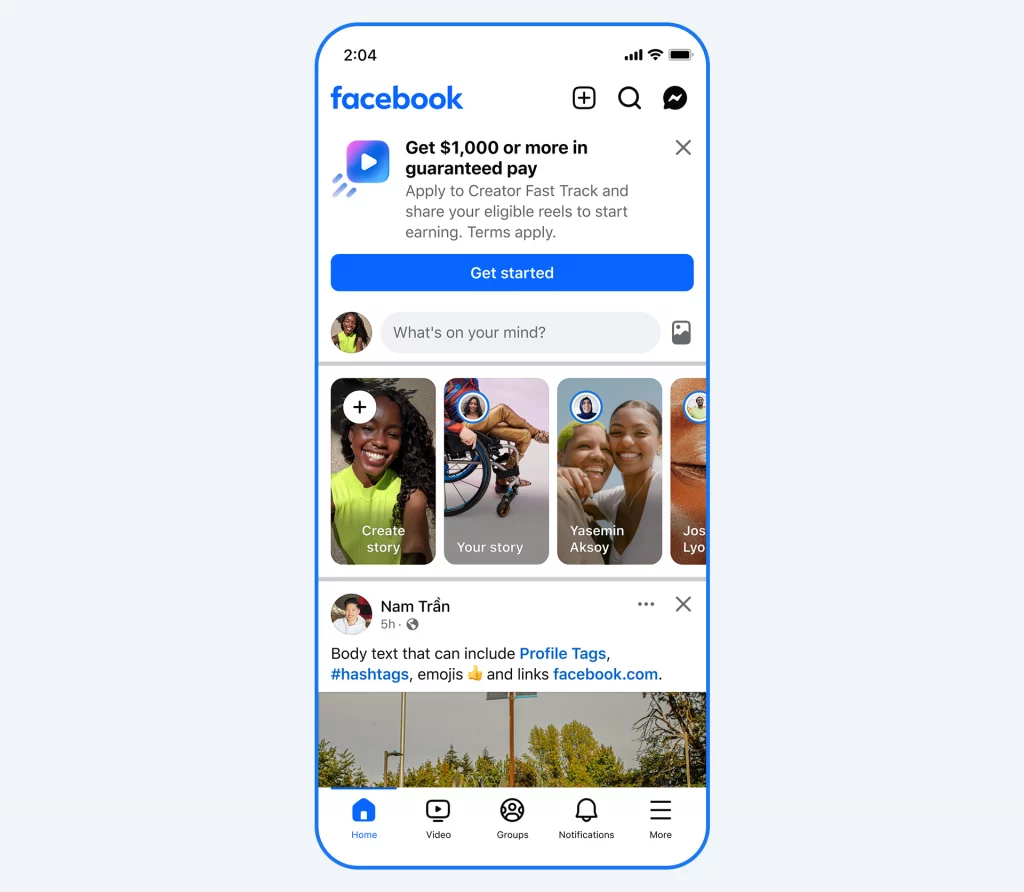

Mit so viel Geld lockt Meta jetzt Top Creator zu Facebook

Mit Creator Fast Track startet Meta den nächsten Anlauf, Facebook wieder zur relevanten Creator-Plattform zu machen. Cash, Distribution und Monetization Access sollen helfen. Ob das für ein Revival von „OG Facebook“ reicht?

Meta macht aus Facebook wieder eine Creator-Bühne und setzt dafür auf altbewährte Hebel: Geld plus Reichweite. Mit dem neuen Creator Fast Track Program will Facebook erfolgreiche Creator von Instagram, TikTok und YouTube auf die eigene Plattform ziehen. Laut Meta erhalten Teilnehmer:innen mit mindestens 100.000 Followern auf Instagram, TikTok oder YouTube 1.000 US-Dollar pro Monat, Creator mit mehr als einer Million Followern sogar 3.000 US-Dollar. Dazu verspricht Facebook mehr Reichweite für Reels und einen schnelleren Zugang zur Facebook Content Monetization. Die garantierten Zahlungen laufen über drei Monate. In dieser Zeit müssen Teilnehmer:innen mindestens 15 Reels veröffentlichen, verteilt auf mindestens zehn verschiedene Tage. Gegenüber CNBC erklärte Yair Livne, Vice President of Product for Facebook Creators, dass der Neustart auf einer neuen Plattform für Creator mit bestehender Reichweite oft abschreckend wirke. Genau diese Hürde soll das Programm senken.

Facebooks Creator Race gegen TikTok und YouTube

Meta verweist im Zuge des Launchs darauf, 2025 fast drei Milliarden US-Dollar an Creator ausgezahlt zu haben, ein Plus von 35 Prozent gegenüber dem Vorjahr. 60 Prozent dieser Summe entfielen laut Meta auf Reels, der Rest auf Stories sowie Foto- und Text-Posts. Parallel führt Facebook neue Monetarisierungsmetriken wie Qualified Views, Earnings Rate und eine Aufschlüsselung nicht qualifizierter Aufrufe ein.

Die garantierten Zahlungen von 1.000 oder 3.000 US-Dollar pro Monat dürften für viele Creator attraktiv sein, verändern aber nicht automatisch die Wahrnehmung von Facebook als Plattform für kreative Inhalte. An fehlender Reichweite scheitert das Netzwerk dabei nicht. Meta zufolge nutzen inzwischen mehr als zwei Milliarden Menschen Facebook täglich und damit mehr als Instagram. Die eigentliche Herausforderung liegt also weniger darin, Aufmerksamkeit zu erzeugen, sondern diese enorme Reichweite wieder stärker in Creator-Relevanz, Content-Dynamik und eine jüngere Audience zu übersetzen. Dass Meta das Problem selbst kennt, zeigt auch eine Aussage von Mark Zuckerberg. In der Colin and Samir Show aus 2025 sagte der Meta CEO:

I just don’t think that a lot of creators today think about Facebook as the primary place they can go. But that itself actually creates this huge arbitrage opportunity.

Zuckerberg erklärte damals, er wolle den ursprünglichen Geist von Facebook wiederbeleben, also das, was er selbst als „OG Facebook“ bezeichnete.

Facebook stellt Messenger.com ein und setzt auf Mobile

Garantierte Zahlungen und ein softer Plattformstart für Top Creator auf Facebook

Mit dem Creator Fast Track Program setzt Meta bei der Creator-Gewinnung auf garantierte Zahlungen, mehr Distribution, also zusätzliche Reichweite für Inhalte, und einen schnelleren Einstieg in die Monetarisierung. Wer auf Instagram, TikTok oder YouTube bereits Reichweite aufgebaut hat, soll diese Social Signals, also die Sichtbarkeit und Glaubwürdigkeit von anderen Plattformen, nun in Facebook-Wachstum übersetzen. Das Programm richtet sich an Creator, die Facebook neu entdecken oder zur Plattform zurückkehren wollen. Die Inhalte müssen dafür nicht exklusiv für Facebook produziert werden, aber vom Creator selbst stammen. Auch KI-generierte Inhalte sind möglich, solange sie als eigene Inhalte gelten.

Der eigentliche Hebel liegt dabei nicht nur im Bonus, sondern im geringeren Kaltstartrisiko, also im Problem, auf einer neuen Plattform erst einmal ohne Reichweite anfangen zu müssen. Facebook kombiniert zusätzliche Reichweite mit einem Onboarding-Modell, das den Neustart auf der Plattform kalkulierbarer machen soll. Creator müssen ihre Audience nicht erst mühsam von null aufbauen, sondern erhalten Distribution und ein finanzielles Sicherheitsnetz direkt zum Einstieg. Für viele dürfte das attraktiver wirken als ein klassisches Revenue-Share-Modell, bei dem Einnahmen erst mit Verzögerung sichtbar werden. Dass Meta dabei vor allem auf Reels setzt, ist naheliegend. Das Format zählt zu den wichtigsten Bausteinen im Plattformgeschäft des Konzerns.

Ein wichtiger Haken bleibt allerdings: Die Facebook Content Monetization ist invite-only. Creator können in der mobilen App zwar ihr Interesse bekunden, sind damit aber nicht automatisch Teil des Programms. Zur konkreten Verfügbarkeit in einzelnen Regionen macht Meta in der Ankündigung keine Angaben.

Wie hoch sind die Chancen auf Zuckerbergs „OG Facebook“?

Neu sind diese Ambitionen vonseiten Meta für Facebook allerdings nicht. Engadget erinnert daran, dass Meta schon zuvor mit hohen Boni um Creator geworben hat, etwa rund um Facebook Watch, im Game Streaming oder nach dem Start von Reels. Teile dieser Programme wurden später wieder eingestellt oder stark zurückgefahren. Der Unterschied liegt diesmal vor allem darin, dass Meta Creator Fast Track direkt an das bestehende Content Monetization Program koppelt. Das Programm soll also nicht nur kurzfristig mit garantierten Zahlungen locken, sondern Creator über die ersten drei Monate hinaus in ein dauerhaftes Monetarisierungsmodell überführen.

Die entscheidende Frage ist nun, ob Facebook Creator mit Fast Track, die bislang lieber nur auf TikTok, Instagram und YouTube setzen, nicht nur kurzfristig auf die Plattform zieht, sondern sie auch nachhaltig bindet und darüber hinaus wieder mehr Relevanz bei jüngeren Social Media Usern aufbauen kann. Denn auch große Creator-Namen entfalten nur dann echten Wert, wenn auf der Plattform eine aktive, relevante Audience vorhanden ist. Genau daran wird sich am Ende auch messen, ob Meta mit dem Programm mehr erreicht als einen kurzfristigen Creator Push und Zuckerbergs Idee von „OG Facebook“ tatsächlich neu beleben kann.

Konto wiederherstellen wird einfacher:

Endlich besserer Support für Instagram und Facebook

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 2 Wochen

Social Mediavor 2 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 4 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenÜber 220 m³ Fläche: Neuer Satellit von AST SpaceMobile ist noch größer

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur