Künstliche Intelligenz

Meta stoppt Batman VR-Nachfolger und zieht sich aus VR-Gaming zurück

Meta zieht sich weiter aus der VR-Spieleentwicklung zurück. Wie das Branchenmagazin UploadVR berichtet, wird das geplante Sequel zu „Batman: Arkham Shadow“ nicht erscheinen. Gleichzeitig kommt es zu tiefgreifenden Umstrukturierungen bei den letzten verbliebenen internen Spielestudios. Das von Camouflaj entwickelte „Arkham Shadow“ gilt als eines der besten VR-Spiele überhaupt und ist ein Referenztitel für Metas VR-Brillen Quest 3 und Quest 3S. Ein Nachfolger soll dem Bericht zufolge intern bereits in Arbeit gewesen sein.

Weiterlesen nach der Anzeige

Allerdings sei nicht mehr Camouflaj selbst als Entwickler vorgesehen gewesen, sondern Sanzaru Games, das zuvor die beiden Titel der „Asgard’s Wrath“-Reihe verantwortete. Sanzaru hat Meta jedoch im Rahmen einer Kündigungswelle komplett geschlossen. Auch bei Camouflaj, das 2024 noch Interesse an einer Fortsetzung geäußert hatte, gibt es erhebliche Einschnitte. Das Studio bleibt zwar formal bestehen, entwickelt jedoch künftig keine VR-Spiele mehr. Stattdessen soll das verbliebene Rumpfteam Tutorial-Inhalte für künftige Geräte wie eine mögliche Meta Quest 4 erstellen.

Auch Förderprogramme gestrichen

Ein weiterer Bericht von Android Central legt nahe, dass Meta auch Fördermittel für externe Studios gestrichen hat. Der Großteil der Förderungen, die Oculus Publishing im Rahmen des „Meta Horizon Start Program“ für Entwickler bereitgestellt hat, soll eingestampft worden sein. Bisher soll Meta 2026 insgesamt 60 Millionen US-Dollar in die VR-Spieleförderung gepumpt haben. Mehr soll es nicht mehr geben.

Metas Rückzug aus dem VR-Gaming soll unter anderem zu Entlassungen von etwa 70 Prozent der Mitarbeitenden bei Cloudhead Games geführt haben. Das Studio ist für den seit Jahren etablierten Rhythmus-Shooter „Pistol Whip“ verantwortlich. Der gut vernetzte YouTuber GamertagVR zitiert zudem interne Quellen, die von der Einstellung eines weiteren namhaften Quest-Exklusivspiels wissen wollen. Meta soll Skydance Interactive („Behemoth“, „The Walking Dead: Saints & Sinners“) mit einem VR-Spiel aus dem „Harry Potter“-Universum beauftragt haben. Offiziell bestätigt wurde ein solcher Titel bisher nicht.

Empfohlener redaktioneller Inhalt

Mit Ihrer Zustimmung wird hier ein externes YouTube-Video (Google Ireland Limited) geladen.

The Meta Situation Just Got Worse

VR-Gaming spielt keine Rolle mehr bei Meta

Mit dem Aus von Sanzaru, Twisted Pixel („Marvel’s Deadpool VR“), Armature Studio („Resident Evil 4 VR“) und der erst fusionierten, dann zusammengeschrumpften Downpour Interactive und Camouflaj hat Meta innerhalb weniger Monate fünf der besten VR-Spielestudios überhaupt geschlossen. Nach aktuellem Stand bleiben nur noch drei interne Teams aktiv: Beat Games („Beat Saber“), BigBox („Population: One“) und Ouro Interactive, das sich ausschließlich auf Inhalte für die Social-VR-Plattform Horizon Worlds konzentriert. Damit dürfte klar sein, dass Meta auch für künftige VR-Headsets keine eigenen Exklusivtitel mehr produzieren dürfte und eher als Hardware- und Marketplace-Anbieter fungieren will.

Weiterlesen nach der Anzeige

heise online XR-Briefing abonnieren

Jeden zweiten Montag, liefern wir Ihnen die wichtigsten Entwicklungen der XR-Branche. Damit Sie alles im Blick behalten.

E-Mail-Adresse

Ausführliche Informationen zum Versandverfahren und zu Ihren Widerrufsmöglichkeiten erhalten Sie in unserer Datenschutzerklärung.

Virtual Reality ist in Metas Prioritätenliste schon längst nach unten gerutscht und Kürzungen in den dafür zuständigen Abteilungen deuteten sich bereits vor Monaten an. Wie schwer es den VR-Anteil der Reality Labs nun getroffen hat, ist dennoch ein Schock für die gesamte Industrie. Über 1500 Stellen werden abgebaut, weitere Einschnitte könnten folgen. Allein 2025 sollen die Reality Labs ihr Budget um 30 Prozent kürzen – deutlich mehr als jede andere Abteilung des Konzerns.

Meta-Technikchef Andrew Bosworth kündigte intern an, künftig verstärkt auf Augmented Reality und KI-Wearables zu setzen. Virtual Reality hingegen werde nur noch reduziert unterstützt. Die VR-Sparte hatte Meta seit 2014 aufgebaut und mit Milliardenaufwand ausgebaut. Doch der erhoffte Erfolg auf dem Massenmarkt stellte sich nicht ein. Das Projekt Metaverse bleibt laut Bosworth zwar bestehen, soll künftig aber stärker auf mobilen Geräten stattfinden.

(joe)

Künstliche Intelligenz

Metas Ray-Bans: Clickworker sehen Sexvideos

Videos, die mit den Ray-Ban- oder Oakley-Brillen von Meta aufgezeichnet werden, bleiben nicht lokal auf dem Gerät oder dem Smartphone mit der dazugehörigen Meta AI App gespeichert. Das scheint vielen Menschen nicht klar zu sein. Denn wie das „Svenska Dagbladet“ berichtet, landen bei den zuständigen Clickworkern auch Videos von eher intimen Momenten.

Weiterlesen nach der Anzeige

Ob Sex oder der Gang zur Toilette. Solche Aufnahmen sollen dem Bericht zufolge bei Arbeitern in Kenia aufgetaucht sein. Die Menschen dort werten Videos aus, beschriften und markieren sie. Das nennt sich Daten-Annotation. Mit den so vorbereiteten Daten werden dann wiederum neue KI-Modelle trainiert. Man kann diese Menschen getrost als das Rückgrat von KI bezeichnen, denn ohne ihre Arbeit wären KI-Modelle aller Unternehmen deutlich weniger leistungsfähig oder klug.

Dass die Arbeit oftmals belastend sein kann, ist ebenfalls bekannt. Inhalte können etwa Gewalt zeigen. Auch das muss beschriftet werden, damit ein KI-Modell lernen kann, wie Gewalt aussieht oder was als Gewalt gilt – und was gegebenenfalls dann genau nicht generiert werden darf, sofern es eine solche Richtlinie für ein Modell gibt. Clickworker bekommen in der Regel sehr wenig Geld und leiden zudem psychisch unter den Aufgaben.

Es überrascht nicht, dass sie intime Situationen oder sogar Bankdaten zu sehen bekommen. Dass offenbar so wenig Bewusstsein bei den Nutzern der smarten Brillen für die potenzielle Weitergabe der Daten besteht, erstaunt aber doch.

Meta hält Vorgehen für transparent

Meta verweist auf die Datenschutzrichtlinie und Nutzungsbedingungen. Auf Nachfrage von heise online sagt ein Sprecher: „Wenn Menschen Inhalte mit Meta AI teilen, nutzen wir manchmal Subunternehmen, die diese Inhalte auswerten, um die Funktionsweise der smarten Brillen zu verbessern.“ Das stehe ganz klar in den Richtlinien.

Sprachaufnahmen können tatsächlich laut Datenschutzrichtlinie nicht automatisch weitergegeben werden. Möglicherweise hat Meta hier aus vorherigen Skandalen um etwa Amazons Alexa und Apples Siri gelernt. Auch hier landeten Sprachaufnahmen zur Auswertung und für die Verbesserung der eigenen Produkte bei Menschen, die diese anhören und auswerten mussten.

Weiterlesen nach der Anzeige

Videoaufnahmen, die mit den Ray-Bans und Oakleys aufgezeichnet werden, können aber immer an Meta und andere Unternehmen weitergereicht werden. Das lässt sich nicht abschalten. Meta AI, der Dienst und die gleichnamige App, die für die Verarbeitung der Nutzeranfragen zuständig ist, kann nur mittels Datenweitergabe die angebotenen Funktionen erfüllen. Sprich: Damit Meta AI dem Nutzer sagen kann, vor welchem Gebäude er gerade steht, müssen die Bilder an Meta geschickt und dort ausgewertet werden.

Wie die schwedische Tageszeitung berichtet, funktioniert auch die Anonymisierung der Videos nicht richtig. Clickworker sollen berichtet haben, dass Gesichter nicht verpixelt werden. Meta jedoch sagt auf Nachfrage, dass man die Inhalte sehr wohl filtere, um die Menschen zu schützen. Auch hier werde kontinuierlich an Verbesserungen der Systeme gearbeitet.

Ein weiterer Hinweis von Meta bezieht sich auf die Unsicherheit von Menschen, heimlich gefilmt zu werden. Die Brillen zeigen immer anhand einer kleinen LED im Gestell an, wenn sie aktiviert sind. Zudem sagt Meta, in den Nutzungsbedingungen sei festgehalten, dass Menschen die Dienste im Rahmen der Gesetzgebung sowie in einer respektvollen Art nutzen sollten.

(emw)

Künstliche Intelligenz

c’t-Workshop: DHCP-Automatisierung mit Kea und Stork

Der DHCP-Dienst bildet das Rückgrat moderner Netzwerke. In vielen Umgebungen verteilen sich Verwaltungsdaten jedoch auf mehrere Systeme – etwa IP-Adressmanagement, Inventardatenbanken, VoIP-Plattformen oder Deployment-Werkzeuge. Mit Kea-DHCP und der Weboberfläche Stork führen Admins diese Daten zusammen und synchronisieren sie über APIs mit dem DHCP-Dienst. So automatisieren sie wiederkehrende Konfigurationsaufgaben.

Weiterlesen nach der Anzeige

Im Workshop DHCP-Automatisierung mit Kea und Stork binden die Teilnehmer Kea-DHCP mit Open-Source-Werkzeugen in automatisierte Netzwerkumgebungen ein.

Von der Installation bis zum Monitoring

Der Workshop deckt den gesamten Lebenszyklus einer Kea-DHCP-Umgebung ab. Die Teilnehmer installieren Kea, richten ein Datenbank-Backend mit MySQL oder PostgreSQL ein und konfigurieren Subnetze sowie Adresspools. Danach bauen sie einen Hochverfügbarkeits-Cluster auf, testen Failover und prüfen den Status der Instanzen.

Anschließend setzen sie typische DHCP-Szenarien um: PXE-basierter Netzwerkboot, Vendor- und VIVSO-Optionen sowie dynamische DNS-Updates. Danach aktivieren sie die Kea-API, sichern den Zugriff ab und verwalten darüber Subnetze, Optionen, Client-Klassen und Reservierungen.

Mit Stork administrieren sie ihre Kea-Instanzen zentral und kontrollieren Versionen sowie HA-Zustände. Für Metriken und Alerts binden sie Monitoring-Werkzeuge wie Prometheus, Grafana, Zabbix und Uptime-Kuma ein. Ergänzend analysieren sie Logs und DHCP-Leases.

Direkt anwendbares Know-how

Die Teilnehmer erwerben Wissen, das sie unmittelbar im Produktivbetrieb einsetzen können. Sie lernen, typische Stolperfallen zu erkennen, bevor diese im laufenden Betrieb Probleme verursachen. Außerdem gewinnen sie ein tieferes Verständnis für Skalierbarkeit, Hochverfügbarkeit und Betriebssicherheit ihrer DHCP-Infrastruktur.

Weiterlesen nach der Anzeige

Durch den Workshop führt Carsten Strotmann von der sys4 AG. Er betreut seit über 25 Jahren Unix- und Windows-Netzwerke. Zu seinen Schwerpunkten zählen DNS, DNSSEC und IPv6. Als Trainer arbeitet er unter anderem für das Internet Systems Consortium, das Linuxhotel und Men & Mice.

Voraussetzungen und Anmeldung

Der Workshop richtet sich an Systemadministratoren, Netzwerkingenieure und DevOps-Teams mit Linux- und TCP/IP-Grundkenntnissen. Erfahrung mit JSON-APIs und DHCP erleichtert den Einstieg.

Die Teilnehmerzahl ist auf 20 Personen begrenzt. Die Veranstaltung am 2. und 3. Juni jeweils von 9:00 bis 17:00 Uhr online über Zoom statt. Zur Teilnahme genügen ein aktueller Browser mit JavaScript sowie ein Mikrofon oder Headset; ein SSH-Client ist hilfreich. Wer bis zum 05.05.2026 bucht, sichert sich einen Frühbucher-Rabatt von 10 Prozent und zahlt 792,00 Euro. Weitere Informationen und Details zur Anmeldung finden Sie auf der Seite zum Workshop.

(abr)

Künstliche Intelligenz

Android Studio Panda 2: KI-Agent erstellt neue Android-Apps

Google hat Android Studio Panda 2 veröffentlicht. Die neue Version stattet die integrierte Entwicklungsumgebung für Android-Apps mit erweiterten KI-Möglichkeiten aus: Per KI-Agent lassen sich komplette neue App-Prototypen erstellen. Aber auch im Umgang mit vorhandenen Codebasen soll der KI-Agent unterstützen können und Entwickler von Boilerplate-Code befreien.

Weiterlesen nach der Anzeige

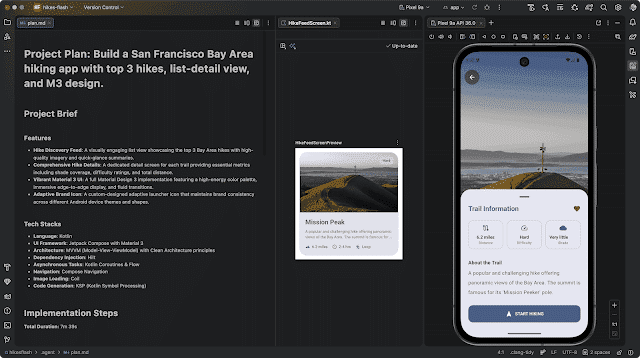

Per Prompt zur App: Google demonstriert den KI-gestützten „New Project“-Flow.

(Bild: Google)

Neue Apps per Prompt

Wie das Android-Team ausführt, soll der KI-gestützte „New Project“-Flow das Erstellen eines App-Prototyps mit nur einem Prompt ermöglichen. Dabei können Developer neben einer Beschreibung der geplanten App auch Bilder hochladen. Der KI-Agent setzt dann die Pläne in die Tat um und nutzt dazu Technologien wie Kotlin und Compose unter Befolgung der Best Practices in der Android-Entwicklung. Die App wird letztlich zu einem Android-Emulator deployt und Developer können jeden Screen dahingehend prüfen, ob er ihren Anforderungen entspricht.

Nicht nur neue Apps, sondern auch bestehende Codebasen sollen von den Fähigkeiten des KI-Agenten profitieren. Der Version Upgrade Assistant in Android Studio kann nun mithilfe von KI Dependencies verwalten. Dazu klicken Entwickler im Versionskatalog mit der rechten Maustaste, wählen AI und anschließend Update Dependencies aus. Auch aus dem Refactor-Menü lässt sich die KI-Funktion aktivieren: Update all libraries with AI.

Die Dependency-Verwaltung kann nun per KI geschehen.

(Bild: Google)

Dann soll der KI-Agent mehrere automatisierte Runden durchführen, bis er Dependency-Konflikte behoben hat und der Build schließlich erfolgreich verläuft.

Weiterlesen nach der Anzeige

Qualitätsverbesserung gegen Aufpreis

Neben dem kostenfreien Standard-Modell in Android Studio kann der KI-Agent für zahlende Kunden auf weitere Optionen zugreifen. Entwicklerinnen und Entwickler können ihren eigenen API-Key für Google AI Studio eingeben, um einen zahlungspflichtigen Gemini-API-Key einzubinden. Das ermöglicht Zugriff auf neuere und schnellere Modelle von Google zum Erstellen neuer Apps, darunter das KI-Bildmodell Nano Banana und Gemini 3.1 Pro Preview, was das Generieren verbesserter Designs ermöglichen und die Codequalität erhöhen soll.

Android Studio Panda 2 steht bei Google zum Download bereit. Weitere Informationen bietet der Blogeintrag zur Ankündigung.

(mai)

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 3 Wochen

Social Mediavor 3 WochenCommunity Management zwischen Reichweite und Verantwortung

-

Social Mediavor 2 Tagen

Social Mediavor 2 TagenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Künstliche Intelligenzvor 2 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Datenschutz & Sicherheitvor 3 Monaten

Datenschutz & Sicherheitvor 3 MonatenSyncthing‑Fork unter fremder Kontrolle? Community schluckt das nicht

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Anthropic verschenkt MCP – mit fragwürdigen Hintertüren

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenGame Over: JetBrains beendet Fleet und startet mit KI‑Plattform neu

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights