Apps & Mobile Entwicklung

Nicht mehr nur GPUs: Nvidia Groq 3 LPU erhöht Inference-Durchsatz massiv

Der im Dezember zwischen Nvidia und Groq geschlossene Technologie-Lizenzvertrag trägt zur GTC 2026 erste Früchte. Eine neue Language Processing Unit (LPU) soll den Inference-Durchsatz mit niedriger Latenz massiv erhöhen. Demnach wird bei Nvidia nicht länger nur auf GPUs gesetzt. Zum Einsatz kommen sie im neuen LPX-Rack.

Gerüchten zufolge soll das Lizenzabkommen Nvidia 20 Milliarden US-Dollar wert gewesen sein. Offiziell handelt es sich um einen nicht-exklusiven Deal, denn Groq wurde für den propagierten Preis nicht von Nvidia übernommen, es bleibt ein eigenständig. Das Abkommen sieht aber vor, dass Groq-Gründer Jonathan Ross und Groq-Präsident Sunny Madra sowie weitere Mitarbeiter zu Nvidia wechseln.

LPU des Hauptarchitekten der Google TPU

Das KI-Chip-Startup Groq wurde 2016 von Jonathan Ross und Douglas Wightman gegründet. Ross war zuvor bei Google einer der Hauptarchitekten der Google Tensor Processing Unit (TPU). Mit Groq wollte er eine neue Prozessorarchitektur speziell für das KI-Inferencing entwickeln, die deutlich geringere Latenzen und höhere Geschwindigkeiten bei der Ausführung großer Sprachmodelle ermöglicht. Dabei herausgekommen ist die Language Processing Unit (LPU), die mit der Einführung der Vera-Rubin-Plattform zum Bestandteil der aktuellen Datacenter-Architektur von Nvidia wird. Bedeutet: Nvidia setzt nicht mehr nur auf GPUs, sondern erstmals auch spezielle Inference-Beschleuniger.

Das zeichnet eine LPU aus

Ziel der LPU ist die bei Inference wichtige sehr schnelle Token-Generierung für Echtzeit-KI-Anwendungen. Dafür setzt sie auf eine deterministische Architektur ohne Caches, Branch-Prediction oder dynamisches Scheduling. Weil der Compiler jede Operation und jeden Datenfluss im Voraus plant, entstehen exakt vorhersehbare Laufzeiten. Das Ergebnis ist ein Inference-Beschleuniger mit konstanter und sehr niedriger Latenz.

500 MB SRAM statt 288 GB HBM4

Für sehr kurze Zugriffszeiten und eine hohe Bandbreite sorgt ein großer On-Chip-SRAM. GPUs für Künstliche Intelligenz setzen hingegen auf eine oftmals komplexer Cache-Hierarchie und extern angebundenen High Bandwidth Memory (HBM). Beide Lösungen haben ihre Vor- und Nachteile, weshalb Nvidia auch nicht von LPUs statt GPUs, sondern von GPUs und LPUs redet. Erreicht werden soll eine Kombination aus hohem Durchsatz und niedriger Latenz. Deshalb gesellt sich das neue LPX-Rack neben das Vera Rubin NVL72, in dem CPUs und GPUs zum Einsatz kommen.

Eine Nvidia Groq 3 LPU kommt mit 500 MB On-Chip-SRAM (Static RAM). Der Speicher fällt somit deutlich kleiner (1/500) als der 288 GB große HBM4 der Rubin-GPU aus. Doch der SRAM erreicht mit 150 TB/s eine um das Vielfache höhere Bandbreite als HBM4 mit 22 TB/s. Kleine Randnotiz: Nvidia gibt zur GTC offiziell 22 TB/s für den HBM4 von Rubin an, Gerüchte einer Reduzierung auf 20 TB/s haben sich bislang nicht bestätigt. Die spezialisierte LPU bietet eine FP8-Leistung von 1,2 PFLOPS, während Rubin bei 50 PFLOPS für NVFP4 liegt. 98 Milliarden Transistoren zählt eine LPU. Zum Vergleich: Rubin kommt auf 336 Milliarden zuzüglich 2,5 Billionen Transistoren (!) für den HBM4.

LPX-Rack reiht sich in Vera-Rubin-Ökosystem ein

Zusammengeführt werden die LPUs im neuen LPX-Rack, das insgesamt 256 LPUs, 128 GB SRAM, 315 PFLOPS und 40 PB/s SRAM-Bandbreite bietet. Auch bei diesem Rack setzt Nvidia für den dicht gepackten Scale-up im Rack auf eine Flüssigkeitskühlung, die zum restlichen Vera-Rubin-Ökosystem kompatibel ist. Die LPX-Racks könne man auf mehr als 1.000 LPUs skalieren, erklärte Nvidia.

LPUs und GPUs im Zusammenspiel

Das LPX-Rack findet seinen Platz neben einem Vera Rubin NVL72, sodass die Workloads entsprechend der Anforderungen auf die verschiedenen Lösungen verteilt werden. Das soll die Vorteile beider Arten von Beschleunigern zusammenführen. Nvidia zeigt dies am Beispiel eines Effizienz-Trade-offs beim LLM-Inferencing für ein Modell mit 1 Billion Parametern und 400K Kontextfenster – jeweils auf Blackwell, Rubin und Rubin mit LPX. Für alle Architekturen gilt: Je schneller ein einzelner Nutzer Antworten bekommt (höhere TPS/User), desto schlechter wird die Energieeffizienz des gesamten Systems. Denn eine hohe Antwortgeschwindigkeit erfordert mehr parallele Ressourcen pro Nutzer.

Im konkreten Beispiel hat sich Nvidia einen Punkt bei etwa 500 TPS/User und Kosten von 45 US-Dollar pro eine Million Tokens herausgepickt. Hier liefere Rubin mit LPX einen 35 Mal höheren Inference-Durchsatz respektive höhere Energieeffizienz (TPS/MW) als Blackwell. Der nominelle Direktvergleich nur mit Rubin bleibt aus, die Grafik verbildlicht aber auch hier den Vorteil. Anbieter könnten mir der gemischten Architektur einen bis zu 10 Mal höheren Umsatz in USD pro Sekunde pro Rechenzentrum-Megawatt generieren, so Nvidia. Während Blackwell auf 1 USD und Rubin auf 4 USD komme, erreiche Rubin mit LPX 10 USD.

Die neuen LPX-Racks sollen gemeinsam mit den weiteren KI-Lösungen der neuen Vera-Rubin-Plattform im Verlauf des zweiten Halbjahres 2026 an den Start gehen.

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA im Vorfeld und im Rahmen einer Veranstaltung des Herstellers in San Jose, Kalifornien erhalten. Die Kosten für An-, Abreise und fünf Hotelübernachtungen wurden vom Unternehmen getragen. Eine Einflussnahme des Herstellers oder eine Verpflichtung zur Berichterstattung bestand nicht. Die einzige Vorgabe aus dem NDA war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

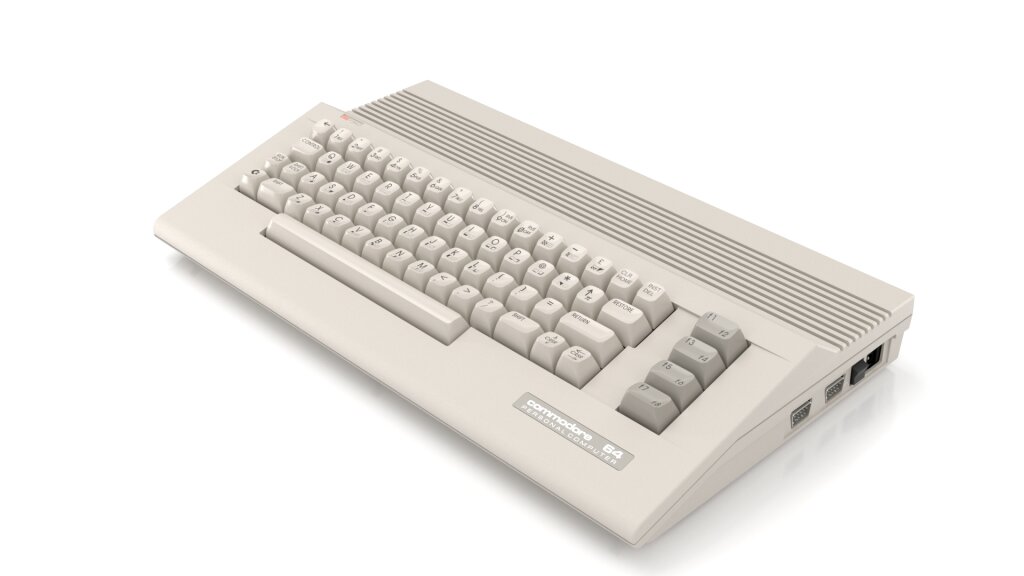

Retro-Heimcomputer-Neuauflage: Commodore 64C Ultimate erscheint im September

Mit dem Commodore 64C Ultimate bekommt ein weiteres Modell des altehrwürdigen Retro-Rechners eine Neuauflage mit aktueller FPGA-Technologie. Das Gehäuse entspricht weiterhin dem des Original-64C aus dem Jahr 1986.

Die Neuauflage des Commodore 64C kann ab sofort zum Preis ab rund 300 US-Dollar vorbestellt werden. Die Auslieferung wird dem Hersteller zufolge im Zeitraum zwischen dem 2. und 15. September 2026 erfolgen. Dabei nutzt Commodore die Spritzgussformen des Originalmodells, wodurch rundliche Fließspuren als Echtheitsmerkmale auf der Gehäuseoberfläche erkennbar sind.

Commodore 64C Ultimate mit moderner FPGA-Technik

Während das Äußere des Commodore 64C Ultimate dank der wiedererworbenen Gussformen dem Original treu bleibt, basiert das Innenleben des Retro-Heimcomputers auf aktueller FPGA-Technologie. FPGA, ausgeschrieben „Field Programmable Gate Array“, sind hierbei integrierte Schaltkreise, dessen Logik weitreichend umprogrammiert werden kann. Dadurch kann die ursprüngliche Hardware genau nachgebildet werden.

Das FPGA-basierte Mainboard bietet darüber hinaus aber auch aktuelle Anschlussmöglichkeiten wie ein HDMI-Port, USB-Anschlüsse sowie WLAN. Zudem wird der Commodore 64C Ultimate mit Spielen und Demos ausgeliefert, während ein spiralgebundenes Handbuch nicht nur die Bedienung des Retro-Computers erläutert, sondern zusätzlich in die Programmierung mit BASIC einführt.

Drei Editionen stehen zur Wahl

Dabei stehen insgesamt drei Editionen des Commodore 64C Ultimate zur Auswahl, die schon jetzt mit einem Preisnachlass von jeweils 50 US-Dollar vorbestellt werden können. Demnach gibt es die „BASIC Beige“-Edition zum Preis von 299,99 US-Dollar als originalgetreue Nachbildung, die „Starlight Edition“ mit durchsichtigem Gehäuse und LED-Beleuchtung für 349,99 US-Dollar sowie die „Founder’s Edition“ mit goldbeschichteten Tastenkappen, vergoldeten Logos und halbtransparentem Gehäuse für 499,99 US-Dollar.

The Commodore 64 Ultimate has tapped into a nostalgia not just for a piece of technology, but for a time when technology served us not enslaved us; when it challenged us and helped us grow. But there’s still something comforting about the tangible side of that nostalgia; a visual reminder of the time we long to return to. And for many users, that memory is intrinsically tied to the C64C. Soon they can have one at their fingertips once again.

Peri Fractic, Präsident und CEO sowie Chief Product Officer von Commodore

Mit dem Commodore 64C Ultimate möchte das Unternehmen die Sehnsucht nach Nostalgie bedienen, als „uns Technologie noch diente, statt zu versklaven“, wie Commodore-Chef Peri Fractic im Rahmen eines Blogbeitrags erklärt. Ferner ist diese Ankündigung, die als zweites Produkt auf den „Brotkasten“ Commodore 64 Ultimate folgt, nur die erste von mehreren Enthüllungen, die noch für das aktuelle Jahr geplant sind.

Apps & Mobile Entwicklung

Moza R9 mit CS Pro Lenkrad im Test

Mit der R9 V3 Wheel Base mit 9 Nm, den SR-P-Pedalen mit Hybrid-Load-Cell-Bremse sowie dem neuen CS Pro Wheel mit RGB-Buttons, 2,99“-Display und mindestens vier rückseitigen Paddeln bietet Moza ein komplettes Racing-Sim-Paket für knapp über 800 Euro an. Der Test zeigt Vorzüge, aber auch Einschränkungen auf.

Das Bundle im Überblick

Das getestete Bundle besteht aus der Moza R9 V3 Wheel Base, einer passenden Tischklemme, den SR-P-Pedalen sowie dem recht neuen Moza CS Pro Lenkrad. Im Preisvergleich kommen die Komponenten in Summe zum Start in den Mai auf 820 Euro, wobei das Lenkrad aktuell nur bei Moza selbst verfügbar ist.

Die Moza R9 V3 Wheel Base

Die Wheel Base bietet ein maximales Drehmoment von 9 Newtonmetern bei einer maximalen Leistung von 180 Watt sowie Mozas Quick-Release-Verbindung für die Lenkradaufnahme. Die Tischklemme ist aus schwarzem Metall gefertigt und kostet ab 45 Euro. Die Wheel Base ist ab 309 Euro erhältlich.

Die Moza SR-P Pedale

Die SR-P-Pedale bestehen aus einem Gas- und einem Bremspedal. Letzteres soll mit einer Hybridbremse, die eine Load-Cell und einen Winkelsensor kombiniert, überzeugen. Mit einer UVP von rund 160 Euro ist es ein wenig günstiger als die Fanatec CSL Pedals LC und 10 Euro teurer als die kürzlich zusammen mit dem Logitech G RS50 System getesteten RS Pedals für rund 150 Euro. Der Handel ruft aber schon nur noch Preise ab 118 Euro auf.

Das Moza CS Pro Lenkrad

Das neue Moza CS Pro Lenkrad bietet ein Display, hinterleuchtete Knöpfe sowie auf der Rückseite zwei Schaltwippen und zwei Kupplungspaddel. Sein Lenkradkranz hat einen Durchmesser von 325 mm. Verkauft wird es ab 349 Euro. Das zusätzliche Paddel-Addon-Kit kostet weitere 50 Euro.

Macht in Summe ohne die Addon-Paddles etwas über 800 Euro. Was Kunden dafür bekommen, hat ComputerBase ausführlich getestet. Die Details finden sich auf den folgenden Seiten.

- Moza R9 V3 Wheel Base

- Moza SR-P-Pedale mit Gas- und Bremspedal

- Moza CS Pro Lenkrad mit Paddles-Addon-Kit

- Tischklemme

Apps & Mobile Entwicklung

Philips Evnia AmbiScape: Raumbeleuchtung folgt Ambiglow-Monitor auf den Fuß

Die Umgebungsbeleuchtung „Ambiglow“ der Evnia-Monitore von Philips kann nun mit Matter-kompatibler Innenraumbeleuchtung in Einklang gebracht werden. AmbiScape nennt sich die neue Funktion, die Raum und Monitor synchron leuchten lässt.

Voraussetzung dafür ist zum einen der Besitz eines Evnia-Monitors mit Ambiglow und zum anderen ein netzwerkfähiges Beleuchtungssystem, das mit dem Matter-Ökosystem kompatibel ist.

Realisiert wird der Abgleich der Beleuchtung über die kostenlose Software Philips Evnia Precision Center. Ambiglow nutzt eine mit KI optimierte Technik, die die Beleuchtung dynamisch an das Geschehen im Spiel anpasst. Dabei werden unter anderem Farbbalance und Szenenwechsel erfasst und mit der Umgebungsbeleuchtung in Einklang gebracht. Das Pendant dazu bei Philips-Fernsehern ist Ambilight.

AmbiScape nutzt Matter-Standard

Mit AmbiScape wurde jetzt eine Matter-zertifizierte Schnittstelle hinzugefügt, „die das Geschehen auf dem Bildschirm in die Umgebung überträgt, indem sie Matter-kompatible Smart-Leuchten mit dem Geschehen auf dem Bildschirm synchronisiert“, erklärt Philips.

Aktuelle Version des Precision Center nötig

Die neue Funktion stehe allen Besitzern eines Evnia-Monitors kostenlos zur Verfügung. Dafür müssen diese mindestens die Version 1.9 der Precision Center Software installiert haben, die seit dem 29. April zum Download angeboten wird.

Nähere Informationen liefert Philips auf seiner Webseite zu AmbiScape.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview