Apps & Mobile Entwicklung

AI-Beschleuniger nach China: Nvidia hat Bestellungen und Lizenzen für H200-Exporte

Nvidias CEO Jensen Huang hat auf der GTC 2026 geklärt, dass AI-Beschleuniger nun wirklich bald wieder nach China geliefert werden. Davon gesprochen wurde zuletzt bereits mehrfach, doch jetzt soll es wirklich wieder los gehen und zwar ganz schnell – aber nur für die ersten Kunden.

Wir haben Bestellungen und Lizenzen

„We have orders, we have licences,“ erklärte Nvidia CEO Jensen Huang im Rahmen einer Q&A-Runde mit Journalisten in San Jose, USA, bei der auch ComputerBase anwesend war. Bestellungen seien demnach von mehreren Kunden eingegangen und könnten auch bedient werden.

Ein Fragezeichen bleibt jedoch bei der Menge an verfügbaren Produkten, die Nvidia tatsächlich liefern kann. Denn Huang erklärte weiter, „we’re in the process of restarting production of H200 for China“. Demnach könnten erste Auslieferungen noch aus dem Lagerbestand erfolgen, andere Kunden müssten sich aber wohl gedulden, bis die Produktion nachgezogen hat. H200-Chips von Nvidia sind zwar noch in Produktion, allerdings in viel kleinerem Rahmen als Blackwell-Chips, die als Herzstück für AI-Beschleuniger (GB200/GB300) das Zepter nun fast vollständig übernommen haben.

Huang betonte bei der Ankündigung, dass der Hintergrund inzwischen ein anderer sei als noch vor Wochen. Nicht ohne Grund: Vor drei Wochen erklärte das Unternehmen im Rahmen des Quartalsberichts noch, dass man zwar „eine kleine Menge H200“ exportieren dürfe, aber erst einmal nicht mit Umsatz dadurch planen werde – das sieht jetzt wohl anders aus.

Viel Auf und Ab seit letztem Dezember

Bereits im Dezember 2025 hatte US-Präsident Trump in einem Posting auf seiner Social-Media-Plattform bestätigt, dass Nvidia wieder H200-Chips nach China liefern darf. Dafür muss China respektive Nvidia 25 Prozent Abgaben zahlen, was die Marge senkt, doch der Umsatz scheint wichtiger. Ebenfalls positiv: Dass das CUDA-Ökosystem in China weiter offiziell im AI-Umfeld genutzt wird.

Was folgte, war jedoch ein Auf und Ab. Chinesische Unternehmen wollten, der Staat jedoch nicht. Dann gab es anscheinend Auflagen, das Aus schien Ende Januar abgewendet. Nun soll es also wirklich losgehen, unter welchen Bedingungen genau, werden aber wohl erst die kommenden Wochen zeigen.

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA im Vorfeld und im Rahmen einer Veranstaltung des Herstellers in San Jose, Kalifornien erhalten. Die Kosten für An-, Abreise und fünf Hotelübernachtungen wurden vom Unternehmen getragen. Eine Einflussnahme des Herstellers oder eine Verpflichtung zur Berichterstattung bestand nicht. Die einzige Vorgabe aus dem NDA war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Nvidias Vera CPU im Detail

Vera ist Nvidias neue Datacenter-CPU für den Einsatz mit Rubin-GPU (als Vera Rubin) oder als eigenständige Lösung im Rack mit bis zu 256 Prozessoren. Im Rahmen der GTC 2026 hat Nvidia weitere technische Details zu Vera verraten: Vera hat mehr Kerne, unterstützt SMT, bietet größere Caches und nutzt schnelleren Speicher.

Nvidia Vera folgt auf die aktuelle Grace-CPU, die von Nvidia unter anderem als Single-Socket-Umsetzung Grace CPU C1, im Doppelpack als Grace CPU Superchip, oder im Zusammenspiel mit Blackwell-GPUs als Grace Blackwell (Ultra) angeboten wird.

Vera kommt auch im CPU-only-Rack

Vera soll im Laufe des zweiten Halbjahres 2026 an den Start gehen. Vorgesehen sind erneut unterschiedliche Konfigurationen, etwa in Kombination mit Rubin-GPUs, oder aber als reines CPU-Rack, das sich in Nvidias Referenz-Lösung mit bis zu 256 Prozessoren bestücken lässt. Partner wie HPE gehen sogar noch weiter und verbauen bis zu 640 Vera-CPUs in einem Server-Schrank.

88 Olympus-Kerne mit SMT

Vera macht einiges anders als Grace, wie eine technische Session zur GTC verdeutlichte. Zunächst einmal bietet Vera schlichtweg mehr Kerne als Grace: 88 statt 72. Es handelt es sich zudem nicht mehr um Neoverse-V2-Kerne von Arm, sondern um ein Custom-Design namens Olympus, dem die Architektur Arm v9.2 zugrunde liegt, auf der auch Neoverse-V3-Kerne basieren. Vera sei vollständig Arm-kompatibel, erklärt Nvidia.

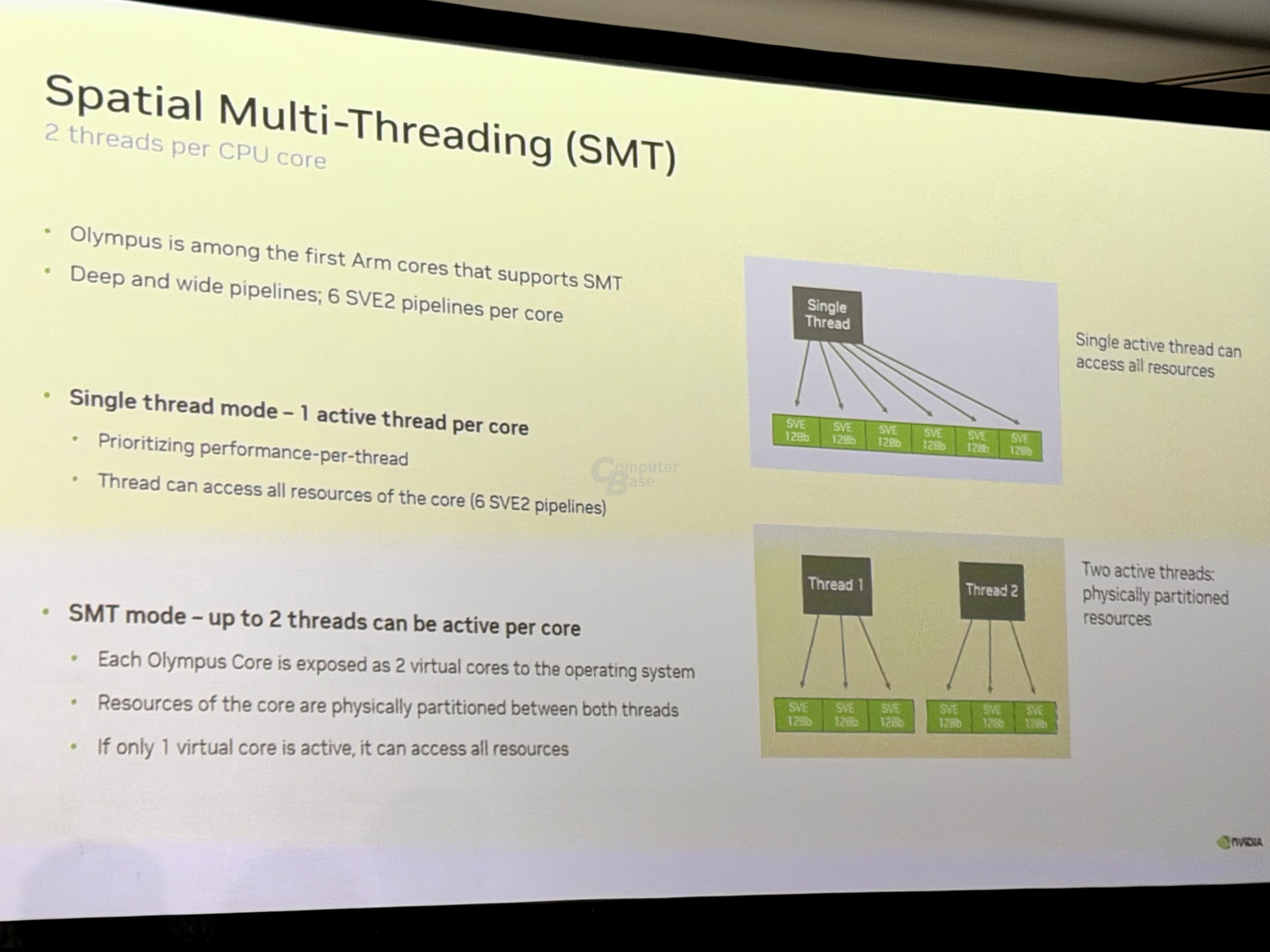

Es sind in Vera aber nicht nur 16 Kerne mehr verbaut, das Design bringt erstmals auch „Spatial Multi-Threading“ (SMT) ins Spiel, sodass 176 Threads verarbeitet werden können. Im Gegensatz zu anderen SMT-Verfahren wird aber nicht auf ein Time-Slicing gesetzt, sodass „A“ und „B“ im Wechsel ausgeführt werden, sondern Vera kann bei SMT tatsächlich zwei Threads parallel über die Pipelines des Kerns verteilen.

Single Thread Mode oder SMT Mode

Dabei lässt sich Vera in zwei Modi betreiben:

- Im Single Thread Mode gibt es maximal einen aktiven Thread pro Core. Dieser Thread kann auf alle Ressourcen des Cores zugreifen, zum Beispiel auf die sechs SVE2-Pipelines.

- Im SMT Mode können hingegen bis zu zwei Threads pro Core aktiv sein. Jeder Olympus-Kern wird gegenüber dem Betriebssystem als zwei virtuelle Kerne exponiert. Die Ressourcen des Cores werden in dieser Konfiguration physisch partitioniert und stehen beiden Threads in gleicher Anzahl zur Verfügung, also etwa drei SVE2-Pipelines pro Thread. Ist im SMT Mode allerdings nur ein Thread aktiv, kann dieser wieder auf alle Ressourcen zugreifen.

Olympus ist ein 10-wide Design mit FP8-Support

Der Olympus genannte Custom-Arm-Core von Nvidia ist ein „10-wide“ Decode-Design und ist damit deutlich breiter als Grace aufgebaut. Beim Decode werden die geladenen Maschinenbefehle in interne Steuer- und Mikrooperationen übersetzt, damit die Recheneinheiten verstehen, was konkret ausgeführt werden soll.

Nvidia hat zudem den L2-Cache verdoppelt, den L1D-Cache vergrößert, mehr Vector Pipelines integriert, FP8-Support hinzugefügt und das zuvor erläuterte SMT integriert. Die Vera-CPU ist die weltweit erste Arm-CPU, die FP8-Operationen unterstützt, also denselben Datentyp, wie ihn auch Nvidias GPUs unterstützen.

Arm MPAM hält Einzug

Das Design führt zudem Arm MPAM ein. MPAM ist eine Hardware-Erweiterung in modernen Arm-Prozessoren, die eine feingranulare Kontrolle über gemeinsam genutzte Ressourcen wie Cache und Speicherbandbreite ermöglicht. Sie erlaubt es, diese Ressourcen bestimmten Anwendungen, Prozessen oder virtuellen Maschinen gezielt zuzuweisen, zu begrenzen oder zu priorisieren.

Gleichzeitig kann MPAM überwachen, wie stark einzelne Workloads diese Ressourcen tatsächlich nutzen. Das ist besonders wichtig in Systemen mit vielen parallel laufenden Aufgaben (z. B. Cloud, Server oder AI), da so verhindert wird, dass einzelne Anwendungen den Speicher „überlasten“ und andere ausbremsen. Insgesamt verbessert MPAM also Isolation, Vorhersagbarkeit und Quality of Service im System.

Darf es von allem deutlich mehr sein?

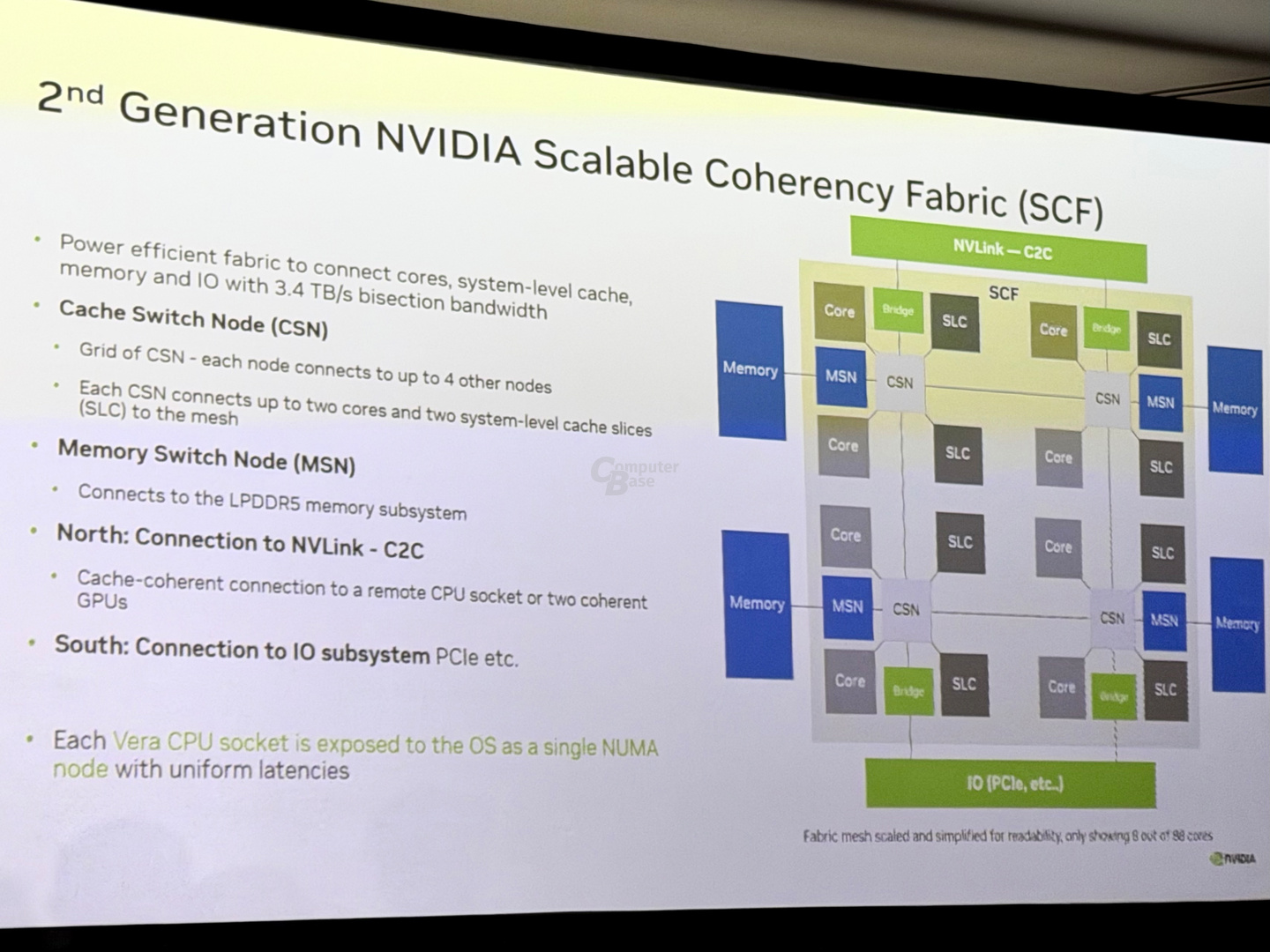

Vera ist auch über den Olympus-Kern hinaus ein mächtigerer Chip mit mehr und schnellerem Speicher. Dessen Maximum steigt von 480 GB LPDDR5X bei Grace auf jetzt 1,5 TB SOCAMM2-LPDDR5X. SOCAMM2 ist modular, sodass bei Speicher-Defekten nicht direkt ein Vera-Board ausgetauscht respektive aufwendig repariert werden muss. Auch bei der Speicherbandbreite, der NVLink-C2C-Bandbreite beim Einsatz von zwei CPUs, dem SLC sowie dem Scalable Coherency Fabric (SCF) und weiteren Aspekten legt Vera nach.

Fabric verbindet Nodes mit Cores, Caches und mehr

Über das Scalable Coherency Fabric werden die Cores, der SLC, der Speicher, NVLink und I/O mit 3,4 TB/s Bisektionsbandbreite angebunden. Das Fabric gliedert sich in die Cache Switch Nodes (CSN), von denen jeder Node mit bis zu vier weitere Nodes verbunden ist. Jeder CSN verbindet bis zu zwei Olympus-Kerne und zwei Slices des SLC mit dem Mesh. Angebunden wird an den CSN auch jeweils ein Memory Switch Node (MSN), der wiederum die Verbindung zum LPDDR5X-Speichersubsystem herstellt.

Über Brücken am Nord- und Südende des Chips erfolgt die Verbindung einerseits zum NVLink-C2C (Norden), um eine Vera-CPU mit einer weiteren zu verbinden. Zum anderen wird darüber die Verbindung zum I/O-Subsystem für PCIe (Süden) hergestellt.

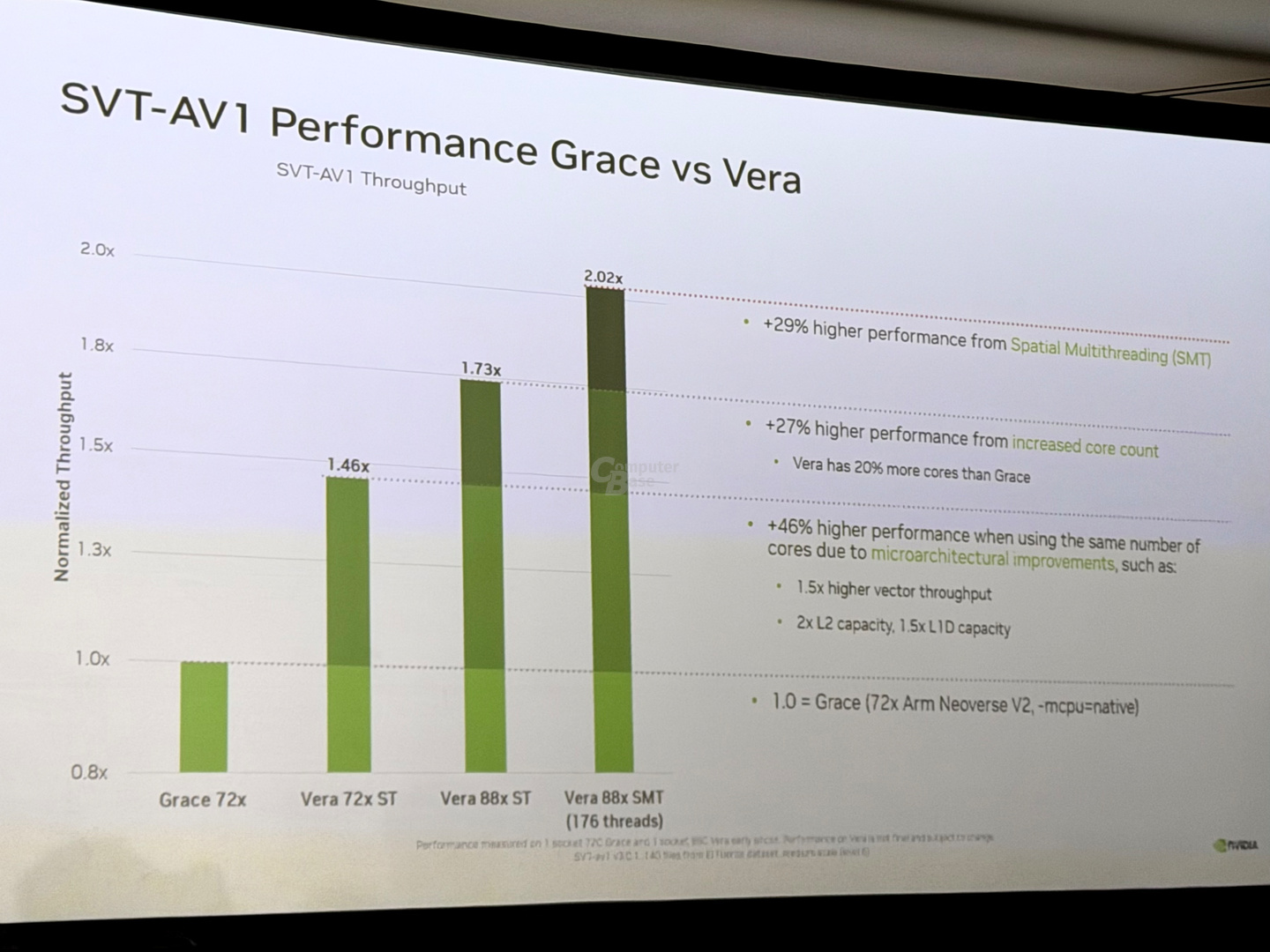

Vera im Benchmark gegenüber Grace

Um die Leistung von Vera gegenüber Grace zu verdeutlichen, hat Nvidia die Leistung im DCPerf Benchmark von Meta demonstriert. Dabei erfolgt das SVT-AV1-Encoding auf Multi-Core-CPUs mittels FFmpeg. DCPerf ahmt die Encoding-Pipeline von Instagram, Reels, Facebook Short Videos etc. nach. Als Datensatz wird der Open-Source-Film El Fuente von Netflix verwendet.

In diesem Benchmark erreicht Vera eine bis zu 2,02-fache Leistung gegenüber Grace. Das lässt sich folgendermaßen erklären: 46 Prozent mehr Leistung Im Vergleich zu Grace kommen zunächst einmal über die Verbesserungen der Mikroarchitektur von Olympus. Der höhere Vektor-Durchsatz und die größeren Caches tragen ihren Teil dazu bei. Weitere 27 Prozent kommen über die 27 Prozent mehr Kerne von Vera hinzu. Weitere 29 Prozent lassen sich mit SMT hinzufügen.

Taktraten waren kein Thema

Nvidia vergleicht dabei nach dem Ansatz „ISO Core“, also mit gleicher Anzahl von Kernen, obwohl Grace 72 Kerne und Vera eigentlich 88 Kerne bietet. Ob der Vergleich auch nach „ISO Clock“ erfolgt ist, wollten die Moderatoren der Session nicht offenlegen. Taktraten blieben ebenfalls unter Verschluss, sie sollen sich aber nicht stark voneinander unterscheiden. Bis zu 3,44 GHz sind es bei Grace.

TDP liegt bei 450 Watt

Zum Abschluss der Session folgte im Raum noch eine letzte Frage zum Verbrauch von Vera. Nvidia gibt bis zu 450 Watt pro Sockel an. Bei Grace sollen es inklusive Speicher 500 Watt sein. Vera könne mit einer TDP von minimal 250 Watt konfiguriert werden.

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA im Vorfeld und im Rahmen einer Veranstaltung des Herstellers in San Jose, Kalifornien erhalten. Die Kosten für An-, Abreise und fünf Hotelübernachtungen wurden vom Unternehmen getragen. Eine Einflussnahme des Herstellers oder eine Verpflichtung zur Berichterstattung bestand nicht. Die einzige Vorgabe aus dem NDA war der frühestmögliche Veröffentlichungszeitpunkt.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.

Apps & Mobile Entwicklung

Verkaufsverbot für Kopfhörer von Sennheiser und Apple

Erst wurde gewarnt, jetzt wird gehandelt. Kopfhörer vieler Hersteller, darunter auch von Sennheiser und Apple, werden nicht mehr verkauft. Der Grund ist erschreckend, aber nachvollziehbar. Noch kein Verkaufsverbot, aber eine Warnung gibt es auch zu Kopfhörern von Bose, JBL und Sony.

Im vergangenen Jahr wurden in Deutschland rund 15 Millionen Kopfhörer verkauft. In-Ear, Over-Ear, On-Ear. Besonders gefragt: Modelle mit Noise Cancelling und ohne Kabel. Die beliebtesten Marken heißen Apple, Sony, JBL – aber auch Bose, Samsung, Sennheiser und Panasonic. Kopfhörer sind längst im Alltag angekommen. Im Schnitt tragen Nutzer sie zweieinhalb bis drei Stunden am Tag, auf dem Weg zur Arbeit, beim Arbeiten, danach beim Sport und im Bett beim Einschlafen. Musik, Podcasts, Meetings, Meeresrauschen – die Ohren haben kaum noch Feierabend. Und dann kommt die Wissenschaft und sagt: Es ist noch schlimmer als gedacht.

Kopfhörer vieler namhafter Hersteller haben ein Problem

Lange galt die Lautstärke als Hauptproblem. Zu laut, zu lange, Hörschaden. Das war wenigstens simpel. Jetzt wird es komplizierter, weil es nicht nur darum geht, was man hört, sondern womit man es hört. Forscher des Projekts ToxFree LIFE for All haben 81 Kopfhörermodelle untersucht. Von Amazon, von Onlineplattformen wie Shein und Temu, billig, teuer, alles dabei. Das Ergebnis ist eindeutig: In allen getesteten Geräten stecken gesundheitsschädliche Chemikalien. Auch bei den großen Namen, auch bei den teuren.

Die Stoffe heißen Bisphenol A, Bisphenol S, Phthalate, chlorierte Paraffine und Flammschutzmittel. Sie stecken im Kunststoff von Polstern und Gehäusen, genau dort, wo Haut stundenlang Kontakt mit dem Kopfhörer hat. Laut den Forschern können diese Stoffe in den Körper übergehen. Besonders effizient funktioniert das beim Sport, wenn Wärme, Schweiß und Reibung zusammenkommen.

→ Zurück zum Kabel: Warum ich den Bluetooth-Kopfhörern den Rücken kehre

Was diese Stoffe im Körper anrichten können, liest sich wie die Packungsbeilage eines giftigen Antibiotikums: Krebsverdacht, Störungen der neurologischen Entwicklung, ein Hormonsystem, das plötzlich improvisieren muss. Bisphenole wirken wie Östrogen. Das kann bei Männern zu unerwünschten Effekten führen, bei Mädchen zu verfrühter Pubertät und allgemein zu Fruchtbarkeitsproblemen. Besonders heikel ist das für Jugendliche und junge Erwachsene, deren Körper ohnehin im Umbau sind. Wer täglich mehrere Stunden Kopfhörer trägt, ist ebendiesen Risiken ausgesetzt.

Verkaufsverbot greift

Und jetzt reagiert der Markt, zumindest stellenweise. In den Niederlanden wurden erste Modelle aus dem Verkauf genommen, unter anderem bei der lokalen Tochter von MediaMarkt. Betroffen sind laut Berichten unter anderem die beliebten Sennheiser Momentum Wireless 4 und die Beats Solo Buds – ein Modell, der Marke von Apple.

- Razer Kraken V3

- HyperX Cloud III Gaming-Headset

- Enjoy Music M6pop Katzenohr-Kopfhörer

- Sennheiser Momentum Wireless 4

- Haylou S35 ANC Bluetooth-Kopfhörer

- Logitech G733 Lightspeed Wireless RGB Gaming-Headset

- Philips SHD8850

- Beats Solo Buds

- Fresh ‘n Rebel Clam Junior

- Hema Nijntje / Miffy

- Action / OTL Technologies Super Mario

→ Hört man wirklich den Unterschied? Die Wahrheit über teure Kopfhörer

Die gesamte Liste (PDF) der Kopfhörer, die mit giftigen Zusätzen im Lieferumfang kommen, zeigt: Es müssten noch viele Modelle mehr aus dem Verkehr gezogen werden. Etwa die Samsung Galaxy Buds3 Pro, der Verkaufsschlager Sony WF-1000XM5 oder die Bose QuietComfort Headphones. Ob der Verkaufsstopp in den Niederlanden nur der Anfang einer Verbotswelle ist, bleibt indes abzuwarten.

Apps & Mobile Entwicklung

Hauptlieferant für AMD: Samsung liefert HBM für Instinct MI455X und DRAM für Venice

Schon bei der aktuellen Generation AI-Beschleuniger liefert Samsung den HBM, die Zusammenarbeit setzt AMD auch bei Instinct MI455X fort. Laut Mitteilung der beiden Unternehmen am heutigen Tage wird Samsung für HBM4 der Hauptlieferant für AMD sein.

Während Samsung im letzten Jahr bei Nvidia und der Zertifizierung von Samsung-HBM3e bei Blackwell-Lösungen noch Probleme hatte, wurden AMD Instinct MI350X und MI355X längst mit HBM3e von Samsung bestückt und verkauft. Bereits damals hatte es den Anschein, dass Samsungs Speicher gut genug war, Blackwell jedoch spezielle Anforderungen hatte, die Samsung nicht erfüllen konnte. Das wiederum war für AMD ein Gewinn, so konnten sie ausreichende Kapazitäten erhalten.

Bei HBM4 wird AMD auf Nummer sicher gehen. Und so ist CEO Lisa Su nach Südkorea gereist und hat dort persönlich die Speicherfertigung in einer „Window Tour“ – also nicht direkt im Reinraum und deshalb ohne Bunny Suit – in Pyeongtaek besucht. Es folgte die Unterzeichnung eines Memorandum of Understanding (MOU) für die verstärkte zukünftige Zusammenarbeit, was in Lieferungen von HBM4 und DRAM für Zen-6-Profisysteme mit AMD Epyc Venice münden wird. Aber auch kommende Speichergenerationen sollen berücksichtigt sein, ohne diese genauer zu benennen.

Powering the next generation of AI infrastructure requires deep collaboration across the industry. We are thrilled to expand our work with Samsung, bringing together their leadership in advanced memory with our Instinct GPUs, EPYC CPUs and rack-scale platforms. Integration across the full computing stack, from silicon to system to rack, is essential to accelerating AI innovation that translates into real-world impact at scale.

Lisa Su, AMD-CEO

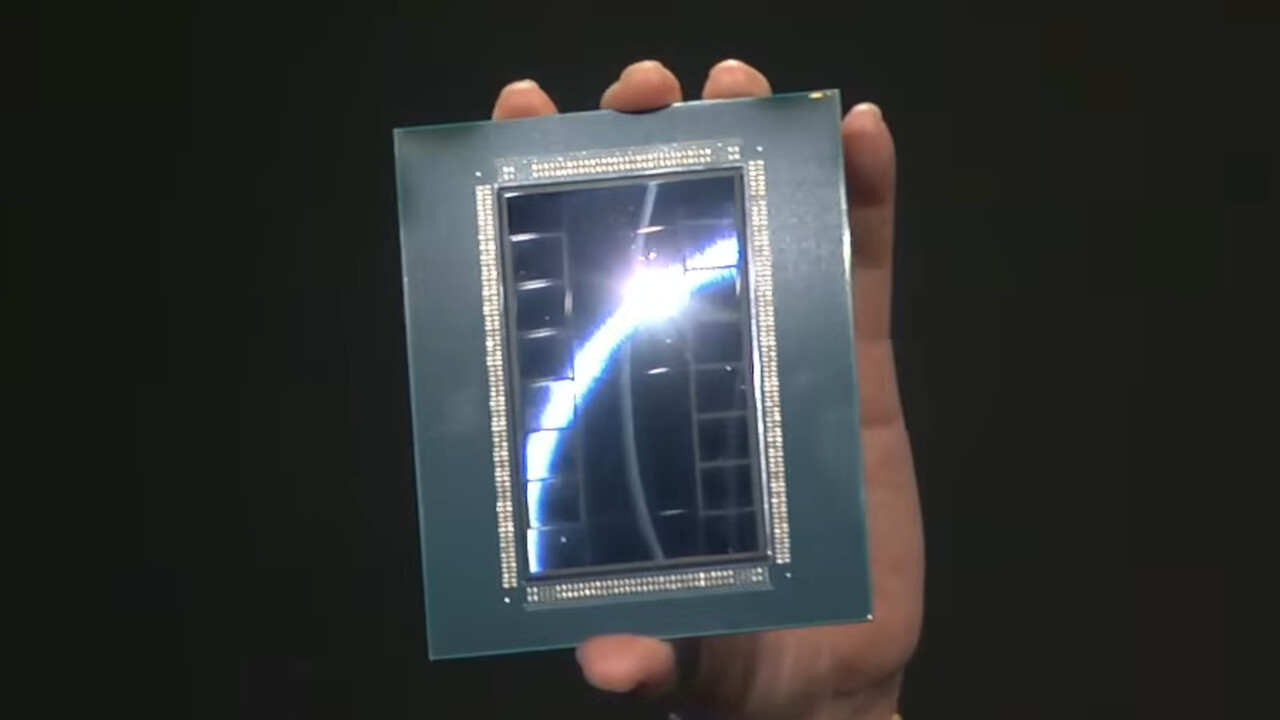

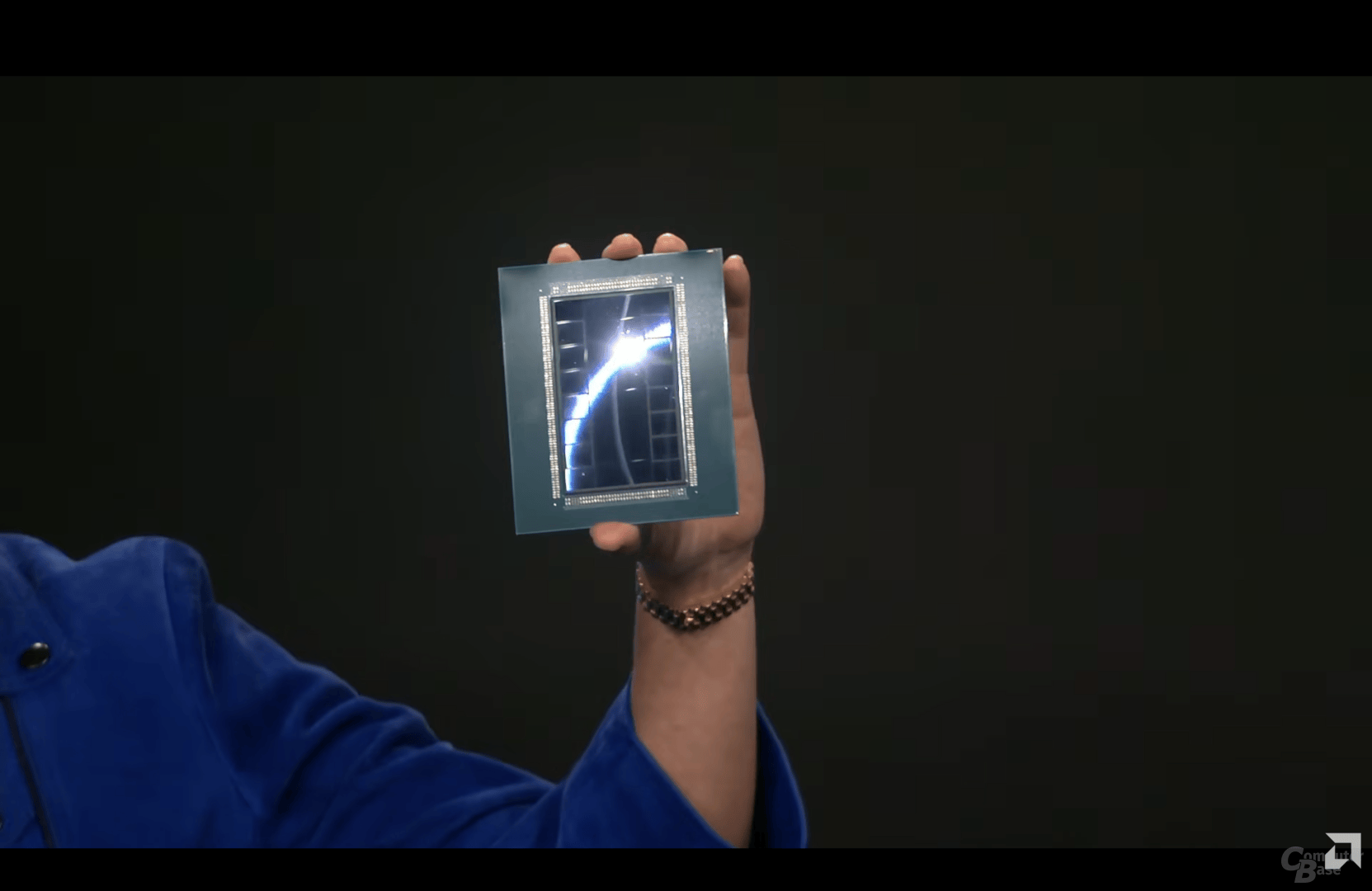

Zur CES 2026 hatte AMD Instinct MI455X erstmals „nackt“ gezeigt, also ohne aufgesetzten Heatspreader oder Kühler. Leicht erkennbar waren dabei die jeweils sechs HBM4-Chips an der Außenseite, in der Mitte sitzen die ebenfalls direkt miteinander verbundenen GPU-Chiplets.

Über Foundry-Geschäft wird auch beraten

Die Zusammenarbeit könnte in Zukunft aber auch noch weiter gehen. Denn AMD und Samsung wollten auch über Möglichkeiten des Foundry-Geschäfts reden. Samsung könnte in Zukunft also wieder Produkte für AMD fertigen. Um was genau es da gehen könnte, ist allerdings völlig offen. Gerüchte in dieser Richtung gibt es zwar immer wieder, Resultate haben sich bislang aber nicht gezeigt. Samsung Foundry kämpft in den letzten Jahren mit dem Anschluss, bei 2 nm könnte er erstmals wieder gelingen. Da alle AI-Firmen nach High-End-Fertigungskapazität lechzen, ergibt sich für Samsung hier eventuell eine Chance.

The two companies will also discuss opportunities for foundry partnership, through which Samsung would provide foundry services for next-generation AMD products.

Samsung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 2 Wochen

Social Mediavor 2 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 4 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenDie meistgehörten Gastfolgen 2025 im Feed & Fudder Podcast – Social Media, Recruiting und Karriere-Insights

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenÜber 220 m³ Fläche: Neuer Satellit von AST SpaceMobile ist noch größer