Apps & Mobile Entwicklung

Amazon: KI-Coding-Bots verursachten AWS-Ausfälle – ComputerBase

Zwei Ausfälle in Amazons Cloud-Sparte AWS in den letzten Monaten sollen von internen KI-Entwicklertools ausgelöst worden sein, berichtet die Financial Times (via Golem). Intern bekräftigt das die Zweifel an den Coding-Assistenten.

Mitte Dezember kam es dem Bericht zufolge zu einer 13-stündigen Störung in einem System, weil der interne Coding-Agent Kiro AI autonom eine Umgebung gelöscht und neu erstellt hat. Laut Amazon führte der Fehler aber zu keinem großen Ausfall. Betroffen war ausschließlich ein einzelner Dienst in Teilen von China.

Bei Kiro AI handelt es sich um einen modernen Coding-Assistenten, der seit Juli in AWS verfügbar ist. Entwickler sollen diesen nutzen, um die Software-Entwicklung zu automatisieren.

Zuvor gab es bereits den Chatbot Amazon Q Developer, den Entwickler verwenden sollten, um Code zu schreiben. Dieser Assistent soll laut den Quellen der Financial Times ebenfalls einen Ausfall verursacht haben. Laut Amazon hatte der Vorfall aber keine Auswirkungen auf AWS-Kunden.

„Es waren Fehler, kein KI-Fehler“

Amazon erklärte auf Anfrage der Financial Times, in beiden Fällen habe es sich „um Fehler, nicht KI-Fehler“ gehandelt. Es sei Zufall gewesen, dass KI-Tools involviert waren. Menschliche Entwickler hätten diese Vorfälle ebenfalls verursachen können. Generell habe man bislang noch keine Hinweise, dass es mit den Coding-Assistenten mehr Fehler gebe.

Konkret bei Kiro AI sei etwa ein Problem gewesen, dass der Coding-Assistent zu weitreichende Berechtigungen hatte. Bei der Fehleranalyse gehe es also um die Zugriffsrechte, die Menschen erteilt haben und nicht um die autonom arbeitende KI.

Nach dem Dezember-Vorfall hat AWS daher weitere Sicherheitsvorgaben implementiert. Dazu zählen etwa verpflichtende Peer-Review-Verfahren und Mitarbeiterschulungen.

Big Tech forciert AI-Coding

Die Big-Tech-Konzerne arbeiten seit Monaten und Jahren daran, möglichst viel Code von den Coding-Assistenten produzieren zu lassen. Microsofts Chef Satya Nadella verkündete schon im Frühjahr 2025, dass bereits zu diesem Zeitpunkt 20 bis 30 Prozent des Microsoft-Codes KI-generiert seien – und der Wert soll seitdem nochmals deutlich gestiegen sein. Ähnlich äußerte sich Google und ebenso Meta-Chef Mark Zuckerberg.

Amazon hat laut dem Bericht das interne Ziel ausgegeben, dass 80 Prozent der Entwickler mindestens einmal pro Woche die Coding-Assistenten nutzen sollen. Laut den Quellen der Financial Times existiert aber eine gewisse Skepsis, einige Mitarbeiter sind besorgt angesichts des Fehlerpotenzials, das von den autonomen Assistenten ausgeht.

Apps & Mobile Entwicklung

Mehrere Gigawatt Rechenleistung: Anthropic baut Partnerschaft mit Google und Broadcom aus

Anthropic sucht weiterhin nach Wegen, die eigenen Kapazitätsengpässe zu beheben. Dazu hat das Unternehmen nun eine Partnerschaft mit Google und Broadcom angekündigt, die mehrere Gigawatt an TPU-Kapazität ermöglichen soll. Davon könnten auch Drittanbieter-Agenten profitieren, die zuletzt noch blockiert worden waren.

Knappe Kapazitäten führen zum Ausschluss von externen Agenten

Diese Engpässe waren von Kunden von Claude Code oder Cowork insbesondere zu Stoßzeiten bemerkt und kritisiert worden, weshalb sich Anthropic zu dem Schritt gezwungen sah, seine KI-Dienste für Drittanbieter-Tools wie OpenClaw zu sperren. Laut Claude-Code-Entwickler Boris Cherny seien Anthropics Kapazitäten nicht auf den Ansturm solcher Drittanbieter-Tools ausgelegt.

Mehr Rechenleistung in den USA ab nächstem Jahr

Mit der nun mit den Konzerngrößen Google und Broadcom geschlossenen Partnerschaft soll diesem Engpass entgegengewirkt werden. Die unterzeichnete Vereinbarung sieht vor, voraussichtlich ab 2027 mehrere „Gigawatt TPU-Kapazitäten der nächsten Generation“ aufzubauen, wie Anthropic in einem veröffentlichten Blog-Beitrag erklärt. Mit dieser Maßnahme soll zu diesem Zeitpunkt der Ausbau der eigenen Recheninfrastruktur beginnen, um die weltweit gestiegene Nachfrage nach KI-Diensten des Unternehmens bedienen zu können. „Wir bauen die Kapazitäten auf, die erforderlich sind, um dem exponentiellen Wachstum unserer Kundenbasis gerecht zu werden, so Krishna Rao, CFO bei Anthropic, im Beitrag.

Der Großteil der neuen Kapazitäten soll in den Vereinigten Staaten entstehen und damit die im November 2025 angekündigten Investitionen von 50 Milliarden US-Dollar in den Ausbau der amerikanischen Recheninfrastruktur unterstützen. Anthropic will dabei weiterhin auf eine hohe Diversität setzen, bei der verschiedene KI-Hardware wie AWS Trainium, Google TPU und NVIDIA-GPU zum Einsatz kommen, sodass für unterschiedliche Anforderungen die jeweils passende Technologie genutzt wird. Diese Vielfalt an Plattformen soll nicht nur die Leistung steigern, sondern auch die Ausfallsicherheit erhöhen, insbesondere für Kunden, die bei kritischen Anwendungen auf Claude angewiesen sind.

Anthropic will breit aufgestellt bleiben

Amazon soll trotz der neu geschlossenen Partnerschaft weiterhin sowohl primärer Cloud-Anbieter als auch Trainingspartner von Anthropic bleiben, zugleich soll die enge Zusammenarbeit mit AWS am Projekt Rainier fortgeführt werden. Claude soll dabei allerdings weiterhin das einzige wegweisende KI-Modell bleiben, das Kunden auf allen drei der weltweit größten Cloud-Plattformen zur Verfügung steht: Amazon Web Services (Bedrock), Google Cloud (Vertex AI) und Microsoft Azure (Foundry).

Erfolg fordert Maßnahmen

Diese Investitionen gelten auch als notwendig, da sich der Zustrom neuer Kunden im Jahr 2026 weiter beschleunigt hat. Der Run-Rate-Umsatz von Anthropic – eine betriebswirtschaftliche Kennzahl, die den aktuellen Umsatz eines Unternehmens auf ein volles Jahr hochrechnet – lag Ende 2025 bei rund 9 Milliarden US-Dollar und soll im laufenden Jahr auf 30 Milliarden US-Dollar ansteigen. Mit der Finanzierungsrunde im Februar 2026 hatte Anthropic mitgeteilt, dass rund 500 Geschäftskunden jeweils mehr als eine Million US-Dollar pro Jahr ausgeben; mittlerweile hat sich diese Zahl innerhalb von weniger als zwei Monaten auf 1.000 verdoppelt.

Apps & Mobile Entwicklung

Epub- und PDF-Format: Amazon beginnt, DRM-freie E-Books zu kennzeichnen

Amazon hat zu Jahresbeginn eine regelrechte Kehrtwende vollzogen und bietet digitale Bücher nun auch im Epub- und PDF-Format sowie ohne DRM an. Inzwischen hat das Unternehmen zudem damit begonnen, entsprechende Titel im Sortiment sichtbar und nachvollziehbar zu kennzeichnen – zumindest in den USA.

Amazon geht zumindest kleinen Schritt auf Kunden zu

Dieser Schritt steht im deutlichen Kontrast zu den Veränderungen, die Kunden bei Amazon im Bereich digitaler Bücher in jüngerer Zeit hinnehmen mussten. So stellte das Unternehmen im Februar des vergangenen Jahres zunächst den Download von E-Books ein, bevor im September ein neues DRM-System eingeführt wurde. Vor rund einem Monat folgten schließlich Berichte, wonach Amazon sein DRM-System sogar ohne Firmware-Update auf Kindle-Readern weiter verschärft habe.

Vor diesem Hintergrund wirkt ein Bericht von Good e-Reader beinahe wie ein Entgegenkommen des Unternehmens. Demnach hat Amazon damit begonnen, digitale Bücher im Epub- und PDF-Format ohne digitales Rechte-Management entsprechend zu kennzeichnen. Derzeit scheint diese Praxis jedoch ausschließlich auf die USA beschränkt zu sein, zumindest konnten Stichproben der Redaktion im deutschsprachigen Angebot keine entsprechenden Hinweise zutage fördern.

DRM-freie Bücher ab sofort mit entsprechendem Hinweis

Entsprechende Titel sind neuerdings mit dem Zusatz „At the Publisher’s request, this title is being sold without Digital Rights Management Software (DRM) applied“ versehen. Darüber hinaus findet sich an anderer Stelle in den Produktdetails ein weiterer Hinweis, der ebenfalls auf das fehlende DRM-System aufmerksam macht. So wird bei diesen Büchern angegeben, dass die gleichzeitige Nutzung auf mehreren Geräten unbegrenzt möglich ist, ein Umstand, der üblicherweise durch DRM eingeschränkt wird. Laut Bericht ist die Zahl entsprechender Titel bislang noch gering und beschränkt sich auf wenige Verlage oder Plattformen, es gilt jedoch als wahrscheinlich, dass weitere Anbieter folgen werden.

DRM-freie Bücher bislang nur auf wenige Formate beschränkt

Seit Ende des vergangenen Jahres liegt die Entscheidung bei Autoren und Verlagen, ob E-Books ohne Kopierschutz angeboten werden sollen. In diesem Fall stehen die Titel allerdings ausschließlich im Epub- oder PDF-Format zur Verfügung. Ob Amazon sein restriktives DRM auch für die eigenen Formate AZW beziehungsweise KFX entsprechend anpassen wird, ist bislang nicht bekannt.

Apps & Mobile Entwicklung

Mehr EUV-Systeme von ASML: SK Hynix zahlt Premium-Preise für extra schnelle Lieferung

Die Bestellung in Milliardenhöhe von SK Hynix bei ASML vor wenigen Tagen und dabei anvisierten Lieferzeiten nur bis Ende 2027 warf einige Fragen auf, wie das denn umgesetzt werden kann. Ein Teil der Fragestellung wird wohl durch höhere Preise beantwortet werden.

Ende März kündigte SK Hynix offiziell an, für 6,913 Milliarden Euro bei ASML EUV-Systeme zu kaufen. Vor allem der dabei anvisierte Zeitraum überraschte, ist er doch ein ziemlich kurzer. Denn pro Jahr baut ASML nicht einmal 50 EUV-Systeme – zuletzt waren es im Jahr 2024 44 Systeme und 2025 48 Systeme – deren Stückpreis zuletzt jedoch deutlich angestiegen sein soll. Es waren vor einigen Jahren wohl zum Auftakt nur 140 Millionen Euro pro System, dann 160 Millionen, 180 Millionen und nun sollen es wohl 200 Millionen Euro und mehr sein.

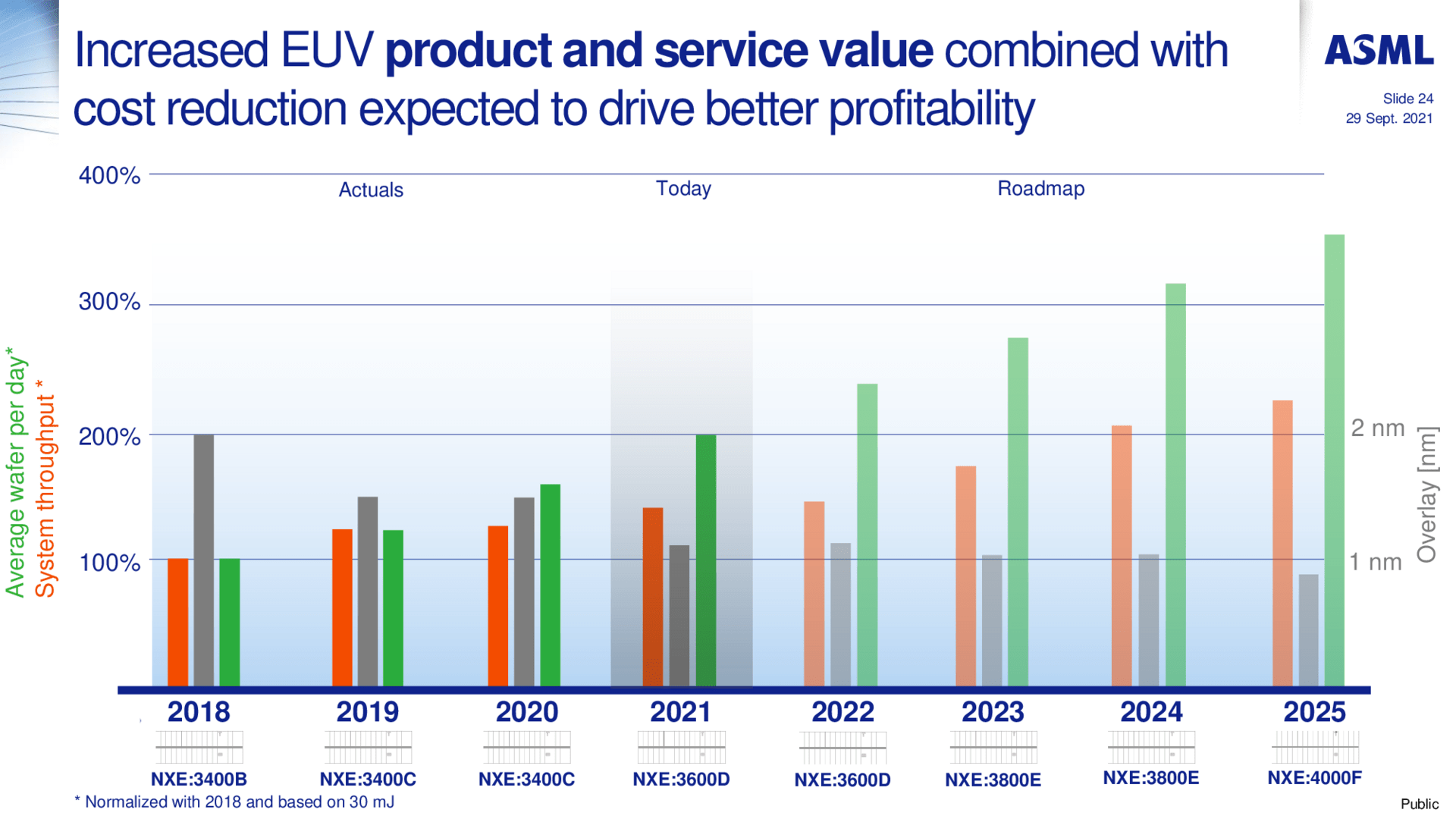

EUV-Scanner werden immer besser

Der höhere Preis begründet sich dabei aber nicht nur in den gestiegenen Materialkosten und sonstigen Veränderungen im Markt, sondern vor allem auch in der Aufwertung der Maschinen. Ein modernster Twinscan NXE:3800E, wie das Flaggschiff der EUV-Systeme heißt, belichtet heutzutage viel mehr Wafer als die ersten Systeme dieser Baureihe. Die Produktivität wurde zuletzt auf über 220 Wafer pro Stunde gesteigert, ein NXE:3400C aus dem Jahr 2020 schaffte kaum 135 Wafer die Stunde.

Wie üblich bei ASML können die Systeme auch im Einsatz aufgewertet werden, in Zukunft soll die Produktivität weiter steigen (und vermutlich auch der Preis).

Südkoreanische Medien berichten, dass der Preis pro System nun sogar bei umgerechnet 230 Millionen Euro liegen könnte. Hinzu kommt nun angesichts des sehr kurzen Zeitfensters der Lieferungen, dass SK Hynix wohl einen Aufschlag von 15 bis 20 Prozent zahlen könnte, was zum Teil jedoch damit verrechnet wird, dass es bei Großbestellungen gewisse Rabatte gibt. So etwas ist in der Halbleiterindustrie nichts außergewöhnliches, auch die Chip-Hersteller verkaufen gern Premium-Slots in der Fertigung zu höheren Preisen – der Kunde bekommt dafür seine Produkte früher.

High-NA-EUV in der Erprobung

Am Ende wird damit gerechnet, dass SK Hynix wohl rund 20 EUV-Systeme abnehmen wird. High-NA-EUV-Scanner sollen letztlich kein Bestandteil dieser Bestellung sein, einen davon nutzt SK Hynix in der aktuellen Ausbaustufe bereits in der Erprobung.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenX3D² bestätigt: Der AMD Ryzen 9 9950X3D2 mit doppeltem 3D V-Cache kommt!

-

Entwicklung & Codevor 4 Wochen

Entwicklung & Codevor 4 WochenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB