Künstliche Intelligenz

GenAI im Unternehmen: Das bestehende .NET-Fundament verwenden

Echten Nutzen bringt generative KI nicht bei individuellen Experimenten und Prototyping, sondern dann, wenn bestehende Softwareprodukte, Plattformen und Geschäftsprozesse gezielt durch GenAI erweitert werden.

Weiterlesen nach der Anzeige

Rainer Stropek ist IT-Unternehmer, Softwareentwickler, Trainer, Autor und Vortragender im Microsoft-Umfeld. Er ist seit 2010 MVP für Microsoft Azure und entwickelt mit seinem Team die Software Time Cockpit.

Oft bilden hier C# und .NET das Fundament zahlreicher ERP-naher Systeme, Individualanwendungen und Standardprodukte. Rund um diese Plattform existieren umfangreiches Know-how, stabile Build- und Deployment-Pipelines sowie erprobte Betriebs- und Sicherheitskonzepte. Diese Investitionen sind langfristig angelegt und lassen sich nicht ohne Weiteres ersetzen.

Statt also komplette Systeme für GenAI neu zu entwickeln, sollen bestehende Anwendungen durch Assistenzfunktionen, kontextbezogene Unterstützung, teilautomatisierte Workflows oder Copilot-ähnliche Erweiterungen intelligenter werden. Dafür müssen Large Language Models (LLMs) nahtlos in bestehende Architekturen integrierbar sein.

Der Kontext zählt: GenAI als Experiment oder im Produktiveinsatz

Hier zeigt sich der Unterschied zwischen Experiment und Produktivsystem. Ein Proof of Concept lässt sich schnell in Python umsetzen. Für produktive Systeme zählen jedoch andere Kriterien: Integration in bestehende Authentifizierungsmechanismen, Zugriff auf interne Services und Datenbanken, Wiederverwendung bestehender Bibliotheken, sauberes Logging, reproduzierbare Builds und klar geregelter Betrieb. Jede zusätzliche Sprache und jede neue Toolchain erhöhen die Komplexität und damit Aufwand und Risiko.

Aus dieser Perspektive ist .NET für GenAI-Anwendungen hochrelevant. Nicht, weil .NET grundsätzlich besser für KI geeignet wäre, sondern weil es den Übergang vom Experiment zur produktiven Anwendung deutlich vereinfacht. Bestehende Teams können mit bekannten Werkzeugen arbeiten, vorhandene Infrastruktur bleibt nutzbar, Governance- und Sicherheitsanforderungen lassen sich leichter einhalten.

Gleichzeitig gilt: .NET ist selten die erste Wahl für KI-nahe Forschung, Modelltraining oder frühe Exploration. In diesen Bereichen dominieren Python und zunehmend auch TypeScript. Neue Frameworks und APIs erscheinen dafür meist zuerst.

Weiterlesen nach der Anzeige

Für produktive GenAI-Systeme in Unternehmen hingegen ist .NET häufig die naheliegende Plattform, vorausgesetzt, geeignete SDKs stehen zur Verfügung. Niemand möchte auf Protokollebene mit HTTP-Requests, JSON-Parsing und asynchronen Event-Streams arbeiten, nur um ein LLM anzubinden.

Gut gepflegte .NET-SDKs sind deshalb kein Luxus, sondern ein Enablement-Faktor. Sie bestimmen, ob bestehende Entwicklungsteams GenAI schnell, sicher und wartbar integrieren können oder ob unnötige Reibungsverluste entstehen. Wie gut die aktuelle SDK-Landschaft diesen Anspruch heute erfüllt, zeigt der Blick auf die verfügbaren Anbieter und Abstraktionen.

Die SDK-Landschaft für Large Language Models aus .NET-Sicht

Wer ein LLM mit .NET nutzen möchte, trifft heute auf eine deutlich vielfältigere SDK-Landschaft als noch vor einem Jahr. Doch nicht alle verfügbaren SDKs sind gleichwertig und nicht jedes eignet sich für produktive Anwendungen.

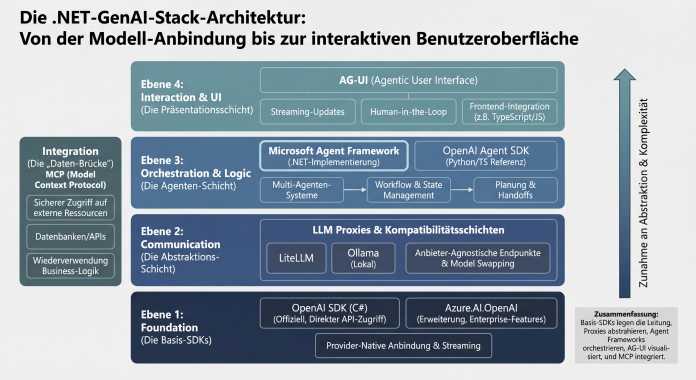

Die folgende Abbildung stellt den Zusammenhang zwischen Basis-SDKs, LLM-Proxies, Agenten-Schicht, Präsentationsschicht und MCP dar. Auf diese Punkte gehen die folgenden Kapitel genauer ein. Dabei beschäftigt sich der Artikel insbesondere damit, wie gut die SDK-Landschaft aus .NET-Sicht aufgestellt ist.

Verortung von Basis-SDKs, LLM-Proxies, Agenten-Schicht, Präsentationsschicht und MCP.

Lange Zeit waren offizielle SDKs für Large Language Models fast ausschließlich für Python und TypeScript verfügbar. Das beginnt sich zu ändern. Inzwischen stellen mehrere große Modellanbieter .NET-SDKs bereit, die sich für produktive Anwendungen eignen.

Die ersten ernstzunehmenden C#-SDKs für die OpenAI-API entstanden nicht direkt bei OpenAI selbst, sondern bei Microsoft als Teil der engen strategischen Partnerschaft zwischen beiden Unternehmen. Sie wiesen jedoch noch Schwächen auf. Nach einer Übergangsphase übernahm OpenAI selbst die Verantwortung. Heute wird das offizielle C#-SDK direkt von OpenAI gepflegt und als reguläres NuGet-Paket veröffentlicht. Microsoft stellt ergänzend ein begleitendes Paket bereit. Es erleichtert unter anderem Authentifizierung, Konfiguration und Integration mit OpenAI in Azure Foundry, ist jedoch optional. Die Kernfunktionalität für den Zugriff auf OpenAI-Modelle liegt heute eindeutig im offiziellen OpenAI-SDK selbst.

Anthropic stellt ein offizielles C#-SDK bereit, das aktuell noch als Beta gekennzeichnet ist, jedoch bereits gut nutzbar ist. Google bietet mit seinem GenAI-SDK eine offizielle .NET-Anbindung für Gemini-Modelle, sowohl für Google AI als auch für Vertex AI. Auch für andere LLM-Anbieter existieren heute offizielle, vom Hersteller gepflegte .NET-SDKs.

Die größte Reife und Verbreitung besitzt aber das OpenAI-SDK. Das zugehörige GitHub-Repository verzeichnet mehrere Tausend Sterne und das NuGet-Paket kommt auf fast 35 Millionen Downloads.

Neben den offiziellen SDKs existiert eine Vielzahl an Community- und Open-Source-SDKs. Eine besondere Rolle spielt hier das Projekt tryAGI, das auf Basis von OpenAI-Spezifikationen systematisch C#-SDKs für eine Vielzahl von LLM-Anbietern generiert.

Auf diese Weise stehen für viele Modelle SDKs zur Verfügung, für die es keine offiziellen .NET-Bibliotheken gibt, darunter auch Anbieter wie Mistral und Plattformen wie Ollama. Der Ansatz ist pragmatisch: Die SDKs sind konsistent aufgebaut, schnell verfügbar und decken in der Regel die grundlegenden API-Funktionen zuverlässig ab. Allerdings haben sie Grenzen: Generierte SDKs folgen relativ streng der jeweiligen API-Spezifikation mit keinen oder begrenzten manuellen Anpassungen, weshalb fortgeschrittene API-Funktionen manchmal nur holprig oder gar nicht verfügbar sind. Auch die langfristige Wartung hängt nicht vom Modellanbieter selbst ab, sondern vom Engagement der Community.

Für einfache Anwendungsfälle sind solche SDKs oft vollkommen ausreichend. Für komplexere, interaktive oder langfristig betriebene Systeme sollte man jedoch genau prüfen, ob ein Community-SDK den eigenen Anforderungen genügt.

Proxies und Kompatibilitätsschichten: Abstraktion statt Anbieterbindung

Eine weitere Kategorie bilden Proxies und Kompatibilitätsschichten, die versuchen, unterschiedliche Modellanbieter hinter einer einheitlichen API zu bündeln. Ein prominentes Beispiel dafür ist LiteLLM, das eine OpenAI-kompatible API bereitstellt und Anfragen an eine Vielzahl von Modellen weiterleitet.

Für .NET-Entwicklerinnen und -Entwickler kann dieser Ansatz attraktiv sein, da sie OpenAI-SDKs verwenden können. Oft genügt es, die Base-URL zu ändern und andere Modellnamen zu konfigurieren. Ähnlich verhält es sich bei lokal betriebenen Modellen über Ollama, das ebenfalls OpenAI-kompatible Endpoints bereitstellt.

Diese Abstraktion erleichtert den Wechsel zwischen Modellen und Anbietern, hat jedoch ihren Preis. Kompatibilitätsschichten orientieren sich in der Regel am kleinsten gemeinsamen Nenner der unterstützten APIs. Neuere oder anbieterspezifische Features werden häufig nur eingeschränkt unterstützt oder fehlen ganz. Besonders bei neueren API-Varianten oder fortgeschrittenen Funktionen kann es hier zu spürbaren Einschränkungen kommen.

Künstliche Intelligenz

Samsung-Studie: Galaxy Watch könnte Ohnmachtsanfälle vorhersagen

Samsung forscht offenbar an der Erweiterung der Gesundheitsfunktionen seiner Galaxy Watches: In einer klinischen Studie zusammen mit dem Chung-Ang University Gwangmyeong Hospital in Korea konnte der Tech-Riese nachweisen, dass sich eine kurzzeitige Ohnmächtigkeit (vasovagale Synkope, VVS) mithilfe der von der Galaxy Watch 6 erfassten Biosignale mit hoher Genauigkeit vorhersagen lässt.

Weiterlesen nach der Anzeige

Bis zu fünf Minuten im Voraus

Das Forschungsteam unter der Leitung von Professor Cho führte bei 132 Patienten mit Verdacht auf VVS-Symptome während induzierter Ohnmachtstests Untersuchungen durch. Mithilfe einer Galaxy Watch 6, die mit einem Photoplethysmographie-Sensor (PPG) – der etwa auch in einem Pulsoximeter steckt – ausgestattet war, analysierte das Team die Herzfrequenzvariabilitätsdaten (HRV) der Uhr mit einem KI-Algorithmus, so Samsung. Das Modell sagte bevorstehende Ohnmachtsanfälle bis zu fünf Minuten im Voraus mit einer Genauigkeit von 84,6 Prozent, bei einer klinisch aussagekräftigen Sensitivität von 90 Prozent und einer Spezifität von 64 Prozent, voraus.

Eine vasovagale Synkope tritt auf, wenn Herzfrequenz und Blutdruck einer Person aufgrund von Faktoren wie übermäßigem Stress plötzlich absinken. Dies führe zu einem vorübergehenden Bewusstseinsverlust. Während die Ohnmacht an sich in der Regel nicht lebensbedrohlich sei, können plötzliche Stürze schwere Folgeverletzungen wie Knochenbrüche oder Gehirnerschütterungen verursachen, weshalb eine frühzeitige Erkennung für die Prävention von entscheidender Bedeutung sei, erklärt das Unternehmen.

Frühwarnung zur Prävention

„Bis zu 40 Prozent aller Menschen erleben im Laufe ihres Lebens eine vasovagale Synkope, wobei ein Drittel wiederkehrende Episoden erleidet“, erklärte Professor Jun Hwan Cho von der Abteilung für Kardiologie am Chung-Ang University Gwangmyeong Hospital. „Eine Frühwarnung könnte den Patienten Zeit verschaffen, sich in eine sichere Position zu begeben oder Hilfe zu rufen, was die Häufigkeit von Folgeverletzungen drastisch reduzieren würde.“ Die Forschungsergebnisse wurden in Band 7, Ausgabe 4 des „European Heart Journal – Digital Health“ veröffentlicht.

Weiterlesen nach der Anzeige

Derzeit handelt es sich lediglich um eine Studie; ob oder wann Samsung eine solche Ohnmachtserkennung in ein Serienmodell einer Galaxy Watch integrieren wird, ist unklar. Jongmin Choi, Leiter der Health R&D Group im Geschäftsbereich Mobile eXperience von Samsung Electronics, sagte zur Studie: „Diese Studie ist ein Beispiel dafür, wie Wearable-Technologie dazu beitragen kann, das Gesundheitswesen von einem Modell der ‚Nachsorge‘ hin zu einem Modell der ‚Präventivversorgung‘ zu verlagern. Wir setzen uns dafür ein, technologische Innovationen voranzutreiben, die unseren Nutzern ein gesünderes Alltagsleben ermöglichen.“

Samsung hat seiner Galaxy Watch nach und nach zahlreiche Gesundheitsfunktionen hinzugefügt. Die im vergangenen Jahr erschienene Galaxy Watch 8 kann etwa den Antioxidantiengehalt der Haut, die Gefäßbelastung, die Herzfrequenz sowie den Blutdruck und den Schlaf messen und ein EKG erstellen. Zuletzt hatte Samsung eine Schlafapnoeerkennung für einige Uhrenmodelle freigeschaltet.

Der südkoreanische Tech-Riese ist indes nicht das einzige Unternehmen, das an Gesundheitsvorsorgefunktionen für Smartwatches arbeitet. Auch Apple, Google sowie Huawei und weitere Unternehmen arbeiten kontinuierlich daran, ihre smarten Uhren mit Extrafunktionen zu bestücken. Zudem ist Apple bekannt dafür, regelmäßig Studien zu verschiedenen Gesundheitsthemen im Zusammenhang mit seinen Produkten zu veröffentlichen.

Lesen Sie auch

(afl)

Künstliche Intelligenz

Bericht: AirPods mit Kamera in „später Testphase“

Schon seit mindestens einem Jahr kursieren Gerüchte, dass Apple bei seinen AirPods eine Kamera einbauen möchte. Nun soll die Produktentwicklung angeblich weit fortgeschritten sein. Laut einem Bloomberg-Bericht vom Donnerstag ist Apple nun in den „Late Stages of Development” der neuen Modellreihe. Das heißt aber noch nicht, dass die Kamera-AirPods produktionsreif sind. Die Prototypen erreichten allerdings einen (fast) finalen Status mit (fast) allen Funktionen. Mit einem Verkaufsstart ist vermutlich nicht vor 2027 zu rechnen.

Weiterlesen nach der Anzeige

AirPods Pro 3 mit verlängertem Stiel

Die Kamera-AirPods sollen nicht als neuartiges Fotowerkzeug dienen. Stattdessen geht es Apple um KI: Durch die Erfassung der Umgebung sollen sie zu den „Augen“ einer verbesserten Siri werden, die im Herbst mit iOS 27 erwartet wird. Visuelle Informationen werden demnach in relativ geringer Auflösung erfasst – ausreichend jedoch, um damit KI-Abfragen durchzuführen. Die Sensoren sitzen demnach in den Stielen der AirPods, die deshalb etwas verlängert wurden – das Produkt soll ansonsten den aktuellen AirPods Pro 3 ähneln.

Das Prototypen-Stadium, das die neuen AirPods erreicht haben sollen, nennt sich Design Validation Test (DVT). Dieses kommt vor der PVT-Phase (Production Validation Test), bei der die frühe Massenproduktion untersucht wird. Apples Problem scheint jedoch weniger die reine Hardware als die Software zu sein: Schon deshalb wurde das Projekt, dessen Release schon 2026 angedacht war, angeblich verschoben. Apple ist es immer noch nicht gelungen, seine kontextsensitive Siri umzusetzen. Eine Chatbot-fähige Siri mit Google-Gemini-Unterstützung ist nicht vor iOS 27 im Herbst zu erwarten.

Anwendungsideen – und ein Kamera-Anhänger

Was die praktische Anwendung der neuen Kamera-AirPods sein wird, bleibt ebenfalls noch abzuwarten. Offenbar ist die Idee, Visual Intelligence zu vereinfachen, sich etwa Produkte oder Orte direkt ins Ohr erklären zu lassen. Ein Beispiel laut Bloomberg wäre auch ein Abendessen mit AirPods-Hilfe: Man müsste sich dann nur die vorhandenen Zutaten anschauen und bekomme ein Rezept. Weitere Anwendungsideen sind Erinnerungen basierend auf dem Kamerabild – etwa wenn diese einen Supermarkt wahrnimmt.

Um Datenschutz zu gewährleisten, sollen die Kamera-AirPods eine rote LED haben, die anzeigt, wenn die Kamera arbeitet und Daten in die Cloud geschaufelt werden. Interessiert wird noch, wie gut diese Warnung sichtbar sein wird – ein Problem, das Meta nur zu gut von seinen Ray-Ban-Smartglasses kennt. Neben den Kamera-AirPods arbeitet Apple auch noch an weiteren Geräten wie einem Anhänger mit Kamera. Solche KI-Geräte waren im Markt bislang Flops.

Weiterlesen nach der Anzeige

(bsc)

Künstliche Intelligenz

Claude Mythos: IWF sieht globales Finanzsystem in Gefahr

Der Internationale Währungsfonds (IWF) hat vor Cybergefahren durch KI-Modelle wie Claude Mythos gewarnt, die das globale Finanzsystem bedrohen könnten. Es wachse das Risiko eines „makrofinanziellen Schocks“, heißt es in einem Blogbeitrag des IWF. Cyberangriffe, die mehrere Banken gleichzeitig treffen, könnten demnach zu Vertrauensverlusten, Zahlungsausfällen, Liquiditätsengpässen und einer Dynamik von Notverkäufen führen.

Weiterlesen nach der Anzeige

Die Frage sei, „ob das Finanzsystem auch unter extremem Stress weiterhin funktionsfähig bleibt“, schreiben die Autoren. Das bislang nur einem kleinen Kreis von Firmen verfügbare Modell Claude Mythos unterstreiche, wie schnell sich die Risiken erhöhten. Aktuell werde die Situation noch gemildert, weil die fortgeschrittenen KI-Fähigkeiten noch nicht so verbreitet seien und weil die Branche auf geschlossene Finanzsoftware setze, die nach Einschätzung des IWF schwieriger anzugreifen sei als Open-Source-Infrastruktur. Diese Puffer dürften jedoch rasch schwinden.

Cybersicherheit zentral für Finanzstabilität

Das Finanzsystem stütze sich auf gemeinsame und stark vernetzte digitale Infrastruktur aus Software, Cloud-Diensten und Netzwerken für Zahlungen und andere Daten. Wenn KI-Modelle den Zeit- und Kostenaufwand für die Identifizierung und Ausnutzung von Schwachstellen drastisch reduzieren, steige damit auch die Wahrscheinlichkeit, dass Schwachstellen in weit verbreiteten Systemen gleichzeitig entdeckt und angegriffen werden und zu systemischen Problemen führen. Auch andere Sektoren wie Energie, Telekommunikation und öffentliche Dienste könnte das betreffen.

Die Politik müsse deshalb auf KI-getriebene Risiken reagieren und Cybersicherheit als zentrales Thema der Finanzstabilität behandeln. Bestehende Maßnahmen seien zwar immer noch relevant, müssten jedoch in einer Welt mit schnelleren, automatisierten und immer raffinierteren Angriffen erweitert und geschärft werden.

So gefährlich, dass es hinter Gitter muss?

KI-Schmiede Anthropic hat mit ihrem Modell Claude Mythos Anfang April eine neue Debatte um IT-Sicherheit entfacht und bis in höchste US-Regierungskreise für Aufregung gesorgt. Mythos sei laut Anthropic so gut darin, Sicherheitslücken aufzuspüren, dass man es erst einmal nicht veröffentlichen könne. Das KI-Modell habe bereits tausende hochriskante Zero-Day-Lücken identifiziert, darunter auch welche in allen großen Betriebssystemen und jedem Internetbrowser. Funktionierende Exploits sollen sich damit auch bauen lassen.

Über die Initiative „Project Glasswing“ erhalten deshalb zunächst nur ausgewählte Unternehmen und Organisationen Zugriff, um kritische Software abzusichern, bevor vergleichbare Fähigkeiten breiter verfügbar werden. Zu den Beteiligten zählen Apple, Google, Microsoft und Nvidia, aber auch Großbanken wie JPMorgan Chase. Dass auch US-Finanzminister Scott Bessent und Notenbankchef Jerome Powell die größten Banken der USA zusammengerufen haben, um über die Gefahren durch KI-gestützte Hackerangriffe zu beraten, unterstreicht die mögliche Tragweite für kritische Infrastrukturen und die Finanzstabilität.

Weiterlesen nach der Anzeige

Bundesregierung im Austausch mit Anthropic

Europa ist Berichten zufolge größtenteils außen vor, was direkten Zugriff auf Claude Mythos angeht. In Deutschland hatte die Präsidentin des Bundesamts für Sicherheit in der Informationstechnik (BSI), Claudia Plattner, bereits kurz nach der Vorstellung von Claude Mythos Preview erklärt, das BSI nehme die Ankündigungen von Anthropic sehr ernst und erwarte „Umwälzungen im Umgang mit Sicherheitslücken und in der Schwachstellenlandschaft insgesamt“. Das BSI habe Kontakt zu Anthropic, Claude Mythos bislang aber nicht getestet und plane auch keine Testung, sagte ein Sprecher Mitte April.

Die EZB und die deutsche Bankenaufsicht BaFin haben laut Bericht des Handelsblatts auch bereits europäische und deutsche Geldhäuser vor den Folgen gewarnt. Dem Bericht nach bemühten sich die Banken intensiv darum, direkten Zugriff auf Mythos zu bekommen. Über Dienstleister wie Microsoft und Google erhielten einige mittlerweile zumindest indirekte Einblicke. Bundesbank-Präsident Joachim Nagel forderte, Mythos auch für Geldhäuser außerhalb der USA verfügbar zu machen: „Alle relevanten Institute sollten Zugang zu dieser Technologie haben, um Wettbewerbsverzerrungen zu vermeiden“, sagte er.

Die Bundesregierung ist laut dem Handelsblatt inzwischen auch aktiv geworden. Demnach habe der nationale Sicherheitsrat geheim in der Sache getagt, ebenso wolle man mit dem Hersteller Gespräche zu Mythos führen. „Die Bundesregierung steht gegenwärtig mit dem Hersteller Anthropic im Austausch“, sagte ein Sprecher des Innenministeriums dem Handelsblatt.

(axk)

-

Künstliche Intelligenzvor 3 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview