Apps & Mobile Entwicklung

Humble Bundle: Mega Spaß mit Mega Man – wenn’s denn gefällt

Nachdem es letztes Jahr September bereits ein Capcom-Bundle mit Ace Attorney und einigen Mega-Man-Spielen gegeben hatte, bietet Humble aktuell ein Bundle mit vollem Fokus auf Mega-Man an. Enthalten sind neun Titel, allerdings für einen ungewöhnlich hohen Preis.

Das Bundle umfasst vier Stufen. Die erste Stufe startet mit folgenden drei Titeln (inklusive Bewertung laut SteamDB):

- Mega Man Battle Network Legacy Collection Vol.1 – 83 Prozent

- Mega Man Battle Network Legacy Collection Vol.2 – 81 Prozent

- MEGA MAN X DiVE Offline – 77 Prozent

Auf Stufe 2 kommen die folgenden zwei Titel hinzu:

- Mega Man 11 – 86 Prozent

- Mega Man Zero/ZX Legacy Collection – 74 Prozent

Stufe 3 beinhaltet zudem:

- Mega Man Legacy Collection 2 – 81 Prozent

- Mega Man X Legacy Collection 2 – 74 Prozent

Die vierte und letzte Stufe enthält schließlich noch:

- Mega Man X Legacy Collection – 76 Prozent

- Mega Man Legacy Collection – 84 Prozent

Wer letztes Jahr schon beim Capcom-Bundle zugeschlagen hat, braucht dieses Jahr lediglich über die zweite Bundle-Stufe nachzudenken. Die vier Titel der dritten und vierten Stufe waren damals schon enthalten.

Nachschub erst 2027

Bei Mega Man handelt es sich um eine klassische Spielreihe, deren Anfänge bis in das Jahr 1987 zurückreichen. In den ersten Teilen der Serie muss Mega Man, ein humanoider Roboter, die Welt vor dem größenwahnsinnigen Dr. Wily und seinen Roboterschergen retten.

Bis 2018 erschienen insgesamt elf Titel für beinahe alle mehr oder weniger bekannten Konsolen sowie für PC und Smartphone. Während im letzten Jahr noch über einen neuen Teil der Serie spekuliert wurde, ist mittlerweile klar, dass mit „Mega Man: Dual Override“ im kommenden Jahr ein neuer Teil an den Start gehen wird.

Spielen und Gutes tun

Wie immer kommt ein Teil der Erlöse einer gemeinnützigen Organisation zu Gute. In diesem Fall ist das „Children’s Miracle Network Hospitals“, eine gemeinnützige Organisation in den USA und Kanada, die Spenden für über 170 Kinderkrankenhäuser sammelt. Sie finanziert Behandlungen, medizinische Forschung und Ausrüstung, um die Gesundheitsversorgung jährlich von Millionen von Kindern zu verbessern.

Preis und Verfügbarkeit

Ungewöhnlich, vor allem im Vergleich zum letztjährigen Capcom-Bundle, wirkt die aktuelle Preisgestaltung. Stufe 1 startet bei 20,19 Euro, Stufe 2 kostet 30,28 Euro, gefolgt von Stufe 3 mit 40,38 Euro und schließlich das gesamte Bundle mit allen neun Titeln für 50,49 Euro.

Erwähnenswert ist die Preisgestaltung dahingehend, dass es sechs von neun Titeln bereits im Capcom-Bundle im letzten Jahr gab. Dieses kostete aber nur 35,67 Euro und bot zudem noch mehrere Sammlungen der Ace-Attorney-Spiele und zwei Gutscheine. Die drei neuen Titel im Mega-Man-Bundle kosten auf Steam unrabattiert jeweils 29,99 Euro, sind aber wiederum bereits auf Stufe 1 und 2 zu haben. Logischer wäre es gewesen, die teuren Titel erst auf einer höheren Stufe zugänglich zu machen. So aber dürfen sich Sparfüchse freuen, die bereits im letzten Jahr zugeschlagen haben. Wie dem auch sei, alle neun Titel haben auf Steam einen Wert von 208,58 Euro, wodurch das Bundle für Mega-Man-Fans auch ohne Rechenspiele von Interesse sein kann – vor allem wenn auf Steam noch kein Titel vorhanden ist.

Das Mega-Man-Bundle ist noch bis zum 19. März erhältlich.

Apps & Mobile Entwicklung

tado°: Steuerung mehrerer Haushalte mit einem Konto kommt

tado° ermöglicht mit einem Update die Steuerung mehrerer Haushalte oder Büros mit einem Konto. Damit können auch V3+-Produkte und tado X unter einem Konto verwaltet werden. Die Funktion wird ab Sommer 2026 für alle Nutzer von tado° verfügbar sein.

Ab Sommer sollen Nutzer auf diese Weise smarte Thermostate in bis zu fünf Haushalten über ein einziges Konto steuern können. Für das eigene Zuhause, das Büro oder die Ferienwohnung sind so keine getrennten Accounts mehr erforderlich, was die Steuerung deutlich vereinfacht. Zusätzliche Kosten entstehen hierfür nicht.

Durch die gemeinsame Verwaltung mehrerer Haushalte ist nun auch eine abgestimmte automatische Steuerung etwa durch Geofencing möglich. Verlässt man das Zuhause und macht sich auf den Weg zur Ferienwohnung, kann nun zuhause automatisch die Heizung ausgeschaltet und in der Ferienwohnung automatisch vor Ankunft eingeschaltet werden, ohne dass man hierfür manuell eingreifen und zwischen den Accounts wechseln muss.

Verschiedene Generationen möglich

Dabei ist auch ein Mischbetrieb verschiedener tado°-Generationen möglich. Während in einem Haushalt tado X läuft, kann in einem anderen Haushalt weiterhin die ältere V3+-Generation genutzt werden. Erstmals können Nutzer somit unterschiedliche tado°-Produktlinien mit demselben Konto verwalten.

Im Test der smarten Heizungssteuerung tado° X war von ComputerBase bereits bemängelt worden, dass keine Möglichkeit besteht, zwei Haushalte in einer App zu betreiben, ohne dies über zwei Accounts umzusetzen, zwischen denen dann immer wieder durch Aus- und Einloggen gewechselt werden muss.

AI Assist & Auto Assist: Ein Abo für alle Haushalte

Erfreulich für Nutzer ist dabei auch, dass ein bestehendes Abonnement für AI Assist (tado° X) oder Auto-Assist (für V3+ und ältere Generationen) in allen verwalteten Haushalten genutzt werden kann. Das Abonnement bietet Funktionen wie die automatische ortsabhängige Steuerung (Geofencing), Fenster-Offen-Erkennung, adaptives Heizen und mehr.

Die Steuerung mehrerer Wohnungen oder Häuser wird für alle tado°-Nutzer verfügbar sein. AI-Assist- und Auto-Assist-Abonnenten können gleichzeitig in all ihren Haushalten angemeldet sein und den „Ein-Klick“-Wechsel in der tado°-App nutzen, während Nicht-Abonnenten sich ab- und wieder anmelden, um zwischen den Wohneinheiten zu wechseln.

ComputerBase hat Informationen zu diesem Artikel von tado° unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Firefox 150: Jubiläum mit besser geteilter Ansicht und neuen Tab-Funktionen

Mozilla hat Firefox 150 veröffentlicht und spendiert dem Browser zum Jubiläum eine überarbeitete geteilte Ansicht sowie weitere Verbesserungen. Dazu zählen unter anderem das Teilen mehrerer Tabs in einem Schritt und erweiterte PDF-Funktionen. Parallel dazu wurden mehr als 40 teils kritische Sicherheitslücken geschlossen.

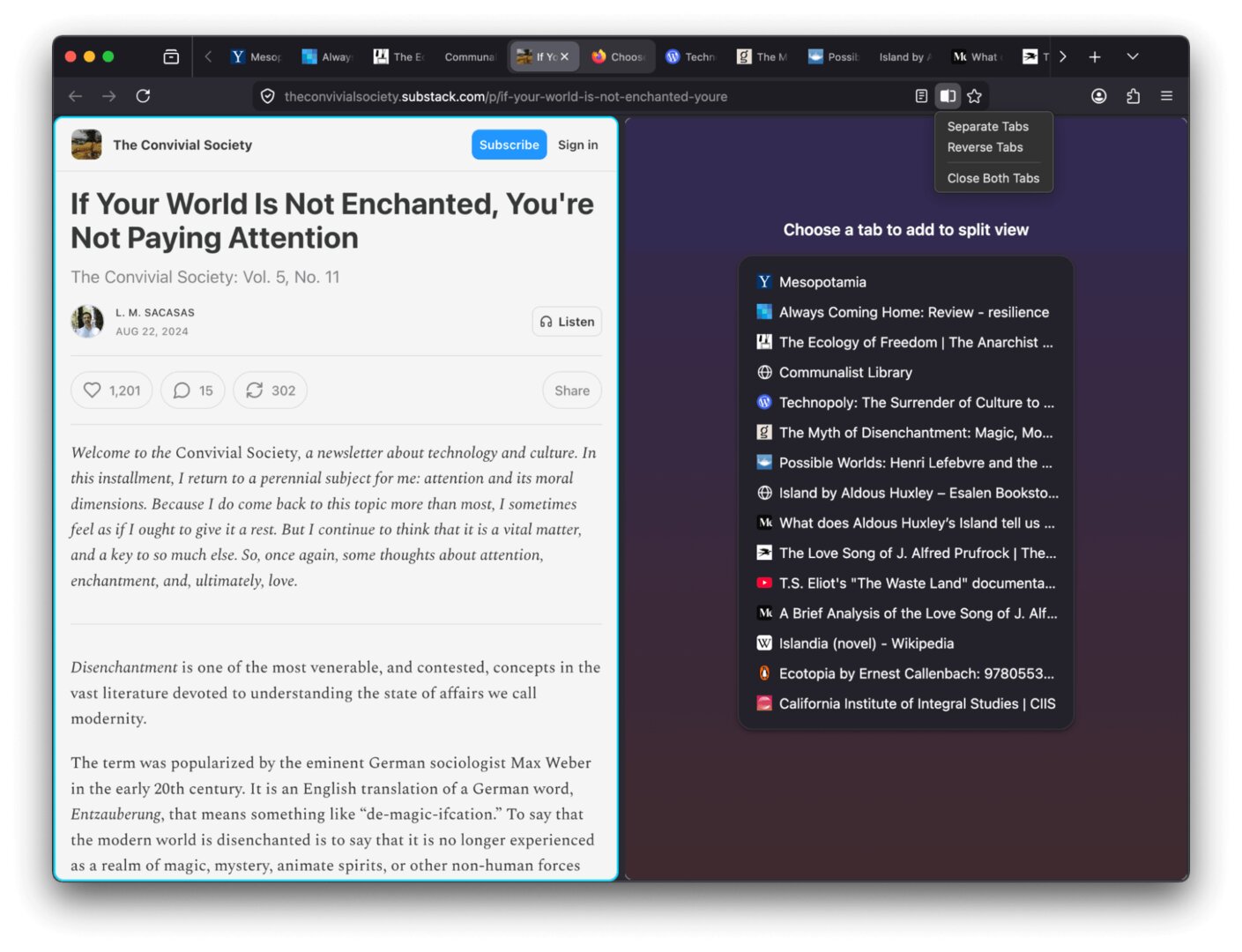

Verbesserte geteilte Ansicht und leichteres Teilen

Mozilla hat die mit der vorherigen Version eingeführte geteilte Ansicht erneut überarbeitet und deren Bedienung deutlich vereinfacht. So lässt sich nun per Rechtsklick ein beliebiger Link anwählen und über das Kontextmenü mit der Option „Link in geteilter Ansicht öffnen“ direkt neben dem aktuellen Tab darstellen. Zusätzlich können beim Erstellen einer geteilten Ansicht nun auch bereits geöffnete Tabs durchsucht werden. Die Position der Tabs lässt sich über die neue Funktion „Tabs umkehren“ im Tab-Kontextmenü schnell anpassen.

Darüber hinaus erlaubt Firefox 150 nun das gleichzeitige Teilen mehrerer Tabs in nur einem Schritt. Beim Einfügen in andere Anwendungen enthalten die erzeugten Links sowohl den Seitentitel als auch die URL, was die Lesbarkeit verbessern soll. Auch der integrierte PDF-Editor wurde erweitert und unterstützt nun das Neuordnen, Kopieren, Einfügen, Löschen und Exportieren von Seiten.

Auch unter Linux gibt es Verbesserungen

Auch abseits dieser Funktionen wurden in der Anwendung Optimierungen umgesetzt. Unter Linux unterstützt Firefox nun den GTK-Emoji-Picker, sodass sich Emojis über die systemweite Tastenkombination (in der Regel Strg+.) einfügen lassen. Zudem stellt Mozilla für Linux-Nutzer unter Red Hat, Fedora, openSUSE und anderen RPM-basierten Distributionen ein neues .rpm-Paket bereit. Darüber hinaus stehen Firefox-Web-Apps nun auch Anwendern unter Windows zur Verfügung, die den Browser über den Microsoft Store installiert haben.

Leichterer Umgang mit Profilen

Auch die Verwaltung von Profilen wurde überarbeitet und vereinfacht. Die entsprechenden Funktionen stehen nun allen Benutzern zur Verfügung, einschließlich Anwendern von Windows 10. Gleiches gilt für die Möglichkeit, Profile in eine Datei zu sichern, die nun ebenfalls für alle Nutzer von Windows 10 und Windows 11 verfügbar ist. Dies schließt auch diejenigen ein, die bereits das neue Profilverwaltungssystem einsetzen.

Alle Änderungen und Neuerungen sind in den Release Notes aufgelistet.

Kritische Lücken erfordern schnelles Update

Mit Firefox 150 haben die Entwickler zudem mehr als 40 Schwachstellen behoben, von denen 13 als kritisch eingestuft wurden. Dazu zählen unter anderem Use-after-free-Probleme in verschiedenen Komponenten wie Core & HTML oder WebRTC, aber auch weitere sicherheitsrelevante Fehler wurden beseitigt. Diese Lücken können ausreichen, damit Angreifer sensible Daten auslesen oder im schlimmsten Fall die Kontrolle über ein betroffenes System übernehmen. Entsprechend wird empfohlen, die neue Version zeitnah zu installieren. In den Security Fixes listet Mozilla sämtliche behobenen Schwachstellen im Detail auf.

Auch Varianten mit verlängertem Support erhalten Updates

Parallel dazu haben auch die ESR-Versionen 140.10.0 und 115.35.0 mit verlängertem Support Aktualisierungen erhalten. Wie bei diesen Veröffentlichungen üblich, bringen sie keine neuen Funktionen mit sich, sondern konzentrieren sich ausschließlich auf die Behebung von Sicherheitsproblemen. Konkret wurden dabei 26 beziehungsweise 11 teils kritische Schwachstellen geschlossen, weshalb auch hier eine zeitnahe Installation empfohlen wird.

Ab sofort verfügbar

Firefox 150 sowie Firefox 140.10.0 ESR und 115.35.0 ESR stehen ab sofort auf der Website von Mozilla zum Download bereit. Ebenso lässt sich die Aktualisierung über die Update-Funktion im Browser anstoßen, wobei die meisten Anwender mittlerweile auch eine Benachrichtigung über die neue Version erhalten haben dürften. Alternativ können die neuen Versionen auch wie gewohnt bequem über den Link am Ende dieser Meldung aus dem Download-Bereich von ComputerBase bezogen werden.

Downloads

-

4,7 Sterne

Firefox ist ein freier Browser der gemeinnützigen Mozilla Foundation mit vielen Erweiterungen.

- Version 150.0 Deutsch

- Version 140.10.0 ESR Deutsch

- Version 115.35.0 ESR Deutsch

Apps & Mobile Entwicklung

Xbox GamePass: Der Preis sinkt wieder, weil Call of Duty später kommt

Microsoft geht einen Schritt zurück: Zwei Versionen des Game Pass werden wieder etwas günstiger. Das liegt an der Streichung eines großen Namens: Call of Duty wird nicht mehr ab Tag 1 über das Abo spielbar sein, sondern erst nach einer gewissen Wartezeit.

Ganz die vorherigen Preise erreicht der Game Pass nicht, die letzte, deutliche Erhöhung aus Oktober 2025 nimmt der Konzern nur teilweise zurück. Der GamePass Essential und die Premium-Version, der Standard-GamePass, bleiben ohnehin so teuer wie zuvor.

Die teuersten Pässe werden günstiger

Im Preis gesenkt wird der GamePass auf dem PC. Er kostet künftig rund 13 statt wie bisher 15 Euro. Noch deutlicher fällt der Preis der teuersten Version. Der GamePass Ultimate kostet fortan knapp 21 statt bisher 27 Euro. Damit wäre die letzte Preiserhöhung auf ein übliches Niveau korrigiert worden.

Der gesenkte Preis korreliert mit gekürztem Angebot. Call of Duty wird nicht mehr direkt bei Erscheinen, also nicht mehr „Day One“, im Game Pass enthalten sein. Künftig werden sie erst in „der darauf folgenden Weihnachtssaison“ und damit rund ein Jahr verzögert Teil des Angebots. Wie bisher bleiben sie der Ultimate-Stufe vorbehalten.

Die Strategie liegt auf der Hand. Microsoft nimmt so zwei Mal das Weihnachtsgeschäft mit und setzt Anreize, den Titel trotz GamePass-Abo zu kaufen um sofort spielen zu können. Die Rechnung scheint klar, denn die Platzierung von Call of Duty: Black Ops 6 im GamePass soll 300 Millionen US-Dollar an Einnahmen gekostet haben. Der Titel konnte nicht über den Verkaufspreis, sondern ausschließlich über Mikrotransaktionen monetarisiert werden.

Änderungen mit Ankündigung

Microsoft hatte zuletzt versucht, die Profitabilität seiner Gaming-Sparte über den Branchendurchschnitt hinaus zu steigern. Preiserhöhungen im GamePass und das Zusammenstreichen von Spieleprojekten zu Gunsten von zugkräftigen Marken waren die Folge. Der jüngste Wechsel an der Führungsspitze durch den Abgang von Xbox-Urgestein Phil Spencer sowie schlechte Zahlen des Gaming-Bereichs hatten weitere Änderungen bereits angekündigt.

Asha Sharma, die aus der KI-Sparte des Konzerns kommt, hatte erst letzte Woche erklärt, dass der GamePass zu teuer sei und kurzfristig betrachtet mehr Gegenwert bieten müsse. Langfristig soll sich das Angebot jedoch vom aktuellen Modell wegbewegen und flexibler werden.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenInterview: Massiver Anstieg der AU‑Fälle nicht durch die Telefon‑AU erklärbar

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß