Apps & Mobile Entwicklung

Neues Spitzenmodell für ChatGPT: OpenAI verbessert GPT-5.4 bei autonomer Computersteuerung

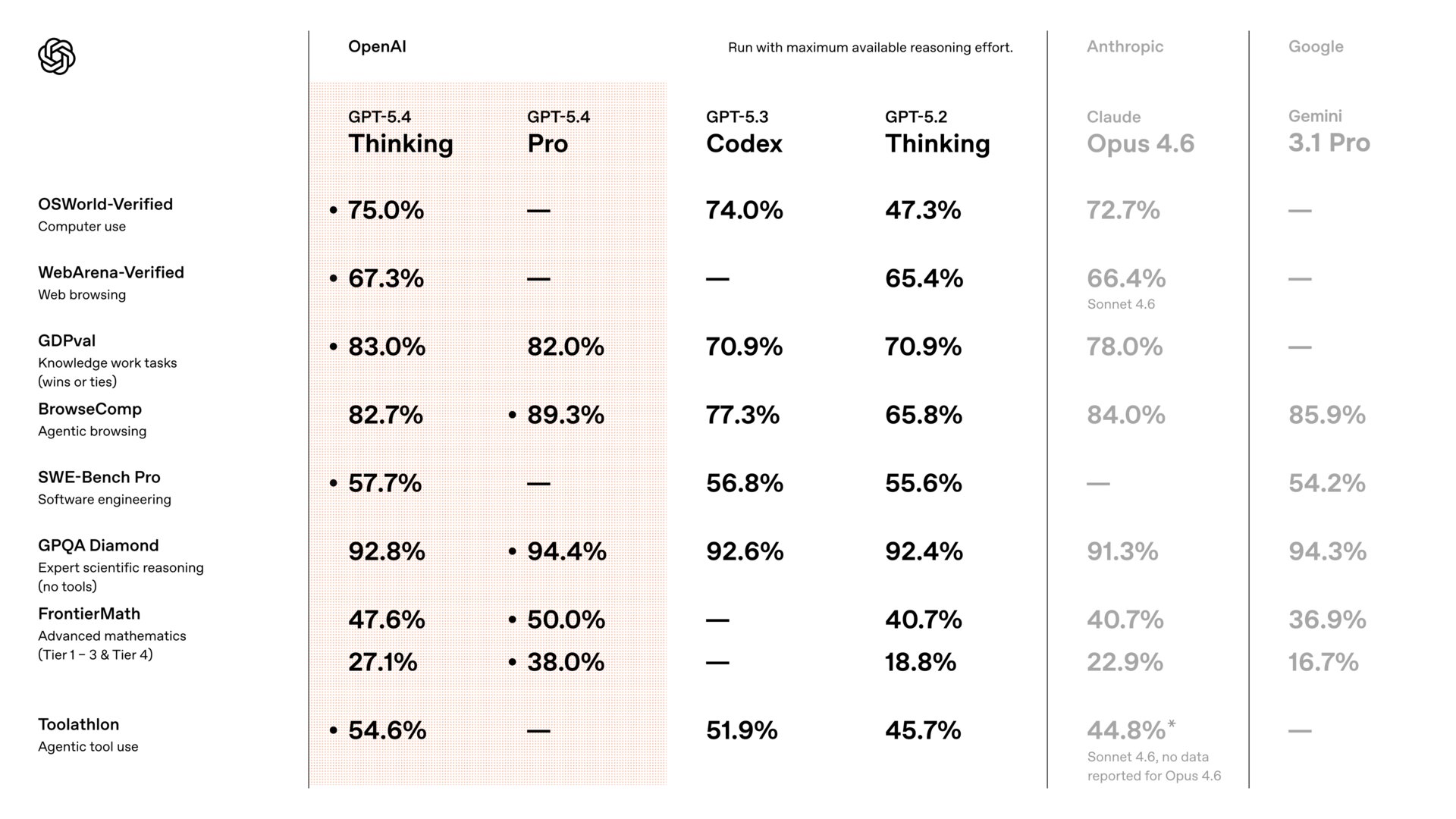

OpenAI hat mit GPT-5.4 ein neues Spitzenmodell für ChatGPT vorgestellt. Während das erst zwei Tage zuvor präsentierte GPT-5.3 Instant vor allem die alltäglichen Chatgespräche verbessern soll, bietet GPT-5.4 mehr Leistungsfähigkeit in Bereichen wie Logikaufgaben, Reasoning und Agenten-Funktionen.

So bezeichnet OpenAI das neue Modell auch als „Spitzenmodell für professionelles Arbeiten“. Im Fokus stehen die Fortschritte bei komplexen und mehrstufigen Aufgaben. In Benchmarks wie GDPval, der die Agenten-Performance messen soll, kann sich GPT-5.4 deutlich vom Vorgänger absetzen. Dasselbe gilt für weitere Benchmarks, die OpenAI bereitstellt.

OpenAI setzt auch bei der Kontrolle des Modells an. Wenn man den Thinking-Modus nutzt, soll es bei komplexen Anfragen zunächst einen Plan präsentieren, den Nutzer dann anpassen können. Damit ist es möglich, den Output frühzeitig zu optimieren.

Die Halluzinationsrate hat OpenAI bereits mit GPT-5.3 Instant gesenkt. Mit GPT-5.4 soll die Fehlerrate ebenfalls geringer ausfallen. Optimiert wurde auch die Websuche.

State-of-the-Art-Computernutzung

Was OpenAI verbessert hat, ist die Computernutzung. Das Modell kann also besser Tools wie Browser oder Apps steuern. Vergrößert wurde auch das Kontextfenster, das nun bis zu einer Million Token unterstützt. Die Größe des Kontextfensters hat mit den Agenten enorm an Bedeutung gewonnen, weil dieser Wert beschreibt, wie viele Informationen das Modell innerhalb eines Prompts erfassen kann. Weil selbst mittelgroße Projekte schnell in Token-Grenzen laufen, bieten größere Kontextfenster bei mehrstufigen und komplexen Aufgaben einen Vorteil.

Profitieren soll die Alltagsarbeit auch von der erhöhten Effizienz. Im Vergleich zu GPT-5.2 löst GPT-5.4 Probleme mit deutlich weniger Token, was sich in schnelleren Antworten und geringeren Kosten für viele Workloads niederschlägt, heißt es in der Mitteilung von OpenAI.

Bereits in ChatGPT abrufbar

GPT-5.4 ist in ChatGPT als GPT-5.4 Thinking verfügbar, nutzen lässt es sich zudem über die API und das Agenten-System Codex. Zusätzlich stellt OpenAI neue Skills für Codex bereit – also eine Art Plug-in, das Agenten-Fähigkeiten speziell für bestimmte Aufgaben wie Präsentationen optimiert. Geschäftskunden können zudem die aktuelle Variante des Add-ins ChatGPT for Excel nutzen.

Codex-App für Windows verfügbar

Neben GPT-5.4 hat OpenAI auch die Codex-App für Windows veröffentlicht – bislang war OpenAIs Claude-Code-Konkurrent nur für MacOS verfügbar. Nutzer können damit das Agenten-System lokal vom Rechner aus per App starten und steuern, wobei die Modelle selbstverständlich nach wie vor in der Cloud berechnet werden.

Mit der Codex-App ist es laut OpenAI möglich, mehrere Agenten asynchron über verschiedene Projekte auszuführen. Die Fortschritte der Agenten lassen sich individuell prüfen.

Agenten-Systeme wie Codex und Claude richten sich derzeit vor allem noch an Programmierer. Fähigkeiten wie das Automatisieren von Routine-Aufgaben sind aber bereits außerhalb des Coding-Kosmos realisierbar. Ebenso bieten die Systeme Vorteile bei komplexen und mehrstufigen Aufgaben in Bereichen wie Datenanalysen.

Apps & Mobile Entwicklung

GameSir Cyclone 2 Gamepad im Test

Ein weiterer Controller-Tipp der CB-Community muss sich dem Test stellen. Zur Empfehlung macht das GameSir Cyclone 2 die Kombination aus Standard-Preis von gut 55 Euro und einer ganzen Palette Upgrade-Technik, die das Xbox-Gamepad alt aussehen lassen. Zeit für den Blick hinter die Papierform.

Der Cyclone 2 wertet konsequent Kernbestandteile des Xbox-Gamepads auf. Verbesserungen quasi für jede einzelne Taste und ein paar Komfort-Extras klingen nach einem absoluten Sorglos-Paket. Das wirft zwei Fragen auf: Ist das tatsächlich eine spürbare Verbesserung – und lohnt sich ein teureres Produkt überhaupt noch? Die Antwort ist am Ende keine Überraschung.

- TMR-Sticks & Mikrotaster

- Zusatztasten

- Softwarelos konfigurierbar

- Geringes Gewicht

- D-Pad etwas „matschig“

- Trigger ohne Force Feedback

Der Cyclone 2 im Überblick

Der Cyclone 2 setzt auf ein unverändertes Xbox-Layout, das um zwei Paddle-Tasten auf der Unterseite und RGB-LEDs ergänzt wird, die durch die halbtransparente Oberseite leuchten.

Haltbare Technik

Beim Unterbau liefert GameSir auf dem Papier alle Elemente höherer Preisklassen. TMR-Thumbsticks und Hall-Effekt-Trigger mit Sperren versprechen Schutz vor Stick Drift und weitergehende Konfigurationsmöglichkeiten. Dazu gehört es, die Totzone anzupassen oder auszuschalten sowie Reaktionskurven zu modifizieren. Unter den ABXY-Tasten und dem D-Pad sitzen klickende Mikrotaster, die für klareres Feedback beim Drücken sorgen.

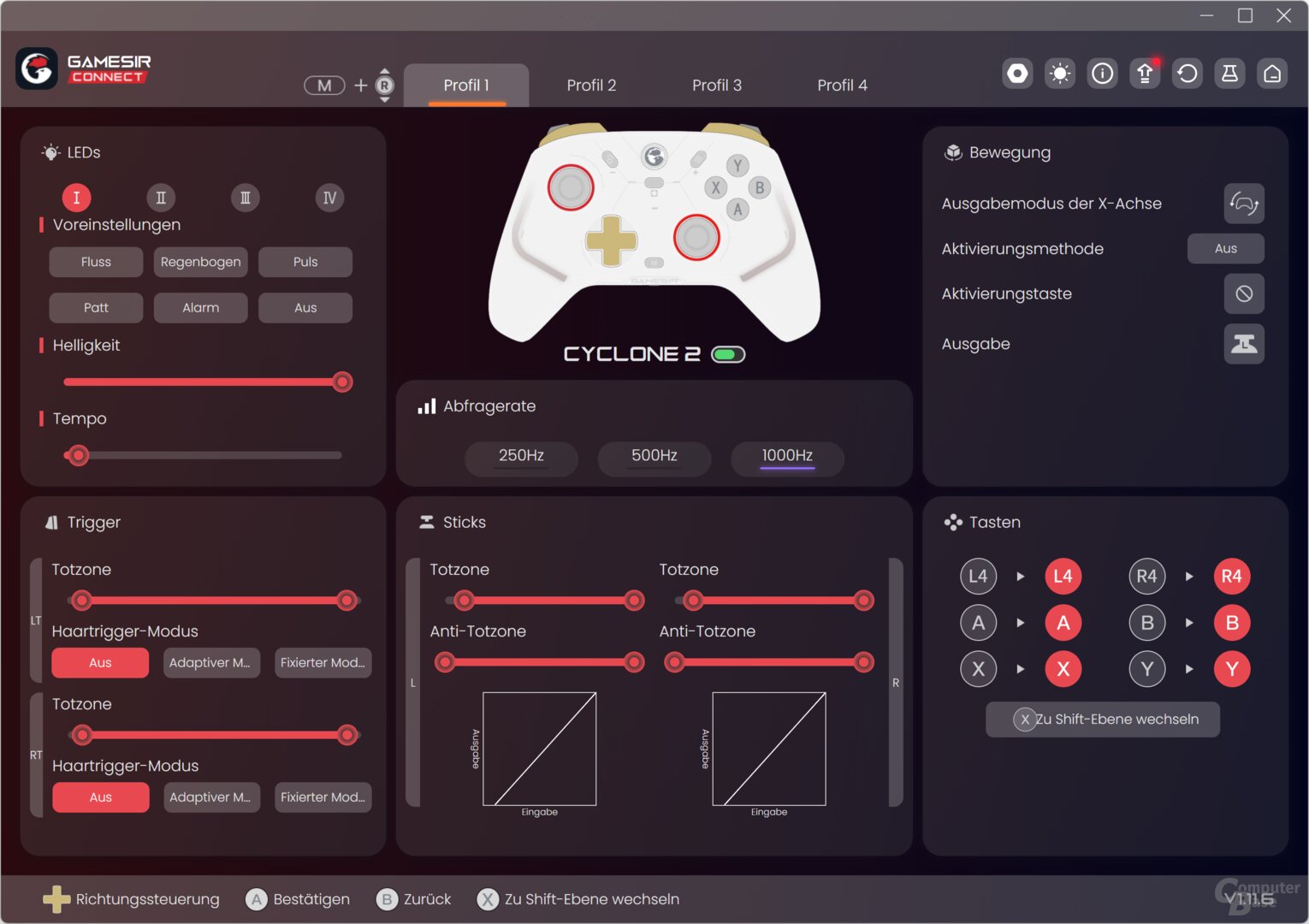

Das Kapitel Konnektivität umfasst das übliche Dreiergespann aus Kabel, Bluetooth und Funk mit maximal 1.000 Hz, per 860-mAh-Akku sollen Laufzeiten von etwa neun Stunden möglich sein. Unterstützt werden neben Windows, Android, iOS und die Switch, laut Berichten im Netz auch die Switch 2. An der Xbox funktioniert das Pad nur per Kabel. Konfiguriert wird der Cyclone 2 entweder durch Tastenkombinationen oder weitreichender mit der Connect-App unter Windows.

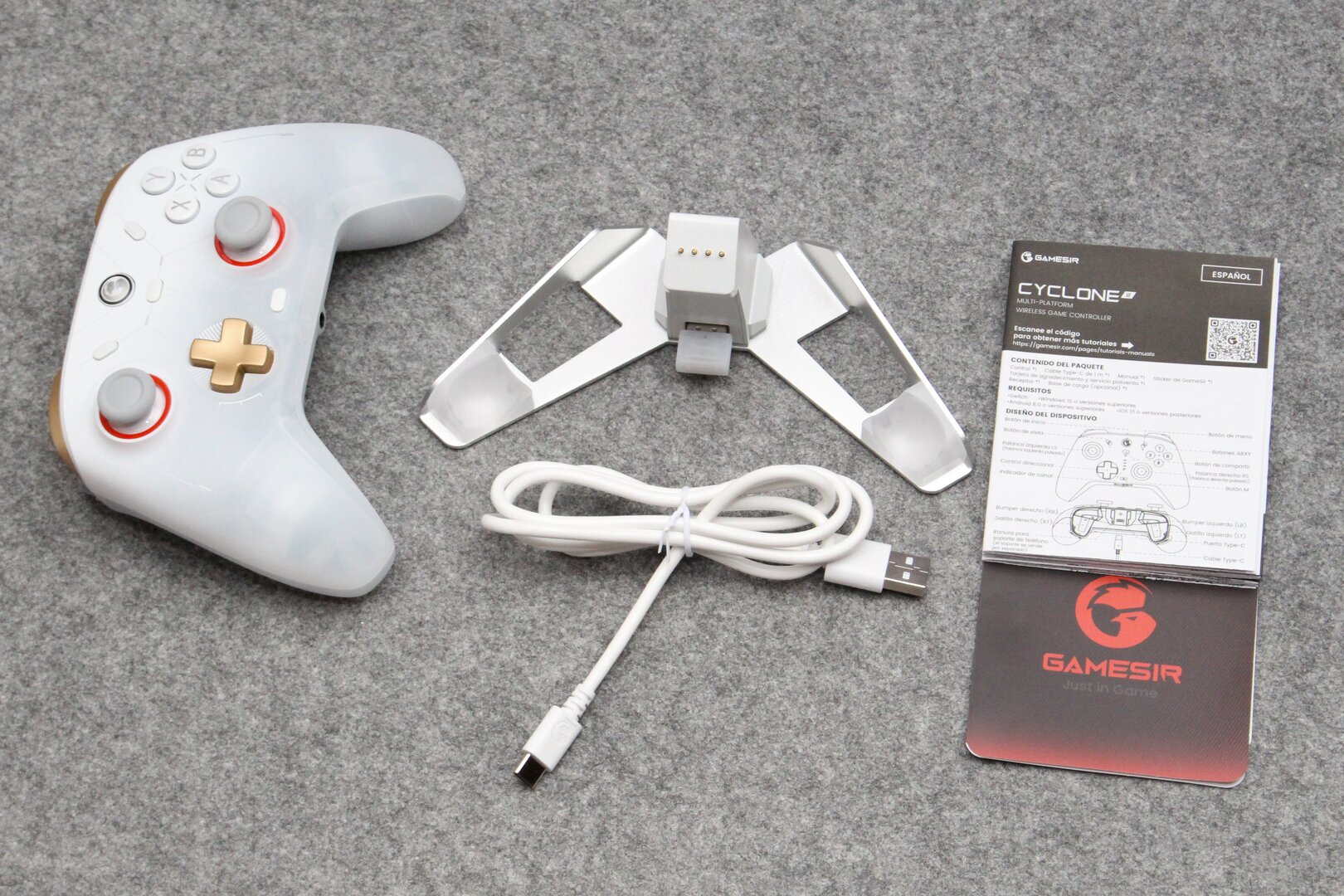

Varianten, Preis und Zubehör

Den Cyclone 2 gibt es entweder in Weiß oder Schwarz mit jeweils kleineren farblichen Akzenten. Eine Ladestation lässt sich separat für rund 15 Euro zukaufen. Sie gehört nicht immer zum Lieferumfang. Da die Bundle-Edition preisgleich oder für einen kleinen Aufpreis von etwa sechs Euro im freien Handel zu finden ist, lohnt sich beim Kauf ein genauer Blick. Weiteres Zubehör gibt es nicht, Sticks, D-Pad-Cover und Faceplate montiert GameSir fest.

Praxistest

Für etwa 55 Euro verspricht das Gamepad Vorsprung durch Technik. Wunderwaffe des Cyclone 2? Technik. Was es nicht schafft, ist die Gleichwertigkeit der Papierform in Gleichwertigkeit der Realform zu übertragen. Theoretisch liefert der Cyclone 2 das, was sonst das Doppelte oder gar Vierfache kostet, praktisch tun sich feine Unterschiede auf. Über die glasklaren Qualitäten des Cyclone 2 darf das nicht hinwegtäuschen.

Deshalb ist dieses Pad gut

Denn die technischen Upgrades zeigen unbestreitbar Wirkung, der Cyclone 2 fühlt sich rundum besser an als das Xbox-Gamepad. Knackige Buttons und Menütasten lassen ihn direkter wirken, präzise, straffe Sticks mit weitreichenden Einstellungsmöglichkeiten sorgen für Zackigkeit. Die Stick-Taster sind dabei sogar deutlicher als die des teuren G7 Pro und tragen zu einem homogenen Eingabe-Handdruck bei.

Diese Klarheit des Feedbacks hebt das Pad auch vom 8BitDo Ultimate 2C (Test) ab, bei dem nur die spitzer klickenden, wenn auch viel lauteren Schultertasten noch besser gefallen. Akustisch macht der Controller ebenfalls einen guten Eindruck: Er ist akustisch dezent und klickt hell, ohne dabei billig oder klapprig zu wirken – besser als der Xbox-Controller.

Und noch etwas sorgt für ein positives Gefühl: Das geringe Gewicht erweist sich als weiteres Upgrade. Das sind die Zusatztasten ebenfalls. Es fehlt zwar eine Sperre, durch ihre Form und Einbettung in die Griffe lässt sich der Controller aber auch so gut halten, ohne sie versehentlich zu betätigen. Ob es die Beleuchtung braucht, ist eine nur subjektiv beantwortbare Frage, die LEDs lassen sich aber ab- und umschalten. Nur die des Funkempfängers bleibt immer an und immer weiß. Im Alltag lässt die Ladestation aber keinen Zweifel an ihrem Mehrwert aufkommen. Rundum also macht sich der Cyclone 2 besser. Besser noch: Er bleibt dabei ausgewogen.

Das können Upgrades besser

Die Unterschiede zu teureren Pads sind eine Frage des Erlebens. Dieses Erlebnis wird durch verschiedene subtile Faktoren geprägt. Sticks und Trigger benötigen einen Hauch mehr Kraft, sie stehen stärker unter Spannung. Mehr Gefühl, aber weniger Präzision, das ist das feine Ergebnis dieser Abstimmung. Hauptsächlich der linke Trigger fiel zudem durch einen winzigen „Bump“auf, der bei sehr langsamem Eindrücken weniger als Druckpunkt denn als winzige Widerstandsveränderung spürbar wurde – mit zunehmender Zeit oder Eingewöhnung aber schwächer spürbar. Fertigungstoleranzen möglicherweise, ungünstig für feinste Dosierung definitiv. Force Feedback fehlt den Triggern zudem.

Mikrotaster, das zeigt der Cylcone 2, sind zudem nicht gleich Mikrotaster. ABXY sind stramm, haben knappen Hub und gefallen sogar besser als die des teureren G7 Pro, die mehr Spiel aufweisen. Andere Luxus-Controller klicken allerdings mit weniger Toleranzen und feiner.

Beim D-Pad ist das etwas anders. Es ist einerseits ein klares Upgrade gegenüber Rubberdome-Varianten, aber nicht in der Deutlichkeit wie anderswo, weil es bei ungünstiger Betätigung am Gehäuse schleifen kann. Zudem hat es relativ großen Hub, den „Pre-Travel“. Der Weg bis zum Klick liegt bei etwa einem halben Millimeter und erzeugt einen matschigen Eindruck. Man kann hier Entwarnung geben: Er entsteht nur beim Antippen des Steuerkreuzes, was im Alltag nie passiert. Nein, die absolute Unmittelbarkeit eines guten Mikrotaster-Pads erreicht diese Variante so nicht – und nein, im Alltag fallen alle diese Nickeligkeiten nicht auf.

Festhalten lässt sich daher: Je mehr Geld ausgegeben wird, desto feiner und homogener wird das Ergebnis, desto stärker hat jemand an Details gefeilt. G7 Pro, insbesondere in der verbesserten 8K-Variante, oder ein Asus Raikiri 2 fühlen sich agiler und kontrollierter an. Ob das den Aufpreis wert ist, ist die nächste Frage, vor allem wenn man den Vergleich nicht ständig in der Hand hat.

Software & Einstellungen

Die Connect-App gleicht im Prinzip der Nexus-App des G7 Pro, sie unterstützt lediglich neuere Controller. Übersichtlicher Aufbau und umfangreiche Einstellungsmöglichkeiten erleichtern schnelle Anpassungen, die App gefällt. Weil der Controller nicht an der Xbox funktionieren muss, gehören dazu nun auch Makros und Tastatur- oder Mausbefehle, die auf die Tasten gelegt werden können.

Fazit

Das Cyclone 2 wertet konsequent Kernbestandteile des Xbox-Gamepads auf. Verbesserungen quasi für jede einzelne Taste und ein paar Komfort-Extras klingen nach einem absoluten Sorglos-Paket. Das wirft zwei Fragen auf: Ist das tatsächlich eine spürbare Verbesserung – und lohnt sich ein teureres Produkt überhaupt noch? Die Antwort ist am Ende keine Überraschung.

Sie lautet „Ja“ und trotzdem „Ja“. Ja, 55 Euro liefern hier ein rundes Produkt: Es ist durch Gewicht und Form komfortabler, durch bessere Technik merklich „präziser“ und „agiler“. Das spürt man. Die Abstimmung ist, Stichwort Trigger und D-Pad, nicht ganz perfekt, fällt im Alltag aber vor allem durch Homogenität auf – es fällt nichts aus dem Rahmen. Das Urteil ist insofern eindeutig: Wer in dieser Preisklasse zum Xbox-Controller greift, möchte entweder das „klassische“ Feeling der Buttons, will Akkus wechseln oder besitzt eine Xbox. Am PC spricht insofern sehr viel für den Cyclone 2.

Und trotzdem: Ja, natürlich geht alles noch besser und teurere Controller sind besser als günstigere. Muss man diese Weisheit überhaupt aufschreiben? Man muss, denn der Unterschied liegt nicht nur in der Anzahl der Features, sondern auch in ihrer individuellen Qualität. Ein

G7 Pro (Test) ist insgesamt noch einmal fein besser, die 8K-Version sogar rundum. Aber selbst ein Asus ROG Raikiri 2 (Test), das gut 200 Euro kostet, „vergütet“ den Mehrpreis noch einmal mit gleichmäßigen, stramm und „sofort“ klickenden Buttons. Nur eines bekommt man dann nicht mehr: sehr viel Leistung pro Euro.

- TMR-Sticks & Mikrotaster

- Zusatztasten

- Softwarelos konfigurierbar

- Geringes Gewicht

- D-Pad etwas „matschig“

- Trigger ohne Force Feedback

ComputerBase hat den Cyclone 2 von GameSir leihweise zum Testen erhalten. Eine Einflussnahme des Herstellers auf den Testbericht fand nicht statt, eine Verpflichtung zur Veröffentlichung bestand nicht.

(*) Bei den mit Sternchen markierten Links handelt es sich um Affiliate-Links. Im Fall einer Bestellung über einen solchen Link wird ComputerBase am Verkaufserlös beteiligt, ohne dass der Preis für den Kunden steigt.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.

Apps & Mobile Entwicklung

Tippen wie auf Kissen: Duckys „Nest Mount“ sorgt für leise & weiche Anschläge

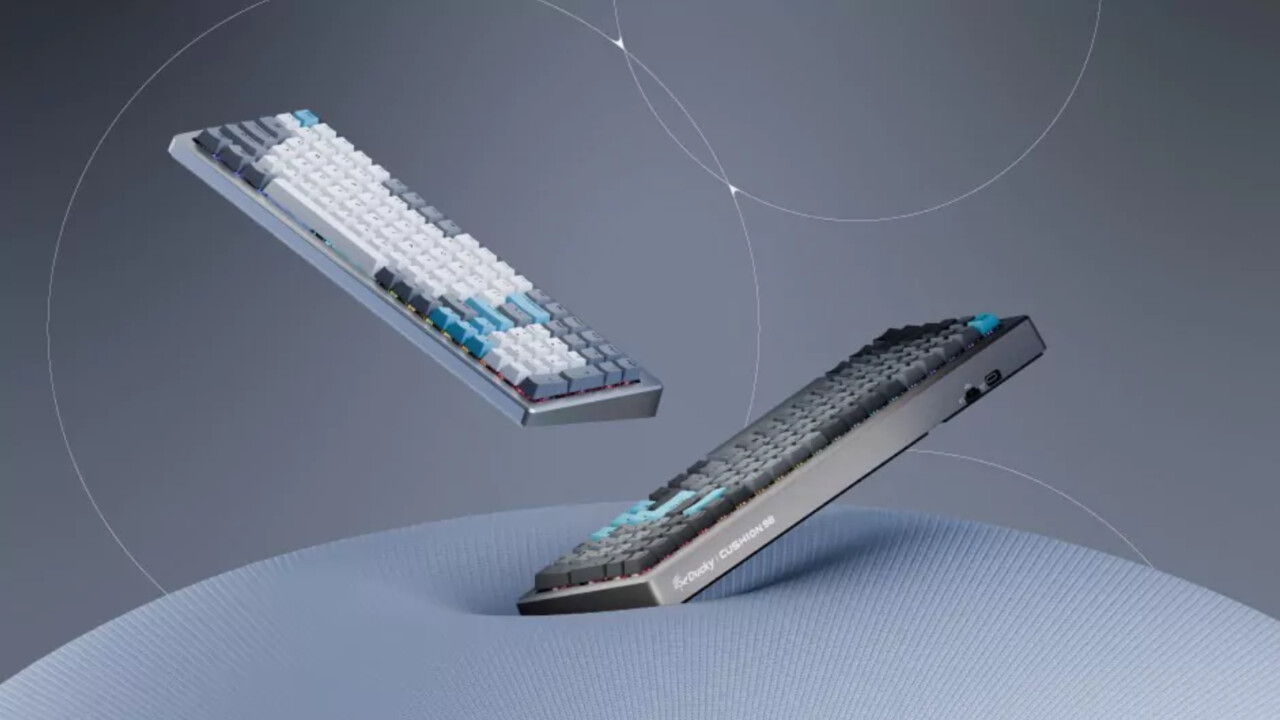

Ducky zeigt zur Computex die OK-M, eine günstige Tastatur mit quelloffener Firmware sowie ein darauf basierendes Modell mit analoger Technik. Auf der „Kissen-Tastatur“ Cushion 98 soll es sich zudem besonders sanft und leise tippen.

Ducky kann auch günstig

Die OK-M-Serie besteht aus drei Tastaturen mit 65%-, 75%- oder 98%-Layout mit Drehregler. Taster stammen von KTT und kommen in linearer oder taktiler Abstimmung mit PBT-Double-Shot-Tastenkappen und Hot-Swap-Sockeln. Geräusche werden mit fünf Schichten aus Silikon, Schaumstoff und EVA sowie einer Polycarbonat-Switchplate reduziert, Anschläge sollen dadurch weicher und gedämpfter klingen.

Tri-Mode-Verbindung (Kabel, Funk, Bluetooth) und RGB-Beleuchtung mit seitlichen Leuchtstreifen gehören ebenfalls zur Ausstattung. Programmiert wird die OK-M dank quelloffener Firmware über die anbieterunabhängige Browser-App VIA. Preise für das US-ANSI-Modell liegen auf Amazon.com zwischen umgerechnet 61 und 78 Euro, abhängig von der Tastenanzahl. Dazu muss aber immer noch die Mehrwertsteuer gerechnet werden. Wann und zu welchem Preis das ISO-Layout in den Handel kommt, ist unklar.

Der OK-M sehr ähnlich sieht die ebenfalls in drei Größen erhältliche OK-HE-Serie. Sie zielt auf Spieler und verfügt für das Segment über analoge Taster, mutmaßlich die induktiven Modelle der One X (Test), und eine erhöhte Polling-Rate von 8.000 Hz. Programmiert wird dieses Modell über eine Web-App, von quelloffener Firmware spricht Ducky aber nicht mehr.

Kissen-Tastatur

Was die Cushion98 auszeichnet, steckt im Namen. Sie soll mit ihrem 98%-Layout, das Funktionstasten neu verteilt, ruhig und gleichmäßig tippen. Den klassischen Gasket Mount, bei dem das PCB auf mehreren Gummielementen gelagert wird, ersetzt Ducky hierbei laut TechPowerUp! durch ein Silikonkissen, das Druck von Anschlägen gleichmäßig verteilen soll. In eine ähnliche Richtung gehen Duckys Silent-Taster, die „Shush-Switches“, die ebenfalls in Hot-Swap-Sockeln stecken. Änderungen von Klang und Tippgefühl werden durch eine werkzeuglos abnehmbare Oberschale erleichtert.

Gezeigt wurde die Tastatur auch in einer limitierten Sonderausgabe gezeigt. Das Red-Hare-Design spielt auf das Pferd eines berühmten chinesischen Warlords an. Für die Cushion 98 gibt es ebenfalls noch keinen Termin. Da erste Prototypen bereits im vergangenen Jahr gezeigt wurden, ist von einer Markteinführung noch 2026 auszugehen.

Apps & Mobile Entwicklung

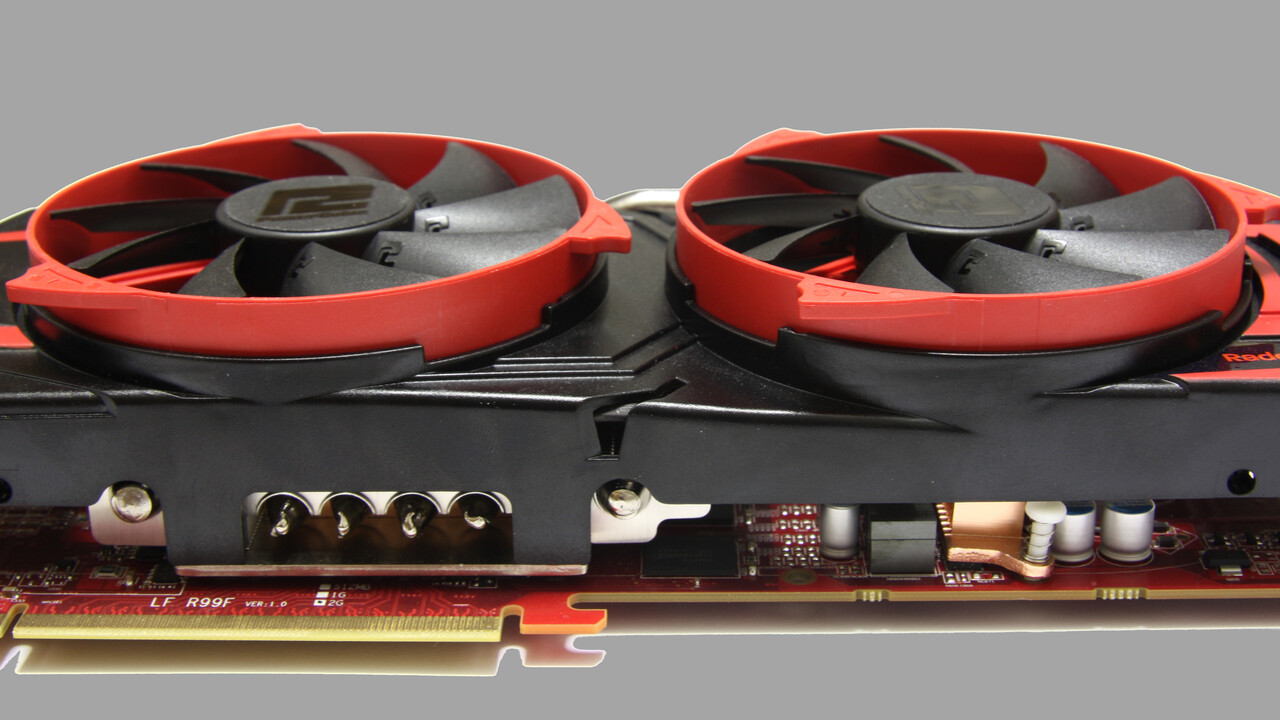

Im Test vor 15 Jahren: Die Radeon HD 6950 Vortex PCS+ mit ausfahrbaren Lüftern

Die PowerColor Radeon HD 6950 Vortex PCS+ (Test) verpackte eine HD 6950 in einem ungewöhnlichen Kleid. Die Basis stellte ein leicht modifiziertes PCB einer Radeon HD 6970 dar und darauf befand sich ein eigens entwickelter Dual-Slot-Kühlkörper, der mittels ausfahrbarer Lüfter zu einem Triple-Slot-Design mutieren konnte.

Ausfahrbare Lüfter für eine leisere und kühlere Grafikkarte

Die Radeon HD 6950 Vortex PCS+ war PowerColors vierte Radeon HD 6950 neben dem Standard-Modell, der „Dual-Fan“ mit eigenem Kühlerdesign und der „PCS++“ mit eigenem Kühlerdesign und offizieller Unterstützung für das Freischalten der deaktivierten Shader-Einheiten. Die Vortex PCS+ selbst arbeitete mit leicht erhöhten Taktraten gegenüber der Referenz.

Gekühlt wurde sie von einem eigens entwickelten Kühlkörper, der aus einem Kupferkern und einem Aluminiumradiator bestand, die mittels vier Heatpipes verbunden waren. Die warme Abluft wurde von zwei 85-mm-Axiallüftern abgeführt. Diese ließen sich per Hand ausfahren, indem die Plastikabdeckungen gedreht wurden. Somit verwandelte sich die Vortex PCS+ von einer Dual-Slot-Grafikkarte effektiv in ein Triple-Slot-Modell. PowerColor motivierte die ausfahrbaren Lüfter mit niedrigeren Temperaturen und einer gesenkten Lautstärke: Kurzum, der Kühler sollte so effizienter arbeiten können.

Gegenüber einer Radeon HD 6950 im Referenzdesign konnte die PowerColor Radeon HD 6950 Vortex PCS+ im Durchschnitt einen Leistungsvorteil von vier Prozent verbuchen. Dieser war den leicht erhöhten Taktraten zu verdanken. Zu der teureren PCS++ mit freigeschalteten Shader-Einheiten – also effektiv einer Radeon HD 6970 – fehlten ihr noch drei Prozent.

Abseits der Leistung war vor allem der Einfluss der ausfahrbaren Lüfter interessant. In Sachen Schalldruckpegel landete die Radeon HD 6950 Vortex PCS+ unter Last bei 49,5 dB(A) und somit einem guten Ergebnis. Das Ausfahren der Lüfter senkte den Schalldruckpegel um ein weiteres Dezibel, womit der Effekt eher in die Kategorie „Placebo“ fiel. Das gleiche Fazit ließ sich über die GPU-Temperatur fällen: Der ausfahrbare Lüfter hatte hier überhaupt keinen Effekt. Keinen Effekt hatte auch das Übertakten der Grafikkarte, da zumindest das getestete Modell nahezu keinen Spielraum bot. Bestenfalls drei Prozent mehr Leistung ließen sich der Radeon HD 6950 Vortex PCS+ so entlocken.

Fazit

Die PowerColor Radeon HD 6950 Vortex PCS+ war eine interessante Grafikkarte. Die Leistung war gut und die leichte Übertaktung bescherte ihr einen mess-, aber nicht spürbaren Leistungssprung gegenüber dem Referenzdesign. Das Augenmerk lag vor allem auf dem Kühler: Während der ausfahrbare Lüfter eine Spielerei ohne Nutzen war, war der Kühler generell gelungen und für eine Radeon HD 6950 sogar gut. Der Knackpunkt zum Erscheinungszeitpunkt war der Preis. Mit 248 Euro lag dieser knapp 50 Euro über dem einer Radeon HD 6950 im Referenzdesign, allerdings waren dies nur vorläufige Preise von Händlern ohne Verfügbarkeit. Laut dem Hersteller sollte die Preisdifferenz am Ende eher bei 20 Euro liegen. In diesem Fall war das PowerColor-Modell deutlich besser aufgestellt als das sehr laute Referenzdesign.

In der Kategorie „Im Test vor 15 Jahren“ wirft die Redaktion seit Juli 2017 jeden Samstag einen Blick in das Test-Archiv. Die letzten 20 Artikel, die in dieser Reihe erschienen sind, führen wir nachfolgend auf:

Noch mehr Inhalte dieser Art und viele weitere Berichte und Anekdoten finden sich in der Retro-Ecke im Forum von ComputerBase.

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 3 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenMähroboter ohne Begrenzungsdraht für Gärten mit bis zu 300 m²

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateniPhone Fold Leak: Apple spart sich wohl iPad‑Multitasking

-

Künstliche Intelligenzvor 3 Monaten

JBL Bar 1300MK2 im Test: Soundbar mit Dolby Atmos, starkem Bass und Akku‑Rears

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenPetra‑AI: KI soll Frauen in der Perimenopause unterstützen

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenEnttäuschung für die Forschung: Asteroid 2024 YR₄ wird den Mond klar verfehlen