Online Marketing & SEO

Digitalkonferenz SXSW: Wieso die Kommunikation mit Menschen und Vögeln so schwer ist

SXSW-Keynote-Speaker Aza Raskin

Auf der Digitalkonferenz SXSW in Austin näherten sich die Kognitionswissenschaftlerin Carmen Simon und der Technologie-Vordenker Aza Raskin aus unterschiedlichen Perspektiven derselben Frage: Wie entsteht unsere Wahrnehmung der Realität, wer oder was formt sie und wie kann künstliche Intelligenz einen Unterschied machen?

Aufmerksamkeit bestimmt, was wir wahrnehmen – und Wahrnehmung bestimmt, wie wir die Welt verstehen. Neurowissenschaftlerin Simon nähert sic

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

Online Marketing & SEO

Zurück zu den Wurzeln: So macht Volkswagen neugierig auf den neuen ID. Polo

Rückkehr zu den Wurzeln: Volkswagen präsentiert den neuen ID. Polo

Mit dem Launch des ID. Polo bricht die Marke Volkswagen in ein neues Zeitalter auf. Zur Weltpremiere starten die Wolfsburger gemeinsam mit der neu formierten Omnicom-Einheit Bernbach in die Kommunikation. Sie macht neugierig auf das, was im September folgt.

Da ist er endlich: der VW ID. Polo. Unaufgeregt präsentiert er sich bei seiner Weltpremiere. Fast schon ein bisschen zurückhaltend, angesich

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

Online Marketing & SEO

Neue Kampagne: Jägermeister feiert die echten Nacht-Erlebnisse seiner Markenfans

Jägermeister feiert in seiner neuen Markenkampagne (mal wieder) die Nacht

Das Nachtleben steht bei Jägermeister schon lange im Mittelpunkt der Markenkommunikation. Das ist auch in der neuen Kampagne nicht anders, die für die Kult-Spirituosen-Brand den Auftakt einer neuen Markenplattform markiert. Das Besondere: Alle Assets zeigen echte nächtliche Erlebnisse von Jägermeister-Fans.

Ob mit „Be The Meister“, „Die besten Nächte“, „Save The Night“ oder zuletzt „Für sonnengereifte Nächte“ zur Markteinführung von Jägermeister Orange – die Nacht steht schon seit einigen Jahren im Fokus der Aktivitäten der traditionsreichen Likörmarke. In diesem Jahr steht der große Werbeauftritt von Jägermeister unter dem Motto „Die Nacht gehört euch“. Damit will die Marke das Bedürfnis der in erster Linie jungen Zielgruppe nach gemeinsamen nächtlichen Erlebnissen und Momenten der Freiheit zu später Stunde bedienen und dieser Sehnsucht eine strategische Heimat geben.

„Wir glauben an die Nacht als Raum der Selbstbestimmung. Und wir glauben daran, dass wir als Marke echte Anknüpfungspunkte für Konsumenten kreieren müssen, anstatt auf werbliches Media-Storytelling zu fokussieren“, sagt Sebastian Koenen, Vice President Consumer Marketing bei Jägermeister Deutschland. „Der neue Ansatz zielt auf Echtheit, Nähe und Dialog als neues Konsumenten-Wow: Die Menschen, ihre Nächte und ihre Energie stehen im Fokus. Damit wird Jägermeister vom Broadcaster eines Markenversprechens zum Kurator echter Feiermomente.“

Die Kampagne wird großflächig auf Außenwerbeflächen zu sehen sein

Marketingchefin Larisa Hohmann

Wie Jägermeister an den besten Nächten der GenZ teilhaben will

Seit Anfang des Jahres ist Larisa Hohmann Marketingchefin bei Jägermeister. Ihre Herausforderung: den stringenten Weg der Traditionsmarke weitergehen und dabei dennoch eigene Impulse setzen. Ihr Fokus liegt dabei auf den Lebenszyklen der verschiedenen Zielgruppen. …

Online Marketing & SEO

Bessere Search Ads mit AI Max und AI Brief Update

Wichtige Neuerung für Search Marketer: AI Max kommt für Shopping und Travel, AI Brief formt das Targeting mit deinen Worten und Final URL Expansion findet immer die passende Seite für die Conversion.

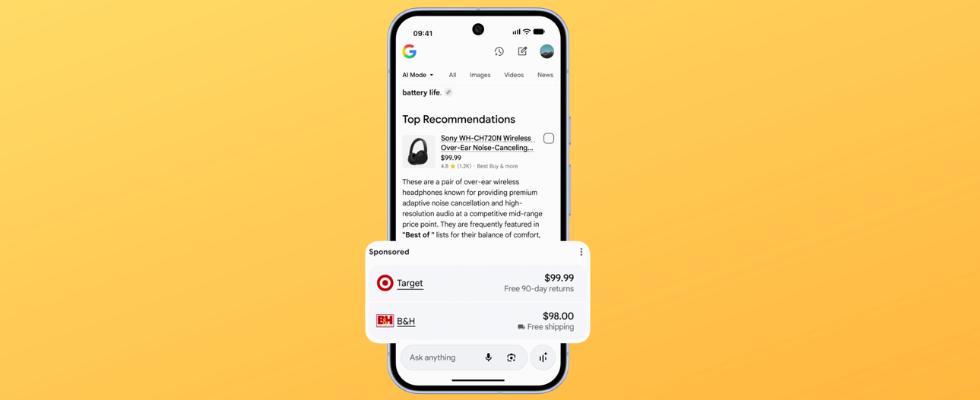

Anlässlich des ersten Geburtstags von AI Max hat Google neue Optionen für die Search Ads eingeführt. Zum einen wird die Verfügbarkeit von AI Max auf bestimmte Kampagnentypen ausgeweitet, zum anderen hilft AI Brief Advertisern künftig bei der Feinjustierung im Targeting. Und ein neues URL Feature sorgt dafür, dass auch bei Ads im konversationellen Suchkontext – etwa bei Gesprächen mit dem AI Mode – immer die passende Landing Page für User erscheint.

Google bringt neues Shopping-Werbeformat für den AI Mode

AI Max für Shopping und Travel

Die 2025 eingeführten AI Max-Funktionen werden für Shopping-Kampagnen und reisebezogene Kampagnen integriert. Beide Werbemöglichkeiten werden weltweit in allen verfügbaren Sprachen ausgerollt, allerdings in einer geschlossenen Betaversion. Mit AI Max für Shopping-Kampagnen können Advertiser Anzeigen kreieren, die unmittelbar auf Suchanfragen mit natürlicher Sprache reagieren; diese Option soll auch zu Performance Max kommen. Dabei werden die besten Formate automatisch ausgewählt, die Shoppern in ihrer Entdeckungsphase in der Suche begegnen können – je nach Kommunikationskontext. Die dynamischen Ads basieren auf Daten aus dem Produkt-Feed im Merchant Center. Mithilfe dieser Option sollen Werbetreibende mit wenig Aufwand inkrementell mehr Reichweite generieren können.

Advertiser, die im Reisekontext werben, können jetzt dank AI Max bisher fragmentierte Kampagnentypen zusammenführen. Alle relevanten Inventare können dabei in Suchkampagnen gebucht werden. Von diesem Punkt aus haben die Advertiser Zugriff auf AI Max und diverse neue Funktionen.

AI Brief und Final URL Expansion: Mit KI planen, was in die Kampagnen soll und was nicht

Zu den brandneuen Funktionen im AI Max-Kosmos gehör AI Brief. Dabei handelt es sich quasi um ein KI-Briefing für die Kampagnen. Mithilfe natürlicher Sprache kannst du Informationen zum Unternehmen einpflegen, Details zu Zielgruppen festlegen und deine Botschaften präzisieren. Du kannst zum Beispiel vorgeben, was in deinen Werbebotschaften vorkommen soll und was nicht. Das kann ein Ausschluss sein, etwa: Erwähne niemals Preise. Das kann aber ebenso ein Vorgabe für das Matching und die Audience sein. Gib zum Beispiel an, dass du vornehmlich bei Suchanfragen zu gesunden Nahrungsmitteln werben und Personen erreichen möchtest, deren Kerninteresse im Suchkontext gesundheitsbewusste Ernährung ist. Das AI Brief Feature wird auf Englisch in den kommenden Monaten zunächst für AI Max-Suchkampagnen ausgerollt. Dann folgen Performance Max- und AI Max-Shopping-Kampagnen.

Schon in den nächsten Wochen kommt dagegen weltweit und für alle Sprachen die Option Final URL Expansion. Damit können Advertiser mithilfe der Google AI die jeweils für eine komplexe Suchanfrage oder eine ausführliche KI-Kommunikation im Suchumfeld passende Landing Page bereitstellen. Google erklärt:

Landing pages are critical for conversions, but as searches become more conversational and unique, it’s become impossible to manually choose the right page for every query. Final URL expansion (FUE) uses Google AI to identify the best destination for each search, ensuring your customers find exactly what they need when they need it.

Für Advertiser in regulierten Bereichen, die spezifische Hinweise zu ihren Anzeigen in allen Werbekontexten benötigen, ist es fortan möglich, dank der Google-Text-Disclaimer alle Hinweise in Search Ads integriert zu wissen – auch beim Einsatz von Final URL Expansion.

Wer indes noch Support bei der vorgelagerten Kreation von Kampagnen benötigt, kann sich inzwischen auch in Deutschland auf das Marketing Tool Pomelli für KMU stützen.

Googles Pomelli kommt endlich nach Deutschland:

KMU Marketing Tool mit AI Power

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview

![Neu in .NET 10.0 [21]: Ausgabe der Befehle und Parameter in JSON bei SDK-Tools Neu in .NET 10.0 [21]: Ausgabe der Befehle und Parameter in JSON bei SDK-Tools](https://i2.wp.com/heise.cloudimg.io/bound/1200x1200/q85.png-lossy-85.webp-lossy-85.foil1/_www-heise-de_/imgs/18/5/0/7/4/1/4/3/dotnet-sign-6f751b3d1088dffe.jpg?w=400&resize=400,240&ssl=1)

![Neu in .NET 10.0 [21]: Ausgabe der Befehle und Parameter in JSON bei SDK-Tools Neu in .NET 10.0 [21]: Ausgabe der Befehle und Parameter in JSON bei SDK-Tools](https://i2.wp.com/heise.cloudimg.io/bound/1200x1200/q85.png-lossy-85.webp-lossy-85.foil1/_www-heise-de_/imgs/18/5/0/7/4/1/4/3/dotnet-sign-6f751b3d1088dffe.jpg?w=80&resize=80,80&ssl=1)