Online Marketing & SEO

Adobe automatisiert Kreativarbeit mit neuem Firefly AI Assistant

Von der Idee zum fertigen Asset in Minuten: Der neue Firefly AI Assistant erstellt Social Content, Mockups und Designs per Prompt. Mit über 60 Funktionen, Creative Skills und integrierten Top-KI-Modellen baut Adobe die Zukunft kreativer Arbeit.

Im März hat der Software-Konzern diverse KI-Tools in Firefly gelauncht. Jetzt folgt „one of the most exciting betas we’ve ever shipped“, so Adobe in der Ankündigung. Denn Firefly wird agentisch. Statt einzelne Funktionen in Adobe Photoshop, Adobe Premiere Pro oder Adobe Lightroom anzusteuern, beschreiben User einfach das gewünschte Ergebnis. Der Assistant übernimmt die Umsetzung im Hintergrund.

Photoshop ohne Profi-Skills:

Adobe bringt AI Assistant für Photoshop und neue KI in Firefly

So funktioniert der neue Firefly AI Assistant

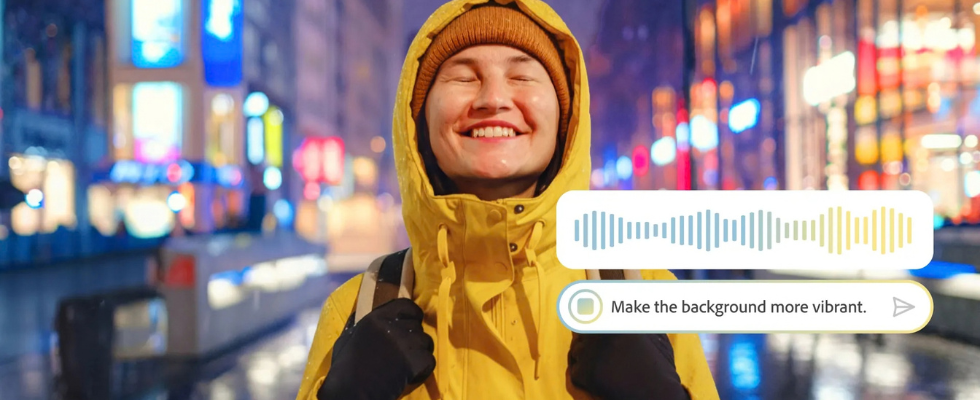

Im Kern läuft alles über eine zentrale Chat-Oberfläche. Statt Tools anzusteuern, beschreiben User einfach, was sie erstellen wollen, und der Firefly AI Assistant setzt es um. Ein Prompt reicht, um aus einem Produktbild Social Assets zu generieren, ein Moodboard zu erstellen oder Bilder zu optimieren. Der Assistant koordiniert dabei mehrstufige Workflows über die Creative Cloud hinweg und übernimmt die Umsetzung im Hintergrund. Wie der Firefly AI Assistant in der Praxis arbeitet, zeigt Adobe an mehreren Beispielen: User können etwa ein Event-Foto hochladen, den gewünschten Output formulieren, und der Assistant übernimmt. Er erstellt Zuschnitte, passt Formate an und optimiert Inhalte direkt für mehrere Plattformen.

Zum Start greift der Assistant auf über 60 Funktionen aus Tools wie Adobe Photoshop, Adobe Lightroom oder Adobe Premiere Pro zu. Dazu gehören Features wie Generative Fill, Remove Background oder Auto Tone. Ergänzt werden diese neuen Funktionen durch sogenannte Creative Skills. Das sind vorgefertigte Abläufe für typische Aufgaben wie mehrere Bilder auf einmal bearbeiten, Mockups erstellen oder Inhalte für Social Media anpassen. Inhalte lassen sich dabei medienübergreifend erstellen, von der ersten Idee bis zum finalen Output.

Trotz der Automatisierung behalten User die Kontrolle. Jeder Schritt lässt sich einsehen, der Prozess kann jederzeit angepasst werden. Die Ergebnisse landen direkt in der Creative Cloud und sind in allen Apps verfügbar.

Firefly holt Top KI-Modelle an Bord

Mit dem Firefly AI Assistant verfolgt Adobe die Anfang April vorgestellte Vision von „agentic creativity“. Kreative Arbeit soll immer weniger aus Tool-Bedienung bestehen und mehr Raum für Ideenfindung und Konzeptarbeit schaffen. Die Public-Beta startet weltweit für Nutzer:innen mit Creative Cloud Pro oder kostenpflichtigen Firefly-Abonnements wie Pro, Pro Plus und Premium und wird schrittweise ausgerollt.

Parallel erweitert Adobe das Modellökosystem in Firefly. Neben eigenen Funktionen integriert die Plattform inzwischen auch externe KI-Modelle wie GPT Image 2 von OpenAI sowie Lösungen von Google, Runway und ElevenLabs. Ergänzt wird das durch neue Features wie Precision Flow und AI Markup, die mehr Kontrolle im kreativen Prozess ermöglichen. Perspektivisch sollen die eigenen Tools zudem auch in Drittumgebungen verfügbar gemacht werden, etwa in Kombination mit Claude von Anthropic.

„Du orchestrierst Agents wie ein Teamchef Aufgaben verteilt“:

Der Sprung von Gen AI zu Agentic AI

Online Marketing & SEO

GPT-5.5 Prompt Guide: Warum weniger Input mehr bringt

Statt komplexer Schrittfolgen liefert GPT-5.5 somit die besten Ergebnisse, wenn User kurze, ergebnisorientierte Prompts formulieren. Zu viele Anweisungen verschlechtern die Output-Qualität, weil sie den Lösungsraum einschränken. Für weitere Details zu den Verhaltensänderungen von GPT-5.5 empfiehlt OpenAI, mit dem Leitfaden „Using GPT-5.5“ zu starten.

GPT-5.5 ist OpenAIs schlauestes Modell:

Arbeit von Monaten in Minuten

Unterschätzte Prompt-Hebel: Personality und Collaboration Style

OpenAI trennt im Prompting zwei Ebenen, die oft vermischt werden und genau deshalb für inkonsistente Ergebnisse sorgen. Personality und Collaboration Style. Der Collaboration Style legt fest, wie das Modell an Aufgaben herangeht. Ob es direkt loslegt oder erst nachfragt. Ob es Annahmen trifft oder strikt auf Input wartet. Wie viel Kontext es liefert. Und ob es Ergebnisse eigenständig überprüft oder einfach ausgibt. Das ist vor allem relevant, wenn du mit komplexeren Tasks, Automatisierungen oder agentischen Workflows arbeitest.

Die Personality legt fest, wie das Ergebnis klingt. Also ob es nüchtern, beratend oder eher kreativ formuliert ist. Im Marketing-Kontext entscheidet das darüber, ob ein Text nach Support, Beratung oder Kampagne klingt. So sieht ein typischer Personality Prompt aus:

# Personality

You are a capable collaborator: approachable, steady, and direct. Assume the user is competent and acting in good faith, and respond with patience, respect, and practical helpfulness.Prefer making progress over stopping for clarification when the request is already clear enough to attempt. Use context and reasonable assumptions to move forward. Ask for clarification only when the missing information would materially change the answer or create meaningful risk, and keep any question narrow.

Stay concise without becoming curt. Give enough context for the user to understand and trust the answer, then stop. Use examples, comparisons, or simple analogies when they make the point easier to grasp. When correcting the user or disagreeing, be candid but constructive. When an error is pointed out, acknowledge it plainly and focus on fixing it.

Match the user’s tone within professional bounds. Avoid emojis and profanity by default, unless the user explicitly asks for that style or has clearly established it as appropriate for the conversation.

Wenn du deine Markenstimme schärfen willst, ergänzt du im Prompt Tonalität, Stil und Haltung deiner Brand, damit Inhalte konsistent und wiedererkennbar sind.

Mit diesem Trick antwortet GPT-5.5 „schneller“

GPT-5.5 antwortet bei komplexeren Aufgaben oft nicht sofort, weil es im Hintergrund erst plant. Auf User wirkt das manchmal so, als arbeite die KI „langsam“. OpenAI empfiehlt einen einfachen Trick: Lass das Modell direkt kurz reagieren, bevor es loslegt. Das kannst du so in den Prompt schreiben:

Before any tool calls for a multi-step task, send a short user-visible update that acknowledges the request and states the first step. Keep it to one or two sentences.

Auch bei komplexeren Setups kannst du dem Modell direkt am Anfang sagen, wie es starten soll:

You must always start with an intermediary update before any content in the analysis channel if the task will require calling tools. The user update should acknowledge the request and explain your first step.

Der Effekt: GPT-5.5 wirkt deutlich schneller und transparenter, obwohl die KI im Hintergrund genauso arbeitet.

Vergiss Schritt-für-Schritt-Prompts: So holst du mehr aus GPT-5.5 raus

GPT-5.5 braucht keine Schritt-für-Schritt-Anleitung für jeden Zwischenschritt. Besser funktioniert ein Prompt, der deutlich aufzeigt, welches Ergebnis am Ende stehen soll, welche Kriterien erfüllt sein müssen und welche Grenzen gelten. OpenAI empfiehlt deshalb, Aufgaben stärker vom Ziel aus zu formulieren. Also nicht: Erst A prüfen, dann B vergleichen, dann C erklären. Sondern: Löse das Problem vollständig und liefere genau diese Bestandteile. So sieht das im Guide aus:

Resolve the customer’s issue end to end.

Success means:

- the eligibility decision is made from the available policy and account data

- any allowed action is completed before responding

- the final answer includes completed_actions, customer_message, and blockers

- if evidence is missing, ask for the smallest missing field

Was du vermeiden solltest, sind harte Regeln wie „always“, „never“, „must“ oder „only“, wenn sie gar nicht wirklich nötig sind. Solche Begriffe gehören in Sicherheitsregeln oder Pflichtfelder, aber nicht in jede normale Arbeitsanweisung. Diesen Stil solltest du laut OpenAI nur nutzen, wenn wirklich jeder Schritt gebraucht wird:

First inspect A, then inspect B, then compare every field, then think through

all possible exceptions, then decide which tool to call, then call the tool,

then explain the entire process to the user.

Besser sind klare Stop-Regeln. Sie sagen dem Modell, wann genug geprüft wurde und wann es antworten soll:

Resolve the user query in the fewest useful tool loops, but do not let loop minimization outrank correctness, accessible fallback evidence, calculations, or required citation tags for factual claims.

After each result, ask: „Can I answer the user’s core request now with useful evidence and citations for the factual claims?“ If yes, answer.

Und wenn Belege fehlen, sollte das Modell nicht einfach weiterraten oder pauschal verneinen:

Use the minimum evidence sufficient to answer correctly, cite it precisely, then stop.

Je genauer du Ziele und Regeln vorgibst, desto weniger Detailsteuerung braucht GPT 5.5 somit.

15 ChatGPT Prompts, um 15 Stunden pro Woche zu sparen

Zu lang, zu unübersichtlich? So steuerst du Länge und Format bei GPT-5.5 richtig

GPT-5.5 kann das Format, die Länge und die Struktur ziemlich genau einhalten, wenn du diese Punkte vorgibst. Viele erklären diese jedoch nicht und wundern sich dann über zu lange oder unübersichtliche Antworten. Der wichtigste Hebel ist text.verbosity. Standard ist medium. Wenn du kürzere Antworten willst, stellst du im Prompt auf low oder schreibst direkt dazu, dass die Antwort kurz sein soll.

Beim Format gilt eine einfache Regel. Erstmal Fließtext. Also kurze Absätze, gut lesbar, ohne unnötige Aufzählungen. Listen oder Überschriften nur dann, wenn sie wirklich helfen, zum Beispiel bei Vergleichen oder mehreren Punkten. Zusätzlich solltest du immer sagen, für wen der Text ist und wie lang er sein soll. Zum Beispiel so:

Write for a senior business audience. Keep the answer under 400 words. Use short paragraphs and only include bullets when they improve scannability. Prioritize the conclusion first, then the reasoning, then caveats.

Das sorgt dafür, dass der Output direkt besser passt, ohne viel Nacharbeit. Wenn du Texte überarbeiten lässt, fehlt oft eine wichtige Info. Was soll gleich bleiben. Wenn du das nicht sagst, verändert das Modell schnell mehr als gewollt. Deshalb:

Preserve the requested artifact, length, structure, and genre first. Quietly improve clarity, flow, and correctness. Do not add new claims, extra sections, or a more promotional tone unless explicitly requested.

Am Ende gilt. Wenn du Format, Länge und Zielgruppe klar vorgibst, bekommst du deutlich passendere Ergebnisse ohne ständiges Nachjustieren

Mit dem richtigen Prompt zu präzisen, sauber belegten Antworten

Wenn du verlässliche Antworten willst, musst du im Prompt festlegen, was belegt werden soll und wann genug Belege vorliegen. Sonst entscheidet das Modell selbst und das führt schnell zu unsauberen Aussagen. Ein weiterer Hebel ist das sogenannte Retrieval Budget. Damit legst du fest, wie oft und wann überhaupt gesucht wird. Ohne diese Begrenzung sucht das Modell oft zu viel oder an den falschen Stellen. So beschreibt es OpenAI im Guide:

For ordinary Q&A, start with one broad search using short, discriminative keywords. If the top results contain enough citable support for the core request, answer from those results instead of searching again.

Weitere Suchen sollen nur dann passieren, wenn wirklich etwas fehlt:

Make another retrieval call only when:

- The top results do not answer the core question.

- A required fact, parameter, owner, date, ID, or source is missing.

- The user asked for exhaustive coverage, a comparison, or a comprehensive list.

- A specific document, URL, email, meeting, record, or code artifact must be read.

- The answer would otherwise contain an important unsupported factual claim.

Wichtig ist auch, was du vermeidest. Nicht nochmal suchen, nur um Formulierungen zu verbessern oder zusätzliche Beispiele einzubauen:

Do not search again to improve phrasing, add examples, cite nonessential details, or support wording that can safely be made more generic.

Wenn du präzisierst, wann genug Information da ist und wann nachgelegt werden muss, werden Antworten präziser und unnötige Schleifen vermieden.

Lass GPT-5.5 die Ergebnisse selbst prüfen

Wenn möglich, gib GPT-5.5 Zugriff auf Tools oder fordere es im Prompt explizit dazu auf, die Ergebnisse zu überprüfen. Ohne diesen Schritt bleiben Fehler oft unentdeckt. Gerade bei Code solltest du solche Checks vorgeben:

After making changes, run the most relevant validation available:

- targeted unit tests for changed behavior

- type checks or lint checks when applicable

- build checks for affected packages

- a minimal smoke test when full validation is too expensive

If validation cannot be run, explain why and describe the next best check.

Auch bei visuellen Outputs lohnt sich ein zusätzlicher Schritt. Lass das Modell das Ergebnis prüfen, bevor es fertig ist:

Render the artifact before finalizing. Inspect the rendered output for layout, clipping, spacing, missing content, and visual consistency. Revise until the rendered output matches the requirements.

Und bei Konzepten oder technischen Plänen solltest du Struktur einfordern. Zum Beispiel:

For implementation plans, include:

- requirements and where each is addressed

- named resources, files, APIs, or systems involved

- state transitions or data flow where relevant

- validation commands or checks

- failure behavior

- privacy and security considerations

- open questions that materially affect implementation

Wenn du bei Visuals nicht mehr nur Ideen, sondern direkt nutzbare Assets willst, brauchst du Images 2.0. Das Modell generiert Text im Bild sauber und lesbar und macht Visuals damit sofort einsatzbereit für Ads, Social oder Kampagnen statt nur für erste Entwürfe.

Die detailliertesten KI-Bilder aller Zeiten?

Das ist ChatGPT Images 2.0

Online Marketing & SEO

HORIZONT x Social Match Un:filtered: Wie Schmuckmarke Purelei Community und Commerce verbindet

Purelei-Gründerin Alisa Jahnke und Martin Wroblewski, Managing Director von Social Match & Chief Client Officer bei We Are Era

Mit dem Hawaii-Spirit im Gepäck wollte Alisa Jahnke das Aloha-Lebensgefühl nach Deutschland bringen. Was einst als persönliche Idee begann, entwickelte sich zu einer der bekanntesten Schmuckmarken im Social-Commerce-Umfeld. In der neuen Ausgabe von Un:filtered spricht die Gründerin über den Aufbau einer starken Community und die Herausforderungen des Unternehmertums.

2016 kehrte Jahnke von ihrem Auslandssemester auf Hawaii zurück und stellte fest, dass ihr genau die Leichtigkeit und positive Energie fehlten

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

Online Marketing & SEO

Weniger Vertrauen, mehr Relevanz: Warum Angebotskommunikation stärker gesteuert werden muss

Beim alltäglichen Einkauf fallen vielfach die aktuell erhöhten Preise auf. Das ist auch für den Handel ein Problem

Angesichts steigender Energiepreise und der wieder anziehenden Inflation halten viele Menschen ihr Geld beisammen. Auch beim täglichen Einkauf achten viele Verbraucher zunehmend auf Angebote, die Markenbindung nimmt ab. Welche Folgen das für die Angebotskommunikation hat, erklärt Julian Klein, Country Manager Germany des auf digitale Handelskommunikation spezialisierten Unternehmens Shopfully.

Eine aktuelle Shopper-Studie von Simon-Kucher & Partners liefert einen unbequemen Befund: Mehr als ein Drittel der Befragten sieht Markenartikel v

Jetzt Angebot wählen und weiterlesen!

HORIZONT Digital

- Vollzugriff auf HORIZONT Online mit allen Artikeln

- E-Paper der Zeitung und Magazine

- Online-Printarchiv

HORIZONT Digital-Mehrplatzlizenz für Ihr Team

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter