Künstliche Intelligenz

Die OOP Konferenz kommt direkt ins (Home) Office: Die neue Live-Webinar-Reihe

Die OOP-Konferenz geht mit einer neuen Webinar-Reihe in die kommenden Monate, die sich direkt an IT-Professionals richtet. Teilnehmende können die Sessions bequem vom eigenen Arbeitsplatz aus verfolgen und erhalten Zugang zu Best Practices, Methoden und Strategien aus der IT-Branche. Die Webinare sollen Gelegenheit zum Austausch mit Gleichgesinnten bieten und Impulse für Karriere und Projekte liefern.

Weiterlesen nach der Anzeige

Termine und Themen der Webinar-Reihe

Bisher wurden drei Termine angekündigt: 30. April, 28. Mai und 9. Juni. Weitere Tage mit jeweils einem bis zwei Vorträgen sollen folgen. Zu den geplanten Themen gehören der Einsatz von Large Language Models (LLMs) in der Softwareentwicklung, das Model Context Protocol (MCP) und die Dokumentation von KI-Systemen.

Als Eröffnung am 30. April wird Michael Stal sich mit den praktischen Grenzen generativer KI im Softwareengineering befassen. Die Analyse großer Softwarearchitekturen durch LLMs scheitert häufig am beschränkten Kontextfenster der Foundation-Modelle. Dies gilt auch für die Generierung entsprechender Systeme.

Kai Tödter plant im Anschluss eine Session zum Model Context Protocol, einer Methode zur Orchestrierung von Kontextdaten für LLMs. Ein MCP-Server mit Spring AI soll entwickelt werden, der über Claude Desktop mit einem Movie- und einem Wetter-Service verbunden wird. Die Anbindung soll sowohl über STDIO als auch über REST demonstriert werden.

Praxisberichte und Compliance-Themen

Drei weitere Vorträge wurden ebenfalls bereits veröffentlicht: Benedikt Stemmildt will den Unterschied zwischen „Vibe Coding“ und professionellem „Agentic Engineering“ aufzeigen. Viele Entwickler werfen wahllose Prompts an KI-Systeme, ohne strukturiert vorzugehen. In einer Live-Demo soll gezeigt werden, wie sich eine Funktion in der Hälfte der üblichen Zeit programmieren lässt.

Dirk Riehle wird über adaptive Dokumentationssysteme durch KI-gestützte Entwicklersimulation berichten. Die Session soll Einblicke in zwei Projekte geben: die Implementierung von KI-gestützter Dokumentation in Payment-Systemen sowie Erfahrungen aus der KI-Startup-Welt Nordamerikas und des arabischen Raums. Beide Vorträge finden am 28. Mai statt.

Weiterlesen nach der Anzeige

Ingo Eichhorst befasst sich im Juni dann mit rechtlichen Anforderungen bei der Verwendung von Open-Source-Software. Unternehmen, die Produkte mit Open-Source-Komponenten vertreiben, müssen sowohl Lizenzbestimmungen als auch Regulierungen wie den Cyber Resilience Act der Europäischen Union einhalten. Dazu gehören die Deklaration der Software Bill of Materials, die Prüfung auf unerwünschten Code, korrekte rechtliche Hinweise und die Überwachung von Sicherheitslücken.

Die Webinare bieten die Möglichkeit, Fragen direkt via Chat und Zoom zu stellen. Teilnehmende erhalten ein Jahr lang Zugang zu allen Vortragsvideos und Materialien.

Alle Informationen zur Veranstaltung und Anmeldung finden Sie auf der Webseite.

()

Künstliche Intelligenz

Wichtigster Server-CPU-Benchmark bekommt ein Update nach 9 Jahren

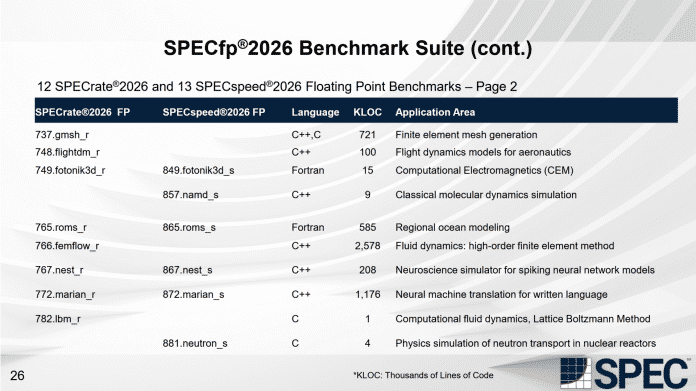

Die Standard Performance Evaluation Corporation (SPEC) aktualisiert nach neun Jahren ihren wichtigsten Benchmark: Auf SPEC CPU 2017 folgt SPEC CPU 2026 mit einem runderneuerten Unterbau. Der zugrundeliegende Test wächst von 43 auf 52 Teil-Benchmarks.

Weiterlesen nach der Anzeige

Anders als andere Benchmarks wie Cinebench oder Geekbench enthalten alle SPEC-CPU-Versionen keine fertige Installationsdatei. Das verantwortliche Konsortium stellt den Quellcode bereit, den Tester selbst kompilieren müssen. Die Idee dahinter: So läuft der Test auf allerlei Hardware und Nutzer können den Benchmark beliebig optimieren, etwa auch um neue CPU-Funktionen auszunutzen.

Hinter SPEC stecken die wichtigsten CPU-Designer, Serverhersteller, Hyperscaler und Forscher. Mit dabei sind etwa AMD, Intel, Nvidia, ARM, Ampere, IBM, Microsoft, Oracle, Supermicro, HPE, Dell, Cisco, Lenovo und SiFive.

SPEC CPU ist in der Industrie weitverbreitet, auch als Standard-Benchmark bei AMD und Intel. Unter Privatanwendern fristet die Suite ein Nischendasein, weil zusätzlich zum jeweiligen Kompilieren die Bedienung per Kommandozeile hinzukommt.

Neue Test-Suite

Wie schon seine Vorgänger stammen alle Teil-Benchmarks von SPEC CPU 2026 „aus der echten Welt“. Das Konsortium sucht dazu Anwendungen aus, die es in seine Suite aufnimmt. Überraschung: Der Render-Teil mit Blender fällt ersatzlos raus, ebenso der x264-Encoder für das Videoformat H.264. Neu dabei sind etwa CPython, ein FLAC-Audio-Encoder und die Datenbank-Engine SQLite.

SPEC

)

Der Basisdurchgang (Base) limitiert alle 52 Teil-Benchmarks auf einen einzigen Compiler mit denselben Flags. „Peak“ erlaubt Compiler-Optimierungen pro Teil-Benchmark, um die Leistung jeweils zu maximieren. Nutzer müssen in C, C++ und Fortran optimieren.

Weiterlesen nach der Anzeige

SPEC CPU 2026 kann auch moderne Serverprozessoren mit 128 CPU-Kernen und mehr auslasten. Einige der Integer-Tests sollen mit vielen Instruktionen explizit das Prozessor-Front-End überlasten, das die Befehle übersetzt und dann an die Rechenwerke verteilt.

Die Test-Suite inkludiert jetzt aber auch explizit Einplatinencomputer wie Raspberry Pis und RISC-V-Prozessoren. Die offizielle Datenbank führt etwa Ergebnisse mit dem Raspi 5 16 GByte auf (mit offensichtlich wenigen Punkten).

Viele Threads brauchen viel RAM

Jede laufende Instanz benötigt 2 GByte RAM. Wer einen modernen Desktop-Prozessor wie AMDs Ryzen 9 9950X3D2 mit 32 Threads auslasten will, benötigt also 64 GByte Arbeitsspeicher. Ein 128-Kerner mit 256 Threads erfordert 512 GByte.

Eine Lizenz für SPEC CPU 2026 kostet standardmäßig 3000 US-Dollar. Upgrader von der 2017er-Version zahlen 2000 US-Dollar (befristet bis 3. November 2026). Gemeinnützige Organisationen zahlen 750 US-Dollar. Akkreditierte Universitäten und Hochschulen bekommen die Lizenz kostenlos.

(mma)

Künstliche Intelligenz

Sovereignty Washing: Wie man Cloud-Souveränität wirklich bewertet

Digitale Souveränität ist kein Standardprodukt, sondern eine strategische Entscheidung mit individuellen Konsequenzen. Das formulierte iX-Autor Kai Müller bereits 2025 treffend. Aber die Entscheidung bleibt häufig auf der Ebene der Absicht. Und zwischen der strategischen Absicht und der operativen Realität klafft eine Lücke.

Wer heute einen souveränen Cloud-Anbieter auswählen muss, steht vor einem Markt, auf dem fast jeder Anbieter für sich beansprucht, souverän zu sein. Die Substanz hinter dem Label fällt aber unterschiedlich aus.

- US-Hyperscaler kaschieren strukturelle Jurisdiktionsrisiken mit EU-Tochtergesellschaften, während europäische Anbieter EU-Eigentümerschaft als Souveränitätsgarantie vermarkten, aber technische Lücken aufweisen.

- Eine Analyse von siebzehn Anbietern anhand von 31 Kriterien zeigt: Die verschiedenen Anbieter unterscheiden sich in ihren Stärken und Schwächen, aber keiner lässt sich als klarer „Souveränitätssieger“ bezeichnen.

- Insbesondere bei der Kryptografie und Schlüsselkontrolle weisen die meisten Anbieter – ob europäisch oder amerikanisch – eine offene Flanke auf. Abhängigkeit durch die Lieferkette relativiert außerdem jedes Souveränitätsversprechen eines europäischen Standorts.

- Für Anbieter sind Zertifizierungen ein zweischneidiges Schwert: BSI-C5-Attestierung, SecNumCloud und ISO 27001 sorgen zwar für gute Souveränitätswerte, schaffen aber hohe Einstiegshürden in den Markt.

Es lohnt sich also zu prüfen, was hinter den Versprechen steckt – auf der Grundlage von Daten aus dem Sovereign Cloud Compass, einem öffentlich zugänglichen Vergleichswerkzeug.

Das war die Leseprobe unseres heise-Plus-Artikels „Sovereignty Washing: Wie man Cloud-Souveränität wirklich bewertet“.

Mit einem heise-Plus-Abo können Sie den ganzen Artikel lesen.

Künstliche Intelligenz

Seit 1987 weiterentwickelt: Großes Update für Spiele-Oldie „NetHack“

Mit „NetHack“ hat eines der ältesten immer noch aktiv entwickelten Computerspiele ein weiteres großes Update erhalten, von Version 3.6.7 geht es damit direkt auf 5.0.0. Das Update nimmt nicht nur Bugfixes vor, sondern bringt auch zahlreiche Änderungen am Spiel selbst – insgesamt sprechen die Verantwortlichen von mehr als 3100 Modifikationen am Code. Alle lassen sich einsehen.

Weiterlesen nach der Anzeige

Das Team warnt jedoch, dass einige der Einträge – vor allem zu neuen Funktionen – Spoiler enthalten könnten. Außerdem laufen bisherige Spielstände nach dem Update nicht mehr.

Auch mal zehn Jahre Update-Pause

„NetHack“ gibt es seit 1987, die erste freigegebene Version war eine deutliche Weiterentwicklung des 1984 veröffentlichten Spiels „Hack“, das sich wiederum stark am vier Jahre älteren „Rogue“ orientierte. Danach erschienen Updates in unregelmäßigen Abständen, teils mit mehr als zehn Jahren Pause. Nach dem jüngsten großen Update auf Version 3.6.0 erschienen mehrere kleinere Updates, die vor allem Fehler behoben. Das aktuelle Update verbessert unter anderem die generelle Architektur der Software.

„NetHack“ ist ein textbasiertes Rollenspiel, dessen „Grafik“ anfangs aus ASCII-Zeichen bestand. Das Spiel läuft aber inzwischen auf unterschiedlichsten Plattformen, längst auch mit grafischen Oberflächen, die viele Spieler bevorzugen. Mit einem zuvor angepassten Charakter erkundet man einen immer wieder neu generierten Dungeon auf der Suche nach dem Amulett von Yendor, das der böse Moloch gestohlen hat. Dabei geht es explizit nicht darum, alles und jeden zu töten, sondern die Erkundung. Bekannt ist „NetHack“ hauptsächlich für seinen enormen Umfang, den Humor und dafür, dass das Spiel auf jede denkbare Spielsituation vorbereitet zu sein scheint. Es gibt einen umfangreichen „Reiseführer“, der für das aktuelle Update angepasst wurde.

(mho)

-

Künstliche Intelligenzvor 3 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick