Apps & Mobile Entwicklung

Arm Flexible Access: Lizenzmodell öffnet sich mit neuer IP für größere Start-ups

Arm reduziert für Start-ups die Hürden bei der Nutzung des Lizenzmodells Arm Flexible Access, sodass jetzt auch höhere Fördersummen und Umsätze dennoch eine zunächst kostenfreie Nutzung zulassen. Außerdem stellt Arm das Gebührenmodell auf ein Angebot für alle Partner um und ermöglicht für weniger Geld unlimitierte Tape-outs.

Arm Flexible Access Entry sowie die kostenfreie Variante für Start-ups sind Lizenzmodelle, die bislang als Bindeglied zwischen dem günstigsten Flexible-Lizenzmodell „DesignStart“ und dem Komplettpaket „Standard Licensing“ fungierten. Bei Arm Flexible Access werden Lizenzgebühren für jedes lizenzierte Produkt erst nach der Entwicklung des SoCs und nicht schon vorab fällig. Flexible Access gibt Partnern Zugriff auf ein breites Spektrum an IP, darunter zahlreiche Cortex-Kerne, GPUs, Interconnects, System-Controller, Sicherheits-IP, Peripherie, Debug und Trace sowie Design-Kits. Auch Zugriff auf physische IP, Werkzeuge sowie Support erhalten Partner über die Lizenz.

Start-ups dürfen mehr Förderung erhalten

Start-ups konnten bislang kostenlos auf den Flexible Access zugreifen, sofern sie gewisse Fördersummen und Umsätze nicht überschreiten. Das sollte sicherstellen, dass das Programm tatsächlich nur von gewissen Start-ups genutzt werden kann. Die maximale Fördersumme eines Start-ups lag bislang bei 20 Millionen US-Dollar, fortan liegt das Limit aber bei 50 Millionen US-Dollar. Auch der Jahresumsatz darf mit 5 Millionen statt 1 Million US-Dollar jetzt auf höherem Niveau liegen.

Neue IP im Arm Flexible Access

Neuerdings gehört zu dem Programm mit der Ethos-U85 auch eine deutlich stärkere NPU. Damit will Arm die Künstliche Intelligenz an der Edge, also die KI direkt auf dem Endgerät des Nutzers, in breiterem Maße in den technischen Lösungen der Start-ups fördern. Die Ethos-U85 hatte Arm bereits letztes Jahr für den Flexible Access in Aussicht gestellt, als mit dem Cortex-A320 auch der erste CPU-Kern mit Armv9 Einzug hielt.

Arm Flexible Access umfasst jetzt außerdem die Corstone-320, eine Referenzplattform aus IP und Software, die unter anderem Cortex-M85 CPU, Ethos-U85 NPU und Arm Mali-C55 ISP zu einer Lösung zusammenfasst. SoC-Designer sollen damit vergleichsweise schnell AI-Edge-Lösungen für Wearables, Vision-Geräte, Sprachinterfaces und IoT-Systeme auf die Beine stellen können. Mit dem Cortex-M52 gehört zudem die laut Arm flächen- und energieeffizienteste Umsetzung der Armv8.1-M-Architektur zum Portfolio.

Ein Lizenzmodell für 85.000 US-Dollar

Wie sich an dem Programm teilnehmen lässt, hat Arm ebenfalls umgestellt. Für alle Partner gilt nun eine einzige jährliche Gebühr von 85.000 US-Dollar. Start-ups bleiben bis zu den genannten Grenzen davon ausgenommen. Bislang waren für 80.000 US-Dollar maximal drei Tape-outs pro Jahr möglich, wenn gewisse M-Prozessoren als Hauptprozessor der Gesamtlösung fungierten, ansonsten war sogar nur ein Tape-out möglich. Erst für 212.000 US-Dollar pro Jahr waren unlimitierte Tape-outs möglich. Diese Einschränkung fällt mit der jetzt einheitlichen Gebühr weg.

Apps & Mobile Entwicklung

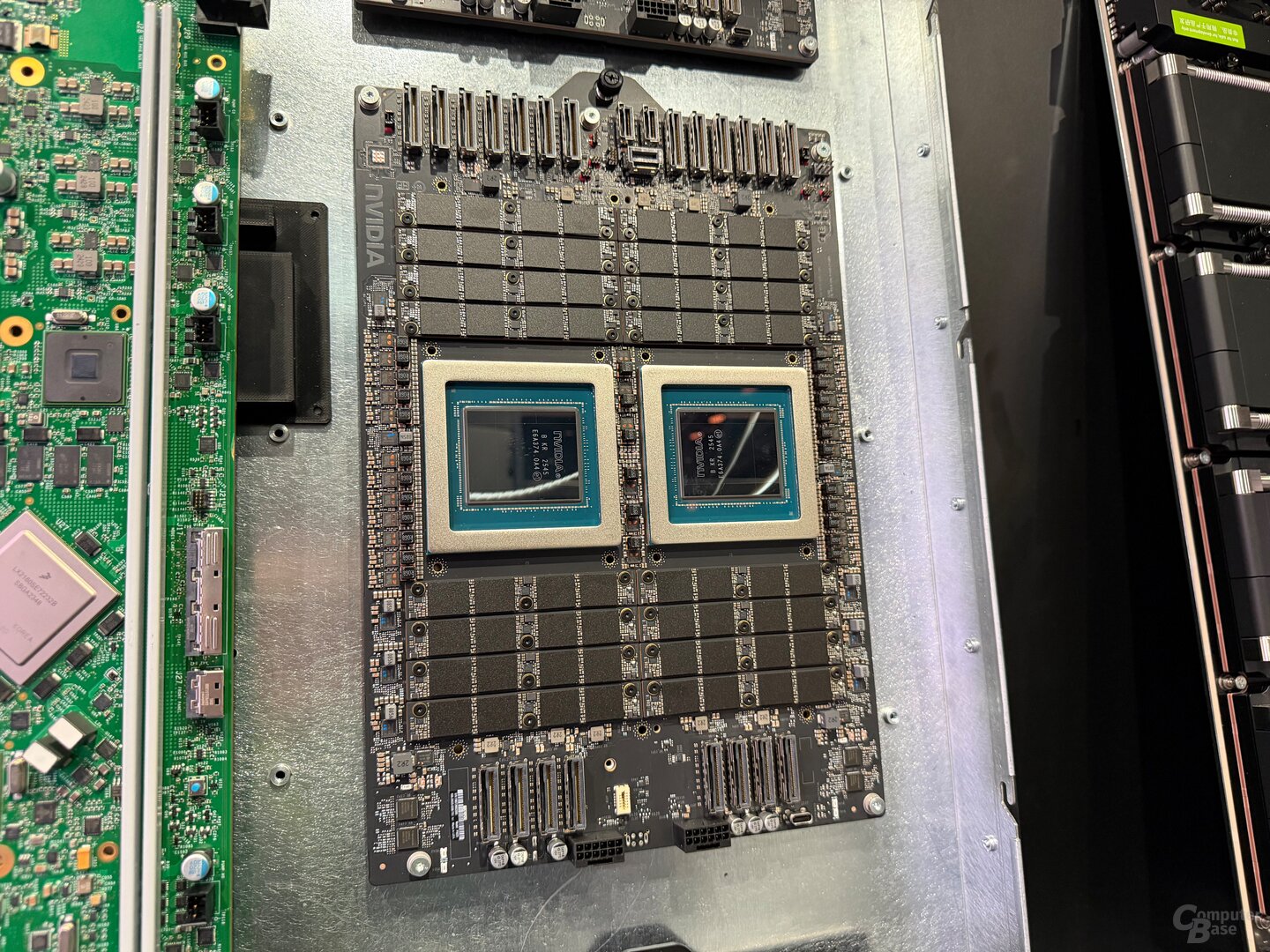

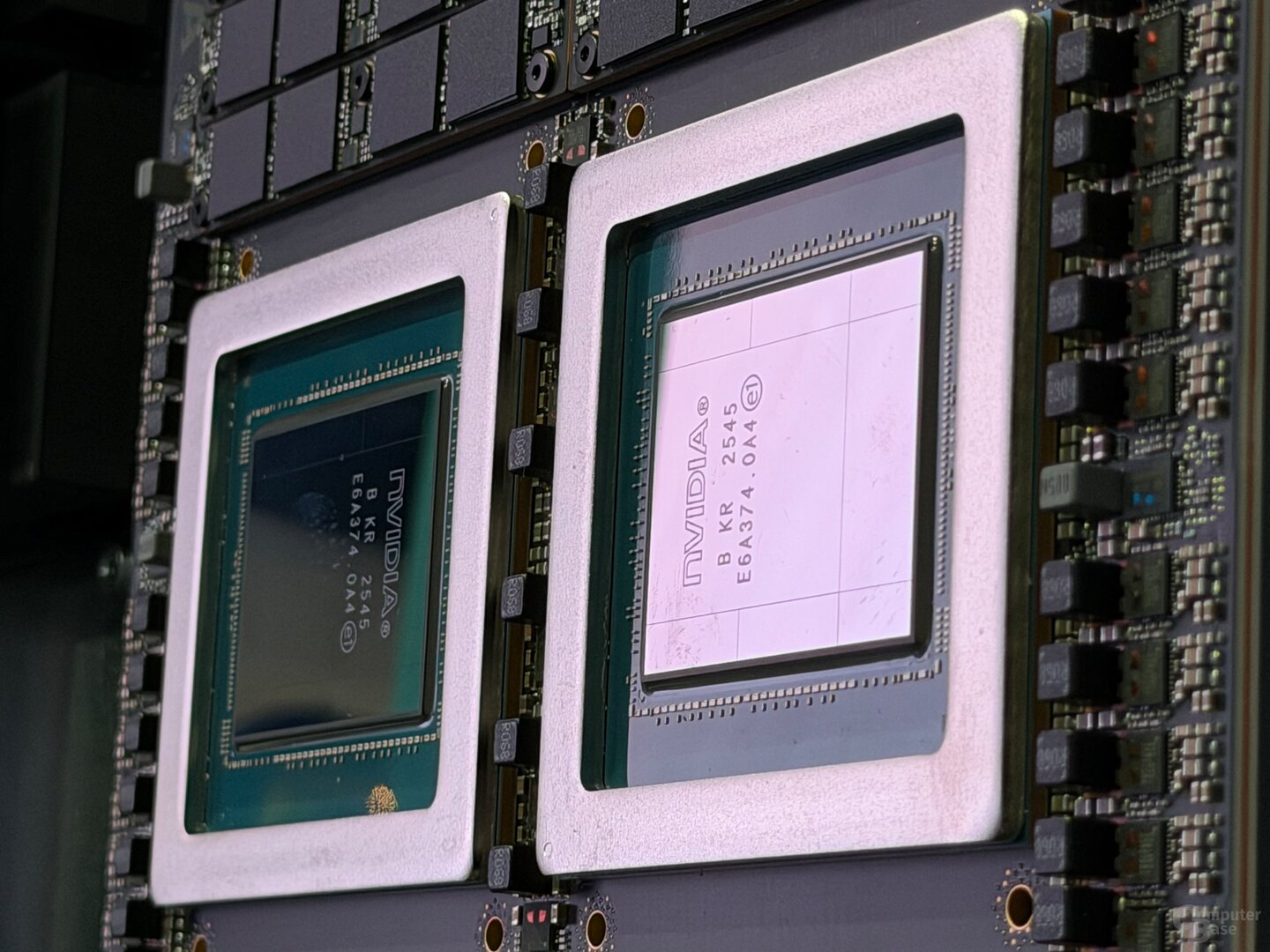

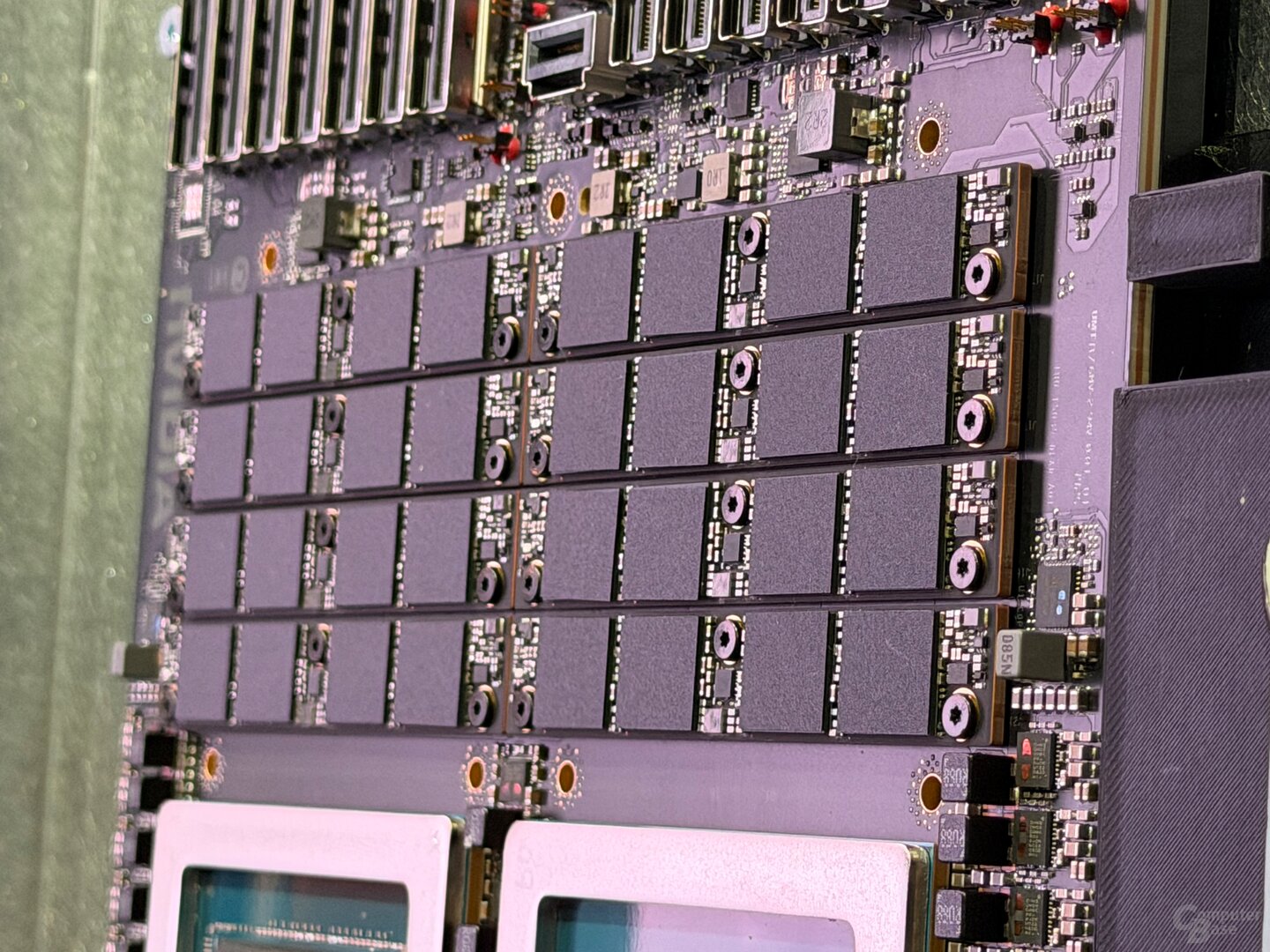

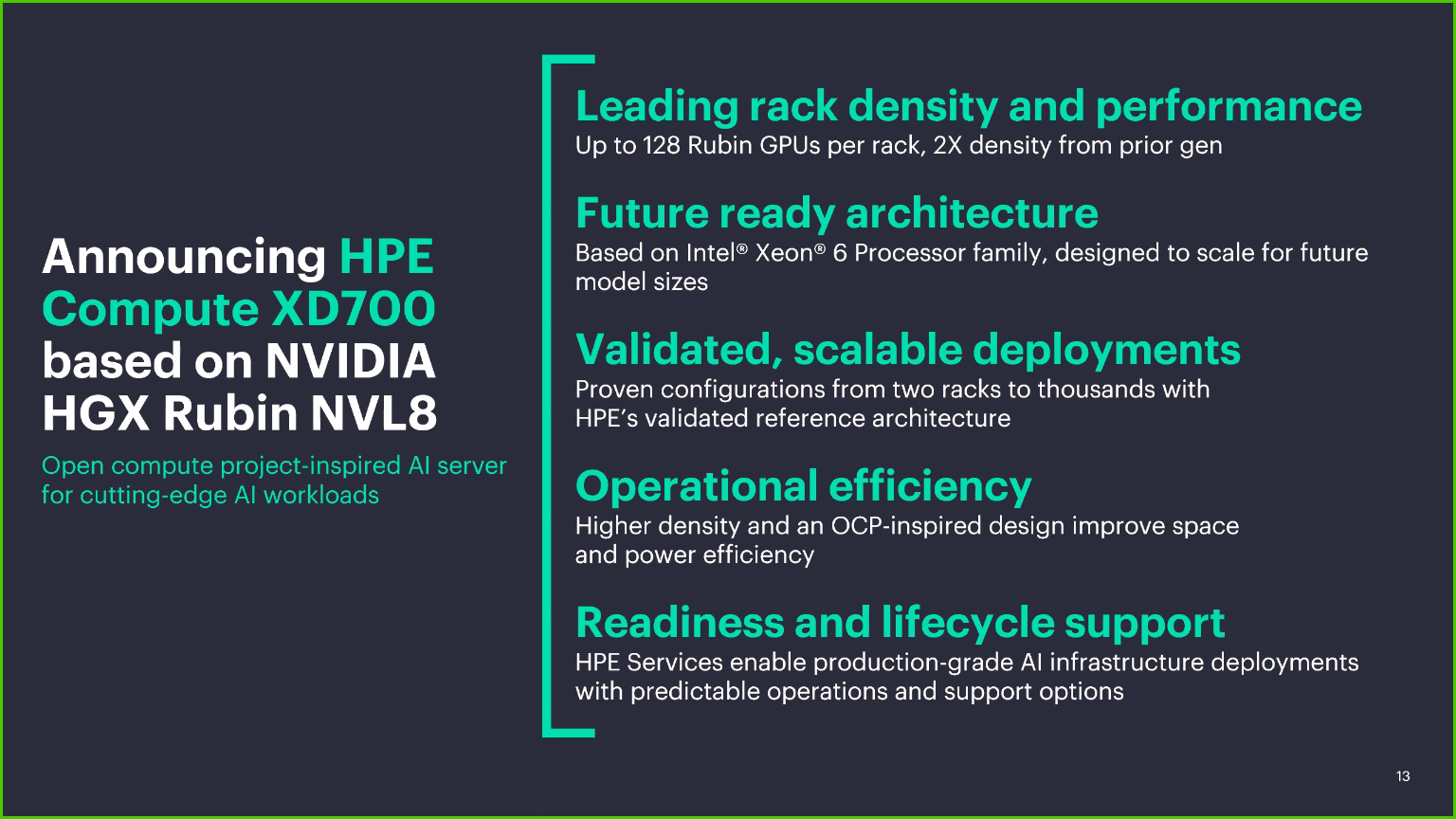

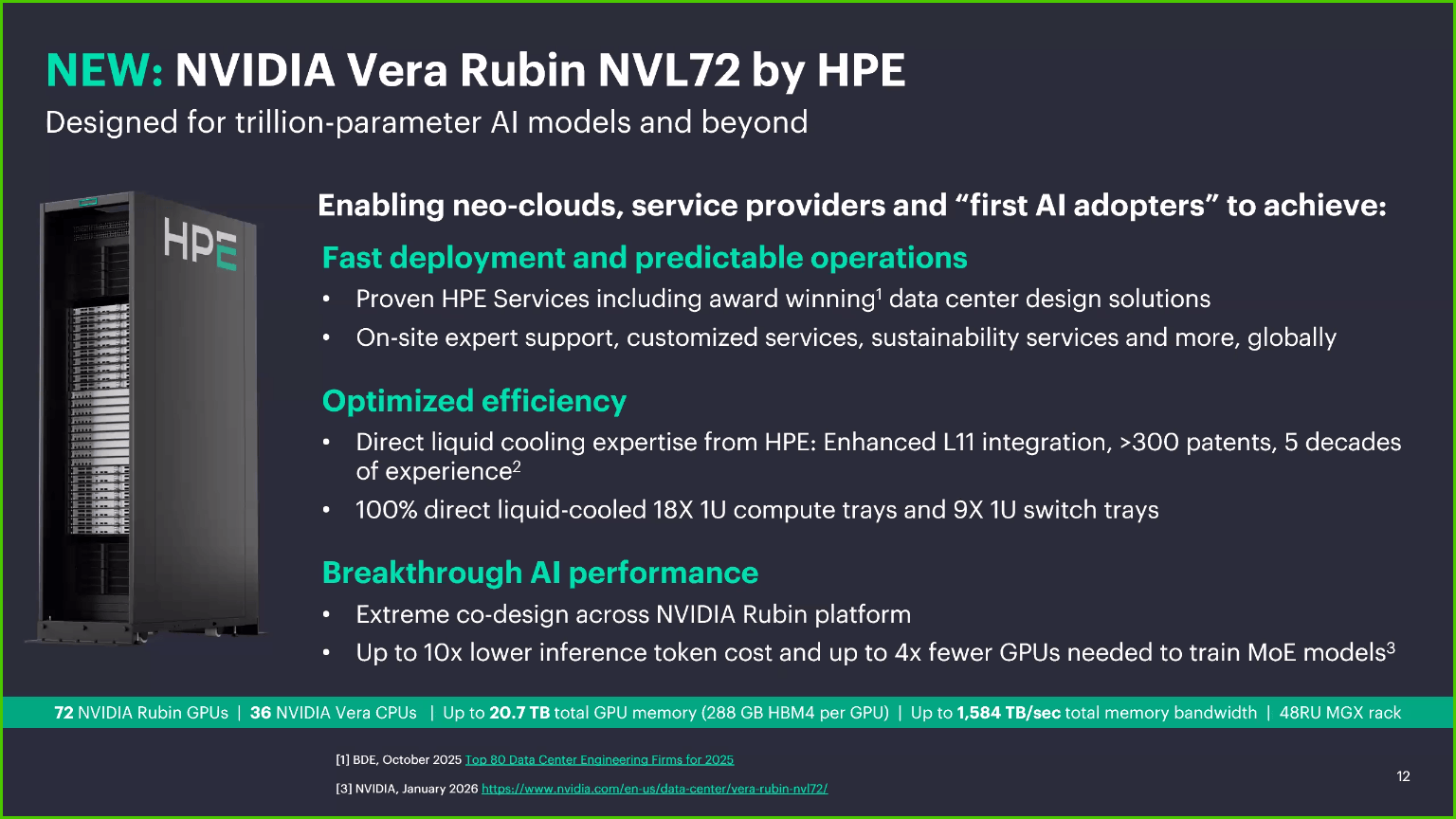

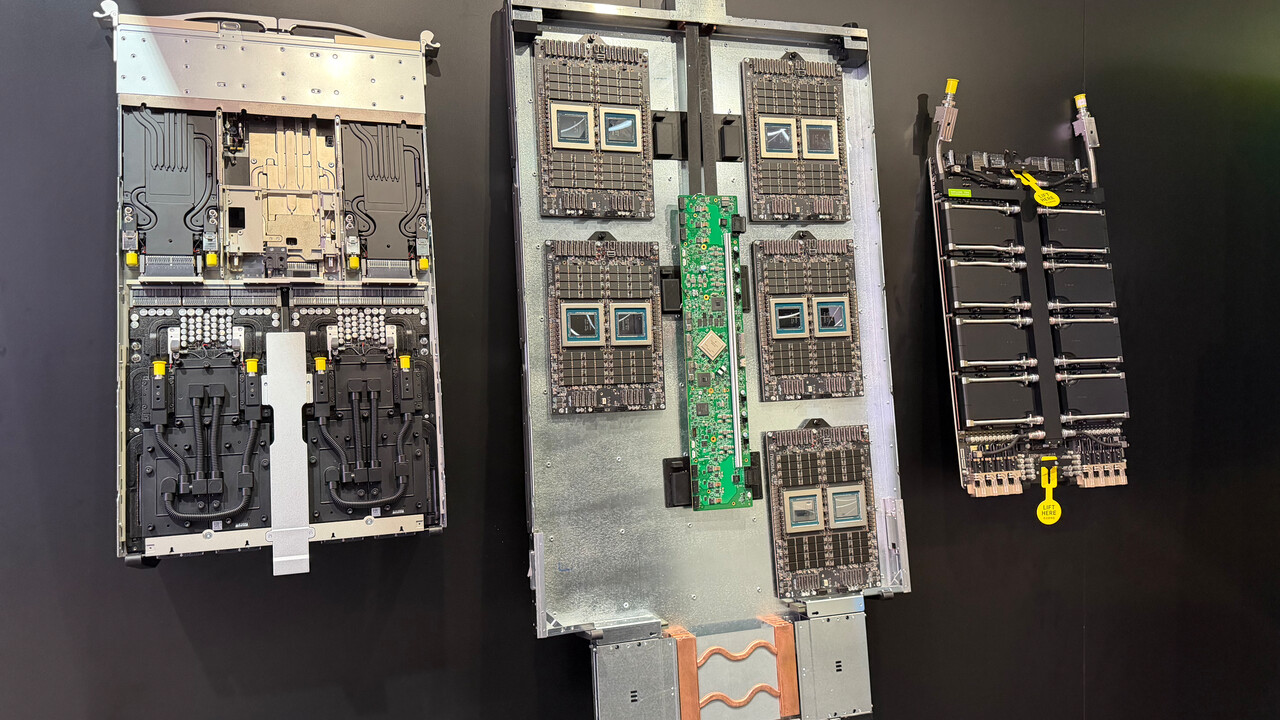

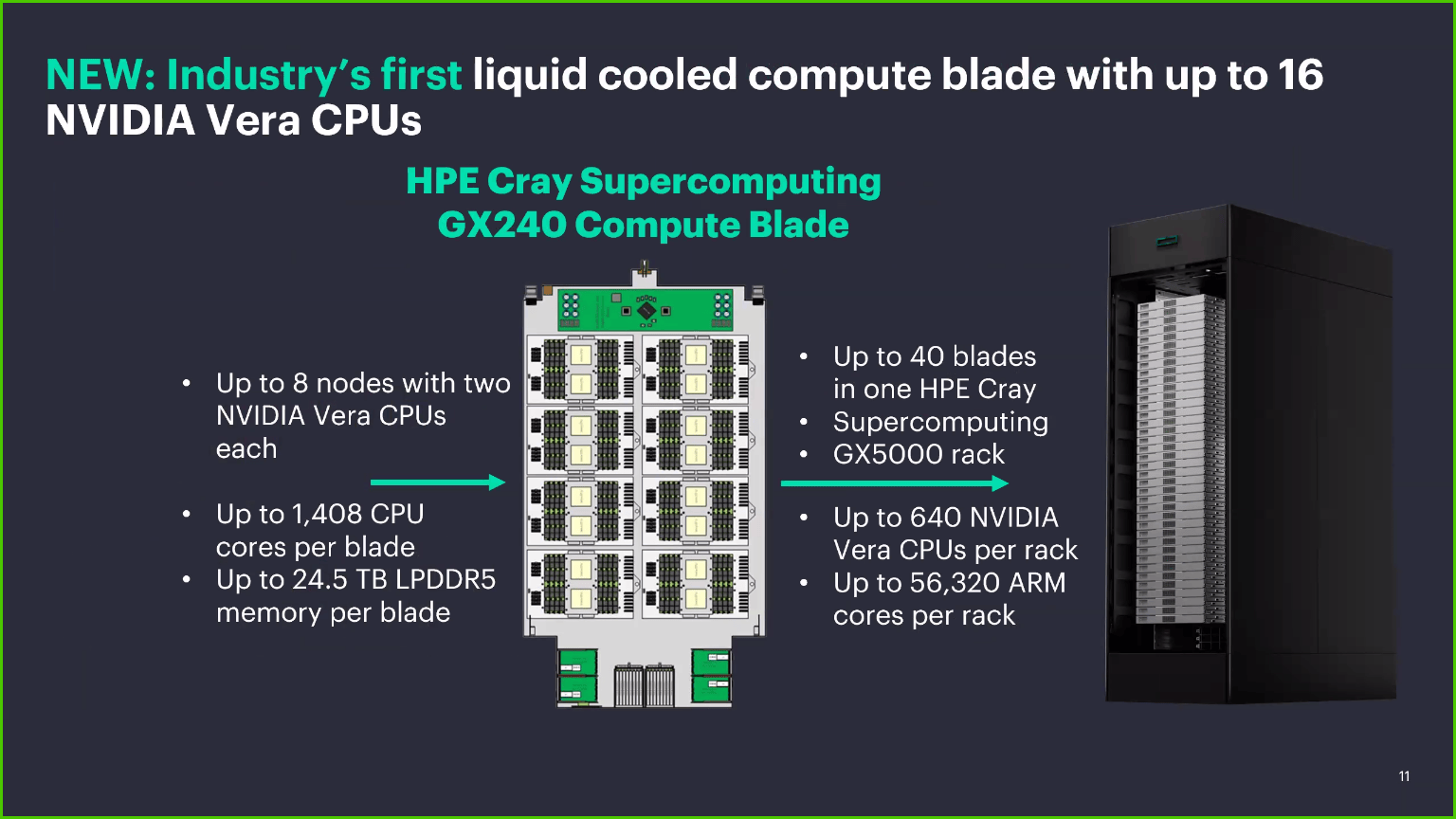

GX240 Compute Blade: HPE packt 16 × Vera in ein Blade für 640 CPUs pro Rack

Nvidia rührt zur GTC 2026 kräftig die Werbetrommel für die Vera-CPU. HPE packt sie extrem dicht und ermöglicht so die maximale Anzahl pro Rack. Denn während Nvidia sich primär auf die Variante mit 256 Prozessoren in einem Serverschrank fokussiert, legt HPE eine Supercomputer-Version mit 640 Prozessoren auf.

Reine CPU-Racks kehren zurück

Prozessoren sind wieder cool, das erklärte schon Intel vor einigen Tagen, auch AMDs Tenor ging zuletzt in die Richtung. Denn für AI-Datacenter und Co werden plötzlich die Stärken von Prozessoren wiederentdeckt. Bei HPE werden sie deshalb als reine CPU-Racks wieder für die nächsten Supercomputer ins Angebot aufgenommen, ab 2027 kommt da auch erstmals die Nvidia-CPU-only-Lösung.

Nvidia hat die vor einem Jahr angekündigte Vera-CPU heute selbst auch in ein eigenes Rack gepackt. Bei HPE im Marktsegment für die größten und stärksten Supercomputer weltweit wird das Konzept aber noch mehr als deutlich ausgebaut. Denn während Nvidia das Rack noch mit vielen weiteren Dingen bestückt und so letztlich „nur“ Platz für 256 CPUs bleibt, wird HPE mit 16 CPUs pro GX240 Compute Blade und bis zu 40 dieser Blades in einem riesigen Rack insgesamt 640 Prozessoren bereitstellen. Oder anders ausgedrückt: 56.320 Olympus Arm-Kerne von Nvidia, die mit SMT 112.640 Threads anbieten.

Das Compute Blade wird Bestandteil der Plattform HPE Cray Supercomputing GX5000, kann in dem Rahmen unter anderem parallel zu AI-Racks und anderen Systemen aufgestellt werden.

Teil des aktualisierten Angebots für das GX5000-Supercomputer-System ist auch Nvidias neuer Quantum-X800-InfiniBand-Switch. Dieser bietet 144 Ports mit 800 Gb/s, aber auch Features für eine verbesserte Energieeffizienz wie Low-power link state and power profiling.

Erst 2027 verfügbar

Das Quantum-X800 InfiniBand wird für die HPE Cray Supercomputer GX5000 erst in 2027 verfügbar sein, das gleiche Jahr gilt auch für das GX240 Compute Blade und den HPE Compute XD700, der auf den im Januar 2026 bereits vorgestellten HGX Rubin NVL8 basiert und in einem Rack dann bis zu 128 GPUs kombiniert. Im Dezember 2026, also immerhin wie von Nvidia auch mal angekündigt, kommt immerhin Vera Rubin NVL72 auch von HPE.

Die Redaktion hat Informationen in diesem Artikel von HPE unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Kritik könnte Wirkung zeigen: Wie Microsoft die KI-Strategie von Windows 11 anpasst

Im Zuge der angekündigten Verbesserungen und Optimierungen für Windows 11 wurde Anfang des Jahres auch bekannt, dass Microsoft die KI-Strategie für das Betriebssystem überdenken will. Nun zeichnet sich ab, was der Konzern mit den Copilot-Funktionen plant.

Komplette Neubewertung

Einem Bericht von Windows Central zufolge unterzieht Microsoft seine KI-Pläne angesichts der anhaltenden Kritik weiterhin einer umfassenden Neubewertung. Zahlreiche geplante Funktionen stehen demnach auf dem Prüfstand, nicht wenige wurden bereits vollständig gestrichen. Betroffen ist unter anderem die ursprünglich für 2024 vorgesehene Integration von Copilot in die Benachrichtigungen und Einstellungen der Windows-11-Benutzeroberfläche, mit der seinerzeit der KI-Aufwand im gesamten Betriebssystem reduziert werden sollte. Auch die geplante Verschmelzung des KI-Assistenten mit dem Datei-Explorer wird offenbar nicht in der für 2024 angedachten Form umgesetzt.

Viele Pläne werden nicht mehr verfolgt

Zwar hatte Microsoft mit der Verzahnung von Copilot und Datei-Explorer bereits in einer Insider-Preview begonnen, doch das Ergebnis hatte mit den ursprünglichen Plänen nur noch wenig gemein. Der Datei-Explorer erhielt zwar ein KI-Aktionsmenü, doch dessen Umsetzung weicht grundlegend vom Copilot-Konzept des Jahres 2024 ab: Während die aktuelle Version Aktionen lediglich an andere Apps weiterleitet, hätte die ursprünglich geplante Copilot-Variante diese Aktionen eigenständig und ohne separate Anwendung ausführen sollen. Microsoft-EVP Yusef Mehdi hatte die Funktion seinerzeit noch für das damals laufende Jahr angekündigt, in ihrer ursprünglich erdachten Form wurde sie jedoch bis heute nicht veröffentlicht.

Weitere KI-Updates, zu denen insbesondere die Agenten-Pläne für Windows 11 zählen, stehen allerdings weiterhin auf dem Plan.

Copilot nur noch ein Schatten von dem, was er werden sollte

Bereits kurz nach der Kontroverse rund um Recall legte der Software-Riese außerdem Pläne ad acta, Copilot als übergreifenden Markenbegriff für sämtliche KI-Funktionen unter Windows zu etablieren. Nie das Licht der Welt erblickt haben bislang auch die Copilot-Vorschläge in Benachrichtigungen, bei denen sich der KI-Assistent in Popup-Meldungen von Apps hätte einklinken sollen, um Ein-Klick-Aktionen wie das Öffnen einer Datei oder das Beantworten von Nachrichten anzubieten. Ob diese Funktionen jemals als Copilot-Feature unter Windows erscheinen werden, gilt mittlerweile als mehr als fraglich. Ähnlich verhält es sich mit der Windows Copilot Runtime, die inzwischen schlicht in „Windows AI APIs“ umbenannt wurde.

Realität holt Microsoft ein

Die einstige „Marke“ Copilot dürften die meisten Nutzer mittlerweile eher mit Microsoft 365 als mit Windows in Verbindung bringen – von den ursprünglichen Visionen ist kaum noch etwas übrig geblieben. Das Unternehmen rückt dabei ebenso zusehends von der Idee ab, Copilot als allgegenwärtigen KI-Assistenten tief in Windows zu verankern. Möglicherweise waren die Pläne schlicht zu ambitioniert und ließen sich in der Theorie weitaus leichter formulieren, als sie in der Praxis umzusetzen wären. Zudem dürfte Microsoft wenig Interesse daran haben, diese Kehrtwende öffentlich zu kommunizieren, allzu leicht könnte sie als Rückschritt wahrgenommen werden – was sie im Grunde auch ist.

Apps & Mobile Entwicklung

AMD Medusa Point: Weitere Zen-6-Benchmarks, doch ohne Aussagekraft

Nach dem ersten Auftauchen von AMD Medusa Point im Geekbench-Browser folgen weitere Einträge in der Benchmark-Datenbank. Diese verleiten zu Leistungsvergleichen. Sie stehen jedoch auf wackeligen Füßen, da unklar ist, welche Daten korrekt ausgelesen wurden und welche nicht.

Schlagzeilen wie „Zen 6 bei 2 GHz schneller als Zen 5 bei 5 GHz“ oder „Medusa Point bei halbem Takt genauso schnell wie Strix Point“ sorgen gerade für Aufsehen, versprechen dabei allerdings viel mehr, als die Datenlage wirklich hergibt. Fakt ist nur: Es gibt kurz nach der ersten Sichtung von AMD Medusa Point im Geekbench jetzt weitere Einträge mit der namentlich identischen Testplattform „AMD Plum-MDS1“. Bei Medusa Point handelt es sich um die kommende APU-Generation von AMD, die im Mobile-Package (FP10) vor allem für Notebooks bestimmt ist.

Doppelt so viel Punkte bei gleichem Takt, ergeben keinen Sinn

Die neuen Einträge nennen viel höhere Punktzahlen im Geekbench als das erste Resultat. Die rund 2.200 bis 2.300 Punkte im Single-Core und 11.500 bis 13.000 Punkte im Multi-Core entsprechen mehr oder weniger der APU-Familie Strix Point. Da allerdings die angegebene maximale Taktfrequenz deutlich niedriger ist, wird schnell auf eine immense Leistungssteigerung geschlussfolgert.

Allerdings ist bekannt, dass die ausgelesenen Daten im Geekbench-Browser nicht immer stimmig sind, gerade auch was die Taktraten angeht. Und so soll etwa beim ersten Ergebnis mit nur 1.210/7.323 Punkten der maximale Takt bei 2,01 GHz gelegen haben, während die Resultate zwei und drei bei nahezu identischem Takt fast doppelt so hoch ausfielen. Inzwischen gibt es sogar ein viertes Ergebnis, bei dem der maximale Takt mit höheren 3,36 GHz angegeben ist. Dennoch liegt die Punktzahl mit 2.241/11.503 sogar unter den vorherigen Ergebnissen.

Noch zu viele Unstimmigkeiten

Das allein bestätigt, dass die Ergebnisse und die Taktraten noch keinerlei Aussagekraft besitzen, da sie nicht stimmig sind. Einzig beim Basistakt, der bei 2,4 GHz liegen soll, sind sich die Einträge einig. Probleme beim Auslesen könnte der Software zum einen die völlig neue Zen-6-Architektur bereiten, zum anderen kommt laut einstimmigen Gerüchten auch noch ein Hybrid-Design aus Zen 6 und Zen 6c zum Einsatz. Da die verschiedenen Kerne voraussichtlich unterschiedlich hoch takten, kann auch das die Software „verwirren“.

10 Kerne, doch welche?

Dass das Engineering Sample von Medusa Point über insgesamt 10 Kerne verfügt, erscheint gesichert. Pro Kern soll 1 MB L2-Cache vorhanden sein, der L3-Cache soll 32 MB umfassen und damit größer sein als bei Strix Point und dessen Refresh Gorgon Point.

Während das erste Resultat von 1 Cluster mit 10 Kernen spricht, melden die jüngeren Einträge ein „Cluster 1“ mit 4 Kernen und ein „Cluster 2“ mit 6 Kernen. Der letzte Stand der Gerüchteküche ist aber eher „4 Zen 6 + 4 Zen 6c + 2 LP“, also ein Hybrid-Design mit sogar drei Clustern, bei dem bisher bei AMD noch nicht eingesetzte Low-Power-Kerne ins Spiel kommen.

Bis zur Vorstellung von Medusa Point als neue Ryzen Mobile Familie dürften weitere Details ans Tageslicht kommen. Derzeit wird erwartet, dass der Marktstart erst Anfang 2027 erfolgt.

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSchnelles Boot statt Bus und Bahn: Was sich von London und New York lernen lässt

-

Social Mediavor 3 Wochen

Social Mediavor 3 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 4 Wochen

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenÜber 220 m³ Fläche: Neuer Satellit von AST SpaceMobile ist noch größer

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur