Apps & Mobile Entwicklung

Gemini Notebooks: Googles KI-Modell organisiert ab sofort Chats und Dateien

Google hat sein KI-Modell Gemini um eine von Nutzern lange geforderte Funktion erweitert, die in NotebookLM bereits seit Längerem verfügbar ist: Mit „Notebooks“ lassen sich ab sofort Konversationen und Dateien analysieren, strukturieren und thematisch organisieren sowie zwischen Gemini und NotebookLM synchronisieren.

Wichtige Informationen an allen Orten

Der von Google verwendete Begriff „Notebook“ ist dabei nicht im Sinne mobiler Rechner zu verstehen, sondern entspricht der eigentlichen Übersetzung als „Notizbuch“. Nachdem Google NotebookLM bereits Ende des vergangenen Jahres als Quelle in die Gemini-App integriert hatte, folgt nun mit den Notizbüchern der nächste Schritt. In NotebookLM ist es schon seit längerer Zeit möglich, Texte, Konversationen und weitere Inhalte mithilfe der KI-Plattform zu analysieren und als umfassende Wissenssammlung zu organisieren. Ziel ist es dabei, sowohl Lernprozesse als auch Arbeitsabläufe zu erleichtern. Diese Funktionen hat Google nun aus NotebookLM herausgelöst und stellt sie zusätzlich direkt in Gemini bereit.

Hilfe vor allem für größere Projekte und Aufgaben

Damit erhalten Nutzer auch innerhalb der KI-App einen eigenen Bereich, in dem sich entsprechende Daten ablegen lassen, die anschließend themenspezifisch ausgewertet werden können. Das gesammelte Wissen lässt sich jederzeit durch neue Dokumente erweitern, wodurch Gemini fortlaufend zusätzlichen Kontext erhält, der für Recherchen genutzt werden kann. Auch das Strukturieren umfangreicher Texte übernimmt die KI. Google zielt damit insbesondere darauf ab, die Qualität der generierten Antworten spürbar zu steigern. Abhängig vom gewählten Abonnement können Anwender auf eine größere Anzahl an Quellen zugreifen, um umfangreichere Aufgaben oder komplexere Projekte umzusetzen. Damit zieht Google mit der vergleichbaren ChatGPT-Funktion „Projects“ gleich.

Den aktuellen Stand auf allen Geräten

Die erstellten Notizbücher lassen sich zwischen der Gemini-App und NotebookLM synchronisieren, sodass alle Plattformen stets auf denselben Wissensstand zugreifen. Neue Inhalte können beispielsweise unterwegs hinzugefügt werden und stehen anschließend unmittelbar auch auf Smartphone, Tablet oder dem heimischen Rechner bereit.

Start noch in dieser Woche – Europa muss warten

Die Einführung von Notebooks soll noch in dieser Woche in den USA beginnen, zunächst für Abonnenten von Google AI Ultra, Pro und Plus in der Webversion. In den darauffolgenden Wochen ist eine Ausweitung auf Mobilgeräte, weitere Länder in Europa sowie auf kostenlose Nutzer geplant. Zusätzlich weist Google darauf hin, dass Notebooks weder für Nutzer unter 18 Jahren noch für Workspace- und Education-Konten verfügbar sein werden.

Apps & Mobile Entwicklung

Windows 11: Microsoft rätselt immer noch über Integration der Copilot-App

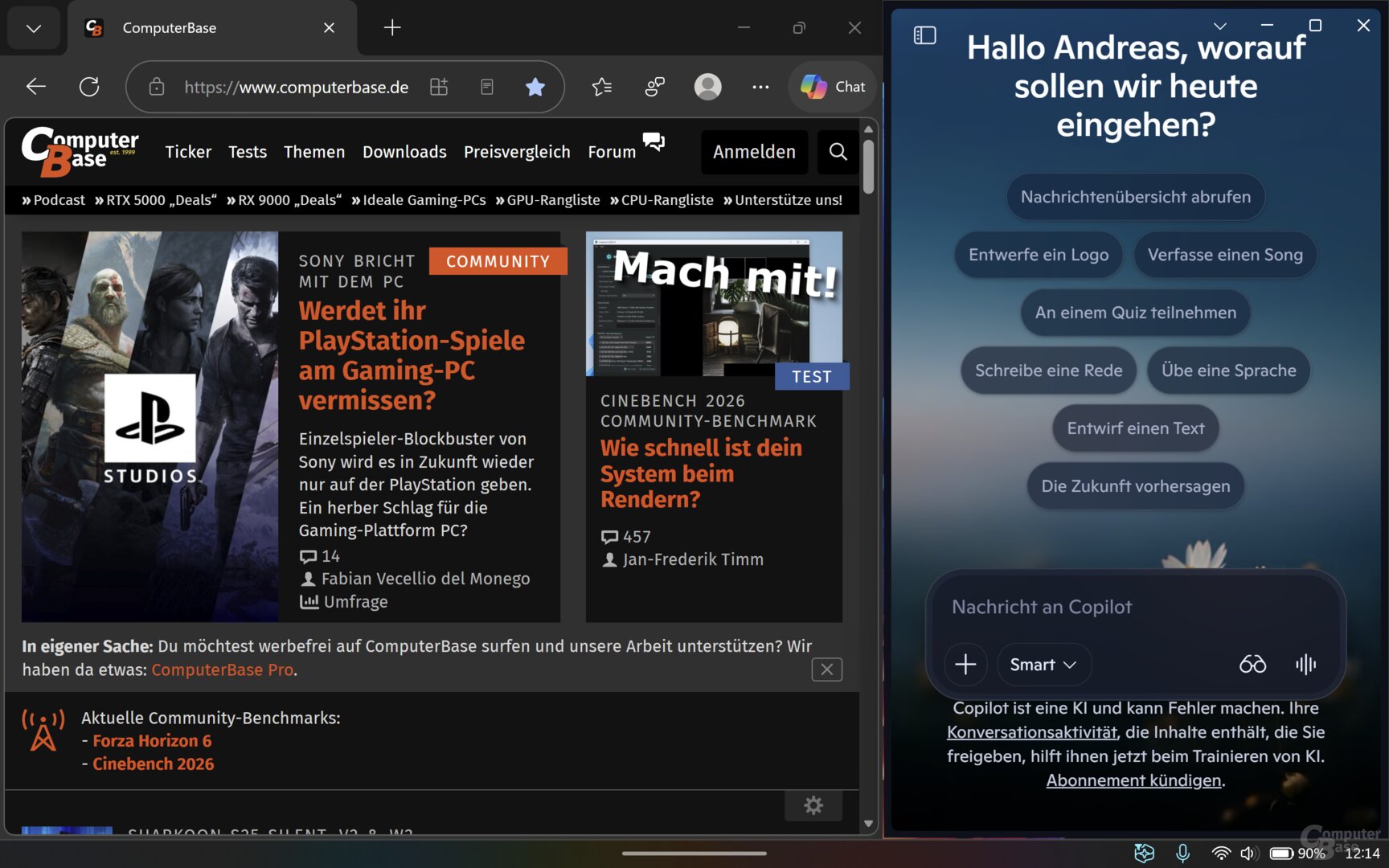

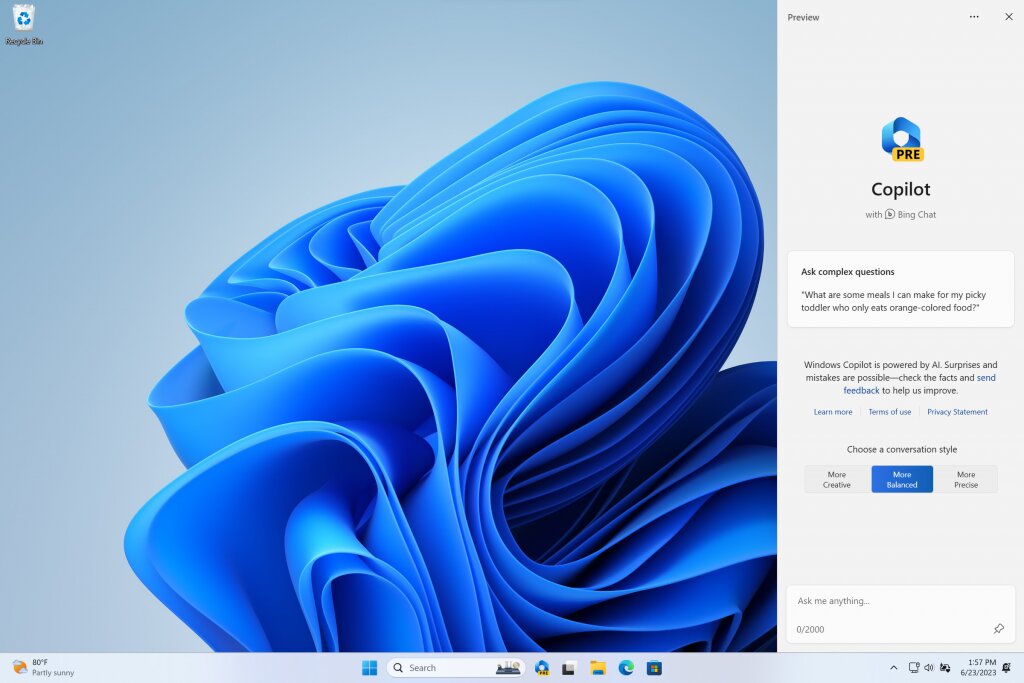

Die KI-Integration zu optimieren ist eines der Ziele, das Microsoft für die Runderneuerung von Windows 11 ausgegeben hat. Wie man mit der Copilot-App verfährt, ist immer noch wechselhaft. Derzeit erhält diese wieder eine Sidebar-Funktion, berichtet Windows Latest.

Die entsprechende Funktion befindet sich in der aktuellen Version der Copilot-App, die derzeit schrittweise an die Nutzer verteilt wird. Öffnet man den Copilot unter Windows 11, erscheint dieser nach wie vor als reguläre App. Im Drop-Down-Menü lässt sich aber die Ansicht steuern. Damit ist es dann möglich, den KI-Assistenten an die rechte oder linke Seite des Desktops zu pinnen. Startet man Apps wie Browser oder Office-Dokumente, bleibt die Copilot-App damit im Bild.

Copilot-App als omnipräsenter KI-Assistent für Windows 11

Microsoft nähert sich damit wieder einem Plan an, den der Konzern laut Windows Latest schon beim Start der Copilot-App verfolgte: Der KI-Assistent soll nicht eine App unter mehreren sein, sondern sich praktisch immer im Blickwinkel des Nutzers befinden, wenn dieser andere Apps verwendet. Läuft also der Browser, kann der Copilot-Assistent im Idealfall – zumindest nach Sichtweise von Microsoft – den Bildschirm scannen und direkt Auskünfte zum Inhalt wie einer Webseite machen. Es wäre also eine direkte Integration in den Workflow des Nutzers.

An dem Konzept festgehalten hat Microsoft jedoch nicht. Die Copilot-App wurde seit dem Start zig Mal umgebaut. Weg von der Sidebar, hin zu einer nativen Windows-App und dann zur Web-App. Aktuell handelt es sich bei der Copilot-App laut Windows Latest um ein Edge-basiertes Wrapper-Konstrukt. Die Copilot-App ist im Prinzip also eine Edge-Instanz, die in einer separaten App-Form läuft.

Edge-basierte Copilot-App benötigt deutlich mehr RAM

Generell ist diese Variante einfacher umsetzbar. Für Microsoft hat es zudem den Vorteil, dass die App im Prinzip den Edge-Browser simuliert – bei dessen KI-Browser-Funktionen läuft der Copilot ebenfalls in der Sidebar. Der Nachteil dieser Lösung ist aber ein erhöhter RAM-Verbrauch unter Windows 11. Laut den Messungen von Windows Latest benötigt die Edge-basierte Copilot-App 500 MB bis 1 GB RAM. Bei der nativen App, die auf dem WinUI-Gerüst basierte, waren es demnach weniger als 100 MB.

Wie der Copilot-Assistent unter Windows 11 integriert ist, ist eine der Baustellen, an denen Microsoft bei der Runderneuerung des Betriebssystems arbeitet. Weniger Copilot-Schaltflächen innerhalb von Windows 11 ist eines der Vorhaben, der Umbau der Copilot-App ist ein weiteres.

Apps & Mobile Entwicklung

Sony bricht mit dem PC: Werdet ihr PlayStation-Spiele am Gaming-PC vermissen?

Sony schraubt die Multiplattform-Strategie der vergangenen Jahre in weiten Teilen zurück. God of War, Horizon, Ghost of Yōtei und Co. gibt es künftig nicht mehr auf dem PC: Einzelspieler-Titel bleiben wieder exklusiv auf den PlayStation-Konsolen. Werdet ihr sie am PC vermissen? Und welche habt ihr eigentlich bisher gespielt?

Sony-Blockbuster bleiben wieder auf der PlayStation

Sony bringt seit ein paar Jahren ältere PlayStation-Spiele, aber auch Neuerscheinungen verlässlich mit etwas zeitlichem Abstand auf den PC. Mal dauerte es einige Jahre, mal auch nur einige Monate. Sogar PlayStation-Trophäen und ein -Overlay kamen auf den PC. Aber Sonys PC-Engagement wird sich nach inzwischen verlässlich untermauerten Informationen künftig drastisch reduzieren: Einzelspieler-Titel mit Story-Fokus werden ab sofort wieder permanent exklusiv auf der Konsole erscheinen. Ghost of Yōtei oder Saros wird es damit nur auf der PlayStation 5 oder einer Nachfolgekonsole geben.

Die heutige Sonntagsfrage soll sich darum drehen, wie ihr bisher mit Sonys PC-Angebot umgegangen seid, welche einstig exklusiv auf der PlayStation erschienenen Spiele ihr am PC gespielt habt, ob ihr den Publisher vermissen werdet und ob euch deswegen vielleicht bald eine Sony-Konsole ins Haus steht.

Wo spielt ihr?

Los geht es als Grundlage der heutigen Umfragen aber mit der Frage, ob ihr überhaupt aktiv auf dem PC, der PlayStation oder beiden Plattformen spielt.

Welche PlayStation-Spiele habt ihr am PC gespielt?

Es folgt die Frage, ob ihr in den vergangenen Jahren eines der auf den PC portierten, ehemals exklusiv auf der PlayStation erschienenen Spiele gespielt habt – und zwar auf dem PC.

-

Ja, mehrere!

-

Ja, eines.

-

Nein, bisher nicht.

Falls dem so ist, um welche(n) Titel handelt es sich?

-

Horizon Zero Dawn Complete Edition / Remastered

-

Days Gone

-

God of War

-

Marvel’s Spider Man Remastered

-

Uncharted: Legacy of Thieves Collection

-

Sackboy: A Big Adventure

-

Marvel’s Spider-Man: Miles Morales

-

Returnal

-

The Last of Us Part I

-

Ratchet & Clank: Rift Apart

-

Helldivers 2

-

Horizon Forbidden West Complete Edition

-

Ghost of Tsushima Director’s Cut

-

God of War Ragnarök

-

Until Dawn

-

Lego Horizon Adventures

-

Marvel’s Spider-Man 2

-

The Last of Us Part II Remastered

-

Stellar Blade

-

Midnight Murder Club

-

Lost Soul Aside

-

Death Stranding 2: On the Beach

-

Keines davon, ich spiele aber generell am PC.

-

Keines davon, denn ich spiele ohnehin nicht am PC.

Wie steht ihr zu Sonys Kehrtwende?

Anschließend folgt die Frage, wie ihr persönlich zu Sonys neuer alter Exklusivpolitik steht: Seid ihr traurig, dass zukünftige Einzelspieler-Vorzeigespiele von Sony nicht mehr den Sprung von der Konsole auf den PC schaffen werden? Oder lässt euch das gänzlich kalt?

-

Ich finde das persönlich sehr schade. Sonys Spiele haben die Plattform PC bereichert, da waren viele tolle Titel mit dabei. In Zukunft werde ich bestimmt das ein oder andere Spiel auf dem PC vermissen.

-

Na ja, mehr Auswahl ist sicherlich gut und da waren einige tolle Spiele dabei, aber ich werde auch ohne Sony-Games genug zum Spielen finden oder wechsele eben auf eine PlayStation. Das ist keine große Sache.

-

Das ist mir ehrlich gesagt komplett egal – ich kann mit den Sony-Spielen sowieso nichts anfangen.

-

Das betrifft mich nicht – ich spiele nicht auf dem PC bzw. besitze bereits eine PlayStation.

Kaufgrund für eine Spielkonsole?

Abhilfe schafft in Zukunft wieder der Kauf einer PlayStation. Waren Exklusivspiele für euch schon in der Vergangenheit einmal der entscheidende oder zumindest ein schwerwiegender Grund, eine Konsole anzuschaffen?

-

Ja, das war im Endeffekt auch der maßgebliche Grund für den Kauf.

-

Ja, die Exklusivspiele haben definitiv eine Rolle gespielt, waren aber nicht der einzige oder stärkste Grund für den Kauf.

-

Nein, nicht unbedingt; für mich standen andere Gründe im Vordergrund.

Und wie seht ihr die Situation in der Zukunft: Glaubt ihr, dass ihr zu einer PlayStation greifen werdet, um Sony-Titel zu spielen? Oder sind die Exklusivspiele angesichts weiterhin steigender Konsolenpreise nicht überzeugend genug?

-

Ja, es wird früher oder später bestimmt darauf hinauslaufen.

-

Na ja – möglich ist das, dafür werde ich aber zukünftige Exklusivspiele abwarten.

-

Nein, das halte ich für ausgeschlossen.

Das größte Konsolenexklusivspiel kommt im Herbst

Nicht von Sony, aber am 19. November exklusiv auf die Konsolen kommt Grand Theft Auto VI. Ist das für euch ein Grund, euch – mitunter zusätzlich zum Gaming-PC – eine (neue) Spielkonsole zu kaufen?

-

Ja, ich werde mir extra für GTA 6 eine kompatible Spielkonsole kaufen bzw. habe das schon getan. GTA 6 ist die Ursache.

-

Ja. Zwar geht es mir nicht nur um GTA 6, das Spiel hat aber nun den Anstoß gegeben. GTA 6 ist der Auslöser.

-

Ja – zwar besitze ich schon eine kompatible Konsole, ich schiele aber auf ein leistungsstärkeres Modell (bspw. PlayStation 5 Pro).

-

Nein – ich besitze schon eine passende Konsole.

-

Nein. Zwar habe ich Interesse an GTA 6, aber ich sehe es finanziell nicht ein, mir dafür eine Konsole zu kaufen. Ich warte auf die PC-Fassung.

-

Nein. Ich habe Interesse an GTA 6, möchte es aber nicht mit den technischen Limitierungen der Konsolen spielen und warte deswegen auf die PC-Fassung.

-

Nein, ich habe an GTA 6 grundsätzlich kein Interesse.

Mitmachen ist ausdrücklich erwünscht

Die Redaktion freut sich wie immer über fundierte und ausführliche Begründungen zu euren Entscheidungen in den Kommentaren zur aktuellen Sonntagsfrage. Wenn ihr persönlich ganz andere Ansichten vertretet, die von den bei den Umfragen im Artikel gegebenen Antwortmöglichkeiten nicht abgedeckt werden, könnt ihr davon ebenfalls im Forum berichten. Auch Ideen und Anregungen zu inhaltlichen Ergänzungen der laufenden oder zukünftigen Umfragen sind gerne gesehen.

Leser, die sich noch nicht an den vergangenen Sonntagsfragen beteiligt haben, können dies gerne nachholen, denn die Umfragen laufen stets über eine Dauer von 30 Tagen. Voraussetzung zur Teilnahme ist lediglich ein kostenloser ComputerBase-Account. Insbesondere zu den letzten Sonntagsfragen sind im Forum häufig nach wie vor spannende Diskussionen im Gange.

Die letzten zehn Sonntagsfragen in der Übersicht

Motivation und Datennutzung

Die im Rahmen der Sonntagsfragen erhobenen Daten dienen einzig und allein dazu, die Stimmung innerhalb der Community und die Hardware- sowie Software-Präferenzen der Leser und deren Entwicklung besser sichtbar zu machen. Einen finanziellen oder werblichen Hintergrund gibt es dabei nicht und auch eine Auswertung zu Zwecken der Marktforschung oder eine Übermittlung der Daten an Dritte finden nicht statt.

Apps & Mobile Entwicklung

Sharkoon S25 Silent, V2 & W2: Geräuschdämmung macht Gehäuse am teuersten

Sharkoons geräumiger Budget-Tower S25 ist mit bunter Beleuchtung nicht am teuersten. Wer Glas und Licht will, spart Geld. Am meisten kostet die schlichteste Variante mit den wenigsten Öffnungen und Schalldämmung.

Basis aller drei Modellvarianten ist ein Chassis, das Grafikkarten und Kühlern genug Platz schafft. Höhenbeschränkungen für 172 Millimeter für Kühler und eine Limitierung der Grafikkarte auf eine Länge von 380 Millimeter haben eigentlich nur theoretisch Relevanz. Größere Produkte gibt es allenfalls in Form von exotischen Spezialfällen.

Festplatten werden in zwei 2,5″-Halterungen hinter das Mainboard gelegt, eine weitere Halterung mit einem Einschub und einem festen Montageplatz befindet sich vor dem Netzteil. Dort können auch 3,5″-Laufwerke montiert werden. Dazu kommt ein 5,25″-Montageplatz für ein optisches Laufwerk.

Unterschiede der Modellvarianten

Unterschiede zwischen den Modellvarianten betreffen die Belüftung. In der Basisversion V2 können sieben 120-mm-Lüfter an Front, Deckel und Heck montiert werden. An die Oberseite passen alternativ zwei 140-mm-Modelle. Zwei schwarze 120-mm-Lüfter mit PWM-Anschluss (500 bis 1.500 U/Min) liefert Sharkoon mit.

Um in den Innenraum zu sehen, braucht es das S25 W2 ARGB. Das Seitenteil besteht bei diesem Modell aus Glas, zudem wird der Hecklüfter durch ein Modell mit ARGB-LEDs getauscht. Der Frontlüfter bleibt hingegen unbeleuchtet, ist aber auch „unsichtbar“ verbaut.

Beim S25 Silent entfallen die Lüfter an der Oberseite und damit auch der sonst dort vorhandene Staubfilter. Stattdessen sollen vier Dämmmatten an Front, Seiten und Deckel Schall absorbieren. Ein 360-mm-Radiator passe trotz der entfallenden Öffnung an Deckel in das Gehäuse, schreibt Sharkoon, er kann allerdings nur noch an die Front gesetzt werden. Unabhängig seiner Position muss bei Nutzung eines 5,25″-Laufwerks auf einen kleineren Radiator ausgewichen werden.

Preise und Verfügbarkeit

Die Serie hat den Handel bereits erreicht. Am günstigsten wird dort die V2-Version gelistet. Preise für das Modell starten ab 55 Euro. Für 5 Euro Aufpreis steht das W2 ARGB in den Händlerlisten, für das preisliches Spitzenmodell, die Silent-Ausführung, müssen 65 Euro bezahlt werden.

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 3 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenMähroboter ohne Begrenzungsdraht für Gärten mit bis zu 300 m²

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateniPhone Fold Leak: Apple spart sich wohl iPad‑Multitasking

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview

-

Künstliche Intelligenzvor 2 Monaten

JBL Bar 1300MK2 im Test: Soundbar mit Dolby Atmos, starkem Bass und Akku‑Rears