Apps & Mobile Entwicklung

BMW: Im neuen iX3 rollt Alexa+ schon über deutsche Straßen

BMW hat das neue Alexa+ schon in den BMW Intelligent Personal Assistant integriert. Im neuen BMW iX3 rollt der KI-basierte Sprachassistent schon über deutsche Straßen. Andere Fahrzeuge ab BMW OS 9 erhalten das Update im Laufe des zweiten Halbjahres.

BMW führt die deutsche Sprachversion des neuen KI-gestützten BMW Intelligent Personal Assistant mit dem Start von Alexa+ direkt auch in den eigenen Fahrzeugen ein. Den Anfang macht der seit Ende März erhältliche BMW iX3, in dem ab sofort natürlich formulierte Dialoge zu allgemeinen Themen und Fahrzeugfunktionen mit dem Assistenten möglich sind.

Natürliche Gespräche führen ans Ziel

Das System verknüpft die Spracheingaben des Fahrers oder der Mitfahrer mit den zur Verfügung stehenden Fahrzeugfunktionen. Navigationsziele können direkt aus dem gesprochenen Inhalt übernommen werden und lassen sich jederzeit über natürliche Spracheingaben ändern. So können sich Insassen beispielsweise vom Personal Assistant zunächst etwas über das Brandenburger Tor erzählen lassen, bevor man ihm sagt, dass man gerne dorthin fahren möchte. Im Rahmen eines Dialogs, der nun nicht mehr aus einfachen Anweisungen und Befehlen bestehen muss, können dann weitere Zwischenstopps hinzugefügt oder gegebenenfalls notwendige Tankstopps auf dem Weg zum Ziel geplant werden.

Das Fahrzeug erkennt anhand der Mikrofone im BMW auch, wer eine Anfrage stellt und kann dies bei der Ausführung berücksichtigen – etwa wenn der Beifahrer seine Sitzheizung aktivieren möchte, der Fahrer jedoch nicht.

Grundlage ist der Alexa Custom Assistant

Die bisherige Nutzung von Sprachbefehlen im BMW wird mit den neuen Möglichkeiten, die Alexa+ im Hintergrund bietet, um die dialogorientierte Interaktion im Fahrzeug erweitert. Denn technologische Grundlage für diese Funktionalität ist der Alexa Custom Assistant von Amazon. Dabei werden spezifische Funktionen auf Basis von Alexa+ für die Sprachinteraktion im Auto in die Fahrzeugsoftware integriert. Optional kann der BMW Intelligent Personal Assistant mit einem Amazon‑Konto verbunden werden. Dadurch stehen Funktionen wie Musiksuche und -Streaming über kompatible Dienste per Sprache zur Verfügung. Verzichtet man auf die Verknüpfung, merkt sich das Fahrzeug den Kontext zwar vorübergehend, aber nicht dauerhaft wie Alexa+. Die Aktivierung des Assistant im Fahrzeug erfolgt über „Hey BMW“ oder „BMW“ oder über die Taste für Sprachbefehle am Lenkrad.

Mit dem neuen BMW Intelligent Personal Assistant setzen wir durch den Einsatz Künstlicher Intelligenz neue Maßstäbe in der Interaktion zwischen Mensch und Fahrzeug – in Natürlichkeit ebenso wie in Dialogfähigkeit. Gemeinsam mit unserem Partner Amazon haben wir die englisch- und deutschsprachige Version parallel entwickelt. Nun freuen wir uns, diese neue Qualität der Sprachinteraktion erstmals auch unseren deutschsprachigen Kunden anbieten zu können.

Stephan Durach, BMW Group – Senior Vice President Development, Digitale Dienste, Infotainment, Connected Company

Start im iX3, weitere Modelle folgen

Wie eingangs erwähnt, ist der neue KI-gestützte BMW Intelligent Personal Assistant in allen neuen BMW iX3 seit Mitte April 2026 bereits aktiv. Bereits produzierte Fahrzeuge dieses Modells erhalten die Funktion ab Ende Mai 2026 per Software‑Update. In weiteren BMW-Modellen mit BMW Operating System 9 sowie BMW Operating System X wird der KI‑gestützte Sprachassistent ab der zweiten Jahreshälfte 2026 schrittweise verfügbar sein.

ComputerBase hat Informationen zu diesem Artikel von BMW unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

AMD Instinct MI430X: AMDs echter HPC-Chip ist „6 Mal schneller“ als Nvidia Rubin

AMD hat überraschend einen Ausblick auf die Leistung des Instinct MI430X gegeben. Ausnahmsweise ist das kein AI-Beschleuniger, er zielt auf andere Szenarien im HPC-Segment: Denn in der Wissenschaft, bei Simulationen und vielen weiteren Anwendungen ist die Berechnung bei doppelter Genauigkeit weiterhin extrem wichtig.

Es gibt auch noch etwas neben AI

Der Trend zuletzt war unverkennbar: Große GPUs werden nur noch zu einem Zweck gebaut: für AI. Dafür wurden die Datenformate immer kleiner, auf FP8 und BF8 folgten FP6 und FP4, dazu viele Formate, die in ähnlichem Umfeld unterwegs sind wie MXFP6 und MXFP4. Der Fokus hierbei ist Schnelligkeit und möglichst geringer Speicherbedarf, aber alles auf Kosten der Genauigkeit. Dieser Ansatz führt in gewissen Bereichen aber zu Ergebnissen, die man genau nicht haben will.

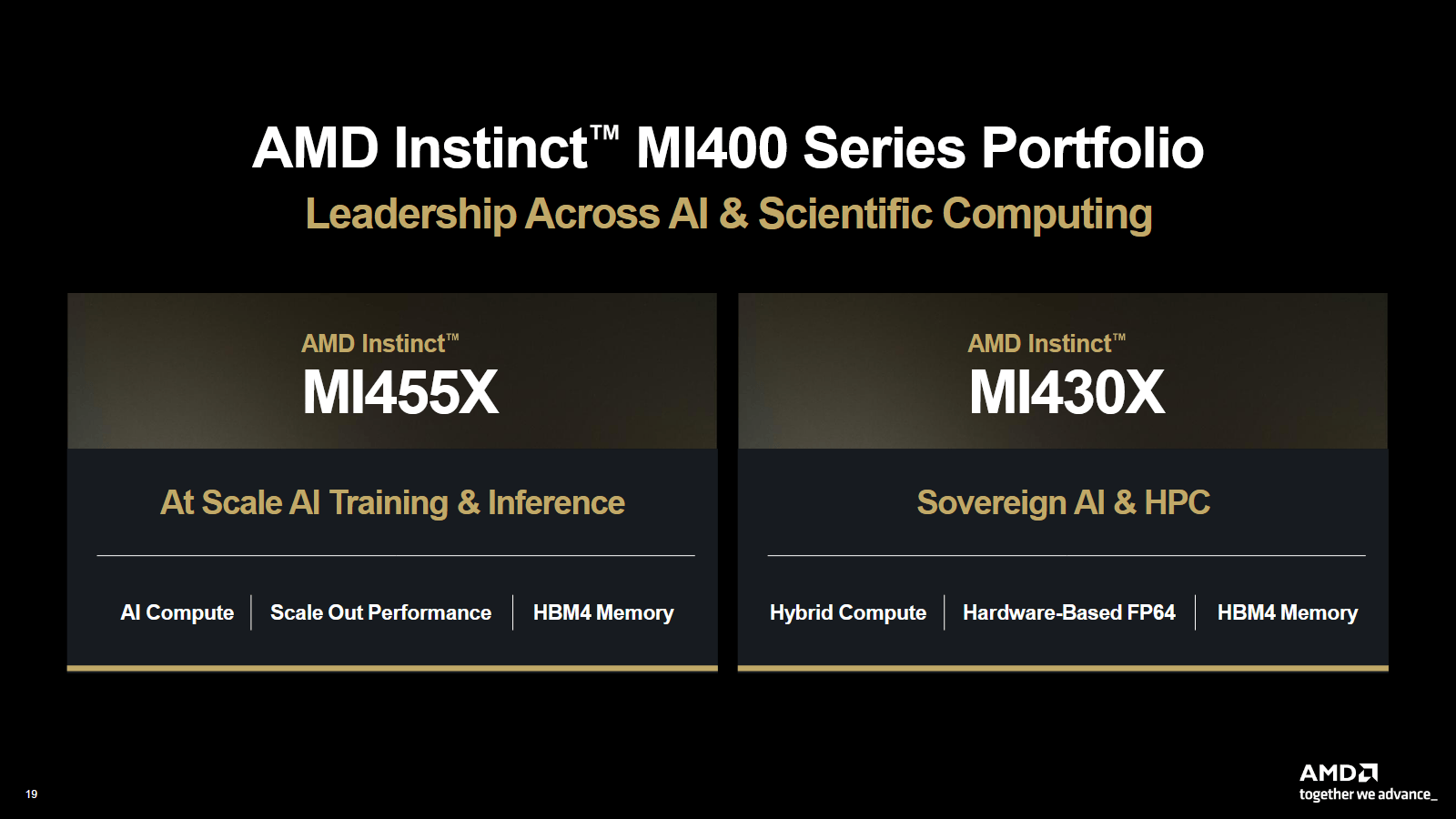

AMD hatte sich deshalb bei der kommenden Familie AMD Instinct MI400 bereits früh dazu entschlossen, nicht nur voll in Richtung AI zu schwenken – so mit der Serie MI450/455X umgesetzt –, sondern auch einen echten HPC-Chip aufzulegen: den MI430X. Im Herbst des letzten Jahres bestätigte das Unternehmen den Chip erstmals offiziell, als er bereits erste Großaufträge einsammeln konnte.

>200 TFLOPS native FP64-Leistung

Jetzt gibt AMD einen ersten Ausblick auf die Leistung der Beschleunigerlösung mit 432 GByte HBM4. Mit über 200 TFLOPs nativer FP64-Leistung wird sie in dem Bereich „mehr als sechsmal so schnell“ sein wie Rubin. Der Vergleich ist aber, wie eingangs ausgeführt, etwas von Äpfeln mit Birnen: Nvidia Rubin ist ein reiner AI-Beschleuniger mit Fokus auf FP4 & Co, FP64 läuft dort, wenn überhaupt, nur nebenbei noch mit, einen echten FP64-Gegenspieler hat Nvidia gar nicht mehr. Rubin dürfte wiederum in FP4-Disziplinen dem MI430X überlegen sein – den dazu passenden Wert nennt AMD heute natürlich nicht.

Zur besseren Einordnung hilft da eher der Blick zu Instinct MI355X: 78,6 TFLOPs FP64-Leistung bietet der Chip, ein MI325X kam zuvor schon mal auf 81,6 TFLOPs FP64-Leistung, der ältere MI300X auf 81,7 TFLOPs. Man sieht auch hier, dass der Fokus bei AMD in eine andere Richtung ging. Eine deutlich stärkere Leistung in der FP64-Disziplin ist es aber zweifelsohne auch im eigenen Haus.

AMD feierte in den letzten Jahren große Erfolge im HPC-Segment, stellt weltweit die Hardware für die schnellsten Supercomputer. Genau dies ist auch die Zielgruppe für den neuen Chip, erste Aufträge wie Discovery am Oak Ridge National Laboratory, USA, und auch Alice Recoque in Frankreich untermauern dies. Letzterer wird bereits mit über einem ExaFLOP FP64-Leistung beworben und damit zu Europas schnellsten HPC-Systemen gehören.

Finale Spezifikationen und Details werden zum Event AMD Advancing AI 2026 am 22/23. Juli erwartet.

Apps & Mobile Entwicklung

Amazon: Alexa+ startet in Deutschland

Endlich startet Alexa+ auch in Deutschland. Wenn auch vorerst nur im Early Access, aber ab sofort kann auch hierzulande in natürlicher Sprache mit Alexa kommuniziert werden. Damit kommt der typische Alexa-Befehls-Sprech zum Ende. Die AI-Revolution mit generativer KI kommt auch auf den deutschen Amazon-Echo-Lautsprechern an.

Statt starrer Anfragen, an die man sich in den letzten 10 Jahren Alexa gewöhnt hat, können Nutzer mit dem digitalen Sprachassistenten nun ganz normale Gespräche führen. Generativer KI sei dank, versteht Alexa nicht nur, was man möchte, sondern ordnet das Gesagte ein, zieht Schlüsse daraus und merkt sich Informationen für die Zukunft, um noch personalisierter und auf die eigenen Bedürfnisse angepasst antworten zu können. Weiß Alexa etwa, dass man Kinder hat, vegetarisch isst oder jeden Tag zur selben Zeit das Licht einschaltet, reagiert es darauf künftig auch proaktiv.

Wie kann man Alexa+ ausprobieren?

Alexa+ wird ab sofort in Deutschland im Rahmen eines Early-Access-Programms eingeführt. Ziel von Amazon ist es zunächst, Feedback von Kunden zu erhalten, um das Erlebnis weiter zu verbessern, bevor es zum Standard für alle Nutzer wird.

Am Early Access für Alexa+ können Nutzer auf zwei Wegen teilnehmen:

- Sie kaufen ein neues Echo-Gerät wie beispielsweise einen Echo Show 8, Echo Show 11, Echo Dot Max oder Echo Studio. Daraufhin ist Alexa+ auf diesem und allen vorhandenen Echo-Geräten aktiv.

- Wer schon ein kompatibles Echo-Gerät besitzt, kann sich bei Amazon registrieren*, um eine Einladung zu erhalten.

Im Early Access und mit Prime kostenlos

Alexa+ ist während des Early Access kostenlos. Danach können Prime-Mitglieder Alexa+ auch weiterhin ohne zusätzliche Kosten nutzen. Für Kunden ohne Prime-Abonnement ist Alexa+ nach der Early-Access-Phase für 22,99 Euro im Monat verfügbar.

Alexa+ läuft auf fast allen Echos

Die meisten Echo-Geräte unterstützen Alexa+. Ausgenommen sind nur einige älterer Echo-Modelle, auf denen aber weiterhin die ursprüngliche Version von Alexa genutzt werden kann. Amazon schaltet diese Modelle also auch mit dem Start von Alexa+ nicht einfach ab, so dass sie unbrauchbar werden, sondern das Unternehmen betreibt beide Systeme parallel – zumindest vorerst. Auch auf Geräten von Drittherstellern mit „Alexa Built-in“ wird Alexa+ zunächst nicht verfügbar sein.

- Echo Dot 1. Generation

- Echo 1. Generation

- Echo Plus 1. Generation

- Echo Show 1. Generation

- Echo Show 2. Generation

- Echo Spot 1. Generation

Alle anderen Echo-Lautsprecher sind mit Alexa+ kompatibel und können mit der neuen KI genutzt werden.

Zu den kompatiblen Fire-TV-Geräten gehören folgende Modelle:

- Fire TV Stick HD (2. Gen)

- Fire TV Stick 4K Select

- Fire TV Cube (3. Gen.)

- Fire TV Stick 4K Max (2. Gen.)

- Fire TV Stick 4K Plus (2. Gen.)

Bei den Fernsehern von Amazon wird die aktuelle Generation der Amazon Ember Smart TVs unterstützt. Diese umfasst die Ember Omni Mini-LED Series, Ember Omni QLED Series, Ember 4-Series, Ember 2-Series und die neue Ember Artline.

Auf Fire-TV-Geräten liefert Alexa+ in erster Linie gesprochene Antworten, um die aktuellen Inhalte nicht zu überlagern. Das ist in einem ersten Test auch dann der Fall, wenn sich das Gerät im Standby befindet, also problemlos auch visuelle Antworten einblenden könnte. Ob Amazon dies in Zukunft anpasst und beispielsweise Fotos und Informationen zu einem Schauspieler oder einem Film, über den man sich gerade informiert hat, direkt einblendet, bleibt abzuwarten. Nicht nur mit IMDb hat das Unternehmen hier in jedem Fall eine gute Datenbasis. Was jedoch schon jetzt problemlos funktioniert, ist das Starten eines Films über Alexa+, wenn dem Assistenten mitgeteilt wird, was man gerne sehen möchte, selbst wenn der genaue Namen des Films unbekannt ist.

Alexa+ lässt sich aber auch in der Alexa-App auf dem Smartphone und bald auch im Stile von ChatGPT im Browser nutzen.

Was ist Alexa+?

Ziel von Alexa+ ist es, eine „Ambient KI“ zu sein. Also immer da, immer verfügbar, im Hintergrund laufend, Informationen bereithaltend, um sie dem Nutzer – und nur diesem – zur Verfügung stellen, wenn er sie braucht. So kann man Alexa+ in der Küche nun beispielsweise fragen, welches Essen man zubereiten kann, wenn bestimmte Zutaten zur Verfügung stehen. Oder es lässt sich in natürlicher Sprache nachfragen, welche Termine der Kinder in dieser Woche anstehen. Auch das Restaurant lässt sich per Dialog mit Alexa buchen, sofern es an den Dienst OpenTable angebunden ist – alternativ nennt Alexa+ die Telefonnummer des Restaurants zwecks telefonischer Reservierung.

Wichtige Dinge kann sich Alexa+ auch dauerhaft merken. Sagt man der KI beispielsweise, dass ein Haushaltsmitglied Vegetarier ist, wird dies bei vorgeschlagenen Rezepten künftig berücksichtigt. Wird gegenüber Alexa geäußert, dass einem der Besuch in einem Restaurant nicht gefallen hat, wird dieses künftig nicht mehr vorgeschlagen. Werden im Smart Home immer wieder ähnliche Ereignisse ausgelöst, fragt Alexa, ob man diese nicht in eine Routine packen möchte, damit sie künftig automatisch ausgeführt werden.

Innerhalb der Gespräche mit Alexa muss die KI nicht jedes Mal über das Erkennungswort neu geweckt werden, sondern Alexa hört zu, bis das Gespräch abgeschlossen ist. Selbstredend können auch ganz alltägliche Fragen an Alexa gestellt werden, etwa zu prominenten Persönlichkeiten, Ereignissen oder Sehenswürdigkeiten. Alexa erinnert sich an den Kontext des Gesprächs und berücksichtigt den bisherigen Gesprächsverlauf bei den Antworten.

Und wechselt man zwischen den Anfragen beispielsweise den Raum, kann lässt sich ein Gespräch auch problemlos auf einem anderen Echo- oder Fire-TV-Gerät weiterführen.

Alexa handelt auch und liefert nicht nur Informationen

Einen grundsätzlichen Unterschied zwischen Alexa+ und Chatbots wie ChatGPT sieht Amazon darin, dass Alexa+ tatsächlich handeln könne, es liefere nicht einfach nur Informationen. Durch ein Gespräch kann man beispielsweise die Heizung oder andere Smart-Home-Geräte steuern lassen, Termine dem Kalender hinzufügen oder nach Produkten auf Amazon suchen und diese dann auch direkt bestellen. Sagt man Alexa beispielsweise „Alexa, hier ist es zu heiß“, wird die Temperatur im Smart Home angepasst. „Alexa, mach das Licht hier gemütlich“ steuert die smarten Lichter in dem Raum, in dem man sich aufhält. Hierfür müssen Nutzer künftig also nicht mehr wissen, wie die Smart-Home-Geräte oder der hinterlegte Raum genau heißen, um sie zu steuern. Zudem lassen sich mehrere Geräte in nur einer Anfrage steuern.

Im Zusammenspiel mit dem Shopping-Angebot von Amazon können Anwender insbesondere auf den Echo-Show-Geräten mit Bildschirm nach passenden Geschenken zu einem Thema suchen, sich per Sprache die Bewertungen der anderen Nutzer zusammenfassen lassen und das Produkt dem Einkaufswagen hinzufügen oder direkt bestellen. Auch Aktionen wie „benachrichtige mich, wenn der Preis unter 30 Euro fällt“ sind nun möglich und sorgen dafür, das Alexa den Nutzer erinnert, sobald der Preis gefallen ist.

Alexa+ verarbeitet auch Fotos, Dokumente und E-Mails

Reicht die Sprache für die Kommunikation mit Alexa+ nicht aus, kann man auch Alexa mit visuellen Informationen füttern. Dies ist entweder über die Alexa-App möglich, über die Nutzer Fotos oder Dokumente hochladen können, oder indem man eine E-Mail an alexa@alexa.de von der bei Alexa registrierten E-Mail-Adresse des Accounts schickt. Die Informationen aus diesen Daten werden von der KI im Hintergrund analysiert und stehen künftig bereit. Diese vom Nutzer hochgeladenen Daten werden von Amazon nicht für das Training der KI genutzt.

So lassen sich beispielsweise auch eigene Rezepte zu Alexa hinzufügen, damit diese später wieder abgefragt werden können oder man sich nach den Zutaten erkundigen kann. Oder es wird ein Foto seines Kühlschrankinhalts bereitgestellt die KI gefragt, was mit den erkannten Zutaten heute gekocht werden könnte. Oder der Stundenplan der Kinder kann als Bild hochgeladen oder per E-Mail weitergeleitet werden, so dass Alexa weiß, wann die Kinder welchen Unterricht haben und wann sie nach hause kommen.

Echo Show als Stilberater

Mit einem Echo Show mit Kamera kann man diese auch nutzen, um Alexa beispielsweise zu fragen, ob das eigene Outfit für einen geplanten Anlass angemessen ist. Alexa erstellt über das Gerät ein Foto und gibt anschließend Tipps, wie es sich optimieren lässt.

Alexa+ wurde für Deutschland optimiert

Ein Grund, warum Alexa+ in Deutschland später als in den USA startet, sind die zahlreichen Dialekte, die verstanden werden müssen. Darüber hinaus wurde Alexa+ für Deutschland und auf seine Gewohnheiten angepasst. Es versteht nicht nur die Sprache, sondern auch lokale Eigenheiten und den hiesigen Humor. Sie kennt die Lieblingsmusik, regionale Spezialitäten und kulturelle Besonderheiten der einzelnen Regionen. Zudem ist Alexa moderner und nutzt Ausdrücke wie „läuft“, „muss ja“ oder „passt schon“ und rät davon ab, Weißwurst nach 12 Uhr zu essen. Auch mit Brötchen, Schrippen und Semmeln kann Alexa etwas anfangen.

Wie schützt Alexa+ Privatsphäre und Daten?

Wie auch bei den bisherigen Sprachanfragen, hat der Nutzer bei Alexa+ die Kontrolle darüber, welche Daten über ihn gespeichert werden und wann sie gelöscht werden sollen. Im Alexa-Datenschutzportal oder in der Alexa-App können Nutzer die Interaktionen mit Alexa+ einsehen und Einstellungen überprüfen und verwalten. Sie können hören, was Alexa gehört hat, die von ihnen geteilten Anhänge überprüfen oder definieren, ob und wie lange Sprachaufnahmen gespeichert werden.

Alexa-fähige Geräte bieten auch weiterhin die Möglichkeit, die Mikrofone und Kamera auszuschalten, so dass keinerlei Daten verarbeitet werden.

ComputerBase hat Informationen zu diesem Artikel von Amazon unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

(*) Bei den mit Sternchen markierten Links handelt es sich um Affiliate-Links. Im Fall einer Bestellung über einen solchen Link wird ComputerBase am Verkaufserlös beteiligt, ohne dass der Preis für den Kunden steigt.

Apps & Mobile Entwicklung

Snapdragon 4 Gen 5 & 6 Gen 5: Schnellere App-Starts und weniger Ruckler in der Mittelklasse

Qualcomm erneuert mit dem Snapdragon 4 Gen 5 und Snapdragon 6 Gen 5 zwei Chips der Mittelklasse und hat mit Honor, Oppo, Realme und Redmi bereits mehrere Partner gefunden, die im Verlauf des zweiten Halbjahres Smartphones damit ausstatten wollen. Qualcomm verspricht eine flüssigere Bedienung, mehr Leistung und aktuelle Features.

Die Neuzugänge bilden die Nachfolger des Snapdragon 4 Gen 4 und Snapdragon 6 Gen 4, die Qualcomm im Dezember 2025 respektive Februar 2025 vorgestellt hatte.

Schnellere App-Starts und weniger Ruckler

Qualcomm will mit den aktualisierten Chips eine „lag-freie“ Navigation auch in der Smartphone-Mittelklasse erreichen und versammelt dafür unter der Bezeichnung „Snapdragon Smooth Motion UI“ mehrere Verbesserungen in der Bedienung. Auf Smartphones mit Snapdragon 4 Gen 5 sollen Apps 43 Prozent schneller starten und 25 Prozent weniger Ruckler entstehen, wie eigene Messungen im Labor mit einem Qualcomm Reference Design (QRD) im Vergleich zum Vorgänger ergeben hätten. Für den Snapdragon 6 Gen 5 belaufen sich die Optimierungen auf 20 Prozent für App-Starts und 18 Prozent für weniger Ruckler.

Mehr GPU- und CPU-Leistung

Für den Snapdragon 4 Gen 5 gibt Qualcomm eine Steigerung der GPU-Leistung um 77 Prozent an, was erstmals das Spielen mit bis zu 90 FPS in der Mittelklasse ermögliche. Zum Einsatz kommt eine nicht näher detaillierte Adreno-GPU, die Bildschirme mit bis zu „FHD+“ und 144 Hz ansteuern kann. Die CPU des Chips setzt auf Arm- anstelle von eigenen Qualcomm-Oryon-Kernen, wie der Name „Kryo“ suggeriert, und ist in zwei P-Cores mit 2,4 GHz und sechs E-Cores mit 2,0 GHz unterteilt. Beim Vorgänger Snapdragon 4 Gen 4 kamen dafür Cortex-A78 und Cortex-A55 zum Einsatz.

Der Snapdragon 6 Gen 5 wiederum kommt auf ein Plus von 21 Prozent für die – ebenfalls nicht im Detail benannte – GPU und bietet eine CPU, die dieses Mal aus vier P-Cores mit 2,6 GHz und vier E-Cores mit 2,0 GHz besteht. Die CPU des Snapdragon 6 Gen 4 war noch in 1+3+4 mit Cortex-A720 und Cortex-A520 unterteilt.

Multi-SIM DSDS, Wi-Fi 7 und XPAN

Einzug halten zudem Features wie Multi-SIM mit 5G und 4G DSDA im Snapdragon 4 Gen 5. DSDA (Dual SIM, Dual Active) bezeichnet ein Smartphone mit zwei SIM-Karten, bei dem beide Karten gleichzeitig aktiv sind, um zum Beispiel auf einer SIM telefonieren und trotzdem auf der anderen erreichbar bleiben zu können. Im Unterschied zu „Dual Standby“ wird die zweite SIM also nicht deaktiviert, wenn die erste genutzt wird.

Beim Snapdragon 6 Gen 5 kommt über Qualcomms FastConnect-Plattform Support für Wi-Fi 7, außerdem sind Bluetooth 6.0, LE Audio und Bluetooth Channel Sounding neu.

Auch Qualcomm XPAN ist jetzt an Bord. Expanded Personal Area Network Technology (XPAN) nennt Qualcomm die Übergabe des Signals von Bluetooth an WLAN, um die Reichweite von wenigen Metern auf ein ganzes Zuhause oder größeres Gebäude zu erweitern, sofern sich das Abspielgerät und die mit passendem Chip ausgestatteten Kopfhörer im selben WLAN befinden. Die Verbindung kann nicht nur vom Smartphone über einen Router zu den Kopfhörern, sondern auch direkt vom Smartphone zu den Kopfhörern mittels WLAN erfolgen. Dabei hebt Qualcomm die Datenrate auf bis zu 29 Mbit/s an und schaltet die Lossless-Übertragung von Audio in 24 Bit mit 192 kHz frei.

-

Künstliche Intelligenzvor 3 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview