Bild: Jana Reske

Bild: Jana Reske

Von der Suchliste zur fertigen Antwort

Über viele Jahre hinweg folgte Online-Marketing einer relativ klaren Logik: Wer bei Google möglichst weit oben rankt, wird gefunden, bekommt Klicks und hat damit die Chance, Nutzer:innen auf die eigene Website zu führen. Diese Gleichung beginnt jedoch gerade zu kippen.

Mit der Verbreitung generativer KI-Systeme verändert sich die Struktur der Suche selbst. Tools wie ChatGPT, Perplexity AI oder Googles Google AI Overviews liefern immer häufiger direkt formulierte Antworten statt einer Liste von Links. Die Modelle durchsuchen verschiedene Quellen, fassen Informationen zusammen und präsentieren Nutzer:innen eine bereits kuratierte Antwort. Das wirkt auf den ersten Blick effizient. Für Websites bedeutet es jedoch, dass Sichtbarkeit zunehmend auch ohne klassischen Klick stattfinden kann.

GEO statt SEO?

In diesem Zusammenhang taucht seit einiger Zeit ein neuer Begriff auf, der in Marketing- und Tech-Kreisen immer häufiger diskutiert wird: Generative Engine Optimization, kurz GEO.

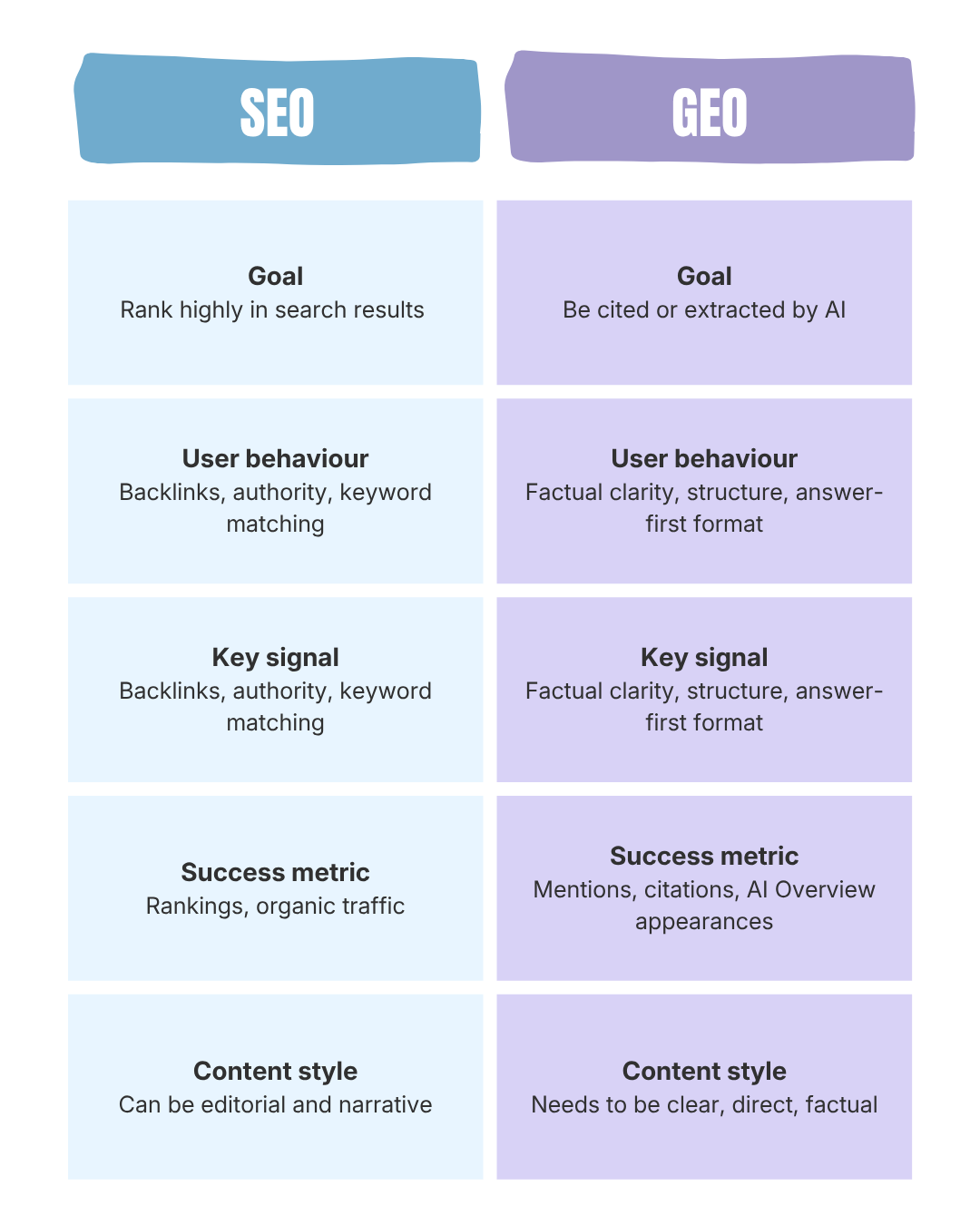

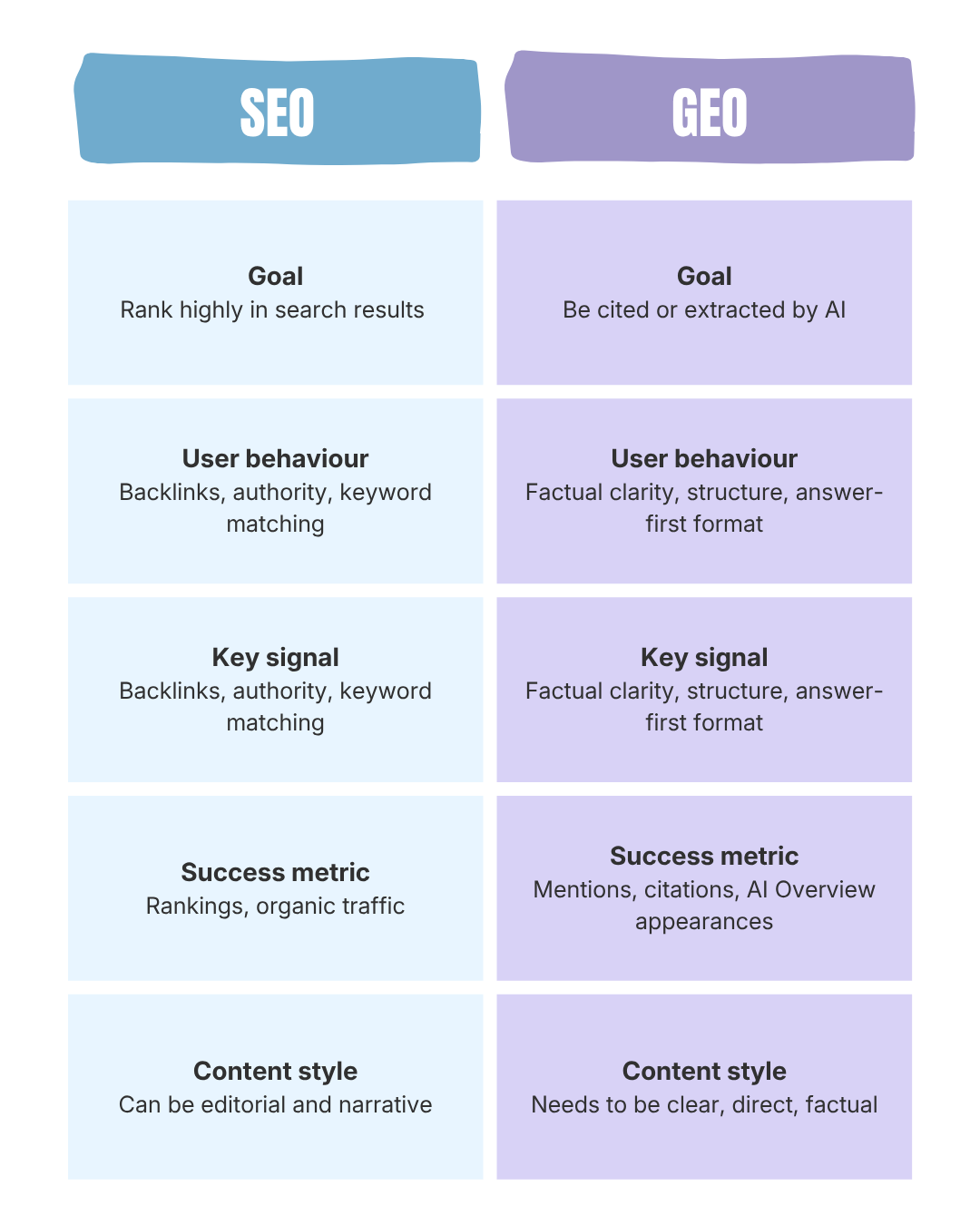

Während sich Search Engine Optimization (SEO) lange darauf konzentriert hat, Inhalte für Suchmaschinen zu optimieren und möglichst weit oben in den Ergebnislisten zu erscheinen, verschiebt sich der Fokus bei GEO leicht, aber entscheidend.

Die zentrale Frage lautet nicht mehr nur, ob eine Website gefunden wird, sondern ob ihre Inhalte Teil der Antworten werden, die generative KI-Systeme formulieren. Damit verändert sich auch der klassische Weg digitaler Aufmerksamkeit. Wo früher ein klarer Ablauf existierte – Suche, Klick, Website –, kann dieser Prozess heute deutlich kürzer ausfallen. Die Antwort erscheint bereits in der Oberfläche der Suchmaschine oder des Chatbots selbst.

Sichtbarkeit ohne Klick

Genau darin liegt eine der größten Verschiebungen. Wenn KI-Systeme Antworten direkt zusammenstellen, kann es passieren, dass Nutzer:innen die Information bereits erhalten haben, ohne eine Website überhaupt zu öffnen. Für viele Unternehmen stellt sich daher eine neue Frage: Nicht nur, ob eine Marke gefunden wird, sondern auch, ob die KI sie überhaupt »kennt«.

In Marketingdiskussionen taucht dafür inzwischen gelegentlich ein Begriff auf, der an den klassischen »Share of Voice« erinnert: der Share of Model. Gemeint ist damit die Präsenz einer Marke innerhalb der Antworten generativer Systeme. Wenn ein Modell beispielsweise regelmäßig dieselben Tools oder Anbieter nennt, entsteht eine neue Form von Sichtbarkeit, selbst dann, wenn kein direkter Websitebesuch stattfindet.

Ein wesentlicher Unterschied zwischen SEO und GEO liegt darin, wie stark Unternehmen die eigene Sichtbarkeit kontrollieren können. Klassische Suchmaschinenoptimierung konzentrierte sich lange auf die eigene Website: Inhalte, Struktur, Keywords und technische Optimierung.

Generative KI funktioniert anders. Die Modelle greifen auf ein breites Spektrum an Quellen zurück, wie journalistische Artikel, Blogs, Foren, Bewertungen oder Social-Media-Beiträge. Dadurch entsteht ein deutlich komplexeres Bild davon, wie eine Marke im Netz wahrgenommen wird.

Die überraschende Rückkehr der Textplattformen

Gerade deshalb gewinnen Plattformen an Bedeutung, die lange nicht unbedingt als klassische Marketingkanäle galten. Besonders auffällig ist derzeit die Rolle textbasierter Community-Plattformen.

So taucht etwa Reddit in vielen KI-Antworten überraschend häufig als Quelle auf. Die Plattform besteht aus Diskussionen, Erfahrungsberichten und Bewertungen, genau jener Art von Inhalten, die Sprachmodelle gut verarbeiten können. Wenn Nutzer:innen dort Produkte vergleichen oder konkrete Probleme diskutieren, entstehen Beiträge, die für generative Systeme besonders wertvoll sind.

Auch LinkedIn scheint eine neue Rolle einzunehmen. Während die Plattform lange vor allem als berufliches Netzwerk wahrgenommen wurde, entwickeln sich längere LinkedIn-Posts und Artikel zunehmend zu einer Art öffentlich zugänglicher Wissensbasis. Beiträge, die ein Thema erklären oder analysieren, werden immer häufiger von KI-Systemen als Quelle aufgegriffen.

Diese Entwicklung könnte Social-Media-Strategien langfristig verändern. Plattformen, die stark auf kurze visuelle Inhalte setzen, bleiben zwar wichtig für Aufmerksamkeit. Doch textbasierte Plattformen könnten wieder an Bedeutung gewinnen. Schlicht deshalb, weil sie die Art von Informationen liefern, aus denen KI-Modelle ihre Antworten konstruieren.

Eine neue Phase der Suche

Suchmaschinen experimentieren weiterhin mit KI-Antworten, und auch die Modelle selbst entwickeln sich ständig weiter. Doch schon jetzt zeigt sich, dass generative KI nicht nur ein neues Interface für die Suche darstellt. Sie verändert auch, wo und wie Informationen im Netz entstehen und damit die Orte, an denen Marken sichtbar werden.

All das deutet darauf hin, dass sich Marketing langsam in eine andere Richtung bewegt. Während SEO lange stark auf technische Optimierung und Keyword-Strategien ausgerichtet war, rückt nun stärker in den Fokus, wie eine Marke im gesamten digitalen Diskurs erscheint.

Es reicht möglicherweise nicht mehr aus, nur Inhalte auf der eigenen Website zu veröffentlichen. Entscheidend wird zunehmend, ob eine Marke auch in Artikeln, Diskussionen, Erfahrungsberichten oder Analysen auftaucht. Genau darin liegt vielleicht die spannendste Veränderung: Sichtbarkeit entsteht nicht mehr nur durch Rankings, sondern durch Einordnung, Kontext und Erwähnungen.

Quelle

Social Mediavor 3 Monaten

Social Mediavor 3 Monaten

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 Monaten

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 Monaten

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 Monaten

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 Monaten

Social Mediavor 2 Monaten

Social Mediavor 2 Monaten