Apps & Mobile Entwicklung

Agenten und Copilot in der Taskleiste: Was Microsoft an KI-Neuerungen in Windows 11 plant

Bei Windows 11 will Microsoft an den Kern-Funktionen ansetzen, um sowohl die Performance als auch die Stabilität zu verbessern. KI-Funktionen stehen aber weiterhin Agenda. Was man mit Agenten, der Sprachsteuerung und der Copilot-Integration in den Explorer plant, skizziert der Konzern in einem Video.

Abrufbar sind die in Windows 11 integrierten Agenten über die neue Copilot-Suchfunktion in der Taskleiste, die die herkömmliche Windows-Suche ersetzt. Von dort sollen Nutzer normale Anfragen starten, können aber auch direkt den Copilot-Assistenten starten.

Agenten als Alltagshelfer

Relevanter für die Windows-11-Zukunft erscheinen jedoch die Agenten-Funktionen, die Teil des Plans sind, das Betriebssystem zu einem agentic OS umzubauen. Was sich damit in der Praxis machen lässt, schildert Microsoft-Direktor Jeremy Chapman. So lassen sich über die Taskleiste einzelne Agenten wie „Analyst“ und „Researcher“ starten. Diese arbeiten dann im Hintergrund Aufgaben ab und erstellen im Fall von Researcher etwa umfassende Berichte.

Vergleichbar ist diese Funktion also in erster Linie mit den Deep-Research-Assistenten, die es etwa in den Assistenten ChatGPT und Gemini gibt. Von Agenten wie Claude Code und OpenClaw, die einen Rechner autonom steuern, zeigt Microsoft noch nichts.

Windows-11-Agenten in der EU noch nicht verfügbar

In der EU sind die Agenten noch nicht verfügbar, außerhalb von Europa verteilt Microsoft aber Vorabversionen über das Windows Insider Program. Erste Nutzerberichte fallen aber generell negativ auf. In der PC World kritisiert der Autor Mark Hachman etwa, dass der Agent nicht in der Lage war, doppelte Dateien in OneDrive zu entfernen.

KI in Windows 11 nutzt lokale Dateien

Als relevante Entwicklung präsentiert Chapman auch die Sprachsteuerung, die in Microsoft 365 Copilot enthalten ist. Interessant soll das vor allem sein, wenn der Assistent die Work-Tab-Funktion nutzt. In diesem Fall wird der Microsoft Graph als Datengrundlage verwendet, der Assistent kann also auch auf Informationen zugreifen, die in der Microsoft-365-Umgebung gespeichert sind – also etwa Dokumente in OneDrive oder Mails in Outlook.

Davon verspricht Microsoft Hilfe im Alltag. Baut ein Nutzer etwa eine PowerPoint-Präsentation, kann er per Sprachsteuerung die passenden Informationen anfragen, die gerade benötigt werden. Ein Wechsel der Fenster oder eine eigenständige Suche wäre im Idealfall also nicht mehr nötig.

Indem Microsoft den Copilot-Assistenten direkt in den Explorer integriert, soll auch der Umgang mit Dokumenten erleichtert werden. Die Copilot-Schaltfläche erscheint direkt neben dem Dateinamen. Wird diese gedrückt, öffnet sich der Assistent und es lassen sich direkt spezifische Fragen zum Inhalt stellen.

KI und die Suche nach dem Mehrwert

Mit Nachdruck hat Microsoft neue KI-Funktionen in Windows 11 integriert. Was der Konzern damit aber vor allem erreicht hat, ist den Ruf des Betriebssystems – zumindest unter Enthusiast-Nutzern – gewaltig zu ramponieren. Einen konkreten Mehrwert liefern diese bislang aber kaum, das zeigt etwa die Analyse von ComputerBase.

Das Problem mit den KI-Funktionen zeigt sich auch in einem Blog-Beitrag von letzter Woche, in dem Microsoft das Jahr 2026 als „Moment für KI-Computer“ beschreibt. Traditionelle Computer folgen demnach den Befehlen der Nutzer, KI-PCs würden hingegen die Wünsche antizipieren. Wenn es konkret wird, landet Microsoft aber bei Copilot+-Funktionen wie der neuen KI-Suche, die bislang in der Praxis nur unausgegoren funktioniert. Oder es werden Funktionen wie die KI-Suche Recall erwähnt, die äußerst unbeliebt sind.

- 4 Erkenntnisse: Wie Microsoft den Ruf von Windows 11 ruiniert hat

- Verbesserungen bei Microsoft: Windows 11 schneller & stabiler, KI auf dem Prüfstand

KI-Funktionen in Windows 11 zu straffen, zählt zu den Verbesserungen, die im Raum stehen. Was genau damit geplant ist, bleibt abzuwarten. Die aktuellen Ankündigungen zeigen jedoch: Vom grundsätzlichen KI-Kurs weicht Microsoft nicht ab.

Spielraum existiert derweil vor allem noch bei den Agenten. KI-Assistenten wie Claude Code bieten schon deutlich mehr Fähigkeiten als das, was Microsoft bislang präsentiert hat. Naheliegend also, dass Microsoft hier nochmal deutlich nachlegt.

Apps & Mobile Entwicklung

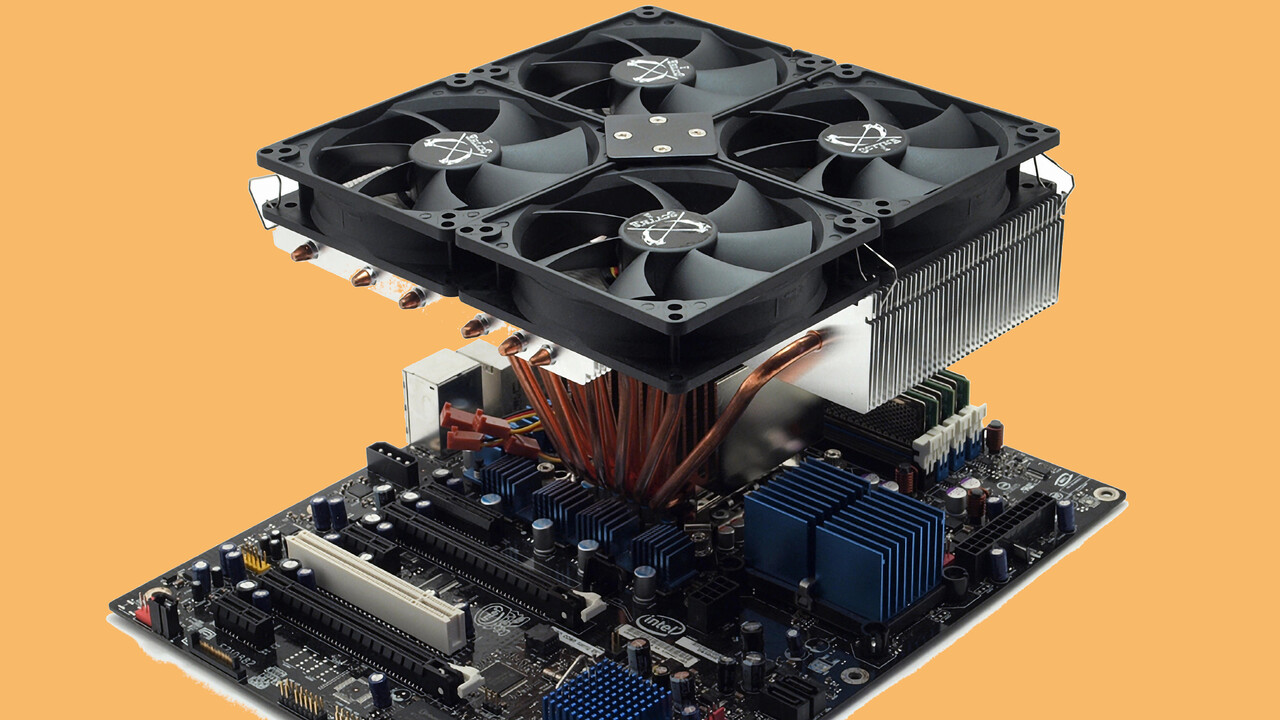

Im Test vor 15 Jahren: Der Scythe Susanoo war trotz vier Lüftern nur Durchschnitt

Abseits des Einheitsbreis gab es vor 15 Jahren wenig im Markt für CPU-Kühler. Der japanische Hersteller Scythe wagte mit dem Susanoo (Test), ein neues Konzept zu versuchen. Mit vier 100-mm-Lüftern, gigantischen Dimensionen und einem rekordverdächtigen Gewicht sollte der Susanoo zu hoher Kühlleistung verhelfen.

Der Ansatz war rohe Gewalt

Prinzipiell lautete Scythes Ansatz für den Susanoo „viel hilft viel“. Das gewaltige Top-Blow-Konstrukt kam inklusive der vier 100-mm-Lüfter auf Abmessungen von 210 × 210 × 160 mm bei einem Gesamtgewicht von satten 1.575 Gramm. Dabei kamen gleich zwei Kühlkörper zum Einsatz, die über zwölf Heatpipes verfügten, die sie mit der kupfernen Bodenplatte verbanden. Die Kühlkörper waren asymmetrisch ausgelegt: Der größere Kühlkörper bestand aus 42 Aluminiumlamellen, während der kleinere auf 26 kam. Die beigelegten Lüfter ließen sich in einem Drehzahlbereich von 500 bis 2.000 U/min ansteuern, wobei sie laut Herstellerspezifikation von 85,03 bis 340,14 m³/h Luft förderten.

Dem Gewicht entsprechend bedingte der Susanoo eine stabile Montage. Der Hersteller setzte hierfür auf eine Rückplatte sowie Haltebügel auf der Front des Mainboards. Aufgrund der Abmessungen des Kühlers gestaltete sich die Installation nicht einfach. Zum einen überragte der Kühler die Grafikkarte, sodass diese rechtzeitig montiert werden musste. Zum anderen war der Einbau des Mainboards in das Gehäuse erschwert, da sich die mittlere Schraubenreihe nicht mehr erreichen ließ. Scythe legte aus diesem Grund kleine Plastik-Clips bei, um die Schrauben zu ersetzen.

Viel Wind um nichts

Der Susanoo musste sich auf einem Intel Core i7-920 bewähren. Dieser wurde sowohl im „Standardmodus“ bei 2,66 GHz und 1,2 Volt als auch im „Performancemodus“ bei 3,4 GHz und 1,4 Volt betrieben. Trotz der gigantischen Abmessungen und der vier Lüfter fiel die Kühlleistung des Scythe Susanoo ernüchternd aus. Gegenüber anderen Kühlern lag der Susanoo abgeschlagen am Ende des Testfeldes, wenn die erreichte CPU-Temperatur den Drehzahlen der Lüfter gegenübergestellt wurde.

Zumindest teilweise war diese schlechte Leistung in den Abmessungen des Susanoo begründet. Der Kühler war so groß, dass er zu nah an der Seitenwand des Gehäuses lag, was den Luftstrom behinderte und dem Susanoo so den Wind aus den Segeln nahm. Bei geschlossener Seitenwand gegenüber einem geöffneten Gehäuse verlor der Susanoo knapp 13,5 Kelvin, während ein Noctua NH-D14 nur 5 Kelvin verlor. Im Test handelte es sich spezifisch um ein Silverstone TemJin-SST-TJ09S, das stellvertretend für Standard-ATX-Gehäuse stand.

Fazit

Am Ende des Tages konnte der Susanoo nicht überzeugen. Obwohl es löblich war, dass Scythe sich abseits der etablierten Standards ausprobierte, scheiterte dieser Versuch mit dem Susanoo. Die riesigen Dimensionen und das entsprechende Gewicht zusammen mit dem hohen Preis von 80 Euro und der schlechten Kühlleistung ergaben kein stimmiges Gesamtpaket.

In der Kategorie „Im Test vor 15 Jahren“ wirft die Redaktion seit Juli 2017 jeden Samstag einen Blick in das Test-Archiv. Die letzten 20 Artikel, die in dieser Reihe erschienen sind, führen wir nachfolgend auf:

Noch mehr Inhalte dieser Art und viele weitere Berichte und Anekdoten finden sich in der Retro-Ecke im Forum von ComputerBase.

Apps & Mobile Entwicklung

Neues PlayStation DRM-System: Dauerhafte Offline-Spiele erst nach Server-Check bestätigt

Nach einigen Tagen Unsicherheit und Spekulationen hat Sony die Existenz eines neuen DRM-Systems für Spiele aus dem PlayStation-Store bestätigt. Das setzt nach dem Kauf einmalig eine Online-Verbindung voraus, soll aber eigentlich keinen Unterschied machen.

Das steckt hinter dem neuen 30-Tage-Timer

Vergangene Woche entdeckten Spieler nach dem Kauf im PlayStation-4-Store einen neuen Timer mit einer Laufzeit von 30 Tagen. Läuft der Timer ab bevor eine Internetverbindung hergestellt wird, geht der Zugriff auf das Spiel verloren. Ausgenommen sind Spiele auf Blu-ray und in der Vergangenheit erworbene Titel. Auf der PlayStation 5 wird der Timer hingegen nicht angezeigt, ohne Verifizierung ließen sich Spiele dort jedoch nicht starten.

Das führte zu Spekulationen. Angenommen wurde unter anderem, dass die Konsolen nun alle 30 Tage eine Internetverbindung benötigen – und bei einer leeren CMOS-Batterie der Zugriff auf Spiele verloren geht, weil das System keine Zeit mehr abgleichen kann. Ein genauerer Blick ergab allerdings, dass ab dem 15. Tag nach dem Kauf eine bestehende Internetverbindung aus der 30-Tages-Lizenz eine dauerhafte, auch unbegrenzt offline nutzbare Lizenz macht. Besteht vorher eine Internetverbindung, ändert sich nichts: Die Lizenz bleibt temporär, die Server müssen einmal nach Ablauf von 14 Tagen kontaktiert werden.

Sony bestätigt und gibt Entwarnung

Sony bestätigte die Änderung nun unter anderem gegenüber GameSpot. Das Unternehmen stellte klar, dass nach dem Kauf eine einmalige Online-Verifikation, danach aber keine weiteren Server-Kontakte nötig sind. „Spieler können auf ihre Spiele wie gewohnt zugreifen und sie normal spielen“, schrieb Sony. Im Prinzip soll sich also nichts ändern.

Über die Gründe für die Änderung am System schweigt Sony. Als Grund wird jedoch angenommen, dass Sony Exploits schließen wollte. Dafür spricht, dass die Umwandlung der Lizenz nach Ablauf des Rückerstattungsfensters erfolgt. User „andshrew“ aus dem Resetera-Forum nimmt daher an, dass es offenbar möglich war ein Spiel zu kaufen, die Lizenz zu kopieren und das Spiel anschließend zurückzugeben. Eine Einschränkung der Lizenz während des Rückgabezeitraums könne eine Möglichkeit sein, eine solche potentielle Lücke zu schließen.

Apps & Mobile Entwicklung

UltraGear evo GM9 27GM950B: LG bringt hellen 5K-Monitor mit über 9.000 Mini-LEDs

Einen 5K-Monitor mit hellem Mini-LED-Backlight und Dual-Mode bringt LG mit dem UltraGear evo GM9 (27GM950B) auf den Markt. Der 27″-Monitor liefert 218 ppi und soll in der Spitze mit 1.250 cd/m² leuchten. Spieler haben die Wahl zwischen nativer Auflösung mit 165 Hz oder WQHD mit 330 Hz.

5K-Auflösung für 218 ppi

Die 5.120 × 2.880 Pixel des UltraGear evo GM9 (27GM950B) bedeuten eine Bildpunktdichte von 218 ppi bei 27 Zoll Diagonale. Diese Variante der 5K-Auflösungen wird auch 5K UHD+ genannt und nutzt das klassische 16:9-Seitenformat. Sie liefert doppelt so viele Pixel wie Dual QHD mit 5.120 × 1.440 in 32:9.

IPS mit 2.304 Mini-LED-Zonen

Das IPS-Display ist mit einem Mini-LED-Backlight bestückt, das über 2.304 separat dimmbare Leuchtzonen verfügt. Die Gesamtzahl der Mini-LEDs gibt LG mit 9.216 an. Jede Zone verfügt demnach über 4 Leuchtdioden. Je mehr Zonen ein Mini-LED-Display hat, umso feiner ist die Abstufung bei der Beleuchtung, was den Halo-Effekt bei hellen Objekten vor dunklem Hintergrund verringert, aber nicht eliminiert. Die Kombination aus 5K UHD+ und 2.304 Mini-LED-Zonen bietet sonst nur Apples Studio Display XDR.

LG spricht von „Hyper Mini LED“ und wirbt mit einer „überragenden Spitzenhelligkeit“ von 1.250 cd/m². Diese Leuchtkraft wird allerdings nur punktuell erreicht. Auf ganzer Fläche sollen aber ebenfalls hohe 750 cd/m² möglich sein. Der Monitor ist nach DisplayHDR 1000 zertifiziert.

Durch einen besonders geringen Abstand zwischen Panel und Hintergrundbeleuchtung sollen lichtdurchlässige Stellen und Blooming-Effekte reduziert werden. LG spricht von „Zero Optical Distance“-Technologie.

Dual-Mode für bis zu 330 Hz

Die native 5K-Auflösung wird mit bis zu 165 Hz dargestellt. Spieler, die Auflösung zugunsten einer höheren Bildwiederholrate opfern wollen, können auf den alternativen Modus mit 2.560 × 1.440 Pixeln umschalten, um dann die doppelte Bildwiederholfrequenz von 330 Hz zu erhalten.

DisplayPort 2.1 mit UHBR20

Bei den Videoeingängen ist der aktuelle DisplayPort 2.1 in der maximalen Ausbaustufe mit vier 20-Gbit/s-Lanes (UHBR20) für 80 Gbit/s brutto vertreten. Außerdem gibt es zweimal HDMI 2.1, einen USB-C-Anschluss mit 90 Watt Power Delivery sowie zwei USB-A-Buchsen und einen Kopfhörerausgang. Eine KVM-Funktion wird auf den Produktseiten zwar nicht explizit erwähnt, doch weist der Eintrag „Dual Controller“ bei den Spezifikationen darauf hin.

Weitere Ausstattung

Der Monitor verfügt über einen integrierten Prozessor, mit dem sich niedriger auflösende Inhalte auf 5K Hochskalieren lassen (Upscaling). Das Feature ist allerdings nicht für Spiele gedacht, hier leisten die Grafikkarten von AMD, Intel und Nvidia bessere Arbeit.

Die integrierten Stereolautsprecher (2 × 7 W) sollen dank „AI Sound“ ein immersives virtuelles 7.1.2-Kanal-Klangerlebnis simulieren.

AI Sound trennt einzelne Audioelemente – Stimmen, Effekte und Hintergrundgeräusche – auf intelligente Weise voneinander und passt sich dem Spielgeschehen an. So entsteht ein immersives virtuelles 7.1.2-Kanal-Klangerlebnis. Über die integrierten 7-W-Stereolautsprecher (2 x 7 W) oder Kopfhörer bleiben Stimmen auch in intensiven Feuergefechten deutlich hörbar, während wichtige Hinweise wie Schrittgeräusche jederzeit klar zu erkennen sind.

LG

Sowohl AMD FreeSync als auch Nvidia G-Sync (kompatibel) werden unterstützt. Das Display lässt sich in der Höhe verstellen, neigen sowie vertikal und horizontal schwenken. Auf der Gehäuserückseite ermöglichen zwei LED-Streifen RGB-Leuchteffekte.

Preis und Verfügbarkeit

Die internationale Pressemitteilung nennt den April für den Marktstart, der je nach Region aber variieren kann. In den USA wird der UltraGear evo GM9 (27GM950B) zum Preis von rund 1.200 Dollar zur Vorbestellung angeboten.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview