Apps & Mobile Entwicklung

CPUs bleiben wichtig: Nvidia bietet reines Vera-CPU-Rack mit 256 Prozessoren an

Agentic AI und Reinforcement Learning benötigen schnelle CPUs, erklärt Nvidia zur GTC. Deshalb bietet das Unternehmen seine neue Vera-CPU jetzt auch in einem Rack ausschließlich mit CPUs an. Es reiht sich damit neben der Vera-Rubin- und der neuen LPU/LPX-Lösung ein. Partner gehen dabei noch weiter als Nvidia selbst mit 256 CPUs.

Vera hat 88 Custom-Arm-Kerne mit SMT für 176 Threads

Vera ist Nvidias neue Custom-Arm-CPU und bildet den CPU-Teil der neuen Vera-Rubin-Plattform, die in der zweiten Jahreshälfte 2026 an den Start gehen soll. Nvidia hatte Vera erstmals zur Computex 2024 benannt, zudem sind seit der letztjährigen GTC erste technische Details bekannt. Vera bietet 88 Custom-Arm-Kerne mit SMT für 176 Threads und wird mittels NVLink-C2C-Interconnect mit 1,8 TB/s an Rubin angebunden.

Zur diesjährigen GTC zeigt Nvidia die Vera-CPU allerdings auch als Einzellösung im Rack – ohne Rubin-GPU. Datacenter-Installationen lassen sich damit um mehr Prozessoren erweitern, als sie die Vera-Rubin-Plattform in der CPU-GPU-Kombination alleine mitbringt. Zur Erinnerung: Im „Oberon“ getauften Rack von Vera Rubin (VR NVL72) kommen 18 Compute Trays mit jeweils zwei Boards zum Einsatz, wobei auf jedem Board zwei Rubin-GPUs und eine Vera-CPU verbaut sind, also vier GPUs und zwei CPUs pro Tray für insgesamt 72 GPUs (mit 144 Dies) und 36 CPUs pro Rack.

Warum schnelle CPUs auch bei KI wichtig sind

Schnelle CPUs können im Zeitalter von Agentic AI und Reinforcement Learning von hoher Bedeutung im KI-Rechenzentrum sein. Reinforcement Learning ist ein Verfahren aus dem Machine Learning, bei dem ein KI-System durch Ausprobieren und Feedback lernt. Ein Agent führt Aktionen in einer Umgebung aus und erhält dafür Belohnungen oder Strafen. Durch viele Wiederholungen lernt das System, welche Entscheidungen langfristig die beste Belohnung bringen, und verbessert so schrittweise seine Strategie.

Nvidia sieht eine Architektur für das Reinforcement-Learning-Training von KI-Agenten vor, bei der GPUs und CPUs unterschiedliche Aufgaben übernehmen. Ein großer GPU-Cluster führt das Training und Inference des Modells durch. Das Modell erzeugt dabei Tokens – z. B. Code, Befehle oder Abfragen. Eine Sandbox-Infrastruktur mit CPU-Kernen führt diese erzeugten Tokens tatsächlich aus, z. B. SQL-Abfragen, Code kompilieren, Python-Programme laufen lassen. Die CPUs liefern die Ergebnisse und Daten zurück, die als Bewertung (Evaluation/Reward) für das Training dienen. Damit wird Reinforcement Learning umgesetzt: Das Modell probiert Aktionen aus (Code schreiben), sieht das Ergebnis der Ausführung und lernt daraus, bessere Lösungen zu erzeugen.

Olympus-Kern mit „world-class“ Single-Thread-Leistung

Zur GTC hat sich Nvidia erstmals auch zur Mikroarchitektur von Vera geäußert und dabei erklärt, was die Custom-Arm-Kerne auszeichnet. Die eigens entwickelten Kerne laufen demnach unter der Bezeichnung „Olympus“ und sollen eine „world-class“ Single-Thread-Leistung erreichen. Vera biete die 1,5-fache IPC von Grace, erklärte Nvidia in San Jose zur Hausmesse für KI-Entwickler.

Olympus bietet ein „10-wide instruction decode“, kann demnach bis zu 10 Instruktionen pro Takt dekodieren und an die Ausführungseinheiten weiterreichen. Die Mikroarchitektur bietet einen Neural Branch Predictor, also eine neue Art der Sprungvorhersage, bei der ein kleines neuronales Modell verwendet wird, das Muster in früheren Programmverläufen erkennt und dadurch oft genauere Vorhersagen trifft als klassische Tabellen- oder Heuristik-basierte Verfahren. Dadurch werden Pipeline-Stalls im Idealfall reduziert und die CPU kann effizienter arbeiten. Zwei Sprungvorhersage pro Taktzyklus sind bei Olympus möglich. Außerdem kommt bei der CPU ein für PyTorch optimierter Instruction-Buffer zum Einsatz.

Mehr Speicherbandbreite als x86-Prozessoren

Eine weitere Eigenschaften von Vera ist die laut Nvidia dreifache Speicherbandbreite pro Kern im Vergleich zu – namentlich nicht genannten – x86-Prozessoren. Das Unternehmen gibt insgesamt 1,2 TB/s für die 1,5 TB SOCAMM-LPDDR5X an, die jeder CPU zur Seite stehen. Pro Kern ist von bis zu 80 GB/s die Rede. Die CPUs bieten einen NVLink GPU Connect mit 1,8 TB/s sowie einen CPU-Chip-zu-Chip-Support für 2P-Lösungen.

Vera-CPU-Rack mit 256 Prozessoren

Nvidia selbst zeigt zur GTC ein neues Vera-CPU-only-Rack mit insgesamt 256 Vera-CPUs (22.528 Kerne mit 45.056 Threads), 400 TB SOCAMM-LPDDR5X für insgesamt 300 TB/s und 64 BlueField-4 DPUs. Vera-Racks setzen auf dieselbe MGX-Architektur zur Flüssigkeitskühlung wie die Vera-Rubin-Plattform.

Die Partner gehen noch weiter

Vera sei in voller Produktion, sagt Nvidia, und soll im Laufe des zweiten Halbjahres 2026 von zahlreichen namhaften Server-Partnern verfügbar sein. Einer davon ist HPE, der mit seinem GX5000 Rack weit über die Lösung von Nvidia hinausgeht. Bis zu 40 Blades mit jeweils 8 Nodes mit jeweils 2 Vera-CPUs (16 CPUs pro Blade) sind bei HPE möglich, sodass in einem Rack bis zu 640 CPUs mit 56.320 Olympus-Kernen zum Einsatz kommen.

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA im Vorfeld und im Rahmen einer Veranstaltung des Herstellers in San Jose, Kalifornien erhalten. Die Kosten für An-, Abreise und fünf Hotelübernachtungen wurden vom Unternehmen getragen. Eine Einflussnahme des Herstellers oder eine Verpflichtung zur Berichterstattung bestand nicht. Die einzige Vorgabe aus dem NDA war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Wochenrück- und Ausblick: AMDs 9950X3D2, VWs ID. Polo und Valves Steam Controller

Der Test des Ryzen 9 9950X3D2, die Vorstellung des VW ID. Polo sowie der Start des neuen Valve Stream Controller waren die Themen der Woche. Im Podcast ging es derweil um eine überraschende Anpassung der Nutzungsrichtlinien von GeForce Now als Reaktion auf eine Beschwerde aus der Community, die ComputerBase weitergereicht hatte.

Zum Fall des Testembargos konnten wir in Folge der von AMD nur sehr zaghaft verteilten Muster keinen Test liefern, eine Woche hingegen schon – auf Basis eines Musters von AMD. Interessiert niemanden mehr? Weit gefehlt, denn der Test landete mit Abstand auf dem ersten Platz.

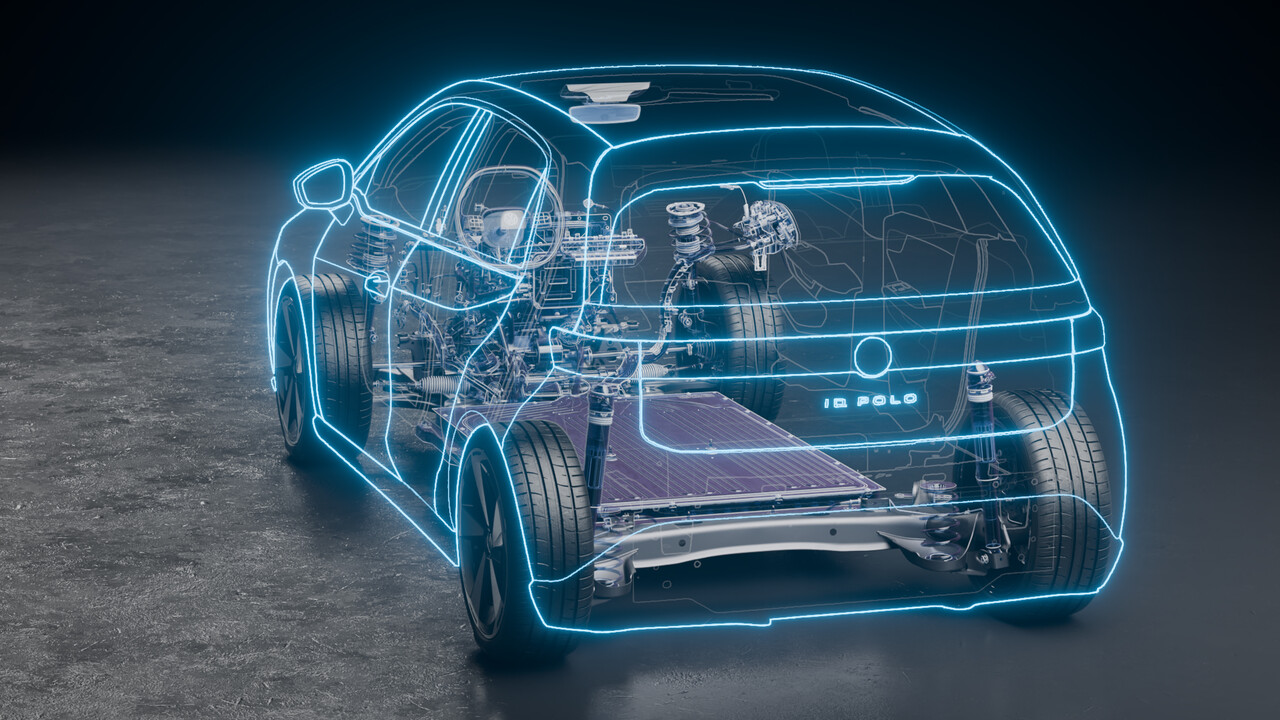

Bei den News schob sich in dieser Woche der neue ID. Polo, VWs erstes Elektroauto für „unter 25.000 Euro“, auf den ersten Platz – sogar die News zum neuen Valve Stream Controller, ab sofort für 99 Euro verfügbar, hatte demgegenüber das Nachsehen.

Podcast

Jan und Fabian sind diese Woche von Nvidia gleich doppelt überrascht worden, blieben dafür von AMDs neuem Ryzen-Topmodell auch nach Volkers Test unbeeindruckt, aber freuten sich mit Asus, Sapphire und – oh Wunder – sogar Ubisoft. Mehr Details in der News zu CB-Funk #167 oder direkt im Podcast:

CB-Funk lässt sich nicht nur über den in dieser Notiz eingebetteten Podigee-Player abspielen, sondern auch bequem direkt in den Podcast-Apps eurer Wahl abonnieren und anhören. Verfügbar ist der ComputerBase-Podcast auf Spotify, Apple Podcasts, Amazon Music, Deezer und ebenso auf YouTube.

Wochenausblick

Zum Einstieg in die nächste Woche werfen wir einen Blick auf die Rückkehr des Dell XPS, konkret das 14-Zoll-Modell mit Intel Core Ultra 300. Darüber hinaus steht ein Update des GPU-Testparcours an, wenn auch weniger umfangreich als üblich: Denn einerseits gilt es mal wieder top-aktuelle Ranglisten zu erstellen, andererseits wird der Parcours sehr wahrscheinlich nicht eine neue Grafikkarte sehen – denn bis AMD, Intel und Nvidia endlich wieder neue Hardware veröffentlichen, dürften die genutzten Treiber und Patch-Stände der Spiele schon wieder viel zu alt sein…

Wir wünschen euch allen einen erholsamen Sonntag!

Apps & Mobile Entwicklung

Legacy of the Dark Knight: Lego-Batman braucht Upscaling und Frame Generation

Lego Batman: Legacy of the Dark Knight hat schon wieder andere – und nun ergänzte – Systemanforderungen, die kurz vor der Veröffentlichung am 11. Mai finalisiert wurden. Upsampling ist fast Pflicht und damit auch ein Batcomputer. Der sei beim Spiel nicht dabei, scherzen die Entwickler. Um den kommen sie nur mit Tricks herum.

Am unteren Ende ändert sich am Meisten. Auf AMD-Plattformen reicht nun ein schwächerer Prozessor, der zuvor angesetzte Ryzen 5 3600 weicht einem zwei Generationen älteren Ryzen 5 1600. Bei Intel braucht es nun einen Intel Core i5-10600K, der etwas zügiger als der bislang genannte Core i5-9600K zu Werke geht. Bei der Grafikkarten geht es deutlich nach unten. Eine GeForce GTX 960, Radeon RX 6400 oder Intels Arc A580 sind absolute Einsteiger-Karten.

Der Haken findet sich an an derer Stelle: Um selbst mit niedrigster Detailstufe in 1080p auf 30 Bilder pro Sekunde zu kommen, wird FSR beziehungsweise bei Intel XESS, also Upsampling, mit(!) Frame Generation. Ohne wird die Bildrate also unter dem angegebenen Limit liegen. FSR mit Frame Generation ist dabei prinzipiell auch auf älteren (Nvidia-)GPUs lauffähig.

Weniger Hardware-Hunger = mehr Tricks

Etwas schwächer darf nun auch das empfohlene System sein. Der AMD Ryzen 7 5800X ist eine Generation älter als das bislang genannte AMD-Modell, bei Intel bleibt ein Core i7-12700K Pflicht. RTX 3080 und RX 6800 XT werden durch die etwas langsamere RTX 2070 Super und RX 6650 XT ersetzt. Auch hier gilt: 1440p mit 60 Bildern pro Sekunde erreicht nur, wer Upsampling und Frame Generation einsetzt.

Das relativiert auch die auf den ersten Blick moderaten 4K-Anforderungen. Oberklasse-Prozessoren müssen hierfür „nur“ mit GeForce RTX 4070 und AMD Radeon RX 9070 XT kombiniert werden, nativ werden die genannte Auflösung und Bildrate aber nicht erreicht. Für ein Lego-Spiel sind das unüblich hohe Anforderungen, die sonst recht simple Grafik lief im Grunde auf jedem beliebigen Rechner. Das ist hier anders. Wie gut das Spiel dann tatsächlich läuft, müssen Benchmarks bei Erscheinen ab dem 22. Mai 2026 zeigen.

Die Redaktion dankt ComputerBase-Leser „mibbio“ für den Hinweis zu dieser Meldung!

Apps & Mobile Entwicklung

Genaue Systemanforderungen: Subnautica 2 startet Mitte Mai auf starken Prozessoren

In rund zwei Wochen startet die Unterwasser-Survival-Sim Subnautica 2 endlich in den Early Access. Was es braucht um am Meeresboden zu überleben, verraten detaillierte Systemanforderungen mit vier Beispielkonfigurationen. In einem Bereich wird Rechenleistung benötigt.

Lange war die Unterwasser-Survival-Sim Subnautica 2 vor allem wegen Streitigkeiten zwischen Publisher Krafton und dem Studio Unknown Worlds in den Nachrichten, bei dem es um eine Verschiebung des Erscheinungstermins und die damit verknüpfte Zahlung oder eben Nicht-Zahlung von Boni ging. Nach gerichtlicher Klärung weitgehend im Sinne der Entwickler bei Unknown Worlds kann das Spiel nun in den Early Access starten. Schon am 14. Mai soll es in die Tiefe gehen.

Start im Early Access

In Subnautica 2 erkunden Spieler einen fremden Planeten unter Wasser, entweder alleine oder mit bis zu drei Freunden. Dazu errichten sie genretypisch einen Stützpunkt und entwickeln neue Werkzeuge, die immer weiter in die Tiefen des Meeres führen. Das Prinzip war im Vorgänger, der zu den Größen des Genres zählt, ein echter Hit.

Zunächst startet Subnautica 2 allerdings im Early Access, der laut den Entwicklern „etwa 2 bis 3 Jahren dauern“ wird. Im Laufe der Zeit soll das Spiel deutlich ausgebaut werden, unter anderem stellt Unknown Worlds neben den üblichen Optimierungen an Bedienung und Balancing weitere Biome, Lebewesen, Gegenstände, Funktionen und Erzählungen in Aussicht. Der Preis des Spiels ist noch unbekannt, soll aber am Ende mit Version 1.0 angehoben werden.

Systemanforderungen im Detail

Als untere Grenze werden sechs Rechenkerne und eine Einstiegs-GPU vom Schlage einer Radeon rX 5500 oder GeForce GTX 1660 benötigt. Dazu kommen lediglich sechs Gigabyte Arbeitsspeicher. Mengen gibt Unknown Worlds dabei sehr feinschrittig an, was der eskalierten Preissituation geschuldet sein wird. 1080p, niedrige Details und 30 Bilder pro Sekunde sind das Resultat.

Optimal sind hingegen acht Rechenkerne auf AMDs AM5-Sockel oder noch mehr Kerne in Intels i7-13700 mit acht oder zwölf Gigabyte RAM. Grafikseitig steigen die Anforderungen für mehr Details, höhere Bildraten und mehr Pixel noch vergleichsweise moderat auf maximal eine GeForce RTX 4070 oder Radeon RX 6900XT für 1440p, hohe Details und 60 FPS. Für Ultra-Einstellungen braucht es allerdings einen AMD Ryzen 9 7900X3D, AMDs 12-Kern-Gaming-Prozessor, oder einen Core i9-14900K. Dafür kann die GPU in der Leistungsklasse einer GeForce RTX 5070 Ti bleiben – oft genug wird dann eine RTX 4090 oder gar 5090 verlangt.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview