Online Marketing & SEO

KI enttarnt anonyme Accounts: Diese Spuren verraten dich

Anonym im Netz? Eine aktuelle Studie zeigt, dass große Sprachmodelle (LLMs) Accounts unter Pseudonym immer häufiger den dahinterstehenden Personen zuordnen können. Schon Schreibstil, Interessen oder kleine Details können Profile enttarnen – mit Risiken für Privatsphäre und Whistleblower.

Ein Reddit-Alt, ein anonymer LinkedIn-Kommentar oder ein pseudonymer Thread auf Hacker News galten lange als vergleichsweise sichere Wege, unerkannt im Netz zu agieren. Doch die Studie Large-scale online deanonymization with LLM agents, an der unter anderem Forschende der ETH Zürich und der University of Washington beteiligt waren, zeigt, wie leistungsfähig große Sprachmodelle inzwischen bei der Zuordnung pseudonymer Accounts werden.

Wer also noch glaubt, dank eines Nicknames wirklich anonym zu bleiben, könnte sich täuschen. Denn was Menschen beim Lesen oft übersehen, kann KI inzwischen systematisch erkennen: Muster in Sprache, Interessen oder biografischen Details lassen sich automatisiert analysieren und über Plattformen hinweg miteinander verknüpfen. Über die Analyse berichten unter anderem The Verge und The Guardian. In der Studie untersuchten die Forschenden, wie LLM-Agents öffentlich verfügbare Informationen auswerten und Profile plattformübergreifend miteinander abgleichen können. Die Forschung wurde von der ETH Zürich geleitet, wo auch die zentralen Experimente durchgeführt wurden. Der KI-Sicherheitsforscher Nicholas Carlini von Anthropic unterstützte das Team zusätzlich als wissenschaftlicher Berater.

OpenAI erreicht neues User- und Abo-Hoch:

Stoppt CancelChatGPT den Höhenflug?

Dein Schreibstil ist dein digitaler Fingerabdruck

Die Untersuchung zeigt, dass zur Identifizierung weder Hacks noch Datenlecks nötig sind. Oft reichen bereits Informationen, die Nutzer:innen selbst veröffentlichen. Die in der Studie eingesetzten LLMs analysieren Texte aus anonymen Accounts und suchen im Netz nach wiederkehrenden Mustern. Dabei erkennen sie typische Signale, die Rückschlüsse auf eine Person zulassen können, etwa:

- Schreibstil

- Wortwahl und Satzstruktur

- Interessen und Fachbegriffe

- biografische Hinweise aus Posts

Diese Informationen werden anschließend mit Profilen auf anderen Plattformen abgeglichen. Ziel ist es, mögliche Identitäten hinter pseudonymen Accounts zu identifizieren. Die Ergebnisse sind bemerkenswert. In Tests konnte das System Accounts mit einer Trefferquote von 68 Prozent bei 90 Prozent Präzision den dahinterstehenden Personen zuordnen. Grundlage waren Datensätze aus Plattformen wie Reddit, Hacker News und LinkedIn sowie Interview-Transkripte.

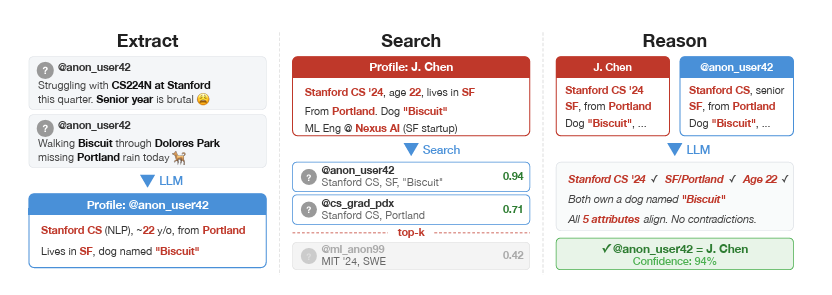

Ein Beispiel aus der Studie zeigt, wie die Methode funktioniert. Ein anonymes Konto berichtet etwa über schulische Schwierigkeiten und erwähnt Spaziergänge mit seinem Hund Biscuit im Dolores Park. Die KI durchsucht anschließend andere Plattformen nach Profilen mit ähnlichen Details und konnte so den anonymen Account @anon_user42 zuordnen. Voraussetzung dafür ist jedoch, dass irgendwo im Netz öffentliche Informationen existieren, etwa ein Profil mit Klarnamen, persönliche Posts oder andere Hinweise, die eine Verbindung ermöglichen. Erst durch solche übereinstimmenden Details kann die KI mehrere Profile derselben Person miteinander verknüpfen. Je mehr Inhalte ein anonymer Account veröffentlicht, desto leichter lässt er sich enttarnen.

Wer heute im Netz anonym bleiben möchte, müsste seine Accounts deshalb deutlich stärker voneinander trennen. Mögliche Gegenmaßnahmen wären etwa:

- bewusst unterschiedliche Schreibstile verwenden

- unterschiedliche Accounts konsequent voneinander trennen

- keine biografischen Details teilen

- wiederkehrende Interessen oder Themen nicht plattformübergreifend posten

- keine spezifischen Ortsangaben oder persönlichen Routinen erwähnen

- unterschiedliche Nutzungszeiten oder Aktivitätsmuster verwenden

- keine identischen Emojis, Formulierungen oder Redewendungen nutzen

Große Sprachmodelle können solche Analysen erstmals kostengünstig skalieren. Was früher Stunden oder sogar Tage manueller Recherche erforderte, lässt sich heute automatisiert durchführen. Gleichzeitig bleiben die Kosten niedrig. Laut der Studie kann eine Analyse lediglich ein bis vier US-Dollar pro Profil kosten. Die KI-Forscher Simon Lermen und Daniel Paleka erklärten, dass LLMs damit „eine grundlegende Neubewertung dessen erzwingen könnten, was im Internet noch als privat gilt“.

Die Risiken der KI-Deanonymisierung: Betrug, Fehlzuordnungen und Druck auf Whistleblower

Die KI-gestützte Überwachung entwickelt sich zu einem schnell wachsenden Forschungsfeld, das bei Informatiker:innen und Datenschutzexpert:innen zunehmend Besorgnis auslöst. Große Sprachmodelle können enorme Mengen öffentlich zugänglicher Informationen über Personen sammeln und miteinander verknüpfen. Für Menschen wäre eine solche Analyse kaum zu bewältigen, für KI lässt sie sich dagegen automatisieren und in großem Maßstab durchführen. Noch handelt es sich allerdings nicht um ein perfektes Überwachungssystem. Die Experimente wurden mit kuratierten Datensätzen durchgeführt, das zugrunde liegende Paper ist bislang nicht peer-reviewed und die Methode wurde nicht mit realen anonymen Accounts im offenen Internet getestet.

Potenzielle Vorteile solcher Technologien liegen vor allem im Bereich der Analyse und Moderation digitaler Kommunikation. KI-Systeme könnten etwa helfen, koordinierte Desinformationskampagnen aufzudecken, Bot-Netzwerke zu identifizieren oder orchestrierte Einflussversuche schneller zu erkennen. Gerade für Plattformen, die mit Manipulation, Fake Accounts oder organisierten Kampagnen kämpfen, könnte eine solche Analyse ein nützliches Werkzeug sein.

Der KI-Forscher Simon Lermen weist jedoch darauf hin, dass öffentlich zugängliche Informationen über Bürger:innen bereits heute „direkt für Betrug missbraucht werden“ könnten. Ein Beispiel ist Spear Phishing. Dabei sammeln Angreifer:innen gezielt Informationen über eine Person – etwa aus Social-Media-Profilen, Kommentaren oder Forenbeiträgen – und nutzen diese, um besonders glaubwürdige Betrugsnachrichten zu erstellen. Die Nachricht wirkt dann so, als käme sie von einer vertrauten Person oder einem bekannten Unternehmen und enthält häufig einen Link oder eine Bitte um persönliche Daten. Durch KI wird dieser Betrugsprozess deutlich einfacher. Große Sprachmodelle können Informationen über eine Person automatisch zusammentragen und daraus personalisierte Nachrichten formulieren.

Ein weiteres Risiko sind mögliche Fehlzuordnungen. Der Informatikprofessor Peter Bentley vom University College London warnt, dass KI-Systeme Accounts auch falsch miteinander verknüpfen könnten. Im schlimmsten Fall könnten Menschen dadurch für Aussagen verantwortlich gemacht werden, die sie nie getätigt haben.

Besonders kritisch ist die Entwicklung zudem für Menschen, die bewusst unter Pseudonym kommunizieren. Dazu zählen etwa Aktivist:innen, Journalist:innen oder Mitarbeitende, die Missstände anonym öffentlich machen wollen. Wenn sich solche Accounts durch KI leichter einer realen Person zuordnen lassen, könnten Betroffene schneller identifiziert und unter Druck gesetzt werden, etwa durch Belästigung im Netz, berufliche Konsequenzen oder rechtliche Schritte.

Wie sieht die Zukunft der Online-Anonymität im KI-Zeitalter aus?

Online-Anonymität verschwindet durch solche Technologien nicht sofort. Sie wird jedoch deutlich fragiler. Wer über verschiedene Plattformen hinweg ähnliche Interessen, Geschichten oder Schreibweisen teilt, hinterlässt einen digitalen Fingerabdruck. Genau diese digitalen Spuren können große Sprachmodelle heute schneller erkennen, analysieren und miteinander verknüpfen als Menschen.

Das hat zwei Seiten. Einerseits könnten solche Systeme Plattformen dabei helfen, Manipulation im Netz besser zu erkennen. Probleme wie Hate Speech, Bot-Netzwerke oder koordinierte Desinformation beschäftigen Social-Media-Dienste seit Jahren. Besonders schwer zu kontrollieren sind sogenannte Sockpuppet Accounts, also mehrere Profile, die von einer Person gesteuert werden, um Diskussionen gezielt zu beeinflussen oder künstlich Reichweite zu erzeugen. Wenn Systeme Schreibmuster, Inhalte und biografische Hinweise analysieren, lassen sich möglicherweise orchestrierte Debatten, Astroturfing-Kampagnen oder koordinierte Einflussversuche schneller identifizieren. Gerade für Community-Plattformen und Diskussionsnetzwerke wie Reddit, X, Threads oder Discord wäre das relevant.

Gleichzeitig zeigt die Forschung, wie leicht sich digitale Spuren im Netz zusammenführen lassen – und wie schnell sie für Betrug missbraucht oder für Datenschutzangriffe eingesetzt werden könnten. Mit immer leistungsfähigeren KI-Systemen wird Online-Anonymität zunehmend brüchiger. In Zukunft dürfte sie weniger eine Frage des Nicknames sein, sondern vielmehr davon abhängen, wie konsequent digitale Spuren getrennt werden.

Online Marketing & SEO

GPT-5.5 noch intelligenter: Arbeit von Monaten in Minuten

OpenAIs GPT-5.5 ist größer und schlauer als GPT-5.4, aber genauso schnell und vor allem beim Computer Use und Coding effektiv. User sparen damit Monate an Arbeitszeit und OpenAI verspricht noch mehr Intelligenz.

Die KI-Modellentwicklung war nie schneller. Nur rund einen Monat nach dem Launch von GPT-5.4 für ChatGPT legt OpenAI mit dem Modell GPT-5.5 nach. Das neue Modell soll eine neue „Intelligenzklasse“ bilden, die für die Erledigung von Arbeitsaufträgen prädestiniert ist, vor allem im Computer Use und beim Coding. Erste Beispiele zeigen bereits, wie das Modell unterstützt und dabei hilft, enorm viel Zeit zu sparen. Dabei soll GPT-5.5 in Sachen Tempo trotz der Optimierungen nicht zurückfallen und sogar einen geringeren Token-Einsatz ermöglichen. Codex User können sich indes über den Browser Support freuen.

GPT-5.4 ist da:

ChatGPT zeigt den Denkweg und bedient Software

Was GPT-5.5 ausmacht: Eine neue, intelligente Art, um Arbeit auf dem Computer zu erledigen

OpenAIs brandneues Modell GPT-5.5 wird in ChatGPT und Codex eingeführt. Dort können dann zunächst Pro, Plus, Business und Enterprise User zugreifen, der Roll-out für die Version GPT-5.5 Pro erfolgt nur in ChatGPT für Pro-, Business- und Enterprise-Abonnent:innen. Mit dem neuen Modell verspricht OpenAI eine „neue Intelligenzklasse“. Bei ChatGPT sorgt zum Beispiel GPT-5.5 Thinking für konzise Antworten und schnelle, präzise Hilfestellung. Insgesamt soll das Modell schneller verstehen, was du tun möchtest und diese Ideen und Intentionen im Arbeitskontext in Prozesse umwandeln, die eigenständig ausgeführt werden. Das Modell performt bei diversen Benchmarks wie Terminal-Bench 2.0 oder GDPval (wins or ties) besser als das vorangegangene GPT-5.4 oder das neue Claude Opus 4.7. Im Blog Post kannst du im Detail nachvollziehen, welche Performance-Vorteile GPT-5.5 zu bieten hat. Im Vordergrund steht laut OpenAI jedoch die Tasache, dass dieses Modell trotz optimierter Intelligenz und Größe dem Modell GPT-5.4 bei der Per-Token-Latenz im Real World Serving in nichts nachsteht. Denn oft sind neuere und größere Modelle langsamer, was ihre Nutzung beeinträchtigen kann. Dieses Problem soll GPT-5.5 nicht haben. OpenAI betont zudem, dass für den Einsatz via Codex weniger Token als bei GPT-5.4 eingesetzt werden müssten, um die Effizienz zu steigern:

[…]. GPT‑5.5 delivers this step up in intelligence without compromising on speed: larger, more capable models are often slower to serve, but GPT‑5.5 matches GPT‑5.4 per-token latency in real-world serving, while performing at a much higher level of intelligence. It also uses significantly fewer tokens to complete the same Codex tasks, making it more efficient as well as more capable.

GPT-5.5 delivers this step up in intelligence without compromising on speed.

GPT-5.5 matches GPT-5.4 per-token latency in real-world serving, while performing better across nearly every evaluation we measured.

It also uses significantly fewer tokens to complete the same Codex… pic.twitter.com/5mR46SM7mW

— OpenAI (@OpenAI) April 23, 2026

Der Start von GPT-5.5 kommt auch mit dem Support für den Browser Use bei Codex daher. So kann das Modell auf Web Apps zugreifen, Seiten besuchen und zum Beispiel Screenshots machen, während es arbeitet. Außerdem werden bessere Präsentationen via Google Drive und Microsoft Office ermöglicht.

With GPT-5.5, Codex now gets more of the job done across the browser, files, docs, and your computer.

We’ve expanded browser use so Codex can interact with web apps, and test flows, click through pages, capture screenshots, and iterate on what it sees until it completes the… pic.twitter.com/rUguNHIcIB

— OpenAI Developers (@OpenAIDevs) April 23, 2026

Einer der größten Vorteile des GPT-5.5-Modells soll überdies der optimierte Computer Use Mode sein. Dabei nutzt das Modell Inhalte auf dem Computer, um toolübergreifend und mit Zugriff auf Apps und Dateien Arbeit erledigen zu können. OpenAI schreibt:

[…] When combined with Codex’s computer use skills, GPT‑5.5 brings us closer to the feeling that the model can actually use the computer with you: seeing what’s on screen, clicking, typing, navigating interfaces, and moving across tools with precision.

Weiterentwicklung von GPTs:

OpenAI führt Workspace Agents in ChatGPT ein

So viel Arbeit nimmt das Modell Usern schon ab

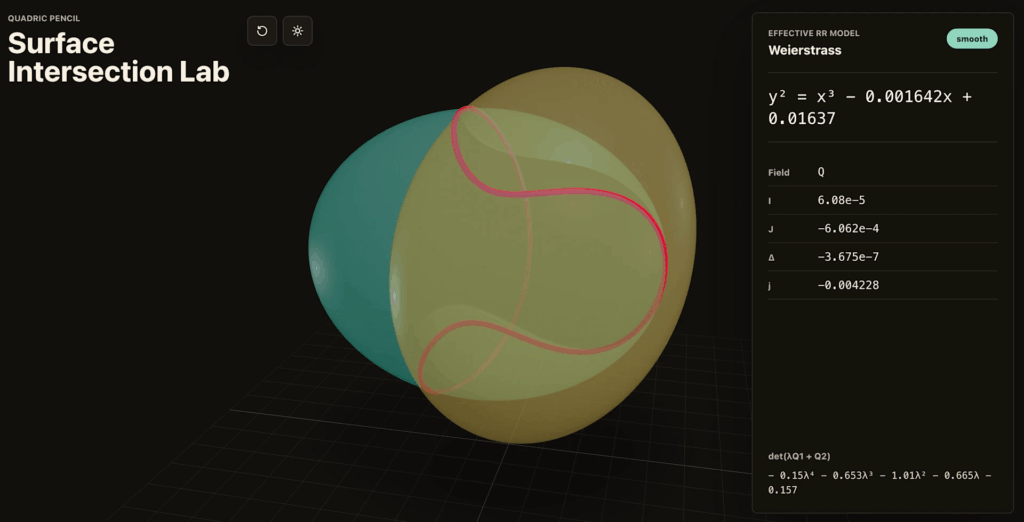

Im ausführlichen Blog Post zum neuen Modell liefert OpenAI eine Reihe von Beispielen, die zeigen, wie viel effizienter einige User mit GPT-5.5 arbeiten können. Die Immunologieprofessorin Derya Unutmaz vom Jackson Laboratory for Genomic Medicine hat beispielsweise mit GPT‑5.5 Pro ein Datenset zur Genexpression mit 62 Samples und rund 28.000 Genen analysieren lassen. Dabei wurden detaillierte Berichte zur Analyse produziert, samt Zusammenfassung der Erkenntnisse und Kernfragen, die offen bleiben. Laut Unutmaz hätte die Arbeit ohne ein solches Modell Monate dauern können, war so aber in kurzer Zeit erledigt. Bartosz Naskręcki wiederum, Assistenzprofessor für Mathematik an der Adam Mickiewicz Universität in Poznań, hat GPT‑5.5 in Codex genutzt, um in nur elf Minuten mit einem einzigen Prompt eine algebraische Geometrie-App zu erstellen, die eine Visualisierung des Schnittpunkts quadratischer Flächen und Umwandlung der resultierenden Kurve in ein Weierstrass-Modell ermöglicht. Naskręcki brauchte dank Codex und GPT-5.5 keine Zusatz-Tools für seine erwünschten Visualisierungen.

Dies sind nur zwei Beispiele für den Einsatz von GPT-5.5, der Usern in diversen Kontexten Zeit sparen und die Arbeit optimieren kann. Der Einsatz bei ChatGPT dürfte fortan ebenfalls zeigen, dass die Ergebnisse sukzessive besser werden mögen.

GPT‑5.5 wurde mit NVIDIAs GB200- und GB300 NVL72-Systemen trainiert und zum Teil dafür designt. NVIDIA ist einer der Konzerne, die Milliardensummen in OpenAI investiert haben. Der Tech-Konzern stellte 2025 100 Milliarden US-Dollar und zehn Gigawatt Energieleistung für das KI-Unternehmen in Aussicht. Neben Investitionen in neue Kernmodelle wie GPT-5.5 gibt es zusätzliche Entwicklungen wie jüngst das KI-Bildmodell ChatGPT Images 2.0.

Die detailliertesten KI-Bilder aller Zeiten?

Das ist ChatGPT Images 2.0

Online Marketing & SEO

Neue Instagram App Instants: Bei Snapchat und BeReal kopiert

Im Hilfebereich von Instagram gibt es jedoch eine offizielle Unterseite für die grundlegende Funktion, noch nicht für die neue App. Daraus geht aber hervor, wie Instants funktioniert:

Ein Sofortbild verschwindet, nachdem es von jemandem geöffnet wurde. Sobald es verschwunden ist, kann es von diesem Konto nicht mehr angesehen werden. Hinweis: Andere können deine Sofortbilder nur innerhalb von 24 Stunden nach dem Teilen öffnen und ansehen. Wenn du dir Fotos ansiehst, die mit Instants geteilt wurden, kannst du darauf reagieren oder antworten. Wenn du auf ein Foto reagierst, erhält die Person, die das Foto geteilt hat, eine Benachrichtigung. Wenn du mit einem Text auf ein Foto antwortest, wird dieser als Nachricht zwischen dir und dieser Person gesendet […].

Wer die Bilder anschaut, ist nicht nachvollziehbar. Instagram rät dazu, diese nur mit bekannten Usern zu teilen. Ohnehin funktioniert das nur mit Freund:innen, also Followern, denen man auch zurückfolgt

In der Standalone App können sich User mit ihrem Instagram Account anmelden, was die Nutzungshürde abbauen soll, ähnlich wie bei Threads. Dort geteilte Bilder lassen sich ebenso direkt in der Instagram App anschauen. Instagram weist in den Insights zum Plattform-Feature darauf hin, dass die Bilder den Meta-Gemeinschaftsstandards entsprechen müssen und dass die Instants, zumindest auf Instagram selbst, als Basis für Empfehlungen und personalisierte Ads genutzt werden können.

Hält sich diese Kopie-App?

Standalone Apps als Ableger von großen Social-Media-Plattformen sind nicht immer mit Erfolgsgeschichten verknüpft. Das zeigt vor allem das Beispiel der Kopien der innovativen Social Media App BeReal. Die französische App liefert Usern einmal am Tag an einem zufälligen Zeitpunkt einen Hinweis, dann haben sie zwei Minuten Zeit, um ein Foto aus ihrem Alltag mit der Vorder- und Rückkamera ihres Geräts aufzunehmen und für ihre Kontakte zu teilen. Auch das spätere Teilen ist möglich. Auf diese Weise können User mit Freund:innen, Kolleg:innen und Familienmitgliedern in Kontakt bleiben, ohne Feeds und umfassende Social-Media-Interaktionen. Zwar hat sich die App-Erfahrung nach dem Verkauf an Voodoo und der Einführung von Ads verändert, doch es gibt noch immer rund 40 Millionen aktive User. Die innovative Funktionsweise der App kopierte Instagram mit Funktionen wie Glimpse in der Story oder Spontaneous Stories und dem „Dual“-Kameramodus direkt in der App.

Instagram launcht neue Features à la BeReal

Aber auch TikTok setzte auf eine BeReal-Kopie, mit TikTok Now gab es sogar eine Standalone App dafür. Die wurde aber nach wenigen Monaten wieder eingestellt. Weder setzte sich diese App durch noch nutzten besonders viele User Instagrams BeReal-Kopien, weshalb die Funktionen zum Teil wieder entfernt wurden.

Mit Instants erinnert Instagram indes an Snapchat und BeReal. Den sehr persönlichen Austausch von Visuals möchte die Plattform damit in einer eigenen App aufgreifen. Ob die User diese App aber vielfach nutzen, ist fraglich. Womöglich setzen sie weiterhin auf Snaps und BeReal-Fotos, wenn sie diese Funktionsweisen schätzen. Wer die Apps allerdings nicht nutzt und auf Instagram aktiv ist, könnte durch den einfachen Login zum Test verleitet sein. Auch wenn nur ein Bruchteil der über drei Milliarden monatlich aktiven Instagram User Instants installiert, kann die App zum Erfolg werden. Wer weiß, vielleicht nutzt Meta diese in diesem hypothetischen Fall nicht zuletzt, um Ads zu integrieren, wie bei BeReal. Dort sind Anzeigen laut Nielsen besonders im Bereich Ad Recall, Kaufabsicht und Markenbefürwortung sehr effektiv. Das dürfte dem Advertising Powerhouse Meta nicht entgangen sein.

„Feel-Good-Space“ trifft Performance:

In dieser Werbemetrik schlägt BeReal Instagram und TikTok

Online Marketing & SEO

All-in-One App: Claude verbindet Spotify, Booking und Co.

Der KI-Assistant erkennt darüber hinaus im Gespräch, was die User planen, und schlägt ihnen passende Apps kontextbasiert vor. Die neuen App-Integrationen sind ab sofort im Web, auf dem Desktop und via Mobile (Beta) verfügbar. Welche Möglichkeiten sich daraus für Reisen, Shopping, Restaurantbuchungen oder Musik ergeben, kannst du im Connector-Verzeichnis einsehen.

Von Spotify bis Booking: Diese Alltags-To-dos übernimmt jetzt Claude für dich

Seit dem Start der Connectoren im Juli 2025 hat Anthropic das Verzeichnis auf über 200 Integrationen ausgebaut – darunter Apps aus Design, Finanzen, Produktivität und Gesundheit. Jetzt kommen Apps aus dem Freizeit- und Alltagskontext hinzu. Suchst du ein Restaurant, schlägt dir Claude direkt Optionen über Resy vor. Planst du eine Reise, bekommst du passende Angebote von Booking.com oder TripAdvisor. Für Musik greift die KI auf Spotify zu. Neu hinzugekommen sind außerdem die Apps AllTrails, Audible, Instacart, Intuit Credit Karma, Intuit TurboTax, StubHub, Taskrabbit, Thumbtack, Uber, Uber Eats und Viator. Weitere sollen folgen.

Du kannst mehrere Apps parallel nutzen und entscheidest jederzeit selbst, welche Aktionen tatsächlich ausgeführt werden. Buchungen oder Käufe erfolgen nicht automatisch, sondern müssen bestätigt werden. Gleichzeitig bleibt Claude werbefrei, Empfehlungen basieren nicht auf bezahlten Platzierungen. Beim Thema Datenschutz hält Claude die wichtigen Leitplanken ein: Sobald du eine App verknüpfst, greift der KI-Dienst in deinem Namen darauf zu. Die Daten werden jedoch nicht für das Training verwendet und bleiben von anderen Konversationen isoliert. Du kannst die Verbindung jederzeit aufheben.

Die Erweiterung zahlt auch auf die Entwicklung von KI-Interfaces hin zu zentralen Steuerungsebenen für digitale Services und Anwendungen ein. Die klassische App-Nutzung tritt dabei zunehmend in den Hintergrund. Statt einzelne Apps aktiv zu öffnen, formulieren User ihre Anliegen direkt im Chat, während KI-Tools wie Claude die Planung, Auswahl und Ausführung kontextbasiert übernehmen.

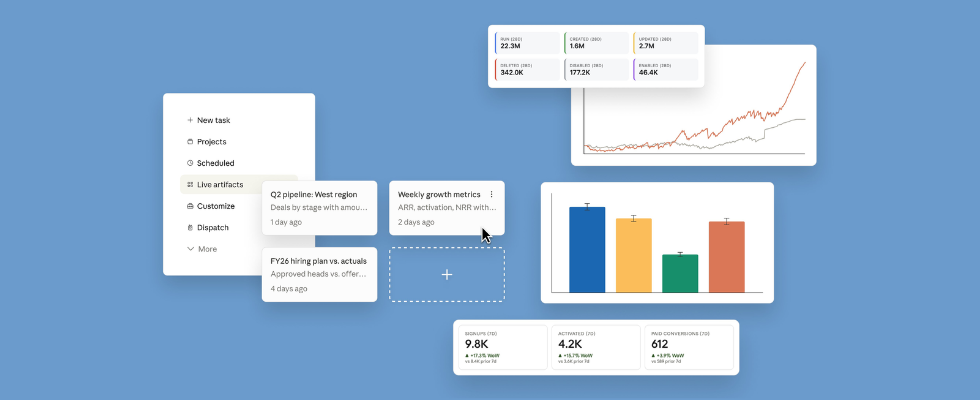

Baue dir jetzt eigene Live Dashboards für Apps mit Claude Cowork

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview