Online Marketing & SEO

Edits bringt Freeze Frame und Voiceover Teleprompter

Mit drei neuen Features kannst du aufmerksamkeitsstarke Reels erstellen und zeitgemäß Storytelling betreiben – sogar mit personalisierten Sound-Effektvorschlägen.

Metas Videobearbeitungs-App Edits entwickelt sich zu einer zentralen Option zur Content-Kreation. Erst vor rund einem Jahr gestartet, ist Edits als CapCut-Alternative gerade für den Meta-Kosmos und die Reels äußerst relevant geworden. Das liegt vor allem an den stetigen Feature Updates. Kürzlich hat Edits beispielsweise automatische Highlights für Captions eingeführt und auch eine Funktion, um Reels bis zu 100 Mal schneller zu machen. Jetzt gibt es schon wieder ein Update, das der offizielle Creators Account von Instagram vorstellt. Damit erhalten Creator unter anderem Sound-Vorschläge passend zu ihren Inhalten und ein aus dem Fernsehen bekanntes Feature, das viel Zeit sparen kann.

Automatische Highlights für Reels Captions, mehr Effekte und neuer Ideas Tab für Edits

Diese 3 Edits Features sind neu: Besseres Storytelling und passende Sounds

Eine der neuen Optionen von Edits ist erstmal nur für iOS User verfügbar. Dabei handelt es sich um die Funktion „Sound Effects for you“. Diese bietet einen eigenen Tab für personalisierte Vorschläge, genannt „For you“, die zum Content des Creators passen. Im Beispielvideo läuft eine Person zur S-Bahn, Edits schlägt dann einen Sound namens „Running“ vor, aber auch „Wind Blowing“, „Bus Horn“ und „Sneaking“. Die Audios kommen aus der Meta-Bibliothek und können für die akustische Untermalung von Reels eingesetzt werden.

Visuell wiederum unterstützt Edits Creator jetzt mit dem Feature Freeze Frame. Damit können, wie der Name schon sagt, einzelne Frames quasi eingefroren werden, um spezielle Momente im Video hervorzuheben. Ebenso ist es möglich, auf besondere Transitions hinzuweisen, die zum Storytelling gehören. Zum Beispiel könnten Creator einen Freeze Frame an einer konkreten Stelle im Reel-Verlauf zu ihrem Erkennungsmerkmal machen oder die Option einsetzen, um einen Spannungsbogen aufzubauen.

Das so optimierte Storytelling kann darüber hinaus jetzt noch besser per Voiceover gestützt werden. Denn Edits liefert einen Voiceover Teleprompter. Damit können Creator ihre Skripte direkt in der Bearbeitungs-App integrieren und sie beim Aufnehmen als Textvorlage auf dem Screen laufen lassen. So können sie Content aufnehmen, das Voiceover einsprechen und mit wenigen Takes das Reel fertigstellen. Das kann Zeit und Nerven sparen.

Noch mehr Insights dazu, wie Creator hochwertige Reels erstellen, die auf Instagram, aber ebenso auf Facebook und Threads, gut performen können, liefert Meta in einer Dos and Don’ts-Übersicht, die wir für dich mit expliziten Tipps aufbereitet haben.

Don’t do it perfect:

Instagrams neue Dos und Don’ts für Reels

Online Marketing & SEO

GPT-5.5 noch intelligenter: Arbeit von Monaten in Minuten

OpenAIs GPT-5.5 ist größer und schlauer als GPT-5.4, aber genauso schnell und vor allem beim Computer Use und Coding effektiv. User sparen damit Monate an Arbeitszeit und OpenAI verspricht noch mehr Intelligenz.

Die KI-Modellentwicklung war nie schneller. Nur rund einen Monat nach dem Launch von GPT-5.4 für ChatGPT legt OpenAI mit dem Modell GPT-5.5 nach. Das neue Modell soll eine neue „Intelligenzklasse“ bilden, die für die Erledigung von Arbeitsaufträgen prädestiniert ist, vor allem im Computer Use und beim Coding. Erste Beispiele zeigen bereits, wie das Modell unterstützt und dabei hilft, enorm viel Zeit zu sparen. Dabei soll GPT-5.5 in Sachen Tempo trotz der Optimierungen nicht zurückfallen und sogar einen geringeren Token-Einsatz ermöglichen. Codex User können sich indes über den Browser Support freuen.

GPT-5.4 ist da:

ChatGPT zeigt den Denkweg und bedient Software

Was GPT-5.5 ausmacht: Eine neue, intelligente Art, um Arbeit auf dem Computer zu erledigen

OpenAIs brandneues Modell GPT-5.5 wird in ChatGPT und Codex eingeführt. Dort können dann zunächst Pro, Plus, Business und Enterprise User zugreifen, der Roll-out für die Version GPT-5.5 Pro erfolgt nur in ChatGPT für Pro-, Business- und Enterprise-Abonnent:innen. Mit dem neuen Modell verspricht OpenAI eine „neue Intelligenzklasse“. Bei ChatGPT sorgt zum Beispiel GPT-5.5 Thinking für konzise Antworten und schnelle, präzise Hilfestellung. Insgesamt soll das Modell schneller verstehen, was du tun möchtest und diese Ideen und Intentionen im Arbeitskontext in Prozesse umwandeln, die eigenständig ausgeführt werden. Das Modell performt bei diversen Benchmarks wie Terminal-Bench 2.0 oder GDPval (wins or ties) besser als das vorangegangene GPT-5.4 oder das neue Claude Opus 4.7. Im Blog Post kannst du im Detail nachvollziehen, welche Performance-Vorteile GPT-5.5 zu bieten hat. Im Vordergrund steht laut OpenAI jedoch die Tasache, dass dieses Modell trotz optimierter Intelligenz und Größe dem Modell GPT-5.4 bei der Per-Token-Latenz im Real World Serving in nichts nachsteht. Denn oft sind neuere und größere Modelle langsamer, was ihre Nutzung beeinträchtigen kann. Dieses Problem soll GPT-5.5 nicht haben. OpenAI betont zudem, dass für den Einsatz via Codex weniger Token als bei GPT-5.4 eingesetzt werden müssten, um die Effizienz zu steigern:

[…]. GPT‑5.5 delivers this step up in intelligence without compromising on speed: larger, more capable models are often slower to serve, but GPT‑5.5 matches GPT‑5.4 per-token latency in real-world serving, while performing at a much higher level of intelligence. It also uses significantly fewer tokens to complete the same Codex tasks, making it more efficient as well as more capable.

GPT-5.5 delivers this step up in intelligence without compromising on speed.

GPT-5.5 matches GPT-5.4 per-token latency in real-world serving, while performing better across nearly every evaluation we measured.

It also uses significantly fewer tokens to complete the same Codex… pic.twitter.com/5mR46SM7mW

— OpenAI (@OpenAI) April 23, 2026

Der Start von GPT-5.5 kommt auch mit dem Support für den Browser Use bei Codex daher. So kann das Modell auf Web Apps zugreifen, Seiten besuchen und zum Beispiel Screenshots machen, während es arbeitet. Außerdem werden bessere Präsentationen via Google Drive und Microsoft Office ermöglicht.

With GPT-5.5, Codex now gets more of the job done across the browser, files, docs, and your computer.

We’ve expanded browser use so Codex can interact with web apps, and test flows, click through pages, capture screenshots, and iterate on what it sees until it completes the… pic.twitter.com/rUguNHIcIB

— OpenAI Developers (@OpenAIDevs) April 23, 2026

Einer der größten Vorteile des GPT-5.5-Modells soll überdies der optimierte Computer Use Mode sein. Dabei nutzt das Modell Inhalte auf dem Computer, um toolübergreifend und mit Zugriff auf Apps und Dateien Arbeit erledigen zu können. OpenAI schreibt:

[…] When combined with Codex’s computer use skills, GPT‑5.5 brings us closer to the feeling that the model can actually use the computer with you: seeing what’s on screen, clicking, typing, navigating interfaces, and moving across tools with precision.

Weiterentwicklung von GPTs:

OpenAI führt Workspace Agents in ChatGPT ein

So viel Arbeit nimmt das Modell Usern schon ab

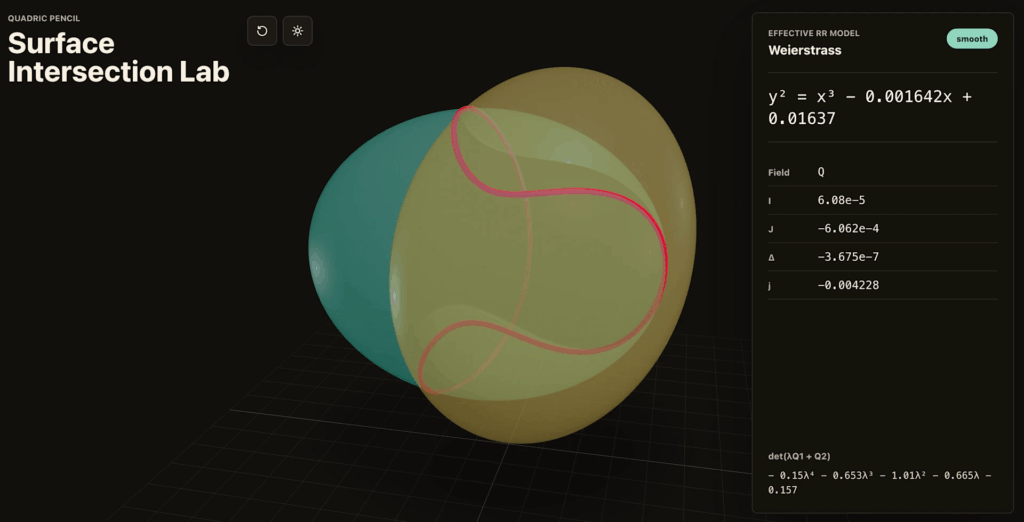

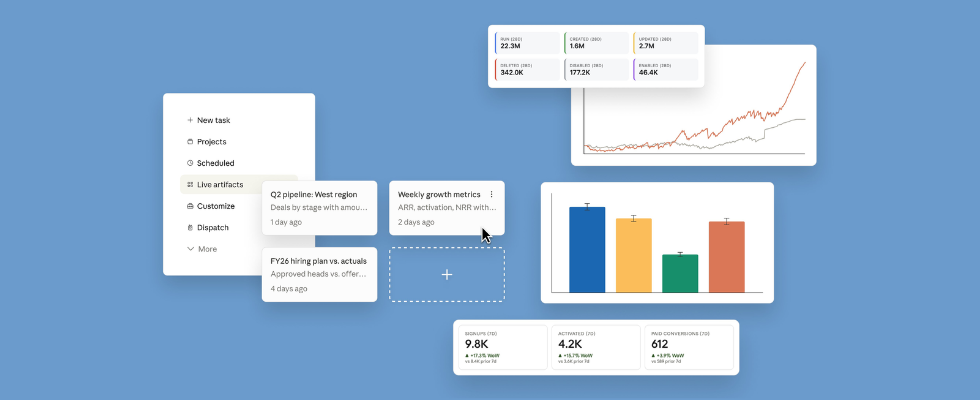

Im ausführlichen Blog Post zum neuen Modell liefert OpenAI eine Reihe von Beispielen, die zeigen, wie viel effizienter einige User mit GPT-5.5 arbeiten können. Die Immunologieprofessorin Derya Unutmaz vom Jackson Laboratory for Genomic Medicine hat beispielsweise mit GPT‑5.5 Pro ein Datenset zur Genexpression mit 62 Samples und rund 28.000 Genen analysieren lassen. Dabei wurden detaillierte Berichte zur Analyse produziert, samt Zusammenfassung der Erkenntnisse und Kernfragen, die offen bleiben. Laut Unutmaz hätte die Arbeit ohne ein solches Modell Monate dauern können, war so aber in kurzer Zeit erledigt. Bartosz Naskręcki wiederum, Assistenzprofessor für Mathematik an der Adam Mickiewicz Universität in Poznań, hat GPT‑5.5 in Codex genutzt, um in nur elf Minuten mit einem einzigen Prompt eine algebraische Geometrie-App zu erstellen, die eine Visualisierung des Schnittpunkts quadratischer Flächen und Umwandlung der resultierenden Kurve in ein Weierstrass-Modell ermöglicht. Naskręcki brauchte dank Codex und GPT-5.5 keine Zusatz-Tools für seine erwünschten Visualisierungen.

Dies sind nur zwei Beispiele für den Einsatz von GPT-5.5, der Usern in diversen Kontexten Zeit sparen und die Arbeit optimieren kann. Der Einsatz bei ChatGPT dürfte fortan ebenfalls zeigen, dass die Ergebnisse sukzessive besser werden mögen.

GPT‑5.5 wurde mit NVIDIAs GB200- und GB300 NVL72-Systemen trainiert und zum Teil dafür designt. NVIDIA ist einer der Konzerne, die Milliardensummen in OpenAI investiert haben. Der Tech-Konzern stellte 2025 100 Milliarden US-Dollar und zehn Gigawatt Energieleistung für das KI-Unternehmen in Aussicht. Neben Investitionen in neue Kernmodelle wie GPT-5.5 gibt es zusätzliche Entwicklungen wie jüngst das KI-Bildmodell ChatGPT Images 2.0.

Die detailliertesten KI-Bilder aller Zeiten?

Das ist ChatGPT Images 2.0

Online Marketing & SEO

Neue Instagram App Instants: Bei Snapchat und BeReal kopiert

Im Hilfebereich von Instagram gibt es jedoch eine offizielle Unterseite für die grundlegende Funktion, noch nicht für die neue App. Daraus geht aber hervor, wie Instants funktioniert:

Ein Sofortbild verschwindet, nachdem es von jemandem geöffnet wurde. Sobald es verschwunden ist, kann es von diesem Konto nicht mehr angesehen werden. Hinweis: Andere können deine Sofortbilder nur innerhalb von 24 Stunden nach dem Teilen öffnen und ansehen. Wenn du dir Fotos ansiehst, die mit Instants geteilt wurden, kannst du darauf reagieren oder antworten. Wenn du auf ein Foto reagierst, erhält die Person, die das Foto geteilt hat, eine Benachrichtigung. Wenn du mit einem Text auf ein Foto antwortest, wird dieser als Nachricht zwischen dir und dieser Person gesendet […].

Wer die Bilder anschaut, ist nicht nachvollziehbar. Instagram rät dazu, diese nur mit bekannten Usern zu teilen. Ohnehin funktioniert das nur mit Freund:innen, also Followern, denen man auch zurückfolgt

In der Standalone App können sich User mit ihrem Instagram Account anmelden, was die Nutzungshürde abbauen soll, ähnlich wie bei Threads. Dort geteilte Bilder lassen sich ebenso direkt in der Instagram App anschauen. Instagram weist in den Insights zum Plattform-Feature darauf hin, dass die Bilder den Meta-Gemeinschaftsstandards entsprechen müssen und dass die Instants, zumindest auf Instagram selbst, als Basis für Empfehlungen und personalisierte Ads genutzt werden können.

Hält sich diese Kopie-App?

Standalone Apps als Ableger von großen Social-Media-Plattformen sind nicht immer mit Erfolgsgeschichten verknüpft. Das zeigt vor allem das Beispiel der Kopien der innovativen Social Media App BeReal. Die französische App liefert Usern einmal am Tag an einem zufälligen Zeitpunkt einen Hinweis, dann haben sie zwei Minuten Zeit, um ein Foto aus ihrem Alltag mit der Vorder- und Rückkamera ihres Geräts aufzunehmen und für ihre Kontakte zu teilen. Auch das spätere Teilen ist möglich. Auf diese Weise können User mit Freund:innen, Kolleg:innen und Familienmitgliedern in Kontakt bleiben, ohne Feeds und umfassende Social-Media-Interaktionen. Zwar hat sich die App-Erfahrung nach dem Verkauf an Voodoo und der Einführung von Ads verändert, doch es gibt noch immer rund 40 Millionen aktive User. Die innovative Funktionsweise der App kopierte Instagram mit Funktionen wie Glimpse in der Story oder Spontaneous Stories und dem „Dual“-Kameramodus direkt in der App.

Instagram launcht neue Features à la BeReal

Aber auch TikTok setzte auf eine BeReal-Kopie, mit TikTok Now gab es sogar eine Standalone App dafür. Die wurde aber nach wenigen Monaten wieder eingestellt. Weder setzte sich diese App durch noch nutzten besonders viele User Instagrams BeReal-Kopien, weshalb die Funktionen zum Teil wieder entfernt wurden.

Mit Instants erinnert Instagram indes an Snapchat und BeReal. Den sehr persönlichen Austausch von Visuals möchte die Plattform damit in einer eigenen App aufgreifen. Ob die User diese App aber vielfach nutzen, ist fraglich. Womöglich setzen sie weiterhin auf Snaps und BeReal-Fotos, wenn sie diese Funktionsweisen schätzen. Wer die Apps allerdings nicht nutzt und auf Instagram aktiv ist, könnte durch den einfachen Login zum Test verleitet sein. Auch wenn nur ein Bruchteil der über drei Milliarden monatlich aktiven Instagram User Instants installiert, kann die App zum Erfolg werden. Wer weiß, vielleicht nutzt Meta diese in diesem hypothetischen Fall nicht zuletzt, um Ads zu integrieren, wie bei BeReal. Dort sind Anzeigen laut Nielsen besonders im Bereich Ad Recall, Kaufabsicht und Markenbefürwortung sehr effektiv. Das dürfte dem Advertising Powerhouse Meta nicht entgangen sein.

„Feel-Good-Space“ trifft Performance:

In dieser Werbemetrik schlägt BeReal Instagram und TikTok

Online Marketing & SEO

All-in-One App: Claude verbindet Spotify, Booking und Co.

Der KI-Assistant erkennt darüber hinaus im Gespräch, was die User planen, und schlägt ihnen passende Apps kontextbasiert vor. Die neuen App-Integrationen sind ab sofort im Web, auf dem Desktop und via Mobile (Beta) verfügbar. Welche Möglichkeiten sich daraus für Reisen, Shopping, Restaurantbuchungen oder Musik ergeben, kannst du im Connector-Verzeichnis einsehen.

Von Spotify bis Booking: Diese Alltags-To-dos übernimmt jetzt Claude für dich

Seit dem Start der Connectoren im Juli 2025 hat Anthropic das Verzeichnis auf über 200 Integrationen ausgebaut – darunter Apps aus Design, Finanzen, Produktivität und Gesundheit. Jetzt kommen Apps aus dem Freizeit- und Alltagskontext hinzu. Suchst du ein Restaurant, schlägt dir Claude direkt Optionen über Resy vor. Planst du eine Reise, bekommst du passende Angebote von Booking.com oder TripAdvisor. Für Musik greift die KI auf Spotify zu. Neu hinzugekommen sind außerdem die Apps AllTrails, Audible, Instacart, Intuit Credit Karma, Intuit TurboTax, StubHub, Taskrabbit, Thumbtack, Uber, Uber Eats und Viator. Weitere sollen folgen.

Du kannst mehrere Apps parallel nutzen und entscheidest jederzeit selbst, welche Aktionen tatsächlich ausgeführt werden. Buchungen oder Käufe erfolgen nicht automatisch, sondern müssen bestätigt werden. Gleichzeitig bleibt Claude werbefrei, Empfehlungen basieren nicht auf bezahlten Platzierungen. Beim Thema Datenschutz hält Claude die wichtigen Leitplanken ein: Sobald du eine App verknüpfst, greift der KI-Dienst in deinem Namen darauf zu. Die Daten werden jedoch nicht für das Training verwendet und bleiben von anderen Konversationen isoliert. Du kannst die Verbindung jederzeit aufheben.

Die Erweiterung zahlt auch auf die Entwicklung von KI-Interfaces hin zu zentralen Steuerungsebenen für digitale Services und Anwendungen ein. Die klassische App-Nutzung tritt dabei zunehmend in den Hintergrund. Statt einzelne Apps aktiv zu öffnen, formulieren User ihre Anliegen direkt im Chat, während KI-Tools wie Claude die Planung, Auswahl und Ausführung kontextbasiert übernehmen.

Baue dir jetzt eigene Live Dashboards für Apps mit Claude Cowork

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview