Apps & Mobile Entwicklung

Intel Arc B390 vs. Nvidia GeForce RTX 5060 Laptop GPU im Test

Was den zahlreichen Tests zur Leistung der Panther-Lake-iGPU, Intel Arc B390, bisher noch fehlte, war der Vergleich mit einer kleinen mobilen Nvidia GeForce RTX 5000 Laptop GPU. Hier ist er: Intel Arc B390 vs. Nvidia GeForce RTX 5060 Laptop GPU im Test.

Arc B390 vs. RTX 5060 Laptop GPU

Die Nvidia GeForce RTX 5060 Laptop GPU ist nicht die kleine mobile aktuelle Blackwell-GeForce von Nvidia, denn mit etwas Zeitversatz hatte Nvidia im Frühjahr 2025 auch noch eine GeForce RTX 5050 Laptop GPU in den Markt entlassen. Ein solches Muster liegt der Redaktion aktuell allerdings nicht vor.

Die GeForce RTX 5060 Laptop GPU bietet 30 Prozent mehr Shader, beim Speicher (8 GB GDDR7) und Speicherinterface (128 Bit) liegen beide gleich auf. Das gilt beinahe auch für die von Nvidia freigegebene TDP-Bandbreite, die bei der RTX 5050 Laptop GPU allerdings noch einmal 10 Watt niedriger ausfallen darf.

Testergebnisse

Die getestete Nvidia GeForce RTX 5060 Laptop GPU ist neben einem Core Ultra 9 386H im neuen Lenovo Yoga Pro 7i Gen 11 (Lenovo Store) verbaut.

Taktraten und TDP

Im höchsten Leistungsprofil stehen ihr laut Sensor-Daten durchschnittlich 79 Watt in den Benchmarks zu. Damit liegt sie ziemlich genau in der Mitte der von Nvidia definierten TDP-Bandbreite für die RTX 5060 Laptop GPU, die von 45 bis 125 Watt reicht (inklusive bis zu 25 Watt über Dynamic Boost 2.0, die vom Power-Budget der CPU kommen, wenn sie die Leistung nicht benötigt). Der durchschnittliche Takt liegt interessanterweise auf dem Niveau der aktuellen iGPUs von Intel.

Gaming-Benchmarks

Getestet wurde die GeForce RTX 5060 Laptop GPU im zuletzt schon für iGPUs genutzten Parcours. Nutzer dürften in der Praxis zwar etwas anspruchsvollere Settings fahren, als sie im Test zum Einsatz kamen, für einen Vergleich der beiden Plattformen bieten sie sich aber auch auf der GeForce noch an.

Im Durchschnitt kann sich die GeForce RTX 5060 Laptop GPU bei circa 80 Watt TDP um gut 61 Prozent von der schnellsten bisher getesteten Intel Arc B390 GPU (hohe TDP, kombiniert mit LPDDR5X-9600) absetzen. Die GeForce RTX 5050 für Desktop-PCs liegt noch einmal sieben Prozent voraus vor der RTX 5060 Laptop GPU. Im Vergleich zur kleinen Panther-Lake-iGPU „Intel Graphics“ ist der Leistungszuwachs durch den Einsatz der GeForce mit Faktor 3,7 enorm – die im Lenovo Yoga Pro 7i Gen 11 gewählte Kombination ergibt damit durchaus Sinn.

Nachfolgend sind die für den Test genutzten Einstellungen sowie die Einzelergebnisse aufgeführt:

Fazit

Nein, eine Nvidia GeForce RTX 5060 Laptop GPU mit nur circa 80 Watt TGP statt maximal erlaubten 115 + 25 Watt (Standard TDP + Dynamic Boost 2.0) ist für Intels Arc B390 in schnellster Ausführung nicht erreichbar. Etwas über 60 Prozent mehr FPS liefert die zweitkleinste mobile Blackwell-dGPU im Vergleich und fährt zugleich auch das umfassendere Featureset auf (CUDA, DLSS 4.5 etc.). Dafür genehmigt sich das Gesamtsystem aber auch deutlich mehr Leistung (47 Watt für Core Ultra 300 mit Arc B390 versus 79 Watt allein für die GeForce).

Auch eine noch weiter in der TDP gedrosselte RTX 5060 Laptop GPU wird einen deutlichen Vorsprung behalten, bei einer GeForce RTX 5050 Laptop GPU dürfte das nicht mehr der Fall sein. ComputerBase kann aktuell jedoch noch keine eigenen Benchmarks vorweisen, die das belegen.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.

Apps & Mobile Entwicklung

Low-Latency-DOCSIS: Vodafone will die Latenz im Kabel-Internet senken

Vodafone schaltet eine neue Technologie für geringere Reaktionszeiten im Kabel-Internet frei: den „Latenz-Booster“. Laut Vodafone soll die Technik die Reaktionszeiten unter Last etwa bei Videokonferenzen oder Online-Spielen deutlich reduzieren. Besonders in Stoßzeiten mit hoher Netzauslastung sollen Nutzer davon profitieren.

Halbierte Latenz bei hoher Netzauslastung

Das Unternehmen spricht von einer Reduzierung der Latenz bei zeitkritischen Anwendungen um mehr als die Hälfte. Internet-Nutzer sollen von der neuen Technik vor allem in Stoßzeiten profitieren, wenn die Netzauslastung hoch ist. Vodafone bereitet aktuell den „Latenz-Booster“ in ersten Netzsegmenten vor. Bis Oktober möchte das Unternehmen die Technologie in rund 45 Prozent des Kabelnetzes freischalten – und damit für rund 12 Millionen Haushalte. Im Oktober sollen dann auch die passenden Firmware-Updates für erste Kabel-Router veröffentlicht werden, damit die Technik auch von den Endgeräten unterstützt wird.

In 2 Jahren sollen alle Anschlüsse umgestellt sein

Die Freischaltung an immer mehr Stellen im Netz soll schrittweise erfolgen. In rund zwei Jahren sollen netzseitig alle 24 Millionen Haushalte mit Kabel-Internet von der neuen Technologie Gebrauch machen können.

Low-Latency DOCSIS priorisiert Echtzeit-Anwendungen

Technisch steckt hinter dem Latenz-Booster der Übertragungsstandard Low-Latency DOCSIS, bei dem speziell gekennzeichnete Datenströme im Netz bevorzugt transportiert werden. Ihre Datenpakete werden nicht mehr aufgehalten, wenn im Hintergrund große Datenmengen wie Downloads oder Updates laufen. Die Daten werden folglich anders sortiert und wichtige Informationen kürzer gepuffert und schneller durch das Netz geleitet.

Test in Stuttgart bestätigt schnellere Reaktionszeiten in Stoßzeiten

Im vergangenen Jahr hat Vodafone die Technologie erstmals im Netz von Stuttgart getestet. Hier wurde sie in einem ausgewählten Netzsegment mit rund 100 Hausanschlüssen und über mehrere Monate aktiviert. Zum Einsatz kam dafür der neueste Kabel-Router Ultra Hub 7. Tausende Messungen aus dem Testgebiet belegen laut Vodafone, dass zu Stoßzeiten, in denen besonders viele Daten transportiert werden, die Reaktionszeiten bei ausgewählten Latenz-kritischen Anwendungen um mehr als 50 Prozent im Vergleich zu vorher reduziert werden konnten.

Apps & Mobile Entwicklung

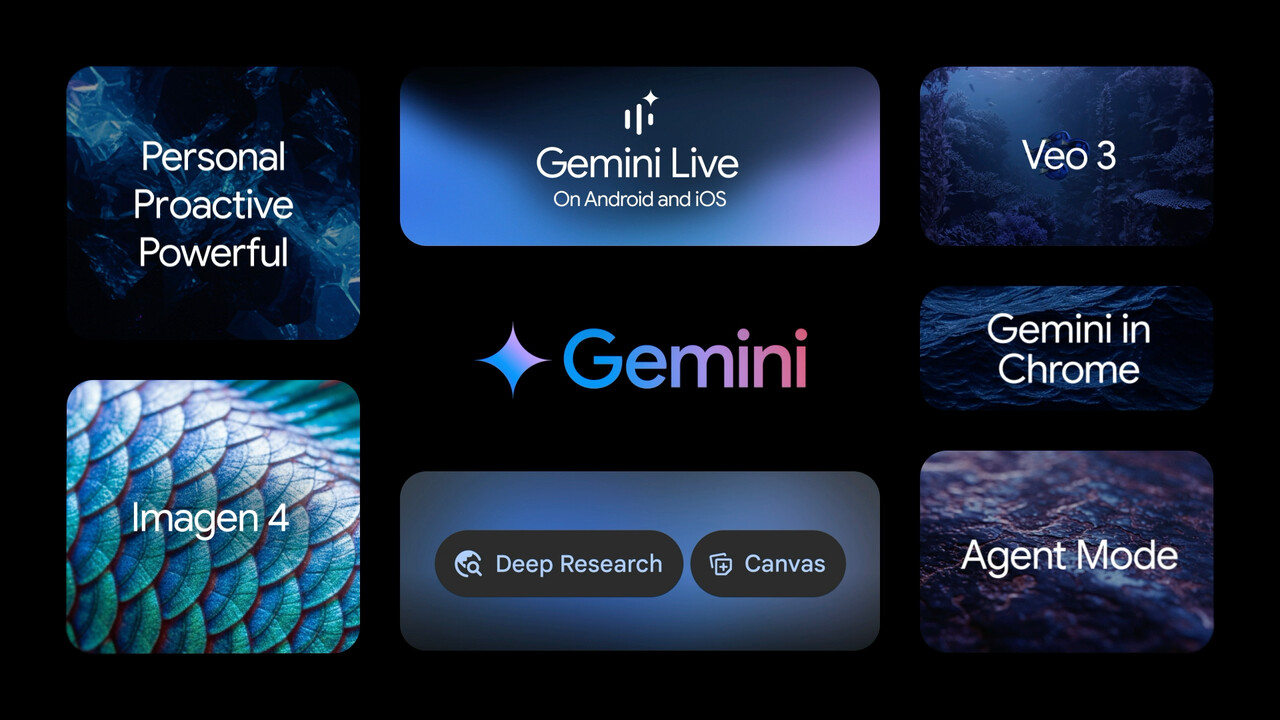

„Rechenbasierte Nutzung“: Google berechnet Limits bei Gemini künftig neu

Bereits Ende April kamen Gerüchte auf, dass Google die Nutzungslimits für Gemini überarbeiten und dabei auch ein Punktesystem einführen könnte. Nun hat das Unternehmen Änderungen angekündigt, deren Grundlage künftig auf den tatsächlichen Verbrauch und nicht mehr auf eine generelle Anzahl von Anfragen basieren wird.

Keine feste Zahl von Anfragen als Grundlage

Laut einem Support-Dokument will Google künftig auf eine „rechenbasierte Nutzung“ setzen und sich damit von der bisherigen festen Anzahl an Anfragen pro Tag verabschieden. In die neue Berechnung sollen unter anderem die Komplexität einer Anfrage, die verwendeten Funktionen oder Anwendungen sowie die Länge der jeweiligen Konversation einfließen. Gleichzeitig weist Google in diesem darauf hin, dass Nutzer mit kostenpflichtigem Abonnement höhere Limits erhalten sollen als Anwender des kostenlosen Tarifs.

Bislang orientierten sich die Nutzungslimits ausschließlich an der Anzahl der täglichen Anfragen, unabhängig davon, wie aufwendig diese tatsächlich waren. Laut Google soll die Berechnung des jeweiligen Verbrauchs künftig alle fünf Stunden erfolgen, die eigentliche Begrenzung werde jedoch über ein wöchentliches Limit geregelt. Das Unternehmen weist außerdem darauf hin, dass bestimmte Funktionen wie die Bild-, Video- oder Musikerstellung, Deep Research sowie Erweitertes Denken und Deep Think das jeweilige Limit deutlich schneller ausschöpfen können.

Google nennt nur Verhältnisse, keine genauen Zahlen

Konkrete Angaben, an denen sich Nutzer orientieren oder ihren Verbrauch nachvollziehen könnten, nennt Google in seiner Veröffentlichung allerdings nicht. Stattdessen erklärt das Unternehmen lediglich, dass Nutzer eines AI-Plus-Abonnements ein doppelt so hohes Nutzungslimit wie Anwender ohne kostenpflichtigen Tarif erhalten sollen. Beim Pro-Abonnement falle das Limit bereits viermal höher als im Standardtarif aus, der Ultra-Tarif wiederum soll ein bis zu 20-fach höheres Limit ermöglichen. Der Grund, dass Google bisher auf konkrete Zahlen verzichtet, könnte darin zu finden sein, dass sich Anpassungen auf diese Weise leichter vornehmen lassen, da dafür lediglich die Ausrichtung des kostenlosen Tarifs geändert werden müsste.

KI-Anbieter spüren immer höheren Kostendruck

Google ist allerdings nicht der erste Anbieter, der sich von einer Begrenzung über die reine Anzahl von Anfragen verabschiedet. Bereits Ende April hatte GitHub angekündigt, die Abrechnung seines KI-Tools Copilot ab dem 1. Juni dieses Jahres von einem klassischen Abo-Modell auf ein ebenfalls nutzungsbasiertes System umzustellen. Auch dort sollen die Kosten künftig stärker an die tatsächliche Nutzung angepasst werden.

Die immer weiter steigende Akzeptanz künstlicher Intelligenz entwickelt sich für viele Unternehmen zunehmend zum Problem. Einerseits lassen sich dadurch mehr Nutzer erreichen und zusätzliche Einnahmen generieren, andererseits wird gleichzeitig immer deutlicher sichtbar, wie stark defizitär viele Anbieter derzeit arbeiten, um neue Abonnenten zu gewinnen. Neben begrenzten Rechenkapazitäten spielen dabei auch die in zahlreichen Regionen deutlich gestiegenen Energiekosten eine wichtige Rolle.

Apps & Mobile Entwicklung

Gemini Omni und Gemini Flash 3.5: Googles neue Spitzenmodelle für Agenten und das Weltverständnis

Nachdem Anthropic und OpenAI zuletzt vorgelegt haben, hat Google auf der Entwicklerkonferenz I/O 2026 ebenfalls neue Spitzenmodelle präsentiert. Gemini 3.5 Flash ist das neue Alltagsmodell, das vor allem Agenten antreiben soll. Gemini Omni ist das neue Video-Modell, das Fähigkeiten von Veo und Nano Banana vereint.

Gemini 3.5 Flash: Effizienz und Geschwindigkeit im Fokus

Gemini 3.5 Flash ist der Auftakt für die nächste Generation, die besonders für agentische Aufgaben optimiert ist und besonders effizient laufen soll. In den von Google veröffentlichten Benchmarks kann sich Gemini 3.5 Flash deutlich von den Vorgängern wie Gemini 3.1 Pro absetzen. Es bewegt sich auf einem ähnlichen Niveau wie Anthropics Claude Opus 4.7 und OpenAIs GPT-5.5.

Was Google im Vergleich zu den anderen Modellen in den Vordergrund rückt, ist die Geschwindigkeit und die Effizienz. So ist 3.5 Flash nicht mehr ganz so schnell wie 3.1 Flash, produziert aber noch wesentlich mehr Token pro Sekunde als andere Top-Modelle.

Grundlage für Googles neue Agenten-Armada

Damit ist es laut Google besonders für agentische Aufgaben geeignet, die lange Zeitspannen in Anspruch nehmen. Davon soll auch Googles Coding-Assistent Antigravity profitieren. Bislang spielt dieser im Vergleich zu Claude Code und Codex nur eine untergeordnete Rolle.

Agenten werden bei Google künftig ohnehin eine größere Rolle spielen. In der Suche können Nutzer künftig Subagents aktivieren, um bestimmte Suchanfragen dauerhaft laufen zu lassen. Mit Spark stellte man zudem die Beta-Version eines neuen persönlichen Agenten vor, der autonom im Hintergrund Alltagsaufgaben erledigen soll.

Verfügbarkeit von Gemini 3.5 Flash

Verfügbar ist Gemini 3.5 Flash ab heute über die Gemini-App und den KI-Modus in der Suche. Über Googles Coding-Assistenten Antigravity und die Google Cloud ist es ebenfalls abrufbar.

Gemini Omini als multimodales Weltmodell

Mit Gemini Omni hat Google zudem ein neues Multimodal-Modell vorgestellt, das verschiedene Input-Arten verarbeiten kann, um Inhalte zu generieren. So ist es etwa möglich, bei der Prompt-Eingabe Bilder, Texte, Videos und Audio-Passagen zu kombinieren. Zunächst es auf die Video-Ausgabe beschränkt.

Laut Google-DeepMind-Chef Demis Hassabis ist vor allem das Weltwissen der nennenswerte Fortschritt bei Omni. Es kombiniert die Fähigkeiten von dem Gemini-Modell mit Veo und Nano Banana. Damit soll es in der Lage sein, etwa physikalische Zusammenhänge und Aspekte wie Gravitation, kinetische Energie und Strömungsverhalten deutlich besser zu imitieren. So können Nutzer am Ende deutlich realistischere Inhalte erstellen.

Gemini Omni ist ebenfalls als erstes in einer Flash-Version verfügbar. Ab heute können es Nutzer mit den Abo-Paketen Google AI Plus, Pro und Ultra weltweit nutzen. Das geht sowohl über die Gemini-App als auch über Google Flow.

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenMähroboter ohne Begrenzungsdraht für Gärten mit bis zu 300 m²

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateniPhone Fold Leak: Apple spart sich wohl iPad‑Multitasking

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview

-

Künstliche Intelligenzvor 2 Monaten

JBL Bar 1300MK2 im Test: Soundbar mit Dolby Atmos, starkem Bass und Akku‑Rears