Apps & Mobile Entwicklung

Rechenzentren in Deutschland: Ausgebremst durch Strommangel, Energiepreise und komplexe Regulierung

Mehr KI, mehr Rechenzentren – die Formel ist einfach. Obwohl der Ausbau sich in Deutschland beschleunigt, reicht es nicht, um die Nachfrage zu decken. Stromknappheit und hohe Preise sowie die komplexe und teils widersprüchliche Regulierung sind zentrale Hürden.

Die Probleme schildert Alexander Rabe, Geschäftsführer des Internetwirtschaftsverbands Eco, auf der Glasfasermesse Fiberdays 26, die der Breko derzeit in Frankfurt am Main veranstaltet. Rechenzentren sind einer der Themenschwerpunkte auf der Messe.

In Frankfurt wird es eng

Selbst wenn man in Europa nicht der Gigantomanie amerikanischer Big-Tech-Konzerne folgt, sind die Ausbaupläne ambitioniert. Allein die IT-Leistung der Colocation-Rechenzentren soll laut Angaben der German Datacenter Association (GDA) bis zum Jahr 2030 von 2,4 GW auf 4,6 GW steigen. Investitionen sollen dafür bei 49 Milliarden US-Dollar liegen.

Speziell in Frankfurt, dem größten Rechenzentrumsstandort in Europa, wird es aber allmählich eng. „Aktuell ist davon auszugehen, dass insbesondere große, leistungsstarke Neuanschlüsse erst ab Mitte der 2030er Jahre erneut bereitgestellt werden können“, erklärte der lokale Energieversorger Mainova laut einem Bericht der Frankfurter Rundschau vor rund einer Woche. Eine Entwicklung, die die Pläne der Branche ausbremst.

Die Nachfrage entwickelt sich dreimal schneller als das Angebot

„Wir haben eine massive Ausbaulücke“, sagt Eco-Geschäftsführer Rabe bei dem Vortrag auf den Fiberdays. Die Ausbaupläne bis 2030 reichen derzeit nicht aus, um Kapazitäten zu decken. Vor allem mit Blick auf die lokale IT-Wirtschaft beschreibt Rabe die Rechenzentren aber als zentrale Infrastruktur für den digitalen Wandel. „Ohne Rechenzentren gibt es keine Künstliche Intelligenz“ – zumindest keine, die von deutschen Anbietern betrieben wird. Sowohl amerikanische als auch chinesische Anbieter präsentieren sich gerne als Alternative, passen aber nur bedingt zu einer Strategie, die auf mehr digitale Souveränität setzen will.

Konkret nennt Rabe vier Punkte, an denen man in Deutschland und der EU ansetzen müsse:

- Regeln für Datenverarbeitung: Der regulatorische Rahmen müsse so gestaltet sein, dass Unternehmen KI-Anwendungen nutzen und entwickeln können.

- Physische Rechenzentren-Kapazitäten erhöhen

- Glasfaser-Anbindungen mit niedrigen Latenzen müssen ausgebaut werden.

- Mehr Energie wird benötigt und die Strompreise müssen sinken.

Energie „ist der Treiber unserer Branche“, so Rabe. Strom macht daher aber auch einen Großteil der Kosten aus. Laut den Zahlen der German Datacenter Association machen Stromkosten rund 50 Prozent der Betriebskosten bei Rechenzentren aus.

Nun ist in Deutschland der Strom nicht nur teuer, sondern auch Mangelware, wie die Einschätzung der Mainova zeigt. Laut Eco sei es daher wichtig, dass Rechenzentren ebenfalls eine Strompreisreduzierung erhalten. Zufrieden ist man daher mit der Rechenzentrum-Strategie, die die Bundesregierung am 18. März vorgestellt hat. Diese sieht unter anderem vor, dass die Betreiber bezahlbare und erneuerbare Energie erhalten. Erleichtert werden soll auch die Standortsuche.

Der Haken an solchen Strategien: Papier ist geduldig. Wie Rabe skizziert, nützt es nichts, das ideale Konzept in der Schublade zu haben. Entscheidend sei vielmehr, was regulatorisch umgesetzt werde. „Wir messen den Erfolg dieser Strategie nicht an Ankündigungen, sondern an dem, was in zwölf Monaten im Bundesgesetzblatt steht“, sagte auch der stellvertretende GDA-Vorsitzende Peter Pohlschröder bei der Vorstellung der Strategie.

Komplexe Regulierung erschwert Standortsuche

Für die Branche relevant sind daher die Reformen beim Energieeffizienzgesetz oder der Digital Network Act (DNA) auf EU-Ebene. Die Gesetze müssten laut Rabe so gestaltet sein, dass sich die Komplexität in der Praxis nicht erhöht.

Schon jetzt sind Vorgaben teilweise widersprüchlich. So müssen Rechenzentren mit erneuerbaren Energien betrieben werden – derzeit sind es 50 Prozent, ab 2027 muss die Ökostrom-Quote bei 100 Prozent liegen. Vorgaben gibt es auch bei der Nutzung der Abwärme. Rechenzentren, die ab dem 1. Juli 2026 ans Netz gehen, müssen 10 Prozent der Abwärme wiederverwenden. Im Juli 2027 steigt der Anteil auf 15 Prozent, 2028 dann auf 20 Prozent. Ebenso benötigen Rechenzentren noch ausreichend Flächen.

In einer Stadt wie Frankfurt am Main, die aufgrund des Internetknotens DE-CIX der größte Rechenzentrenstandort ist, sind jedoch sowohl Flächen als auch Strom äußerst begrenzt. Denkbar wäre also, auf Standorte wie Brandenburg auszuweichen, wo es ausreichend Energie gibt. Der Haken an solchen Orten ist aber: Man wird die Abwärme nicht los.

Konsequenz aus den Hürden ist, dass der Ausbau länger dauert. Rechenzentren benötigen in Deutschland im Schnitt zwischen sieben und zehn Jahren, bis sie in Betrieb gehen. In Großbritannien geht es schneller, dort hat der Ausbau aber auch öffentliches Interesse. An die 1 bis 3 Jahre, die es teils nur in den USA dauert, kommt man in Europa aber nicht heran.

Um die Akzeptanz vor Ort werben

Rechenzentren haben aber auch weitere Herausforderungen. Lokal sind entsprechende Ausbauvorhaben in vielen Fällen äußerst unbeliebt. Das kann laut Rabe dann dazu führen, dass Milliarden-Projekte an Stadtrat-Abstimmungen scheitern können. In der Stadt Maintal, zwölf Kilometer östlich von Frankfurt, wird derzeit um den Bau von zwei Rechenzentren gestritten. Weil der Betreiber Edgeconnex ein Gaskraftwerk für den Betrieb bauen will, steht das Vorhaben auf der Kippe, berichtet die Frankfurter Allgemeine Zeitung (FAZ). Edgeconnex erklärt zwar, Umweltbelastungen wären wesentlich geringer als befürchtet. Kritiker beruhigen kann man bislang aber nicht.

Wie Eco-Präsident Rabe auf den Fiberdays erklärt, müsse die Branche generell besser aufklären, was ein Rechenzentrum vor Ort bedeutet. Ängste, die etwa Umweltverschmutzung oder den Wasserverbrauch betreffen, müssten Betreiber direkt adressieren. Zusätzlich schlägt Rabe mehr finanzielle Anreize vor, um Kommunen zu überzeugen. Denkbar hält er etwa einen neuen Schlüssel bei der Verteilung der Gewerbesteuereinnahmen, sodass Kommunen mehr Geld erhalten, wenn Unternehmen sich in einem Ort ansiedeln.

Apps & Mobile Entwicklung

Windows Insider Program: Wie Microsoft den Datei-Explorer beschleunigen will

Bei der Rundumerneuerung von Windows 11 ist der Datei-Explorer eine der zentralen Baustellen. Upgrades gibt es in der aktuellen Windows-Insider-Build im Experimental-Kanal. Ob Preloading eine geeignete Methode ist, damit sich der Datei-Explorer im Alltag geschmeidiger anfühlt, bleibt aber strittig.

Das Preloading testet Microsoft bereits seit November 2025 im Windows Insider Program. Teile des Explorers werden also bereits im Hintergrund geladen, sodass dieser beim Öffnen eines Fensters schneller bereit ist. Die Konsequenz ist aber ein höherer RAM-Verbrauch. Laut einer Analyse von Windows Latest benötigt der Explorer-Task ohne Preloading 32,4 MB RAM und mit dem Preloading 67,4 MB RAM.

Rund 35 MB RAM sind angesichts der typischen RAM-Mengen in Systemen nicht viel. Dennoch steht die Frage im Raum, ob das Preloading-Konzept trotzdem sinnvoll ist.

Preloading überdeckt Probleme mit Altlasten

Dass der Datei-Explorer sich in Windows 11 langsamer anfühlt als in Windows 10, liegt an den modernen WinUI/XAML-Elementen, die auf der klassischen Win32-UI-Basis aufbauen, beschreibt Windows Latest. Während Windows 10 noch die klassische Win32 UI nutzt, verwendet Windows 11 zwar ebenfalls denselben Kern des Systems, ergänzt diesen aber um WinUI-Elemente. So sorgt die Integration des moderneren Benutzeroberflächen-Frameworks für zusätzliche Rendering-Ebenen, die den Datei-Explorer behäbiger wirken lassen.

Preloading hilft nun, den Datei-Explorer wieder schneller wirken zu lassen. Wie Windows Latest anmerkt, hilft diese Lösung aber nur beim ersten Start. Sind die Fenster erst geöffnet, kann es sich immer noch schwerfällig anfühlen, wenn Anwender sich durch Ordner mit Vorschaubildern wühlen oder das Kontextmenü öffnen.

Ein weiterer Kritikpunkt, der in sozialen Netzwerken immer wieder genannt wird: Das Preloading überdeckt am Ende Probleme, die sich aus einem veralteten technischen Grundgerüst ergeben.

Microsoft optimiert auch den Kern des Datei-Explorers

Am Kern des Datei-Explorers setzt Microsoft auch an, erklärt Tali Roth. Sie ist verantwortlich für den Bereich Windows Shell. Wie Roth auf X schildert, optimiert Microsoft etwa die Startsequenz, indem die Ladereihenfolge sowie kritische Pfade im Code des Datei-Explorers optimiert werden. Entfernt werden zudem unnötige Prozesse und visuelle Animationen, die Verzögerungen ausmachen. Und um generell die Geschwindigkeit des Datei-Explorers zu erhöhen, arbeitet man daran, unnötige Festplattenzugriffe und Hänger zu reduzieren.

Laut Windows Latest sind solche Maßnahmen tatsächliche Fortschritte, die den Datei-Explorer beschleunigen. Bis der Umstieg auf WinUI 3 abgeschlossen ist, verursacht die hybride Framework-Architektur eine zusätzliche Rechenlast. Die Optimierungen zeigen aber nur, dass Microsoft ernsthaft an dem Problem arbeite und es nicht nur mit zusätzlichen Hardware-Ressourcen – also mehr RAM-Verbrauch – erschlagen wolle.

Für die Allgemeinheit freigegeben werden die Datei-Explorer-Optimierungen laut Roth in den nächsten Monaten.

Explorer-Optimierungen in der aktuellen Preview Insider Build

Verbesserungen für den Datei-Explorer verteilt Microsoft auch über die aktuelle Windows 11 Preview Build 26300.8376 im Experimental-Kanal. So unterstützt die Adressleiste nun Pfade mit doppelten Backlashes sowie Anführungszeichen wie etwa C:\Users\user oder „C:\Users\user“. Verbessert wird auch die Lesbarkeit von Dateigrößen, indem diese in der Detailansicht mit der passenden Einheit angezeigt werden – also etwa KB, MB oder GB anstatt ausschließlich KB.

Microsoft setzt auch beim Umbenennen an. Reine Änderungen von Groß- und Kleinschreibung werden nun etwa sofort in der Ordneransicht übernommen.

All das sind Bestandteile von Microsofts Rundumerneuerung für Windows 11. Neben Performance-Verbesserungen zählen dazu auch Optimierungen bei der Benutzeroberfläche und der KI-Integration.

Apps & Mobile Entwicklung

Videospiele: Was macht einen Gamer aus und seid ihr einer?

Über 41 Millionen Gamer gibt es in Deutschland, berichtet diese Woche der Branchenverband game. Die allermeisten davon spielen vorwiegend auf dem Smartphone – aber sind es dann eurer Meinung nach überhaupt Gamer? Welche Kriterien definieren die Bezeichnung? Und was ist mit euch, seht ihr euch selbst als Gamer?

41 Millionen Gamer in Deutschland?

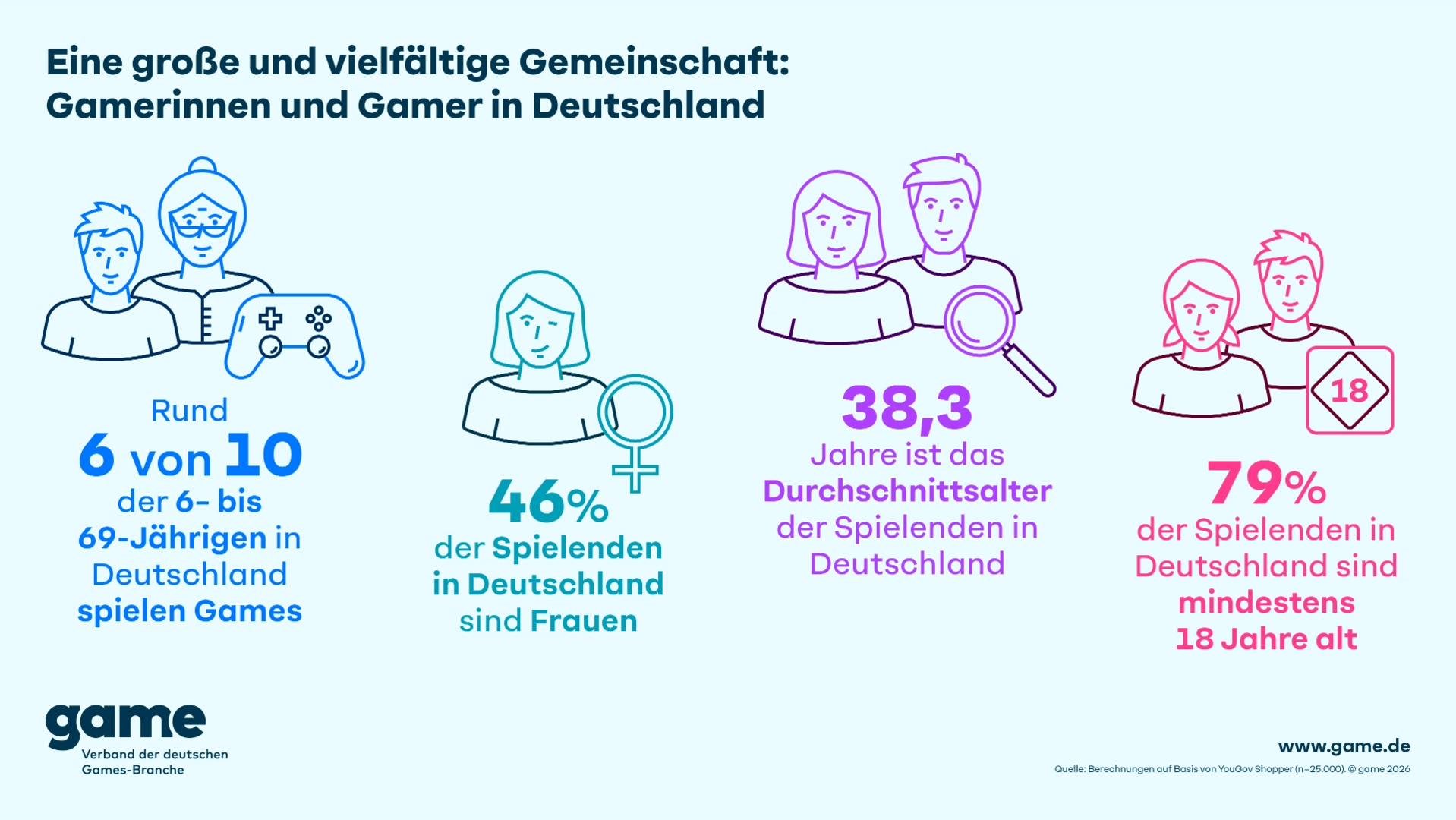

Nach Angaben des Branchenverbands game, die diese Woche publiziert wurden, spielen rund 41,2 Millionen Menschen zwischen 6 und 69 Jahren in Deutschland Videospiele. Das entspricht etwa sechs von zehn Personen in dieser Altersgruppe. Davon sind 46 Prozent Frauen, das Durchschnittsalter liegt bei 38,3 Jahren, und rund 79 Prozent der Spielenden sind volljährig.

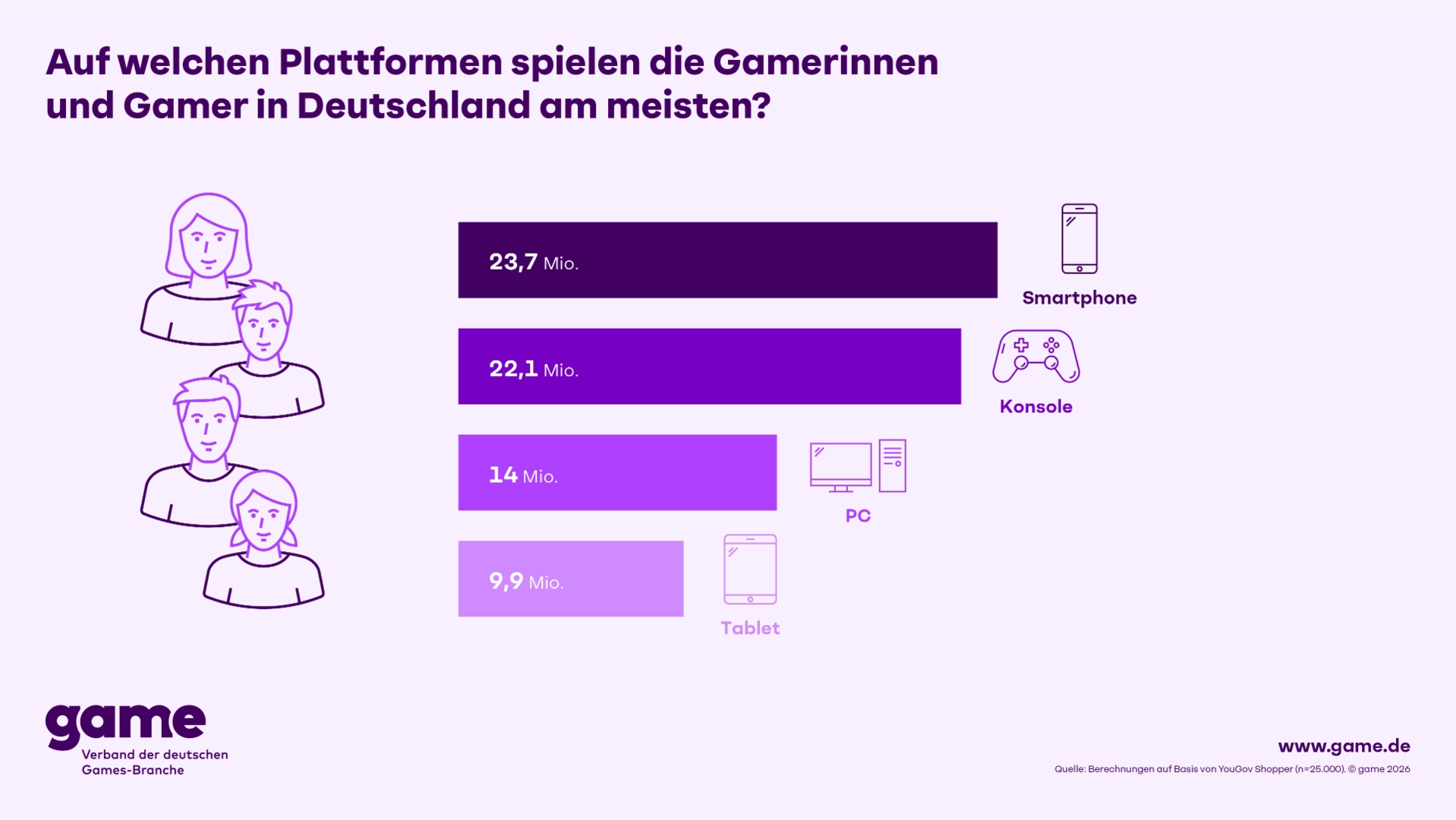

Das Thema wurde im Forum auf ComputerBase diese Woche reichlich diskutiert, denn der Blick auf die genutzten Plattformen zeigt deutliche Unterschiede. Mit 23,7 Millionen Spielern auf Smartphones und weiteren 9,9 Millionen auf Tablets entfällt ein Großteil auf mobile Geräte. Gefragt wurde an dieser Stelle aber nicht nach den Plattformen, auf denen überhaupt gespielt wird – sondern bloß nach der Plattform, auf die Spielerinnen und Spieler in Deutschland am meisten zurückgreifen.

Mit genau dieser Fragestellung beginnt auch die heutige Sonntagsfrage: Ausgehend von den gegebenen vier Kategorien, auf welcher der Plattformen spielt ihr am meisten?

-

PC oder Notebook

-

Spielkonsole

-

Smartphone

-

Tablet

Außen vor ist dabei die Information, auf welchen Plattformen die Spieler in Deutschland überhaupt unterwegs sind. Schließlich kann jemand, der zwar überwiegend am PC spielt, trotzdem auch auf der Konsole unterwegs sein. Wie sieht es also aus, wenn gefragt wird, auf welchen Plattformen ihr generell regelmäßig spielt?

-

PC oder Notebook

-

Spielkonsole

-

Smartphone

-

Tablet

Seid ihr Gamer?

Weiter geht es mit der Frage, ob ihr euch selbst als Gamer bezeichnen würdet – unabhängig davon, welche Kriterien ihr diesem Begriff selbst zugrunde legt.

-

Ja, ich sehe mich selbst als Gamer.

-

Na ja, früher ganz sicher einmal. Mittlerweile mag das streitbar sein.

-

Nein, ich bin ganz sicher kein Gamer.

Was macht jemanden zum Gamer?

Denn darum soll es nachfolgend gehen. Die Debatte wurde in den Kommentaren zum ursprünglichen Artikel bereits geführt, mit der heutigen Sonntagsfrage soll sie mit statistischen Daten unterfüttert werden. Welcher der nachfolgenden Kriterien sind für euch persönlich aussagekräftig, wenn es darum geht, eine Person als Gamer zu bezeichnen? Gerne könnt ihr eure Auswahl in den Kommentaren begründen.

-

Regelmäßig investierte Spielzeit

-

Finanzielles Investment

-

Plattform, auf der gespielt wird

-

Spielen auf mehreren Plattformen

-

Vorhandene Hardware

-

Art der Spiele, die gespielt werden

-

Vielfalt an gespielten Spielen oder Genres

-

Kritische Auseinandersetzung mit dem Medium

-

Kenntnisse über Gaming-Geschichte, Entwickler, Publisher und die Entwicklung verschiedener Genres

-

Einbindung und Engagement in Communities, Clans oder Vereinen

-

Teilhabe an der Gaming-Kultur (Berichterstattung, Messen, Streaming, Modding, Wettbewerbe, Analysen etc.)

-

Selbstidentifikation als Gamer

-

ein ganz anderes Kriterium, siehe meinen Kommentar im Forum

Abschließend hat sich die Redaktion einige – mitunter bewusst kontroverse – Thesen überlegt, die den Begriff „Gamer“ mehr oder weniger eng auslegen. Welchen dieser Aussagen würdet ihr zustimmen? Und welchen überhaupt nicht?

-

Gaming-Kultur findet in erster Linie auf dem PC und auf den Spielkonsolen statt.

-

Wer ausschließlich am Smartphone spielt, ist für mich kein Gamer.

-

Wer ausschließlich ein einziges Genre spielt, ist für mich kein Gamer.

-

Wer nur Multiplayer-Games spielt, ist kein richtiger Gamer.

-

Jemand, der nur Gelegenheitsspiele am Smartphone spielt, ist kein Gamer.

-

Ob jemand, der bloß am Smartphone spielt, ein Gamer ist, hängt von der Auswahl der Spiele ab.

-

Ob jemand, der am PC spielt, ein Gamer ist, hängt von der Auswahl der Spiele ab.

-

Ein echter Gamer spielt immer (auch) auf dem PC.

-

Jemand, der am PC spielt, aber nur Browser-Games, ist kein Gamer.

-

Jemand, der nur Call of Duty und Sportspiele auf der Konsole spielt, ist kein Gamer.

-

Wer regelmäßig Videospiele spielt, ist ein Gamer – ganz gleich, um welche Spiele auf welcher Plattform es geht.

-

Nur, wer sich bewusst selbst als Gamer sieht und Gaming als Hobby lebt, ist ein Gamer.

-

Gamer ist nur, wer sich auch abseits des aktiven Spielens mit diesem Thema auseinandersetzt.

-

Ich würde keiner dieser Aussagen zustimmen.

Die Debatte im Podcast

Zur Gamer-Definitionsfrage haben sich Jan und Fabian diese Woche auch schon im ComputerBase-Podcast CB-Funk geäußert. Das entsprechende Kapitel beginnt mit der 33. Minute. Weitere Themen waren der zehnte Geburtstag von Nvidias Grafikkarten-Serie GeForce GTX 10, Wolfgangs runderneuerte GPU-Benchmarks mit aktuellen GPUs und die massiven Internet-Probleme mit .de-Domains am Dienstagabend.

CB-Funk lässt sich nicht nur über den in dieser Notiz eingebetteten Podigee-Player abspielen, sondern auch bequem direkt in den Podcast-Apps eurer Wahl abonnieren und anhören. Verfügbar ist der ComputerBase-Podcast auf Spotify, Apple Podcasts, Amazon Music, Deezer und ebenso auf YouTube.

Mitmachen ist ausdrücklich erwünscht

Die Redaktion freut sich wie immer über fundierte und ausführliche Begründungen zu euren Entscheidungen in den Kommentaren zur aktuellen Sonntagsfrage. Wenn ihr persönlich ganz andere Ansichten vertretet, die von den bei den Umfragen im Artikel gegebenen Antwortmöglichkeiten nicht abgedeckt werden, könnt ihr davon ebenfalls im Forum berichten. Auch Ideen und Anregungen zu inhaltlichen Ergänzungen der laufenden oder zukünftigen Umfragen sind gerne gesehen.

Leser, die sich noch nicht an den vergangenen Sonntagsfragen beteiligt haben, können dies gerne nachholen, denn die Umfragen laufen stets über eine Dauer von 30 Tagen. Voraussetzung zur Teilnahme ist lediglich ein kostenloser ComputerBase-Account. Insbesondere zu den letzten Sonntagsfragen sind im Forum häufig nach wie vor spannende Diskussionen im Gange.

Die letzten zehn Sonntagsfragen in der Übersicht

Motivation und Datennutzung

Die im Rahmen der Sonntagsfragen erhobenen Daten dienen einzig und allein dazu, die Stimmung innerhalb der Community und die Hardware- sowie Software-Präferenzen der Leser und deren Entwicklung besser sichtbar zu machen. Einen finanziellen oder werblichen Hintergrund gibt es dabei nicht und auch eine Auswertung zu Zwecken der Marktforschung oder eine Übermittlung der Daten an Dritte finden nicht statt.

Apps & Mobile Entwicklung

007 First Light: IO Interactive nennt Ultra-Anforderungen für UHD mit 200 FPS

Am 27. Mai erscheint 007 First Light. Jetzt haben die Entwickler die vollständigen Systemanforderungen für den PC veröffentlicht, die hohe Grafikeinstellungen sowie höhere Auflösungen als Full HD abdecken und bis zu „200 FPS“ abdecken – mit DLSS 4.5 Multi Frame Generation. Von FSR oder XeSS ist aber weiterhin keine Rede.

UHD Ultra mit 200+ FPS?

Schon im Januar hat Hitman-Entwickler IO Interactive erste Systemanforderungen zum neuen Schieß- und Schleichspiel rund um den jungen James Bond bekanntgegeben. Damals ging es aber bloß um 30 bis 60 FPS in Full HD bei niedrigen bis mittleren Grafikeinstellungen. Jetzt folgen die Systemanforderungen für höhere Auflösungen in den Voreinstellungen Hoch bis Ultra. IO Interactive betont, dass in den ersten vier Profilen von Minimum bis Enthusiast kein Upsampling oder Frame Generation zum Einsatz käme, die Angaben gelten also für eine „native“ Ausgabe. Genannt wird überraschenderweise ausschließlich Last-Gen-Hardware, wenngleich für UHD mit 60 FPS im Hoch-Preset immerhin das einstige AMD-Topmodell Radeon RX 7900 XTX gefordert wird.

Alternativ soll es eine GeForce RTX 4080 sein, in jedem Fall werden in UHD aber 16 GB Grafikspeicher verlangt. Für Ultra-Grafikeinstellungen steigen die Anforderungen auf eine GeForce RTX 5080; ein Radeon-Pendant nennen die Entwickler nicht. Der Grund: Die „200+ FPS“, die IO Interactive für das Ultra-Profil spezifiziert, kommen nur mit DLSS 4.5 Multi Frame Generation zustande, wie es ausschließlich Nvidia-Grafikkarten der Blackwell-Generation beherrschen. Es handelt sich also um einen Griff in die Trickkiste, um höchste Grafikqualität in 007 First Light mit der RTX-50-Produktlinie des Technik-Partners Nvidia zu assoziieren.

IO Interactive macht Nvidia den Hof

Nvidia hat sich in den vergangenen Monaten bereits als Partner des James-Bond-Spiels in Stellung gebracht. So kommen zwei Trailer zur Technik und der Pathtracing-Grafik in 007 First Light etwa nicht von IO Interactive, sondern von Nvidia selbst. Darüber hinaus ist inzwischen das volle DLSS-4.5-Paket bestätigt, inklusive Upsampling, Dynamic Multi Frame Generation und Ray Reconstruction. Zu einer Unterstützung für AMD FSR oder Intel XeSS schweigen sich die Entwickler weiterhin aus.

Wie zuvor die Hitman-Spiele basiert 007 First Light auf der proprietären Glacier Engine, die IO Interactive für das neue Spiel „signifikant“ ausgebaut habe. Neben der Implementierung von Raytracing ist insbesondere auch von einem neuen System für volumetrische Rauch- und Nebeleffekte die Rede. Der Pathtracing-Modus soll zusammen mit Ray Reconstruction im „Sommer 2026“ nachgereicht werden.

In zweieinhalb Wochen geht es los

007 First Light erscheint am 27. Mai 2026 für den PC, die PlayStation 5, Xbox Series X|S und später für die Nintendo Switch 2. Erste Previews bescheinigen dem Spiel ein spaßiges Gameplay mit guter Qualität. Das James-Bond-Spiel schicke sich im Endeffekt an, ein gelungenes „Uncharted-like“ zu werden; große Innovationen gäbe es aber keine.

-

Künstliche Intelligenzvor 3 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview